Transformar um belo design do Figma em código funcional e operacional sempre foi uma daquelas dores de cabeça clássicas das equipas de produto. É um processo repleto de tradução manual, trocas intermináveis de mensagens entre designers e programadores, e aquela sensação incómoda de que as coisas poderiam ser muito mais rápidas. O sonho, claro, é que ferramentas de IA como o OpenAI Codex pudessem simplesmente olhar para um ficheiro do Figma e gerar código perfeito.

E, até certo ponto, esse sonho está a tornar-se realidade. Mas o que é realmente necessário para que isso aconteça?

Este guia é uma análise prática e direta das integrações do OpenAI Codex com o Figma. Vamos percorrer o "como fazer" oficial, mas, mais importante, vamos mergulhar na confusão do mundo real que a documentação geralmente ignora. Veremos o que é preciso para construir um fluxo de trabalho verdadeiramente fluido que não para no código, mas que se estende até ao suporte aos seus clientes.

O que são o OpenAI Codex e o Figma?

Antes de começarmos a conectá-los, vamos alinhar o conhecimento sobre os dois principais protagonistas desta história.

O que é o OpenAI Codex?

Provavelmente já ouviu falar do OpenAI Codex como o modelo de IA que alimenta o GitHub Copilot, a ferramenta que parece ler a sua mente enquanto programa. Na sua essência, o Codex é um sistema de IA da OpenAI que é incrivelmente bom a transformar linguagem natural, o simples inglês, em código em dezenas de linguagens.

Agora, um aviso rápido, mas importante: os modelos originais chamados "Codex" foram na verdade descontinuados em março de 2023. Atualmente, o termo "Codex" é frequentemente usado para se referir ao conjunto mais amplo de ferramentas de desenvolvimento da OpenAI, que inclui uma interface de linha de comando (CLI) e extensões para editores de código. Estas ferramentas modernas usam modelos GPT mais novos e potentes para realizar o trabalho. Portanto, quando falamos em integrar com o Figma, estamos a falar de nos conectarmos a este conjunto de ferramentas atual.

O que é o Figma?

Se está no mundo do produto ou do design, é quase certo que conhece o Figma. É a ferramenta de design colaborativa baseada na nuvem que se tornou praticamente o padrão da indústria para tudo, desde os primeiros wireframes até protótipos interativos completos e sistemas de design massivos.

Para os programadores, uma das adições mais revolucionárias foi o Dev Mode. É um espaço de trabalho específico dentro do Figma, construído para tornar a transição do design para o desenvolvimento menos dolorosa. Dá aos programadores acesso direto a medidas, especificações de CSS, recursos para download e até trechos de código prontos a copiar. Este foco em preencher a lacuna entre design e desenvolvimento torna-o um candidato perfeito para ser combinado com um assistente de codificação de IA.

A abordagem oficial: Como funcionam as integrações do OpenAI Codex com o Figma

Então, como fazer estas duas poderosas ferramentas comunicarem entre si? A magia técnica por trás de tudo isto depende de uma linguagem comum que ambas possam falar.

Compreender o Protocolo de Contexto do Modelo (MCP)

Tudo isto é construído sobre algo chamado Protocolo de Contexto do Modelo (MCP). É um padrão aberto que funciona basicamente como um adaptador universal para IA.

Pense nele como uma porta USB para modelos de IA. Uma porta USB permite ligar todo o tipo de dispositivos diferentes - um teclado, um rato, um disco rígido - e o seu computador simplesmente sabe o que fazer com eles. O MCP faz a mesma coisa para a IA. Fornece uma maneira padrão de "ligar" diferentes fontes de informação (como um ficheiro do Figma, um navegador web ou uma base de dados) para dar a um modelo de IA um contexto novo e em tempo real. Em vez de saber apenas aquilo em que foi treinado há meses, a IA pode agora ver e usar informações em direto de outras ferramentas.

O papel do servidor MCP do Figma

Para disponibilizar os seus dados de design a uma IA, o Figma executa o que é chamado de "servidor MCP". Este servidor é o portal que permite que qualquer ferramenta compatível com MCP, como as ferramentas de desenvolvimento Codex, extraia informações diretamente dos seus ficheiros do Figma. É assim que a IA consegue "ver" os seus designs.

De acordo com a documentação do Figma, existem algumas maneiras de se conectar a este servidor:

-

Servidor MCP de desktop: Este é executado localmente na sua máquina através da aplicação de desktop do Figma. É perfeito para um fluxo de trabalho onde pode clicar num componente no Figma e depois pedir à IA para o construir no seu editor de código.

-

Servidor MCP remoto: Este é um endereço web alojado ("https://mcp.figma.com/mcp") que permite que ferramentas e serviços baseados na nuvem se conectem diretamente sem a necessidade da aplicação de desktop estar em execução.

O objetivo final é bastante direto: dar à IA acesso direto às suas frames de design, componentes, variáveis de cor e especificações de layout. Com esse contexto, ela pode gerar código que não é apenas funcional, mas também perfeitamente alinhado com o seu sistema de design estabelecido.

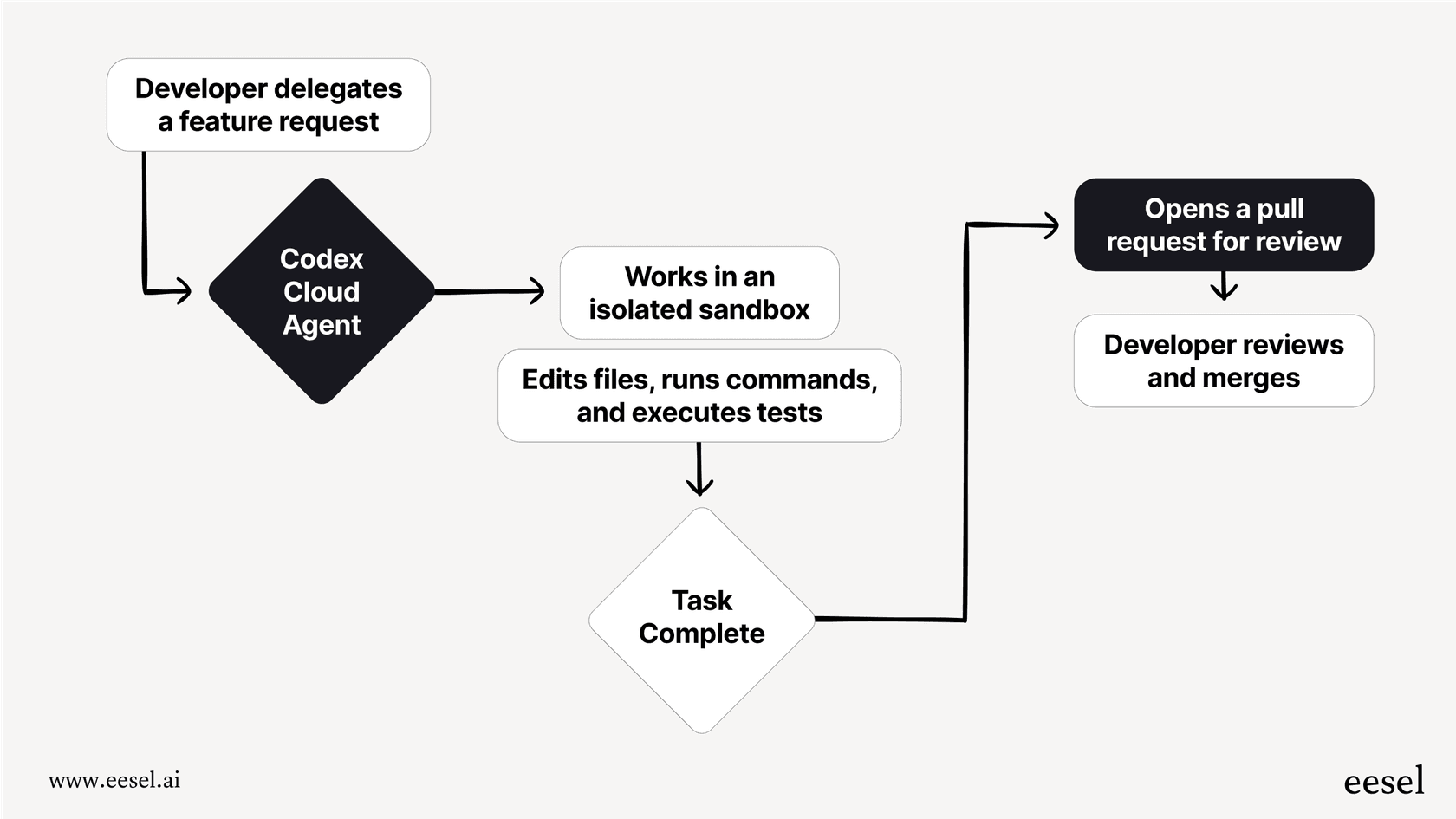

O fluxo de trabalho pretendido

No papel, o processo parece um sonho. Um programador conecta a sua ferramenta Codex (provavelmente a correr dentro de um editor como o VS Code) ao servidor MCP do Figma. Ele pega num link para uma frame específica num ficheiro do Figma, cola-o no seu editor e escreve um prompt como, "Cria-me um componente React com base neste design, e que seja pixel-perfect."

Como a IA pode aceder ao contexto do design através do servidor MCP, ela consegue ver os nomes dos componentes, extrair os códigos hexadecimais exatos das cores da sua marca, usar os tamanhos de fonte corretos e entender o espaçamento, tudo levando a um código incrivelmente preciso. Pelo menos, essa é a teoria. Pode encontrar a documentação oficial sobre isto no site de programadores da OpenAI.

A realidade das integrações do OpenAI Codex com o Figma: Porque são complexas

Embora o fluxo de trabalho oficial pareça limpo e simples, a realidade no terreno é... bem, muito mais confusa. Esta configuração está longe de ser uma instalação de um clique e é realmente acessível apenas para programadores que estão muito confortáveis a trabalhar nos bastidores.

Uma análise do processo de configuração no mundo real

Se pesquisar em fóruns da comunidade, verá rapidamente a desconexão entre a documentação oficial e a experiência do mundo real. Um ótimo exemplo é este tópico no Reddit onde programadores partilham os obstáculos que enfrentaram. O processo não é apenas "ligar"; muitas vezes envolve uma série de passos não óbvios que não são mencionados nos guias principais:

-

Configuração manual: Tem de encontrar e editar manualmente um ficheiro de configuração chamado "config.toml" na sua máquina apenas para dizer à ferramenta Codex que o servidor do Figma sequer existe.

-

CLI para autenticação: Mesmo que queira apenas usar a prática extensão do VS Code, não pode. Primeiro tem de abrir o seu terminal e usar a interface de linha de comando (CLI) para autenticar a sua conta.

-

Gestão de tokens: Também precisará de ir às suas configurações do Figma, gerar um token de acesso pessoal (basicamente uma palavra-passe única para aplicações) e depois descobrir como configurá-lo como uma variável de ambiente para que as ferramentas se possam conectar de forma segura.

Isto está muito longe da experiência simples e amigável que se poderia esperar. Requer um nível de conforto sólido com a linha de comando, edição de ficheiros de configuração e manuseamento de chaves de API, o que a coloca imediatamente fora do alcance da maioria dos designers, gestores de produto e até de alguns programadores.

As limitações de uma abordagem apenas de código

Vamos supor que ultrapassa a configuração complicada e consegue pô-la a funcionar. Isso é uma grande vitória! Mas resolve apenas uma parte muito específica do puzzle do desenvolvimento de produtos: transformar um design estático em código inicial. Não ajuda em nada com tudo o que vem depois.

-

Suporte contínuo: A funcionalidade está ativa e os clientes começam a usá-la. O que acontece quando eles têm perguntas? A sua equipa de suporte está agora na linha da frente, mas não tem uma ligação direta ao contexto do design ou do desenvolvimento.

-

Conhecimento interno: Como é que as suas equipas internas se atualizam? Os seus agentes de suporte ao cliente, engenheiros de vendas e a equipa de marketing precisam de entender como a nova funcionalidade funciona, mas não vão andar a vasculhar código ou ficheiros do Figma para descobrir.

-

Acessibilidade: Todo este fluxo de trabalho é construído por programadores, para programadores. Exclui completamente gestores de produto, líderes de suporte e designers que poderiam obter imenso valor da automação com IA, mas que não passam os seus dias dentro de um editor de código.

Uma forma melhor: Unificar o conhecimento para além do ficheiro de design

Um fluxo de trabalho eficiente precisa de uma IA que compreenda o ciclo de vida inteiro do produto, não apenas um único ficheiro do Figma. Enquanto a integração do Codex está focada em transformar um design em código, uma plataforma como a eesel AI foi construída para automatizar o suporte e a gestão de conhecimento interno que acontece depois de a funcionalidade ser construída.

Em vez de se conectar apenas a uma ferramenta de design, a eesel AI liga-se ao cérebro inteiro da sua empresa:

-

Help desks: Pode aprender com anos de conversas passadas no Zendesk e Freshdesk.

-

Wikis internos: Absorve instantaneamente toda a sua documentação de locais como Confluence, Google Docs e Notion.

-

Ferramentas de chat: Pode implementar assistentes de IA úteis diretamente onde as suas equipas (e clientes) já estão, como no Slack ou no Microsoft Teams.

É aqui que a diferença se torna realmente clara. A configuração complexa e pesada para programadores do Codex e do Figma é o oposto polar da plataforma de autoatendimento da eesel AI, onde um gestor de suporte não técnico pode construir, testar e lançar um poderoso agente de IA em minutos. Sem programação, sem ficheiros de configuração.

Preços e disponibilidade

Ok, vamos falar sobre quanto custa ter acesso a estas ferramentas. Compreender os preços e os requisitos dos planos é bastante importante para decidir se esta integração é sequer uma boa opção para a sua equipa.

Preços do OpenAI Codex

Este é um pouco vago. A OpenAI não tem um preço público e autónomo para a ferramenta de desenvolvimento Codex em si. O acesso é geralmente incluído com outros serviços. Por exemplo, faz parte do que faz o GitHub Copilot funcionar (que tem a sua própria subscrição mensal), ou o seu uso é cobrado contra os seus créditos gerais de API se estiver a usar os modelos subjacentes diretamente.

Preços do Figma

Para o Figma, as coisas são muito mais claras. Para usar o servidor MCP de forma significativa, vai precisar de um plano pago com uma licença de Desenvolvedor ou Completa. Os utilizadores do plano gratuito estão limitados a apenas seis chamadas de ferramentas por mês, o que é basicamente nada se estiver a tentar fazer trabalho de desenvolvimento real.

Aqui está um resumo rápido dos planos relevantes do Figma:

| Plano | Preço (por editor/mês, faturação anual) | Funcionalidades Chave para Programadores |

|---|---|---|

| Professional | $12 | Funcionalidades completas de design e prototipagem. |

| Organization | $45 | Sistemas de design, segurança avançada e controlos de administração. |

| Enterprise | $75 | Segurança escalável, suporte dedicado e controlos. |

A conclusão aqui é que a capacidade de conectar o Figma a um assistente de codificação de IA é uma funcionalidade premium, reservada para clientes pagantes nos planos de nível superior.

Do design-para-código ao design-para-suporte

As integrações do OpenAI Codex com o Figma representam uma fronteira fascinante, poderosa, mas muito técnica no desenvolvimento assistido por IA. Para os programadores dispostos a arregaçar as mangas, a conexão MCP direta é uma ferramenta promissora que pode definitivamente acelerar o processo inicial de codificação. No entanto, ainda é complexa de configurar e aborda apenas uma pequena fatia do desafio muito maior do ciclo de vida do produto.

O futuro deste espaço não é apenas sobre gerar código mais rapidamente. É sobre construir um ecossistema conectado onde o conhecimento flui sem problemas de um ficheiro de design, para o editor do programador e, finalmente, para a equipa de suporte ao cliente que ajuda pessoas reais a usar o produto final. Para equipas que querem automatizar toda essa cadeia sem dedicar tempo de programação à tarefa, é necessária uma abordagem diferente.

O caminho mais inteligente para a automação do fluxo de trabalho

Em vez de passar dias a lutar com ferramentas de linha de comando e ficheiros ".toml" obscuros, e se pudesse automatizar o suporte ao cliente para a sua nova funcionalidade no tempo que leva para beber um café?

A eesel AI oferece uma plataforma de autoatendimento radicalmente mais simples que faz exatamente isso. Conecta todas as suas fontes de conhecimento dispersas para alimentar agentes de IA que podem lidar com questões de suporte de primeira linha, assistir os seus agentes humanos com problemas complexos e triar automaticamente os tickets recebidos. O melhor de tudo é que tem um poderoso modo de simulação, que lhe permite testar a sua IA em milhares dos seus próprios tickets de suporte históricos. Pode ver exatamente qual seria a sua taxa de resolução antes de a ativar para os clientes. Trata-se de automação confiante e sem riscos.

Pronto para automatizar mais do que apenas código? Experimente a eesel AI gratuitamente e veja como é fácil construir um agente de IA que entende todo o seu negócio.

Perguntas frequentes

O que são exatamente as integrações do OpenAI Codex com o Figma e que problema visam resolver para as equipas de produto?

As integrações do OpenAI Codex com o Figma visam automatizar o processo de conversão de ficheiros de design em código funcional. Elas abordam o desafio comum da tradução manual e da comunicação constante entre designers e programadores, acelerando a geração inicial de código a partir de designs do Figma.

Como funcionam as integrações do OpenAI Codex com o Figma a um nível técnico para gerar código a partir de designs?

Tecnicamente, as integrações do OpenAI Codex com o Figma utilizam o Protocolo de Contexto do Modelo (MCP). O Figma fornece um servidor MCP que permite que as ferramentas de desenvolvimento do Codex acedam diretamente aos dados de design dos ficheiros do Figma. Isso dá à IA um contexto em tempo real dos designs para gerar o código correspondente.

Quais são as complexidades ou obstáculos do mundo real ao configurar as integrações do OpenAI Codex com o Figma?

Na realidade, a configuração das integrações do OpenAI Codex com o Figma envolve uma configuração manual significativa. Os utilizadores muitas vezes precisam de editar ficheiros de configuração, usar uma interface de linha de comando para autenticação e gerir tokens de acesso pessoal a partir das configurações do Figma. Requer familiaridade com ferramentas de desenvolvimento avançadas.

Quais as limitações que uma equipa deve ter em conta ao considerar as integrações do OpenAI Codex com o Figma para o seu fluxo de trabalho?

A principal limitação é que as integrações do OpenAI Codex com o Figma estão focadas unicamente na geração de código inicial a partir de designs. Elas não abordam aspetos mais amplos do ciclo de vida do produto, como suporte contínuo ao cliente, gestão de conhecimento interno ou acessibilidade para não-programadores.

Quais são os requisitos de preço para equipas interessadas em usar as integrações do OpenAI Codex com o Figma?

Para as ferramentas Codex da OpenAI, o preço está normalmente associado a créditos de uso de API ou incluído em serviços como o GitHub Copilot. Para o Figma, o uso do servidor MCP para estas integrações requer um plano pago com uma licença de Desenvolvedor ou Completa, já que o plano gratuito oferece chamadas de ferramentas muito limitadas.

Uma vez que os modelos originais do Codex foram descontinuados, como é que isso afeta as atuais integrações do OpenAI Codex com o Figma?

Apesar de os modelos originais "Codex" terem sido descontinuados, as atuais integrações do OpenAI Codex com o Figma aproveitam o conjunto mais amplo de ferramentas de desenvolvimento da OpenAI. Estas ferramentas modernas utilizam agora modelos GPT mais recentes e potentes para converter linguagem natural em código, garantindo que a funcionalidade permanece relevante.