Soyons honnêtes, l'IA générative fait le buzz partout. Mais pour la plupart des entreprises, cet enthousiasme s'arrête net lorsqu'il s'agit de réellement construire quelque chose. Transformer un prototype d'IA sympa en une véritable application sur laquelle les clients peuvent compter est un immense pas en avant. Soudain, vous vous inquiétez des performances, de la fiabilité et des coûts qui peuvent exploser sans crier gare.

Construire et faire évoluer une application d'IA n'est pas seulement compliqué ; cela nécessite une fondation spécialisée pour fonctionner correctement. C'est exactement le problème que Fireworks AI a été créé pour résoudre. C'est une plateforme conçue pour gérer tout le travail lourd côté infrastructure, afin que les développeurs puissent cesser de se battre avec les serveurs et se concentrer sur la création d'excellents produits d'IA.

Dans cet article, nous vous présenterons tout ce que vous devez savoir sur Fireworks AI. Nous détaillerons ses fonctionnalités principales, expliquerons sa tarification et discuterons de son public cible. Nous aborderons également ses limites et explorerons pourquoi, pour certaines équipes, un type d'outil d'IA complètement différent pourrait être bien plus adapté.

Qu'est-ce que Fireworks AI ?

Au fond, Fireworks AI est une plateforme pour créer et exécuter des applications d'IA générative sur une immense bibliothèque de modèles open-source. Considérez-le comme le moteur haute performance d'une application d'IA. Il gère toute l'infrastructure complexe en arrière-plan pour que les développeurs puissent se concentrer sur ce que leur application fait réellement.

L'histoire de l'entreprise en dit long sur ses compétences techniques. Elle a été fondée par certains des innovateurs originaux de Meta AI qui ont contribué à la création de PyTorch, l'un des frameworks d'IA open-source les plus populaires au monde. Selon un article sur le blog de Google Cloud, les fondateurs savaient que les entreprises auraient du mal à déployer l'IA à grande échelle et y ont vu une opportunité d'aider.

L'argument principal de Fireworks AI est de fournir « le moteur d'inférence d'IA générative le plus rapide et le plus efficace à ce jour ». En termes simples, ils fournissent la vitesse et la puissance brutes nécessaires pour exécuter des modèles d'IA complexes sans faire attendre vos utilisateurs. Il est important de se rappeler que Fireworks AI est une couche d'infrastructure, pas un produit fini. Les développeurs utilisent son API pour alimenter leurs propres outils, qu'il s'agisse d'un bot de support client, d'un assistant de codage ou d'un moteur de recherche pour toute l'entreprise.

Fonctionnalités clés de Fireworks AI

La plateforme Fireworks AI repose sur trois idées principales qui soutiennent tout le cycle de vie d'un modèle d'IA, d'une simple expérience à la desserte de millions de personnes.

Un moteur d'inférence ultra-rapide

Alors, qu'est-ce qu'un « moteur d'inférence » exactement ? C'est le système qui prend un modèle d'IA entraîné et l'exécute pour générer une réponse, comme répondre à une question ou créer une image. La vitesse de ce moteur est essentielle pour une application en temps réel. Personne ne veut utiliser un chatbot qui met dix secondes à répondre.

Fireworks AI s'est forgé une réputation de rapidité (faible latence) et de capacité à gérer un grand nombre de requêtes simultanément (débit élevé). Ils traitent plus de 140 milliards de tokens chaque jour et maintiennent une disponibilité de l'API de 99,99 %, ce qui signifie que les applications de leurs clients sont constamment réactives et fiables. Ils y parviennent grâce à des logiciels hautement optimisés fonctionnant sur le matériel le plus récent, comme des GPU NVIDIA haut de gamme.

Une immense bibliothèque de modèles open-source

L'un des meilleurs atouts de Fireworks AI est son engagement envers la communauté open-source. Au lieu de vous enfermer dans leur propre modèle propriétaire, ils vous donnent un accès instantané à une immense bibliothèque de modèles open-source populaires. Cela donne aux développeurs la liberté de choisir le modèle parfait pour leur projet, de le modifier et d'éviter de se retrouver coincés avec un seul fournisseur.

Vous pouvez trouver des modèles bien connus comme Llama 3 de Meta, Gemma de Google, Mixtral 8x22B et Qwen, tous prêts à l'emploi avec un simple appel d'API. Cela vous évite le casse-tête énorme de télécharger, configurer et gérer les puissants GPU nécessaires pour exécuter ces modèles vous-même.

Gestion complète du cycle de vie des modèles d'IA

Fireworks AI vous offre des outils pour chaque étape du processus de création :

-

Construire : Les développeurs peuvent passer d'une idée à un modèle fonctionnel en quelques minutes seulement. La plateforme met en place toute l'infrastructure GPU, vous pouvez donc commencer à expérimenter avec les prompts et obtenir des résultats immédiatement.

-

Ajuster : Vous pouvez utiliser un processus appelé fine-tuning pour entraîner un modèle de base sur vos propres données. Cela aide l'IA à apprendre le jargon spécifique de votre entreprise, la voix de votre marque ou vos connaissances internes, ce qui conduit à des réponses bien meilleures et plus pertinentes.

-

Mettre à l'échelle : À mesure que votre application gagne en popularité, Fireworks AI gère la mise à l'échelle pour vous. Que vous ayez dix utilisateurs ou dix millions, l'infrastructure ajoute automatiquement plus de ressources pour gérer les pics de trafic sans que vous ayez à faire quoi que ce soit.

Explication de la tarification de Fireworks AI

Fireworks AI a un modèle de tarification assez flexible, basé sur l'utilisation, qui convient à tout le monde, du développeur solo qui bricole le week-end à la grande entreprise ayant des besoins sérieux en IA. Leur tarification, que nous avons extraite de leur page de tarification officielle, est divisée en trois types principaux.

Tarification de l'inférence sans serveur

Il s'agit d'un plan de paiement à l'utilisation simple où vous êtes facturé par « token » (un morceau de texte, d'environ quatre caractères) que l'IA traite. C'est un excellent moyen de démarrer, de créer des prototypes ou d'exécuter des applications avec un trafic imprévisible, car vous ne payez que pour ce que vous utilisez exactement.

Voici un aperçu rapide de leurs prix sans serveur pour certains modèles populaires :

| Catégorie du modèle de base | Prix par million de tokens |

|---|---|

| Moins de 4 milliards de paramètres | 0,10 $ |

| 4 milliards - 16 milliards de paramètres | 0,20 $ |

| Plus de 16 milliards de paramètres | 0,90 $ |

| Paramètres MoE 56,1 milliards - 176 milliards | 1,20 $ |

| Meta Llama 3.1 405B | 3,00 $ |

| Kimi K2 Instruct | 0,60 $ en entrée, 2,50 $ en sortie |

Il est bon de savoir que pour certains des modèles les plus sophistiqués, le prix des tokens d'entrée (ce que vous envoyez à l'IA) peut être différent du prix des tokens de sortie (ce que l'IA renvoie).

Tarification du fine-tuning

Cette tarification s'applique lorsque vous souhaitez personnaliser un modèle avec vos propres données. Vous êtes facturé en fonction du nombre de tokens utilisés pendant la tâche d'entraînement. Une fois votre modèle affiné, vous payez le même tarif pour l'exécuter que pour le modèle de base d'origine.

| Taille du modèle de base | Prix par million de tokens d'entraînement |

|---|---|

| Jusqu'à 16 milliards de paramètres | 0,50 $ |

| 16,1 milliards - 80 milliards de paramètres | 3,00 $ |

| >300 milliards de paramètres | 10,00 $ |

Tarification à la demande

Pour les applications nécessitant des performances constantes et intensives, l'option à la demande est généralement la plus économique. Au lieu de payer par token, vous payez à la seconde pour un accès dédié à un GPU. C'est parfait pour les applications à fort volume car cela offre généralement de meilleures performances et des coûts inférieurs au plan sans serveur.

| Type de GPU | Prix par heure (facturé à la seconde) |

|---|---|

| GPU A100 80 Go | 2,90 $ |

| GPU H100 80 Go | 4,00 $ |

| GPU H200 141 Go | 6,00 $ |

À qui s'adresse Fireworks AI ? (Et à qui ne s'adresse-t-il pas ?)

Fireworks AI est une plateforme extrêmement puissante, mais sa concentration intense sur l'infrastructure signifie qu'elle est conçue pour un public très spécifique. Savoir si vous faites partie de ce groupe est la clé pour décider si c'est le bon choix pour vous.

L'utilisateur idéal : développeurs IA et entreprises

L'utilisateur visé par Fireworks AI est assez clair : les startups axées sur l'IA, les grandes entreprises avec des équipes de machine learning dédiées, et tout développeur créant une application d'IA personnalisée à partir de zéro.

Leur plateforme est conçue pour alimenter des choses comme :

-

Chatbots avancés et IA de support client

-

Génération de code et outils d'assistance aux développeurs

-

Recherche interne sophistiquée et résumé de documents

-

Agents IA complexes et multi-étapes

Ces utilisateurs ont besoin de contrôle, de performances brutes et de la scalabilité qu'une plateforme comme Fireworks AI offre. Ils sont à l'aise avec les API, l'affinage des modèles et l'intégration d'un puissant moteur d'IA dans un produit plus grand et personnalisé.

La principale limite : pas un outil prêt à l'emploi pour les équipes métier

C'est probablement la chose la plus importante à comprendre : Fireworks AI est un moteur, pas une voiture finie. Il vous donne toute la puissance que vous pourriez désirer, mais vous devez construire le reste du véhicule vous-même.

Cela signifie que vous avez besoin de beaucoup d'expertise technique, de temps de développement et d'un budget pour la maintenance continue. Un responsable du support client ou un responsable informatique ne peut pas simplement appuyer sur un interrupteur et voir Fireworks AI résoudre ses problèmes. Ce n'est tout simplement pas conçu pour ça. C'est une plateforme pour développeurs, pas une application métier.

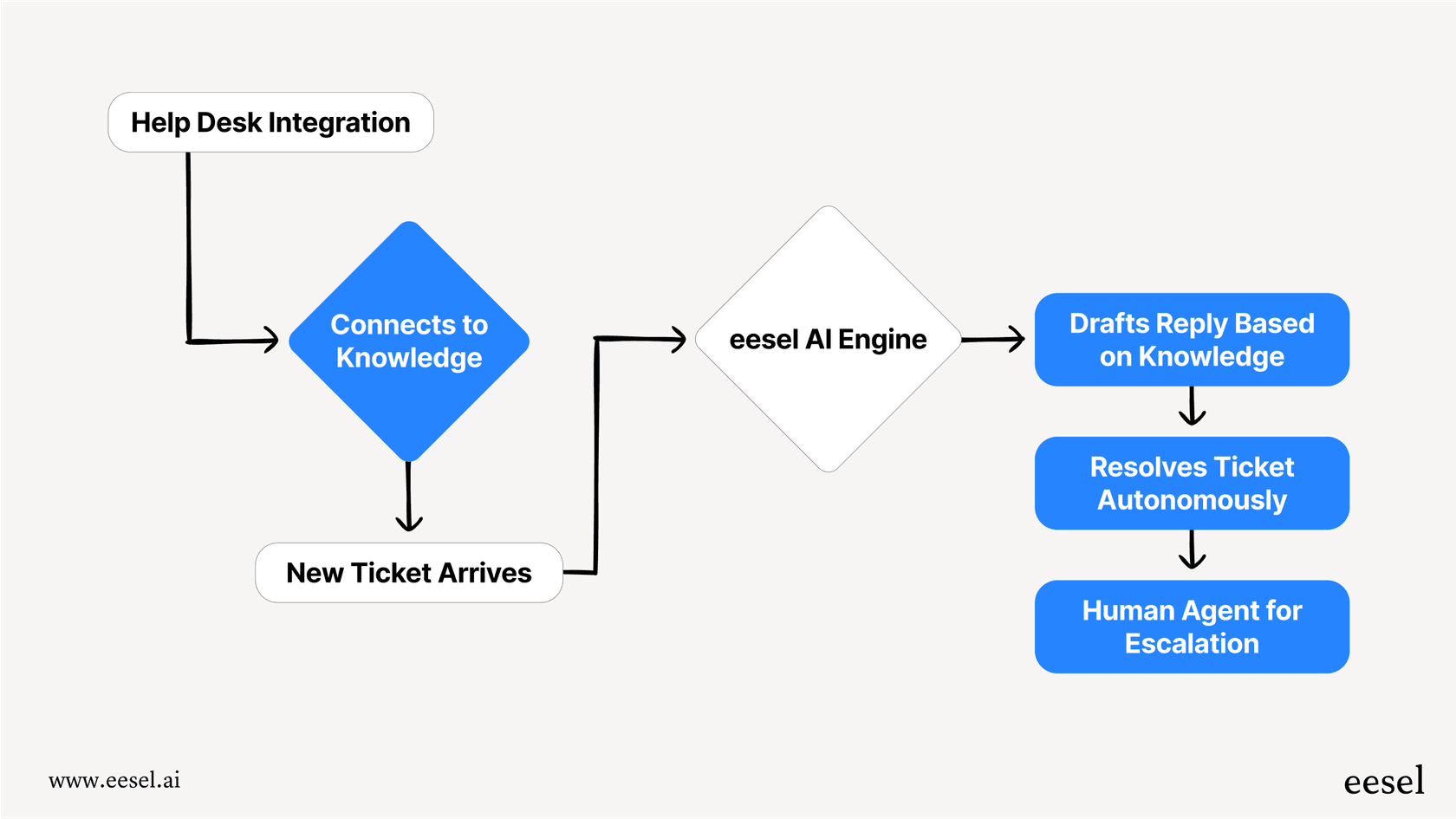

Pour les équipes métier qui ont besoin d'une solution d'IA dès maintenant, sans embaucher une escouade d'ingénieurs, une plateforme prête à l'emploi comme eesel AI est une voie beaucoup plus directe. Ces outils sont conçus pour un travail entièrement différent : résoudre des problèmes métier spécifiques dès leur sortie de la boîte.

Voici où un outil comme eesel AI se démarque :

-

Soyez opérationnel en quelques minutes, pas en quelques mois. eesel AI est entièrement en libre-service et dispose d'intégrations en un clic avec les outils que votre équipe utilise déjà, comme Zendesk, Freshdesk et Slack. Vous pouvez avoir un agent IA fonctionnel qui traite de vraies questions de clients dans le temps qu'il faut pour lire la documentation de l'API.

-

Pas besoin de tout changer. Au lieu de vous forcer à construire quelque chose de nouveau, eesel AI se connecte directement à votre centre d'aide et à vos flux de travail actuels. Il rend simplement plus intelligents les outils que votre équipe sait déjà utiliser.

-

Conçu pour les utilisateurs professionnels. eesel AI est spécialement conçu pour le service client et le support interne. Il apprend automatiquement de vos anciens tickets de support, des articles de votre centre d'aide et de vos bases de connaissances comme Confluence ou Google Docs pour donner des réponses précises et pertinentes dès le premier jour.

Le processus entier est différent. Avec Fireworks AI, un développeur crée une application personnalisée à l'aide d'une API. Avec eesel AI, un responsable de support utilise un tableau de bord simple pour connecter ses outils et activer l'IA.

Notre verdict final sur Fireworks AI

Fireworks AI est, sans aucun doute, une plateforme d'infrastructure d'IA de premier plan. Elle tient absolument sa promesse de vitesse, de scalabilité et de flexibilité. Pour les développeurs et les entreprises qui créent des produits d'IA personnalisés, c'est un choix fantastique.

Si vous avez une équipe d'ingénieurs et une vision pour un outil unique alimenté par l'IA, Fireworks AI vous offre le meilleur moteur de sa catégorie pour y parvenir. Ses performances et sa bibliothèque de modèles offrent tout ce dont vous avez besoin pour construire quelque chose de spécial.

Toutefois, ce n'est pas une solution prête à l'emploi pour les départements métiers comme le support client ou l'informatique. La complexité et l'expertise requises en font le mauvais outil pour les équipes qui veulent simplement automatiser leur travail. Vous n'achèteriez pas un moteur à réaction juste pour aller faire les courses.

La conclusion est la suivante : choisissez Fireworks AI si vous construisez l'avenir de l'IA. Mais pour résoudre vos problèmes métier avec l'IA aujourd'hui, recherchez un outil conçu pour votre flux de travail spécifique.

Commencez dès aujourd'hui avec l'IA pour le support client

Le choix du bon outil d'IA dépend vraiment de votre objectif. Si vous construisez des produits d'IA fondamentaux qui façonneront le marché pour les années à venir, un moteur comme Fireworks AI est indispensable.

Mais si votre objectif est d'automatiser le support client, d'aider vos agents et d'offrir une meilleure expérience à vos clients dès maintenant, alors vous avez besoin d'une solution spécialement conçue. Pour cela, eesel AI est conçu de A à Z pour vous donner des résultats sans écrire une seule ligne de code.

Vous pouvez utiliser son mode de simulation pour voir exactement combien de vos anciens tickets auraient pu être résolus automatiquement. Vous pouvez connecter toutes vos sources de connaissances dispersées en quelques clics. Et vous pouvez mettre en service un agent IA entièrement fonctionnel qui travaille dans votre centre d'aide existant en quelques minutes, pas en quelques mois.

Questions fréquemment posées

Fireworks AI est une plateforme d'infrastructure haute performance conçue pour créer et exécuter des applications d'IA générative. Elle s'attaque aux complexités du déploiement et de la mise à l'échelle des modèles d'IA, permettant aux développeurs de se concentrer sur la création de la logique de l'application plutôt que sur la gestion des serveurs.

Fireworks AI donne accès à une immense bibliothèque de modèles open-source populaires, notamment Llama 3 de Meta, Gemma de Google, Mixtral 8x22B et Qwen. Cet engagement envers l'open-source offre aux développeurs une grande flexibilité dans le choix et la personnalisation des modèles pour leurs projets.

No, Fireworks AI est principalement une couche d'infrastructure conçue pour les développeurs d'IA et les équipes de machine learning en entreprise. Elle nécessite une expertise technique pour l'intégration via des API et la création d'applications personnalisées, ce qui la rend inadaptée aux utilisateurs métier non techniques à la recherche de solutions prêtes à l'emploi.

Fireworks AI propose une tarification flexible basée sur l'utilisation selon trois modèles principaux : l'inférence sans serveur (paiement par token), le fine-tuning (paiement par token d'entraînement) et à la demande (paiement à la seconde pour un accès dédié à un GPU). La meilleure option dépend de votre volume d'utilisation et de vos besoins spécifiques.

Les développeurs bénéficient d'un déploiement beaucoup plus rapide, d'un accès instantané à une vaste bibliothèque de modèles open-source et de capacités de mise à l'échelle automatique. Fireworks AI simplifie les complexités de la gestion des GPU et de l'infrastructure, permettant aux équipes de se concentrer uniquement sur l'innovation en IA.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.

Fireworks AI utilise un moteur d'inférence ultra-rapide optimisé avec des logiciels très efficaces et des GPU NVIDIA haut de gamme. Cette architecture garantit une faible latence et un débit élevé, permettant des réponses en temps réel et le traitement de milliards de tokens par jour.