O mundo da IA está a avançar a um ritmo vertiginoso. Quando pensamos que já dominamos o GPT-4, a OpenAI lança o GPT-4 Turbo e parece que voltamos à estaca zero. Se está a tentar perceber qual destes modelos faz realmente sentido para o seu negócio, não está sozinho. É um pouco como se lhe pedissem para escolher um motor sem saber que tipo de carro está a tentar construir.

A resposta simples é que não existe um modelo único que seja o "melhor" para todos. A escolha certa é um ato de equilíbrio, uma troca constante entre velocidade, inteligência e custo. Este guia está aqui para analisar as diferenças do mundo real entre o GPT-3.5, o GPT-4 e o GPT-4 Turbo, para que possa tomar uma decisão que se ajuste ao que realmente precisa de fazer.

Mas aqui fica um pequeno spoiler: o modelo é apenas o motor. O verdadeiro poder vem de o conectar às ferramentas e dados da sua empresa. Afinal, a IA mais inteligente do planeta é praticamente inútil se não conseguir aceder à sua base de conhecimento interna para dar uma resposta relevante.

O que são os modelos GPT da OpenAI?

Antes de entrarmos nos pormenores, vamos garantir que estamos todos na mesma página. "GPT" significa Generative Pre-trained Transformer. Em português claro, são enormes modelos de linguagem que foram treinados com uma quantidade massiva de texto e dados da internet. Este treino permite-lhes compreender o contexto, gerar texto semelhante ao humano e alimentar ferramentas como o ChatGPT.

O que é o GPT-3.5?

O GPT-3.5 é o burro de carga fiável do grupo. É o motor que alimenta a versão gratuita do ChatGPT e foi construído para duas coisas: velocidade e acessibilidade. Para tarefas diretas e de alto volume, é uma ótima opção. Consegue lidar com perguntas e respostas básicas, resumir textos e seguir instruções simples sem grande esforço. Onde é que fica aquém? Pode tropeçar em raciocínios complexos, instruções subtis ou tarefas que exigem muita nuance.

O que é o GPT-4?

O GPT-4 é o modelo premium, topo de gama. É o cérebro por trás do ChatGPT Plus e representou um enorme salto em termos de inteligência. O GPT-4 brilha quando lhe apresentamos problemas complexos, desde escrita criativa e instruções com vários passos até à análise de dados e escrita de código. As suas respostas são muito mais sofisticadas e precisas. A desvantagem? Todo esse poder de processamento tem um custo. O GPT-4 é visivelmente mais lento e mais caro de usar do que o seu antecessor.

O que é o GPT-4 Turbo?

O GPT-4 Turbo é a tentativa de obter o melhor de dois mundos. Foi construído para oferecer a inteligência de ponta do GPT-4, mas com melhorias significativas em velocidade e custo. Também vem com algumas atualizações massivas: uma "janela de contexto" muito maior (já lá vamos) e dados de treino mais atualizados. Para a maioria das empresas hoje em dia, o GPT-4 Turbo é a escolha prática, atingindo um ponto de equilíbrio ideal entre potência, desempenho e preço.

Velocidade e desempenho

Num contexto empresarial, especialmente quando se tem clientes à espera, a velocidade não é apenas uma vantagem, é tudo. Um cliente a olhar para um chatbot a "pensar" durante 30 segundos é um cliente que está prestes a ficar frustrado e a ir embora.

Eis como os modelos se comparam no teste de velocidade:

-

GPT-3.5: O campeão indiscutível da velocidade. É rápido e responsivo.

-

GPT-4 Turbo: Muito mais rápido que o GPT-4 original, tornando-o um forte concorrente para conversas em tempo real.

-

GPT-4: O mais lento dos três. As pessoas costumam dizer que as suas respostas parecem mais "ponderadas", mas numa conversa ao vivo, isso traduz-se apenas em atraso.

Mas a questão é esta: uma resposta rápida que está errada é pior do que uma resposta um pouco mais lenta que realmente ajuda. Quando se trata de apoio ao cliente, é preciso equilibrar a velocidade com a fiabilidade. Um bot que cospe respostas erradas instantaneamente apenas cria mais trabalho de limpeza para os seus agentes humanos.

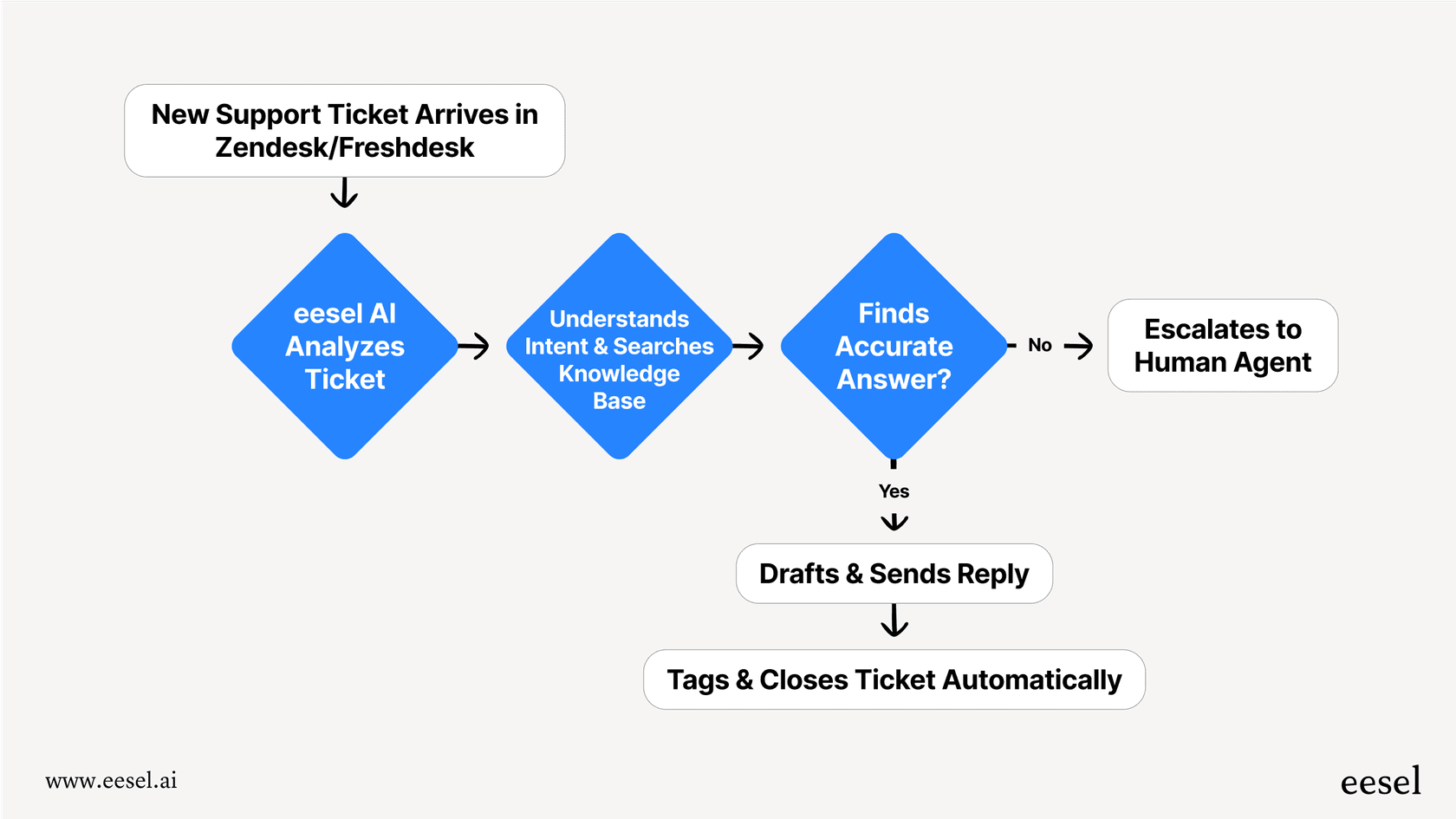

É aqui que ter apenas um modelo não é suficiente. Por exemplo, um agente de suporte de IA da eesel AI faz mais do que apenas chamar uma API. Utiliza um fluxo de trabalho inteligente que consegue perceber quando a pergunta de um cliente é demasiado complicada para uma resposta automática rápida. Em vez de adivinhar e dar uma má resposta, pode instantaneamente fazer outra coisa, como escalar o ticket para a pessoa certa. Desta forma, o cliente obtém sempre uma resposta rápida, seja a resposta perfeita da IA ou uma transição suave para um humano.

Capacidades e precisão

A velocidade é uma coisa, mas o que estes modelos conseguem realmente fazer é onde as coisas se tornam interessantes. Para uso empresarial, estas diferenças podem ser decisivas na sua escolha.

Janela de contexto: Compreender a memória da IA

A "janela de contexto" é um termo técnico para uma ideia simples: quanta informação o modelo consegue reter em qualquer momento de uma conversa. Uma janela de contexto maior significa que a IA pode lidar com conversas mais longas, processar documentos inteiros e recordar detalhes do início da conversa sem se confundir.

-

GPT-3.5: Até 16.385 tokens (cerca de 12.000 palavras).

-

GPT-4: Até 32.768 tokens (cerca de 24.000 palavras).

-

GPT-4 Turbo: Uns massivos 128.000 tokens (cerca de 100.000 palavras, basicamente um livro de 300 páginas).

Para o apoio ao cliente, uma grande janela de contexto é uma enorme vantagem. Significa que um cliente pode explicar um problema complicado e com várias partes, e a IA consegue acompanhar sem se esquecer da primeira coisa que ele disse. Também pode ler um artigo de ajuda inteiro ou uma longa cadeia de e-mails para descobrir a melhor solução.

Raciocínio, precisão e seguimento de instruções

É aqui que o GPT-4 e o GPT-4 Turbo realmente deixam o GPT-3.5 a comer pó. De acordo com a própria investigação da OpenAI, o GPT-4 é 40% mais propenso a produzir respostas factuais do que o GPT-3.5. Quando está a confiar numa IA para interagir com os seus clientes, isso é bastante significativo.

Os modelos mais recentes são também muito melhores a seguir instruções específicas. Pode dizer-lhes para adotar um certo tom de voz ou seguir um formato particular, e eles fá-lo-ão de forma consistente. Por exemplo, se disser ao GPT-3.5 para "responder à pergunta do cliente sobre o envio e depois perguntar se ele precisa de ajuda com mais alguma coisa", ele pode simplesmente responder à pergunta e parar. O GPT-4 e o Turbo são muito mais fiáveis na execução dessa instrução completa de vários passos.

Mas mesmo o modelo mais inteligente só é tão bom quanto a informação a que tem acesso. Um modelo GPT-4 genérico sabe muito sobre o mundo, mas não conhece a política de devoluções única da sua empresa, a solução para um bug específico no seu software ou o estado de um pedido recente de um cliente.

É aqui que entram plataformas como a eesel AI. Elas ancoram estes modelos poderosos na realidade da sua empresa. A eesel AI conecta-se diretamente às suas fontes de conhecimento, quer sejam tickets de suporte passados, o seu centro de ajuda ou documentos internos no Confluence ou Google Docs. Isto garante que o cérebro poderoso da IA está a trabalhar com informação que é precisa e específica para o seu negócio, transformando a inteligência genérica num agente genuinamente útil.

Preços e casos de uso empresariais

Para qualquer negócio, o orçamento é uma realidade. Usar estes modelos através da API da OpenAI significa que paga "por token", ou seja, por cada pedaço de texto que entra e sai. Isto pode ser ótimo pela flexibilidade, mas também pode ser assustadoramente imprevisível. Uma semana movimentada para a sua equipa de suporte pode levar a uma fatura surpreendentemente grande.

Comparação de preços da API da OpenAI

Eis uma breve análise dos custos padrão da API. Para referência, um milhão de tokens equivale a cerca de 750.000 palavras.

| Modelo | Custo de Entrada (por 1M de tokens) | Custo de Saída (por 1M de tokens) |

|---|---|---|

| "gpt-3.5-turbo-0125" | $0.50 | $1.50 |

| "gpt-4" | $30.00 | $60.00 |

| "gpt-4-turbo" | $10.00 | $30.00 |

| Fonte: Página de Preços da OpenAI |

Escolher a ferramenta certa para o trabalho

Tendo em mente estas contrapartidas, eis como pode pensar em aplicá-las:

-

Use o GPT-3.5 para: Tarefas simples e de alto volume onde o custo é o fator principal. Pense em coisas como categorização inicial de tickets, análise básica de sentimento ou um bot de FAQ apenas para uso interno onde os riscos são baixos.

-

Use o GPT-4 para: As tarefas absolutamente críticas onde precisa da melhor resposta possível e está disposto a pagar por ela. Isto pode ser para redigir e-mails sensíveis para clientes de alto valor ou para resolver os seus problemas técnicos mais complexos.

-

Use o GPT-4 Turbo para: Praticamente tudo o resto. É a melhor escolha geral para automação de suporte ao cliente, ajudar os seus agentes humanos a encontrar respostas mais rapidamente e qualquer tarefa que precise de uma combinação de inteligência, velocidade e custo razoável.

Esse preço imprevisível por token é uma enorme dor de cabeça para as empresas que tentam definir um orçamento. É aqui que uma solução completa oferece um valor real. A eesel AI elimina essa incerteza com preços transparentes e previsíveis. Os nossos planos baseiam-se numa taxa mensal fixa para um certo número de interações de IA, sem taxas ocultas por ticket resolvido. Isto significa que pode automatizar o quanto precisar sem ter uma surpresa desagradável no final do mês. Permite-lhe escalar o seu suporte com confiança, sabendo que os seus custos estão completamente sob controlo.

De um modelo bruto a uma solução real

Muito bem, vamos juntar tudo. Qual modelo é o certo para si? Em resumo: o GPT-3.5 é para velocidade e poupança, o GPT-4 é para potência máxima quando o dinheiro não é problema, e o GPT-4 Turbo é a escolha inteligente e equilibrada para a maioria das empresas.

Mas o ponto mais importante é que o modelo é apenas um motor. Para obter qualquer valor real dele, precisa de construir um carro inteiro à sua volta. Uma simples chamada de API não se pode conectar à sua base de dados de pedidos, aprender com os tickets passados da sua equipa ou ser testada em segurança com os seus dados reais antes de a deixar falar com um único cliente.

É para isso que uma plataforma como a eesel AI foi desenhada. Pegamos no poder bruto destes modelos e transformamo-lo numa ferramenta prática e integrada para a sua equipa de suporte. Pode começar em poucos minutos, conectar todo o conhecimento disperso da sua empresa num único cérebro e usar um poderoso modo de simulação para testar a sua IA sem qualquer risco. Se está pronto para deixar de pensar no motor e começar a conduzir o carro, pode ver como uma solução completa pode transformar a sua experiência de suporte.

Perguntas frequentes

Quais são as principais distinções a considerar ao avaliar o GPT-4 Turbo vs GPT-4 vs GPT-3.5 para uso empresarial?

As principais distinções residem na inteligência, velocidade e custo. O GPT-3.5 é rápido e barato, mas menos preciso; o GPT-4 é altamente inteligente, mas lento e caro; enquanto o GPT-4 Turbo oferece um forte equilíbrio da inteligência do GPT-4 com velocidade melhorada e custo mais baixo.

Como difere a estrutura de preços entre o GPT-4 Turbo vs GPT-4 vs GPT-3.5 para uso da API?

O GPT-3.5 é o mais acessível, seguido pelo GPT-4 Turbo, que é significativamente mais barato que o GPT-4 original. O preço é baseado em tokens, o que significa que paga tanto pelo texto de entrada como de saída, sendo o GPT-4 o que acarreta os custos mais elevados.

Qual modelo oferece a melhor velocidade e desempenho para aplicações voltadas para o cliente?

O GPT-3.5 é o mais rápido, ideal para tarefas simples e de alto volume. O GPT-4 Turbo é um forte concorrente para interações em tempo real, oferecendo uma velocidade significativamente melhor do que o GPT-4 original, mais lento, mantendo ainda uma alta inteligência.

Para tarefas que exigem raciocínio avançado e alta precisão, qual modelo é recomendado?

Tanto o GPT-4 como o GPT-4 Turbo são muito superiores ao GPT-3.5 em termos de raciocínio, precisão e seguimento de instruções complexas. O GPT-4 Turbo, especificamente, oferece uma inteligência próxima à do GPT-4 com treino mais atualizado e uma janela de contexto maior.

Quais são as implicações práticas do tamanho da janela de contexto?

Uma janela de contexto maior permite que a IA se "lembre" de mais informações de uma conversa ou documento. A enorme janela de 128.000 tokens do GPT-4 Turbo permite-lhe lidar com interações muito mais longas e complexas e processar documentos inteiros sem perder o contexto, ao contrário do GPT-3.5 ou mesmo do GPT-4.

Pode delinear casos de uso empresariais específicos para cada modelo?

O GPT-3.5 é adequado para tarefas simples e de alto volume onde o custo é crítico. O GPT-4 é para trabalhos críticos que exigem a melhor resposta possível, independentemente do custo. O GPT-4 Turbo é ideal para a maioria do suporte ao cliente e tarefas que requerem um equilíbrio entre inteligência, velocidade e custo razoável.

No geral, para uma empresa que procura uma solução de IA equilibrada, qual modelo oferece o melhor ponto de equilíbrio?

O GPT-4 Turbo é geralmente a melhor escolha geral para a maioria das empresas. Oferece uma poderosa combinação de alta inteligência, velocidade melhorada e custos significativamente mais baixos em comparação com o GPT-4 original, tornando-o uma opção prática e eficiente.