Le monde de l'IA évolue à un rythme vertigineux. Au moment même où vous pensez maîtriser GPT-4, OpenAI lance GPT-4 Turbo et vous avez l'impression de revenir à la case départ. Si vous essayez de déterminer lequel de ces modèles est réellement pertinent pour votre entreprise, vous êtes en bonne compagnie. C'est un peu comme si on vous demandait de choisir un moteur sans savoir quel type de voiture vous essayez de construire.

La réponse simple est qu'il n'existe pas de modèle « meilleur » pour tout le monde. Le bon choix est un exercice d'équilibre, un compromis constant entre la vitesse, l'intelligence et le coût. Ce guide est là pour décomposer les différences concrètes entre GPT-3.5, GPT-4 et GPT-4 Turbo afin que vous puissiez prendre une décision adaptée à ce que vous devez réellement faire.

Mais voici un petit spoiler : le modèle n'est que le moteur. La vraie puissance vient de sa connexion aux outils et aux données de votre entreprise. Après tout, l'IA la plus intelligente de la planète est assez inutile si elle ne peut pas accéder à votre base de connaissances interne pour donner une réponse pertinente.

Que sont les modèles GPT d'OpenAI ?

Avant d'entrer dans le vif du sujet, assurons-nous que nous sommes sur la même longueur d'onde. « GPT » signifie Generative Pre-trained Transformer (transformateur génératif pré-entraîné). En termes simples, il s'agit d'énormes modèles linguistiques qui ont été entraînés sur une quantité massive de texte et de données provenant d'Internet. Cette formation leur permet de comprendre le contexte, de générer du texte de type humain et d'alimenter des outils comme ChatGPT.

Qu'est-ce que GPT-3.5 ?

GPT-3.5 est le cheval de trait fiable du groupe. C'est le moteur qui fait fonctionner la version gratuite de ChatGPT, et il est conçu pour deux choses : la vitesse et l'abordabilité. Pour les tâches simples à volume élevé, c'est une excellente option. Il peut gérer les questions-réponses de base, résumer du texte et suivre des instructions simples sans sourciller. Où est-ce qu'il pêche ? Il peut être déstabilisé par un raisonnement complexe, des instructions subtiles ou des tâches qui nécessitent beaucoup de nuances.

Qu'est-ce que GPT-4 ?

GPT-4 est le modèle haut de gamme par excellence. C'est le cerveau derrière ChatGPT Plus, et il a constitué un énorme bond en avant en termes d'intelligence. GPT-4 excelle lorsque vous lui soumettez des problèmes complexes, qu'il s'agisse de rédaction créative et d'instructions en plusieurs étapes, d'analyse de données et d'écriture de code. Ses réponses sont beaucoup plus sophistiquées et précises. Le hic ? Toute cette puissance intellectuelle a un coût. GPT-4 est sensiblement plus lent et plus coûteux à utiliser que son prédécesseur.

Qu'est-ce que GPT-4 Turbo ?

GPT-4 Turbo est une tentative d'obtenir le meilleur des deux mondes. Il a été conçu pour offrir la haute intelligence de GPT-4, mais avec des améliorations majeures en termes de vitesse et de coût. Il est également livré avec quelques améliorations massives : une fenêtre « contextuelle » beaucoup plus grande (nous y reviendrons dans une seconde) et des données d'entraînement plus récentes. Pour la plupart des entreprises d'aujourd'hui, GPT-4 Turbo est le choix pratique, car il offre un juste milieu entre puissance, performances et prix.

Vitesse et performances

Dans un contexte professionnel, en particulier lorsque des clients attendent, la vitesse n'est pas seulement un avantage, c'est essentiel. Un client qui fixe un chatbot « en train de réfléchir » pendant 30 secondes est un client qui est sur le point d'être frustré et de partir.

Voici comment les modèles se comparent au test de vitesse :

-

GPT-3.5 : Le champion incontesté de la vitesse. Il est rapide et réactif.

-

GPT-4 Turbo : Beaucoup plus rapide que le GPT-4 original, ce qui en fait un concurrent solide pour les conversations en temps réel.

-

GPT-4 : Le plus lent des trois. Les gens disent souvent que ses réponses semblent plus « réfléchies », mais dans un chat en direct, cela se traduit simplement par un décalage.

Mais voici le hic : une réponse rapide mais erronée est pire qu'une réponse légèrement plus lente qui aide réellement. En matière d'assistance clientèle, vous devez équilibrer la vitesse et la fiabilité. Un bot qui crache instantanément des réponses erronées ne fait que créer plus de travail de nettoyage pour vos agents humains.

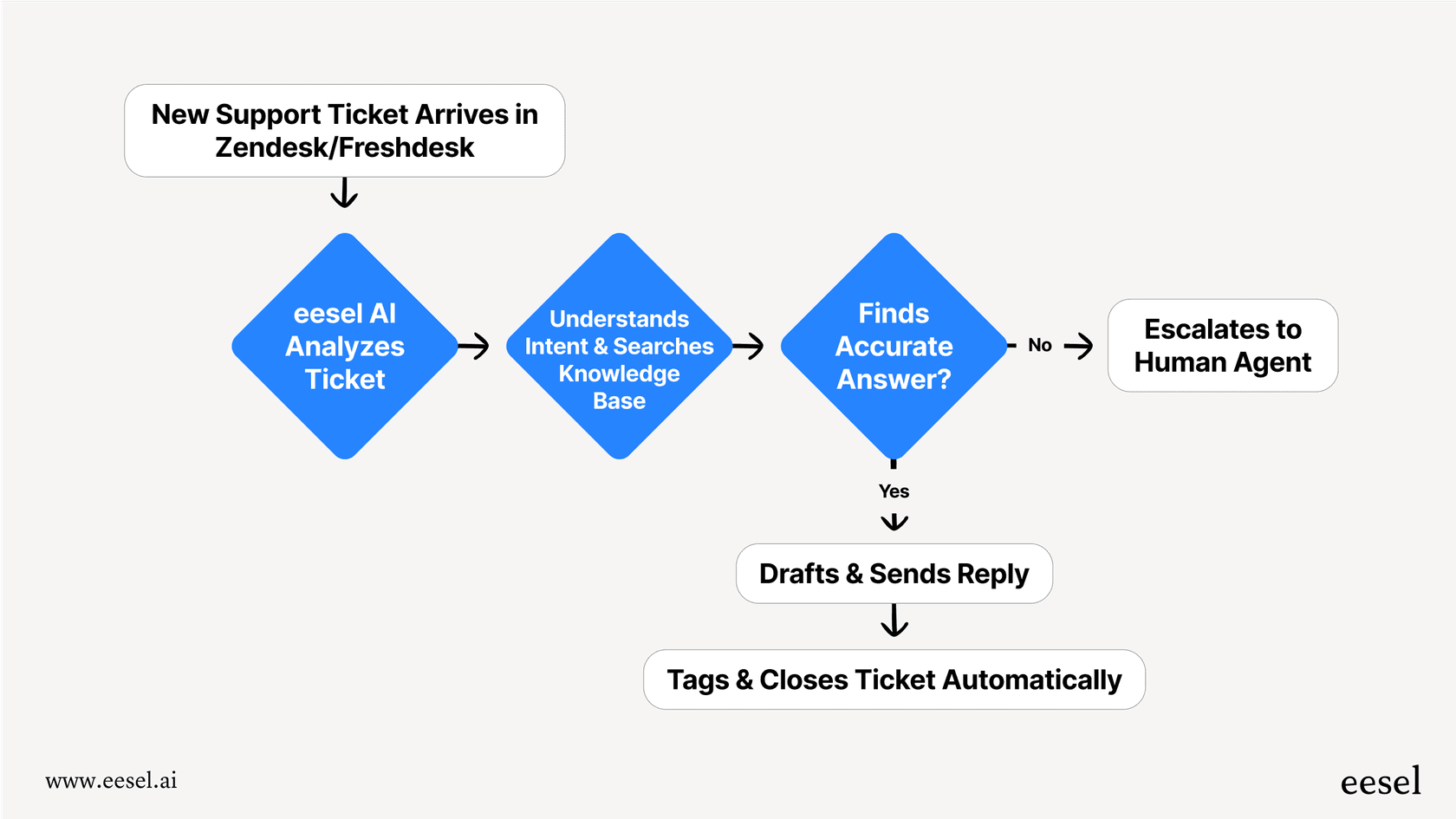

C'est là que le simple fait d'avoir un modèle ne suffit pas. Par exemple, un agent d'assistance IA d'eesel AI fait plus que simplement appeler une API (Application Programming Interface). Il utilise un flux de travail intelligent qui peut déterminer si la question d'un client est trop délicate pour une réponse automatisée rapide. Au lieu de deviner et de donner une mauvaise réponse, il peut instantanément faire autre chose, comme transmettre le ticket à la bonne personne. De cette façon, le client obtient toujours une réponse rapide, qu'il s'agisse de la réponse parfaite de l'IA ou d'un transfert en douceur à un humain.

Capacités et précision

La vitesse est une chose, mais ce que ces modèles peuvent réellement faire est ce qui rend les choses intéressantes. Pour un usage professionnel, ces différences peuvent faire ou défaire votre décision.

Fenêtre contextuelle : comprendre la mémoire de l'IA

La « fenêtre contextuelle » est un terme technique pour une idée simple : la quantité d'informations que le modèle peut mémoriser à un moment donné dans une conversation. Une fenêtre contextuelle plus grande signifie que l'IA peut gérer des discussions plus longues, traiter des documents entiers et rappeler des détails du début de la conversation sans se perdre.

-

GPT-3.5 : Jusqu'à 16 385 jetons (environ 12 000 mots).

-

GPT-4 : Jusqu'à 32 768 jetons (environ 24 000 mots).

-

GPT-4 Turbo : Un nombre impressionnant de 128 000 jetons (environ 100 000 mots, soit un livre de 300 pages).

Pour l'assistance clientèle, une grande fenêtre contextuelle est un énorme avantage. Cela signifie qu'un client peut expliquer un problème compliqué en plusieurs parties, et que l'IA peut réellement suivre sans oublier la première chose qu'il a dite. Elle peut également lire un article d'aide entier ou une longue chaîne d'e-mails pour trouver la meilleure solution.

Raisonnement, exactitude et respect des consignes

C'est là que GPT-4 et GPT-4 Turbo laissent vraiment GPT-3.5 sur le carreau. Selon les propres recherches d'OpenAI, GPT-4 est 40 % plus susceptible de produire des réponses factuelles que GPT-3.5. Lorsque vous faites confiance à une IA pour interagir avec vos clients, c'est un élément important.

Les modèles plus récents sont également beaucoup plus aptes à suivre des instructions spécifiques. Vous pouvez leur dire d'adopter un certain ton ou de suivre un format particulier, et ils le feront réellement de manière cohérente. Par exemple, si vous demandez à GPT-3.5 de « répondre à la question du client concernant l'expédition et de lui demander ensuite s'il a besoin d'aide pour autre chose », il se peut qu'il se contente de répondre à la question et qu'il s'arrête là. GPT-4 et Turbo sont beaucoup plus fiables pour exécuter cette instruction complète en plusieurs étapes.

Mais même le modèle le plus intelligent n'est aussi bon que les informations auxquelles il a accès. Un modèle GPT-4 générique connaît beaucoup de choses sur le monde, mais il ne connaît pas la politique de retour unique de votre entreprise, la solution de contournement d'un bogue spécifique de votre logiciel ou l'état de la commande récente d'un client.

C'est là que des plateformes comme eesel AI entrent en jeu. Elles ancrent ces modèles puissants dans la réalité de votre entreprise. eesel AI se connecte directement à vos sources de connaissances, qu'il s'agisse d'anciens tickets d'assistance, de votre centre d'aide ou de documents internes dans Confluence ou Google Docs. Cela garantit que le cerveau puissant de l'IA travaille avec des informations précises et spécifiques à votre entreprise, transformant l'intelligence générique en un agent réellement utile.

Tarification et cas d'utilisation

Pour toute entreprise, le budget est une réalité. L'utilisation de ces modèles via l'API d'OpenAI signifie que vous payez « par jeton », c'est-à-dire pour chaque élément de texte qui entre et qui sort. Cela peut être formidable pour la flexibilité, mais cela peut aussi être terriblement imprévisible. Une semaine chargée pour votre équipe d'assistance pourrait entraîner une facture étonnamment élevée.

Comparaison des prix de l'API OpenAI

Voici un aperçu rapide des coûts standard de l'API. Pour référence, un million de jetons représente environ 750 000 mots.

| Modèle | Coût d'entrée (par 1 M de jetons) | Coût de sortie (par 1 M de jetons) |

|---|---|---|

| "gpt-3.5-turbo-0125" | 0,50 $ | 1,50 $ |

| "gpt-4" | 30,00 $ | 60,00 $ |

| "gpt-4-turbo" | 10,00 $ | 30,00 $ |

Source : Page de tarification d'OpenAI

Choisir le bon outil pour le travail

En gardant ces compromis à l'esprit, voici comment vous pourriez envisager de les appliquer :

-

Utilisez GPT-3.5 pour : Les tâches simples à volume élevé où le coût est le facteur numéro un. Pensez à des choses comme la catégorisation initiale des tickets, l'analyse de base des sentiments ou un bot de FAQ à usage interne où les enjeux sont faibles.

-

Utilisez GPT-4 pour : Les tâches absolument essentielles où vous avez besoin de la meilleure réponse possible et êtes prêt à payer pour cela. Il peut s'agir de la rédaction d'e-mails sensibles à des clients de grande valeur ou du dépannage de vos problèmes techniques les plus complexes.

-

Utilisez GPT-4 Turbo pour : À peu près tout le reste. C'est le meilleur choix polyvalent pour l'automatisation de l'assistance client, aider vos agents humains à trouver des réponses plus rapidement et toute tâche qui nécessite un mélange d'intelligence, de vitesse et de coût raisonnable.

Cette tarification imprévisible par jeton est un énorme casse-tête pour les entreprises qui essaient d'établir un budget. C'est là qu'une solution complète offre une réelle valeur. eesel AI élimine cette incertitude grâce à une tarification transparente et prévisible. Nos forfaits sont basés sur un forfait mensuel fixe pour un certain nombre d'interactions avec l'IA, sans frais cachés par ticket résolu. Cela signifie que vous pouvez automatiser autant que vous le souhaitez sans avoir de mauvaise surprise à la fin du mois. Cela vous permet d'augmenter votre assistance en toute confiance, en sachant que vos coûts sont totalement maîtrisés.

D'un modèle brut à une solution réelle

Bien, faisons le lien entre tout cela. Quel modèle vous convient le mieux ? En bref : GPT-3.5 est synonyme de vitesse et d'économies, GPT-4 est synonyme de puissance maximale lorsque l'argent n'est pas un problème, et GPT-4 Turbo est le choix intelligent et équilibré pour la plupart des entreprises.

Mais le point essentiel est que le modèle n'est qu'un moteur. Pour en tirer une réelle valeur, vous devez construire toute une voiture autour de lui. Un simple appel d'API ne peut pas se connecter à votre base de données de commandes, apprendre des anciens tickets de votre équipe ou être testé en toute sécurité sur vos données réelles avant que vous ne le laissiez parler à un seul client.

C'est ce qu'une plateforme comme eesel AI est conçue pour faire. Nous prenons la puissance brute de ces modèles et la transformons en un outil pratique et intégré pour votre équipe d'assistance. Vous pouvez démarrer en quelques minutes, connecter toutes les connaissances dispersées de votre entreprise en un seul cerveau et utiliser un mode de simulation puissant pour tester votre IA sans aucun risque. Si vous êtes prêt à cesser de penser au moteur et à commencer à conduire la voiture, vous pouvez voir comment une solution complète peut transformer votre expérience d'assistance.

Foire aux questions

Quelles sont les principales distinctions à prendre en compte lors de l'évaluation de GPT-4 Turbo vs GPT-4 vs GPT-3.5 pour un usage professionnel ?

Les principales distinctions résident dans l'intelligence, la vitesse et le coût. GPT-3.5 est rapide et économique, mais moins précis, GPT-4 est très intelligent mais lent et coûteux, tandis que GPT-4 Turbo offre un bon équilibre entre l'intelligence de GPT-4, une vitesse améliorée et un coût réduit.

En quoi la structure de prix diffère-t-elle entre GPT-4 Turbo vs GPT-4 vs GPT-3.5 pour l'utilisation de l'API ?

GPT-3.5 est le plus abordable, suivi par GPT-4 Turbo, qui est considérablement moins cher que le GPT-4 original. La tarification est basée sur les jetons, ce qui signifie que vous payez à la fois pour le texte d'entrée et de sortie, GPT-4 entraînant les coûts les plus élevés.

Quel modèle offre la meilleure vitesse et les meilleures performances pour les applications destinées aux clients ?

GPT-3.5 est le plus rapide, idéal pour les tâches simples à volume élevé. GPT-4 Turbo est un concurrent sérieux pour les interactions en temps réel, offrant une vitesse nettement supérieure à celle du GPT-4 original, plus lent, tout en conservant une intelligence élevée.

Pour les tâches nécessitant un raisonnement avancé et une grande précision, quel modèle est recommandé ?

GPT-4 et GPT-4 Turbo sont tous deux bien supérieurs à GPT-3.5 en termes de raisonnement, de précision et de respect d'instructions complexes. GPT-4 Turbo, en particulier, offre une intelligence proche de celle de GPT-4 avec une formation plus à jour et une fenêtre contextuelle plus large.

Quelles sont les implications pratiques de la taille de la fenêtre contextuelle ?

Une fenêtre contextuelle plus grande permet à l'IA de « mémoriser » davantage d'informations provenant d'une conversation ou d'un document. La fenêtre massive de 128 000 jetons de GPT-4 Turbo lui permet de gérer des interactions beaucoup plus longues et complexes et de traiter des documents entiers sans perdre le contexte, contrairement à GPT-3.5 ou même GPT-4.

Pouvez-vous décrire des cas d'utilisation spécifiques pour chaque modèle ?

GPT-3.5 est adapté aux tâches simples à volume élevé où le coût est essentiel. GPT-4 est destiné aux tâches critiques exigeant la meilleure réponse possible, quel que soit le coût. GPT-4 Turbo est idéal pour la plupart des tâches et de l'assistance client nécessitant un équilibre entre intelligence, rapidité et coût raisonnable.

Dans l'ensemble, pour une entreprise à la recherche d'une solution d'IA équilibrée, quel modèle offre le meilleur compromis ?

GPT-4 Turbo est généralement le meilleur choix polyvalent pour la plupart des entreprises. Il offre un mélange puissant de haute intelligence, de vitesse améliorée et de coûts considérablement inférieurs à ceux du GPT-4 original, ce qui en fait une option pratique et efficace.