Toda a gente anda a falar sobre IA generativa, mas sejamos honestos, há um grande elefante na sala: a confiança. Especialmente quando se trata de dados de clientes. Como usar estas novas e poderosas ferramentas sem comprometer a privacidade? É uma preocupação válida, e que os clientes partilham. Na verdade, quase três quartos deles estão preocupados com empresas que usam IA de formas antiéticas.

O Salesforce Einstein Trust Layer é a tentativa da Salesforce para resolver este problema. É uma estrutura criada para tornar as suas funcionalidades de IA nativas seguras o suficiente para grandes empresas, envolvendo-as numa camada protetora de segurança e controlos de dados.

Mas o que é que faz no dia a dia? E, mais importante, é a escolha certa para toda a sua equipa de suporte? Este guia irá explicar-lhe o que é o Trust Layer, as suas principais funcionalidades, as suas limitações no mundo real e a sua estrutura de preços confusa. No final, terá uma imagem clara para o ajudar a decidir se é a solução de que precisa, ou se estaria melhor com uma ferramenta mais flexível.

O que é o Salesforce Einstein Trust Layer?

Simplificando, o Salesforce Einstein Trust Layer é um cobertor de segurança para todas as ferramentas de IA integradas na plataforma Salesforce. Não é um extra que se compra; é a arquitetura de fundo que está sempre ativa quando se usam ferramentas como o Einstein Copilot ou o Prompt Builder.

A sua principal função é atuar como um intermediário seguro. Situa-se entre o prompt que insere e o Modelo de Linguagem Grande (LLM) que gera uma resposta. Nessa posição, interceta os seus dados, executa uma série de verificações de segurança e garante que as suas informações sensíveis da empresa e dos clientes nunca saiam do ambiente Salesforce. Pense nele como um segurança para a sua IA. Ele posiciona-se entre o seu pedido e o modelo de IA, verificando a identificação dos seus dados e garantindo que nada sensível ultrapasse a corda de veludo.

graph TD A[O utilizador insere um prompt no Salesforce] --> B{Einstein Trust Layer}; B --> C[1. Recuperação Segura de Dados do CRM]; C --> D[2. Mascaramento de Dados para PII]; D --> E[3. Defesa de Prompt e Verificação de Toxicidade]; E --> F[Parceiro LLM, ex.: OpenAI]; F --> G{Einstein Trust Layer}; G --> H[4. Verificação de Toxicidade na Resposta]; H --> I[5. Desmascaramento de Dados]; I --> J[O utilizador recebe uma resposta segura e relevante]; style F fill:#ADD8E6,stroke:#333,stroke-width:2px style B fill:#90EE90,stroke:#333,stroke-width:2px style G fill:#90EE90,stroke:#333,stroke-width:2px

Principais funcionalidades do Salesforce Einstein Trust Layer

O Trust Layer não é uma única coisa; é um conjunto de componentes a trabalhar em conjunto para manter as suas interações de IA seguras. Para perceber realmente o que faz, tem de olhar para cada peça. Aqui está uma análise das suas funcionalidades mais importantes.

Recuperação segura de dados e fundamentação dinâmica

Uma das maiores desilusões de usar uma IA de propósito geral como o ChatGPT é que não sabe absolutamente nada sobre o seu negócio. Peça-lhe para escrever um e-mail para um cliente e receberá um modelo que soa como se tivesse sido escrito por um robô. É aqui que a fundamentação dinâmica ajuda. O Trust Layer alimenta a IA com contexto em tempo real dos seus dados de CRM, o que torna as suas respostas muito mais relevantes e personalizadas.

Ele gere isto com a recuperação segura de dados. O Trust Layer verifica duas vezes que a IA apenas extrai dados que o utilizador tem permissão para ver. Respeita automaticamente todas as suas permissões de utilizador e segurança ao nível de campo existentes no Salesforce, para que um agente não possa acidentalmente usar informações de um registo ao qual não deveria ter acesso.

Mascaramento de dados para informações privadas

Isto é muito importante. Antes de qualquer prompt ser enviado para um LLM externo, a funcionalidade de mascaramento de dados do Trust Layer encontra e oculta automaticamente informações sensíveis. Procura detalhes como nomes, endereços de e-mail, números de telefone e informações de cartão de crédito e substitui-os por marcadores genéricos.

Utiliza duas formas para fazer isto: deteção baseada em padrões (para coisas num formato padrão, como um número de telefone) e deteção baseada em campo (que usa as classificações de dados que já configurou no Salesforce). Depois de o LLM enviar a sua resposta, o Trust Layer desmascara os dados, colocando a informação real de volta. O utilizador vê os detalhes corretos, mas o LLM nunca viu os dados privados.

Descrição: O infográfico deve ter dois lados.

Lado esquerdo (Antes): Mostra um prompt de utilizador contendo dados sensíveis como "O número de telefone de João Silva é 555-1234". Os dados estão destacados a vermelho. Uma seta aponta disto para o ícone do Einstein Trust Layer.

Lado direito (Depois): Mostra o prompt como enviado para o LLM, com os dados mascarados: "O número de telefone de [NOME] é [NÚMERO_TELEFONE]". Uma seta aponta de volta do LLM para o Trust Layer, que depois mostra a resposta final, desmascarada, a ser enviada para o utilizador.

Política de retenção zero de dados

Uma preocupação comum com modelos de IA de terceiros é o que acontece com os seus dados depois de os ter usado. A Salesforce aborda isto com a sua política de retenção zero de dados. Têm acordos com os seus parceiros de LLM, como a OpenAI, para garantir que os seus dados nunca são armazenados ou usados para treinar os seus modelos.

Isto significa que depois de a IA lhe dar uma resposta, o seu prompt e todos os dados nele contidos são apagados dos servidores do LLM. Nada é guardado para revisão, treino ou qualquer outra coisa, o que é uma parte fundamental para manter a privacidade dos seus dados.

Deteção de toxicidade e defesa de prompts

Sejamos realistas, os modelos de IA podem por vezes gerar respostas tendenciosas, inapropriadas ou simplesmente estranhas (as pessoas costumam chamar a isto "alucinações"). O Trust Layer tem deteção de toxicidade que analisa tanto o prompt do utilizador como a resposta da IA em busca de qualquer coisa prejudicial ou ofensiva, sinalizando tudo o que pareça fora do normal.

Também utiliza a defesa de prompts, que é basicamente um conjunto de instruções que diz ao LLM como se deve comportar. Estas barreiras de proteção mantêm a IA sob controlo, reduzindo as probabilidades de se desviar do tópico e protegendo contra ataques em que alguém tenta enganar a IA para quebrar as suas próprias regras de segurança.

Rasto de auditoria e monitorização

Para manter todos responsáveis, o Trust Layer mantém um rasto de auditoria detalhado. Cada prompt, cada resposta e cada feedback do utilizador são registados e armazenados de forma segura no Salesforce Data Cloud. Isto dá aos administradores uma forma de ver como a IA está a ser usada, rever conversas específicas e garantir que tudo permanece em conformidade com as políticas da empresa.

Limitações do Salesforce Einstein Trust Layer

Apesar de o Salesforce Einstein Trust Layer fazer um bom trabalho a proteger as conversas de IA que acontecem dentro da plataforma Salesforce, o facto de estar integrado cria alguns problemas reais para a maioria das equipas hoje em dia.

O problema: Um jardim murado

O maior problema é que o Einstein Trust Layer foi projetado apenas para proteger dados que entram e saem do Salesforce. Mas o conhecimento da sua empresa não vive apenas num único lugar. A maioria das equipas de suporte depende de um conjunto de ferramentas diferentes. Os seus artigos de ajuda podem estar num centro de ajuda Zendesk, os seus documentos de processos internos no Confluence, e as últimas atualizações de produtos numa série de Google Docs.

A IA da Salesforce não consegue aceder a esse conhecimento externo de forma fácil ou segura. Isto cria silos de conhecimento e força a sua IA a dar respostas com base numa pequena fatia da sabedoria total da sua empresa. O resultado? Respostas incompletas e clientes insatisfeitos.

Configuração complicada e lenta

Começar a usar o Einstein não é tão fácil como carregar num botão. Para ser elegível, tem de estar num dos planos mais caros da Salesforce, e depois tem de comprar um extra dispendioso. Todo o processo envolve um longo ciclo de vendas e um projeto de implementação demorado.

Isto parece completamente desfasado de como o software moderno deveria funcionar. As equipas querem ferramentas que possam experimentar e configurar sozinhas, geralmente em poucos minutos. Ser forçado a "contactar o seu executivo de contas da Salesforce" só para começar é um enorme obstáculo que atrasa tudo e adiciona uma camada de burocracia frustrante.

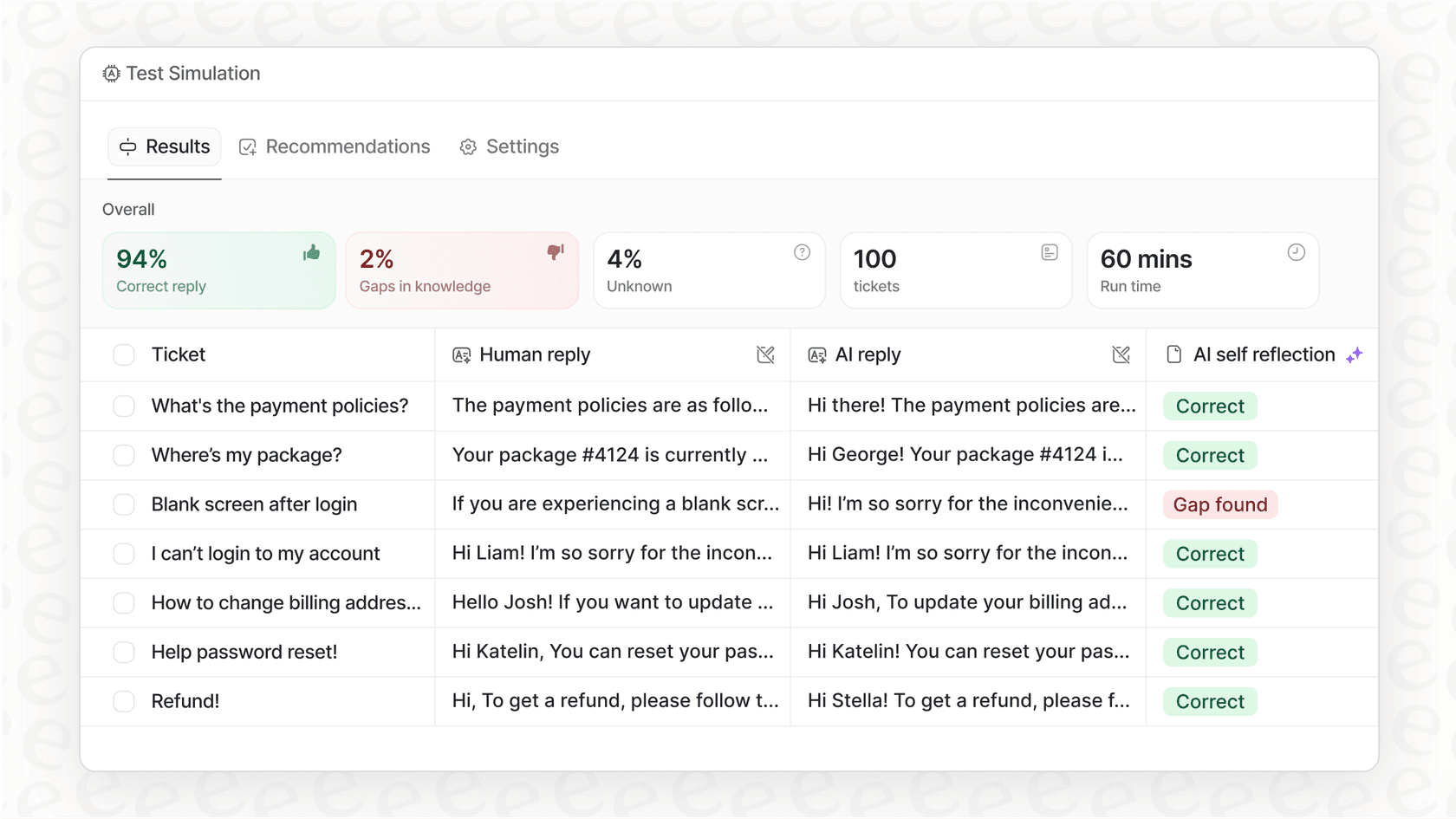

A ansiedade de um lançamento "big bang"

Testar um novo sistema de IA em conversas de chat ao vivo com clientes é uma ideia que causa nervosismo. Embora a Salesforce tenha algumas ferramentas para isto, não oferece uma forma simples de simular como a IA se comportaria em milhares dos seus tickets passados reais. Sem esse tipo de teste histórico, é quase impossível saber quão bem a IA se sairá ou quantos tickets será realmente capaz de resolver.

Esta falta de um bom modo de simulação torna difícil para os líderes de suporte implementar a automação com confiança. Muitas vezes, é empurrado para um lançamento "tudo ou nada" que pode perturbar o fluxo de trabalho da sua equipa e levar a uma péssima experiência do cliente se a IA não estiver totalmente pronta para o horário nobre.

Preços e pacotes do Salesforce Einstein Trust Layer

Se está a tentar encontrar um preço simples para a IA generativa da Salesforce, está sem sorte. O preço é confuso e tudo menos transparente.

De acordo com a própria documentação da Salesforce, a sua IA generativa só está disponível se estiver num plano Enterprise, Performance ou Unlimited. Além disso, tem de comprar um dos seus extras, como "Einstein for Service" ou "Einstein 1 Service". E quanto custam? Adivinhou: tem de "contactar o seu executivo de contas da Salesforce" para obter um orçamento.

Aqui está o que isso realmente significa para si:

-

Um custo de entrada elevado: Já precisa de estar a pagar por um plano de topo da Salesforce antes de poder sequer pensar nas suas ferramentas de IA.

-

Custos surpresa: O preço do extra é um mistério. Isto leva a despesas imprevisíveis negociadas em privado, tornando impossível orçamentar.

-

Dependência do fornecedor: Este modelo de preços foi concebido para o puxar mais para dentro do mundo da Salesforce, tornando mais difícil e mais caro mudar para outras ferramentas se as suas necessidades mudarem mais tarde.

A alternativa: Uma camada de IA flexível para todas as suas ferramentas

Para equipas que precisam de uma solução de IA que funcione com todas as suas ferramentas, e não apenas uma, há uma maneira melhor. O eesel AI foi criado para ser essa camada de IA flexível, projetada para resolver os problemas de plataformas fechadas como a Salesforce.

Comece a funcionar em minutos, não em meses

Esqueça as longas chamadas de vendas e os projetos de implementação que a Salesforce exige. O eesel AI é completamente self-service. Pode inscrever-se, conectar a sua central de ajuda como o Zendesk ou Freshdesk com um único clique, e ter um Copiloto de IA a funcionar em minutos, sem necessidade de demonstração obrigatória ou apresentação de vendas.

Melhor ainda, o eesel AI tem um modo de simulação poderoso que lhe permite testar a sua configuração em milhares dos seus tickets de suporte passados. Isto dá-lhe uma previsão sólida da sua taxa de automação e poupança de custos antes de entrar em funcionamento, eliminando todas as suposições do seu lançamento.

Conecte todo o seu conhecimento, não apenas os dados do Salesforce

O eesel AI conecta-se a todas as suas fontes de conhecimento, não apenas a uma única plataforma. Integra-se com mais de 100 ferramentas, incluindo wikis como o Confluence e Google Docs, aplicações de chat como o Slack, e até plataformas de e-commerce como o Shopify. Ao analisar os seus tickets e macros passados juntamente com os seus artigos de ajuda e documentos internos, o eesel AI constrói uma base de conhecimento verdadeiramente completa. Isto garante que a sua IA dá respostas precisas e conscientes do contexto sempre, independentemente de onde a informação se encontra.

Controlo total e preços claros

Com o eesel AI, obtém um motor de fluxo de trabalho totalmente personalizável, para que possa decidir exatamente quais tickets a IA deve tratar e o que pode fazer, desde uma triagem simples até à consulta de informações de pedidos.

E quando se trata de custos, não há jogos. O eesel AI oferece planos de preços transparentes e previsíveis sem taxas por resolução. Pode começar com um plano mensal flexível e cancelar a qualquer momento, dando-lhe a liberdade de escalar para cima ou para baixo sem ficar preso a um contrato de longo prazo.

| Funcionalidade | Salesforce Einstein Trust Layer | eesel AI |

|---|---|---|

| Tempo de Configuração | Semanas a meses; requer vendas | Minutos; totalmente self-serve |

| Fontes de Conhecimento | Principalmente dados do Salesforce | Mais de 100 integrações (Centros de ajuda, wikis, etc.) |

| Simulação | Limitada e complexa de configurar | Integrada; simule em milhares de tickets passados |

| Modelo de Preços | Opaco; requer planos empresariais + extras | Transparente, taxas mensais fixas; sem custos ocultos |

| Flexibilidade | Prende-o ao ecossistema da Salesforce | Funciona com as suas ferramentas existentes |

Confiar na IA significa mais do que uma única plataforma

O Salesforce Einstein Trust Layer é uma estrutura de segurança sólida e necessária se a sua empresa vive e respira Salesforce. Oferece funcionalidades importantes como mascaramento de dados, políticas de retenção zero e um rasto de auditoria que são essenciais para qualquer IA de nível empresarial.

No entanto, a sua maior força, estar profundamente entrelaçado com a Salesforce, é também a sua maior fraqueza. Cria um jardim murado que simplesmente não corresponde à forma como as equipas modernas realmente trabalham, com o conhecimento espalhado por dezenas de ferramentas diferentes. No mundo de hoje, uma IA de confiança precisa de ser mais do que apenas segura; precisa de ver tudo.

Para a maioria das equipas de suporte, uma solução de IA verdadeiramente útil tem de ser flexível, fácil de configurar e capaz de conectar todo o seu conhecimento, onde quer que ele esteja. Construir confiança real significa dar à sua equipa uma IA que tem a imagem completa, não apenas uma pequena parte dela.

Próximos passos

Se procura uma solução de IA segura que funcione com todas as ferramentas que já tem, e não apenas com uma, então está pronto para uma abordagem mais flexível.

Comece a usar o eesel AI gratuitamente e veja quão rapidamente pode automatizar o suporte conectando-se às ferramentas que a sua equipa já adora.

Perguntas frequentes

O Salesforce Einstein Trust Layer é uma arquitetura de segurança integrada nas funcionalidades de IA nativas da Salesforce. A sua função principal é atuar como um intermediário seguro entre os prompts do utilizador e os Modelos de Linguagem Grandes, garantindo que os dados sensíveis da empresa e dos clientes permaneçam protegidos dentro do ambiente Salesforce.

Ele usa uma funcionalidade de mascaramento de dados que identifica e substitui automaticamente detalhes sensíveis como nomes e informações de cartão de crédito por marcadores genéricos antes de enviar o prompt para um LLM externo. Após o LLM fornecer uma resposta, o Trust Layer desmascara os dados. Também emprega uma política de retenção zero de dados, garantindo que os seus dados nunca sejam armazenados ou usados para treinar modelos de terceiros.

Uma limitação significativa é que o Salesforce Einstein Trust Layer foi projetado principalmente para proteger e utilizar dados exclusivamente dentro da plataforma Salesforce. Isto significa que tem dificuldade em aceder ou proteger o conhecimento armazenado noutras ferramentas como Zendesk, Confluence ou Google Docs, o que leva a silos de conhecimento e a respostas de IA potencialmente incompletas.

O acesso à IA generativa da Salesforce, que inclui o Salesforce Einstein Trust Layer, está disponível apenas para clientes nos planos Enterprise, Performance ou Unlimited. Além disso, os utilizadores devem adquirir um extra separado, muitas vezes sem preço listado, como o "Einstein for Service", sendo que o preço específico requer uma consulta direta com um executivo de contas da Salesforce.

O Salesforce Einstein Trust Layer usa fundamentação dinâmica para alimentar a IA com contexto em tempo real dos seus dados de CRM, tornando as respostas mais relevantes e personalizadas. Também inclui deteção de toxicidade e mecanismos de defesa de prompts para analisar conteúdo impróprio e barreiras de proteção para manter a IA no tópico, reduzindo a probabilidade de resultados irrelevantes ou prejudiciais.

A configuração do Salesforce Einstein Trust Layer geralmente não é um processo rápido, envolvendo muitas vezes um longo ciclo de vendas e um projeto de implementação prolongado. A elegibilidade requer estar num dos planos mais caros da Salesforce, seguido pela compra de um extra adicional e dispendioso, tornando-o menos uma solução self-service.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.