Escolher a API de Modelo de Linguagem Grande (LLM) certa para o seu projeto parece um compromisso enorme, porque, bem, é mesmo. A API sobre a qual decidir construir afetará diretamente o desempenho do seu produto, a sua fatura mensal e o que os seus utilizadores pensam dele.

Neste momento, os dois nomes na mente de todos são OpenAI e Anthropic. Ambos estão no topo do seu jogo, mas abordam a IA de ângulos bastante diferentes, cada um com as suas próprias forças técnicas e filosofias.

Este guia está aqui para o ajudar a analisar as opções. Faremos uma comparação direta entre a API da OpenAI e a API da Anthropic, analisando tudo, desde a experiência do programador ao desempenho e, claro, aos preços. Também exploraremos por que, para muitas empresas, especialmente as de atendimento ao cliente, a questão está a mudar de qual API usar para construir para qual é a forma mais rápida de pôr isto a funcionar.

O que é a API da OpenAI?

OpenAI é a empresa que realmente deu início a toda a festa da IA generativa. São famosos por criar modelos poderosos e versáteis que captaram a atenção de todos.

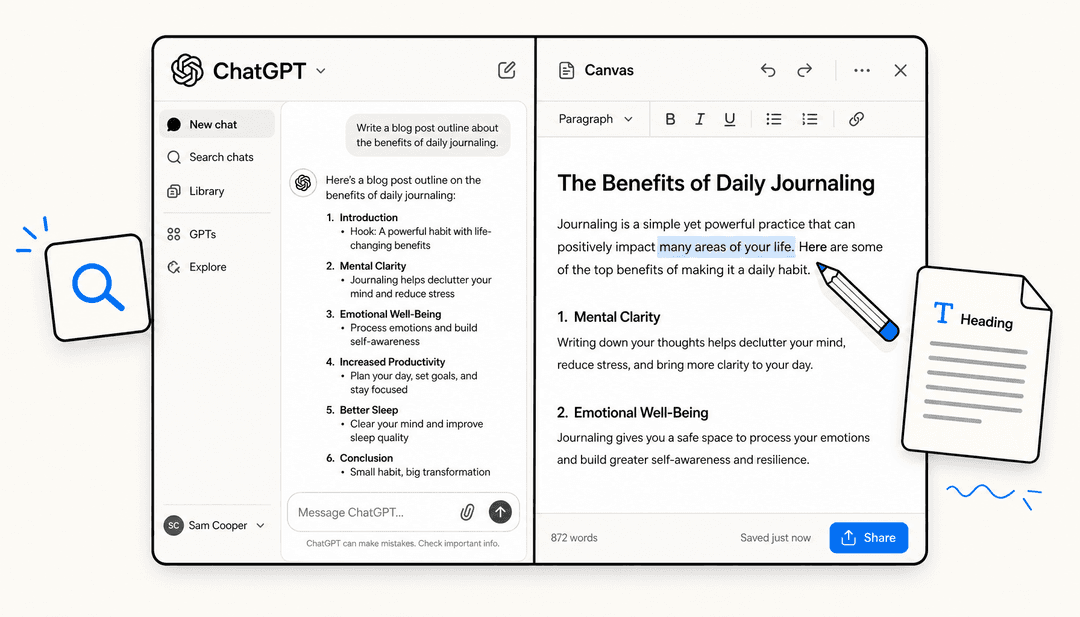

Os seus modelos de topo, como a série GPT (incluindo o mais recente GPT-4o), são conhecidos por serem excelentes em tudo. São sólidos no raciocínio geral, na escrita criativa e estão a ficar cada vez melhores a lidar com texto, imagens e áudio em simultâneo. A API da OpenAI foi concebida para ser adotada e usada pelo maior número possível de pessoas, dando aos programadores as ferramentas para construir desde simples ferramentas de conteúdo até agentes complexos que conseguem realmente executar tarefas. Para muitos, é a escolha padrão para uma base flexível, poderosa e testada.

O que é a API da Anthropic?

A Anthropic surgiu em 2021, fundada por um grupo de antigos investigadores da OpenAI que queriam focar-se intensamente na segurança da IA. A sua missão é construir sistemas de IA que sejam fiáveis, previsíveis e mais fáceis de orientar, o que é um objetivo ligeiramente diferente de apenas perseguir o poder bruto.

A sua principal família de modelos é o Claude, sendo o Claude 3.5 Sonnet a estrela atual. É conhecido por ter uma janela de contexto massiva (o que significa que pode ler e lembrar documentos muito longos), ter um bom desempenho em tarefas focadas em negócios e ter a segurança integrada desde o início. Eles usam um método que chamam de "IA Constitucional", onde o modelo é treinado para seguir um conjunto de princípios éticos. Isto torna a API da Anthropic uma escolha sólida para empresas em setores regulados ou qualquer situação em que seja absolutamente necessário que a IA se comporte de forma previsível.

Uma comparação detalhada entre a API da OpenAI e a API da Anthropic

Embora ambas as plataformas tenham modelos de topo, a experiência real de construir com as suas APIs pode ser completamente diferente. Vamos entrar nos detalhes que realmente notará como programador ou líder de equipa.

Experiência do programador e funcionalidades da API

Passe algum tempo em fóruns de programadores, e verá um quadro claro: ambas as APIs são poderosas, mas têm as suas peculiaridades que podem fazer ou quebrar um projeto. Os pequenos detalhes no seu design realmente importam.

Como estruturam as mensagens

-

OpenAI: A API é conhecida por ser super flexível. Pode adicionar mensagens de sistema em qualquer parte de uma conversa e até ter mensagens consecutivas da mesma "pessoa" (como duas mensagens de utilizador seguidas). Isto pode parecer pouco, mas é uma grande ajuda para simular chats complexos ou construir fluxos de trabalho onde uma IA precisa de usar algumas ferramentas antes de dar a sua resposta final.

-

Anthropic: Aqui as coisas são muito mais rigorosas. Impõe um padrão "utilizador" -> "assistente" -> "utilizador" e só permite colocar um único prompt de sistema no início. Isto torna a API previsível, claro, mas pode ser uma verdadeira dor de cabeça se estiver a tentar construir aplicações mais dinâmicas, como uma que precisa de retomar uma conversa com novas informações.

Como lidam com ferramentas (function calling)

-

OpenAI: Este é um verdadeiro ponto forte da OpenAI. A sua API tem um sólido sistema de function calling, incluindo a capacidade de chamar várias ferramentas de uma só vez. Isto permite que a IA decida que precisa de fazer várias coisas, como procurar uma encomenda e verificar um artigo de ajuda, e pedir tudo de uma vez. É simplesmente mais eficiente e parece menos robótico.

-

Anthropic: O uso de ferramentas parece um pouco mais desajeitado e um de cada vez. Os programadores descobriram que, se for preciso que o modelo use várias ferramentas, é necessário guiá-lo através de uma conversa rígida de ida e volta. Isto adiciona atrasos, custa mais em tokens e torna o desenvolvimento mais complicado. Há também uma quantidade surpreendente de sobrecarga de tokens apenas para ativar a funcionalidade.

Trabalhar com imagens e áudio

Ambas as empresas estão a fazer grandes avanços na visão, permitindo que os seus modelos compreendam imagens. Dito isto, o ecossistema da OpenAI parece um pouco mais completo neste momento. Com ferramentas como o Whisper para conversão de fala para texto e o DALL·E para geração de imagens, tudo sob o mesmo teto, oferece simplesmente um conjunto de ferramentas multimédia mais completo de raiz.

A conclusão do programador

Construir diretamente sobre qualquer uma destas APIs significa que está a comprometer-se a lidar com as suas peculiaridades específicas. Para algo como o atendimento ao cliente, isto pode parecer que está a construir a mesma coisa que toda a gente já construiu. Uma plataforma como a eesel AI trata de todas essas coisas complicadas por si. Não tem de lutar com estruturas de mensagens ou limites de uso de ferramentas; basta conectar os seus documentos de conhecimento, descrever o que quer que o agente faça em linguagem simples, e deixar a plataforma tratar dos detalhes complicados da implementação.

Desempenho, casos de uso e segurança

O "melhor" modelo realmente depende do que está a tentar fazer.

Para que servem

-

OpenAI: A sua flexibilidade e capacidades criativas tornam-na uma ótima opção para aplicações amplas voltadas para o consumidor, criação de conteúdo e qualquer coisa que necessite de uma inteligência geral de topo. Se está a construir algo novo e quer testar ideias rapidamente, a API da OpenAI é muitas vezes a forma mais rápida de o conseguir.

-

Anthropic: O Claude realmente destaca-se num contexto empresarial. É perfeito para tarefas que envolvem a análise de documentos longos, como rever contratos legais, resumir relatórios financeiros ou lidar com pedidos de suporte ao cliente detalhados onde não se pode dar ao luxo de errar.

A sua abordagem à ética e ao controlo

-

OpenAI: A empresa apoia-se fortemente numa técnica chamada Aprendizagem por Reforço com Feedback Humano (RLHF). Basicamente, isto significa que têm revisores humanos a avaliar as respostas do modelo, o que o ensina ao longo do tempo a ser mais útil e menos prejudicial. Funciona, mas por vezes pode absorver os preconceitos subtis dos seus treinadores humanos.

-

Anthropic: A sua "IA Constitucional" é o que os distingue. O modelo é treinado com um conjunto de princípios fundamentais (a sua "constituição"), e aprende a julgar as suas próprias respostas com base nesses princípios. A ideia é criar um modelo que seja naturalmente mais previsível e menos propenso a dizer algo disparatado, sem necessitar de supervisão humana constante.

Para as empresas, a questão resume-se muitas vezes a isto: precisa do poder bruto e flexível da OpenAI, ou da segurança estável e previsível da Anthropic?

Plataformas como a eesel AI oferecem um caminho alternativo. Ao usar modelos poderosos nos bastidores, a eesel AI dá-lhe o melhor de dois mundos. Obtém a inteligência de um modelo de topo, mas com controlo total através de uma interface simples. Pode definir uma personalidade de IA personalizada, limitar o seu conhecimento apenas aos seus documentos aprovados e usar um poderoso modo de simulação para garantir que se comporta exatamente como espera antes que um cliente alguma vez fale com ele.

Preços e modelos de negócio

Tanto a OpenAI como a Anthropic têm uma estrutura de preços semelhante. Oferecem subscrições mensais para os seus chatbots (ChatGPT Plus e Claude Pro) e, depois, um modelo de pagamento conforme o uso para as suas APIs.

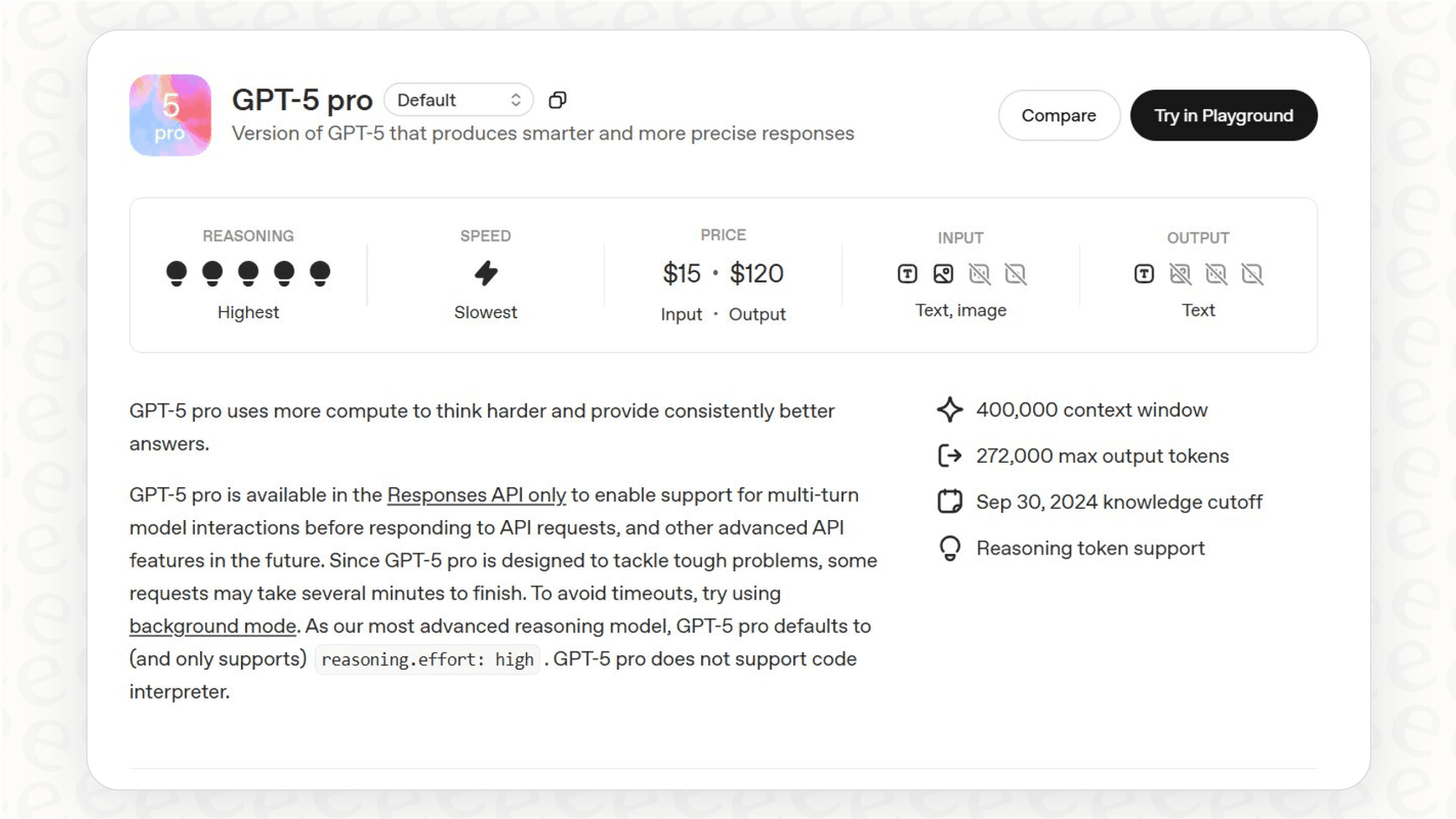

O preço desta API baseia-se em "tokens", que são pequenas porções de palavras (um token equivale a cerca de três quartos de uma palavra). Paga pelos tokens que envia (input) e pelos tokens que recebe de volta (output). Isto é bom para começar, mas pode tornar os seus custos realmente difíceis de prever. Se a sua equipa de suporte for inundada com pedidos num mês, a sua fatura da API pode disparar sem qualquer aviso.

Aqui está uma rápida visão de como os preços das suas APIs se comparam para alguns dos seus modelos populares.

| Modelo | Fornecedor | Preço de Input (por 1M de tokens) | Preço de Output (por 1M de tokens) |

|---|---|---|---|

| GPT-4o | OpenAI | $2.50 | $10.00 |

| Claude 3.5 Sonnet | Anthropic | $3.00 | $15.00 |

| Claude 3 Opus | Anthropic | $15.00 | $75.00 |

| Claude 3 Haiku | Anthropic | $0.25 | $1.25 |

Os preços baseiam-se em informações públicas do final de 2024 e podem mudar.

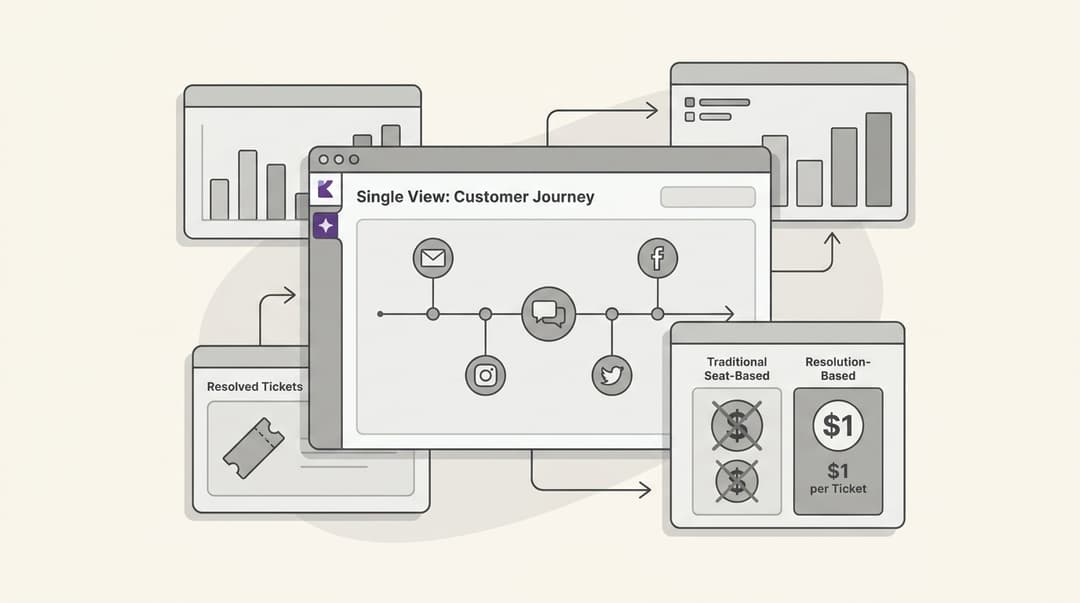

A maior dor de cabeça com os preços baseados em tokens é tentar orçamentar. Como pode prever os seus custos quando estão diretamente ligados ao número de clientes que o contactam? É aqui que uma abordagem diferente pode fazer muito mais sentido. Em contraste, os preços da eesel AI são claros e previsíveis. Os planos baseiam-se num número fixo de conversas de IA por mês, sem taxas extra por pedido resolvido. Isto permite-lhe escalar a sua automação de suporte sem se preocupar com uma fatura surpresa no final do mês.

A solução: Pensar para além do debate sobre a API

Então, aqui está a verdadeira questão: se o seu objetivo é automatizar o suporte ao cliente, faz realmente sentido que os seus engenheiros passem meses a construir e a manter uma solução personalizada numa API em bruto? Para a maioria das empresas, a resposta é provavelmente não.

Uma plataforma de integração de IA é a forma mais inteligente e rápida de o fazer.

-

Comece em minutos, não em meses: Com uma ferramenta como a eesel AI, pode conectar o seu help desk, como o Zendesk ou o Freshdesk, e todas as suas fontes de conhecimento, Confluence, Google Docs, ou até mesmo pedidos de suporte antigos, com apenas alguns cliques. É uma plataforma self-service que está a anos-luz do longo e penoso desenvolvimento de construir de raiz.

-

Reúna todo o seu conhecimento: Em vez de começar com uma IA genérica, a eesel AI aprende instantaneamente com o conhecimento real da sua empresa. Lê os seus pedidos antigos, wikis internas e documentos do centro de ajuda para dar respostas que são precisas, específicas para si e na voz da sua marca.

-

Teste sem risco: Este é um ponto muito importante. O motor de simulação da eesel AI permite-lhe testar o seu agente de IA em milhares de pedidos de suporte antigos num ambiente seguro. Obtém uma previsão precisa de quão bem ele irá desempenhar antes de o ativar para clientes reais, o que elimina grande parte do risco da equação.

Fazer a escolha certa para o seu objetivo

Quando está a decidir entre a OpenAI e a Anthropic, a escolha certa depende realmente de onde quer chegar.

-

Escolha a API da OpenAI se precisar de máxima flexibilidade, as mais recentes funcionalidades multimédia e uma base para construir todo o tipo de aplicações de uso geral.

-

Escolha a API da Anthropic se precisar de fiabilidade de nível empresarial, segurança de topo e um modelo que seja um especialista em analisar documentos longos e complexos.

Mas para a maioria das empresas que tentam resolver um problema específico como a automação do suporte ao cliente, a questão "construir vs. comprar" é muito mais importante do que a questão "OpenAI vs. Anthropic". Construir de raiz é um caminho longo, caro e arriscado.

Plataformas como a eesel AI dão-lhe um caminho direto para os resultados. Oferecem a forma mais rápida, fiável e económica de usar IA poderosa num ambiente empresarial, permitindo que se foque em deixar os seus clientes felizes em vez de gerir a infraestrutura da API.

Pronto para ver como o suporte alimentado por IA pode ser fácil? Comece a usar a eesel AI em minutos e veja como pode transformar as suas operações de atendimento ao cliente.

Perguntas frequentes

A OpenAI foca-se na criação de modelos de uso geral poderosos e versáteis como o GPT-4o, enfatizando a aplicabilidade ampla e a flexibilidade para diversas tarefas. A Anthropic, com os seus modelos Claude, prioriza a segurança da IA, a previsibilidade e a adesão a princípios éticos através do seu treino de "IA Constitucional".

A API da OpenAI oferece mais flexibilidade na estrutura de mensagens e um robusto sistema de chamada de múltiplas ferramentas para fluxos de trabalho complexos. A API da Anthropic é mais rigorosa com os seus padrões de mensagem "utilizador" -> "assistente" e o seu uso de ferramentas pode parecer mais rígido e intensivo em tokens, exigindo frequentemente uma orientação mais sequencial.

Embora a OpenAI seja altamente versátil, os modelos Claude da Anthropic destacam-se particularmente em contextos empresariais. São ideais para tarefas que envolvem análise extensiva de documentos ou suporte ao cliente detalhado, onde a previsibilidade, uma grande janela de contexto e funcionalidades de segurança integradas são cruciais.

Ambas as plataformas usam principalmente uma estrutura de preços de API baseada em tokens, de pagamento conforme o uso, cobrando tanto pelos tokens de entrada como pelos de saída. Este modelo, embora comum, pode dificultar o orçamento, pois os custos flutuam diretamente com o volume de uso, levando a faturas mensais potencialmente imprevisíveis.

Para empresas que visam automatizar funções específicas como o suporte ao cliente, uma plataforma de integração como a eesel AI pode ser uma escolha mais rápida e económica. Ela lida com as complexidades da API, integra várias fontes de conhecimento e oferece preços previsíveis, permitindo que se foque nos resultados do negócio em vez da infraestrutura.

A OpenAI utiliza a Aprendizagem por Reforço com Feedback Humano (RLHF) para alinhar os modelos com os valores humanos, o que por vezes pode refletir preconceitos subtis dos treinadores humanos. A Anthropic emprega a "IA Constitucional", treinando modelos com princípios éticos explícitos para alcançar um comportamento mais previsível e inerentemente mais seguro, sem intervenção humana constante.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.