Si vous êtes développeur, vous avez probablement vu ce que des modèles comme GPT-4o peuvent faire et vous avez pensé à construire quelque chose avec eux. Le principal point d'entrée est l'API OpenAI, mais travailler directement avec elle signifie écrire beaucoup de requêtes HTTP répétitives. C'est là que les SDK OpenAI (Software Development Kits) entrent en jeu. Ce sont essentiellement des boîtes à outils pour différents langages de programmation qui rendent l'appel de l'API beaucoup plus facile.

Mais voilà le problème : si les SDK sont parfaits pour démarrer, la construction d'une application complète et prête pour la production pour quelque chose comme l'assistance clientèle est une bête complètement différente. Il ne s'agit pas seulement de quelques appels d'API. Vous devez penser à l'historique des conversations, à l'extraction de données provenant de différents endroits et à une tonne de tests. Tout cela s'ajoute à beaucoup de temps d'ingénierie. Alors, passons en revue ce que sont les SDK OpenAI, ce que vous pouvez faire avec eux et certaines des complexités du monde réel à garder à l'esprit. Nous examinerons également un moyen d'obtenir des agents d'IA puissants en marche beaucoup plus rapidement.

Que sont les SDK OpenAI ?

Au fond, l'API OpenAI est un service RESTful auquel vous parlez via HTTP. Vous pourriez construire ces requêtes vous-même, mais c'est pénible et facile à gâcher. Les SDK OpenAI sont des bibliothèques officielles qui font le gros du travail pour vous. Ils vous donnent des fonctions et des classes simples pour utiliser l'API directement depuis votre langage de programmation préféré.

Considérez un SDK comme un wrapper convivial. Au lieu de vous soucier des détails des en-têtes d'authentification, du formatage des requêtes et de l'analyse des réponses, vous pouvez simplement faire un appel de fonction simple comme « client.responses.create() ».

OpenAI a des SDK pour un tas de langages populaires :

-

Python : Le choix idéal pour la plupart des travaux d'IA et d'apprentissage automatique.

-

TypeScript / JavaScript (Node.js) : Parfait pour les applications web et les services backend.

-

.NET : Pour tous ceux qui travaillent dans le monde C# et Microsoft.

-

Java : Un choix solide pour les applications plus grandes de style entreprise.

-

Go : Idéal si vous avez besoin de vitesse et d'une bonne concurrence.

Et si votre langage de choix ne figure pas dans cette liste, la communauté a probablement construit une bibliothèque pour celui-ci. L'idée générale est toujours la même : installez le SDK, prenez votre clé API secrète depuis votre tableau de bord OpenAI, et vous pouvez commencer à appeler les modèles depuis votre code.

Principales fonctionnalités et cas d'utilisation des SDK OpenAI

Une fois que vous êtes configuré, les SDK ouvrent la porte à de nombreuses capacités différentes. Voici les principales choses que les gens construisent avec eux.

Génération de texte et de réponses

C'est le pain et le beurre. En utilisant le point de terminaison responses.create, vous pouvez envoyer une invite à un modèle comme « gpt-4o » et obtenir une réponse textuelle. C'est la base de tout, d'un simple générateur de contenu à un chatbot conversationnel complet. Pour donner du contexte au modèle, vous pouvez passer une série de messages dans votre requête, ce qui l'aide à suivre la conversation.

Multimodalité (analyse d'image, d'audio et de fichiers)

Les modèles plus récents comme GPT-4o ne se limitent pas au texte ; ils sont multimodaux. Les SDK OpenAI vous permettent d'inclure différents types de contenu dans vos invites :

-

Images : Vous pouvez passer une URL d'image ou en télécharger une directement et demander au modèle de vous dire ce qu'elle contient, de répondre à des questions à ce sujet ou même d'en extraire du texte.

-

Audio : Les modèles peuvent transcrire des fichiers audio en texte.

-

Fichiers : Vous pouvez télécharger des documents tels que des PDF et demander au modèle de les résumer ou de répondre à des questions en fonction de leur contenu.

Extension des modèles avec des outils (appel de fonction)

C'est là que les choses deviennent vraiment intéressantes. La fonctionnalité « outils » (qui s'appelait auparavant appel de fonction) vous permet de donner au modèle un ensemble de fonctions personnalisées qu'il peut demander à utiliser. Par exemple, vous pouvez définir une fonction appelée get_weather. Si un utilisateur demande « Quel temps fait-il à Paris ? », le modèle n'inventera pas simplement quelque chose. Il renverra un objet JSON indiquant qu'il souhaite appeler votre fonction get_weather avec le paramètre location : "Paris".

Votre code exécute ensuite la fonction, récupère les données météorologiques réelles et renvoie ces informations au modèle. Le modèle utilise ensuite ces données pour donner à l'utilisateur une réponse naturelle. C'est ainsi que vous créez des applications qui peuvent interagir avec le monde extérieur.

Un conseil rapide : bien que vous puissiez créer vos propres appels de fonction pour rechercher les données de commande dans votre base de données, vous devez créer et héberger toute cette logique backend vous-même. Une alternative est une plateforme comme eesel AI, qui vous donne des actions d'IA prédéfinies et un constructeur de flux de travail visuel. Vous pouvez vous connecter à des outils comme Shopify ou des bases de données internes sans écrire toute la plomberie à partir de zéro, ce qui vous permet de gagner beaucoup de temps de développement.

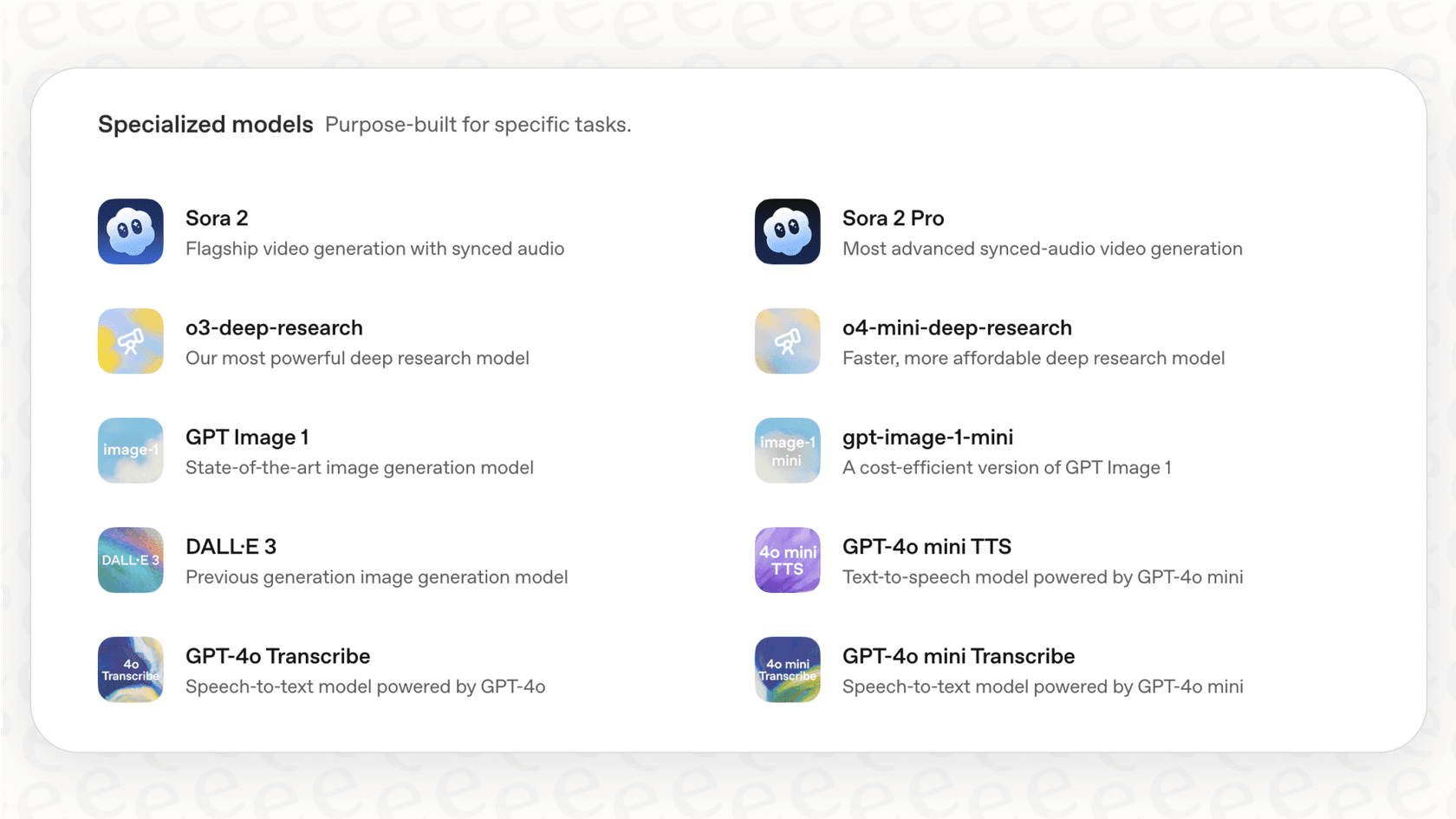

Création d'agents avancés avec le SDK Agents

Pour les tâches plus complexes, OpenAI a un SDK Agents spécialisé. C'est pour la construction d'applications « agentiques », où une IA peut s'attaquer à des problèmes en plusieurs étapes et même se coordonner avec d'autres agents d'IA. C'est puissant, mais c'est aussi un grand pas en avant en termes de complexité.

Le SDK Agents est basé sur quelques idées principales :

-

Agents : Un LLM qui a des instructions spécifiques et une boîte à outils de fonctions qu'il peut utiliser.

-

Transferts : Cela permet à un agent de transmettre une tâche à un autre agent plus spécialisé. Pensez à un agent de triage général qui transmet un rapport de bogue à un agent de support technique.

-

Garde-corps : Ce sont des règles que vous mettez en place pour vérifier le travail d'un agent, en vous assurant qu'il reste sur le sujet et ne s'écarte pas du sujet.

-

Sessions : Le SDK gère automatiquement l'historique des conversations pour vous, même lorsque les tâches sont transmises entre différents agents.

L'utilisation du SDK Agents vous permet de créer une logique assez sophistiquée en Python ou TypeScript. Mais c'est un outil de très bas niveau. La construction de quelque chose qui est assez fiable pour une entreprise nécessite une compréhension approfondie de la conception des agents et une ingénierie logicielle solide.

C'est vraiment là qu'une plateforme spécialement conçue est utile. Assembler vous-même un système de support multi-agents est une entreprise majeure. Pour les besoins de l'entreprise comme le service client, une approche de plateforme est presque toujours plus rapide et plus facile à mettre à l'échelle. Par exemple, eesel AI vous donne un moteur de flux de travail entièrement personnalisable. Vous pouvez définir comment vos agents d'IA doivent se comporter, configurer des escalades (qui sont comme des transferts) et choisir vos sources de connaissances à partir d'un tableau de bord simple. Cela vous permet d'être opérationnel en quelques minutes, pas en quelques mois.

Les coûts cachés et les défis de l'utilisation des SDK OpenAI

Les SDK donnent l'impression qu'il est facile de démarrer, mais le chemin d'un simple script à une application de production a quelques bosses et des coûts cachés que vous devriez connaître.

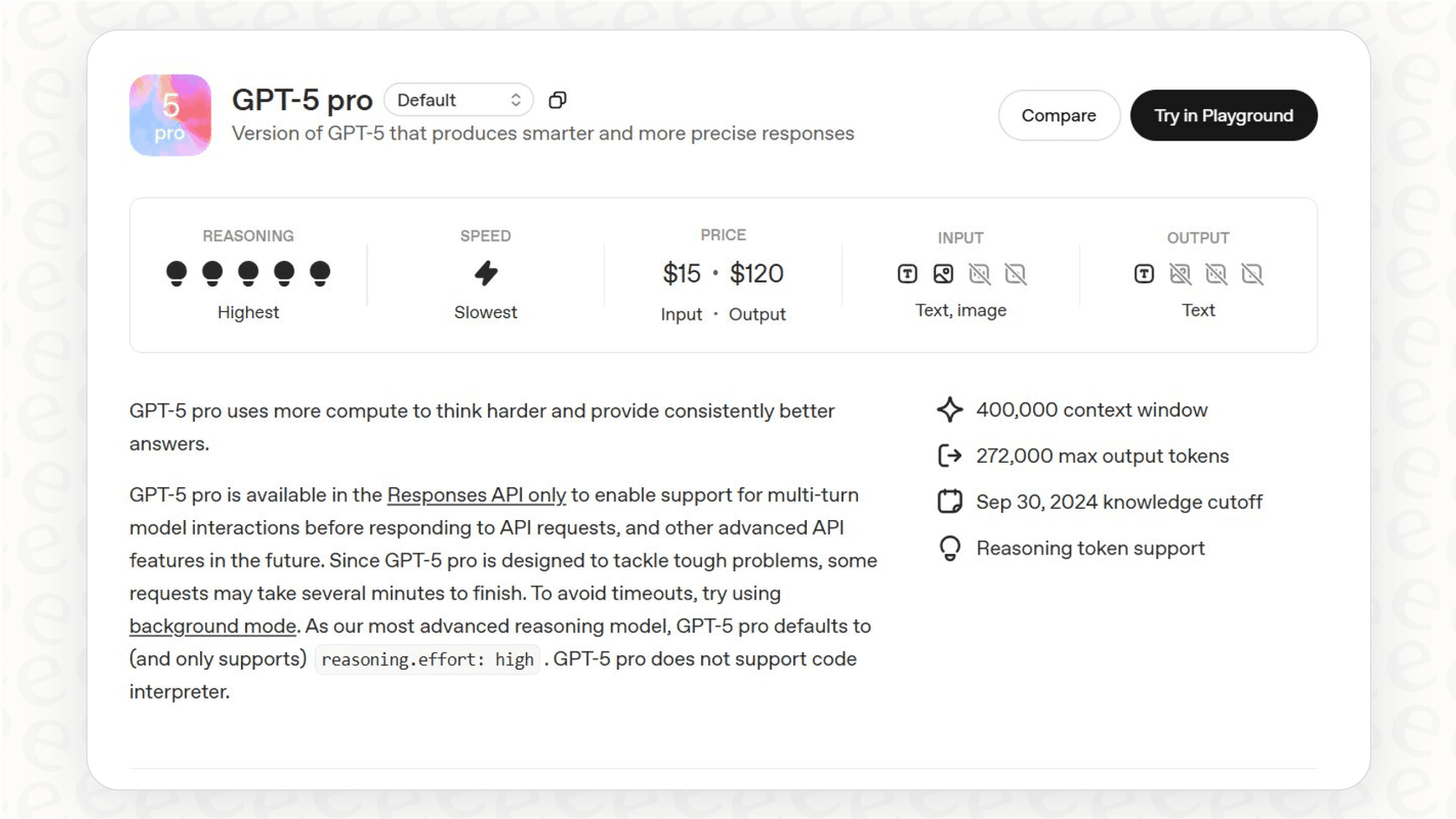

Comprendre la tarification de l'API

La tarification d'OpenAI est principalement à l'utilisation, basée sur les « tokens » (qui sont à peu près des parties de mots). Vous payez pour les tokens que vous envoyez dans votre invite (entrée) et les tokens que le modèle renvoie (sortie). Ces coûts peuvent vous surprendre, surtout si vous envoyez de longues invites ou si vous gérez beaucoup de conversations.

Voici un aperçu rapide de la tarification standard pour quelques modèles (par million de tokens, à partir de fin 2025) :

| Modèle | Entrée (par 1 million de tokens) | Sortie (par 1 million de tokens) |

|---|---|---|

| gpt-4o | 2,50 $ | 10,00 $ |

| gpt-4o-mini | 0,15 $ | 0,60 $ |

| gpt-4.1 | 2,00 $ | 8,00 $ |

| gpt-5-mini | 0,25 $ | 2,00 $ |

Source : Tarification OpenAI. Les prix sont pour le niveau standard et peuvent changer.

Et il n'y a pas que les modèles. D'autres fonctionnalités ont également des coûts :

-

Outils : L'utilisation d'outils intégrés comme Code Interpreter ou File Search ajoute des frais supplémentaires par session ou en fonction du stockage.

-

Ajustement fin : Si vous entraînez un modèle personnalisé, vous paierez pour le processus d'entraînement et pour l'utilisation du modèle.

Cette tarification par token peut rendre votre facture mensuelle imprévisible, ce qui n'est pas idéal pour la budgétisation. En revanche, des services comme eesel AI offrent une tarification claire et prévisible basée sur un nombre fixe d'interactions d'IA. Vous savez exactement ce que vous payez, ce qui facilite grandement la prévision des coûts.

Les frais généraux d'ingénierie de la construction d'une solution complète

Un appel d'API n'est qu'une infime partie d'une application réelle. Un agent de support d'IA véritablement utile a besoin de toute une infrastructure derrière lui, que vous devez construire et entretenir.

-

Gestion des connaissances (RAG) : Pour qu'une IA réponde aux questions avec précision, elle a besoin du contexte des documents de votre entreprise. Vous devrez construire un système de génération augmentée de récupération (RAG). Cela implique de diviser vos documents, de créer des incorporations, de configurer une base de données vectorielle et de créer un moyen de récupérer les bonnes informations.

-

Intégrations : Votre IA doit communiquer avec votre service d'assistance (Zendesk, Intercom), vos bases de connaissances internes (Confluence, Google Docs) et d'autres outils d'entreprise (Shopify, Jira). Chacune de ces connexions est son propre mini-projet.

-

Tests et validation : Comment savez-vous si votre IA aide réellement ou aggrave les choses ? Vous devez construire un cadre de test pour l'exécuter sur vos anciens tickets de support afin de voir comment il fonctionne.

-

Maintenance et amélioration : Les modèles sont mis à jour, vos documents internes changent et les besoins de votre entreprise évoluent. Une solution personnalisée a besoin de soins et d'alimentation constants pour rester efficace.

Description Créer une infographie avec un cercle central étiqueté « Application d'IA de production ». Quatre flèches pointent loin du cercle vers quatre autres cases :

-

Gestion des connaissances (RAG) : Inclure des icônes pour la division de documents, l'incorporation et une base de données vectorielle.

-

Intégrations : Inclure les logos d'outils populaires comme Zendesk, Shopify, Confluence et Jira.

-

Tests et validation : Inclure des icônes représentant les tests A/B, les mesures de performance et l'analyse de données.

-

Maintenance et amélioration : Inclure des icônes pour les mises à jour de modèles, les cycles d'actualisation de données et la surveillance continue.

L'infographie doit représenter visuellement qu'un simple appel d'API n'est que la partie émergée de l'iceberg.

Ce sont exactement les maux de tête que les plateformes comme eesel AI sont conçues pour résoudre. eesel se connecte à toutes vos sources de connaissances avec des intégrations en un clic, prend en charge l'ensemble du pipeline RAG pour vous et dispose même d'un mode de simulation puissant pour tester votre agent d'IA sur des milliers de tickets réels avant qu'un seul client ne lui parle.

Un chemin plus simple vers une IA prête pour la production

Les SDK OpenAI sont des outils de développement fantastiques. Ils sont les éléments constitutifs essentiels pour quiconque fait un travail d'IA personnalisé et approfondi.

Mais pour des problèmes commerciaux spécifiques, comme l'automatisation du support client, la rationalisation des services d'assistance informatique ou la mise en place d'un robot interne de questions-réponses, la construction à partir de zéro est souvent un voyage lent, coûteux et risqué. La question n'est pas seulement de savoir ce qui est techniquement possible ; il s'agit de savoir à quelle vitesse vous pouvez obtenir de la valeur, de la fiabilité du produit final et du coût total au fil du temps.

Pourquoi passer des mois à réinventer la roue alors qu'une plateforme dédiée peut vous donner une solution plus puissante, intégrée et éprouvée en une fraction du temps ? En gérant les parties désordonnées comme les pipelines de données, les intégrations et la logique d'agent, les plateformes comme eesel AI permettent à votre équipe de se concentrer sur ce qui compte vraiment : créer une excellente expérience pour vos clients et vos employés.

Si votre objectif est de résoudre un problème de support aujourd'hui, et non de lancer un projet de R&D à long terme, alors une approche basée sur une plateforme est probablement le bon choix.

Passez en direct avec votre agent d'IA en quelques minutes

Prêt à voir ce qu'un agent de support d'IA de qualité production peut faire pour vous ? Avec eesel AI, vous pouvez connecter votre service d'assistance et vos bases de connaissances en un seul clic, simuler les performances sur vos données réelles et déployer un agent d'IA, copilote ou chatbot entièrement personnalisé. Le tout sans écrire une seule ligne de code.

Commencez votre essai gratuit dès aujourd'hui et voyez par vous-même.

Foire aux questions

Les SDK OpenAI sont des bibliothèques officielles pour divers langages de programmation qui agissent comme un wrapper autour de l'API OpenAI. Ils gèrent les détails de bas niveau tels que les requêtes HTTP, l'authentification et l'analyse des réponses, permettant aux développeurs d'effectuer des appels d'API avec des appels de fonction simples, spécifiques à la langue.

OpenAI fournit des SDK officiels pour plusieurs langages de programmation populaires, notamment Python, TypeScript/JavaScript (Node.js), .NET (C#), Java et Go. Ces SDK répondent à un large éventail d'environnements de développement pour la création de différents types d'applications.

Oui, les SDK OpenAI prennent entièrement en charge la fonctionnalité "tools" (anciennement appelée appel de fonction), qui vous permet de définir des fonctions personnalisées que le modèle peut demander à utiliser. Lorsque le modèle détermine qu'une fonction est pertinente pour la demande d'un utilisateur, il renvoie un objet JSON spécifiant la fonction et ses paramètres pour que votre code l'exécute.

Les principaux défis comprennent d'importants frais généraux d'ingénierie pour la mise en œuvre de la gestion des connaissances (RAG), la création et la maintenance d'intégrations personnalisées et le développement de cadres de test robustes. Ces aspects exigent un temps de développement considérable et une maintenance continue pour une solution prête à la production, en plus de la tarification de l'API.

Le SDK Agents spécialisé est conçu pour créer des applications agentiques sophistiquées, offrant des fonctionnalités telles que les transferts d'agents, les garde-fous pour un comportement contrôlé et la gestion automatique des sessions pour l'historique des conversations. Il facilite une approche structurée pour la résolution de problèmes en plusieurs étapes et la coordination de plusieurs agents d'IA, simplifiant ainsi la logique complexe des agents.

Bien que les SDK OpenAI soient excellents pour le développement d'IA personnalisé et approfondi, les plateformes dédiées comme eesel AI offrent souvent un chemin plus rapide et plus efficace vers la production pour des solutions d'entreprise spécifiques. Ces plateformes font abstraction de l'infrastructure complexe, des pipelines de données et des intégrations, réduisant considérablement les frais généraux d'ingénierie et accélérant le déploiement.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.

Les SDK OpenAI activent les capacités multimodales en vous permettant d'inclure divers types de contenu tels que des URL d'images, des images téléchargées, des fichiers audio et des documents directement dans vos invites. Cela permet aux modèles comme GPT-4o d'analyser et de répondre à divers intrants au-delà du simple texte.