OpenAI a récemment publié GPT 5.2, qu'elle qualifie elle-même de « modèle le plus avancé ». L'annonce était accompagnée de benchmarks (tests de performance) impressionnants, promettant des avancées significatives en programmation, en raisonnement et en vision. Sur le papier, c'est incroyable.

Cependant, depuis sa mise à disposition des utilisateurs, l'accueil est plutôt mitigé. Il semble y avoir un écart entre les tests en laboratoire et ce que les gens vivent au quotidien. Alors, qu'en est-il réellement ?

Cet article propose un regard équilibré sur ce qu'est GPT 5.2, ce qu'il promet, ses points faibles apparents et ce que tout cela signifie pour les entreprises à la recherche de solutions d'IA.

Qu'est-ce que GPT 5.2 ? Une famille de nouveaux modèles

Tout d'abord, GPT 5.2 n'est pas un seul modèle. C'est la toute dernière série de grands modèles de langage (LLM) d'OpenAI, conçus pour des tâches professionnelles complexes. Il s'agit d'une famille d'options, chacune étant adaptée à des besoins et des budgets différents.

Selon l' annonce officielle d'OpenAI, voici la répartition de la famille :

-

GPT-5.2 Instant : C'est la version rapide conçue pour les tâches quotidiennes et l'apprentissage au sein de ChatGPT. Elle est faite pour obtenir des réponses rapides.

-

GPT-5.2 Thinking : C'est le modèle central pour les travaux plus profonds et complexes comme le code et l'analyse. Si vous utilisez l'API, c'est celui que vous appellerez avec

gpt-5.2. -

GPT-5.2 Pro : L'option la plus puissante et la plus précise de la gamme. Elle est destinée aux questions difficiles où l'obtention de la meilleure réponse possible est la priorité absolue.

En parallèle, OpenAI a également déployé GPT-5 mini comme option plus petite et plus efficace, ainsi qu'un modèle spécialisé GPT-5.2-Codex pour les développeurs. Il est clair qu'ils tentent de couvrir tous les besoins en proposant une gamme de modèles variés.

L'histoire officielle : nouvelles fonctionnalités et améliorations revendiquées

Sur la base des supports de lancement d'OpenAI, le modèle affiche des gains significatifs par rapport aux versions précédentes. Analysons les domaines clés où GPT 5.2 est censé exceller, selon leur documentation officielle.

Performance accrue sur les tâches professionnelles

L'une des promesses de GPT 5.2 est sa capacité à gérer le travail intellectuel professionnel et à libérer davantage de valeur économique. OpenAI affirme qu'il est bien meilleur que ses prédécesseurs pour créer des feuilles de calcul, concevoir des présentations et rédiger du code sophistiqué.

Pour étayer cela, ils s'appuient sur le benchmark GDPval, où le modèle est censé surpasser les professionnels du secteur sur plus de 70 % des tâches. Les améliorations en programmation sont particulièrement notables, le modèle atteignant de nouveaux scores records sur des benchmarks ardus comme SWE-Bench Pro (55,6 %). L'idée est qu'il peut désormais traiter des problèmes d'ingénierie logicielle plus complexes, allant au-delà de la simple génération de scripts basiques.

Raisonnement renforcé, vision et capacités de contexte long

OpenAI souligne également la capacité du modèle à raisonner à travers des informations complexes, en particulier sur de longs documents. Le test « needle in a haystack » (une aiguille dans une botte de foin) d'OpenAI (MRCRv2), qui vérifie si un modèle peut trouver une information spécifique dans un large corpus de texte, a montré une précision quasi parfaite. Cela suggère que vous pourriez lui fournir un rapport volumineux et lui faire confiance pour en extraire les détails dont vous avez besoin.

Ses capacités de vision ont également été améliorées, les taux d'erreur sur des tâches telles que le raisonnement sur des graphiques et la compréhension des interfaces logicielles ayant été réduits de moitié environ. En théorie, vous pouvez lui montrer un tableau de bord complexe ou un schéma de carte mère, et il aura une bien meilleure compréhension spatiale de ce qu'il voit. Il a également obtenu les meilleures notes sur des benchmarks scientifiques et mathématiques comme GPQA Diamond (92,4 %) et FrontierMath (40,3 %), repoussant les limites de ce que l'IA peut faire dans des domaines hautement techniques.

Appel d'outils plus fiable pour les flux de travail agentiques

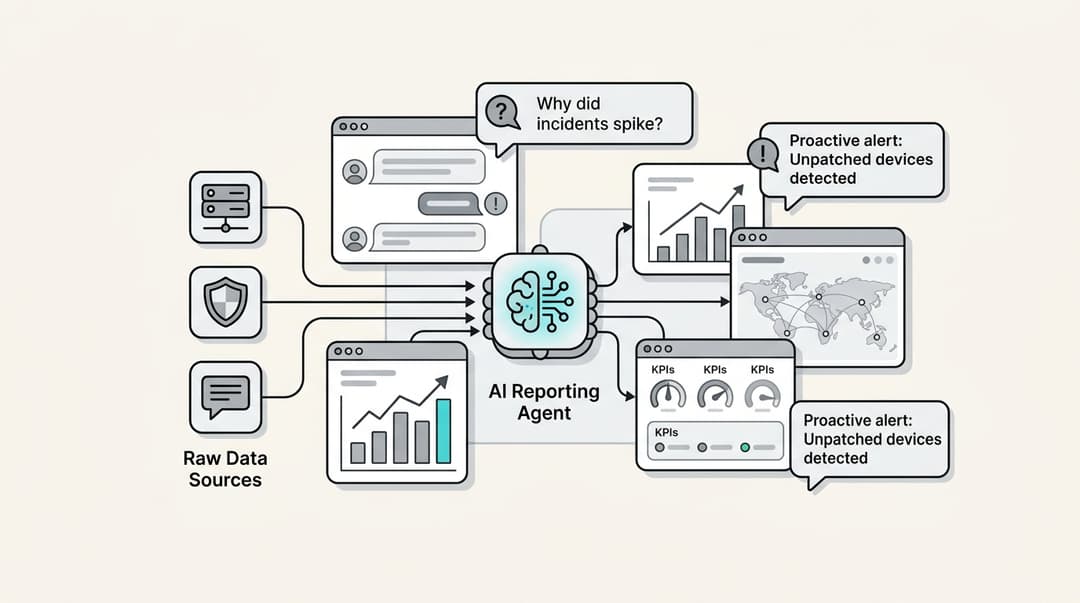

Il s'agit d'une fonctionnalité plus technique, mais elle est cruciale pour créer des applications d'IA pratiques. L'« appel d'outils » (tool calling) est la manière dont un modèle d'IA interagit avec d'autres logiciels pour effectuer des actions, comme rechercher une commande dans Shopify ou créer un ticket dans Jira. GPT 5.2 est conçu pour être bien plus performant dans l'exécution de ces tâches complexes et multi-étapes du début à la fin.

Il a obtenu un score impressionnant de 98,7 % sur le benchmark Tau2-bench Telecom, un test conçu pour simuler des tâches de support client à plusieurs tours. En pratique, cela signifie que vous pouvez créer des agents d'IA plus fiables, capables de gérer des flux de travail entiers, comme la résolution du problème d'expédition d'un client ou l'analyse de données de vente, avec moins d'erreurs.

Introduction de GPT-5.2-Codex pour la programmation avancée

Pour les développeurs, OpenAI a également lancé GPT-5.2-Codex, une version du modèle spécifiquement optimisée pour « l'ingénierie logicielle et la cybersécurité ». Il ne s'agit pas seulement d'écrire quelques lignes de code ; il est conçu pour gérer de vastes bases de code et aider à des tâches longues et complexes comme les migrations de code et les refactorisations.

Il est également doté d'une sensibilité accrue à la sécurité. Pour l'instant, il est disponible via les interfaces Codex pour les utilisateurs payants de ChatGPT, l'accès à l'API étant prévu plus tard. Cela indique la volonté d'OpenAI de faire de ses modèles des outils essentiels pour les équipes de développement logiciel.

Expériences réelles : un bilan mitigé pour les utilisateurs

Les benchmarks sont une chose, mais le test ultime est la performance du modèle pour les personnes réelles dans leur travail quotidien. Depuis la sortie de GPT 5.2, les retours sur les forums de développeurs et dans des publications comme Medium sont variés.

De nombreux utilisateurs rencontrent des problèmes que les benchmarks ne capturent tout simplement pas, créant un fossé entre les performances annoncées et la réalité quotidienne.

Préoccupations concernant le ton et l'augmentation des refus

L'une des plaintes les plus courantes concerne la personnalité du modèle. De nombreux utilisateurs décrivent son ton comme « plus plat et trop aseptisé », comme s'il avait été entraîné à être si prudent qu'il est moins capable d'improviser ou de faire preuve de créativité.

Je ne veux pas d'un 'Yes Man', mais je ne veux pas non plus d'un assistant méfiant et paranoïaque qui pense que je détourne chaque requête, même les plus banales. Nous parlions d'escroqueries en ligne, je lui ai demandé d'expliquer cette arnaque de manière simple et il m'a répondu 'Je ne peux pas encourager les escroqueries'... Mince, je lui ai demandé de l'expliquer simplement, pas de m'aider à escroquer !!!

Cela rejoint un autre problème majeur : l'augmentation des refus. Les utilisateurs signalent que le modèle est désormais excessivement prudent et refuse parfois de discuter de sujets ou de réaliser des tâches que les versions précédentes géraient sans problème. Pour quiconque compte sur le modèle pour de l'écriture créative, du brainstorming ou l'exploration de sujets nuancés, cela peut présenter des défis. Certains utilisateurs ont l'impression d'un recul en termes d'utilisabilité, même si la technologie sous-jacente est plus puissante.

Performances incohérentes et problèmes de contexte

Encore plus préoccupants sont les rapports de performances incohérentes. Certains utilisateurs estiment que pour leurs tâches spécifiques, le modèle semble moins efficace que GPT-4. Il peut obtenir d'excellents résultats lors d'un test de référence, mais avoir des difficultés avec un problème de bon sens.

La chose la plus agaçante que j'ai remarquée, c'est que je lui demande quelque chose et il répond. Je lui demande ensuite autre chose et il répond à la première question en même temps qu'à la seconde.

Une autre plainte fréquente est que le modèle perd le contexte ou se contredit lors de longues conversations. C'est inattendu, compte tenu des affirmations d'OpenAI sur ses performances lors des tests de contexte long. Comme l'a souligné un critique, « les benchmarks sont propres. Les documents réels ne le sont pas ». Les cas d'utilisation réels sont désordonnés, et il semble que le modèle puisse encore trébucher. Cette incohérence rend difficile pour les entreprises la mise en place de flux de travail fiables reposant sur le modèle brut. Cela peut nécessiter une ingénierie de prompt (prompt engineering) plus minutieuse pour obtenir le résultat souhaité.

Pour les applications professionnelles telles que l'IA pour le service client, la prévisibilité est essentielle. Les plateformes spécialisées comme eesel AI sont conçues pour offrir des performances cohérentes et conformes à l'image de marque. Ces plateformes apprennent directement des données propres de l'entreprise et des conversations réussies passées pour fournir des réponses sur mesure.

Comprendre la tarification et l'accessibilité

Si l'on met de côté les performances, le coût et l'accessibilité d'un nouveau modèle sont des facteurs déterminants pour toute entreprise. GPT 5.2 arrive avec une nouvelle structure tarifaire qui le positionne comme un modèle premium de qualité entreprise. Examinons les chiffres de la page de tarification officielle d'OpenAI.

Structure tarifaire de l'API

Les tarifs standards de l'API pour les nouveaux modèles sont nettement plus élevés que ceux des versions précédentes, signalant que cette puissance a un coût. Pour les entreprises capables de gérer des tâches asynchrones (c'est-à-dire qui n'ont pas besoin d'une réponse instantanée), OpenAI propose également une Batch API qui offre une réduction de 50 %, ce qui est incitatif pour les charges de travail non urgentes.

Voici une répartition claire des coûts standards par million de jetons (tokens) pour l'entrée et la sortie, ce qui devrait vous aider à comparer les options. Cette comparaison visuelle souligne la différence de coût significative entre les modèles.

| Modèle | Entrée (par 1M de jetons) | Sortie (par 1M de jetons) |

|---|---|---|

| gpt-5.2-pro | 21,00 $ | 168,00 $ |

| gpt-5.2 | 1,75 $ | 14,00 $ |

| gpt-5-mini | 0,25 $ | 2,00 $ |

Ce que cette tarification signifie pour les entreprises

Alors, que signifie réellement cette tarification ? GPT 5.2 est une matière première puissante mais brute. Le coût variable basé sur les jetons peut rendre la budgétisation de l'IA difficile, surtout si les incohérences du modèle vous obligent à exécuter le même prompt plusieurs fois pour obtenir un résultat utilisable. Chaque tentative coûte de l'argent.

Le prix plus élevé de gpt-5.2-pro, en particulier pour sa sortie, signifie qu'il est probablement mieux adapté à des tâches de très haute valeur et très spécifiques où le coût peut être justifié. Pour de nombreux besoins quotidiens en entreprise, il n'est peut-être pas nécessaire.

Les entreprises qui recherchent des coûts d'IA prévisibles peuvent envisager différents modèles. Par exemple, certains services comme eesel AI proposent une tarification basée sur l'interaction. Avec ce modèle, les coûts sont liés aux résultats (comme un ticket résolu) plutôt qu'au calcul des jetons. Cette approche peut simplifier les prévisions de coûts et la mesure du ROI.

GPT 5.2 est-il un outil puissant qui nécessite une manipulation prudente ?

Alors, quelle est la conclusion finale sur GPT 5.2 ? D'un côté, il établit de nouveaux records sur les benchmarks techniques et représente une prouesse d'ingénierie incroyable. De l'autre, il présente également des défis en termes de cohérence et d'utilisabilité dans les applications réelles, certains adopteurs précoces signalant un écart entre les performances des benchmarks et leur expérience.

Pour les équipes techniques ayant le temps, le budget et l'expertise nécessaires pour expérimenter, affiner les prompts et mettre en place des garde-fous étendus, il offre une puissance phénoménale.

Cependant, de nombreuses entreprises ne cherchent pas à travailler directement avec un modèle d'IA brut. Elles cherchent à résoudre des problèmes spécifiques, comme réduire les tickets de support ou accéder aux connaissances internes. L'objectif est le résultat, pas le processus.

Une alternative à la construction à partir de zéro est l'utilisation d'une solution spécialisée. eesel AI propose des produits conçus pour des besoins spécifiques en entreprise. Il apprend des données de l'entreprise pour fournir des réponses adaptées au contexte de l'organisation. Découvrez comment un Agent d'IA peut commencer à résoudre vos tickets de support dès aujourd'hui.

Pour voir certains de ces tests en conditions réelles, cette vidéo de Fireship propose une analyse rapide et pertinente des performances de GPT 5.2, soulignant à la fois ses points forts et les aspects où il semble ne pas être à la hauteur de l'engouement suscité.

Questions fréquemment posées

GPT 5.2 est la dernière série de modèles de langage d'OpenAI, conçue pour des tâches professionnelles complexes. Il ne s'agit pas d'un modèle unique mais d'une famille (Instant, Thinking, Pro et mini) qui promet des améliorations majeures dans le code, le raisonnement et la compréhension de documents longs par rapport aux versions plus anciennes comme GPT-4.

Selon les benchmarks d'OpenAI, oui. Ils ont publié un modèle spécialisé, GPT-5.2-Codex, qui a obtenu des scores plus élevés lors de tests difficiles d'ingénierie logicielle. Cependant, certains développeurs ont fait état de résultats mitigés dans des conditions réelles, votre expérience peut donc varier.

Cela semble être dû à plusieurs facteurs. Les utilisateurs ont souligné que le ton de GPT 5.2 peut paraître « plat » ou excessivement prudent, ce qui l'amène à refuser certaines tâches. D'autres ont trouvé qu'il manquait de cohérence et pouvait perdre le contexte dans les conversations longues, ce qui n'est pas toujours capturé lors des tests de référence classiques.

Le prix de GPT 5.2 varie selon le modèle. Le modèle standard `gpt-5.2` coûte 1,75 $ pour l'entrée et 14,00 $ pour la sortie par million de jetons (tokens). La version la plus puissante, `gpt-5.2-pro`, est beaucoup plus coûteuse, à 21,00 $ pour l'entrée et 168,00 $ pour la sortie par million de jetons.

Bien que cela soit possible, la variabilité des performances du modèle et les coûts basés sur les jetons sont des facteurs à prendre en compte pour des fonctions critiques comme le support client. Les entreprises utilisent souvent des plateformes spécialisées, telles que eesel AI, qui sont entraînées sur les données spécifiques de l'entreprise pour fournir des réponses cohérentes pour ces cas d'utilisation.

Share this article

Article by

Stevia Putri

Stevia Putri est une généraliste en marketing chez eesel AI, où elle aide à transformer des outils d'IA puissants en récits qui résonnent. Elle est animée par la curiosité, la clarté et le côté humain de la technologie.