Sie haben wahrscheinlich schon den Hype um die wahnsinnige Geschwindigkeit von Groq mitbekommen. Sie schlagen Wellen, indem sie große Sprachmodelle (LLMs) schneller ausführen als so ziemlich jeder andere. Ihr Geheimrezept? Maßgeschneiderte Language Processing Units (LPUs), ein völlig anderer Ansatz als die GPUs, die normalerweise die KI-Welt antreiben.

Aber wie bei jeder coolen neuen Technologie tauchen die großen Fragen auf: Wo ist der Haken? Wie viel kostet es? Und passt es wirklich zu dem, was Sie tun müssen?

Dieser Leitfaden führt Sie durch alles, was Sie über die Preisgestaltung von Groq wissen müssen. Wir werden uns ihr "Tokens-as-a-Service"-Modell ansehen, die Kosten für verschiedene KI-Modelle prüfen und genau die Situationen bestimmen, in denen Groq ein Star ist. Wir werden auch ehrlich über die Grenzen sprechen und eine praktischere All-in-One-Alternative für Teams untersuchen, die einfach nur KI zum Laufen bringen wollen, ohne ein riesiges Entwicklungsprojekt zu starten.

Was ist Groq? Die Technologie hinter der Preisgestaltung verstehen

Im Kern dreht sich bei Groq alles um spezialisierte Hardware. Sie haben einen Chip namens Language Processing Unit (LPU) entwickelt.

Stellen Sie es sich so vor: Die meiste KI läuft auf GPUs (Graphics Processing Units), den gleichen Chips, die auch High-End-Videospiele antreiben. Sie sind leistungsstark, aber sie sind Generalisten. Die LPUs von Groq wurden von Grund auf für eine einzige Aufgabe entwickelt: KI-Modelle blitzschnell auszuführen.

Dieser Prozess wird "Inferenz" genannt, es ist der Teil, in dem die KI tatsächlich die Arbeit erledigt, wie zum Beispiel eine Frage beantwortet oder einen Satz schreibt. Für etwas wie einen Chatbot oder einen Kundensupport-Agenten ist Geschwindigkeit hier alles. Niemand will auf eine Antwort warten; eine langsame, verzögerte KI fühlt sich einfach kaputt an.

Der Hauptvorteil von Groq ist seine unglaublich geringe Latenz und sein hoher Durchsatz (wie viele Wörter oder "Tokens" es pro Sekunde ausgeben kann). Es generiert Text so schnell, dass es sich fast augenblicklich anfühlt. Das haben sie mit einer einzigartigen Architektur geschafft, die die üblichen Engpässe in GPU-Systemen umgeht. Es ist kein Werkzeug zum Trainieren von KI-Modellen; es ist eine hochspezialisierte Maschine, um sie so schnell wie menschlich (oder unmenschlich) möglich auszuführen.

Das Preismodell von Groq im Detail

Die Preisgestaltung von Groq funktioniert nach einem "Pay-as-you-go"-Modell, was für KI-APIs ziemlich Standard ist. Ihnen werden "Tokens" in Rechnung gestellt, die Sie sich als kleine Wort-Teile vorstellen können. Sie bezahlen für die Tokens, die Sie einsenden (Ihre Anfrage), und die Tokens, die das Modell zurücksendet (die Antwort).

Es ist unkompliziert, bedeutet aber auch, dass Ihre Rechnung je nach Nutzung stark schwanken kann. Werfen wir einen Blick auf die offizielle Preisstruktur von Groq.

Groq-Preise für große Sprachmodelle (LLMs)

Groq bietet Ihnen Zugang zu einer Reihe von Open-Source-LLMs. Der Preis ändert sich je nach Größe und Intelligenz des Modells. Größere Modelle kosten in der Regel mehr pro Token, können aber komplexere Anfragen bewältigen.

Hier ist eine Tabelle, die die Preise für ihre beliebtesten Modelle darlegt, basierend auf den Informationen von ihrer offiziellen Preisseite.

| KI-Modell | Geschwindigkeit (Tokens/Sekunde) | Eingabepreis (pro Million Tokens) | Ausgabepreis (pro Million Tokens) |

|---|---|---|---|

| Llama 3.1 8B Instant 128k | 840 TPS | 0,05 $ | 0,08 $ |

| Llama 4 Scout (17Bx16E) 128k | 594 TPS | 0,11 $ | 0,34 $ |

| GPT OSS 20B 128k | 1.000 TPS | 0,10 $ | 0,50 $ |

| Qwen3 32B 131k | 662 TPS | 0,29 $ | 0,59 $ |

| Llama 3.3 70B Versatile 128k | 394 TPS | 0,59 $ | 0,79 $ |

| GPT OSS 120B 128k | 500 TPS | 0,15 $ | 0,75 $ |

| Kimi K2-0905 1T 256k | 200 TPS | 1,00 $ | 3,00 $ |

Groq-Preise für andere Modelle

Groq beschäftigt sich nicht nur mit Text. Sie haben auch Modelle für andere Aufgaben, wie zum Beispiel die Umwandlung von Sprache in Text.

-

Text-to-Speech (PlayAI Dialog v1.0): Dies kostet Sie 50,00 $ für jede Million generierter Zeichen.

-

Automatische Spracherkennung (Whisper Large v3): Der Preis hierfür beträgt 0,111 $ pro Stunde transkribierter Audiodaten.

Enterprise- und Batch-API-Lösungen

Wenn Sie in großem Maßstab arbeiten, hat Groq einige Optionen, um die Kosten bei Aufträgen mit hohem Volumen zu verwalten.

-

Batch-API: Damit können Sie Tausende von Anfragen auf einmal senden und erhalten einen Rabatt von 50 % auf die Echtzeit-Tarife. Das ist ideal für Aufgaben, die nicht dringend sind, bei denen Sie einen großen Auftrag einreichen und die Ergebnisse in ein oder zwei Tagen zurückerhalten können.

-

Prompt-Caching: Dies hilft Ihnen, bei sich wiederholenden Abfragen Geld zu sparen. Wenn Sie häufig die gleiche Eingabe senden, erhalten Sie einen "Cache-Treffer" und zahlen 50 % weniger für diese Eingabe-Tokens.

-

Enterprise-Zugang: Für die großen Projekte, wie die Einrichtung von Groq-Hardware vor Ort (GroqRack) oder die Verwendung von maßgeschneiderten Modellen, müssen Sie sich für einen individuellen Vertrag an deren Vertriebsteam wenden.

Für wen ist Groq geeignet? Den Wert hinter der Preisgestaltung analysieren

Mit seinem Fokus auf reine Geschwindigkeit passt Groq perfekt zu einigen Projekten, ist aber ehrlich gesagt für andere übertrieben. Herauszufinden, ob Sie in ihre Zielgruppe fallen, ist entscheidend.

Wo die Geschwindigkeit von Groq den Preis rechtfertigt

Groq ist für Anwendungen konzipiert, bei denen eine Echtzeit-Antwort nicht nur ein nettes Extra, sondern der Kernpunkt ist.

-

Live-Konversations-KI: Denken Sie an extrem reaktionsschnelle Kundenservice-Bots, virtuelle Assistenten und Echtzeit-Übersetzungstools, bei denen jede Verzögerung die Konversation unangenehm und unnatürlich machen würde.

-

Interaktive Inhaltserstellung: Dinge wie KI-Programmierassistenten, die während des Tippens Vorschläge machen, oder kollaborative Schreibwerkzeuge, die sofortiges Feedback geben.

-

Echtzeit-Datenanalyse: Zur Verarbeitung und Zusammenfassung von Live-Informationsströmen, wie Social-Media-Trends oder Börsendaten, während sie passieren.

-

Sprachgesteuerte Anwendungen: Erstellen von Sprachassistenten, die verstehen, was Sie sagen, und ohne diese seltsamen, langen Pausen antworten können.

Wann die Preisgestaltung möglicherweise nicht die richtige Wahl ist

Obwohl die Geschwindigkeit erstaunlich ist, ist Groq ein spezialisiertes Werkzeug und nicht ohne Nachteile.

-

Nur Inferenz: Sie können die LPUs von Groq nicht zum Trainieren oder Feinabstimmen eines KI-Modells verwenden. Sie müssen mit einem Modell kommen, das bereits trainiert und einsatzbereit ist.

-

Benötigt Skalierung, um sinnvoll zu sein: Die Vorteile der Groq-Architektur spüren Sie wirklich nur, wenn Sie Dinge in großem Maßstab betreiben. Wenn Sie ein Entwickler sind, der nur herumspielt, oder ein kleines Team mit geringem Traffic, könnten die Kosten und der Aufwand schwer zu rechtfertigen sein.

-

Es ist ein Motor, kein Auto: Dies ist wahrscheinlich das Wichtigste, was man verstehen muss. Groq gibt Ihnen einen unglaublich schnellen Motor, aber es ist nur der Motor. Sie müssen den Rest des Autos bauen – das Fahrgestell, die Räder, die Lenkung, die Sitze. Das bedeutet, Ihr Team muss den gesamten Code für Integrationen, Benutzeroberflächen und die Logik, die alles zusammenarbeiten lässt, handhaben. Das ist eine riesige Aufgabe, die ernsthafte Ingenieurressourcen erfordert.

Für die meisten Unternehmen, insbesondere für Support- und IT-Teams, ist eine schnelle API nur ein winziges Puzzleteil. Sie benötigen ein komplettes System, das tatsächlich Geschäftsprobleme löst.

Ein praktischerer Weg für Support-Teams

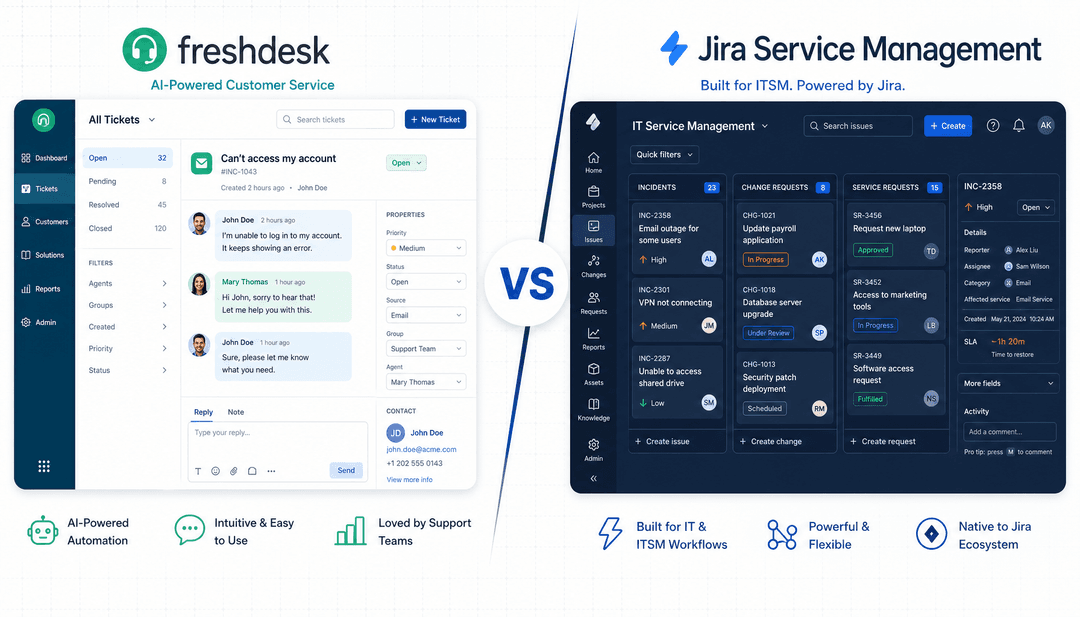

Groq löst ein Problem: Hardware-Geschwindigkeit. Aber für ein vielbeschäftigtes Support- oder IT-Team ist das nur ein kleiner Teil der Gleichung. Sie benötigen ein Werkzeug, das tatsächlich Kundenprobleme löst, nicht nur eine schnelle API.

Hier macht es viel mehr Sinn, sich auf eine Komplettlösung wie eesel AI zu verlassen. Bleiben wir bei unserer Auto-Analogie. Wenn Groq Ihnen den Motor gibt, gibt eesel AI Ihnen das ganze Auto, vollgetankt und fahrbereit. Sie brauchen kein Boxenteam von Entwicklern, um es auf die Straße zu bringen.

Deshalb ist eine End-to-End-Plattform für die meisten Teams die bessere Wahl:

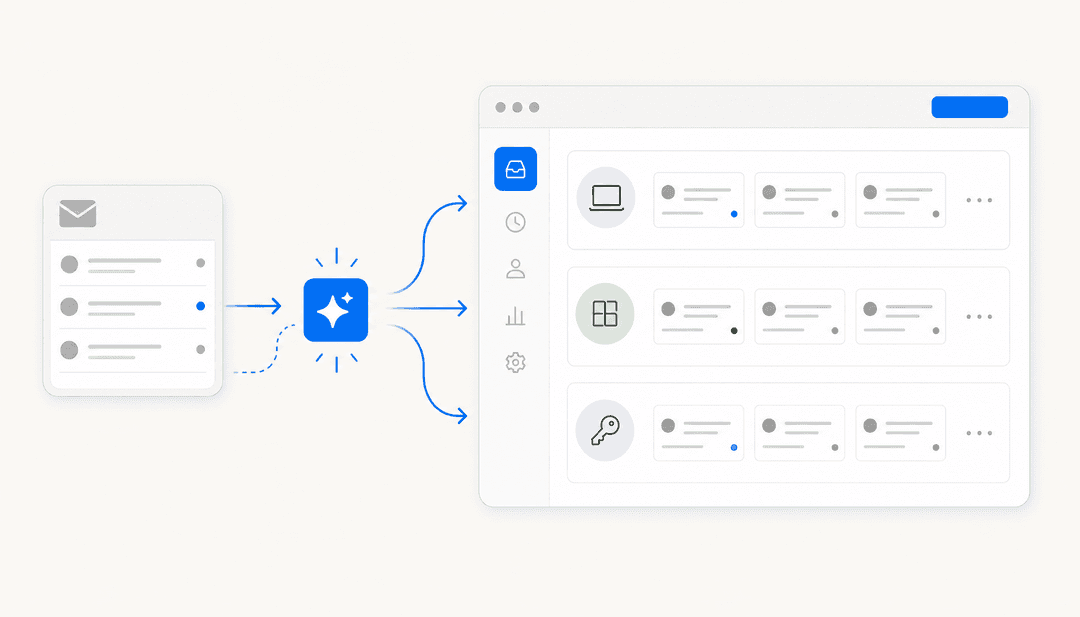

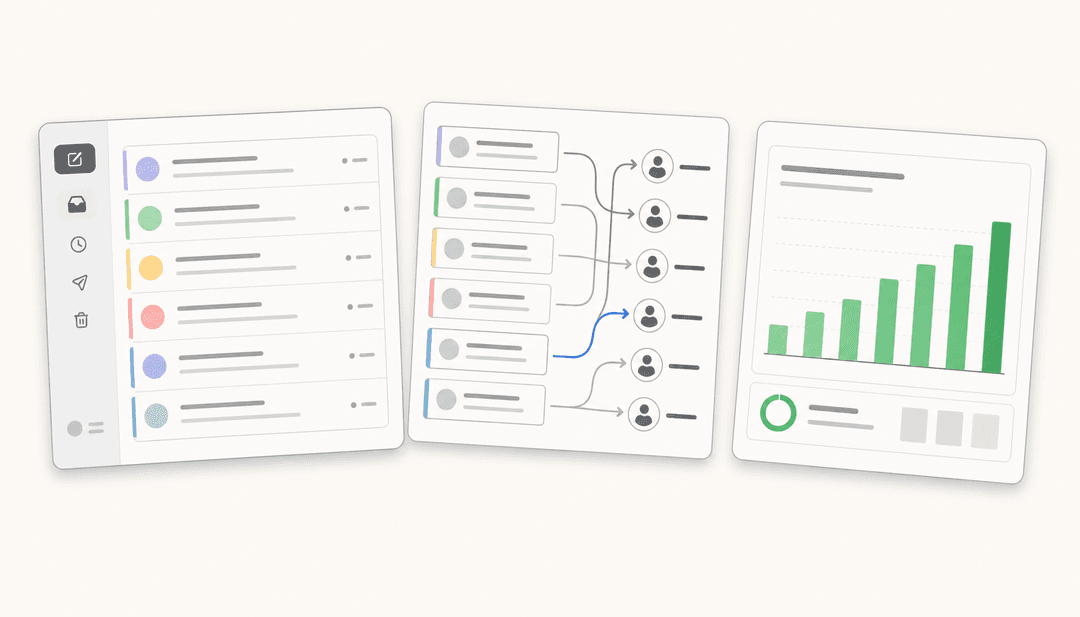

- In Minuten live gehen, nicht in Monaten: Mit eesel AI müssen Sie keine einzige Zeile Code schreiben. Es bietet Ein-Klick-Integrationen mit Helpdesks wie Zendesk und Freshdesk sowie Wissensdatenbanken wie Confluence. Sie können einen voll funktionsfähigen KI-Agenten in wenigen Minuten selbst einrichten. Keine langen Verkaufsgespräche oder komplizierte Einrichtung erforderlich.

- Vereinheitlichen Sie Ihr Wissen sofort: Eine KI ist nur so schlau wie die Informationen, die sie hat. eesel AI verbindet sich automatisch mit Ihren bisherigen Tickets, Hilfeartikeln und internen Dokumenten und lernt daraus. Dadurch wird sichergestellt, dass die Antworten korrekt sind und zu Ihrer Marke passen, ohne dass Sie alles manuell in ein neues System kopieren und einfügen müssen.

- Sicher und mit voller Kontrolle bereitstellen: Wenn Sie auf einer reinen API aufbauen, kann ein Fehler große Probleme verursachen. eesel AI verfügt über einen Simulationsmodus, mit dem Sie Ihre KI an Tausenden Ihrer vergangenen Tickets testen können, bevor sie jemals mit einem echten Kunden spricht. Sie können genau sehen, wie sie geantwortet hätte, ihre Auswirkungen vorhersagen und sie mit Zuversicht einführen.

- Vorhersehbare, transparente Preise: Ein nutzungsbasiertes Modell wie das von Groq kann zu bösen Überraschungsrechnungen führen. eesel AI hat transparente Preispläne, die auf einer festen Anzahl von KI-Interaktionen pro Monat basieren. Ihre Kosten sind vorhersehbar, und Sie werden nicht mit zusätzlichen Gebühren bestraft, wenn Sie mehr Tickets lösen.

Für jedes Team, das die Effizienz steigern und Kunden jetzt glücklicher machen muss, ist eine komplette Plattform wie eesel AI der schnellste und zuverlässigste Weg, dorthin zu gelangen.

Abschließende Gedanken zur Preisgestaltung von Groq

Sehen Sie, die Technologie von Groq ist wirklich beeindruckend. Wenn Sie ein Team mit tiefgreifenden Ingenieurressourcen sind, das eine Echtzeit-App entwickelt, bei der jede Millisekunde zählt, ist ihre Geschwindigkeit kaum zu übertreffen. Das Groq-Preismodell lässt Sie direkt für diese rohe Leistung bezahlen.

Für die meisten Unternehmen, insbesondere im Kundenservice und IT-Bereich, geht es jedoch nicht nur um Geschwindigkeit, sondern darum, Probleme effizient zu lösen. Ein komplettes Support-System von Grund auf auf einer API aufzubauen, ist ein massives, teures Projekt.

Wenn Sie nach einer Lösung suchen, die Ihnen die ganze Kraft der KI ohne den Entwicklungsaufwand bietet, schauen Sie sich eesel AI an. Es ist eine vollständig verwaltete Plattform, die entwickelt wurde, um Ihren Support zu automatisieren, Ihren Agenten zu helfen und Ihren gesamten Betrieb vom ersten Tag an reibungsloser zu gestalten.

Häufig gestellte Fragen

Die LLM-Preise von Groq basieren auf einem "Pay-as-you-go"-Modell (Tokens-as-a-Service). Ihnen werden pro Million Tokens sowohl für die Eingabe (Ihre Anfrage) als auch für die Ausgabe (die Antwort des Modells) Gebühren berechnet, wobei die Preise je nach dem von Ihnen gewählten LLM variieren.

Ja, Groq bietet mehrere Lösungen für hohe Nutzungsvolumen. Ihre Batch-API bietet einen Rabatt von 50 % für nicht dringende, groß angelegte Anfragen, und das Prompt-Caching kann die Kosten für sich wiederholende Abfragen reduzieren. Für benutzerdefinierte Implementierungen wie GroqRack oder maßgeschneiderte Modelle wenden Sie sich an deren Vertriebsteam für eine unternehmensspezifische Groq-Preisgestaltung.

Neben der Anzahl der Tokens hat das spezifische KI-Modell, das Sie auswählen, einen erheblichen Einfluss auf die Groq-Preise; größere, leistungsfähigere Modelle kosten in der Regel mehr pro Token. Zusätzlich beeinflusst es Ihre Gesamtkosten, ob Sie Echtzeit-Inferenz oder die ermäßigte Batch-API für nicht dringende Aufgaben verwenden.

Die Preisgestaltung von Groq geht über rein textbasierte LLMs hinaus. Sie bieten auch Preise für andere KI-Dienste an, wie zum Beispiel Text-to-Speech (PlayAI Dialog v1.0), das pro Million Zeichen berechnet wird, und automatische Spracherkennung (Whisper Large v3), die pro Stunde transkribierter Audiodaten abgerechnet wird.

Ein Unternehmen sollte die Groq-Preise in Betracht ziehen, wenn die Echtzeit-Antwortgeschwindigkeit für seine Anwendung absolut entscheidend ist, wie zum Beispiel bei Live-Konversations-KI, interaktiver Inhaltserstellung oder sprachgesteuerten Anwendungen. Es eignet sich am besten für Projekte, die in erheblichem Umfang betrieben werden und bei denen eine geringe Latenz eine primäre Anforderung ist.

Die Haupteinschränkungen sind, dass Groq nur für die Inferenz ausgelegt ist, was bedeutet, dass Sie es nicht für das Training von Modellen verwenden können. Die Vorteile der Groq-Preise werden am deutlichsten bei großem Maßstab, und es bietet einen "Motor, kein Auto", was erhebliche Ingenieurressourcen erfordert, um eine vollständige Anwendung um seine schnelle API herum zu bauen.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.