ビジネスに最適なAIモデルを選ぶのは、まるでフルタイムの仕事のように感じられるかもしれません。一方にはOpenAIのGPT-4 Turbo、もう一方にはMetaのLlama 3があり、その技術仕様は頭が痛くなるほど複雑です。

ほとんどの人、特にカスタマーサポートの現場では、重要なのは抽象的なベンチマークではありません。実際に機能するか、予算を超えないか、そして開発者チームを雇わずに設定できるか、ということです。このガイドでは、GPT-4 TurboとLlama 3を率直に比較し、ビジネスにとって本当に重要な点、つまり実際の現場でのパフォーマンス、実際のコスト、そしてどこで真価を発揮するかに焦点を当てて解説します。

GPT-4 Turboとは?

まずは、皆さんが最もよく耳にするであろうGPT-4 Turboから見ていきましょう。これは、ChatGPTを世に送り出したOpenAI社の主力モデルです AI分野におけるハイエンドでプレミアムなエンジンだと考えてください。これは「プロプライエタリ」または「クローズドソース」モデルであり、その仕組みを内部から覗き見ることはできません。しかし、その驚異的なパフォーマンスは誰もが目にするところです。

知っておくべきポイントは以下の通りです:

-

最高レベルのパフォーマンス: 複雑な推論、数学の問題、多言語理解において、GPT-4 Turboはしばしば他のモデルの追随を許しません。特に、厄介でニュアンスの細かい問題を解きほぐすのが得意です。

-

巨大なメモリ: 最大128,000トークンという広大なコンテキストウィンドウを持っています。平たく言えば、300ページの分厚い本を一度に読んで記憶できるようなものです。これにより、長文のドキュメントや複雑なサポートのやり取りでも、文脈を見失うことなく全体像を理解できます。

-

API経由でのアクセス: 企業は通常、OpenAI APIを通じてGPT-4 Turboを利用します。つまり、既存のツールに統合するには開発者が必要です。数え切れないほどのAIアプリの舞台裏で動いているエンジンですが、単体では機能しません。

Llama 3とは?

リングの反対側にいるのが、Meta AIのLlama 3です。このモデルファミリーが注目を集めているのは、オープンソースだからです。これは非常に大きな意味を持ちます。これにより、企業はモデルの使用方法において格段に高い柔軟性を得られます。例えば、プライバシーとコントロールを強化するために自社サーバーで実行することも可能です。

その際立った特徴は以下の通りです:

-

用途に応じた様々なサイズ: Llama 3にはいくつかのサイズがあり、中でも8B(80億)と70B(700億)パラメータモデルが最も一般的です。これは素晴らしい特徴で、不要なパワーにお金を払うことなく、必要なパフォーマンスを持つモデルを選べます。必ずしも最も高価なツールが仕事に必要とは限りません。

-

非常に高い競争力: 「オープンソース」という言葉に惑わされてはいけません。Llama 3 70Bモデルは非常に強力です。多くのテストで、旧バージョンのGPT-4と同等、あるいはそれ以上のパフォーマンスを発揮します。これは、オープンソースモデルがプロプライエタリモデルと互角に戦えることの確かな証拠です。

-

効率性を重視した設計: Llama 3は、無駄なくパワフルであるように構築されました。そのため、トークンあたりのコストを抑えつつ最高レベルのAIを求める企業や開発者に人気があります。通常はクラウドプロバイダー経由でアクセスするか、自社でホスティングして利用します。

パフォーマンスとベンチマーク:直接対決

それでは、数字を見ていきましょう。これらのテストがすべてを物語るわけではありませんが、2つのモデルがどのように「思考」し、それぞれどこに強みがあるのかを知るための良い基準になります。

一般知識と推論

幅広い学術的な質問に関しては、通常GPT-4 Turboがわずかにリードしています。MMLU(様々な分野の大学院レベルの問題で構成)のようなテストでは、その広範なトレーニングにより、わずかながら優位に立っています。

とはいえ、Llama 3 70Bもすぐ後ろに迫っています。旧バージョンのGPT-4モデルを上回ることも多く、その差は急速に縮まっています。ビジネスで遭遇するような一般的な知識を問う質問では、おそらく両者の違いを見分けることはできないでしょう。どちらも十分すぎるほど賢いです。

コーディングと数学的能力

ここで、両者の違いが少し明確になってきます。

-

コーディング: モデルのコード記述能力を測定するHumanEvalのようなテストでは、両者とも非常に強力です。GPT-4 Turboは、複雑で多段階のプログラミング課題を解決する能力がやや優れている傾向があります。一方、一部の開発者からは、Llama 3は非常に正確なフォーマット指示に従う能力に長けており、予測可能なコード出力が必要な場合に大きな利点となる、という声が上がっています。

-

数学: 数学的推論のテストでは、GPT-4 Turboが明らかに勝者です。そのアーキテクチャにより、正確な計算と段階的な論理を必要とするタスクにおいて、より高い信頼性を発揮します。数字がユースケースの大部分を占める場合、GPT-4 Turboの方が信頼できる選択肢でしょう。

ベンチマークの簡易比較

| ベンチマーク | タスク | GPT-4 Turbo(おおよそのスコア) | Llama 3 70B(おおよそのスコア) | 主なポイント |

|---|---|---|---|---|

| MMLU | 一般知識 | ~86% | ~82% | GPT-4は幅広い学術的知識でわずかに優位。 |

| HumanEval | コード生成 | ~87% | ~82% | どちらも非常に有能だが、複雑なロジックではGPT-4の方が優れていることが多い。 |

| MATH | 数学問題解決 | ~73% | ~50-60% | 数学的推論ではGPT-4が明らかに勝者。 |

実用的なビジネスアプリケーションとユースケース

さて、理論はここまでにして、これらが実際に仕事にどう役立つのかを見ていきましょう。AIモデル単体では、瓶の中の脳のようなものです。特定のビジネス課題に接続し、適切な情報を与えて初めて役に立ちます。

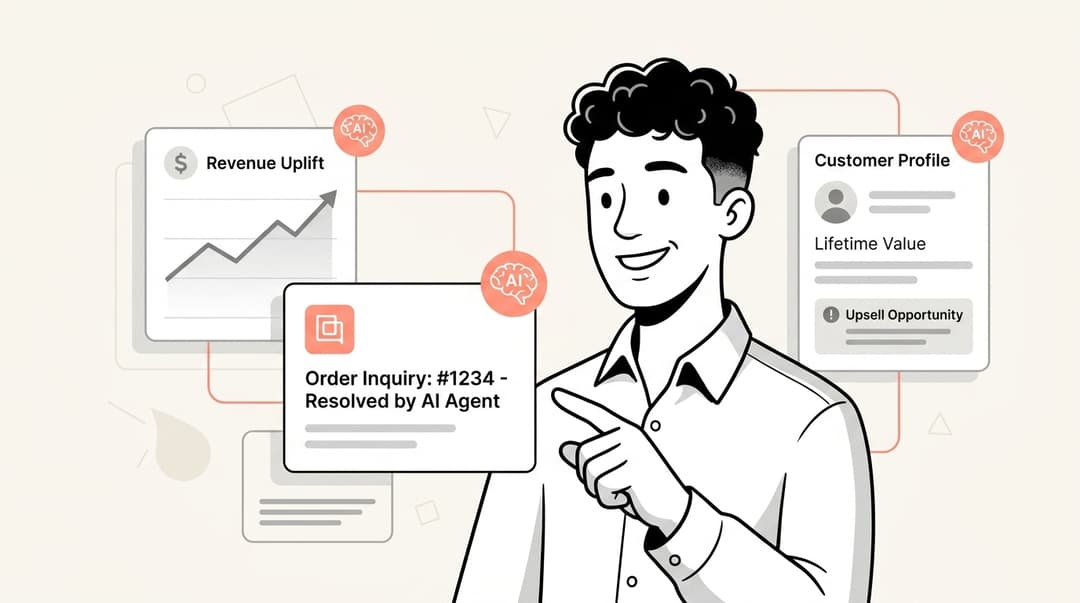

カスタマーサポートの自動化

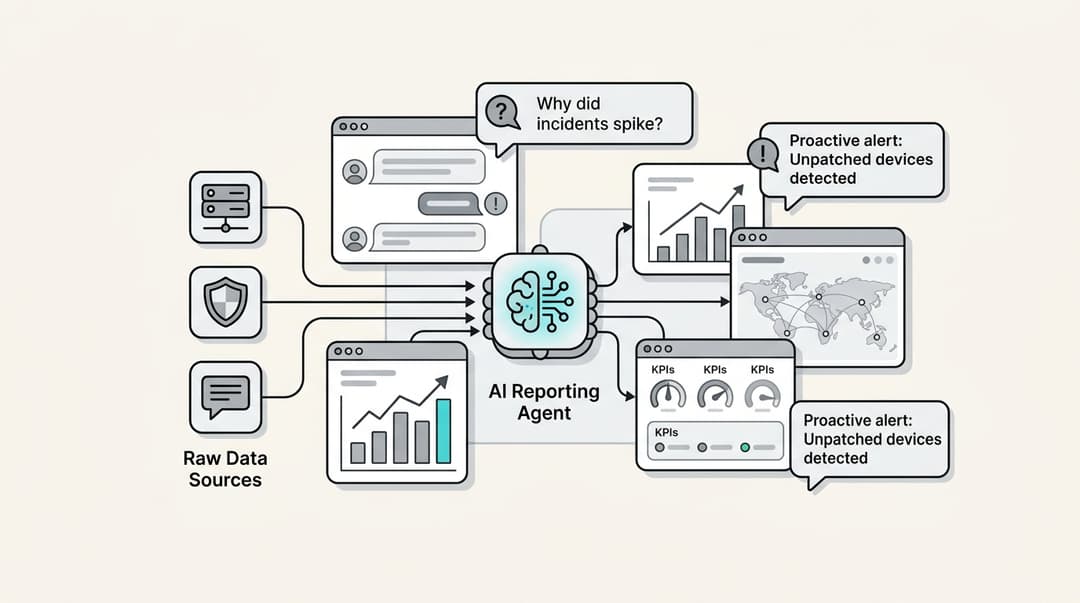

どちらのモデルもサポート業務の処理に優れています。長いチケット履歴の要約、エージェントの丁寧な返信作成の補助、よくある質問への回答が可能です。広大なコンテキストウィンドウにより、複雑な会話を処理して問題の核心に迫ることができます。

しかし、あまり語られないことがあります。これらのモデルは、あなたのビジネスについては何も知らないということです。AIは、返品ポリシーを見たことがなければ、それに関する質問には答えられません。効果を発揮するには、企業のナレッジに接続する必要があります。

コンテンツ作成と要約

この分野では、2つのモデルはそれぞれ異なる強みを持っています。ユーザーからのフィードバックや様々なテストから、Llama 3は特に要約に優れていることがわかっています。長文のドキュメントを簡潔で正確な要約にまとめることができ、社内レポートや他のエージェントへのチケット引き継ぎなどに最適です。

一方、GPT-4 Turboは、より長文でクリエイティブなコンテンツの生成に優れている傾向があります。ブログ記事の下書き、マーケティングアイデアの創出、いくつかのメモから詳細な製品説明を作成するなどの手助けが必要な場合は、こちらの方が良い選択肢でしょう。

社内ナレッジマネジメント

どちらのモデルも、従業員向けの社内Q&Aボットを構築するために使用できます。チームが社内規定、ITのトラブルシューティング、プロジェクトの進捗について質問し、即座に正しい答えを得られるところを想像してみてください。

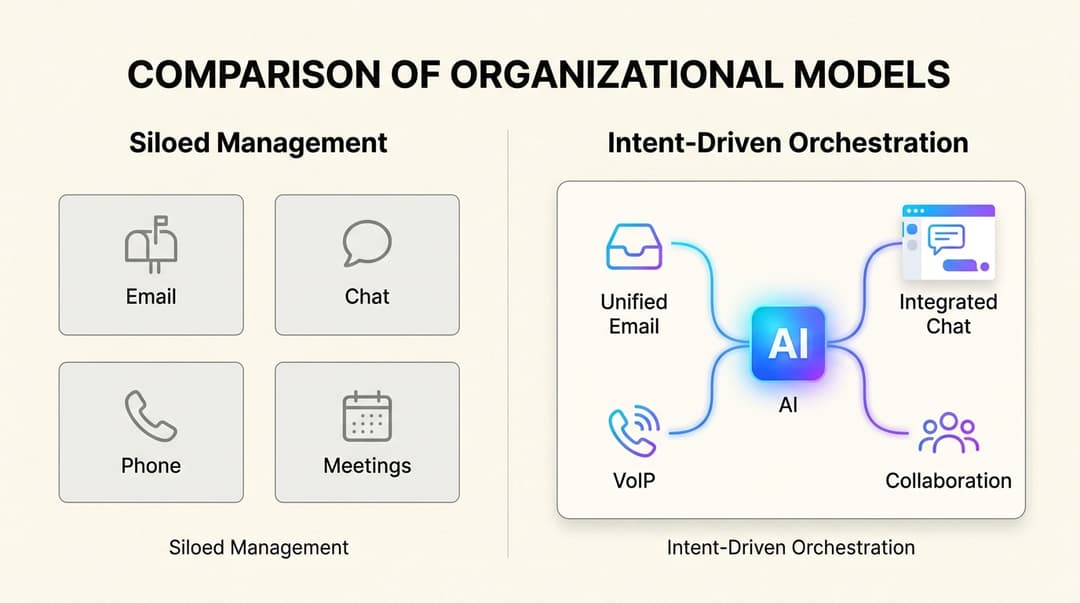

主なハードルはモデル選びではありません。チームに使ってもらうことです。新しいボットを使うためにまた別のアプリを開かなければならないのでは、意味がありません。ツールは、チームがすでにいる場所で機能する必要があります。eesel AIのAI社内チャットのようなプラットフォームは、SlackやMicrosoft Teamsに直接統合されます。社内ドキュメントから学習し、チームが一日中使っているチャットツール内で即座に回答を提供します。

コスト、アクセシビリティ、カスタマイズ性

ほとんどの企業にとって、ここが意思決定の決め手となる部分です。「最高」のモデルであっても、高すぎる、設定が難しすぎる、ニーズを満たすには柔軟性がなさすぎる、といった理由で意味がなくなります。

各モデルの真のコスト

-

GPT-4 Turbo: 送受信するすべての情報に対して、「トークン」単位でOpenAIに料金を支払います。これはプレミアムな選択肢ですが、コストは急速に膨れ上がる可能性があり、特に顧客からの問い合わせが急増した場合には予測が困難になります。

-

Llama 3: オープンソースであるため、ホスティングサービス経由で利用する場合、Llama 3はトークンあたりのコストがはるかに安価です。

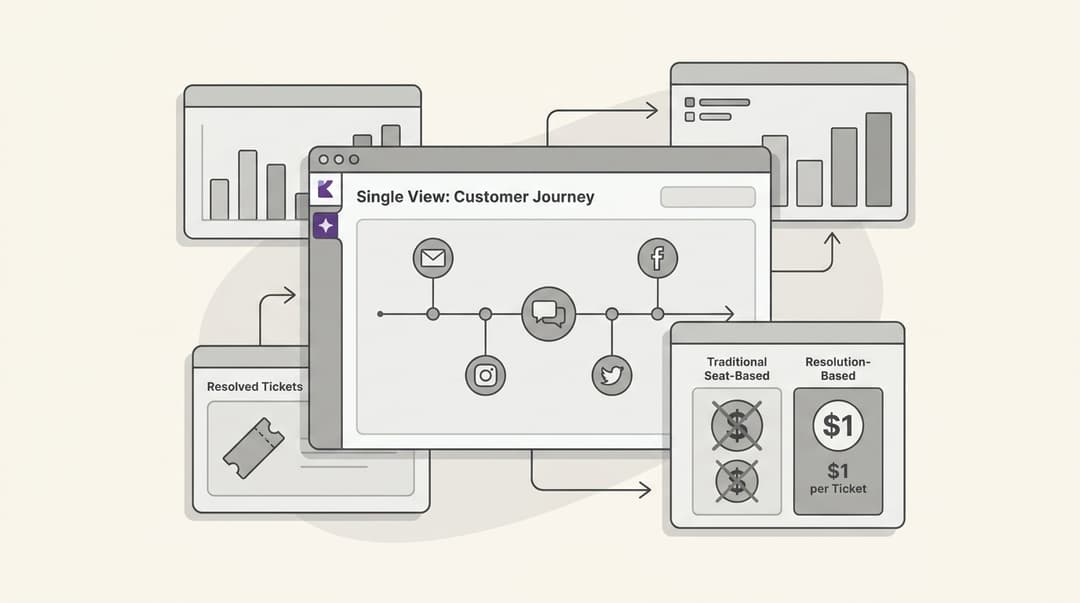

しかし、トークン単価は話の一部に過ぎません。総コストには、エンジニアがセットアップ、統合、バグ修正、継続的なメンテナンスに費やす時間も含まれます。だからこそ、多くの企業がシンプルで予測可能な料金体系のプラットフォームを選ぶのです。例えば、eesel AIは、解決したチケットごとには課金されない、分かりやすい月額プランを提供しています。最も忙しい月でも請求額は変わらず、隠れたエンジニアリングの頭痛の種なしに、予測可能なコストを実現します。

アクセシビリティと設定の容易さ

これらのモデルを直接使用するには、高度な技術スキルが必要です。OpenAI APIを扱える開発者や、Llama 3の複雑なホスティングとデプロイを管理できる開発者が必要です。これは、ただ機能するソリューションを求めているほとんどのサポートチームやITチームにとっては大きな障壁となります。

対照的に、eesel AIのようなプラットフォームは、誰でも使えるように設計されています。Zendeskなどのヘルプデスクを数クリックで接続し、一行のコードも書かずに、数ヶ月ではなく数分で利用を開始できます。

カスタマイズ:ファインチューニング vs ワークフローエンジン

Llama 3はオープンソースなので、「ファインチューニング」と呼ばれるプロセスを通じて深くカスタマイズできます。しかし、これは専門のAIエキスパートと膨大なデータを必要とする、非常に複雑で高価なプロジェクトです。99%の企業にとって、これは現実的な選択肢ではありません。

はるかに実用的な方法は、シンプルでノーコードのワークフローエンジンを持つプラットフォームを利用することです。eesel AIは、使いやすいダッシュボードから完全なコントロールを提供します。AIの個性や口調を設定したり、使用するナレッジソースを指定したり、さらにはShopifyで注文を検索させたり、チケットをエスカレーションさせたりといったカスタムアクションを作成することも、すべて開発者を必要とせずに行えます。

エンジン vs 車

では、結論は何でしょうか?GPT-4 TurboとLlama 3の選択について考える最も簡単な方法は、これらを自動車のエンジンに例えることです。

-

GPT-4 Turboは、高級ブランドのプレミアムで高性能なエンジンです。非常にパワフルで信頼性も高いですが、価格も高く、設置やメンテナンスには専門の整備士(つまり開発者)が必要です。

-

Llama 3は、一流サプライヤーが提供する、多用途で高効率なエンジンのようなものです。はるかに手頃な価格で驚くほどの柔軟性を提供しますが、車の他の部分を自分で組み立てる必要があります。

ほとんどの企業にとって、どちらのエンジンがわずかに優れているかを議論することは、要点を見失っています。本当の価値は完成した車、つまり、すぐに使い始められ、すべてのツールに接続でき、安全にテストでき、初日から結果を出せるプラットフォームにあります。

世界最高のAIを数分で導入

複雑で高価な自社開発プロジェクトに行き詰まる代わりに、eesel AIを使えば、パワフルで安全、そして完全にカスタマイズされたAIエージェントを立ち上げることができます。

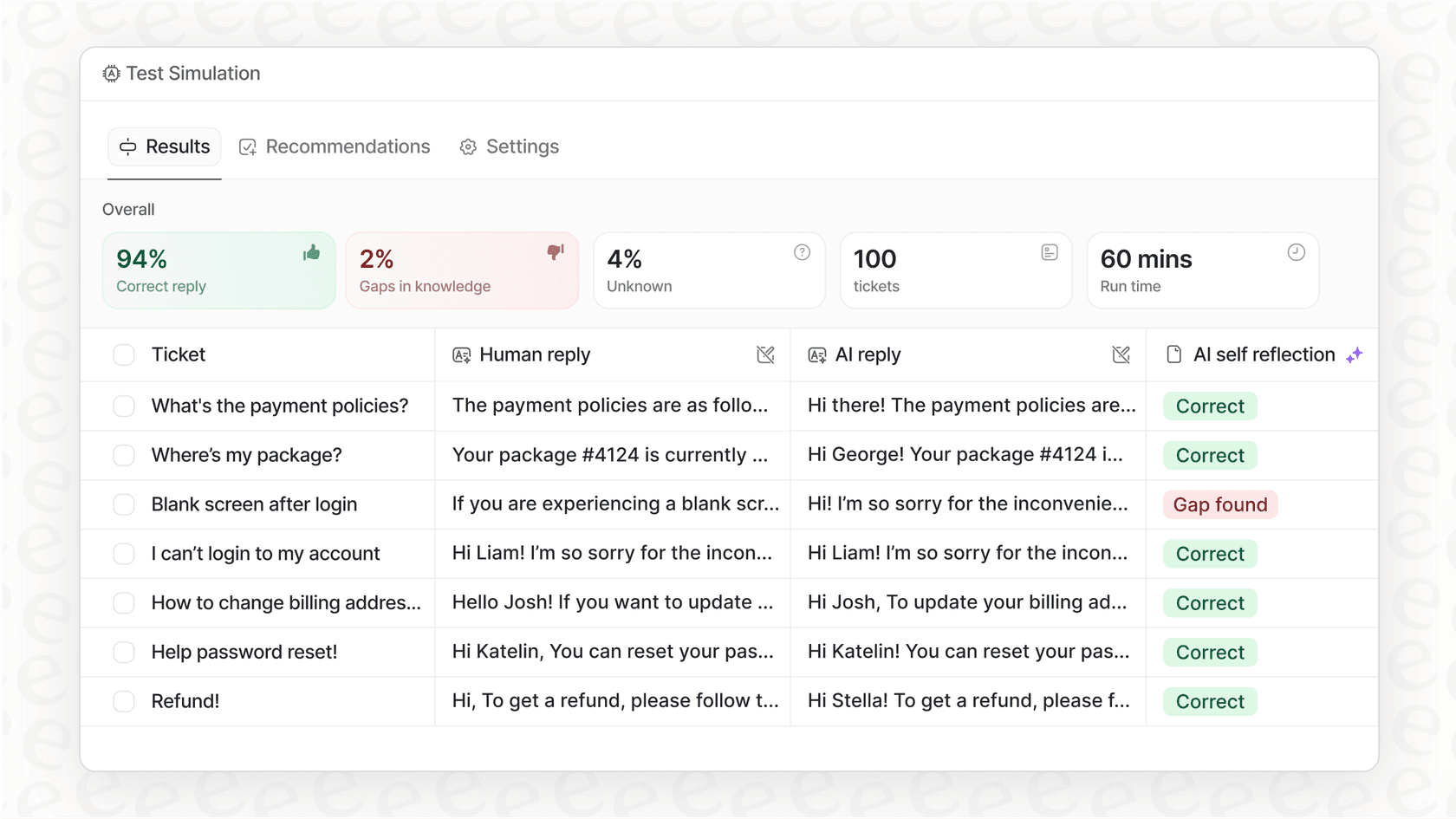

eesel AIは、GPT-4のような最高のモデルを使用するように設計されていますが、複雑な部分はすべて代行します。ツールに接続し、過去のサポート対応の会話から学習してブランドの口調に合わせ、さらにはシミュレーションモードも提供するため、顧客の目に触れる前にすべてを自信を持ってテストできます。

パワフルなAIがいかにシンプルに使えるか、体験してみませんか?今すぐeesel AIの無料トライアルを始めましょう。

よくある質問

GPT-4 TurboはOpenAIのプレミアムなトークン単位課金モデルであり、コストが高く予測しにくい可能性があります。Llama 3は一般的にトークンあたりのコストが安いですが、総コストには統合とメンテナンスのためのエンジニアリング工数を考慮する必要があります。eesel AIのようなプラットフォームは、予測可能な月額料金を提供し、トークンごとの課金や隠れたエンジニアリングコストを排除できます。

GPT-4 Turboは、その広範なトレーニングにより、MMLUのような幅広い学術的ベンチマークでわずかにリードしています。しかし、Llama 3 70Bも非常に競争力のあるパフォーマンスを発揮し、ほとんどの企業が遭遇する一般的な知識を問うタスクでは、GPT-4 Turboと区別がつかないことがよくあります。どちらのモデルも日常的な推論において非常に高い能力を持っています。

GPT-4 Turboは一般的に、複雑な数学的推論や多段階のコーディング課題に優れており、数字を多用するユースケースにおいて信頼性の高い選択肢です。Llama 3もコーディングに強く、特に一部の開発者からは、予測可能なコード出力を得るための正確なフォーマット指示に従う能力が高いと評価されています。

Llama 3のオープンソースという性質は、企業により大きな柔軟性を提供します。これには、プライバシーとコントロールを強化するために自社サーバーで実行するオプションも含まれます。一方、プロプライエタリなGPT-4 TurboはAPIを通じて最高レベルのパフォーマンスを提供しますが、その内部の仕組みを直接見たり変更したりすることはできません。

GPT-4 TurboをAPI経由で使用する場合も、Llama 3を直接デプロイする場合も、セットアップ、統合、継続的なメンテナンスには、高度な技術的専門知識と開発者リソースが必要です。対照的に、eesel AIのようなプラットフォームはこのプロセスを劇的に簡素化し、企業がコードを書くことなく数分でAIソリューションを統合することを可能にします。

Llama 3はオープンソースであるためファインチューニングによる深いカスタマイズが可能ですが、これはほとんどの企業にとって非常に複雑でリソースを大量に消費する作業です。より実用的なアプローチは、eesel AIのようなノーコードのワークフローエンジンを持つプラットフォームを使用することです。これにより、使いやすいダッシュボードからAIの個性、口調、特定の行動を簡単に設定できます。

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.