Tentar escolher o modelo de IA certo para sua empresa pode parecer um trabalho de tempo integral. Você tem o GPT-4 Turbo da OpenAI de um lado e o Llama 3 da Meta do outro, e as especificações técnicas podem fazer sua cabeça girar.

Para a maioria de nós, especialmente no suporte ao cliente, a verdadeira questão não é sobre benchmarks abstratos. É sobre o que realmente vai funcionar, o que não vai quebrar o banco e o que você pode configurar sem contratar uma equipe de desenvolvedores. Este guia é uma comparação direta de GPT-4 Turbo vs Llama 3, focando no que realmente conta para sua empresa: como eles se comportam no mundo real, quanto eles realmente custam e onde eles podem fazer uma diferença real.

O que é GPT-4 Turbo?

Vamos começar com aquele que você provavelmente mais ouviu falar: GPT-4 Turbo. Este é o grande da OpenAI, a empresa que nos deu o ChatGPT. Você pode pensar nele como o motor premium de ponta no espaço da IA. É um modelo "proprietário" ou "de código fechado", o que significa que você não pode espiar sob o capô para ver como ele funciona. Mas o que você vê é seu desempenho seriamente impressionante.

Aqui está o que você precisa saber sobre ele:

-

Desempenho de primeira linha: Quando se trata de raciocínio complexo, problemas de matemática e compreensão de diferentes idiomas, o GPT-4 Turbo é frequentemente o modelo a ser batido. É particularmente bom em desembaraçar questões complicadas e sutis.

-

Uma memória enorme: Ele tem uma janela de contexto (context window) massiva (até 128.000 tokens). Em linguagem simples, é como se ele pudesse ler e lembrar de um livro de 300 páginas de uma só vez. Isso permite que ele entenda o quadro completo de documentos longos ou tópicos de suporte complicados sem se perder.

-

Acessado via API: As empresas geralmente interagem com o GPT-4 Turbo através da API da OpenAI. Isso significa que você precisa de desenvolvedores para integrá-lo em suas ferramentas existentes. É o motor rodando nos bastidores de inúmeros aplicativos de IA, mas não funciona sozinho.

O que é Llama 3?

Do outro lado do ringue está o Llama 3 da Meta AI. Esta família de modelos está fazendo ondas porque é de código aberto, e isso é um grande negócio. Ele oferece às empresas muito mais flexibilidade em como elas usam o modelo, incluindo a opção de executá-lo em seus próprios servidores para maior privacidade e controle.

Aqui está o que o faz se destacar:

-

Tamanhos diferentes para trabalhos diferentes: O Llama 3 está disponível em alguns tamanhos diferentes, com os modelos de 8B e 70B parâmetros sendo os mais comuns. Esta é uma ótima característica porque você pode escolher um modelo que lhe dá o desempenho que você precisa sem pagar por poder que você não vai usar. Você nem sempre precisa da ferramenta mais cara para o trabalho.

-

Desempenho muito competitivo: Não deixe o rótulo "código aberto" te enganar. O modelo Llama 3 70B é uma potência. Em muitos testes, ele tem um desempenho semelhante e, às vezes, até melhor do que as versões anteriores do GPT-4. É uma prova sólida de que os modelos de código aberto podem competir de igual para igual com os proprietários.

-

Projetado para eficiência: O Llama 3 foi construído para ser poderoso sem ser inchado. Isso o torna uma escolha popular para empresas e desenvolvedores que desejam IA de primeira linha que seja mais acessível em uma base por token. Você geralmente o acessa através de provedores de nuvem ou hospedando-o você mesmo.

Desempenho e benchmarks: Uma comparação direta

Certo, vamos dar uma olhada nos números. Embora esses testes não contem toda a história, eles nos dão uma boa linha de base de como esses dois modelos "pensam" e onde cada um tem uma vantagem natural.

Conhecimento geral e raciocínio

Quando se trata de perguntas amplas e de estilo acadêmico, o GPT-4 Turbo geralmente tem uma pequena vantagem. Em testes como o MMLU (que é cheio de perguntas de nível de pós-graduação sobre vários assuntos), seu extenso treinamento lhe dá uma ligeira vantagem.

Dito isto, o Llama 3 70B está logo em seu encalço. Ele frequentemente bate os modelos GPT-4 mais antigos e está rapidamente fechando a lacuna. Para o tipo de perguntas de conhecimento geral que sua empresa provavelmente encontrará, você provavelmente não seria capaz de dizer a diferença entre eles. Ambos são mais do que inteligentes o suficiente.

Habilidades de codificação e matemáticas

É aqui que as diferenças começam a se tornar um pouco mais óbvias.

-

Codificação: Em testes como o HumanEval, que mede a capacidade de um modelo de escrever código, ambos são muito fortes. O GPT-4 Turbo tende a ser um pouco melhor em resolver desafios de programação complexos e de várias etapas. Por outro lado, alguns desenvolvedores descobriram que o Llama 3 é fantástico em seguir instruções de formatação muito precisas, o que é um grande benefício quando você precisa de uma saída de código previsível.

-

Matemática: O GPT-4 Turbo é o claro vencedor quando se trata de testes de raciocínio matemático. Sua arquitetura o torna mais confiável para tarefas que exigem cálculos exatos e lógica passo a passo. Se os números são uma grande parte do seu caso de uso, o GPT-4 Turbo é provavelmente a escolha mais confiável.

Uma comparação rápida de benchmarks

| Benchmark | Tarefa | GPT-4 Turbo (Pontuação Aprox.) | Llama 3 70B (Pontuação Aprox.) | Principal Conclusão |

|---|---|---|---|---|

| MMLU | Conhecimento Geral | ~86% | ~82% | GPT-4 tem uma ligeira vantagem em conhecimento amplo e acadêmico. |

| HumanEval | Geração de Código | ~87% | ~82% | Ambos são muito capazes, mas o GPT-4 é frequentemente melhor para lógica complexa. |

| MATH | Resolução de Problemas de Matemática | ~73% | ~50-60% | GPT-4 é o claro vencedor para raciocínio matemático. |

Aplicações de negócios práticas e casos de uso

Ok, chega de teoria. Como essa coisa realmente ajuda você a fazer o trabalho? Um modelo de IA por si só é apenas um cérebro em um pote; só é útil quando você o conecta aos seus problemas de negócios específicos e lhe dá as informações certas para trabalhar.

Automação de suporte ao cliente

Ambos os modelos são excelentes para lidar com tarefas de suporte. Eles podem resumir longos históricos de tickets, ajudar os agentes a redigir respostas atenciosas e responder a perguntas frequentes. Suas grandes janelas de contexto permitem que eles processem conversas complicadas para chegar ao cerne da questão.

Mas aqui está a coisa que eles nem sempre te dizem: esses modelos não sabem nada sobre sua empresa. Uma IA não pode responder a uma pergunta sobre sua política de devolução se nunca a tiver visto. Ela tem que estar conectada ao conhecimento da sua empresa para ser eficaz.

Criação e resumo de conteúdo

Nesta área, os dois modelos têm diferentes pontos fortes. O feedback do usuário e vários testes mostraram que o Llama 3 é particularmente bom em resumo. Ele pode pegar um documento longo e reduzi-lo a um resumo claro e preciso, o que é ótimo para coisas como relatórios internos ou passar um ticket para outro agente.

O GPT-4 Turbo, no entanto, tende a ser melhor em gerar conteúdo criativo de formato mais longo. Se você precisa de ajuda para redigir uma postagem de blog, criar ideias de marketing ou escrever descrições detalhadas de produtos a partir de algumas notas, provavelmente é a melhor opção.

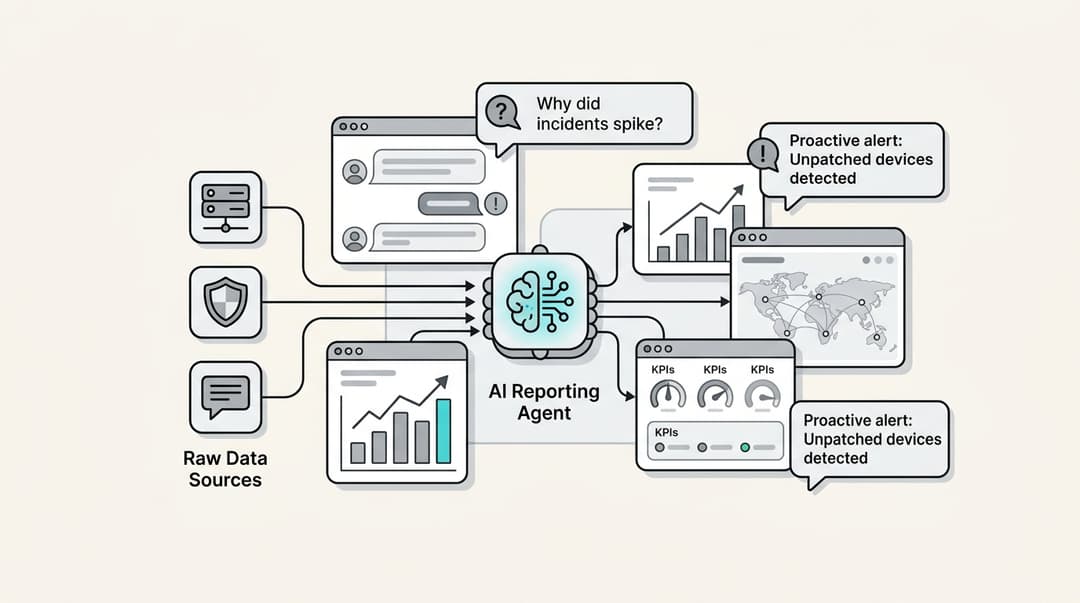

Gerenciamento de conhecimento interno

Qualquer um dos modelos pode ser usado para construir um bot de perguntas e respostas interno para seus funcionários. Imagine sua equipe perguntando sobre políticas da empresa, solução de problemas de TI ou atualizações de projetos e obtendo uma resposta imediata e correta.

O principal obstáculo não é escolher o modelo; é fazer com que sua equipe o use. Um novo bot é inútil se as pessoas tiverem que abrir mais um aplicativo. A ferramenta precisa estar onde sua equipe já está. Uma plataforma como o AI Internal Chat da eesel AI se integra diretamente ao Slack ou Microsoft Teams. Ele aprende com seus documentos internos e dá à sua equipe respostas instantâneas dentro das ferramentas de bate-papo que eles usam o dia todo.

Custo, acessibilidade e personalização

Para a maioria das empresas, é aqui que a decisão realmente é tomada. O modelo "melhor" não importa se for muito caro, muito difícil de configurar ou muito rígido para atender às suas necessidades.

O verdadeiro custo de cada modelo

-

GPT-4 Turbo: Você paga à OpenAI por cada pedaço de informação que você envia e recebe, com base em "tokens". É a escolha premium, e os custos podem aumentar rapidamente e ser difíceis de prever, especialmente se você tiver um pico repentino em perguntas de clientes.

-

Llama 3: Por ser de código aberto, o Llama 3 é muito mais barato em uma base por token quando você o usa através de um serviço de hospedagem.

Mas o preço por token é apenas parte da história. O custo total também inclui o tempo que seus engenheiros gastam em configuração, integração, correção de bugs e manutenção contínua. É por isso que muitas empresas optam por uma plataforma com preços simples e previsíveis. Por exemplo, a eesel AI oferece planos mensais diretos que não cobram por ticket resolvido. Sua conta permanece a mesma, mesmo durante seus meses mais movimentados, dando-lhe custos previsíveis sem as dores de cabeça de engenharia ocultas.

Acessibilidade e facilidade de configuração

Usar qualquer um desses modelos diretamente requer muita habilidade técnica. Você precisa de desenvolvedores que possam trabalhar com a API da OpenAI ou que possam gerenciar a hospedagem e implantação complexas do Llama 3. Essa é uma enorme barreira para a maioria das equipes de suporte e TI que só querem uma solução que funcione.

Em contraste, plataformas como a eesel AI são projetadas para que qualquer pessoa possa usá-las. Você pode conectar seu help desk, como o Zendesk, com apenas alguns cliques e começar em minutos, não meses, tudo sem escrever uma única linha de código.

Personalização: Ajuste fino vs. um mecanismo de fluxo de trabalho

Como o Llama 3 é de código aberto, você pode personalizá-lo profundamente através de um processo chamado "ajuste fino" (fine-tuning). No entanto, este é um projeto muito complexo e caro que requer especialistas em IA especializados e enormes quantidades de dados. Para 99% das empresas, simplesmente não é uma opção realista.

Uma rota muito mais prática é usar uma plataforma que tenha um mecanismo de fluxo de trabalho simples, sem código. A eesel AI lhe dá controle total a partir de um painel fácil de usar. Você pode definir a personalidade e o tom de voz da sua IA, dizer a ela quais fontes de conhecimento usar e até mesmo criar ações personalizadas, como fazê-la procurar um pedido no Shopify ou escalar um ticket, tudo sem precisar de um desenvolvedor.

O motor vs. o carro

Então, qual é a conclusão aqui? A maneira mais fácil de pensar sobre a escolha GPT-4 Turbo vs Llama 3 é compará-los a motores de carro.

-

GPT-4 Turbo é o motor premium de alto desempenho de uma marca de luxo. É incrivelmente poderoso e confiável, mas vem com um preço mais alto e requer mecânicos especializados (seus desenvolvedores) para instalá-lo e mantê-lo.

-

Llama 3 é como um motor versátil e altamente eficiente de um fornecedor de primeira linha. É muito mais acessível e oferece uma flexibilidade incrível, mas você ainda tem que construir o resto do carro em torno dele sozinho.

Para a maioria das empresas, debater qual motor é ligeiramente melhor perde o ponto. O verdadeiro valor está no veículo completo: uma plataforma que é fácil de começar, se conecta a todas as suas ferramentas, é segura para testar e entrega resultados desde o primeiro dia.

Coloque a melhor IA do mundo para trabalhar em minutos

Em vez de ficar atolado em um projeto complexo e caro de construção você mesmo, você pode lançar um agente de IA poderoso, seguro e totalmente personalizado com a eesel AI.

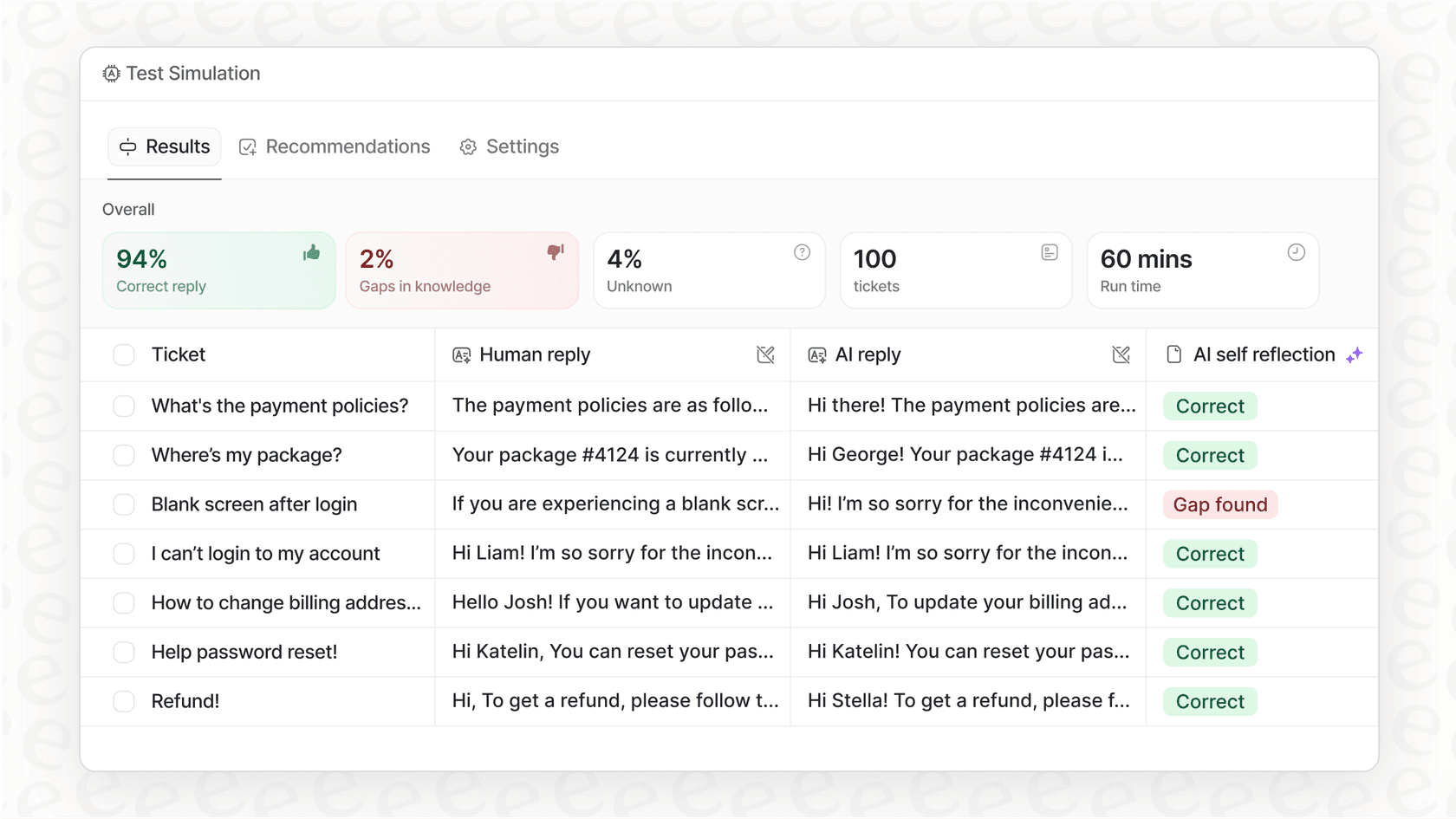

A eesel AI é projetada para usar os melhores modelos como o GPT-4, mas lida com todas as partes complicadas para você. Ele se conecta às suas ferramentas, aprende com suas conversas de suporte anteriores para corresponder à voz da sua marca e até mesmo oferece um modo de simulação para que você possa testar tudo com confiança antes que seus clientes o vejam.

Pronto para ver como a IA poderosa simples pode ser? Comece seu teste gratuito da eesel AI hoje.

Perguntas frequentes

O GPT-4 Turbo é um modelo premium, por token, da OpenAI, o que leva a custos potencialmente mais altos e menos previsíveis. O Llama 3 é geralmente mais acessível em uma base por token, mas o custo total deve levar em conta o esforço de engenharia para integração e manutenção. Plataformas como a eesel AI podem oferecer preços mensais previsíveis, eliminando cobranças por token e custos de engenharia ocultos.

O GPT-4 Turbo normalmente mostra uma ligeira vantagem em benchmarks amplos e acadêmicos como o MMLU devido ao seu extenso treinamento. No entanto, o Llama 3 70B tem um desempenho muito competitivo e é frequentemente indistinguível do GPT-4 Turbo para as tarefas de conhecimento geral que a maioria das empresas encontra. Ambos os modelos são altamente capazes para o raciocínio diário.

O GPT-4 Turbo geralmente se destaca no raciocínio matemático complexo e em desafios de codificação de várias etapas, tornando-o uma escolha confiável para casos de uso com muitos números. O Llama 3 também é forte em codificação e é particularmente notado por alguns desenvolvedores por sua capacidade de seguir instruções de formatação precisas para uma saída de código previsível.

A natureza de código aberto do Llama 3 oferece às empresas maior flexibilidade, incluindo a opção de executá-lo em seus próprios servidores para maior privacidade e controle. O GPT-4 Turbo, sendo proprietário, oferece desempenho de primeira linha por meio de uma API, mas limita o insight direto ou a modificação de seu funcionamento interno.

Usar o GPT-4 Turbo por meio de sua API ou implantar o Llama 3 diretamente requer conhecimentos técnicos significativos e recursos de desenvolvedor para configuração, integração e manutenção contínua. Em contraste, plataformas como a eesel AI simplificam esse processo drasticamente, permitindo que as empresas integrem soluções de IA em minutos, sem escrever código.

Embora o Llama 3 ofereça personalização profunda por meio de ajuste fino devido à sua natureza de código aberto, esta é uma tarefa altamente complexa e que exige muitos recursos para a maioria das empresas. Uma abordagem mais prática é usar uma plataforma com um mecanismo de fluxo de trabalho sem código, como a eesel AI, que permite definir facilmente a personalidade, o tom e as ações específicas da IA a partir de um painel amigável.

Share this article

Article by

Stevia Putri

Stevia Putri é uma generalista de marketing na eesel AI, onde ela ajuda a transformar ferramentas poderosas de IA em histórias que ressoam. Ela é movida por curiosidade, clareza e o lado humano da tecnologia.