La récente décision de Cisco d'acquérir Robust Intelligence pour un montant annoncé de 400 millions de dollars a mis un énorme coup de projecteur sur un secteur du monde de la tech qui passe rapidement sur le devant de la scène : la sécurité de l'IA. Depuis des années, les entreprises se sont lancées dans une course effrénée pour développer et déployer l'IA, mais le débat sur la manière de protéger ces systèmes puissants contre de nouvelles menaces, presque invisibles, a pris du retard.

Robust Intelligence est une entreprise qui se consacre à la sécurisation des systèmes d'IA de l'intérieur. Mais qu'est-ce que cela signifie vraiment ? Dans cet article, nous allons détailler ce que fait Robust Intelligence, pourquoi sa mission est si importante pour toute entreprise utilisant l'IA, et ce que cette tendance signifie pour vous, que vous utilisiez l'IA pour le support client, l'informatique ou tout autre domaine.

Qu'est-ce que Robust Intelligence ?

Au fond, Robust Intelligence est une entreprise de sécurité de l'IA. Ils ont construit une plateforme pour protéger les modèles d'IA, et les applications sur lesquelles ils tournent, tout au long de leur cycle de vie, de la première ligne de code à chaque interaction avec le client.

Fondée par Yaron Singer, ancien professeur de Harvard, et son étudiant de l'époque, Kojin Oshiba, l'entreprise a été bâtie sur une idée simple mais cruciale : les modèles d'IA peuvent échouer, et ils le feront. Leur travail consiste à prévenir ces échecs en dénichant les vulnérabilités avant qu'elles ne puissent être exploitées et en se protégeant contre les attaques malveillantes en temps réel.

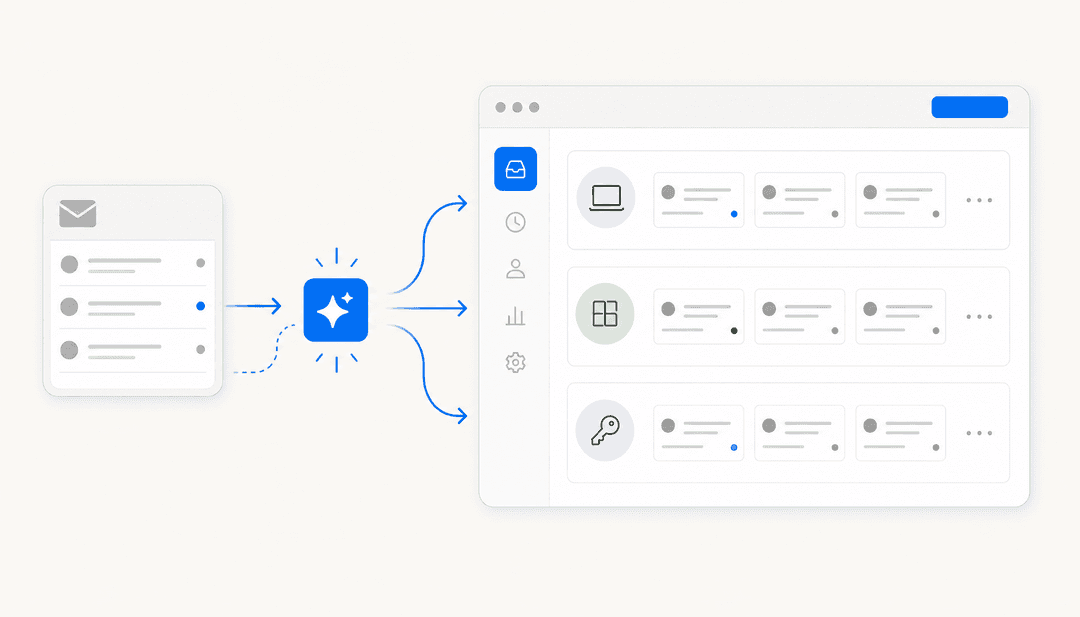

Leur plateforme est divisée en deux parties principales :

-

Validation de l'IA : C'est la partie proactive. Avant même qu'un modèle d'IA ne soit déployé, cet outil automatise le processus de test pour détecter les failles de sécurité et les risques de sûreté. Considérez-le comme un test de résistance qui trouve les points faibles avant qu'ils ne puissent causer des dommages dans le monde réel.

-

Protection de l'IA (Pare-feu IA) : C'est la défense en temps réel. Une fois qu'un modèle est opérationnel, le Pare-feu IA agit comme un ensemble de garde-fous, surveillant constamment les entrées et les sorties pour bloquer les menaces dès leur apparition.

Ils construisent en quelque sorte le système immunitaire de sécurité pour une nouvelle génération de technologie.

graph TD; A[Cycle de vie du modèle d'IA] --> B{Plateforme Robust Intelligence}; B --> C[Validation de l'IA - Tests proactifs]; B --> D[Protection de l'IA - Pare-feu en temps réel]; C --> E[Tests de résistance automatisés]; C --> F[Identification des risques de sécurité et de sûreté]; D --> G[Surveillance des entrées et sorties]; D --> H[Blocage des menaces en temps réel];

Le problème fondamental résolu : Pourquoi la sécurité des modèles d'IA est-elle si importante

Alors que les entreprises se précipitent pour adopter l'IA, elles ouvrent également la porte à une nouvelle catégorie de risques que leurs outils de cybersécurité traditionnels ne peuvent tout simplement pas voir. Les modèles d'IA ne sont pas comme les logiciels classiques ; ils peuvent être manipulés de manières assez étranges et subtiles.

Robust Intelligence a été conçue pour se défendre contre ces menaces uniques. Voici quelques-unes des plus importantes :

-

Injection de prompt et jailbreaking : C'est essentiellement de l'ingénierie sociale pour l'IA. Il s'agit de tromper un bot pour qu'il ignore ses propres règles de sécurité ou qu'il divulgue des informations sensibles qu'il ne devrait pas. Un attaquant pourrait, par exemple, rédiger un prompt qui incite un bot de service client à révéler les détails du compte d'un autre utilisateur ou à générer du contenu malveillant.

-

Empoisonnement des données : La qualité d'une IA dépend des données à partir desquelles elle apprend. L'empoisonnement des données se produit lorsqu'un attaquant fournit secrètement de mauvaises données à l'IA pendant sa phase d'entraînement. Cela peut créer des portes dérobées cachées ou introduire des biais qui amènent le modèle à prendre de très mauvaises décisions plus tard, sans que personne ne s'en aperçoive jusqu'à ce qu'il soit trop tard.

-

Évasion de modèle : Il s'agit de créer des entrées spécifiquement conçues pour dérouter une IA et la faire échouer. Par exemple, un attaquant pourrait modifier une image d'une manière invisible pour un humain mais qui amène une IA à identifier complètement mal ce qu'elle voit.

Ce ne sont pas seulement des problèmes théoriques. Les chercheurs ont démontré à maintes reprises à quel point même les modèles les plus avancés peuvent être vulnérables. Les sécuriser n'est pas seulement un plus ; c'est en train de devenir une exigence de base pour faire des affaires.

L'acquisition de Robust Intelligence par Cisco : Ce que cela signifie pour l'IA d'entreprise

Quand un géant comme Cisco dépense des centaines de millions pour une startup spécialisée, on sait que le marché est en train de changer. Cette acquisition confirme que la sécurité de l'IA n'est plus une préoccupation de niche pour une poignée de data scientists, mais une priorité absolue pour chaque grande entreprise.

Dans le billet de blog annonçant l'acquisition, Tom Gillis, SVP de la sécurité chez Cisco, l'a bien dit : « La combinaison de Cisco et de Robust Intelligence signifie que nous pouvons fournir un traitement de sécurité IA avancé de manière transparente dans les flux de données existants... »

C'est un grand pas en avant. Cela signifie que la sécurité de l'IA est intégrée directement dans l'infrastructure qui alimente les entreprises. Lancer une application d'IA sans sécurité dédiée devient rapidement aussi impensable que de gérer un réseau d'entreprise sans pare-feu. Cela ne se passe pas seulement dans les salles de conseil ; les gouvernements du monde entier, comme les États-Unis avec leur décret présidentiel sur la sécurité de l'IA, poussent pour un développement de l'IA plus sûr et plus sécurisé.

Au-delà de Robust Intelligence et de la sécurité des modèles : L'autre moitié du problème

Alors que des entreprises comme Robust Intelligence se concentrent sur la sécurisation des modèles d'IA fondamentaux, que l'on peut considérer comme le moteur de la voiture, les entreprises utilisant des applications d'IA ont un autre grand défi. Sécuriser le moteur est une chose, mais il faut aussi s'assurer que la voiture roule en toute sécurité, respecte le code de la route et ne dévie pas de sa trajectoire.

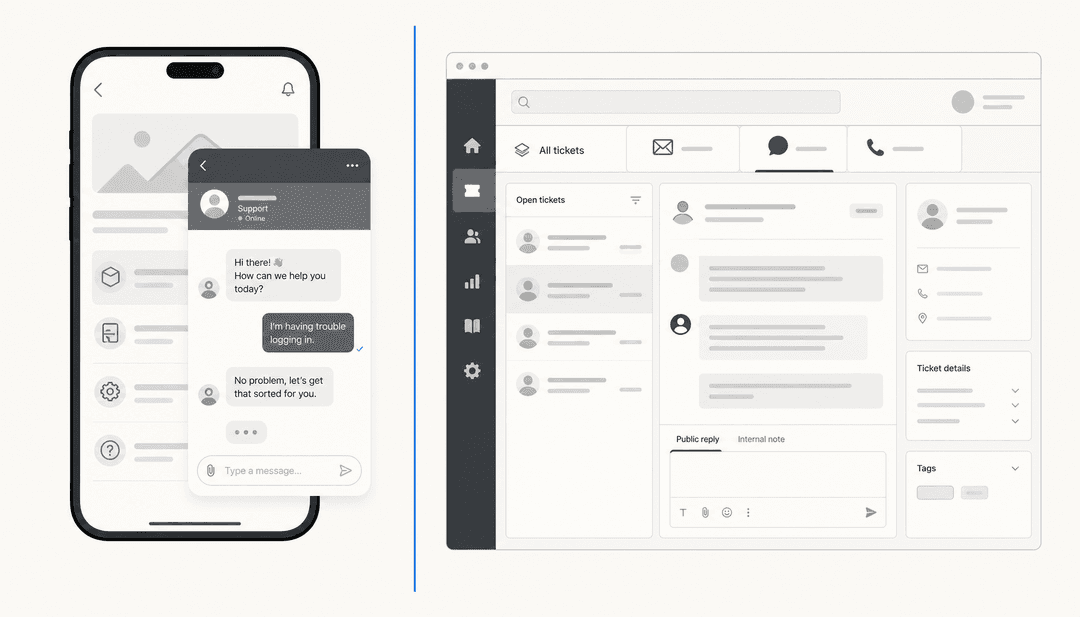

Pour les équipes utilisant l'IA dans le support client, la gestion des services informatiques (ITSM), ou pour des questions internes, ce défi de la « couche applicative » est là où les choses deviennent concrètes. Les risques ici concernent moins les pirates informatiques que la réputation de votre marque et la confiance de vos clients. Un agent IA qui donne de mauvaises informations, adopte un ton étrange ou ne parvient pas à transmettre un problème sensible à un humain peut être tout aussi dommageable qu'une faille technique.

C'est là que vous avez besoin d'un autre type d'intelligence robuste, axée sur le contrôle, la fiabilité et la confiance dans l' application elle-même.

C'est un problème que les plateformes modernes commencent à résoudre. Les meilleures sont construites autour de quelques idées clés :

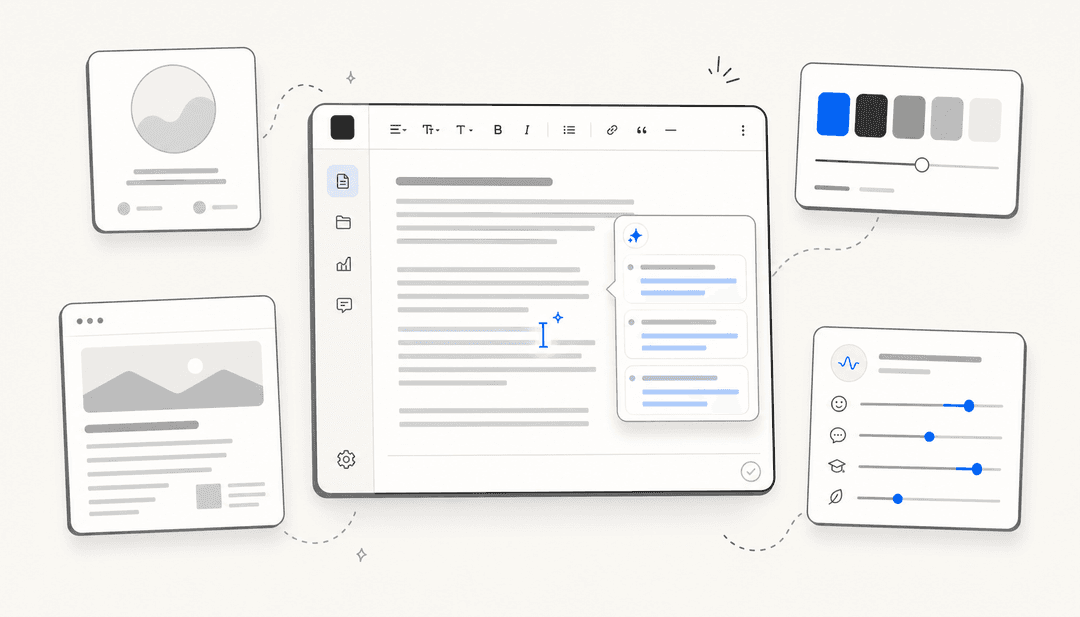

Premièrement, vous avez besoin d'un contrôle granulaire. Vous ne pouvez pas simplement actionner un interrupteur et laisser une IA agir à sa guise. Un véritable contrôle signifie que vous pouvez choisir exactement quels types de questions l'IA automatise. Par exemple, des outils comme eesel AI vous permettent de commencer petit en automatisant des sujets simples et répétitifs tout en vous assurant que tout le reste est transmis à un humain. Cela vous donne un contrôle total sur votre flux de travail de support, afin qu'il n'y ait pas de mauvaises surprises.

Ensuite, il y a les tests sans risque. Comment pouvez-vous faire confiance à une IA avant qu'elle n'ait parlé à un seul client ? La réponse est la simulation. La capacité de tester votre configuration d'IA sur des milliers de vos propres tickets de support passés est un avantage considérable. Elle vous donne une prévision précise de ses performances et de vos économies de coûts, le tout avant de passer en production. Ce type de simulation puissante est une fonctionnalité essentielle d'eesel AI que de nombreuses alternatives n'offrent tout simplement pas.

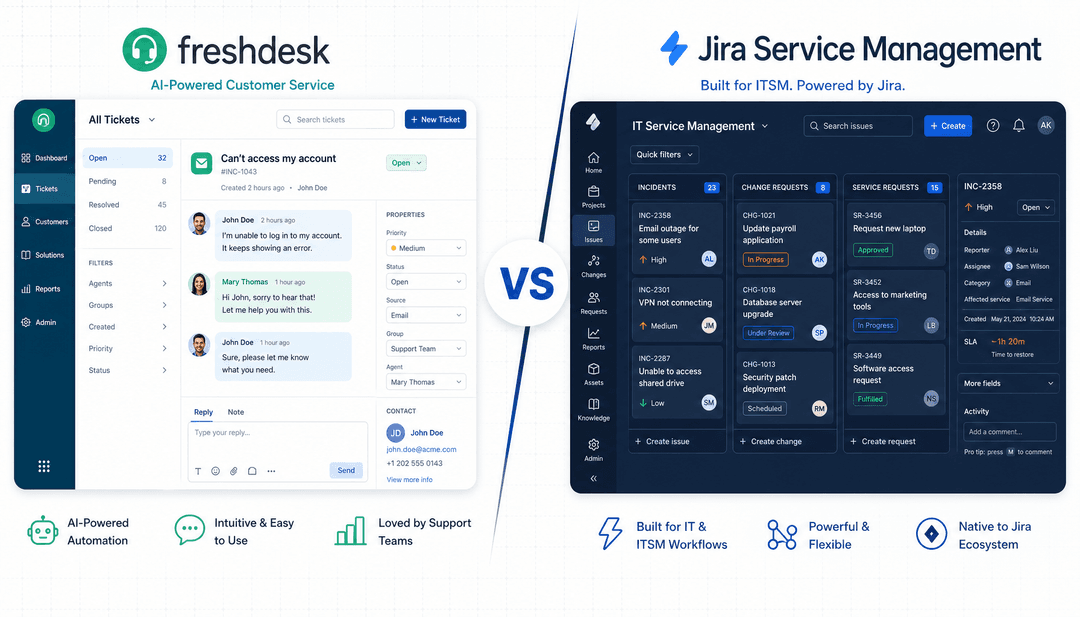

Enfin, il y a l'intégration transparente. La dernière chose que l'on souhaite, c'est une configuration longue et compliquée qui prend des mois de travail de développeur. Les meilleures solutions d'IA ne vous obligent pas à remplacer vos outils existants. Au lieu de cela, elles devraient se connecter directement à votre service d'assistance, que ce soit Zendesk ou Freshdesk, en quelques minutes seulement. Cette approche simple et en libre-service rend l'IA moderne accessible à tous, pas seulement aux grandes entreprises disposant d'énormes budgets informatiques.

Tarifs de Robust Intelligence

Comme on peut s'y attendre avec un logiciel destiné aux grandes entreprises, Robust Intelligence n'affiche pas ses prix publiquement. Pour obtenir un devis, vous devrez planifier une démonstration et parler à leur équipe de vente.

Ce modèle est logique pour leur type de solution complexe, mais il peut être un obstacle pour les équipes qui veulent simplement commencer rapidement et voir si quelque chose fonctionne. Pour de nombreuses entreprises, un prix transparent et prévisible est assez important pour la planification et la budgétisation sans se retrouver coincé dans un long processus de vente.

Élaborer un plan complet de sécurité de l'IA avec Robust Intelligence

L'ascension de Robust Intelligence et son acquisition par Cisco prouvent une chose avec certitude : la sécurité de l'IA est désormais une partie non négociable de toute pile technologique moderne. Ce n'est pas un complément ; c'est une nécessité.

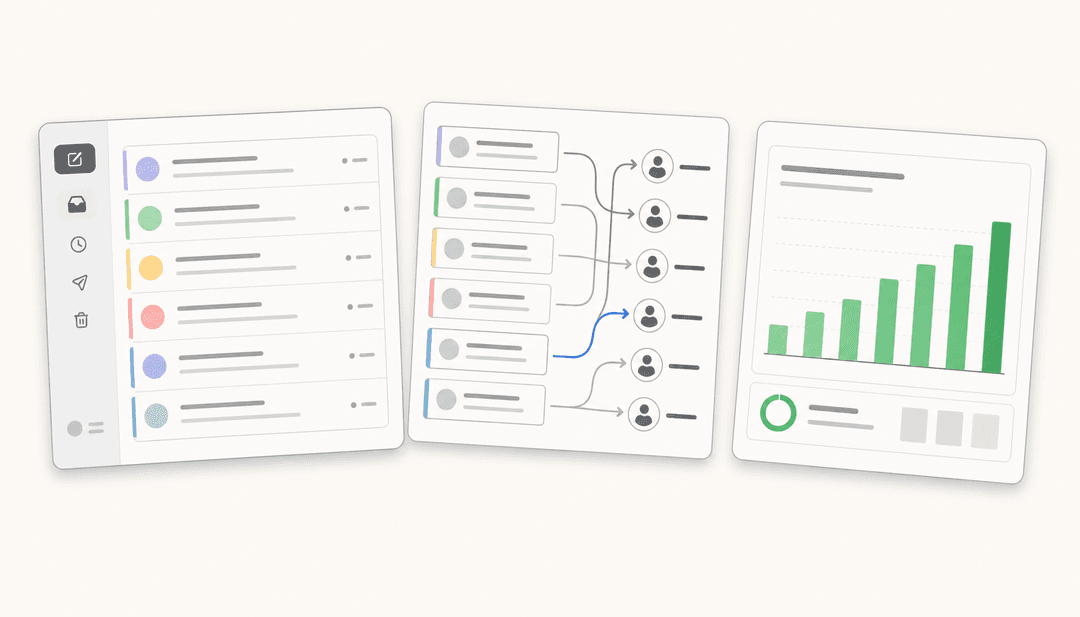

Mais une stratégie complète comporte en réalité deux parties. Premièrement, vous devez sécuriser les modèles d'IA sous-jacents contre les menaces techniques, ce que des entreprises comme Robust Intelligence gèrent. Deuxièmement, vous devez vous assurer que les applications d'IA que vous utilisez réellement sont contrôlées, fiables et dignes de confiance à chaque interaction. C'est là que des plateformes comme eesel AI entrent en jeu.

Pour les équipes du support client, de l'informatique ou des opérations internes, avoir une « intelligence vraiment robuste » signifie utiliser des outils d'IA qui vous offrent de la transparence, un contrôle précis et la confiance nécessaire pour tester et ajuster les choses en toute sécurité. Il s'agit de construire un système auquel vous pouvez réellement faire confiance, du modèle le plus profond jusqu'au client final.

Lancez-vous avec une IA de confiance

Si vous cherchez à utiliser l'IA pour le support client sans les risques, eesel AI offre une plateforme en libre-service que vous pouvez configurer en quelques minutes. Vous pouvez simuler ses performances sur vos propres tickets historiques et obtenir un contrôle total sur ce qui est automatisé. Essayez-la dès aujourd'hui.

Foire aux questions

Robust Intelligence est une entreprise de sécurité de l'IA qui développe une plateforme pour protéger les modèles et les applications d'IA tout au long de leur cycle de vie. Elle résout le problème critique de la sécurisation des systèmes d'IA contre des vulnérabilités uniques et subtiles que les outils de cybersécurité traditionnels ne peuvent pas détecter, garantissant ainsi leur fonctionnement sûr et fiable.

Robust Intelligence emploie une approche à deux volets : la Validation de l'IA, qui teste de manière proactive les modèles pour déceler les failles de sécurité avant leur déploiement, et la Protection de l'IA (Pare-feu IA), qui surveille en continu les entrées et les sorties en temps réel pour bloquer les menaces une fois les modèles opérationnels.

Oui, Robust Intelligence est spécifiquement conçu pour se défendre contre les menaces avancées de l'IA telles que l'injection de prompt et le jailbreaking, qui trompent l'IA pour qu'elle se comporte mal, et l'empoisonnement des données, où les attaquants fournissent secrètement de mauvaises données pour influencer le comportement du modèle. Il protège également contre les techniques d'évasion de modèle.

L'acquisition de Robust Intelligence par Cisco souligne que la sécurité de l'IA n'est plus une préoccupation de niche, mais une priorité absolue pour les grandes entreprises. Elle marque une évolution vers l'intégration directe de la sécurité avancée de l'IA dans l'infrastructure d'entreprise, en faisant une exigence fondamentale pour le déploiement d'applications d'IA.

Alors que Robust Intelligence sécurise les modèles d'IA sous-jacents, une stratégie complète nécessite également la gestion de la couche applicative pour s'assurer que l'IA se comporte de manière fiable dans les scénarios en contact avec les clients. Cela implique un contrôle granulaire des actions de l'IA, des tests sans risque et une intégration transparente avec les outils existants, comme le proposent des plateformes telles qu'eesel AI.

Non, Robust Intelligence n'affiche pas ses prix publiquement. Les entreprises intéressées doivent planifier une démonstration et consulter leur équipe de vente pour obtenir un devis, car leurs solutions sont généralement adaptées aux besoins des grandes entreprises.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.