Alors, vous avez probablement entendu parler de la vitesse folle de Groq. Ils font beaucoup de bruit en exécutant des grands modèles de langage (LLM) plus rapidement que n'importe qui d'autre. Leur ingrédient secret ? Des unités de traitement du langage (LPU) conçues sur mesure, une approche totalement différente des GPU qui alimentent habituellement le monde de l'IA.

Mais comme pour toute nouvelle technologie prometteuse, les grandes questions se posent : où est le piège ? Combien ça coûte ? Et est-ce vraiment adapté à vos besoins ?

Ce guide vous expliquera tout ce que vous devez savoir sur la tarification de Groq. Nous aborderons leur modèle de « jetons en tant que service », examinerons les coûts des différents modèles d'IA et identifierons les situations précises où Groq excelle. Nous serons également réalistes quant à ses limites et explorerons une alternative plus pratique et tout-en-un pour les équipes qui souhaitent simplement mettre en place l'IA sans se lancer dans un projet de développement colossal.

Qu'est-ce que Groq ? Comprendre la technologie derrière la tarification

À la base, Groq repose sur du matériel spécialisé. Ils ont créé une puce appelée l'unité de traitement du langage (LPU).

Imaginez la chose suivante : la plupart des IA fonctionnent sur des GPU (unités de traitement graphique), les mêmes puces qui alimentent les jeux vidéo haut de gamme. Ils sont puissants, mais ce sont des généralistes. Les LPU de Groq ont été conçus de A à Z pour une seule et unique tâche : exécuter des modèles d'IA à la vitesse de l'éclair.

Ce processus est appelé « inférence », c'est la partie où l'IA fait réellement le travail, comme répondre à une question ou écrire une phrase. Pour quelque chose comme un chatbot ou un agent de support client, la vitesse est essentielle. Personne n'aime attendre une réponse ; une IA lente et saccadée donne simplement l'impression d'être défectueuse.

Le principal avantage de Groq est sa latence ridiculement faible et son débit élevé (le nombre de mots, ou « jetons », qu'il peut produire par seconde). Il génère du texte si rapidement que cela semble presque instantané. Ils ont réussi cet exploit grâce à une architecture unique qui évite les embouteillages habituels que l'on observe dans les systèmes GPU. Ce n'est pas un outil pour entraîner des modèles d'IA ; c'est une machine hautement spécialisée pour les exécuter aussi vite que possible, humainement (ou inhumainement).

Décortiquer le modèle de tarification de Groq

La tarification de Groq fonctionne sur un modèle de « paiement à l'utilisation », ce qui est assez standard pour les API d'IA. Vous êtes facturé en fonction des « jetons », que vous pouvez considérer comme de petits morceaux de mots. Vous payez pour les jetons que vous envoyez (votre invite) et les jetons que le modèle renvoie (la réponse).

C'est simple, mais cela signifie aussi que votre facture peut varier considérablement en fonction de votre utilisation. Examinons la structure de tarification officielle de Groq.

Tarification de Groq pour les grands modèles de langage (LLM)

Groq vous donne accès à un ensemble de LLM open-source. Le prix varie en fonction de la taille et de l'intelligence du modèle. Les modèles plus grands coûtent généralement plus cher par jeton, mais ils peuvent traiter des requêtes plus complexes.

Voici un tableau qui présente la tarification de leurs modèles les plus populaires, en utilisant les informations de leur page de tarification officielle.

| Modèle d'IA | Vitesse (Jetons/Seconde) | Prix d'entrée (Par million de jetons) | Prix de sortie (Par million de jetons) |

|---|---|---|---|

| Llama 3.1 8B Instant 128k | 840 TPS | 0,05 $ | 0,08 $ |

| Llama 4 Scout (17Bx16E) 128k | 594 TPS | 0,11 $ | 0,34 $ |

| GPT OSS 20B 128k | 1 000 TPS | 0,10 $ | 0,50 $ |

| Qwen3 32B 131k | 662 TPS | 0,29 $ | 0,59 $ |

| Llama 3.3 70B Versatile 128k | 394 TPS | 0,59 $ | 0,79 $ |

| GPT OSS 120B 128k | 500 TPS | 0,15 $ | 0,75 $ |

| Kimi K2-0905 1T 256k | 200 TPS | 1,00 $ | 3,00 $ |

Tarification de Groq pour d'autres modèles

Groq ne se limite pas au texte. Ils proposent également des modèles pour d'autres tâches, comme la conversion de la parole en texte.

-

Synthèse vocale (PlayAI Dialog v1.0) : Cela vous coûtera 50,00 $ pour chaque million de caractères générés.

-

Reconnaissance vocale automatique (Whisper Large v3) : Le prix est de 0,111 $ par heure d'audio transcrite.

Solutions d'entreprise et API par lots

Si vous opérez à très grande échelle, Groq propose quelques options pour aider à gérer les coûts sur les tâches à volume élevé.

-

API par lots : Elle vous permet d'envoyer des milliers de requêtes en une seule fois et de bénéficier d'une réduction de 50 % sur les tarifs en temps réel. C'est idéal pour les tâches non urgentes, où vous pouvez soumettre un travail énorme et obtenir les résultats en un jour ou deux.

-

Mise en cache des invites : Cela vous aide à économiser de l'argent sur les requêtes répétitives. Si vous envoyez fréquemment la même entrée, vous obtiendrez un « accès en cache » et serez facturé 50 % de moins pour ces jetons d'entrée.

-

Accès Entreprise : Pour les projets d'envergure, comme la mise en place de matériel Groq sur site (GroqRack) ou l'utilisation de modèles personnalisés, vous devrez contacter leur équipe de vente pour un contrat sur mesure.

À qui s'adresse Groq ? Analyse de la valeur derrière la tarification

Avec son accent mis sur la vitesse pure, Groq est un choix parfait pour certains projets, mais honnêtement, c'est excessif pour d'autres. Déterminer si vous êtes dans leur public cible est essentiel.

Là où la vitesse de Groq justifie le prix

Groq est conçu pour les applications où une réponse en temps réel n'est pas seulement un plus, c'est l'essence même du produit.

-

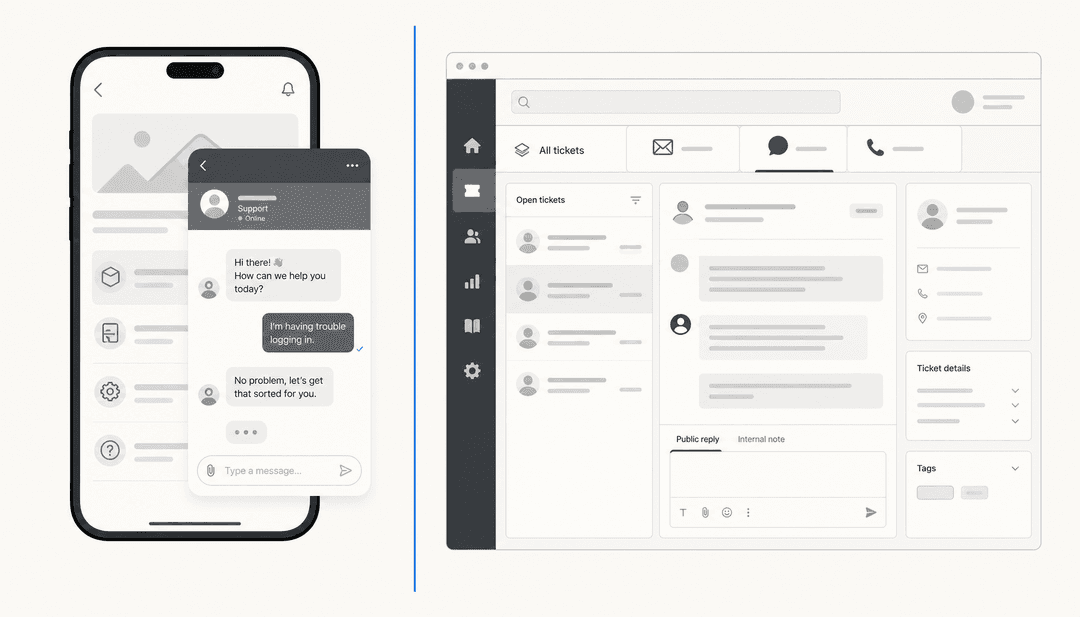

IA conversationnelle en direct : Pensez à des bots de service client ultra-réactifs, des assistants virtuels et des outils de traduction en temps réel où le moindre décalage rendrait la conversation maladroite et peu naturelle.

-

Génération de contenu interactif : Des choses comme des assistants de codage IA qui offrent des suggestions au fur et à mesure que vous tapez ou des outils d'écriture collaboratifs qui donnent un retour instantané.

-

Analyse de données en temps réel : Pour traiter et résumer des flux d'informations en direct, comme les tendances des médias sociaux ou les données boursières, au moment où elles se produisent.

-

Applications à commande vocale : Créer des assistants vocaux qui peuvent comprendre ce que vous dites et répondre sans ces longues pauses étranges.

Quand la tarification pourrait ne pas être le bon choix

Bien que la vitesse soit incroyable, Groq est un outil spécialisé et il n'est pas sans inconvénients.

-

Inférence uniquement : Vous ne pouvez pas utiliser les LPU de Groq pour entraîner ou affiner un modèle d'IA. Vous devez arriver avec un modèle déjà entraîné et prêt à l'emploi.

-

Nécessite une grande échelle pour être pertinent : Vous ne ressentez vraiment les avantages de l'architecture de Groq que lorsque vous exécutez des opérations à grande échelle. Si vous êtes un développeur qui bricole ou une petite équipe avec un faible trafic, le coût et l'effort pourraient être difficiles à justifier.

-

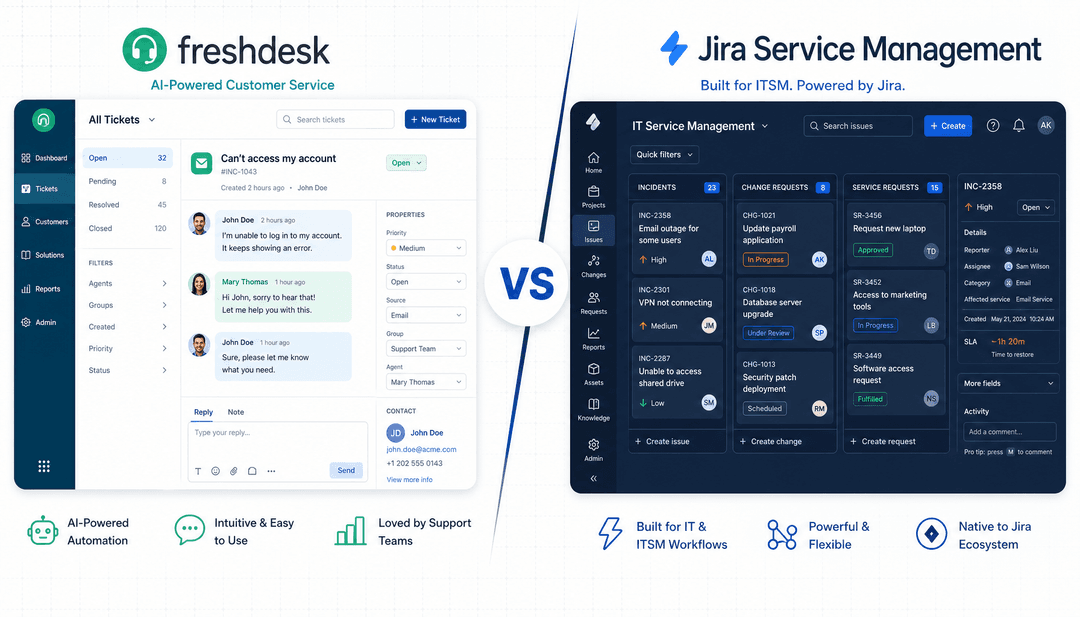

C'est un moteur, pas une voiture : C'est probablement la chose la plus importante à comprendre. Groq vous donne un moteur incroyablement rapide, mais ce n'est que le moteur. Vous devez construire le reste de la voiture : le châssis, les roues, la direction, les sièges. Cela signifie que votre équipe doit gérer tout le code pour les intégrations, les interfaces utilisateur et la logique qui fait fonctionner l'ensemble. C'est un travail énorme qui nécessite des ressources d'ingénierie sérieuses.

Pour la plupart des entreprises, en particulier les équipes de support et d'informatique, avoir une API rapide n'est qu'une toute petite pièce du puzzle. Vous avez besoin d'un système complet qui résout réellement les problèmes de l'entreprise.

Une voie plus pratique pour les équipes de support

Groq résout un problème : la vitesse matérielle. Mais pour une équipe de support ou d'informatique très occupée, ce n'est qu'une petite partie de l'équation. Vous avez besoin d'un outil qui résout réellement les problèmes des clients, pas seulement d'une API rapide.

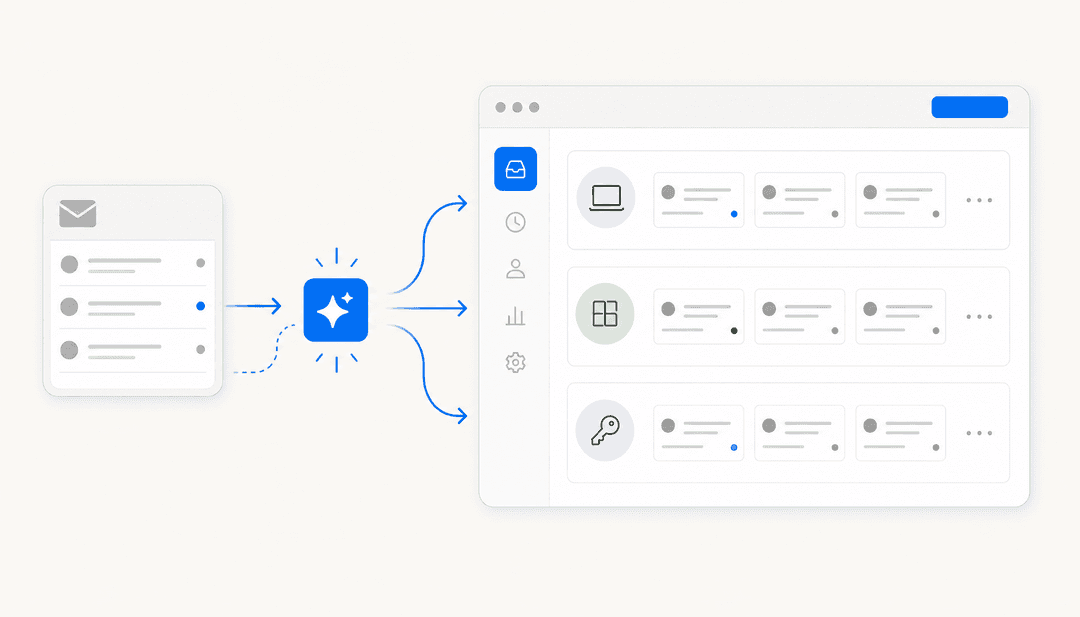

C'est là que s'appuyer sur une solution complète comme eesel AI a beaucoup plus de sens. Reprenons notre analogie de la voiture. Si Groq vous fournit le moteur, eesel AI vous donne la voiture entière, avec le plein et prête à démarrer. Vous n'avez pas besoin d'une armée de développeurs pour la mettre sur la route.

Voici pourquoi une plateforme de bout en bout est un meilleur pari pour la plupart des équipes :

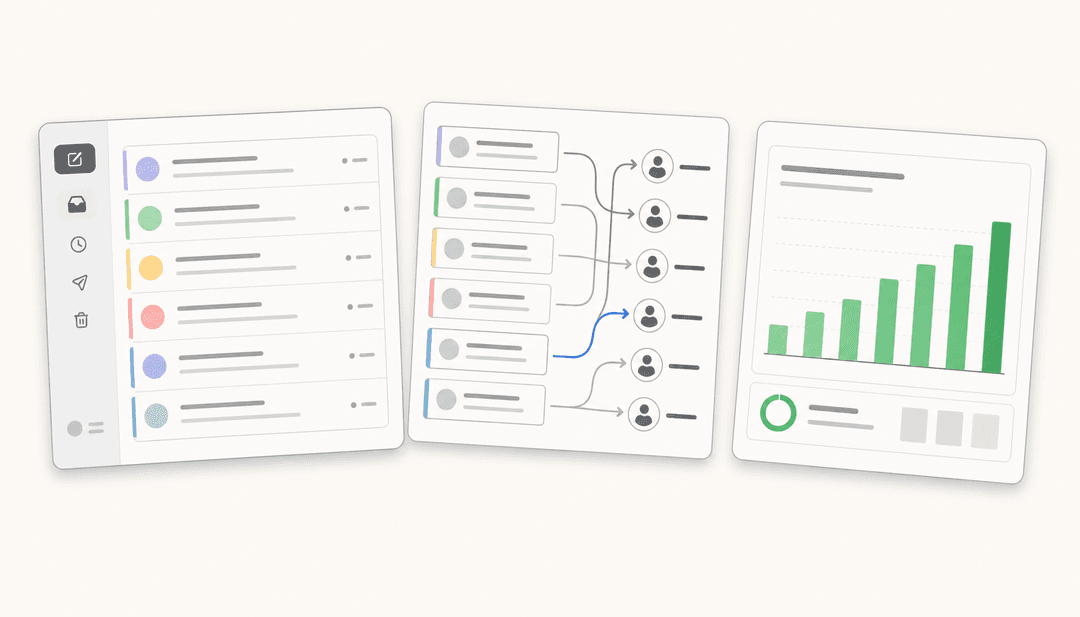

- Soyez opérationnel en quelques minutes, pas en quelques mois : Avec eesel AI, vous n'avez pas besoin d'écrire une seule ligne de code. Il offre des intégrations en un clic avec des services d'assistance comme Zendesk et Freshdesk, ainsi que des bases de connaissances comme Confluence. Vous pouvez avoir un agent IA entièrement fonctionnel en quelques minutes, tout seul. Pas de longs appels de vente ni de configuration compliquée.

- Unifiez vos connaissances instantanément : Une IA n'est intelligente que si les informations qu'elle détient le sont. eesel AI se connecte automatiquement à vos anciens tickets, articles d'aide et documents internes et apprend d'eux. Cela garantit que ses réponses sont précises et correspondent à votre image de marque, sans que vous ayez à tout copier-coller manuellement dans un nouveau système.

- Déployez en toute sécurité et avec un contrôle total : Lorsque vous construisez sur une API brute, une seule erreur peut causer de gros problèmes. eesel AI dispose d'un mode de simulation qui vous permet de tester votre IA sur des milliers de vos anciens tickets avant qu'elle ne parle à un vrai client. Vous pouvez voir exactement comment elle aurait répondu, prévoir son impact et la déployer en toute confiance.

- Tarification prévisible et transparente : Un modèle basé sur l'utilisation comme celui de Groq peut entraîner de mauvaises surprises sur la facture. eesel AI propose des formules tarifaires transparentes basées sur un nombre défini d'interactions IA par mois. Vos coûts sont prévisibles et vous n'êtes pas pénalisé par des frais supplémentaires pour avoir résolu plus de tickets.

Pour toute équipe qui a besoin d'améliorer son efficacité et de rendre ses clients plus heureux dès maintenant, une plateforme complète comme eesel AI est le moyen le plus rapide et le plus fiable d'y parvenir.

Dernières réflexions sur la tarification de Groq

Soyons clairs, la technologie de Groq est vraiment impressionnante. Si vous êtes une équipe avec des ressources d'ingénierie conséquentes qui développe une application en temps réel où chaque milliseconde compte, leur vitesse est difficile à battre. Le modèle de tarification de Groq vous permet de payer directement pour cette performance brute.

Cependant, pour la plupart des entreprises, en particulier dans le service client et l'informatique, l'objectif n'est pas seulement la vitesse, c'est de résoudre les problèmes efficacement. Construire un système de support entier à partir de zéro au-dessus d'une API est un projet massif et coûteux.

Si vous recherchez une solution qui vous offre toute la puissance de l'IA sans le casse-tête du développement, jetez un œil à eesel AI. C'est une plateforme entièrement gérée, conçue pour automatiser votre support, aider vos agents et rendre l'ensemble de vos opérations plus fluides dès le premier jour.

Foire aux questions

Oui, Groq propose plusieurs solutions pour une utilisation à haut volume. Leur API par lots offre une réduction de 50 % pour les requêtes non urgentes à grande échelle, et la mise en cache des invites peut réduire les coûts des requêtes répétitives. Pour les déploiements personnalisés comme GroqRack ou les modèles sur mesure, vous devez contacter leur équipe de vente pour une tarification d'entreprise Groq.

Outre le nombre de jetons, le modèle d'IA spécifique que vous sélectionnez a un impact significatif sur la tarification de Groq ; les modèles plus grands et plus performants coûtent généralement plus cher par jeton. De plus, le fait que vous utilisiez l'inférence en temps réel ou l'API par lots à prix réduit pour les tâches non urgentes affectera votre coût global.

La tarification de Groq va au-delà des simples LLM textuels. Ils proposent également des tarifs pour d'autres services d'IA, tels que la synthèse vocale (PlayAI Dialog v1.0) facturée par million de caractères, et la reconnaissance vocale automatique (Whisper Large v3) facturée à l'heure d'audio transcrite.

Une entreprise devrait envisager la tarification de Groq lorsque la vitesse de réponse en temps réel est absolument essentielle pour son application, comme dans l'IA conversationnelle en direct, la génération de contenu interactif ou les applications à commande vocale. C'est la solution la mieux adaptée aux projets fonctionnant à une échelle significative où une faible latence est une exigence principale.

Les principales limitations sont que Groq est uniquement destiné à l'inférence, ce qui signifie que vous ne pouvez pas l'utiliser pour l'entraînement de modèles. Les avantages de la tarification de Groq sont plus apparents à grande échelle, et il fournit un « moteur, pas une voiture », nécessitant des ressources d'ingénierie importantes pour construire une application complète autour de son API rapide.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.

La tarification des LLM de Groq est basée sur un modèle de « jetons en tant que service » avec paiement à l'utilisation. Vous êtes facturé par million de jetons à la fois pour l'entrée (votre invite) et la sortie (la réponse du modèle), les prix variant en fonction du LLM spécifique que vous choisissez.