On a l'impression que chaque semaine, une nouvelle annonce concernant l'IA nous laisse sans voix, et la révélation par OpenAI d'une voix conversationnelle hyper-réaliste pour ChatGPT en fait définitivement partie. Les démos étaient assez incroyables : une IA capable de discuter, de rire et même de chanter avec un niveau d'émotion et de synchronisation presque humain.

Cette nouvelle fonctionnalité, qui s'inscrit dans le cadre du déploiement massif de la voix ChatGPT, fonctionne sur leur dernier modèle, GPT-4o. C'est un saut de géant par rapport aux chats textuels auxquels nous sommes habitués, nous plongeant dans un monde où parler à une IA semble beaucoup plus naturel. La bonne nouvelle est qu'elle est désormais disponible pour toute personne connectée, bien que les abonnés payants bénéficient de limites d'utilisation beaucoup plus élevées.

Alors, pourquoi tout cet enthousiasme ? Dans cet article, nous allons explorer ce qu'est ce nouveau mode vocal, comment il se compare à l'ancienne version, ce que les gens en pensent réellement, et ce que ses limites signifient pour les entreprises qui souhaitent utiliser l'IA conversationnelle pour plus qu'un simple divertissement.

Qu'est-ce que le nouveau mode vocal GPT-4o ?

Dans le fond, ce nouveau mode vocal est une tout autre espèce. Il est propulsé par GPT-4o, qui est le premier modèle d'OpenAI entraîné de bout en bout sur du texte, de la vision et de l'audio. Pour dire les choses simplement, il ne se contente pas de traiter des mots ; il traite le son.

Il s'agit d'un changement massif d'un point de vue technique. L'ancien mode vocal était un peu maladroit, assemblé à partir de trois modèles distincts : un pour transformer votre parole en texte, un autre pour générer une réponse, et un troisième pour transformer ce texte en parole. Cela fonctionnait, mais ce n'était pas vraiment fluide.

GPT-4o gère tout d'un seul coup. Puisque l'IA traite l'audio directement, elle peut percevoir votre ton, entendre plusieurs interlocuteurs et même remarquer les bruits de fond sans être distraite. Cette approche tout-en-un rend la conversation beaucoup plus réelle, avec un temps de réponse moyen de seulement 320 millisecondes. C'est pratiquement aussi rapide qu'un être humain.

Voici ce que cela signifie concrètement pour vous :

-

Des réponses fluides en temps réel : Ces pauses robotiques gênantes appartiennent au passé. Elle répond presque instantanément, de sorte que la conversation s'écoule naturellement.

-

Vous pouvez l'interrompre : Tout comme lorsque vous parlez à un ami, vous pouvez intervenir pendant que l'IA parle. Elle s'arrêtera, écoutera et ajustera sa réponse sans être déroutée.

-

Conscience émotionnelle et tonale : C'est la partie vraiment impressionnante. GPT-4o peut capter les subtilités de votre voix, comme le sarcasme, l'excitation ou l'hésitation, et répondre avec une large gamme de ses propres émotions et tons.

Pour vous offrir des options, il y a neuf voix prédéfinies au choix : Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce et Vale. Vous pouvez les trouver toutes listées dans la FAQ officielle.

Bien sûr, le déploiement n'a pas été totalement sans heurts. Vous avez peut-être entendu parler de la polémique autour de la voix « Sky ». OpenAI a dû la suspendre après que Scarlett Johansson a exprimé ses inquiétudes quant à la ressemblance frappante avec sa propre voix. Une analyse commandée par NPR a par la suite révélé que la voix de Sky était plus proche de celle de Johansson que celle de 98 % des autres actrices examinées. Cela montre à quel point ce nouveau monde de l'interaction par IA devient complexe.

Comparaison entre l'ancien et le nouveau mode vocal

Bien que la technologie soit un grand pas en avant, l'expérience utilisateur réelle a fait l'objet de nombreux débats. C'est plus rapide, certes, mais est-ce meilleur ? La réponse est un peu plus nuancée qu'on ne le pense.

Pour bien comprendre ce qui change, comparons l'ancien mode vocal côte à côte avec le nouveau.

| Caractéristique | Voix standard (Héritée) | Mode vocal avancé (GPT-4o) |

|---|---|---|

| Modèle sous-jacent | Trois modèles distincts pour la transcription, l'intelligence et la synthèse vocale | Un modèle multimodal unique de bout en bout (GPT-4o) |

| Vitesse de réponse | Délai perceptible de 2,8 à 5,4 secondes | Presque instantanée, avec un temps de réponse moyen de 320 ms |

| Flux de conversation | Par tour ; il fallait attendre que l'IA finisse de parler | Fluide et interruptible, permettant un va-et-vient naturel |

| Conscience tonale | Monotone et robotique ; ne pouvait pas traiter l'émotion de l'utilisateur à partir de l'audio | Peut détecter l'émotion de l'utilisateur et répondre avec des intonations variées |

| Perception utilisateur | Souvent décrite comme « réfléchie », « calme » et « réconfortante » | Perçue par certains comme « précipitée », « superficielle » et moins personnelle |

Cette dernière ligne, « Perception utilisateur », est celle où les choses deviennent intéressantes. Même si la nouvelle voix est techniquement supérieure à tous points de vue, un nombre surprenant de personnes regrettent l'ancienne. La voix héritée (legacy), avec ses pauses lentes et délibérées, semblait plus réfléchie pour certains. Elle vous laissait une seconde pour réfléchir et donnait l'impression d'un partenaire calme et patient.

En revanche, la nouvelle voix GPT-4o peut parfois sembler un peu trop empressée. Elle est si rapide à répondre qu'on peut avoir l'impression qu'elle essaie de précipiter la conversation. Pour des questions rapides, c'est génial. Mais pour un brainstorming approfondi ou simplement pour réfléchir à voix haute, certains utilisateurs ont trouvé que l'ancien rythme, plus lent, était en fait plus utile.

Vous ne pouvez pas non plus avoir de discussions approfondies sur l'AVM comme vous le pouviez sur la version Standard, et les réponses sont beaucoup plus superficielles. C'est inutilisable si vous faites du brainstorming d'idées pour des projets d'écriture créative, etc.

Comment accéder et utiliser le nouveau mode vocal

Vous voulez l'essayer par vous-même ? La mise en route est assez simple.

Selon la FAQ d'OpenAI, les conversations vocales sont disponibles pour tous les utilisateurs connectés sur les applications mobiles, les applications de bureau et la version web sur chatgpt.com. Si vous êtes abonné Plus, vous obtiendrez des limites de messages jusqu'à 5 fois plus élevées que les utilisateurs gratuits, ce qui vous permettra de discuter beaucoup plus longtemps.

Voici comment l'activer :

-

Ouvrez l'application ChatGPT sur votre téléphone ou rendez-vous sur le site web.

-

Cherchez l'icône de casque dans le coin inférieur droit et appuyez dessus.

-

La première fois que vous l'utilisez, il vous sera demandé de choisir l'une des neuf voix.

-

Ne vous inquiétez pas trop du choix. Vous pourrez toujours le modifier plus tard dans vos paramètres.

Et voilà ! Vous pouvez commencer à parler et voir ce que vous en pensez.

Réponse de la communauté : un bilan mitigé

La réaction initiale a été un pur émerveillement. Les démos étaient époustouflantes, montrant une IA capable de réagir à ce qu'un utilisateur voyait via la caméra de son téléphone et de mener une conversation incroyablement réelle. Cela semblait être une véritable percée.

Mais au fur et à mesure que de plus en plus de personnes l'ont eue entre les mains, les retours sont devenus plus complexes. Un coup d'œil rapide sur des forums comme Reddit montre une communauté à la fois impressionnée et un peu déçue.

D'un côté, la vitesse et le flux naturel sont des victoires évidentes. De l'autre, il y a un sentiment commun que quelque chose a été perdu lors de la mise à niveau.

De nombreux utilisateurs ont ressenti un étrange sentiment de perte pour l'ancienne voix. Certains l'ont décrite comme un « ami réconfortant » dont le rythme plus lent et plus mesuré était parfait pour échanger des idées ou résoudre un problème difficile.

ça va être comme perdre un ami cher. La voix standard est réfléchie et possède une voix et une cadence qui sont naturelles et réconfortantes. Poignant.

D'autres ont souligné que la nouvelle voix, plus rapide, semble souvent essayer de mettre fin à la conversation. Elle peut vous donner une réponse rapide puis se taire, au lieu de s'engager dans le type de discussion ouverte dans lequel l'ancienne voix excellait.

Une plainte courante est que la « personnalité » de la nouvelle voix semble un peu générique et pas tout à fait connectée au puissant modèle textuel sous-jacent. Certains estiment que ses réponses sont plus « superficielles », ce qui n'est pas idéal pour les tâches créatives où l'on attend un partenaire pour une réflexion approfondie.C'est comme si elle essayait de conclure et de terminer la conversation à chaque message, même quand nous venons de commencer et que c'est clairement le début d'une discussion.

C'est un exemple classique où une amélioration technique ne conduit pas toujours à une meilleure expérience humaine pour tout le monde. La nouvelle voix est une prouesse d'ingénierie incroyable, mais il semble qu'elle n'ait pas tout à fait capturé la magie qui faisait que certains utilisateurs appréciaient vraiment l'ancienne version, pourtant plus rustique.

Pour voir et entendre la différence par vous-même, regardez cette vidéo qui présente le nouveau mode vocal en action. Elle offre un aperçu direct de la vitesse, du ton et du flux conversationnel de la mise à jour GPT-4o.

Considérations pour les applications professionnelles

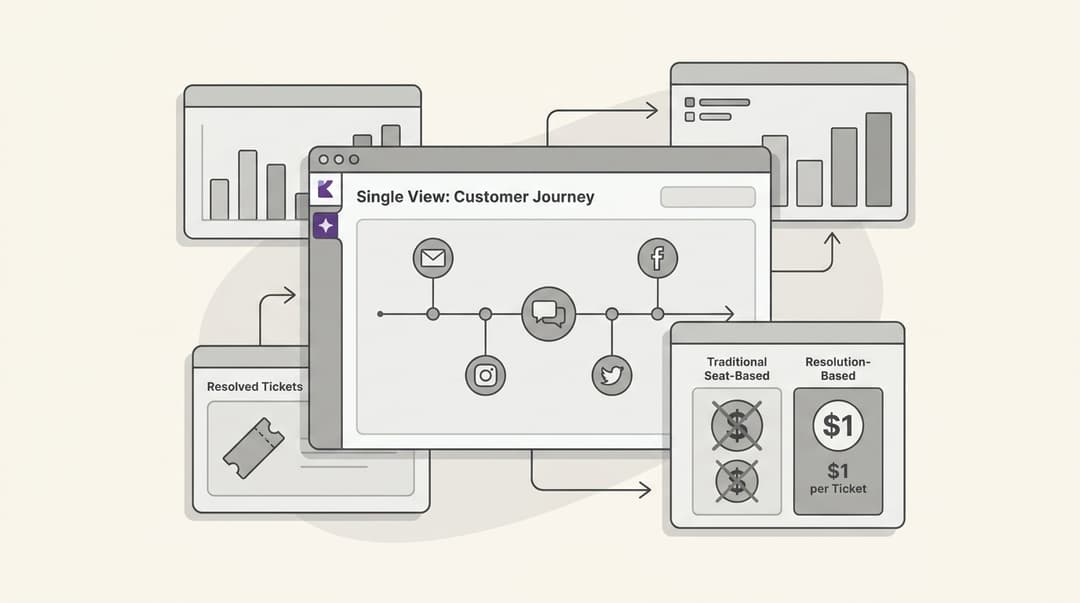

S'il est cool de discuter avec une IA sur son téléphone, qu'est-ce que tout cela signifie pour les entreprises ? Le potentiel de l'IA conversationnelle pour le service client, les ventes et le support interne est massif, mais un outil polyvalent comme ChatGPT présente des limites spécifiques dans un cadre professionnel.

Les retours mitigés des utilisateurs sur sa personnalité ne sont qu'un début. Voici quelques points à considérer pour les applications en entreprise :

-

Manque de contexte métier : ChatGPT n'a aucune idée de votre entreprise. Il ne peut pas consulter vos données de helpdesk dans Zendesk, vérifier l'historique des commandes d'un client dans Shopify, ou trouver vos politiques internes dans Confluence. Ses réponses resteront toujours génériques.

-

Incapacité à agir : Un client ne peut pas lui demander de traiter un remboursement, et un employé ne peut pas lui demander de créer un ticket de support dans Jira. C'est une boîte fermée qui ne peut que parler ; elle ne peut rien faire au sein de vos flux de travail existants.

-

Personnalisation et contrôles de sécurité limités : Pour les applications professionnelles, le contrôle de la voix de marque de l'IA, le respect des politiques de l'entreprise et la mise en place de règles pour le transfert à un agent humain sont cruciaux. Les outils à usage général n'offrent pas forcément un contrôle granulaire sur ces aspects.

Bien que la technologie soit incroyable pour un usage personnel, les entreprises ont besoin d'un coéquipier IA spécialisé, connecté à leurs systèmes et flux de travail existants.

eesel AI : Une IA spécialisée pour l'entreprise

C'est là que des outils spécialisés comme eesel AI peuvent s'avérer bénéfiques. Nous avons construit eesel autour d'une idée simple : vous ne vous contentez pas de configurer une IA, vous l'embauchez comme nouveau coéquipier. Elle est opérationnelle en quelques minutes, et non en semaines, en se connectant à vos outils existants et en apprenant de vos données métier spécifiques, de vos anciens tickets, des articles de votre centre d'aide et de vos documents internes. Cela signifie qu'elle dispose du bon contexte dès le premier jour.

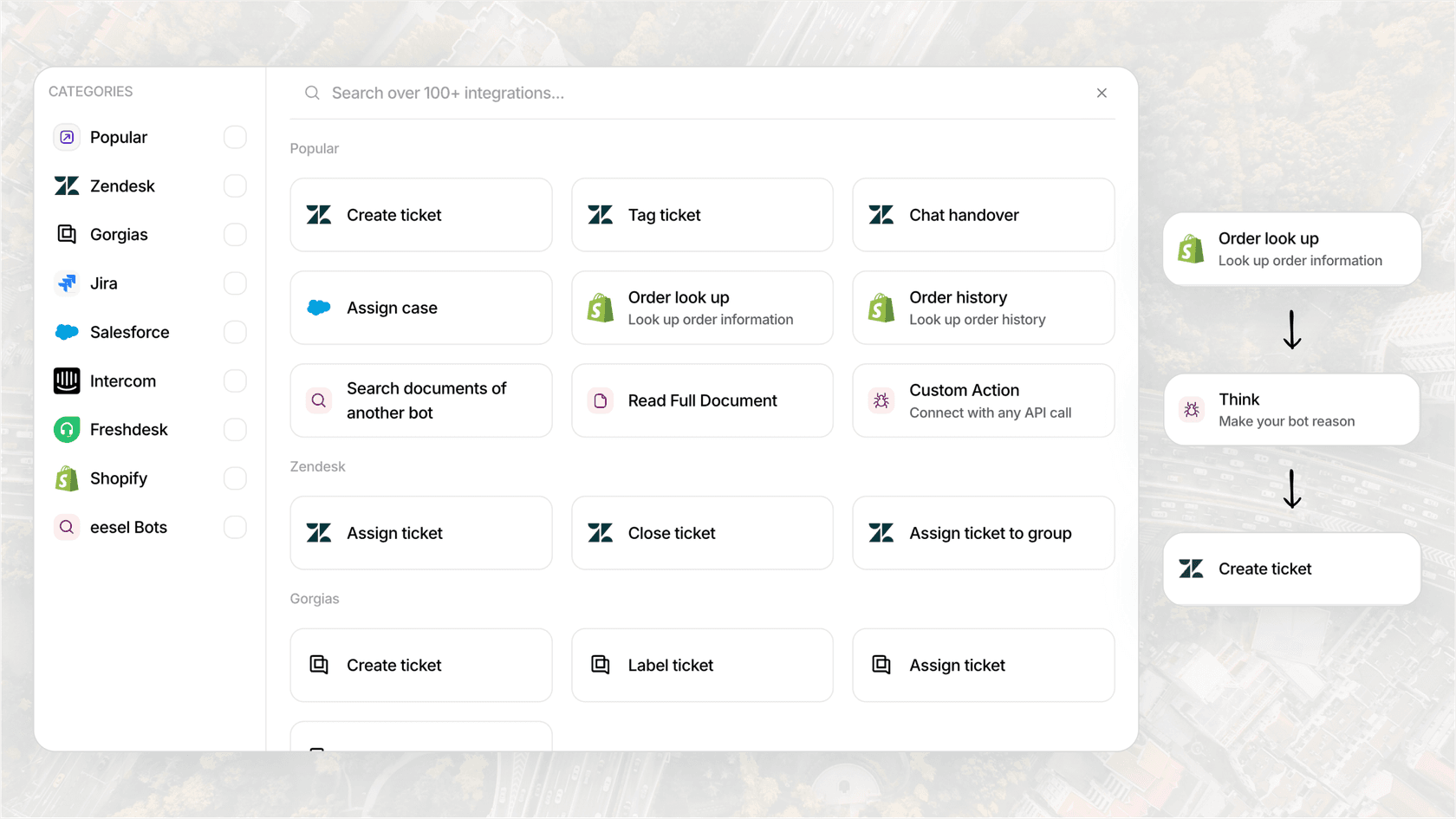

Voici comment un coéquipier IA comme eesel gère les limites d'un outil vocal polyvalent :

-

Conscient du contexte : eesel se connecte directement à vos sources de connaissances comme Confluence et à vos plateformes de support comme Zendesk. Il ne donne pas seulement une réponse générique ; il donne la bonne réponse basée sur les informations réelles de votre entreprise.

-

Orienté vers l'action : Les Agents d'eesel AI sont conçus pour faire plus que simplement parler. Ils peuvent être configurés pour effectuer des tâches dans d'autres applications, comme rechercher des informations sur une commande dans Shopify, mettre à jour un champ de ticket ou diriger les demandes entrantes vers la bonne équipe.

-

Entièrement contrôlé : Avec eesel, c'est vous qui commandez. Vous définissez son ton, sa base de connaissances et ses règles d'escalade en langage naturel. Vous pouvez lui dire : « Transfère toujours les litiges de facturation à un humain », et il le fera. Cela garantit qu'il agit comme une extension fiable de votre équipe.

Pour les entreprises souhaitant utiliser une IA conversationnelle puissante en interne, notre Chat Interne IA est un exemple parfait. Vous pouvez l'inviter sur votre Slack ou Microsoft Teams, où il pourra donner des réponses instantanées et fiables aux questions des employés, le tout basé sur la documentation privée de votre entreprise. C'est un moyen pratique de réduire les questions répétitives et d'aider tout le monde à être plus productif.

Dernières réflexions

Il ne fait aucun doute que le déploiement de la voix ChatGPT est une prouesse technologique majeure. Il rend l'interaction avec l'IA plus naturelle, accessible et humaine que jamais, et offre un aperçu fascinant de ce qui nous attend.

Les retours des utilisateurs soulignent toutefois une distinction entre l'IA polyvalente et l'IA spécialisée. Si une IA vocale à usage général est efficace pour un usage personnel et des questions rapides, les entreprises ont souvent des exigences différentes. Ces besoins incluent souvent une intégration profonde avec les systèmes existants, la capacité d'effectuer des actions spécifiques et des contrôles de sécurité robustes.

Prêt à voir ce qu'un véritable coéquipier IA peut faire pour votre entreprise ? Explorez les solutions d'IA d'eesel ou commencez un essai gratuit dès aujourd'hui.

Questions fréquemment posées

La plus grande différence réside dans la technologie sous-jacente. La nouvelle voix utilise un modèle unique de bout en bout appelé GPT-4o qui traite l'audio directement. Cela rend les conversations beaucoup plus rapides, plus naturelles, et permet à l'IA de détecter les émotions et d'y répondre, contrairement à l'ancien système à étapes multiples.

Oui, il est disponible pour tous les utilisateurs connectés sur mobile, bureau et le web. Cependant, les abonnés payants (comme les utilisateurs de ChatGPT Plus) bénéficient de limites de messages nettement plus élevées, permettant des conversations beaucoup plus longues.

Certains utilisateurs trouvaient que le rythme plus lent et plus délibéré de l'ancienne voix était apaisant et réfléchi. Ils estimaient qu'elle était un meilleur partenaire pour le brainstorming ou la réflexion sur des idées complexes, tandis que la nouvelle voix, plus rapide, peut parfois sembler précipitée ou superficielle.

Pour les entreprises, ses principales limites sont le manque de contexte spécifique (elle ne peut pas accéder aux données de votre entreprise), l'impossibilité d'effectuer des actions dans vos logiciels professionnels (comme traiter un remboursement), et l'absence de contrôle sur sa personnalité, son ton et ses protocoles de sécurité.

Il y a neuf voix prédéfinies disponibles au choix. Elles se nomment Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce et Vale. Vous pouvez changer la voix sélectionnée à tout moment dans les paramètres.

Share this article

Article by

Kenneth Pangan

Rédacteur et marketeur depuis plus de dix ans, Kenneth Pangan partage son temps entre l'histoire, la politique et l'art, avec de nombreuses interruptions de ses chiens réclamant de l'attention.

Pour l'activer, ouvrez l'application ou le site web ChatGPT et cherchez l'icône de casque, généralement située dans le coin inférieur droit. Appuyez dessus, et vous serez invité à choisir une voix pour commencer votre conversation.