さて、Groqの驚異的なスピードについての話題を耳にしたことがあるでしょう。彼らは大規模言語モデル(LLM)を他の誰よりも高速に実行することで、大きな注目を集めています。その秘訣は?独自に構築された言語処理ユニット(LPU)です。これは通常AIの世界を支えているGPUとは全く異なるアプローチです。

しかし、どんな素晴らしい新技術にも大きな疑問がつきものです。何か落とし穴は?コストはどれくらい?そして、それは本当にあなたのニーズに合っているのでしょうか?

このガイドでは、Groqの価格設定について知っておくべきことのすべてを解説します。彼らの「トークン・アズ・ア・サービス」モデルを掘り下げ、様々なAIモデルのコストを確認し、Groqが輝く具体的な状況を特定します。また、その限界についても率直に触れ、大規模な開発プロジェクトなしでAIを機能させたいチームのための、より実用的でオールインワンの代替案を探ります。

Groqとは?価格設定の背景にある技術を理解する

Groqの核心は、特殊なハードウェアにあります。彼らは言語処理ユニット(LPU)と呼ばれるチップを開発しました。

こう考えてみてください。ほとんどのAIは、高性能なビデオゲームを動かすのと同じチップであるGPU(グラフィックス処理ユニット)上で実行されます。GPUは強力ですが、汎用的なものです。GroqのLPUは、ただ一つの仕事、つまりAIモデルを電光石火の速さで実行することだけを目的として、ゼロから構築されました。

このプロセスは「推論」と呼ばれ、AIが実際に質問に答えたり文章を書いたりといった作業を行う部分です。チャットボットやカスタマーサポートエージェントのようなものでは、ここでのスピードがすべてです。返事を待たされるのは誰も好みません。遅くてラグのあるAIは、壊れているように感じられます。

Groqの主な利点は、信じられないほどの低遅延と高スループット(1秒あたりに生成できる単語、つまり「トークン」の数)です。テキストを非常に高速に生成するため、ほとんど瞬時に感じられます。彼らは、GPUシステムでよく見られる通常の交通渋滞を回避する独自のアーキテクチャでこれを実現しました。これはAIモデルをトレーニングするためのツールではなく、それらを人間(あるいは超人的)に可能な限り高速に実行するための、高度に専門化されたマシンなのです。

Groqの価格モデルを分析する

Groqの価格設定は「Pay-as-you-go」(従量課金制)モデルで機能しており、これはAI APIではかなり標準的です。課金は「トークン」に基づいて行われます。トークンは単語の小さな断片のようなものだと考えてください。送信するトークン(プロンプト)とモデルが返すトークン(回答)の両方に対して料金を支払います。

これは単純明快ですが、使用量によって請求額が大きく変動する可能性も意味します。Groqの公式な価格体系を見てみましょう。

大規模言語モデル(LLM)のGroq価格

Groqでは、多くのオープンソースLLMにアクセスできます。価格はモデルのサイズと能力によって変わります。通常、大きなモデルはトークンあたりのコストが高くなりますが、より複雑なリクエストに対応できます。

以下は、公式価格ページの情報に基づいた、最も人気のあるモデルの価格一覧表です。

| AIモデル | 速度(トークン/秒) | 入力価格(100万トークンあたり) | 出力価格(100万トークンあたり) |

|---|---|---|---|

| Llama 3.1 8B Instant 128k | 840 TPS | $0.05 | $0.08 |

| Llama 4 Scout (17Bx16E) 128k | 594 TPS | $0.11 | $0.34 |

| GPT OSS 20B 128k | 1,000 TPS | $0.10 | $0.50 |

| Qwen3 32B 131k | 662 TPS | $0.29 | $0.59 |

| Llama 3.3 70B Versatile 128k | 394 TPS | $0.59 | $0.79 |

| GPT OSS 120B 128k | 500 TPS | $0.15 | $0.75 |

| Kimi K2-0905 1T 256k | 200 TPS | $1.00 | $3.00 |

その他のモデルのGroq価格

Groqはテキストだけではありません。音声をテキストに変換するなど、他のタスク用のモデルも提供しています。

-

**テキスト読み上げ(PlayAI Dialog v1.0):**生成される100万文字ごとに50.00ドルかかります。

-

**自動音声認識(Whisper Large v3):**文字起こしされる音声1時間あたり0.111ドルです。

エンタープライズおよびバッチAPIソリューション

大規模に運用している場合、Groqには大量のジョブのコストを管理するためのいくつかのオプションがあります。

-

**バッチAPI:**一度に数千のリクエストを送信し、リアルタイム料金から50%の割引を受けることができます。緊急ではないタスクに最適で、大量のジョブを投入して1〜2日で結果を受け取ることができます。

-

**プロンプトキャッシング:**繰り返し発生するクエリの費用を節約するのに役立ちます。同じ入力を頻繁に送信すると、「キャッシュヒット」となり、それらの入力トークンに対して50%安い料金が請求されます。

-

**エンタープライズアクセス:**オンプレミスでのGroqハードウェアのセットアップ(GroqRack)やカスタム調整されたモデルの使用など、大規模な案件については、カスタム契約のために営業チームに問い合わせる必要があります。

Groqは誰のためのものか?価格の裏にある価値を分析する

純粋なスピードに焦点を当てているGroqは、一部のプロジェクトには最適ですが、正直なところ、他の用途には過剰スペックです。自分が彼らの得意分野にいるかどうかを見極めることが重要です。

Groqのスピードが価格を正当化する場面

Groqは、リアルタイムの応答が単なる「あれば嬉しい」機能ではなく、まさにその核心であるようなアプリのために作られています。

-

**ライブ会話型AI:**非常に応答性の高いカスタマーサービスボット、仮想アシスタント、リアルタイム翻訳ツールなど、少しの遅延でも会話がぎこちなく不自然に感じられるようなアプリケーションです。

-

**インタラクティブなコンテンツ生成:**入力中に提案を行うAIコーディングアシスタントや、即座にフィードバックを提供する共同執筆ツールなどです。

-

**リアルタイムデータ分析:**ソーシャルメディアのトレンドや株式市場のデータなど、ライブで流れてくる情報を発生と同時に処理・要約するためです。

-

**音声対応アプリケーション:**奇妙な長い間を置かずに、あなたの言っていることを理解して返答できる音声アシスタントの作成です。

価格が適切な選択ではないかもしれない場合

そのスピードは驚異的ですが、Groqは専門的なツールであり、欠点がないわけではありません。

-

**推論のみ:**GroqのLPUを使ってAIモデルをトレーニングしたり、ファインチューニングしたりすることはできません。すでにトレーニング済みの、すぐに使えるモデルを用意する必要があります。

-

**スケールがないと意味がない:**Groqのアーキテクチャの恩恵を本当に感じられるのは、大規模に物事を実行しているときだけです。単なる趣味の開発者やトラフィックの少ない小規模なチームの場合、コストと労力を正当化するのは難しいかもしれません。

-

**エンジンであって、車ではない:**これが恐らく理解すべき最も重要な点です。Groqは信じられないほど高速なエンジンを提供しますが、それはあくまでエンジンです。あなたは車の残りの部分、つまりシャーシ、車輪、ステアリング、座席を自分で作る必要があります。つまり、インテグレーション、ユーザーインターフェース、そしてすべてを連携させるロジックのコードはすべてあなたのチームが担当しなければならないということです。これは、真剣なエンジニアリングリソースを必要とする巨大な仕事です。

ほとんどのビジネス、特にサポートやITチームにとって、高速なAPIを持つことはパズルのほんの小さなピースに過ぎません。ビジネス上の問題を実際に解決する完全なシステムが必要です。

サポートチームのためのより実用的な道筋

Groqはハードウェアの速度という一つの問題を解決します。しかし、多忙なサポートやITチームにとって、それは全体像のほんの一部に過ぎません。必要なのは、単に高速なAPIではなく、実際に顧客の問題を解決するツールです。

ここでeesel AIのような完全なソリューションに頼る方がはるかに理にかなっています。車の例えを続けましょう。Groqがエンジンを提供するとしたら、eesel AIはガソリン満タンですぐに走り出せる車そのものを提供します。それを道路に出すために開発者のピットクルーは必要ありません。

ほとんどのチームにとって、エンドツーエンドのプラットフォームがより良い選択である理由は以下の通りです:

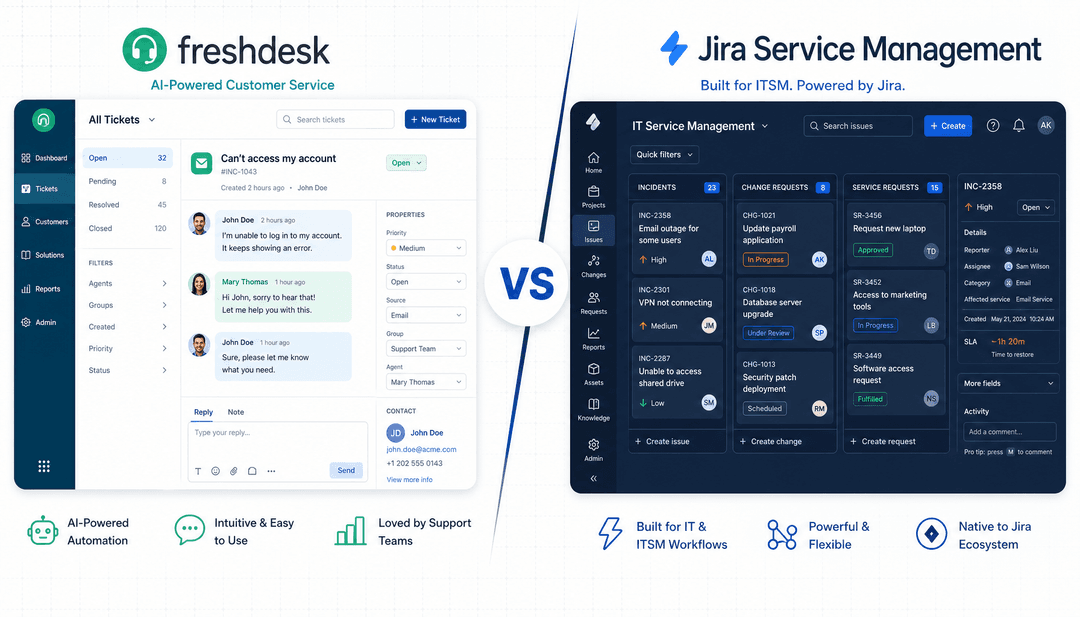

- **数ヶ月ではなく、数分で本番稼働:**eesel AIを使えば、一行のコードも書く必要はありません。ZendeskやFreshdeskのようなヘルプデスク、さらにConfluenceのようなナレッジベースとのワンクリック統合を提供します。完全に機能するAIエージェントを、すべて自分自身で、数分で立ち上げて実行することができます。長い営業電話や複雑な設定は必要ありません。

- **知識を瞬時に統合:**AIは、持っている情報만큼しか賢くなりません。eesel AIは、過去のチケット、ヘルプ記事、社内ドキュメントに自動的に接続し、そこから学習します。これにより、新しいシステムにすべてを手動でコピー&ペーストすることなく、回答が正確でブランドの声に合ったものになります。

- **安全かつ完全にコントロールして展開:**生のAPI上に構築する場合、一つのミスが大きな問題を引き起こす可能性があります。eesel AIにはシミュレーションモードがあり、実際の顧客と話す前に、何千もの過去のチケットでAIをテストすることができます。それがどのように応答したかを正確に確認し、その影響を予測し、自信を持って展開することができます。

- **予測可能で透明性の高い価格設定:**Groqのような使用量ベースのモデルは、予期せぬ高額請求につながる可能性があります。eesel AIには、月々のAIインタラクション数に基づいた透明性の高い料金プランがあります。コストは予測可能で、より多くのチケットを解決しても追加料金でペナルティを受けることはありません。

効率を高め、顧客を今すぐ幸せにする必要があるチームにとって、eesel AIのような完全なプラットフォームは、そこに到達するための最も迅速で信頼性の高い方法です。

Groqの価格設定に関する最終的な考察

見てください、Groqの技術は本当に素晴らしいものです。もしあなたが、ミリ秒単位の応答が重要なリアルタイムアプリを構築する、豊富なエンジニアリングリソースを持つチームなら、彼らのスピードに勝るものはありません。Groqの価格モデルは、その生のパフォーマンスに直接対価を支払うことを可能にします。

しかし、ほとんどのビジネス、特にカスタマーサービスやITの分野では、目標は単なるスピードではなく、問題を効率的に解決することです。APIの上にサポートシステム全体をゼロから構築するのは、巨大で高価なプロジェクトです。

開発の手間をかけずにAIのすべての力を手に入れたいソリューションを探しているなら、**eesel AI**をぜひご覧ください。これは、サポートを自動化し、エージェントを支援し、運用全体を初日からよりスムーズにするために設計された、フルマネージドのプラットフォームです。

よくある質問

GroqのLLM価格は、「pay-as-you-go」(従量課金制)のトークン・アズ・ア・サービスモデルに基づいています。入力(プロンプト)と出力(モデルの応答)の両方に対して100万トークンごとに課金され、価格は選択する特定のLLMによって異なります。

はい、Groqは大量使用向けのいくつかのソリューションを提供しています。バッチAPIは、緊急でない大規模なリクエストに対して50%の割引を提供し、プロンプトキャッシングは繰り返し発生するクエリのコストを削減できます。GroqRackやカスタマイズされたモデルのようなカスタム展開については、営業チームに連絡してエンタープライズ向けのGroq価格設定について相談することになります。

トークン数に加えて、選択する特定のAIモデルがGroqの価格に大きく影響します。一般的に、より大きく高性能なモデルはトークンあたりのコストが高くなります。さらに、リアルタイムの推論を使用するか、緊急でないタスクのために割引されたバッチAPIを使用するかによっても、総コストは変わってきます。

Groqの価格設定はテキストベースのLLMだけにとどまりません。テキスト読み上げ(PlayAI Dialog v1.0)は100万文字ごとに、自動音声認識(Whisper Large v3)は文字起こしされた音声の時間ごとに課金されるなど、他のAIサービスの価格も提供しています。

リアルタイムの応答速度がアプリケーションにとって絶対的に重要である場合、例えばライブ会話型AI、インタラクティブなコンテンツ生成、音声対応アプリケーションなどで、ビジネスはGroqの価格設定を検討すべきです。低遅延が主要な要件である大規模なプロジェクトに最適です。

主な制限事項は、Groqが推論専用であり、モデルのトレーニングには使用できないことです。Groqの価格設定の利点は大規模なスケールで最も顕著になり、また、それは「エンジンであって、車ではない」ため、その高速APIを中心に完全なアプリケーションを構築するには、 상당なエンジニアリングリソースが必要です。

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.