Soyons honnêtes : trouver des informations au travail peut être un véritable casse-tête. Les connaissances les plus importantes de votre entreprise sont probablement éparpillées dans une douzaine d'applications différentes. Vous avez des plans de projet dans Google Docs, des spécifications de produits dans Confluence, des conversations avec les clients dans Zendesk et des décisions rapides enfouies dans de vieux fils de discussion Slack. Ce chaos numérique rend l'obtention d'une réponse claire un processus lent et frustrant pour votre équipe et vos clients.

Et si vous pouviez rassembler toutes ces informations éparses en un seul endroit et obtenir des réponses instantanées et précises ? C'est exactement ce que fait un assistant de recherche de connaissances. C'est un outil alimenté par l'IA qui agit comme un cerveau central pour votre entreprise, connectant toutes vos connaissances pour fournir la bonne information, au bon moment.

Dans ce guide, nous allons décortiquer cette technologie et son fonctionnement. Nous examinerons également les défis liés à la création d'un tel outil par vos propres moyens. Plus important encore, nous vous montrerons comment une plateforme conçue à cet effet peut résoudre ces problèmes et vous rendre opérationnel en quelques minutes.

Qu'est-ce qu'un assistant de recherche de connaissances ?

Fondamentalement, un assistant de recherche de connaissances est un outil d'IA qui se connecte à toutes les sources de connaissances internes de votre entreprise pour répondre aux questions. Au lieu de donner des réponses génériques basées sur l'internet public, il apprend à partir de vos articles de centre d'aide, de vos wikis internes, de vos anciens tickets de support et même de vos documents Google Docs privés.

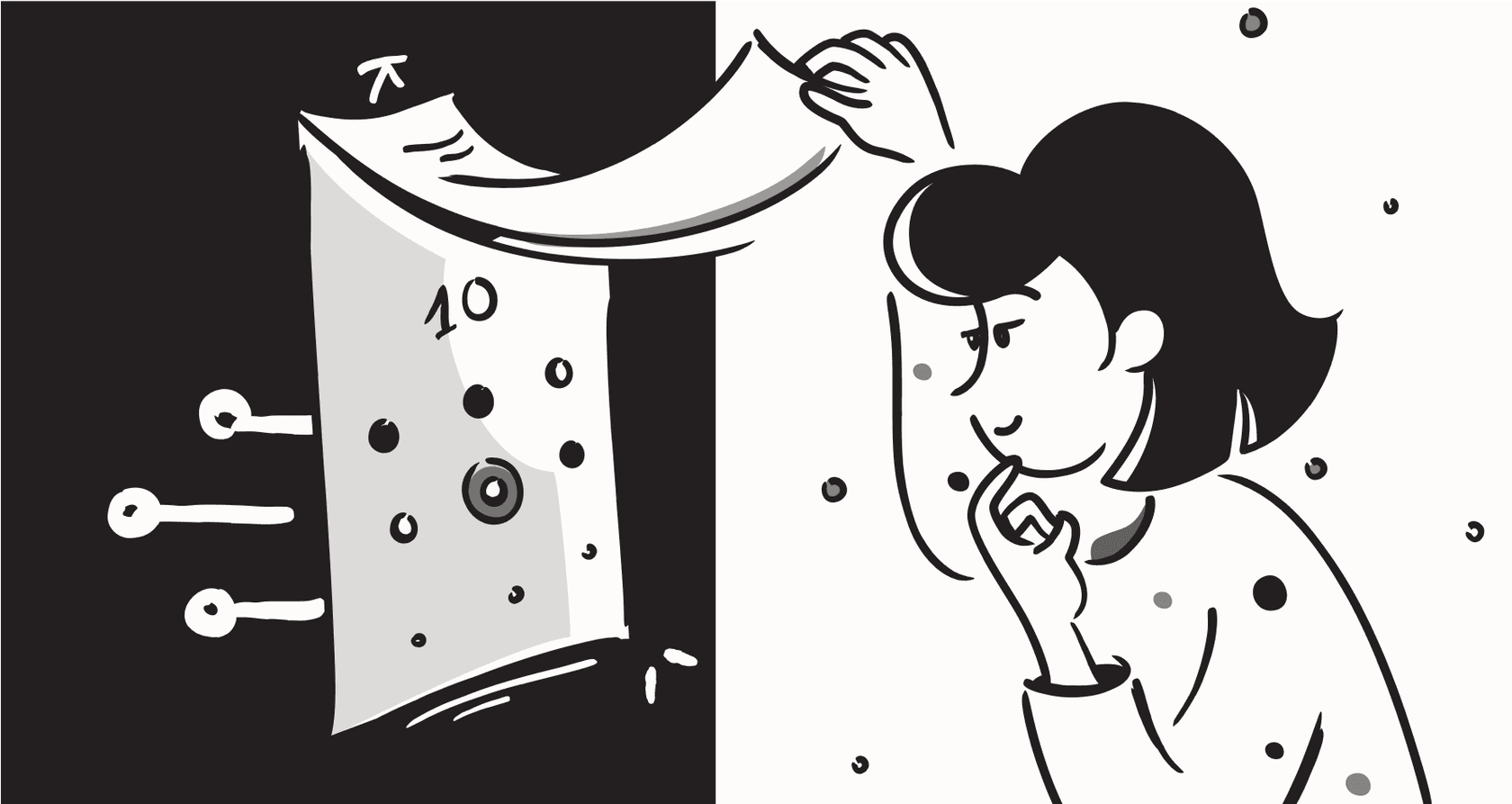

La technologie qui sous-tend ce système s'appelle la Génération Augmentée par la Récupération, ou RAG. La meilleure façon de se représenter le RAG est de l'imaginer comme un examen à livre ouvert pour une IA. Au lieu de se fier uniquement à ce qu'elle a mémorisé lors de sa formation initiale, elle peut consulter la bonne réponse dans les "manuels" de votre entreprise (vos documents et données) avant de fournir une réponse.

Et c'est un avantage considérable, pour plusieurs raisons clés :

-

Cela empêche l'IA d'inventer des choses. Nous avons tous été témoins des "hallucinations" de l'IA. En basant chaque réponse sur les données réelles de votre entreprise, les réponses restent factuelles.

-

L'information est toujours à jour. Les modèles d'IA généraux ont une date limite de connaissances et ne savent rien de vos dernières mises à jour. Un système RAG, en revanche, peut accéder aux informations les plus récentes.

-

Cela renforce la confiance. L'assistant peut citer ses sources, de sorte que les utilisateurs peuvent voir exactement d'où vient l'information et la vérifier par eux-mêmes.

Le parcours du développeur : Créer un assistant de recherche de connaissances avec une API

Alors, vous songez à en créer un vous-même ? Une façon de procéder est d'utiliser un outil comme l'API Assistants d'OpenAI. C'est la voie la plus technique, et il est important de comprendre ce qu'elle implique pour voir pourquoi elle n'est pas pour tout le monde. Un rapide coup d'œil aux forums de développeurs et aux documentations officielles montre que ce n'est pas exactement une configuration simple et prête à l'emploi.

Le processus de configuration

Même d'un point de vue global, le processus est assez complexe et nécessite du temps de développement dédié. On ne se contente pas de "l'activer" ; il faut construire et maintenir un système entier à partir de zéro.

graph TD A[Étape 1 : Configurer l'assistant via l'API] --> B(Définir les instructions, le modèle, les outils); A --> C{Écrire du code}; C --> B; B --> D[Étape 2 : Créer des bases de données vectorielles]; D --> E[Étape 3 : Uploader et indexer manuellement les fichiers]; E --> F[Écrire des scripts d'upload]; E --> G[Attendre le traitement]; F --> G; G --> H[Étape 4 : Gérer les threads et les exécutions]; H --> I[Créer un thread]; I --> J[Ajouter un message]; J --> K[Exécuter la tâche]; K --> L[Obtenir la réponse]; subgraph Processus DIY direction LR A; B; C; D; E; F; G; H; I; J; K; L; end

-

Étape 1 : Configurer l'assistant et les outils. D'abord, vous devez écrire du code pour créer un objet "Assistant" via l'API. Cela signifie définir ses instructions, choisir un modèle et activer des outils comme "file_search" pour qu'il puisse réellement parcourir vos documents.

-

Étape 2 : Créer et gérer les bases de données vectorielles. Vos connaissances ne sont pas simplement jetées dans un grand tas. Vous devez mettre en place des conteneurs séparés appelés "bases de données vectorielles" pour stocker et organiser les données que l'assistant devra parcourir.

-

Étape 3 : Uploader et indexer les fichiers. C'est un travail entièrement manuel. Vous devez écrire des scripts pour uploader vos fichiers, comme les PDF et les DOCX, un par un dans la base de données vectorielle. Ensuite, vous devez attendre qu'OpenAI les traite, les segmente (les divise en plus petits morceaux) et les indexe avant même qu'ils ne soient consultables.

-

Étape 4 : Gérer les threads et les exécutions. Chaque conversation est un processus de codage en plusieurs étapes. Vous devez créer un "thread" pour la conversation, ajouter le message de l'utilisateur, puis exécuter une "tâche" (run) pour obtenir une réponse. Tout cela doit être géré avec votre propre code.

Les défis cachés et les limites d'une approche DIY

La configuration n'est que le début. Les vrais maux de tête apparaissent lors de la maintenance continue et en raison des limitations inhérentes à une approche DIY.

-

C'est un casse-tête de maintenance constant. Ce n'est pas un outil que vous pouvez construire puis confier à un responsable du support. Il nécessite une surveillance constante de la part des développeurs pour gérer les clés d'API, surveiller son fonctionnement, mettre à jour les connaissances et corriger les bugs. Vous n'utilisez pas seulement un outil ; vous construisez et maintenez un projet logiciel.

-

Votre base de connaissances devient rapidement obsolète.

Si vous mettez à jour une politique dans un PDF ou une page Confluence, l'IA ne le saura pas. Vous devez ré-uploader et ré-indexer manuellement le fichier à chaque fois que quelque chose change. Il n'y a pas de synchronisation automatique pour garder les choses à jour.C'est un énorme point de frustration que nous voyons les gens aborder en ligne.

-

Un énorme angle mort en matière de sécurité. Un assistant de base construit avec une API ne peut pas comprendre qui doit voir quoi. Il n'a aucun moyen de savoir que quelqu'un du marketing ne devrait pas voir les documents financiers sensibles s'ils sont tous dans la même base de données vectorielle. Tout le monde a accès à tout, ce qui ne convient tout simplement pas à la plupart des entreprises.

-

Il n'est pas facilement scalable. Bien que l'API soit puissante, elle a ses limites. Par exemple, une seule base de données vectorielle ne peut contenir que 10 000 fichiers au maximum. Pour les grandes entreprises avec des centaines de milliers de documents, cela peut rapidement devenir un problème.

Ce qu'il faut rechercher dans une plateforme dédiée d'assistant de recherche de connaissances

Après avoir vu tout cela, vous vous dites peut-être qu'il doit y avoir une meilleure solution. Et c'est le cas. Pour la plupart des entreprises, une plateforme dédiée d'assistant de recherche de connaissances est une bien meilleure solution car elle s'occupe de tout le travail technique lourd à votre place. Elle est également dotée de fonctionnalités essentielles qui sont difficiles, voire impossibles, à développer à partir de zéro.

Voici ce que vous devriez rechercher.

Des intégrations qui maintiennent vos connaissances synchronisées

Une plateforme de premier ordre ne devrait pas vous obliger à uploader manuellement des fichiers. Elle devrait offrir des intégrations simples, en un clic, avec les outils que votre équipe utilise déjà tous les jours, comme Confluence, Google Docs, Slack, et votre centre d'aide, que ce soit Zendesk ou Freshdesk.

Pourquoi c'est important : Cela résout complètement le problème des "connaissances obsolètes". Lorsqu'un document est mis à jour à son emplacement d'origine, les connaissances sont automatiquement synchronisées. Votre assistant dispose toujours des informations les plus récentes sans que personne n'ait à lever le petit doigt.

Contrôle précis et personnalisation

Vous devez être aux commandes. Une bonne plateforme vous donne un contrôle total sur ce que votre assistant peut et ne peut pas faire. Cela inclut des choses comme :

-

Connaissances ciblées : Vous devriez pouvoir facilement dire à l'IA de n'utiliser que des documents ou des sources de données spécifiques pour différentes situations. Par exemple, un chatbot destiné aux clients ne devrait extraire des réponses que de votre centre d'aide public, et non de votre wiki d'ingénierie interne.

-

Actions personnalisées : Un assistant devrait faire plus que simplement fournir des réponses. Il devrait pouvoir entreprendre des actions, comme rechercher des informations de commande dans Shopify, créer un ticket dans Jira, ou transférer une conversation à un agent humain lorsqu'il est bloqué.

-

Personnalité de l'IA : Vous devriez pouvoir définir le ton de voix et la personnalité de l'IA. Cela garantit qu'il donne l'impression de faire partie de votre marque, et pas seulement d'être un bot générique.

Pourquoi c'est important : Ce niveau de contrôle empêche l'IA de dévier du sujet, garantit que ses réponses sont toujours pertinentes, et le transforme d'un simple bot de Q&R en un membre de l'équipe réellement utile.

Tests sans risque et déploiement progressif

Le déploiement d'un assistant IA ne devrait pas donner l'impression de croiser les doigts en espérant que tout se passe bien. Une excellente plateforme vous permettra de tester l'assistant sur des milliers de vos conversations passées en mode simulation. Vous pouvez voir exactement comment il aurait répondu sans aucun risque.

Vous devriez également pouvoir le déployer progressivement. Peut-être commencer par le laisser traiter un seul type de question, ou le déployer dans un seul canal Slack avant de le lancer à l'échelle de l'entreprise.

Pourquoi c'est important : Cela vous permet de renforcer votre confiance dans le système, d'avoir une idée précise du retour sur investissement potentiel, et de régler les éventuels problèmes avant que l'assistant n'interagisse avec un client ou un employé en direct.

eesel AI : L'assistant de recherche de connaissances en libre-service

C'est là que nous intervenons. Nous avons créé eesel AI pour résoudre précisément ces problèmes, en le concevant dès le départ pour être à la fois incroyablement puissant et d'une simplicité rafraîchissante.

-

Soyez opérationnel en quelques minutes, pas en quelques mois. Nous avons créé une expérience véritablement en libre-service. Vous pouvez vous inscrire, connecter votre centre d'aide et vos sources de connaissances en un seul clic, et avoir un assistant de recherche de connaissances fonctionnel en quelques minutes seulement. Pas de démos obligatoires, pas d'appels commerciaux et aucun code requis.

-

Unifiez vos connaissances instantanément. eesel AI va au-delà des simples documents. Il se connecte à plus de 100 sources et apprend du meilleur travail de votre équipe en analysant vos anciens tickets de support dès le premier jour. Il construit automatiquement une base de connaissances unifiée et intelligente qui comprend vraiment votre entreprise.

-

Testez en toute confiance. Avant de l'activer, vous pouvez utiliser le mode de simulation d'eesel AI pour faire tourner l'IA sur des milliers de vos anciens tickets. Vous verrez exactement comment il aurait performé, vous donnant une prévision claire des taux d'automatisation et des économies de coûts.

-

Vous gardez le contrôle total. Notre moteur de workflow intuitif vous donne un contrôle précis sur chaque partie de l'assistant. Depuis un simple tableau de bord, vous pouvez décider exactement quels tickets automatiser, lesquels transférer à un agent, et quelles actions personnalisées l'IA peut effectuer.

Comparaison des tarifs : DIY vs. une plateforme dédiée

Ok, parlons argent. Lorsque vous décidez de la voie à suivre, le coût est évidemment un facteur énorme. Mais il ne s'agit pas seulement du prix affiché ; il s'agit d'avoir des coûts prévisibles et de comprendre l'investissement total.

L'API Assistants d'OpenAI est facturée en fonction de l'utilisation, ce qui peut rapidement devenir compliqué et imprévisible. Vous payez pour le stockage de fichiers (0,10 $/Go/jour après le premier gigaoctet gratuit), et vous payez également des jetons (tokens) pour chaque question et chaque réponse. Ce modèle ne commence même pas à couvrir le plus grand coût caché : le salaire continu des développeurs dont vous avez besoin pour construire et maintenir le système.

Avec eesel AI, la tarification est transparente. Vous payez un forfait mensuel fixe basé sur le nombre d'interactions IA dont vous avez besoin. Il n'y a pas de frais surprises par résolution, donc vos coûts ne grimperont pas en flèche à mesure que votre automatisation gagnera en efficacité.

| Caractéristique | API OpenAI (Approche DIY) | Plateforme eesel AI |

|---|---|---|

| Coût principal | Basé sur l'utilisation (tokens + stockage) | Forfait mensuel fixe (prévisible) |

| Coûts cachés | Salaires des développeurs, maintenance, infrastructure | Aucun. Forfaits tout compris. |

| Modèle de tarification | Complexe et imprévisible | Transparent et facile à prévoir |

| Valeur | Vous payez pour des composants bruts | Vous payez pour une solution complète et gérée |

Arrêtez de chercher, commencez à répondre avec un assistant de recherche de connaissances

Un assistant de recherche de connaissances n'est plus un luxe ; c'est un incontournable pour toute entreprise fatiguée de la surcharge d'informations. Mais en créer un à partir de zéro est un projet complexe, coûteux et risqué, plein de limitations cachées.

Une plateforme dédiée et en libre-service comme eesel AI élimine toute cette complexité. Elle vous offre un assistant puissant, sécurisé et entièrement contrôlable qui unifie les connaissances de votre entreprise et devient opérationnel en quelques minutes, pas en quelques mois.

Prêt à en finir avec les recherches interminables et à commencer à obtenir des réponses ? Commencez votre essai gratuit d'eesel AI dès aujourd'hui et découvrez par vous-même comment cela fonctionne.

Foire aux questions

Un assistant de recherche de connaissances est un outil alimenté par l'IA qui centralise les informations dispersées de votre entreprise. Il se connecte à diverses sources de connaissances internes, permettant à votre équipe et à vos clients d'obtenir des réponses instantanées et précises à partir d'un point d'accès unique.

Les principaux avantages incluent le fait d'empêcher l'IA d'inventer des informations en basant les réponses sur les données de l'entreprise, de toujours fournir des informations à jour en accédant aux dernières mises à jour, et de renforcer la confiance des utilisateurs en citant les sources de ses réponses.

En créer un soi-même est complexe, nécessitant un temps de développement important pour la configuration et une maintenance constante. Les principaux défis incluent l'upload manuel des fichiers, l'obsolescence rapide des connaissances sans synchronisation automatique, et un manque de sécurité intégrée pour le contrôle d'accès.

Recherchez des plateformes offrant des intégrations en un clic avec vos outils existants pour une synchronisation automatique des connaissances, un contrôle précis sur le comportement de l'IA et les connaissances ciblées, et des capacités de test robustes comme les modes de simulation pour un déploiement sans risque.

Une plateforme robuste d'assistant de recherche de connaissances permet d'utiliser des connaissances ciblées, ce qui signifie que vous pouvez définir quels documents ou sources de données spécifiques l'IA peut utiliser pour différents utilisateurs ou situations. Cela empêche l'accès non autorisé aux informations internes sensibles.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.

Il utilise la Génération Augmentée par la Récupération (RAG), qui permet à l'IA de "consulter" des informations dans les documents et les données de votre entreprise en temps réel. Cela garantit que les réponses sont basées sur vos connaissances réelles, prévenant les "hallucinations" de l'IA et assurant que les informations sont à jour.