Guide GLM 5.1 : Le nouveau roi de l'ingénierie IA à long terme

Stevia Putri

Dernière modification April 21, 2026

{ "title": "Guide GLM 5.1 : Le nouveau roi de l'ingénierie IA à long terme", "keyword": "GLM 5.1", "slug": "glm-5-1", "description": "Découvrez GLM 5.1, le modèle d'IA phare qui établit des benchmarks SOTA en matière de codage et de tâches à long terme. Apprenez comment il surpasse Claude et GPT-5 en 2026.", "excerpt": "GLM 5.1 redéfinit l'ingénierie agentique. Des performances de codage SOTA aux tâches autonomes de 8 heures, découvrez pourquoi ce modèle est la nouvelle référence pour les collaborateurs IA.", "categories": ["Blog Writer AI"], "tags": ["GLM 5.1", "Ingénierie agentique", "Benchmarks IA", "IA de codage", "Z.ai"], "coverImage": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerUrl": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerAlt": "Un logo futuriste GLM 5.1 avec une interface de codage complexe en arrière-plan.", "faqs": [ { "question": "Qu'est-ce que GLM 5.1 ?", "answer": "GLM 5.1 est un modèle d'IA phare de nouvelle génération conçu par Z.ai, spécifiquement pour les tâches d'ingénierie agentique à long terme." }, { "question": "Comment GLM 5.1 se comporte-t-il sur les benchmarks de codage ?", "answer": "GLM 5.1 a atteint un score SOTA de 58,4 sur SWE-Bench Pro, surpassant GPT-5.4 et Claude Opus 4.6." }, { "question": "Puis-je exécuter GLM 5.1 localement ?", "answer": "Oui, les poids du modèle GLM 5.1 sont open-source et compatibles avec des frameworks locaux comme Ollama, vLLM et SGLang." } ] }

Le monde de l'IA évolue rapidement. Nous sommes passés du « codage à l'instinct », où vous demandez un extrait à une IA en espérant qu'il fonctionne, à « l'ingénierie agentique », où les modèles d'IA prennent en charge des projets complexes et multi-étapes de manière indépendante. Mais même dans cette nouvelle ère, la plupart des modèles se heurtent à un mur. Ils commencent fort, mais à mesure que la tâche devient plus complexe et que les appels d'outils s'accumulent, ils plafonnent. Ils épuisent leurs options, répètent leurs erreurs et finissent par abandonner.

Voici GLM-5.1. Sorti début 2026, ce modèle phare de nouvelle génération de Z.ai n'est pas juste une mise à jour incrémentale. C'est un modèle conçu spécifiquement pour le « long terme », pour les tâches qui nécessitent des centaines de cycles d'itération et des milliers d'appels d'outils pour atteindre un résultat optimal.

Que vous construisiez un agent de support client IA entièrement autonome ou que vous optimisiez des noyaux GPU haute performance, GLM 5.1 établit une nouvelle norme pour ce que signifie être un collaborateur IA « productif ».

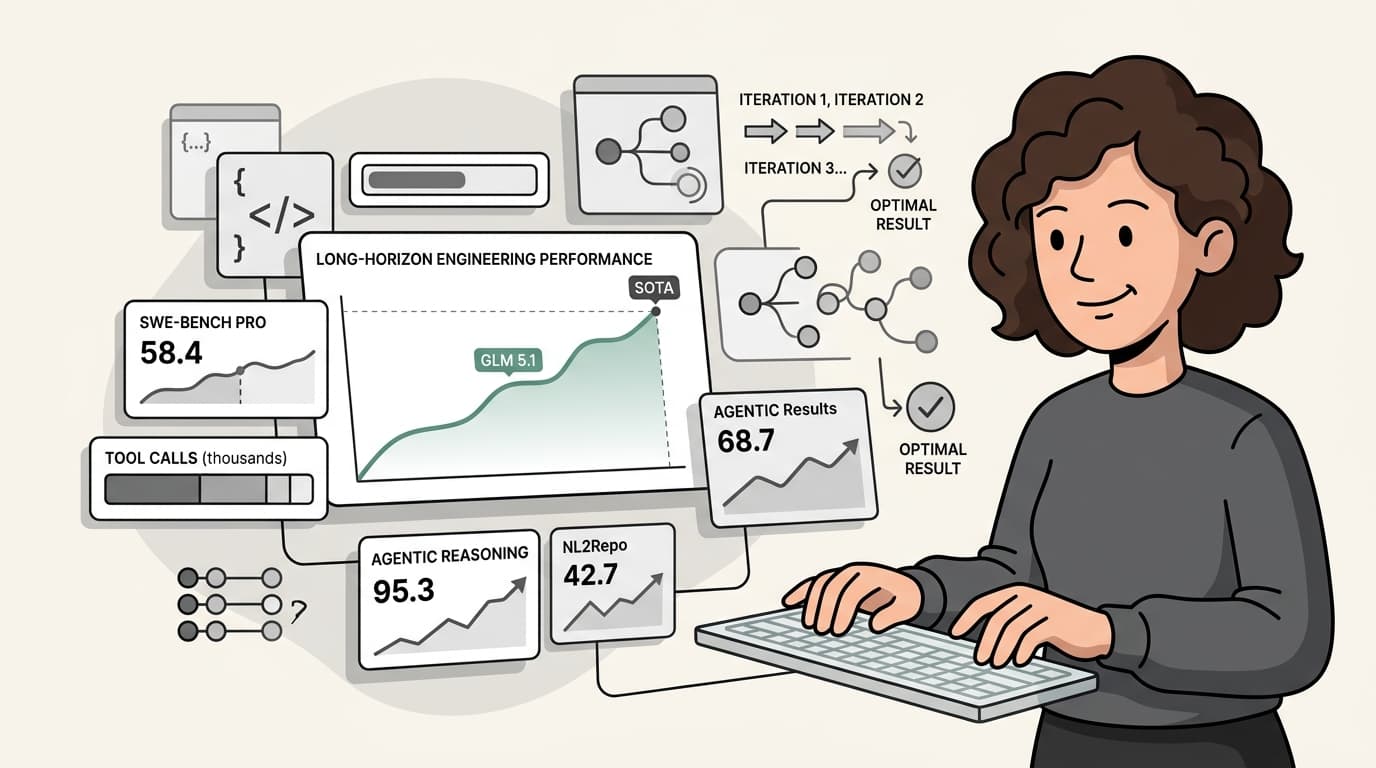

Analyse des benchmarks : SOTA en ingénierie

Si vous voulez savoir comment un modèle d'ingénierie fonctionne réellement, vous devez regarder les benchmarks qui simulent un travail réel. GLM 5.1 ne se contente pas de participer à ces benchmarks ; il les domine.

Sur SWE-Bench Pro, un benchmark conçu pour tester les modèles sur des tâches d'ingénierie logicielle complexes et réelles, GLM 5.1 a atteint un score de pointe (SOTA) de 58,4. Pour mettre cela en perspective, il a surpassé des poids lourds comme GPT-5.4 (57,7) et Claude Opus 4.6 (57,3).

Mais il ne s'agit pas seulement de codage. GLM 5.1 affiche des gains significatifs sur tous les plans :

- Terminal-Bench 2.0 : Il a obtenu un score de 63,5 sur le framework Terminus-2, grimpant à 69,0 lorsqu'il est intégré au harnais Claude Code. Cela démontre son incroyable maîtrise de la navigation dans les environnements de terminal réels.

- Raisonnement : Il a atteint 95,3 sur AIME 2026 et 52,3 sur le Humanity’s Last Exam (HLE) avec des outils, prouvant que son raisonnement de haut niveau n'est pas sacrifié au profit de ses compétences techniques.

- Génération de dépôts : Sur NL2Repo, il a obtenu 42,7, montrant qu'il peut gérer des dépôts entiers, et pas seulement des fichiers isolés.

Le modèle « Escalier » : Comment GLM 5.1 résout les problèmes difficiles

La plupart des LLM suivent un chemin prévisible : ils résolvent rapidement les parties faciles d'un problème, puis leurs performances stagnent. Leur donner plus de temps ou plus d'appels d'outils ne sert à rien car ils ont déjà « épuisé leur répertoire ».

GLM 5.1 brise cette tendance avec ce que Z.ai appelle le modèle d'optimisation « Escalier ». Au lieu de plafonner, le modèle identifie continuellement les goulots d'étranglement et met en œuvre des changements structurels pour les surmonter.

Prenons l'exemple du défi VectorDBBench. L'objectif était de construire une base de données vectorielle haute performance. Alors que la plupart des modèles pourraient atteindre 3 500 QPS et s'arrêter, GLM 5.1 a été autorisé à fonctionner pendant 600 itérations et plus de 6 000 appels d'outils.

Le résultat ? Il a finalement atteint 21,5k QPS, soit environ 6 fois le meilleur score précédent. Au cours de l'exécution, le modèle n'a pas seulement ajusté les paramètres ; il a modifié ses stratégies de manière autonome. Il est passé d'une analyse complète du corpus à un sondage par grappes IVF, puis a introduit un pipeline à deux étapes avec pré-score u8. Chaque « marche » de l'escalier était un moment où le modèle analysait ses propres journaux, identifiait un blocage et concevait une correction structurelle.

Scénarios d'ingénierie agentique dans le monde réel

La puissance de l'IA à long terme n'est pas théorique ; elle est testée dans des scénarios incroyablement ambitieux.

1. Optimisation des noyaux GPU (KernelBench)

Sur KernelBench, les modèles sont chargés de prendre une implémentation PyTorch de référence et de produire un noyau GPU plus rapide. GLM 5.1 a atteint une accélération de 3,6x sur les problèmes de niveau 3 (qui couvrent des architectures de modèles complets comme MobileNet et Mamba). Il a maintenu cette optimisation bien au-delà de la limite de 1 200 tours d'utilisation d'outils, continuant à trouver des gains là où ses prédécesseurs comme GLM-5 plafonnaient.

2. Construction d'un bureau Linux en 8 heures

La démonstration la plus impressionnante a peut-être été une tâche ouverte : construire un environnement de bureau de type Linux en tant qu'application web à partir de zéro. La plupart des modèles produisent une barre des tâches basique puis s'arrêtent. GLM 5.1, cependant, a fonctionné pendant 8 heures en continu. Il a construit le navigateur de fichiers, le terminal, l'éditeur de texte et même des jeux, tout en s'assurant que l'interface utilisateur restait visuellement cohérente et que les interactions étaient fluides.

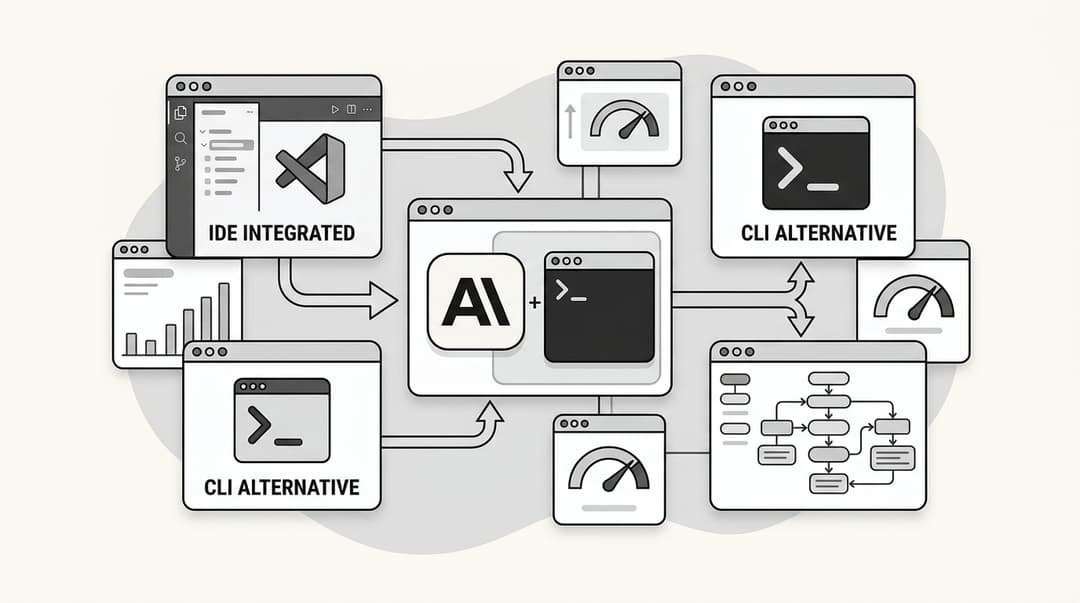

Pour commencer : Comment utiliser GLM 5.1 dès aujourd'hui

Que vous souhaitiez utiliser GLM 5.1 pour vos propres projets ou le voir en action via un collaborateur IA, il existe plusieurs façons de commencer.

Accès API

Vous pouvez accéder à GLM 5.1 via l'API officielle Z.ai ou via des fournisseurs comme OpenRouter. Sur OpenRouter, la tarification est très compétitive à 0,698 $ par million de jetons d'entrée et 4,40 $ par million de jetons de sortie, avec une fenêtre de contexte massive de 202 752 jetons.

Déploiement local

Pour ceux qui préfèrent garder leurs données en local, les poids du modèle sont disponibles publiquement sur HuggingFace sous la licence MIT et la licence NVIDIA Open Model. Il est compatible avec les principaux frameworks de service locaux, notamment :

- vLLM (v0.19.0+)

- SGLang (v0.5.10+)

- Ollama

Intégration avec eesel AI

Chez eesel AI, nous pensons que l'avenir du travail réside dans les collaborateurs IA qui effectuent le gros du travail. La capacité de GLM 5.1 à gérer des tâches à long terme en fait le moteur idéal pour les générateurs de contenu IA et les agents de support qui ne se contentent pas de répondre aux questions, mais résolvent des problèmes complexes au fil du temps.

Conclusion : L'avenir des collaborateurs autonomes

GLM 5.1 représente un changement fondamental dans les capacités de l'IA. Il ne s'agit plus seulement de la première réponse ; il s'agit de la ténacité à continuer jusqu'à ce que le travail soit bien fait. En maîtrisant les tâches à long terme, GLM 5.1 nous rapproche d'un monde où l'IA n'est pas seulement un outil, mais un collaborateur véritablement autonome.

Alors que nous avançons en 2026, l'écart entre les modèles « assez bons » et ceux capables de maintenir une optimisation sur des milliers d'étapes ne fera que se creuser. Si vous construisez pour l'avenir de l'ingénierie, GLM 5.1 est la frontière.

Questions fréquemment posées

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.