GLM 5.1 : La fin du plateau de l'IA ? | eesel AI

Stevia Putri

Dernière modification April 21, 2026

Si vous avez passé du temps à travailler avec des assistants de codage IA récemment, vous avez probablement atteint le « plateau ». Vous commencez une session, le modèle vous donne quelques premières lignes brillantes, et puis... il abandonne tout simplement. Il commence à répéter le même code bogué, ignore vos retours ou perd complètement le fil après quelques cycles de débogage.

C'est frustrant car nous savons que l'intelligence est là, mais l'endurance manque.

Voici GLM 5.1.

Publié par Z.AI (Zhipu AI) en avril 2026, GLM 5.1 n'est pas juste une autre mise à jour incrémentale du classement des LLM. C'est un modèle spécifiquement conçu pour s'attaquer à ce que les chercheurs appellent les tâches à « long horizon » (le genre de projets d'ingénierie complexes en plusieurs étapes qui font généralement planter l'IA).

Que vous soyez un responsable technique à la recherche d'agents autonomes plus fiables ou un ingénieur fatigué de surveiller votre IA, GLM 5.1 représente un changement massif dans notre façon de concevoir « l'ingénierie agentique ».

Le problème du « plateau » : Pourquoi les autres modèles échouent sur les tâches longues

La plupart des LLM (même les poids lourds comme GPT-5.4 et Claude 4.6) sont optimisés pour des performances « one-shot » ou de courte durée. Ils sont conçus pour vous donner la bonne réponse immédiatement. Et pour la plupart des choses, c'est très bien.

Mais l'ingénierie n'est pas un jeu en une seule étape. C'est un processus itératif d'expérimentation, d'échec et de raffinement. Lorsque vous demandez à un modèle traditionnel de résoudre un bogue complexe au niveau d'un dépôt, il épuise souvent son répertoire rapidement. Il applique les correctifs les plus évidents en premier, et si cela ne fonctionne pas, il atteint un plafond de performance. Lui donner plus de temps ou plus d'appels d'outils n'aide généralement pas ; il tourne simplement en rond.

Ce « plateau » se produit parce que la plupart des modèles manquent de jugement interne pour réaliser quand une stratégie ne fonctionne pas. Ils ne peuvent pas efficacement « revenir en arrière » ou repenser toute leur approche. Au lieu de cela, ils continuent de creuser le même trou, s'enfonçant de plus en plus dans une impasse logique.

Percée : Comment GLM 5.1 gère les tâches à long horizon

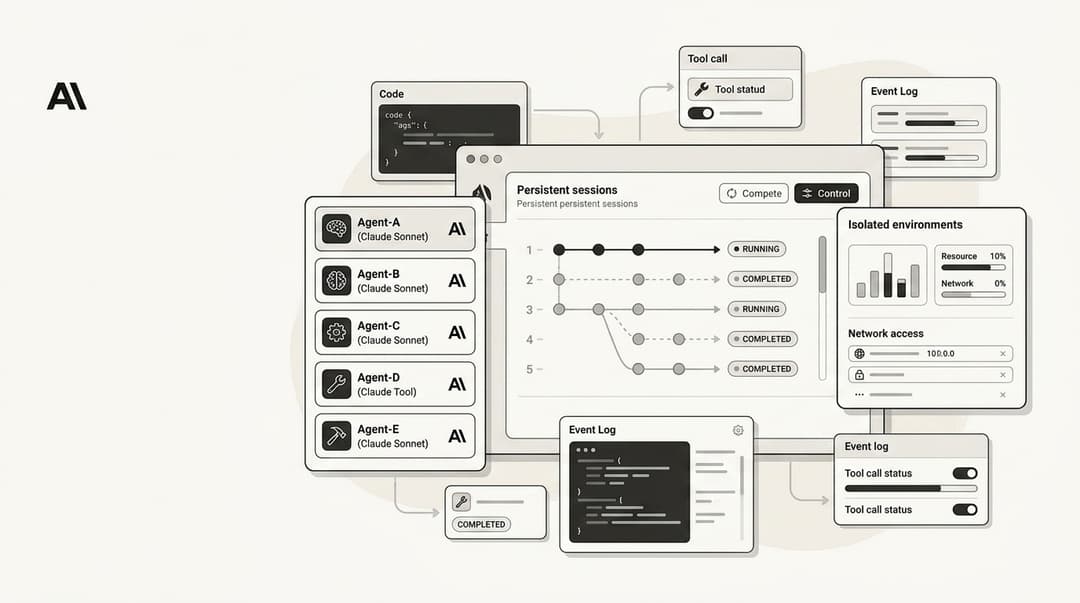

GLM 5.1 a été construit avec une philosophie différente : plus il fonctionne longtemps, meilleur devrait être le résultat.

Ce n'est pas juste du marketing. Z.AI a optimisé le modèle pour des sessions qui durent plus d'un millier d'appels d'outils. L'ingrédient secret est ce qu'ils appellent le « Raisonnement basé sur la réflexion ».

Au lieu de foncer tête baissée, GLM 5.1 utilise une boucle de réflexion interne pour évaluer ses étapes intermédiaires. Si une commande échoue ou si une suite de tests ne passe pas, le modèle a le jugement nécessaire pour dire : « Attends, toute cette stratégie est mauvaise », et revenir à un point de décision précédent.

Cette capacité de « long horizon » signifie que le modèle peut gérer des problèmes ambigus avec un bien meilleur jugement. Il reste productif sur des sessions de plusieurs heures, décomposant des problèmes complexes, menant des expériences et identifiant les blocages avec une réelle précision. C'est la différence entre un développeur junior qui a besoin d'une supervision constante et un développeur senior à qui l'on peut laisser le soin de résoudre un ticket du début à la fin.

Confrontation des benchmarks : En tête des classements

Les chiffres confirment l'engouement. Sur SWE-Bench Pro (la référence absolue pour évaluer comment les agents IA résolvent des problèmes GitHub réels), GLM 5.1 a atteint un taux de réussite stupéfiant de 58,4 %.

Pour le contexte, cela surpasse GPT-5.4 (57,7 %) et Claude Opus 4.6 (57,3 %). Bien que ces marges puissent sembler faibles, dans le monde des agents autonomes, chaque point de pourcentage représente des milliers d'heures humaines économisées en correction de bogues.

Mais il ne s'agit pas seulement d'un benchmark. GLM 5.1 est également en tête sur :

- Terminal-Bench 2.0 : Un benchmark pour les tâches de terminal réelles comme la configuration de l'environnement et l'analyse des journaux.

- NL2Repo : Un test pour générer des dépôts entiers et cohérents sur le plan architectural à partir de zéro.

Ces scores prouvent que GLM 5.1 est plus qu'un simple chatbot ; c'est une puissance pour les systèmes autonomes.

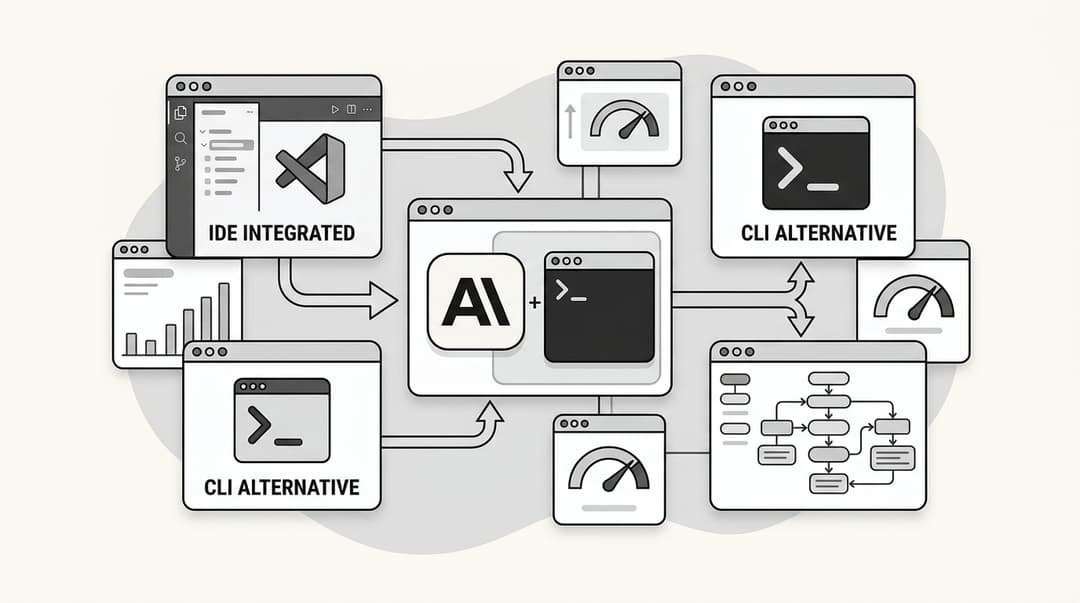

Guide pratique : Comment déployer et utiliser GLM 5.1 aujourd'hui

La bonne nouvelle est que vous n'avez pas besoin d'une ferme de serveurs massive pour commencer à jouer avec cela. GLM 5.1 est étonnamment accessible.

Accès API

Pour la plupart des cas d'utilisation en production, vous voudrez passer par l'API. En avril 2026, OpenRouter et NVIDIA Build sont les principaux fournisseurs.

- Tarification OpenRouter : Environ 2,00 $ par 1 million de jetons d'entrée et 6,00 $ par 1 million de jetons de sortie.

- NVIDIA Build : Offre des tarifs légèrement plus compétitifs et des crédits gratuits pour que les développeurs puissent tester le modèle.

Déploiement local

Si vous êtes soucieux de la confidentialité ou si vous aimez simplement faire tourner les choses sur votre propre matériel, Ollama a déjà ajouté la prise en charge de GLM 5.1. Vous pouvez l'exécuter localement aux formats GGUF ou FP16, bien qu'il soit préférable d'avoir une configuration GPU décente pour tirer le meilleur parti de la version phare.

Conseil de pro pour le prompting

Parce que GLM 5.1 est conçu pour l'itération, n'ayez pas peur de lui donner des tâches complexes et ouvertes. Au lieu de diviser les choses en minuscules étapes pour le modèle, donnez-lui l'objectif et les outils, et laissez sa boucle de réflexion interne faire le gros du travail.

La perspective d'eesel AI : Les LLM pour le support autonome

Chez eesel AI, nous cherchons constamment des moyens de rendre nos agents de support autonomes encore plus fiables. Pour nous, la percée du « long horizon » change la donne.

Les tickets de support client nécessitent souvent un débogage en plusieurs étapes (vérifier le compte d'un client, consulter les fichiers journaux, vérifier une intégration technique, puis formuler une solution). Si un agent IA « plafonne » à mi-chemin de ce processus, le client vit une mauvaise expérience.

La capacité de GLM 5.1 à persister à travers des centaines d'appels d'outils et à s'autocorriger lorsqu'il se heurte à un mur est exactement ce qui est nécessaire pour un support véritablement autonome. Cela nous permet d'exécuter des « modes de simulation » plus fiables où nous testons l'IA sur des milliers de tickets passés pour nous assurer qu'elle ne se retrouve jamais dans une impasse de raisonnement.

Découvrez comment eesel AI construit des agents autonomes

Conclusion

La sortie de GLM 5.1 marque la fin de l'ère du « plateau de l'IA ». Nous nous éloignons des modèles qui répondent simplement aux questions pour aller vers des coéquipiers agentiques capables de résoudre des problèmes.

La capacité à continuer d'essayer, à revenir en arrière et à maintenir la productivité sur de longs horizons est ce qui définira la prochaine génération d'outils d'IA. Si vous ne l'avez pas encore essayé, GLM 5.1 est un excellent point de départ.

Questions fréquemment posées

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.