KI mischt die Softwareentwicklung definitiv auf. Die Idee ist, die langweiligen Dinge zu automatisieren, damit sich Entwickler auf die schwierigen Probleme konzentrieren können. OpenAI Codex ist ein großer Name in diesem Bereich und verspricht einen KI-Agenten, der Ihren Code verstehen, neue Funktionen schreiben und sogar Pull-Requests bearbeiten kann. Ihn mit GitHub zu verbinden, klingt wie ein Traum, oder? Ein KI-Assistent, der ein Ticket nimmt, einen Fehler behebt und um eine Überprüfung bittet.

Aber wie ist es wirklich, ihn zu benutzen? Dieser Leitfaden gibt Ihnen einen umfassenden Überblick über die Integrationen von OpenAI Codex mit GitHub. Wir gehen auf seine Funktionen, den Einrichtungsprozess, die Kosten und die häufigsten Probleme ein, mit denen Teams konfrontiert sind. Am Ende werden Sie eine viel klarere Vorstellung davon haben, worauf Sie sich einlassen.

Was sind OpenAI Codex-Integrationen mit GitHub?

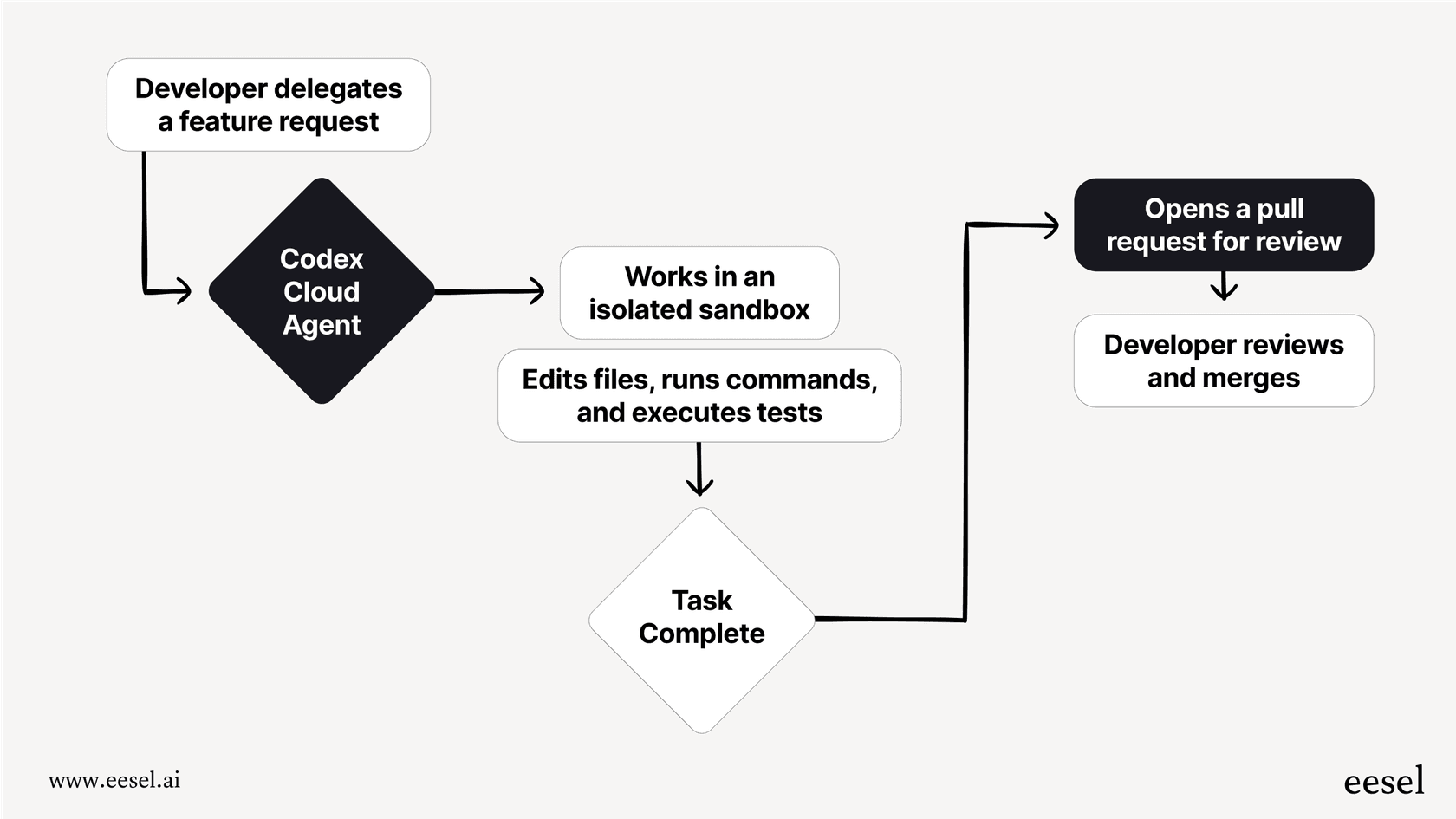

Stellen Sie sich OpenAI Codex als einen KI-Softwareentwickler vor, der in der Cloud arbeitet. Er basiert auf "codex-1", einer Version der OpenAI-Modelle, die speziell für das Programmieren trainiert wurde. Das ist nicht nur eine schicke Autovervollständigung. Codex erhält seine eigene kleine Sandbox-Umgebung, in die Ihr Code geladen wird, sodass er Dateien lesen, Tests ausführen und Funktionen von Grund auf erstellen kann.

Die Integration mit GitHub ist das, was alles zum Laufen bringt. Wenn Sie Ihr GitHub-Konto verbinden, geben Sie Codex die Erlaubnis, auf bestimmte Repositories zuzugreifen. Dann können Sie anfangen, Aufgaben zu übergeben, wie zum Beispiel:

-

Einen Fehler basierend auf einem von Ihnen geschriebenen Issue beheben.

-

Unordentlichen Code aufräumen, um ihn lesbarer zu machen.

-

Fragen zur Funktionsweise eines Teils Ihrer Codebasis beantworten.

-

Einen Pull-Request entwerfen und zur Überprüfung durch einen Menschen einreichen.

Dadurch wird Codex von einem allgemeinen Programmierwerkzeug zu einem Agenten, der den Kontext Ihres Projekts tatsächlich versteht. Sie können ihm eine Aufgabe geben und ihn im Hintergrund laufen lassen, fast wie ein neuer, sehr leiser Teamkollege.

Wie OpenAI Codex-Integrationen mit GitHub funktionieren

Um Codex zum Laufen zu bringen, müssen Sie ihn mit Ihrer Entwicklungsumgebung verbinden. Dies können Sie über eine Weboberfläche oder ein Befehlszeilentool tun, je nachdem, was Sie bevorzugen.

OpenAI Codex-Integrationen mit GitHub in ChatGPT einrichten

Die meisten Leute beginnen damit, Codex über die ChatGPT-Oberfläche zu verwenden. Wenn Sie zum Codex-Bereich gehen, werden Sie aufgefordert, Ihr GitHub-Konto zu verbinden.

-

Autorisierung: Sie werden zu GitHub weitergeleitet, um die "ChatGPT connector"-App zu genehmigen. Hier können Sie auswählen, auf welche Repositories (öffentlich oder privat) Codex zugreifen darf.

-

Eine Aufgabe zuweisen: Sobald die Verbindung hergestellt ist, können Sie ihm in einfachem Englisch sagen, was er tun soll. Sie können ihm entweder Fragen stellen ("Ask") oder den "Code"-Modus verwenden, um ihn Code schreiben oder ändern zu lassen.

-

Bei der Arbeit zusehen: Für jede Aufgabe erstellt Codex einen isolierten Cloud-Container, klont Ihr Repository und macht sich an die Arbeit. Sie können seinen Fortschritt in Echtzeit sehen, während er durch Dateien navigiert, Befehle ausführt und Änderungen vornimmt.

-

Der Pull-Request: Wenn er fertig ist, committet Codex die Änderungen und kann einen Pull-Request in Ihrem GitHub-Repository zur Überprüfung durch Ihr Team öffnen.

Klingt einfach genug, aber viele Entwickler sind bei der Ersteinrichtung auf Probleme gestoßen. Einige sind in einer endlosen Authentifizierungsschleife stecken geblieben. Die übliche Lösung besteht darin, in die Einstellungen von ChatGPT zu gehen, die GitHub-App zu trennen und dann erneut zu versuchen, sie zu verbinden. Es ist etwas umständlich und zeigt, dass es noch einige Ecken und Kanten gibt.

Die Befehlszeilenschnittstelle (CLI) verwenden

Wenn Sie sich im Terminal wohler fühlen, bietet OpenAI ein Codex CLI. Es ist ein kleines Open-Source-Tool, das die gleiche Leistung auf Ihren lokalen Rechner bringt.

-

Authentifizierung: Sie melden sich einfach mit Ihrem ChatGPT-Konto an, und es kümmert sich um die Einrichtung des API-Schlüssels für Sie.

-

Lokaler Kontext: Das CLI arbeitet mit Ihren lokalen Dateien, sodass es nichts in eine separate Umgebung klonen muss. Es hat den Kontext sofort.

-

Git-Integration: Es arbeitet gut mit Ihrer bestehenden Git-Einrichtung zusammen. Sie können leicht Diffs sehen, Änderungen stagen und den von der KI generierten Code committen.

Obwohl das CLI sich eher wie ein traditionelles Entwicklerwerkzeug anfühlt, finden es einige etwas mühsam, es reibungslos mit VS Code oder anderen IDEs zum Laufen zu bringen.

AGENTS.md verwenden

Um Codex eine bessere Vorstellung davon zu geben, wie Ihr Projekt funktioniert, können Sie eine "AGENTS.md"-Datei zum Stammverzeichnis Ihres Repositorys hinzufügen. Es ist wie eine "README.md", aber für die KI. Sie können dort Anweisungen hinterlegen, wie zum Beispiel:

-

Befehle, die zur Einrichtung der Umgebung ausgeführt werden müssen.

-

Wie man Ihre Test-Suite startet.

-

Etwaige Styleguides oder Best Practices, denen es folgen sollte.

Das ist eine nette Idee, bedeutet aber, dass Sie eine spezielle Konfigurationsdatei erstellen und pflegen müssen, die nicht Teil Ihrer normalen CI-Skripte oder Dockerfiles ist. Es ist nur eine weitere Sache, die man im Auge behalten muss.

Wichtige Funktionen und Preise

Codex versucht, mehr als nur ein Programmier-Sidekick zu sein; es soll ein echter Software-Engineering-Agent sein. Seine Funktionen sind darauf ausgelegt, Aufgaben zu bewältigen, die mehrere Schritte und ein gewisses Hin und Her erfordern.

Was es kann

-

Aufgaben eigenständig ausführen: Sie können ihm ein übergeordnetes Ziel geben (wie "Behebe den Login-Bug") und es wird bis zu 30 Minuten lang selbstständig daran arbeiten.

-

Fragen zu Ihrem Code beantworten: Sie können ihm komplizierte Fragen zu Ihrer Architektur stellen, und es wird die Dateien durchsuchen, um eine Antwort zu finden, manchmal sogar Diagramme ausgeben.

-

Testen und Debuggen: Es kann Ihre Tests ausführen, sehen, was fehlschlägt, und versuchen, den Code zu reparieren, bis alles bestanden ist.

-

Refactoring und Dokumentation: Es ist ziemlich praktisch für Aufräumarbeiten wie das Aufteilen großer Dateien, das Verbessern der Dokumentation oder das Hinzufügen von Tests, um Ihre Codeabdeckung zu erhöhen.

Die Preisaufschlüsselung

Sie können OpenAI Codex nicht einfach einzeln kaufen. Es ist in den kostenpflichtigen ChatGPT-Abonnements enthalten, also müssen Sie mit einer monatlichen Gebühr pro Benutzer rechnen.

Hier sind die offiziellen Preise für die ChatGPT-Pläne, die Sie benötigen werden:

| Plan | Preis (Monatlich) | Wichtige Funktionen für den Codex-Zugang |

|---|---|---|

| Plus | 20 $/Monat | Eingeschränkter Zugriff auf Codex-Agentenfunktionen. |

| Pro | 60 $/Monat | Vollständiger Zugriff auf Codex, einschließlich unbegrenzter Nachrichten und erweiterter Agentenfunktionen. |

| Business | Individuell | Alles aus Pro, plus Konnektoren für Unternehmenswissen (GitHub, Slack usw.) und Admin-Steuerungen. |

| Enterprise | Individuell | Alles aus Business, plus Sicherheit auf Unternehmensebene, priorisierter Support und benutzerdefinierte Datenaufbewahrung. |

Häufige Herausforderungen und Einschränkungen

Obwohl ein KI-Entwickler erstaunlich klingt, bringt die heutige Nutzung von OpenAI Codex mit GitHub einige echte Frustrationen mit sich, auf die frühe Nutzer schnell hingewiesen haben.

1. Die „GitHub oder nichts“-Einschränkung

Das ist wahrscheinlich der größte Nachteil. Die Integration ist exklusiv für GitHub. Wenn Ihr Team Azure DevOps, Bitbucket oder GitLab verwendet, haben Sie Pech. Codex hat keine native Unterstützung für diese Plattformen, was einen großen Teil der Entwicklungsteams, insbesondere in größeren Unternehmen, ausschließt. Alle auf einen einzigen Anbieter zu zwingen, ist für Teams, die ihre Werkzeuge genau nach ihren Wünschen eingerichtet haben, schwer zu verkaufen.

Dies steht im krassen Gegensatz zu modernen KI-Agenten-Beispielen in anderen Geschäftsbereichen. Nehmen Sie zum Beispiel die KI im Kundensupport. Ein Tool wie eesel AI ist darauf ausgelegt, flexibel zu sein, da Unternehmenswissen überall verstreut ist. Es verbindet sich sofort mit Dutzenden von Apps, von Helpdesks wie Zendesk und Jira Service Management bis hin zu Wikis wie Confluence und Google Docs.

2. Unordentliche Pull-Requests und Branches

Die Art und Weise, wie Codex mit Branches und PRs umgeht, kann, wie ein Benutzer es ausdrückte, ein "Albtraum" sein. Hier sind einige der Hauptkritikpunkte:

-

Seltsame Branch-Namen: Codex erstellt oft Branches mit zufälligen Namen wie "d92ewq-codex/...". Das macht es wirklich mühsam herauszufinden, welcher Branch zu welcher Aufgabe gehört.

-

Unvorhersehbare Updates: Wenn Sie eine Folgeaufgabe stellen, ist es Glückssache, ob der bestehende Branch aktualisiert oder einfach ein neuer erstellt wird. Sie können mit einem verworrenen Durcheinander von Pull-Requests enden.

-

Vage PR-Beschreibungen: Die von ihm generierten Pull-Requests haben oft keine guten Beschreibungen oder Kontext, was bedeutet, dass Entwickler Zeit damit verschwenden müssen, nachzuforschen, um zu verstehen, was die KI tatsächlich geändert hat.

3. Die „faule“ Leistung

Eine weitere häufige Beschwerde ist, dass Codex "faul" sein kann. Sie können ihm eine komplexe Aufgabe geben, und er beginnt stark, nur um auf halbem Weg aufzuhören oder nur einen winzigen Teil der Arbeit zu erledigen. Er könnte spezifische Anweisungen ignorieren oder vergessen, Tests auszuführen, wie Sie es verlangt haben, was Sie zwingt, ständig nach dem Rechten zu sehen und ihm weitere Anweisungen zu geben, um die Arbeit zu erledigen. Es ist nicht ganz der "einstellen und vergessen"-Assistent, den Sie sich vielleicht erhoffen.

4. Umständliche Umgebungseinrichtung

Die Abhängigkeit von einer speziellen "AGENTS.md"-Datei für die Einrichtung ist ein weiterer wunder Punkt. Die meisten Teams haben bereits viel Aufwand in die Definition ihrer Umgebungen mit Standardwerkzeugen wie Dockerfiles oder CI/CD-Skripten in GitHub Actions oder Jenkins investiert. Diese Logik in eine separate, proprietäre Datei kopieren zu müssen, ist nur zusätzliche Arbeit und eine weitere Sache, die kaputtgehen kann.

Diese Art von Einrichtungskomplexität ist genau das, was moderne KI-Plattformen in anderen Bereichen zu vermeiden versuchen. In der Kundensupport-Automatisierung zum Beispiel geht es bei einem Tool wie eesel AI darum, Sie in Minuten live zu bringen. Mit Ein-Klick-Verbindungen und einem cleveren Simulationsmodus können Sie Ihre KI an vergangenen Support-Tickets risikofrei testen, bevor Sie sie mit echten Kunden sprechen lassen. Es geht darum, die Einführung reibungslos und stressfrei zu gestalten.

Das Urteil zu OpenAI Codex-Integrationen mit GitHub

OpenAI Codex-Integrationen mit GitHub geben uns einen ziemlich coolen Einblick, wohin sich die Softwareentwicklung entwickelt. Einen KI-Agenten zu haben, der Code verstehen, schreiben und testen kann, ist eine große Sache. Für kleinere, gut definierte Aufgaben, wie das Schreiben von Unit-Tests, das Refactoring einer Funktion oder das Beheben eines einfachen Fehlers, kann Codex die Dinge ernsthaft beschleunigen.

Aber die Plattform ist noch jung, und die alltäglichen Probleme sind real. Die Tatsache, dass es nur mit GitHub funktioniert, ist eine große Einschränkung, und die verwirrenden Arbeitsabläufe sowie die inkonsistente Leistung bedeuten, dass es nicht der nahtlose KI-Teamkollege ist, den Sie sich vielleicht vorstellen. Es erfordert etwas Geduld und viele sorgfältige Anweisungen, um es richtig hinzubekommen.

Da die KI-Modelle schlauer und die Werkzeuge besser werden, wird Codex wahrscheinlich ein fester Bestandteil des Arbeitsablaufs jedes Entwicklers werden. Vorerst ist es ein leistungsstarkes, aber fehlerhaftes Werkzeug, das am meisten für Teams Sinn macht, die in GitHub leben und atmen.

Ihr Unternehmenswissen verdient eine intelligentere KI

Codex ist mit Code beschäftigt, aber was ist mit all dem anderen Wissen, das in Ihrem Unternehmen eingeschlossen ist? Ihre Support-Tickets, internen Wikis und Help-Center-Artikel sind vollgepackt mit Informationen. Das ist das Material, das eine KI nutzen kann, um Kundenprobleme zu lösen, Mitarbeiterfragen zu beantworten und all diese repetitiven Supportaufgaben zu automatisieren.

Genau dafür wurde eesel AI entwickelt. Es verbindet sich mit all den Tools, die Sie bereits verwenden – Zendesk, Slack, Confluence und über 100 weitere –, um präzisen, automatisierten Support zu bieten. Wir haben uns darauf konzentriert, es einfach zu machen, damit Sie in Minuten live gehen und unseren Simulationsmodus nutzen können, um Ihren Return on Investment zu sehen, bevor Sie überhaupt anfangen.

Erfahren Sie, wie eesel AI Ihre Support-Workflows noch heute automatisieren kann.

Häufig gestellte Fragen

OpenAI Codex-Integrationen mit GitHub ermöglichen es einem KI-Agenten, der auf dem "codex-1"-Modell von OpenAI basiert, direkt mit Ihren GitHub-Repositories zu interagieren. Er kann Code verstehen, neue Funktionen schreiben, Fehler beheben, Fragen zu Ihrer Codebasis beantworten und sogar Pull-Requests entwerfen.

Die Einrichtung kann über die ChatGPT-Oberfläche durch Autorisierung einer "ChatGPT connector"-App für den Zugriff auf Ihre GitHub-Repos erfolgen oder über eine Befehlszeilenschnittstelle (CLI), die mit Ihren lokalen Dateien arbeitet. Eine optionale "AGENTS.md"-Datei kann ebenfalls verwendet werden, um Umgebungsspezifika zu definieren.

Der Zugriff auf Codex ist in der Regel in kostenpflichtigen ChatGPT-Abonnements (Plus, Pro, Business, Enterprise) enthalten. Für CLI-Benutzer hat das "codex-mini-latest"-Modell eine eigene API-Preisgestaltung, die auf Eingabe- und Ausgabe-Token basiert, wobei bei Plus-/Pro-Plänen einige kostenlose Credits zur Verfügung gestellt werden.

Die bedeutendste Einschränkung ist, dass die OpenAI Codex-Integrationen ausschließlich für GitHub gelten. Teams, die andere Plattformen wie Azure DevOps, Bitbucket oder GitLab verwenden, haben derzeit keine native Unterstützung für die Integration von Codex.

Entwickler stoßen häufig auf Probleme wie zufällige oder unklare Branch-Namen, unvorhersehbare Updates (bei denen neue Branches erstellt werden, anstatt bestehende zu aktualisieren) und vage Pull-Request-Beschreibungen. Dies kann zu einer unübersichtlichen Git-Historie und zusätzlichem Überprüfungsaufwand führen.

Ja, einige Benutzer beschreiben Codex als "faul", was bedeutet, dass er eine komplexe Aufgabe beginnen, aber auf halbem Weg aufhören, nur einen kleinen Teil erledigen oder spezifische Anweisungen wie das Ausführen von Tests ignorieren könnte. Dies erfordert oft eine ständige Überwachung und zusätzliche Anweisungen, um die Erledigung der Aufgabe sicherzustellen.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.