La IA está revolucionando el desarrollo de software. La idea es automatizar las tareas aburridas para que los ingenieros puedan centrarse en los problemas difíciles. OpenAI Codex es un nombre importante en este campo, y promete un agente de IA que puede entender tu código, escribir nuevas funcionalidades e incluso gestionar pull requests. Conectarlo a GitHub suena como un sueño, ¿verdad? Un asistente de IA que puede tomar un ticket, corregir un error y solicitar una revisión.

Pero, ¿cómo es realmente usarlo? Esta guía te ofrece una visión completa de las integraciones de OpenAI Codex con GitHub. Analizaremos sus características, el proceso de configuración, su costo y los problemas comunes a los que se enfrentan los equipos. Al final, tendrás una idea mucho más clara de en qué te estás metiendo.

¿Qué son las integraciones de OpenAI Codex con GitHub?

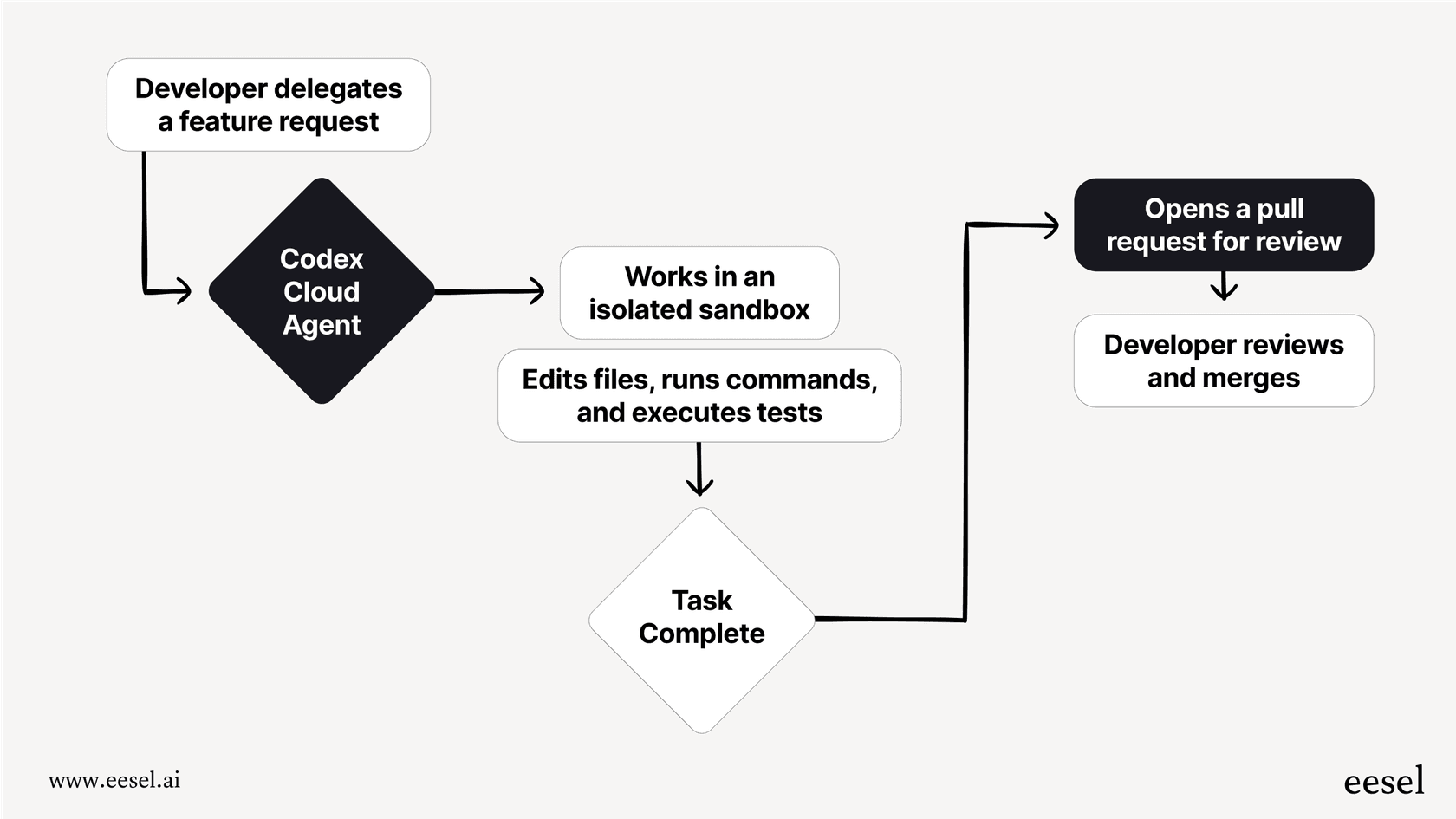

Piensa en OpenAI Codex como un ingeniero de software de IA que trabaja en la nube. Se basa en "codex-1", una versión de los modelos de OpenAI entrenada específicamente para entender la programación. Esto no es solo un autocompletado sofisticado. Codex obtiene su propio entorno de pruebas (sandbox) con tu código cargado, por lo que puede leer archivos, ejecutar pruebas y desarrollar funcionalidades desde cero.

La integración con GitHub es lo que hace que todo funcione. Cuando conectas tu cuenta de GitHub, le das permiso a Codex para acceder a ciertos repositorios. A partir de ahí, puedes empezar a asignarle tareas como:

-

Corregir un error basándose en una incidencia que hayas creado.

-

Limpiar código desordenado para que sea más fácil de leer.

-

Responder preguntas sobre cómo funciona una parte de tu código.

-

Crear y enviar un pull request para que una persona lo revise.

Esto convierte a Codex de una herramienta de programación general en un agente que realmente entiende el contexto de tu proyecto. Puedes darle una tarea y dejar que trabaje en segundo plano, casi como un nuevo compañero de equipo muy silencioso.

Cómo funcionan las integraciones de OpenAI Codex con GitHub

Poner en marcha Codex implica conectarlo a tu entorno de desarrollo. Puedes hacerlo a través de una interfaz web o una herramienta de línea de comandos, según lo que prefieras.

Configurar las integraciones de OpenAI Codex con GitHub en ChatGPT

La mayoría de la gente empieza a usar Codex a través de la interfaz de ChatGPT. Cuando vayas a la sección de Codex, te pedirá que conectes tu cuenta de GitHub.

-

Autorización: Serás redirigido a GitHub para aprobar la aplicación "ChatGPT connector". Aquí puedes elegir a qué repositorios (públicos o privados) quieres que Codex tenga acceso.

-

Asignarle una tarea: Una vez conectado, puedes decirle qué hacer en lenguaje natural. Puedes "Preguntar" (Ask) o usar el modo "Código" (Code) para que escriba o modifique código.

-

Verlo trabajar: Para cada tarea, Codex crea un contenedor aislado en la nube, clona tu repositorio y se pone a trabajar. Puedes ver su progreso en tiempo real mientras navega por los archivos, ejecuta comandos y realiza cambios.

-

El pull request: Cuando termina, Codex confirma los cambios y puede abrir un pull request en tu repositorio de GitHub para que tu equipo lo revise.

Parece bastante simple, pero muchos desarrolladores han tenido problemas con la configuración inicial. Algunos se han quedado atascados en un bucle de autenticación infinito. La solución habitual es ir a la configuración de ChatGPT, desconectar la aplicación de GitHub y luego intentar conectarla de nuevo. Es un poco engorroso y demuestra que todavía hay algunos aspectos por pulir.

Usar la interfaz de línea de comandos (CLI)

Si te sientes más cómodo en la terminal, OpenAI tiene una CLI de Codex. Es una pequeña herramienta de código abierto que lleva la misma potencia a tu máquina local.

-

Autenticación: Solo tienes que iniciar sesión con tu cuenta de ChatGPT, y se encarga de la configuración de la clave de la API por ti.

-

Contexto local: La CLI trabaja con tus archivos locales, por lo que no necesita clonar nada en un entorno separado. Simplemente tiene el contexto de inmediato.

-

Integración con Git: Funciona perfectamente con tu configuración de Git existente. Puedes ver fácilmente las diferencias, preparar los cambios y confirmar el código que genera la IA.

Aunque la CLI se parece más a una herramienta de desarrollo tradicional, a algunos les resulta un poco complicado hacerla funcionar sin problemas con VS Code u otros IDE.

Usar AGENTS.md

Para darle a Codex una mejor idea de cómo funciona tu proyecto, puedes añadir un archivo "AGENTS.md" en la raíz de tu repositorio. Es como un "README.md" pero para la IA. Puedes poner instrucciones ahí, como:

-

Comandos para configurar el entorno.

-

Cómo ejecutar tu suite de pruebas.

-

Cualquier guía de estilo o buenas prácticas que deba seguir.

Es una idea interesante, pero significa que tienes que crear y mantener un archivo de configuración especial que no forma parte de tus scripts de CI habituales o Dockerfiles. Es una cosa más de la que estar pendiente.

Características clave y precios

Codex intenta ser más que un simple compañero de programación; está diseñado para ser un verdadero agente de ingeniería de software. Sus características están creadas para gestionar tareas que requieren múltiples pasos y cierta interacción.

Lo que puede hacer

-

Realizar tareas por su cuenta: Puedes darle un objetivo de alto nivel (como "Arregla el error de inicio de sesión") y trabajará en ello por sí solo hasta 30 minutos.

-

Responder preguntas sobre tu código: Puedes hacerle preguntas complejas sobre tu arquitectura y buscará en los archivos para encontrar una respuesta, a veces incluso generando diagramas.

-

Probar y depurar: Puede ejecutar tus pruebas, ver qué falla e intentar corregir el código hasta que todo pase.

-

Refactorizar y documentar: Es bastante útil para tareas de limpieza como dividir archivos grandes, mejorar la documentación o añadir pruebas para aumentar la cobertura.

El desglose de precios

No puedes comprar OpenAI Codex por separado. Viene incluido en las suscripciones de pago de ChatGPT, por lo que tendrás que pagar una cuota mensual por usuario.

Aquí están los precios oficiales de los planes de ChatGPT que necesitarás:

| Plan | Precio (mensual) | Características clave para el acceso a Codex |

|---|---|---|

| Plus | 20 $/mes | Acceso limitado a las funciones del agente Codex. |

| Pro | 60 $/mes | Acceso completo a Codex, incluyendo mensajes ilimitados y capacidades de agente ampliadas. |

| Business | Personalizado | Todo lo de Pro, más conectores de conocimiento de la empresa (GitHub, Slack, etc.) y controles de administrador. |

| Enterprise | Personalizado | Todo lo de Business, más seguridad de nivel empresarial, soporte prioritario y retención de datos personalizada. |

Desafíos y limitaciones comunes

Aunque la idea de un desarrollador de IA suena increíble, usar OpenAI Codex con GitHub hoy en día conlleva algunas frustraciones reales que los primeros usuarios no han tardado en señalar.

1. La limitación de 'GitHub o nada'

Este es probablemente el mayor inconveniente. La integración es exclusiva para GitHub. Si tu equipo usa Azure DevOps, Bitbucket o GitLab, no tienes suerte. Codex no tiene soporte nativo para estas plataformas, lo que excluye a una gran parte de los equipos de desarrollo, especialmente en empresas más grandes. Forzar a todos a usar un único proveedor es difícil de aceptar para equipos que tienen sus herramientas configuradas exactamente como les gusta.

Es un marcado contraste con los ejemplos de agentes de IA modernos en otras áreas de negocio. Tomemos como ejemplo el soporte al cliente con IA. Una herramienta como eesel AI está diseñada para ser flexible porque el conocimiento de la empresa está disperso por todas partes. Se conecta a docenas de aplicaciones de inmediato, desde servicios de asistencia como Zendesk y Jira Service Management hasta wikis como Confluence y Google Docs.

2. Pull requests y ramas desordenadas

La forma en que Codex maneja las ramas y los PR puede ser, como dijo un usuario, una "pesadilla". Estas son algunas de las quejas principales:

-

Nombres de ramas extraños: Codex a menudo crea ramas con nombres aleatorios como "d92ewq-codex/...". Esto hace que sea muy difícil averiguar qué rama pertenece a qué tarea.

-

Actualizaciones impredecibles: Si pides un seguimiento, es una incógnita si actualizará la rama existente o simplemente creará una nueva. Puedes terminar con un lío de pull requests.

-

Descripciones de PR vagas: Los pull requests que genera a menudo carecen de buenas descripciones o contexto, lo que significa que los desarrolladores tienen que perder tiempo investigando para entender qué cambió realmente la IA.

3. El rendimiento 'perezoso'

Otra queja común es que Codex puede ser "perezoso". Puedes darle una tarea compleja y comenzará con fuerza, solo para abandonar a la mitad o completar solo una pequeña parte del trabajo. Puede ignorar instrucciones específicas u olvidar ejecutar las pruebas como le pediste, lo que te obliga a supervisarlo constantemente y darle más indicaciones para que termine el trabajo. No es exactamente el asistente de "configúralo y olvídate" que podrías estar esperando.

4. Configuración del entorno incómoda

Depender de un archivo especial "AGENTS.md" para la configuración es otro punto débil. La mayoría de los equipos ya han invertido mucho esfuerzo en definir sus entornos con herramientas estándar como Dockerfiles o scripts de CI/CD en GitHub Actions o Jenkins. Tener que copiar esa lógica en un archivo separado y propietario es simplemente trabajo extra y una cosa más que puede fallar.

Este tipo de complejidad en la configuración es exactamente lo que las plataformas de IA modernas en otros campos intentan evitar. En la automatización del soporte al cliente, por ejemplo, una herramienta como eesel AI se centra en que puedas empezar a usarla en minutos. Con conexiones de un solo clic y un ingenioso modo de simulación, puedes probar tu IA con tickets de soporte pasados sin ningún riesgo antes de dejar que hable con clientes reales. Se trata de hacer que la implementación sea fluida y sin estrés.

El veredicto sobre las integraciones de OpenAI Codex con GitHub

Las integraciones de OpenAI Codex con GitHub nos dan una visión bastante interesante de hacia dónde se dirige el desarrollo de software. Tener un agente de IA que pueda entender, escribir y probar código es un gran avance. Para tareas más pequeñas y bien definidas, como escribir pruebas unitarias, refactorizar una función o corregir un error simple, Codex puede acelerar seriamente las cosas.

Pero la plataforma aún es joven, y los problemas del día a día son reales. El hecho de que solo funcione con GitHub es una limitación importante, y los flujos de trabajo confusos y el rendimiento inconsistente significan que no es el compañero de equipo de IA perfecto que podrías tener en mente. Requiere algo de paciencia y muchas indicaciones cuidadosas para hacerlo bien.

A medida que los modelos de IA se vuelvan más inteligentes y las herramientas mejoren, es probable que Codex se convierta en una parte estándar del flujo de trabajo de todo desarrollador. Por ahora, es una herramienta potente pero imperfecta que tiene más sentido para los equipos que viven y respiran GitHub.

El conocimiento de tu empresa merece una IA más inteligente

Codex está ocupado con el código, pero ¿qué pasa con todo el otro conocimiento encerrado en tu empresa? Tus tickets de soporte, wikis internas y artículos del centro de ayuda están repletos de información. Ese es el material que una IA puede usar para resolver problemas de clientes, responder preguntas de empleados y automatizar todas esas tareas de soporte repetitivas.

Eso es exactamente para lo que está diseñado eesel AI. Se conecta a todas las herramientas que ya usas, Zendesk, Slack, Confluence y más de 100 otras, para proporcionar un soporte preciso y automatizado. Nos hemos centrado en hacerlo simple, para que puedas empezar a usarlo en minutos y utilizar nuestro modo de simulación para ver tu retorno de la inversión incluso antes de empezar.

Descubre cómo eesel AI puede automatizar tus flujos de trabajo de soporte hoy mismo.

Preguntas frecuentes

Las integraciones de OpenAI Codex con GitHub permiten que un agente de IA, basado en el modelo "codex-1" de OpenAI, interactúe directamente con tus repositorios de GitHub. Puede entender el código, escribir nuevas funcionalidades, corregir errores, responder preguntas sobre tu base de código e incluso crear borradores de pull requests.

La configuración se puede realizar a través de la interfaz de ChatGPT autorizando a una aplicación "ChatGPT connector" para que acceda a tus repositorios de GitHub, o mediante una interfaz de línea de comandos (CLI) que funciona con tus archivos locales. También se puede usar un archivo opcional "AGENTS.md" para definir detalles específicos del entorno.

El acceso a Codex generalmente está incluido en las suscripciones de pago de ChatGPT (Plus, Pro, Business, Enterprise). Para los usuarios de la CLI, el modelo "codex-mini-latest" tiene su propio precio de API basado en los tokens de entrada y salida, con algunos créditos gratuitos proporcionados en los planes Plus/Pro.

La limitación más significativa es que las integraciones de OpenAI Codex son exclusivas de GitHub. Los equipos que utilizan otras plataformas como Azure DevOps, Bitbucket o GitLab actualmente no tienen soporte nativo para integrar Codex.

Los desarrolladores a menudo se enfrentan a problemas como nombres de ramas aleatorios o poco claros, actualizaciones impredecibles (donde se crean nuevas ramas en lugar de actualizar las existentes) y descripciones de pull requests vagas. Esto puede llevar a un historial de Git desordenado y a un esfuerzo de revisión adicional.

Sí, algunos usuarios describen a Codex como "perezoso", lo que significa que puede comenzar una tarea compleja pero detenerse a la mitad, completar solo una pequeña parte o ignorar instrucciones específicas como ejecutar pruebas. Esto a menudo requiere una supervisión constante e indicaciones adicionales para garantizar que la tarea se complete.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.