2025 年のデベロッパー向け、Modal AI の代替となる最適な7つの選択肢

Stevia Putri

Katelin Teen

最終更新 October 5, 2025

Modal をご利用中なのですね。これは、Python コード、機械学習モデル、および大規模なバッチジョブを、頭を悩ませることなくクラウドで実行するための優れたツールです。GPU コンピューティングに対するそのサーバーレスなアプローチは、迅速な実験にとってまさに救世主です。しかし、プロジェクトが大きくなるにつれて、予測不可能なコストやプラットフォームの制限など、Modal AI の代替手段について疑問に思うようになるかもしれません。

AI アプリを構築していて、「他に何があるのだろう?」と考えているなら、あなたは正しい場所にたどり着きました。ここでは、DevOps の深い知識がなくても特定のビジネス上の問題を解決するのに役立つプラットフォームと、カスタムコードに対してより生のパワーと柔軟性を提供するプラットフォームという、主に 2 種類の代替手段を見ていきます。

Modal AI とは何ですか?

簡単に復習しましょう。Modal は、開発者が基盤となるインフラストラクチャを気にすることなくクラウドでコードを実行できるサーバーレスプラットフォームです。Python 関数を取り、デコレーターをポップアップして、非常に強力なハードウェア(H100 GPU)で実行することができます。人々は、ほぼ瞬時のコールドスタートと、ローカルマシンで作業しているような開発エクスペリエンスを気に入っています。

最もよく使用されるのは、次のようなものです。

-

大規模言語モデルおよび画像ジェネレーターの推論の実行。

-

カスタムデータでのオープンソースモデルの微調整。

-

数千のコンテナにわたって実行するために、バッチ処理ジョブをスケールアップ。

基本的に、Kubernetes の構成や終わりのない YAML ファイルに手間取るよりも、コードを書きたい開発者向けです。

Modal AI の代替手段を探す理由

Modal はシンプルさのチャンピオンですが、その焦点にはいくつかのトレードオフが伴います。クールなプロトタイプから実際のプロダクションシステムにプロジェクトが成熟するにつれて、いくつかの共通の問題点が表面化する傾向があります。

-

完全なアプリケーションの構築は困難です。 Modal は個々の関数を実行することに優れていますが、フロントエンド、バックエンド、およびデータベースを備えた完全なアプリケーションを調整するために設計されたものではありませんでした。複数のサービスをまとめて結合しようとすると、少し扱いにくいと感じることがあります。

-

コストが予測不可能になる可能性があります。 秒単位の料金モデルは、短時間でたまに行うタスクに最適です。しかし、しばらく実行する必要があるジョブや、常に GPU にアクセスする必要があるジョブの場合、それらの秒数がすぐに加算され、月額料金の予測が実際の推測ゲームになる可能性があります。

-

ロックインされます。 このプラットフォームは、Modal 固有のコードとインフラストラクチャを使用してそのマジックを実行します。それは開始するには最適ですが、アプリケーションを別のクラウドプロバイダーに移動するには、大規模なリファクタリングプロジェクトが必要になります。

-

制限された制御とネットワーク。 独自のクラウドアカウント(BYOC)を使用したり、独自のプライベートネットワーク(VPC)にデプロイしたりすることはできません。大企業の場合、これはデータセキュリティ、居住地、およびコンプライアンスルールにより、議論の余地がない場合があります。

-

組み込みの CI/CD または Git ワークフローはありません。 Git からトリガーされた自動テストとデプロイメントを備えた適切な開発パイプラインが必要な場合は、外部ツールをボルトで固定する必要があります。これにより、Modal が回避しようとしていた複雑さの一部が再び追加されます。

最適な Modal AI の代替手段を選択するための基準

このリストを実際に役立つものにするために、Modal のギャップの一部に直接対処するプラットフォームを選択しました。いくつかの主要なレンズを通してそれぞれを検討しました。

-

主な目的: (サポートエージェントのような)特定の AI 製品を構築するために設計されているのか、それとも汎用コーディング用なのか?

-

料金モデル: 料金は明確で予測可能か、それともそれを理解するためにスプレッドシートが必要になるか?

-

開発者のエクスペリエンス: コードをデプロイして実行し続けるのはどれほど簡単か?

-

スケーラビリティと制御: 実際のプロダクションのトラフィックを処理できますか?また、BYOC のような高度な機能を提供していますか?

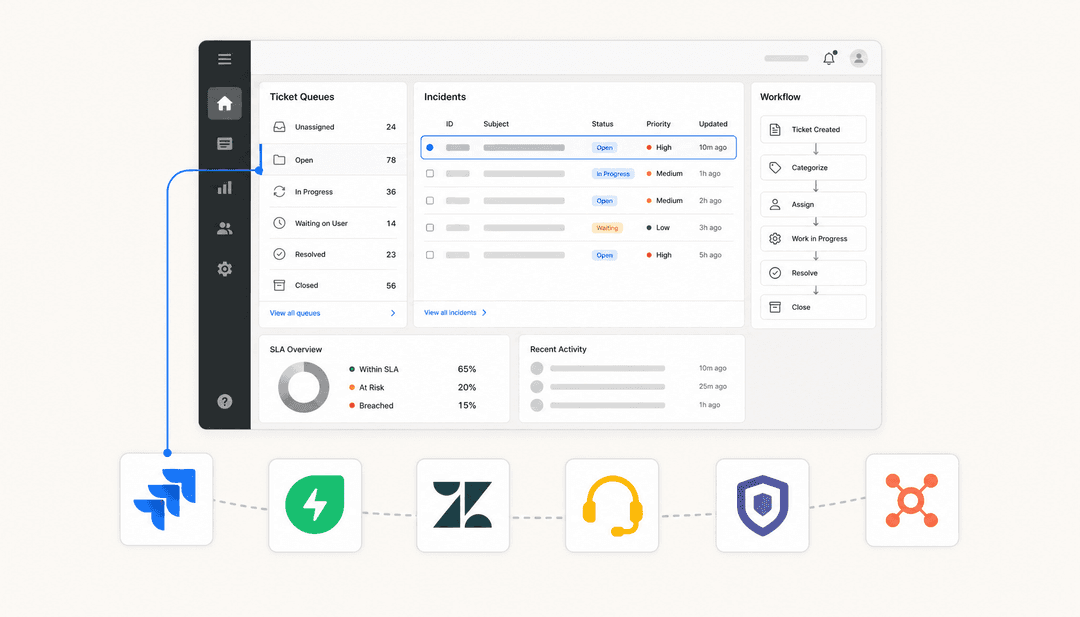

Modal AI の最適な代替手段の簡単な比較

ここでは、上位の選択肢が互いにどのように積み重なっているかを大まかに見てみましょう。

| プラットフォーム | 最適な用途 | 料金モデル | 主な機能 | BYOC サポート |

|---|---|---|---|---|

| eesel AI | AI カスタマーサポート自動化 | インタラクションごと(予測可能) | 数分で稼働、インフラ不要 | いいえ |

| Northflank | フルスタック AI 製品デプロイメント | 使用量ベース | Git ベースの CI/CD と GPU オーケストレーション | はい |

| RunPod | 予算に優しい GPU コンピューティング | 秒単位 | 低コストの GPU マーケットプレイス | いいえ |

| Replicate | パブリックモデルのデモと API | 秒単位 | オープンソースモデルをデプロイする最も簡単な方法 | いいえ |

| Baseten | 内部 ML ツールとモデル API | 使用量ベース | デモ用の統合 UI ビルダー | いいえ |

| AWS SageMaker | エンタープライズグレードの MLOps | 使用量ベース(複雑) | 深い AWS 統合とセキュリティ | はい |

| Anyscale | Ray による分散トレーニング | 使用量ベース | スケーラブルな Ray ベースのコンピューティング | はい |

2025 年の Modal AI の代替となる最適な7つの選択肢

それでは、詳細を見ていきましょう。Modal から移行する準備ができたら検討する価値があると思われるプラットフォームを次に示します。

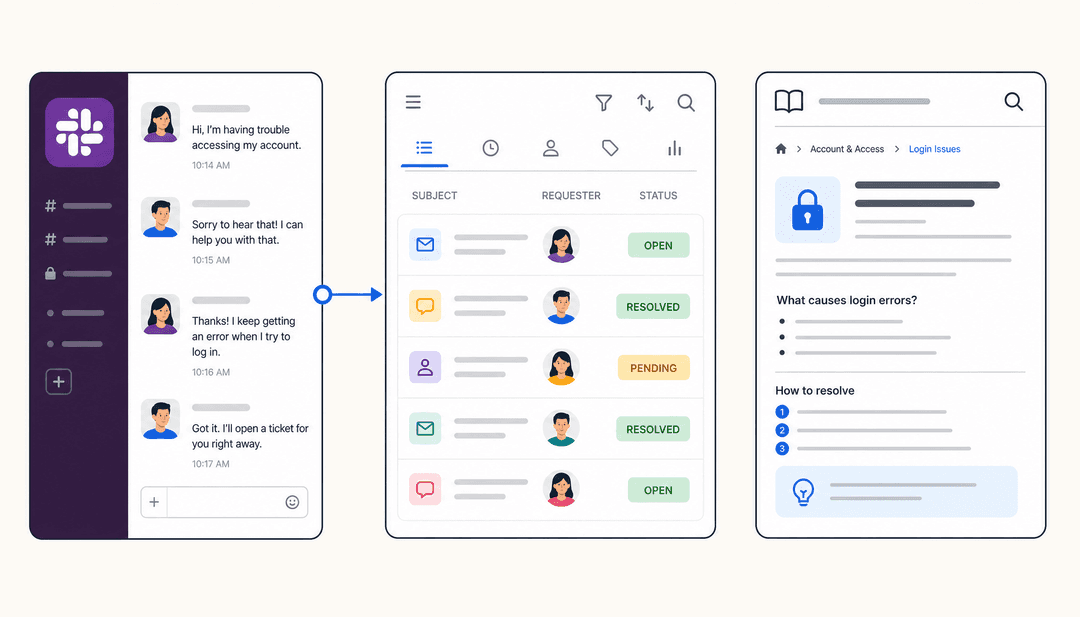

1. eesel AI

最初は別の種類の代替手段です。Modal を使用する主な理由が、カスタマーサポートチャットボット や 内部ヘルプデスクエージェント などの特定の AI アプリケーションを構築することである場合、eesel AI のようなプラットフォームは、はるかに直接的なルートです。低レベルのビルディングブロックを提供する代わりに、完成した、すぐに本番環境で使用できるソリューションを提供します。

eesel AI をヘルプデスク(Zendesk や Intercom など)、ナレッジベース(Confluence や Google Docs など)、およびチャットツール(Slack や Microsoft Teams など)に直接接続できます。過去のサポートチケットを読んで、最前線のサポートを自動化 し、人間のエージェントへの返信を作成 し、問題をトリアージ します。これらはすべて、ブランドの声に合わせながら行われます。サインアップから、数か月ではなく数分で、AI エージェントを稼働させることができます。

Modal で自分で構築するよりも優れた代替手段である理由:

開始するために営業担当者と話す必要はありません。AI エージェント のセットアップ、構成、および起動はすべて自分で行うことができます。実際の顧客に話しかける前に、過去の数千件のチケットでシミュレーションを実行して、AI がどのように実行されたかを正確に確認できます。これにより、事前に潜在的な ROI を計算できます。さらに、AI が処理するチケットと、注文情報の検索や人間のトリッキーな問題のエスカレーションなど、AI が実行できるアクションを完全に制御できるワークフローエンジンを入手できます。

-

利点: 数分で稼働、管理するインフラストラクチャなし、強力なシミュレーションモード、および解決ごとの隠れた料金のない明確な料金設定。

-

短所: 特にカスタマーサービスと内部サポートに焦点を当てているため、汎用コードを実行するためのプラットフォームではありません。

-

料金: eesel AI の料金 は予測可能性に基づいて構築されています。Team プランは月額 299 ドル(年間請求の場合は月額 239 ドル)で、最大 1,000 件の AI インタラクションをカバーします。Business プランは月額 799 ドル(年間請求の場合は月額 639 ドル)で、3,000 件のインタラクションと、過去のチケットでのトレーニングや AI 駆動のトリアージなどの追加機能が追加されます。このモデルは、忙しい月でもコストが一定であることを意味します。

2. Northflank

単一の関数スクリプトを超えて、完全なマルチパート AI 製品を構築する必要がある場合は、Northflank が有力な候補です。Modal の関数ファーストのアプローチとは異なり、Northflank では、バックエンド API、フロントエンド UI、データベースなど、コンテナ化されたサービスをデプロイして、それらをすべてリンクすることができます。

最大のセールスポイントは、組み込みの Git ベースの CI/CD パイプライン、すべてのプルリクエストのプレビュー環境、およびスマート GPU オーケストレーションです。また、独自のクラウド(BYOC)を持ち込むことをサポートしており、Modal が提供していないインフラストラクチャの制御を実現しています。

-

利点: ベンダーロックインなし、明確な料金設定、組み込みの CI/CD、およびフルスタックアプリケーション向けに設計されています。

-

短所: 1 つのスクリプトを実行するだけでよい場合は、Modal よりも少し複雑に感じる場合があります。

-

料金: Northflank は、使用するリソースに基づいて従量課金制で動作します。時間単位で請求されます。CPU は 0.01667 ドル/時間、メモリは 0.00833 ドル/GB/時間、GPU には独自の料金があります(たとえば、NVIDIA H100 は 2.74 ドル/時間)。これにより、多くの制御が可能になりますが、コストを管理するには使用状況を監視する必要があります。

3. RunPod

代替手段を探している主な理由が GPU の料金を下げることである場合は、RunPod をリストの一番上に表示する必要があります。これは、オンデマンドの GPU コンピューティングをどこよりも競争力のある価格で提供するクラウドプラットフォームです。安全なデータセンターとピアツーピアマシンからなる「コミュニティクラウド」の両方を含むマーケットプレイスでこれを実現しています。

RunPod は、カスタム Docker イメージと永続ストレージをサポートしており、Modal よりも環境をより直接的に制御できます。Jupyter ノートブックを実行したり、モデルを微調整したり、銀行を壊すことなく推論 API をデプロイしたりする必要がある ML の人には最適です。

-

利点: 非常に低い GPU コスト、利用可能な GPU の膨大な選択肢、およびランタイム環境の完全な制御。

-

短所: Modal よりも手動設定が必要で、統合された CI/CD やフルスタックアプリの構築のサポートはありません。

-

料金: RunPod の料金 は、秒単位の請求で打ち負かすのは困難です。たとえば、NVIDIA H100 GPU は、セキュアクラウドで 1 時間あたり 1.99 ドルという低価格で見つけることができます。また、秒単位で価格設定されたサーバーレス GPU インスタンスも提供しており、急増する推論ワークロードにとって最も安価なオプションの 1 つになっています。

4. Replicate

Replicate は、シンプルな API を通じてオープンソースモデルをデプロイおよび共有することを目的として構築されています。クールな新しい生成モデルをオンラインで取得し、世界と共有したり、別のアプリに接続したりしたい場合は、Replicate がおそらく最も簡単な方法です。数回クリックするだけで、その広範なライブラリから人気のあるモデルをデプロイできます。

シンプルさを愛するという Modal の気持ちを共有していますが、推論ユースケースに重点が置かれています。モデルのトレーニング、バッチジョブの実行、またはプライベートな本番環境グレードのアプリケーションの構築には適したツールではありません。

-

利点: セットアップ不要のモデルホスティング、モデルの共有または収益化が簡単、および優れたコミュニティライブラリ。

-

短所: 実際には本番環境のアプリケーション向けに構築されておらず、プライベートインフラストラクチャまたは CI/CD を提供していません。

-

料金: Replicate の料金モデル は、ハードウェアの秒単位の使用量に基づいています。Nvidia T4 GPU の費用は 0.000225 ドル/秒(1 時間あたり 0.81 ドルになります)、Nvidia A100 は 0.001400 ドル/秒(1 時間あたり 5.04 ドル)です。一部のプロプライエタリモデルでは、出力ごと(生成された画像ごとなど)に請求されるため、コストを見積もりやすくなります。

5. Baseten

Baseten は、特に内部ツールや初期段階の製品の場合に、モデルを API として迅速に提供する必要がある機械学習チームを対象としています。そのキラー機能は、フロントエンドコードに触れることなくモデルのシンプルなユーザーインターフェイスを作成できる統合された「アプリビルダー」です。これにより、同僚や関係者と作品を共有するのが非常に速くなります。

モデルを、オートスケーリングやロギングなどのすべての装飾が施された本番環境に対応した API エンドポイントに変えるのに最適な選択肢ですが、より複雑なバックエンドや完全なアプリケーションを構築するのにそれほど柔軟ではありません。

-

利点: モデルからライブ API への非常に高速な方法であり、組み込みの UI ビルダーはデモに最適です。

-

短所: 内部ツールに重点が置かれる傾向があり、複数のサービスを調整するためのオプションは限られています。

-

料金: Baseten の料金 は従量課金制で、専用マシンの分単位で請求されます。GPU インスタンスは T4 の場合は 0.01052 ドル/分から、H100 の場合は 0.10833 ドル/分までです。また、一般的な LLM の事前パッケージ化された API も提供しており、100 万トークンあたりで請求されます。

6. AWS SageMaker

すでに AWS エコシステムにすべてを投入している大企業にとって、Amazon SageMaker はヘビー級のチャンピオンです。これは大規模な MLOps プラットフォームであり、データのラベリングやモデルのトレーニングから、本番環境でのデプロイと監視まで、機械学習のライフサイクルですべてを実行しようとします。

SageMaker は IAM や VPC などの他の AWS サービスと深く結び付いているため、Modal が持っていないエンタープライズレベルのセキュリティおよびコンプライアンス機能が備わっています。しかし、すべてのパワーには急な学習曲線が伴い、小規模なチームにとっては深刻な過剰になる可能性があります。

-

利点: 最高水準のセキュリティおよびコンプライアンス機能を備えた、強力で成熟したエコシステム。

-

短所: セットアップと管理が非常に複雑になる可能性があり、料金は予測が難しいことで有名です。

-

料金: SageMaker の料金 はそれ自体が獣であり、数十の異なるコンポーネントに及ぶ従量課金制モデルです。インスタンスの時間、ストレージ、データ処理などについて個別に請求されます。柔軟性がありますが、コストの予測が非常に困難になり、注意しないと予期せぬ請求が発生しやすくなります。

7. Anyscale

Anyscale は、分散コンピューティング用の頼りになるオープンソースフレームワークである Ray の作成者からのものです。これにより、Ray を使用して大規模な分散トレーニングおよび推論ジョブを実行する必要があるチームに最適なプラットフォームになります。Modal でシングル GPU ジョブでパフォーマンスの限界に達している場合は、Anyscale を使用すると、多くのマシンにスケールアウトするための簡単なパスが得られます。

これは Ray エコシステムに関する非常に特殊なツールであるため、並列コンピューティングに Ray を使用することをすでに決定しているチームに最適です。

-

利点: スケーラブルな Ray ベースのコンピューティングに最適なプラットフォームです。また、フォールトトレラントです。

-

短所: 高度に特殊化されており、汎用アプリケーションプラットフォームとして使用することを目的としていません。

-

料金: Anyscale は 、ホストされたサービスを使用するか、独自のクラウドにデプロイするか(BYOC)によって異なる料金で従量課金制を提供しています。ホストされたコンピューティングは CPU のみのインスタンスの場合は 0.0112 ドル/時間から始まり、NVIDIA H100 の場合は 1.8603 ドル/時間までです。BYOC モデルのプラットフォーム料金は低くなりますが、クラウドプロバイダーの料金も負担する必要があります。

プロジェクトに最適な Modal AI の代替手段を選択する方法

これらのすべてのオプションを使用すると、適切なオプションを選択することは、何を達成しようとしているかに帰着します。

eesel AI のようなアプリケーションレイヤーの Modal AI の代替手段を選択する場合

サーバーを管理するのではなく、ビジネス上の問題を解決したいと考えています。最終的な目標が、既存のツールで動作する洗練された AI サポートエージェントを立ち上げることである場合、eesel AI のようなプラットフォームを選択すると、数か月の開発作業を節約できます。基盤となる技術スタックではなく、顧客エクスペリエンスに集中して時間を費やすことができます。

インフラストラクチャレイヤーの Modal AI の代替手段を選択する場合

カスタムコードを実行したり、独自の要件がある必要があります。まったく新しい ML モデルを開発したり、コンテナ環境を完全に制御したり、フルスタックアプリケーションをゼロから構築したりする場合は、Northflank や RunPod のようなプラットフォームを使用すると、必要なパワーと柔軟性が得られます。

ビルディングブロックからビジネスソリューションへ

Modal は、開発者がインフラストラクチャの煩雑な部分を隠すツールを愛していることを世界に示してくれました。しかし、この進化の次のステップは、アプリケーションロジック自体を隠すことです。Modal のようなプラットフォームが LEGO ブロックを提供する一方で、eesel AI のようなソリューションは完全に構築された宇宙船を提供します。

ほとんどのチームにとって、目標はクラウドでコードを実行することだけではなく、特定のビジネス結果を得ることです。その結果がよりスマートで、より速く、より役立つカスタマーサポートである場合、開発プラットフォームで最初からすべてを構築することは、景色の良いルートをたどることです。よりスマートな代替手段は、その問題をすでに解決しているソリューションを使用することです。

ワールドクラスの AI サポートエージェントをどれだけ早く立ち上げられるか見てみませんか?eesel AI を無料で試して、数分で始めましょう。

よくある質問

セットアップの複雑さは、Modal AI の代替手段によって大きく異なります。eesel AI のように、ほぼ瞬時のデプロイメント向けに設計された既製のソリューションもあれば、AWS SageMaker のように、より広範な構成が必要ですが、エンタープライズニーズに合わせて詳細なカスタマイズが可能なものもあります。

一部の Modal AI の代替手段(例:RunPod、Replicate)も秒単位の請求を使用していますが、他のものは、インタラクションごと(eesel AI)またはリソースの時間単位料金が明確な使用量ベース(Northflank、Baseten)など、より予測可能なモデルを提供しています。ただし、AWS SageMaker の料金は、多くのコンポーネントがあるため、予測が非常に複雑になる可能性があります。

多くの Modal AI の代替手段、特に Northflank のようなインフラストラクチャに焦点を当てたものは、標準的なコンテナ化と BYOC のサポートにより、より高い柔軟性を提供し、ベンダーロックインを軽減します。特定のサービスに特化したプラットフォームには、プラットフォーム固有の要素が含まれている可能性がありますが、一般的に Modal よりもオープンスタンダードを目指しています。

完全なフルスタック AI アプリケーションを構築するには、Northflank が有力な候補です。主なニーズが手頃な価格の生の GPU コンピューティングである場合は、RunPod が最適です。カスタマーサポート のような特定のビジネス上の問題を解決するために、eesel AI は包括的ですぐに使用できるソリューションを提供します。

はい、Northflank、AWS SageMaker、Anyscale(BYOC オプション付き)など、いくつかの Modal AI の代替手段は、インフラストラクチャの制御を大幅に強化します。これにより、独自のクラウドアカウントまたはプライベートネットワークへのデプロイが可能になり、エンタープライズレベルのコンプライアンスとセキュリティにとって非常に重要になります。

多くの Modal AI の代替手段、特に Northflank は、堅牢な組み込みの Git ベースの CI/CD パイプライン、自動デプロイメント、およびプレビュー環境を提供します。これは Modal の一般的な問題点に対応しており、適切な開発パイプラインのために外部ツールを組み込む必要があります。

Ray フレームワーク上に構築された Anyscale は、大規模なスケーラブルな分散トレーニングおよび推論ワークロード向けに特別に設計されており、高性能 ML に最適です。AWS SageMaker は、大規模なエンタープライズグレードの MLOps ニーズにも広範なスケーリング機能を提供します。

Share this article

Article by

Stevia Putri

Stevia Putri は eesel AI のマーケティングジェネラリストであり、強力な AI ツールを共感を呼ぶストーリーに変える手助けをしています。彼女は好奇心、明瞭さ、テクノロジーの人間的な側面に突き動かされています。