金融の世界では、スケールはまったく異なるものです。JPMorgan Chaseのような巨大な銀行は、1日に約4300万件の取引を処理しています。その膨大な量を管理しながら、顧客サービスを向上させ、セキュリティを強化し、コンプライアンスを維持することは大変な頭痛の種です。ここで新しい技術が注目を集め始めています:大規模言語モデル(LLM)です。これらは、単なる技術の流行語から、銀行の業務を変える中核的なツールへと急速に移行しています。

金融業界にいるなら、この用語を聞いたことがあるでしょうが、日々の業務にどのように影響するのか疑問に思っているかもしれません。このガイドはその疑問を解消するためのものです。LLMとは何かを解説し、銀行での最も実用的な使用例を見て、銀行を阻む実際の課題について話し、始めるための明確で無駄のない計画を提供します。

銀行におけるLLMの完全な形を理解する

基本を押さえましょう。LLM、つまり大規模言語モデルは、膨大な量のテキストデータで訓練されたAIの一種です。インターネットのような大きさの図書館を読んだ人を想像してください。その膨大な読書量のおかげで、人間のように驚くほど自然にテキストを理解し、要約し、生成し、予測することができます。

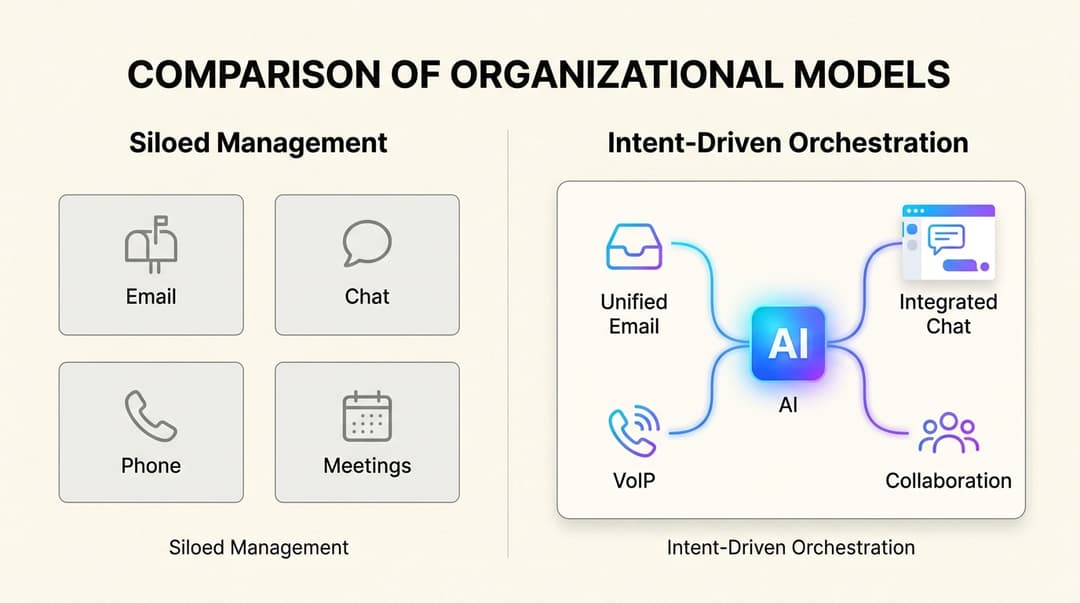

銀行におけるLLMの完全な形は依然として「大規模言語モデル」ですが、金融での使用方法はまったく異なるものです。無料版のChatGPTのような公共のAIをそのまま使って、機密性の高い金融の質問に対応できると期待することはできません。リスクがあまりにも高すぎます。銀行には、複雑な金融用語を理解し、厳格な規制に従い、最も重要なこととして顧客データを厳重に保護するLLMが必要です。

そのため、金融における本当の議論は、一般的なAIではなく、銀行の独自データに安全に接続された 専門的なAIエージェントについてです。AIはアクセスできる情報の賢さに依存しており、銀行にとってその情報は安全で正確で内部的でなければなりません。

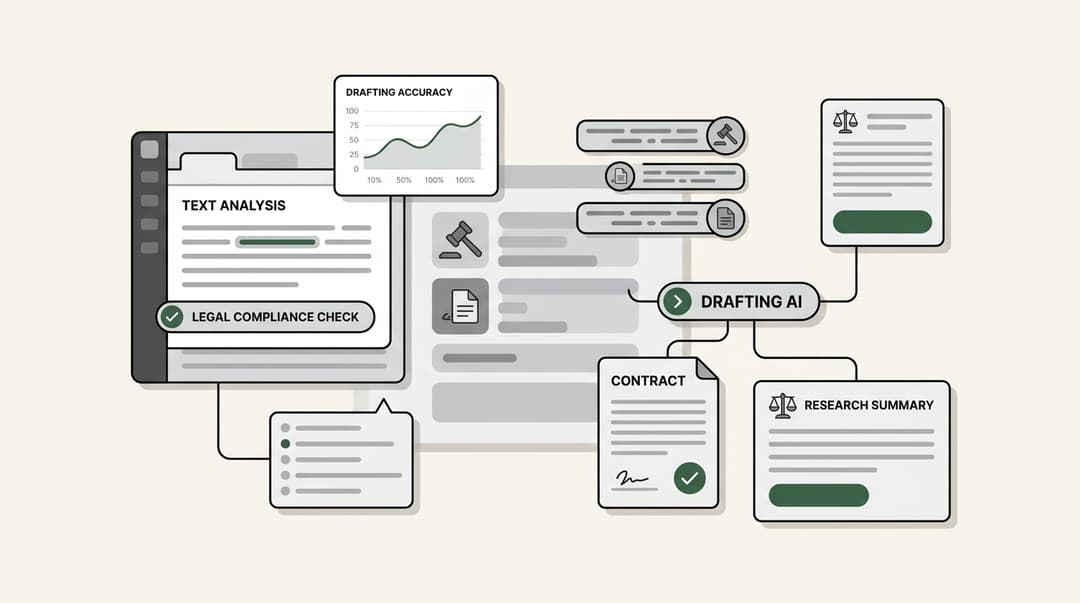

銀行におけるLLMの完全な形の主な使用例

LLMは単一の魔法の弾丸ツールではありません。これをさまざまな銀行業務に適用できる基盤技術と考えてください。現在、最も実用的に使用されている方法をいくつか紹介します。

顧客サービスの向上

すべての銀行は、顧客に迅速で正確かつ本当に役立つサポートを提供したいと考えています。LLMは、24時間稼働するスマートなチャットボットやバーチャルアシスタントを駆動することで、それを実現しています。これらは数年前のぎこちないスクリプトベースのボットではありません。顧客が実際に何を尋ねているのかを理解し、「私の口座残高はいくらですか?」から特定のローン商品に関する質問まで、役立つ回答を提供できます。

問題は、多くのAIチャットボットプロジェクトが壮大に失敗することです。これらはしばしば一般的な知識に基づいて構築されているため、銀行のポリシーや顧客のアカウントに特有の質問に対応できません。そして、現在のヘルプデスク、ZendeskやFreshdeskと連携させることは、通常、時間とリソースを吸い取る長く高価な開発プロジェクトに変わります。

もっと良い方法があります。現代のAIプラットフォームであるeesel AIは、この頭痛を解決するために構築されました。公共のインターネットをスクレイピングする代わりに、eesel AIは銀行の信頼できる知識源に直接接続します。過去のサポートチケット、Confluenceの内部ウィキ、Google Docsの手順書、公式のヘルプセンターから学習します。これにより、あなたのデータに基づいた正確で関連性のある回答を提供します。何よりも、既存のヘルプデスクに数分で接続できるため、チームがすでに使い慣れたツールを捨てる必要はありません。

不正検出の自動化

LLMは人間のアナリストが見逃すかもしれないパターンを見つけるのが非常に得意です。不正検出において、これは非常に重要です。取引データ、顧客のコミュニケーション、その他の信号をリアルタイムで分析することで、LLMは不正を示す可能性のある異常なパターンをフラグし、銀行が実際の被害を受ける前に脅威を阻止するのを助けます。

しかし、これらの専門的な不正モデルを構築することは大変な作業です。完璧にクリーンな巨大なデータセットと、それを構築し維持するデータサイエンティストのチームが必要です。市販のソリューションは、銀行や顧客に特有の不正パターンを拾うことができないため、しばしば不十分です。

プロのヒント: カスタムの不正検出システムは長期的な目標としては素晴らしいですが、最初に取り組むには巨大なプロジェクトです。より賢明な最初のステップは、より迅速で測定可能な成果をもたらすAIの使用例を選ぶことです。一般的な内部サポート質問や顧客のFAQへの回答を自動化することで、チームの時間をほぼ即座に解放できます。これにより、より大きなAIプロジェクトに取り組む準備が整ったときに構築するための明確な成功事例が得られます。

銀行におけるAIがリスク評価を容易にする方法

銀行業界は、非構造化データ、ニュース記事、規制申告、長い内部報告書などに溺れています。LLMはそのノイズを切り抜けて、信用リスクの評価や変化するコンプライアンスルールの監視などのタスクを支援するのに優れています。数千の文書を数秒でスキャンし、リスクとコンプライアンスチームが見る必要のある正確な情報を引き出すことができます。

しかし、ここでの大きな課題は「ブラックボックス」問題です。多くのLLMは回答を提供できますが、その根拠を示すことができません。規制監査では、「AIがそう言ったから」では通用しません。明確で追跡可能な推論のラインが必要です。

ここで、Retrieval-Augmented Generation(RAG)を使用したプラットフォームが本当に違いを生み出します。eesel AIのAIエージェントが質問に答えるとき、それは単にテキストを吐き出すだけでなく、情報源を引用します。内部ポリシードキュメントの特定の段落や、回答を導き出すために使用した正確なサポートチケットに直接リンクできます。これにより、完璧な監査トレイルが作成され、コンプライアンスチームにAIが伝えることを実際に信頼するための自信を与えます。

銀行でLLMを使用する際の大きな課題

LLMには多くの可能性がありますが、それを稼働させるには多くの障害があります。銀行は当然慎重であり、AI計画はこれらの懸念に正面から取り組む必要があります。

データプライバシーとセキュリティリスク

これは間違いなく、AIを検討している銀行にとって最大の障害です。非常に機密性の高い顧客および金融データを扱っています。公共のLLMを使用することは、しばしばそのデータを第三者のサーバーに送信することを意味し、巨大なセキュリティおよびコンプライアンスリスクを生み出します。GDPRのような規制に従わなければならない銀行にとっては、これは始めることができないことです。

検討するソリューションは、最初からエンタープライズグレードのセキュリティで構築されている必要があります。たとえば、eesel AIは、データが一般的なモデルのトレーニングに使用されることはなく、特定のAIエージェントのためだけに使用されることを保証します。EUデータ居住のオプションや、SOC 2 Type II認定インフラストラクチャに基づいた基盤などの機能を備えており、銀行に現代のLLMの力を提供しながら、セキュリティを妥協することなく使用できます。

銀行におけるAIの高コストと痛みを伴う実装

正直に言うと、従来のAIプロジェクトは遅く、高価で、複雑であるという評判があります。立ち上げに数ヶ月から数年かかり、ほとんどの場合、データサイエンティストや開発者の専任チームが必要です。さらに悪いことに、多くのAIベンダーは、製品が適合するかどうかを確認するために必須のデモや長期契約に強制する、苛立たしい販売プロセスを持っています。

ここで新世代のAIツールがスクリプトをひっくり返しています。eesel AIは完全にセルフサービスで設計されています。実際に数分でライブにできるのは、主要なヘルプデスクのためのワンクリック統合のおかげです。価格設定は透明で予測可能であり、使用するたびに解決ごとの料金で罰せられることはありません。これにより、多くの優れたAIアイデアが始まる前に殺される財務的不確実性と複雑さが排除されます。

精度、幻覚、制御の欠如

AIが「幻覚」を起こし、ただの作り話をするという話を見たことがあるでしょう。カジュアルなチャットではそれは面白いかもしれませんが、銀行の文脈ではそれは災害です。一般的なAIがどのトピックに答えようとするかを制御するのは非常に難しく、ブランドに合わない、不正確な、または法的にリスクのある回答を引き起こす可能性があります。

このため、完全な制御が必須です。eesel AIのようなプラットフォームを使用すると、常に運転席に座っていることができます。

- スコープされた知識: AIに特定の文書やデータソースのみを使用するように簡単に指示できます。住宅ローンのAIは住宅ローンについてのみ知識を持ち、小売銀行のAIは自分の知識に固執します。

- カスタマイズ可能なプロンプトとアクション: AIの性格、声のトーン、許可される行動を定義できます。単純なTier 1の質問のみを処理し、より複雑なものはすべて人間のエージェントに直接渡すように指示できます。

- シミュレーションモード: これはリスクを避けたい組織にとって最も重要な機能かもしれません。eesel AIは、過去のサポートチケットを数千件にわたって安全にAI設定をテストできます。これはAIのフライトシミュレーターのようなものです。実際にどのように応答するかを確認し、自動化率を予測し、顧客が話しかける前にその動作を調整できます。他のプラットフォームはこのレベルのリスクフリーで現実世界のテストを提供していません。

| 機能 | 従来のAIプロジェクト | eesel AIのアプローチ |

|---|---|---|

| 立ち上げまでの時間 | 3-6ヶ月 | 数分から数時間 |

| セットアッププロセス | 開発者とデータサイエンティストが必要 | 完全セルフサービス、コード不要 |

| ローンチ前のテスト | 制限されたまたは現実世界のテストなし | 過去のデータでの強力なシミュレーション |

| 価格モデル | 複雑で、しばしば解決ごと | 透明で、定額プラン |

| 制御 | 固定されたハードコードルール | トピックとアクションに対する詳細な制御 |

銀行でLLMを始めるための実用的な4ステッププラン

AIを始めることは、何年もかかる数百万ドルの大事業である必要はありません。より賢明で機敏なアプローチが、より速く、リスクを大幅に減らして結果をもたらします。

- 小さく、勝てる戦いを選ぶ。 海を沸かそうとしないでください。最初の日に複雑な不正分析を自動化しようとする代わりに、限定された反復的な問題に焦点を当ててください。特定の部門の一般的な質問に答えることや、特定のタグを持つチケットをトリアージすることは、始めるのに最適な場所です。

- 頭痛なしで知識を接続する。 AIは与えられた情報の良さに依存します。トリックは、すでに使用しているツールに接続するプラットフォームを選ぶことです。あなたのGoogle Docs、Confluence、ヘルプデスクに即座に安全に接続できる能力が、役立つAIと役に立たないAIを分けます。

- 安全な環境でテストする。 テストしていないAIをライブにすることは絶対に避けてください。従業員や顧客と対話する前に、過去のデータでシミュレーションを実行する必要があります。これが自動化率を正確に予測し、現実世界の結果なしに問題を修正する唯一の方法です。これはeesel AIのようなプラットフォームのコア機能です。

- ゆっくりと展開し、すべてを測定する。 AIに問い合わせの小さな割合を処理させることから始めてください。分析ダッシュボードを使用して、どのように機能しているかを確認し、知識ベースのギャップを特定し、改善の余地を見つけます。明確で実行可能なレポートを提供するプラットフォームは、安全かつ賢明に自動化を拡大するためのロードマップを提供します。

銀行の未来はスマートでアクセスしやすい

大規模言語モデルは銀行業界にとって驚異的な可能性を秘めています。より効率的に作業し、一流の顧客体験を提供し、リスクをこれまで以上にうまく管理するのに役立ちます。しかし、このトレンドに乗るために、ゼロから大規模で数年にわたるAI戦略を構築する必要はありません。

成功の鍵は、既存のワークフローに適合する安全で使いやすいプラットフォームを使用することです。適切なツールを使用すれば、小さく始めて価値をすぐに証明し、自信を持ってAIの取り組みを拡大できます。

数分で銀行サポートの自動化を開始する

eesel AIは、銀行にLLMの力をもたらす最速で最も安全な方法です。数分でライブにでき、シミュレーションエンジンでリスクフリーでテストし、データセキュリティとAIの応答を完全に制御できます。完璧なAI戦略を待つのをやめて、今日から価値を提供し始めましょう。

どれほど簡単かを自分で確認し、無料トライアルを開始するか、デモを予約する。

よくある質問

銀行業界向けの専門的なLLMは、セキュリティとプライバシーが確保されているため、根本的に異なります。公共のツールとは異なり、銀行グレードのソリューションは内部の知識にのみ接続し、顧客の機密データが公開モデルのトレーニングに使用されたり、露出したりすることはありません。

主なリスクはデータプライバシーです。一般的なLLMを使用すると、機密の金融情報や顧客情報を第三者のサーバーに送信することが多く、GDPRのようなコンプライアンス規制に違反します。企業向けに構築された安全なプラットフォームは、データを隔離し保護します。

これは、Retrieval-Augmented Generation (RAG)のような機能で対処される正当な懸念です。現代のプラットフォームは、すべての回答を内部のポリシードキュメントの特定の段落にリンクし、明確で信頼できる監査トレイルを作成することで、情報源を引用できます。

最も安全な方法はシミュレーションモードを使用することです。これにより、過去のサポートチケットを数千件にわたって安全なサンドボックスでAIをテストし、実際の顧客と対話する前にどのように応答するか、またその自動化率がどの程度であるかを正確に確認できます。

最良のアプローチは、コーディング不要のプラットフォームで小さく始めることです。内部の繰り返し質問や顧客のFAQに答えるといった特定の高ボリュームの問題に焦点を当てます。これにより、価値を迅速に証明し、より大きなAIプロジェクトのための勢いをつけることができます。

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.