J'ai testé 5 alternatives à Claude Opus 4.5 : Voici la meilleure IA pour le code en 2026

Kenneth Pangan

Katelin Teen

Dernière modification January 6, 2026

Claude Opus 4.5 est un modèle puissant pour le codage intensif et les tâches complexes de type agentique. Cependant, ses capacités ont un coût significatif. Avec des coûts d'API à 5 $ par million de jetons d'entrée et 25 $ par million pour la sortie, les dépenses peuvent s'accumuler rapidement. Pour les développeurs en solo, les petites équipes ou les entreprises soucieuses de leur budget, ce coût peut être un obstacle.

Opus est trop cher maintenant, il aurait vraiment dû être 1,6x. Enfin bon, c'était sympa tant que ça a duré

Cela a conduit à une exploration d'alternatives pratiques offrant un équilibre entre performance et coût. Cet article évalue cinq concurrents de premier plan sur des défis de codage du monde réel, allant de fonctions simples à des projets logiciels complexes multi-fichiers.

Ici, nous allons analyser GPT-5.2 Codex, Gemini 3 Pro, Devstral 2, GLM-4.7 et MiniMax M2.1. Cette comparaison vise à vous aider à sélectionner le bon partenaire IA pour votre flux de travail (workflow) et votre budget.

Qu'est-ce que Claude Opus 4.5 et pourquoi envisager des alternatives ?

Opus 4.5 est considéré comme un modèle de premier plan, particulièrement pour les développeurs professionnels. Il obtient de bons résultats sur les benchmarks de codage, avec un score impressionnant de 80,9 % sur SWE-bench Verified, et sa fenêtre de contexte (context window) massive de 200K lui permet de gérer des tâches longues et complexes sans dégradation des performances. Ses nouvelles capacités de raisonnement hybride sont également d'une grande aide pour les problèmes particulièrement épineux.

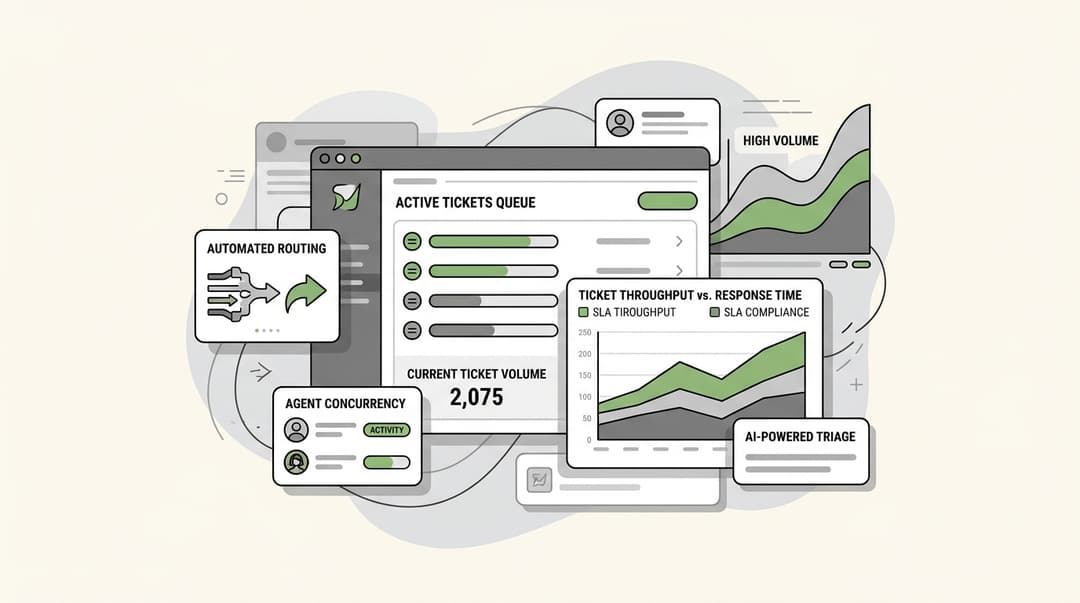

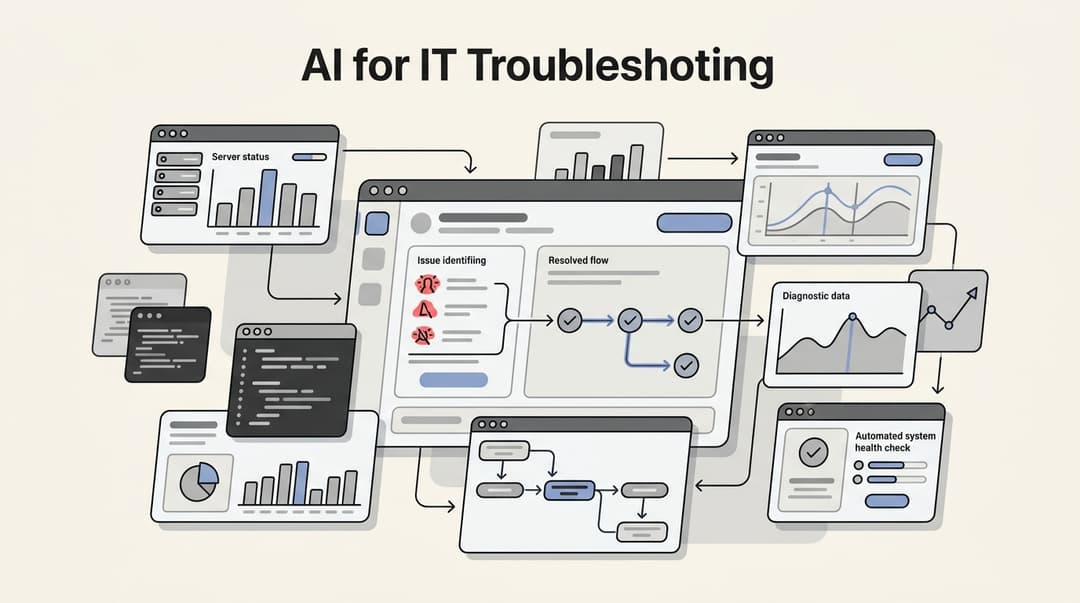

Cela nous amène à la raison principale d'envisager des alternatives : le coût. Les tarifs de l'API sont plus élevés que ceux de bon nombre de ses concurrents. Bien que le modèle soit puissant, ces coûts peuvent grimper rapidement, surtout si vous exécutez de nombreux flux de travail agentiques ou des tâches à gros volume. Cette structure tarifaire peut être une considération pour les équipes gérant des tâches massives. Cette infographie illustre le compromis entre ses capacités haut de gamme et son coût premium, une raison clé de l'exploration des alternatives à Claude Opus 4.5.

Critères d'évaluation des alternatives à Claude Opus 4.5

Choisir une alternative appropriée implique plus que de simplement sélectionner le modèle ayant les mesures de performance les plus élevées. Cela nécessite un équilibre de facteurs clés qui impactent les flux de travail de développement quotidiens. Voici ce que j'ai examiné :

-

Performance de codage et de raisonnement : Quelle est sa réelle efficacité pour coder ? Je parle de tâches d'ingénierie logicielle complexes et multi-fichiers. Pour rester objectif, je me réfère aux scores de benchmarks respectés comme SWE-bench Verified et Terminal-Bench 2.0.

-

Intégration du flux de travail : Comment s'intègre-t-il réellement dans votre configuration ? S'agit-il d'une intégration fluide dans un IDE (environnement de développement intégré) comme VS Code, ou est-ce plutôt un outil en ligne de commande ? Moins il y a de frictions, mieux c'est.

-

Rentabilité : J'ai comparé le coût par million de jetons pour évaluer la valeur globale et identifier les solutions rentables.

-

Flexibilité et contrôle : L'alternative prend-elle en charge les modèles à poids ouverts (open-weight) que vous pouvez exécuter localement pour une meilleure confidentialité, personnalisation et contrôle ?

Une comparaison des meilleures alternatives à Claude Opus 4.5

Ce tableau fournit une comparaison de haut niveau des spécifications clés de chaque modèle.

| Modèle | Force principale | SWE-Bench Verified | Fenêtre de contexte | Coût (Entrée/Sortie par 1M de jetons) |

|---|---|---|---|---|

| GPT-5.2 Codex | Codage agentique & cybersécurité | 80,0 % | 128K | 1,75 $ / 14,00 $ |

| Gemini 3 Pro | Multimodal & contexte long | 74,2 % | Jusqu'à 2M | Via Google AI Studio |

| Devstral 2 | Poids ouverts & focus agentique | 53,8 % | 32K | Via Mistral Platform |

| GLM-4.7 | "Deep Thinking" & rentabilité | 73,8 % | 205K | 0,60 $ / 2,20 $ |

| MiniMax M2.1 | Multi-langage & génération d'UI | 61,0 % (M2) | ~200K | 0,30 $ / 1,20 $ |

Les 5 meilleures alternatives à Claude Opus 4.5 en 2026

Chacun de ces modèles possède des forces uniques, et le choix idéal dépend de vos exigences de projet spécifiques et de vos priorités.

1. GPT-5.2 Codex

GPT-5.2 Codex est le modèle d'OpenAI conçu spécifiquement pour l'ingénierie logicielle professionnelle. Il est adapté aux tâches exigeantes comme les refactorisations (refactors) à grande échelle, les migrations complexes et les tâches de cybersécurité défensive.

Il est extrêmement performant, atteignant un score impressionnant de 80,0 % sur SWE-bench Verified et 64,0 % sur Terminal-Bench 2.0. Ses capacités de vision sont également excellentes, ce qui signifie qu'il peut interpréter des designs d'UI et des diagrammes techniques avec facilité. Son principal avantage réside dans son raisonnement solide et sa fiabilité pour les flux de travail professionnels étendus. En tant que modèle propriétaire, il ne peut être ni personnalisé ni exécuté localement. Bien qu'il soit plus abordable qu'Opus 4.5, il reste une option au tarif premium.

Gpt4o semble ivre et ignore des détails importants pour se contenter de recracher du code. Je le corrige encore, puis encore, puis encore, et là nous avons peut-être une solution.

Côté tarifs, il est disponible via une API à 1,75 $ par million de jetons d'entrée et 14,00 $ pour la sortie. Cela en fait une option plus rentable que Claude pour des tâches comparables.

Idéal pour : Les développeurs professionnels et les équipes d'entreprise travaillant sur des bases de code critiques à grande échelle qui ont besoin d'un partenaire de codage fiable et intelligent.

2. Gemini 3 Pro

Gemini 3 Pro est la proposition de Google dans l'espace du codage par IA, et ses caractéristiques phares sont ses capacités multimodales natives et sa grande fenêtre de contexte.

Ce modèle peut comprendre des vidéos et des images en même temps que votre code, ce qui est une fonctionnalité unique et utile pour certains types de développement. Il a obtenu un score très compétitif de 74,2 % sur SWE-bench Verified, et certaines analyses suggèrent qu'il est particulièrement bon pour les tâches qui nécessitent que l'intégralité du projet soit maintenue en contexte. Ses principaux atouts sont sa rapidité et sa compréhension visuelle, ce qui en fait un choix fantastique pour le travail UI/UX ou l'analyse de ressources visuelles. Sa tarification API est intégrée aux plateformes cloud de Google, ce qui peut différer des modèles de tarification autonomes d'autres fournisseurs.

Vous pouvez y accéder via Google AI Studio et Vertex AI. Pour un usage individuel, il est disponible via le plan Gemini Advanced.

Idéal pour : Les développeurs travaillant sur des applications multimédias, les designers UI/UX, ou toute personne ayant besoin de traiter des entrées visuelles aux côtés du code à grande vitesse.

3. Devstral 2

Devstral 2 de Mistral AI est un modèle de pointe conçu spécifiquement pour l'ingénierie logicielle agentique, en mettant l'accent sur les principes de l'open-source.

Il a été conçu pour les agents de codage et il est performant pour un modèle à poids ouverts, obtenant 53,8 % sur SWE-bench Verified. Il s'intègre également aux IDE populaires comme VSCode et JetBrains, s'insérant ainsi parfaitement dans les flux de travail existants. Un avantage clé est sa nature ouverte et personnalisable. Vous avez plus de contrôle et pouvez même l'auto-héberger pour des raisons de confidentialité ou de performance. En tant qu'outil spécialisé, son écosystème est moins mature que celui des plus grands fournisseurs, et ses scores de benchmark sont actuellement inférieurs à certains des meilleurs modèles propriétaires.

Il est disponible en tant que modèle à poids ouverts pour l'auto-hébergement ou vous pouvez y accéder via la plateforme de Mistral et ses partenaires comme AWS, Azure et Google Cloud.

Idéal pour : Les développeurs qui aiment la ligne de commande, veulent un agent IA open-source, ou ont besoin d'exécuter un modèle puissant localement pour la confidentialité et le contrôle.

4. GLM-4.7

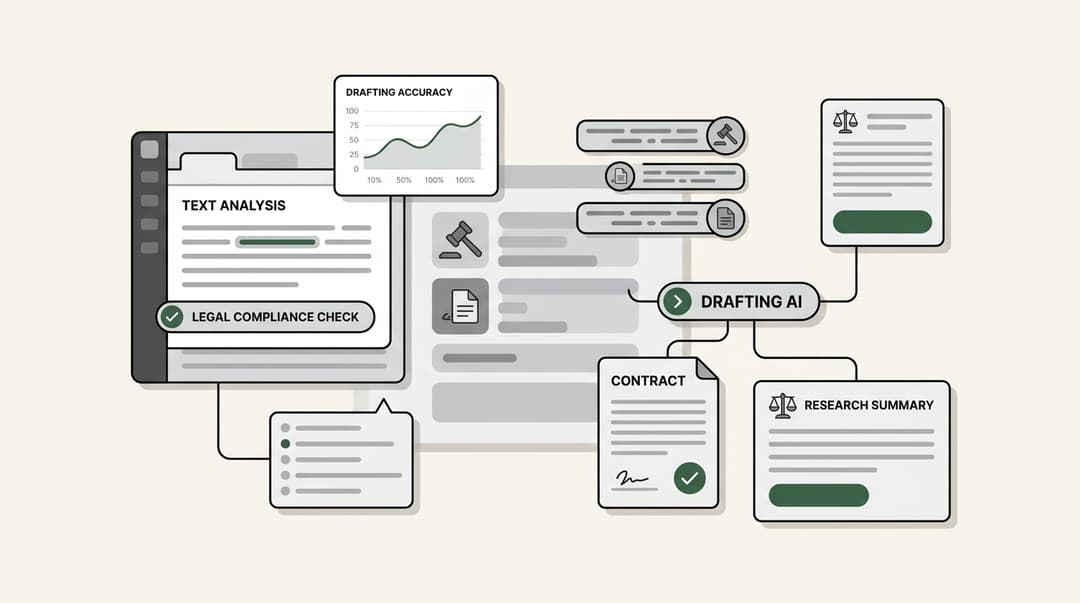

Le GLM-4.7 de Zhipu AI peut être décrit comme un modèle de « réflexion ». Il dispose d'une fonctionnalité qui lui permet de raisonner sur un problème avant de générer une solution, ce qui peut conduire à un code plus robuste et logique.

Son mode « Deep Thinking » peut être activé dans l'API pour améliorer la stabilité sur les tâches à long terme. Il affiche de bons chiffres, avec un score de 73,8 % sur SWE-Bench, et est doté d'une généreuse fenêtre de contexte de 205K. Il dispose également de fonctionnalités spécifiquement optimisées pour générer des interfaces utilisateur propres et modernes. L'avantage clé est cette étape de raisonnement explicite, qui aide dans les flux de travail complexes à étapes multiples. Ce processus peut ajouter de la latence, mais le processus de réflexion peut être diffusé (streaming) pour réduire l'attente perçue.

Le tarif est très compétitif. Il est très rentable à seulement 0,60 $ par million de jetons d'entrée et 2,20 $ pour la sortie.

Idéal pour : Les équipes créant des agents IA complexes et les développeurs travaillant sur des problèmes de codage délicats à étapes multiples où la cohérence logique est plus importante que la vitesse pure.

5. MiniMax M2.1

MiniMax M2.1 est un modèle hautement efficace. Il excelle dans la programmation multi-langage et la génération UI/UX tout en étant l'une des options les plus abordables du marché.

Il dispose d'un support amélioré pour des langages au-delà du simple Python, notamment Rust, Java, Go et C++. Sa fonctionnalité « Vibe Coding » est utile pour générer des interfaces utilisateur de haute qualité, et il propose des poids open-source pour un déploiement local. Il propose même un format d'API compatible Anthropic pour simplifier la migration. Ses principaux avantages sont son rapport performance/prix et son solide support multi-langage. En tant que modèle MoE (Mélange d'Experts) efficace, il est très rapide, bien qu'il puisse ne pas égaler la puissance de raisonnement de modèles plus grands sur des problèmes très profonds et à sujet unique. Il a obtenu un solide 61,0 % sur SWE-bench.

Le tarif est très compétitif, à seulement 0,30 $ par million de jetons d'entrée et 1,20 $ pour la sortie, offrant des capacités significatives à un coût inférieur à celui des modèles premium.

Idéal pour : Les développeurs full-stack travaillant dans plusieurs langages de programmation, les ingénieurs frontend axés sur l'UI/UX, et toute équipe recherchant une solution puissante, rentable et auto-hébergeable.

Pour ceux qui souhaitent voir ces modèles en action, cette vidéo propose une comparaison pratique et examine quelles alternatives pourraient être les meilleures en fonction de vos besoins spécifiques en matière de codage.

Comment choisir le bon assistant IA

Il n'existe pas de modèle unique « idéal » pour tous les cas d'utilisation. Le bon choix dépend de la tâche spécifique. Pour la complexité de niveau entreprise, GPT-5.2 est une option adaptée. Pour la rapidité et les flux de travail visuels, Gemini est un choix solide. Pour les utilisateurs qui privilégient le contrôle et les modèles open-source, Devstral est une option viable, et pour les utilisateurs soucieux de leur budget, GLM-4.7 et MiniMax M2.1 offrent une excellente valeur.

Une pratique recommandée consiste à utiliser le bon outil pour le bon travail. Ces assistants de codage polyvalents sont efficaces pour écrire du code. Cependant, le travail d'un développeur s'étend au-delà du codage. Vous devez également rédiger de la documentation, créer des articles de blog pour annoncer de nouvelles fonctionnalités et répondre aux questions de votre communauté. Pour les tâches liées au contenu, un outil spécialisé peut être plus efficace.

Par exemple, alors qu'un assistant de codage par IA est utilisé pour construire une application, un outil comme l'eesel AI Blog Writer peut être utilisé pour générer des annonces de lancement et de la documentation technique à partir d'un seul mot-clé. De tels outils sont conçus pour créer du contenu optimisé pour le SEO (référencement), permettant aux assistants de codage d'être utilisés pour leur but premier : écrire du code.

Réflexions finales : Une approche hybride des assistants de codage par IA

Le paysage du codage par IA en 2026 est riche et diversifié. Se reposer sur un seul modèle à coût élevé comme Claude Opus 4.5 n'est peut-être pas nécessaire ou rentable pour tous les utilisateurs.

Un flux de travail efficace est souvent hybride. Cela implique d'utiliser une « chaîne de modèles » ou une approche multi-outils. Utilisez un modèle puissant comme GPT-5.2 pour la planification architecturale, un modèle rapide comme Gemini pour l'itération frontend, et un modèle rentable comme MiniMax pour les tâches de routine.

Je prends souvent une réponse d'Opus ou de Gemini Advanced et je la soumets ensuite à GPT 4 en lui demandant d'évaluer la précision de l'autre IA. Ensuite, il corrige le code ou quoi que ce soit d'autre, et je le ramène à Claude qui s'excuse souvent et me traite comme si j'étais une sorte de génie parce que « j'ai » trouvé une meilleure façon de le faire.

Créer des logiciels nécessite à la fois du codage et de la communication. Si ces assistants IA peuvent améliorer le développement, d'autres outils comme eesel AI peuvent aider pour les besoins de communication. Qu'il s'agisse de répondre à des questions internes avec notre IA Chat Interne ou de créer tout votre contenu destiné aux clients avec notre IA Blog Writer, vous pouvez couvrir tous vos besoins.

Questions fréquemment posées

Pour les startups ayant un budget limité, GLM-4.7 et MiniMax M2.1 sont d'excellents choix. Ils offrent des performances impressionnantes à une fraction du coût des modèles premium, avec un tarif d'API aussi bas que 0,30 $ par million de jetons d'entrée (tokens).

Absolument. Devstral 2 est un puissant modèle à poids ouverts (open-weight) conçu à cet effet. Vous pouvez l'exécuter sur votre propre infrastructure, ce qui vous donne un contrôle total sur vos données et votre vie privée. MiniMax M2.1 propose également des poids open-source pour un déploiement local.

Si la performance sur des tâches complexes de niveau entreprise est votre priorité absolue, GPT-5.2 Codex est très performant. Il obtient des scores presque aussi élevés qu'Opus 4.5 sur des benchmarks comme SWE-bench Verified et est conçu pour l'ingénierie logicielle intensive.

Oui, Gemini 3 Pro se distingue ici. Ses capacités multimodales natives lui permettent de traiter des vidéos et des images aux côtés du code, ce qui le rend parfait pour le travail UI/UX ou tout développement impliquant des ressources visuelles.

MiniMax M2.1 est une excellente option si vous travaillez avec plusieurs langages. Il bénéficie d'un support amélioré pour des langages comme Rust, Java, Go et C++, ce qui en fait un choix polyvalent pour les développeurs full-stack.

Share this article

Article by

Kenneth Pangan

Rédacteur et marketeur depuis plus de dix ans, Kenneth Pangan partage son temps entre l'histoire, la politique et l'art, avec de nombreuses interruptions de ses chiens réclamant de l'attention.

La meilleure approche consiste à adapter l'outil à la tâche. Envisagez un modèle hybride : utilisez un modèle haute performance comme GPT-5.2 pour l'architecture complexe, un modèle rapide comme Gemini 3 Pro pour le frontend, et un modèle rentable comme MiniMax M2.1 pour le code de routine.