Es scheint, als würde fast jede zweite Woche ein neues, umwerfendes KI-Modell auf den Markt kommen. Für Unternehmen, die herausfinden wollen, wie sie diese Technologie tatsächlich nutzen können, ist es schwierig, den Überblick zu behalten. Der gesamte Bereich wird im Moment im Wesentlichen von drei großen Akteuren beherrscht: OpenAI, Anthropic und Google. Wenn Sie darüber nachdenken, KI in Ihrem Unternehmen einzusetzen, insbesondere für etwas so Wichtiges wie den Kundensupport, ist die Wahl der richtigen API eine enorm wichtige Entscheidung.

Dieser Leitfaden soll Ihnen helfen, den Überblick zu behalten. Wir werden diese Plattformen anhand dessen vergleichen, was für ein Unternehmen wirklich zählt: wie gut sie funktionieren, was sie kosten und wie aufwendig sie einzurichten sind. Wir werden uns ansehen, was diese reinen Modelle von sich aus können, und dann werden wir über einen praktischeren Weg sprechen, KI für Sie arbeiten zu lassen.

Ein Überblick über die führenden KI-Modell-APIs

Lassen Sie uns zunächst kurz klären, worüber wir sprechen. Eine API (Application Programming Interface, Anwendungsprogrammierschnittstelle) ist im Grunde eine Brücke, die es Entwicklern ermöglicht, ihre eigene Software mit diesen leistungsstarken KI-Modellen zu verbinden. Wenn Sie also die OpenAI API vs. Anthropic API vs. Gemini API vergleichen, betrachten Sie die Engines, die Tausende verschiedener KI-Tools antreiben.

Was ist die OpenAI API?

Wenn Sie jemals ChatGPT verwendet oder einen Entwickler über GitHub Copilot schwärmen gesehen haben, haben Sie die Arbeit von OpenAI gesehen. Sie waren die ersten, die die Aufmerksamkeit der Öffentlichkeit wirklich auf sich zogen, und ihre API-Plattform ist die etablierteste und am weitesten verbreitete. Ihre GPT-Modelle, wie GPT-4.1 und GPT-4o, sind dafür bekannt, dass sie großartige Allrounder sind, die solide in Bezug auf Argumentation, Programmierung und allgemeine Konversation sind. Da es sie schon am längsten gibt, gibt es eine riesige Community von Entwicklern, was bedeutet, dass Sie ein Tutorial für so ziemlich alles finden können.

Was ist die Anthropic API?

Anthropic wurde von ehemaligen OpenAI-Forschern gegründet, die KI mit Sicherheit als oberste Priorität entwickeln wollten. Ihre Modelle sind alle nach Claude benannt, wobei Claude 4 Opus und Sonnet die derzeitigen Schwergewichte sind. Die Anthropic API ist aus ein paar guten Gründen bei größeren Unternehmen beliebt geworden: Sie ist hervorragend darin, lange Dokumente zu verarbeiten und darüber nachzudenken, sie ist so konzipiert, dass sie zuverlässiger ist und weniger wahrscheinlich Fakten erfindet, und ihre integrierten Sicherheitsfunktionen machen sie zu einer sicheren Wahl für Unternehmen in regulierten Bereichen.

Was ist die Google Gemini API?

Gemini ist Googles Einstieg in das KI-Rennen und wurde von Anfang an als "nativ multimodal" konzipiert. Das bedeutet lediglich, dass es bei der Google Gemini API nicht nur um Text geht, sondern dass sie Bilder, Videos und Audio verstehen kann, ohne ins Schwitzen zu geraten. Sie verfügt über ein riesiges Kontextfenster (darauf kommen wir gleich) und ist eng mit anderen Google-Produkten wie Google Cloud und Workspace verwoben. Sie ist ein wirklich starker Kandidat für Unternehmen, die bereits Google-Tools verwenden oder etwas bauen wollen, das über reine Worte hinausgeht.

Vergleich der Kernfähigkeiten und der Leistung

Okay, genug mit den Definitionen. Lassen Sie uns nun vergleichen, wie diese APIs tatsächlich bei den Funktionen abschneiden, die für Ihr Projekt wichtig sind.

Warum ein größeres Kontextfenster nicht immer besser ist

Sie werden den Begriff "Kontextfenster" oft hören. Es ist lediglich der Fachbegriff dafür, wie viele Informationen ein Modell in einem einzigen Gespräch in seinem Kurzzeitgedächtnis speichern kann. Es wird in "Tokens" gemessen, wobei etwa 1.000 Tokens 750 Wörtern entsprechen.

Sowohl Google Gemini als auch die neuesten OpenAI-Modelle behaupten, riesige Kontextfenster mit über 1.000.000 Tokens zu haben. Das klingt unglaublich, oder? Man könnte sie mit einem ganzen Buch füttern. Aber es gibt einen Haken. Die Leistung des Modells ist nicht immer über das gesamte Fenster stabil. Tests haben gezeigt, dass die Genauigkeit einbrechen kann, wenn Sie die Obergrenzen ausreizen. Es ist ein bisschen so, als würde man in einem überfüllten Raum zuhören: Je mehr man versucht, auf einmal aufzunehmen, desto schwieriger ist es, sich auf das Wesentliche zu konzentrieren.

Anthropic's Claude geht die Sache etwas anders an. Es bietet ein 200.000-Token-Fenster, das immer noch riesig ist und problemlos ein 150.000 Wörter umfassendes Dokument verarbeiten kann. Der Schlüssel ist, dass seine Leistung von Anfang bis Ende bemerkenswert konstant ist. Für die meisten geschäftlichen Anforderungen, wie z. B. die Analyse eines langen Support-Threads oder eines Vertrags, ist diese Art von Zuverlässigkeit viel nützlicher als ein rekordverdächtiges, aber manchmal fehlerhaftes Kontextfenster.

Mehr als nur Text verarbeiten

Multimodalität bedeutet lediglich die Fähigkeit, verschiedene Arten von Informationen zu verarbeiten, nicht nur Text. Hier sticht Google's Gemini wirklich heraus. Es wurde entwickelt, um Bilder, Audio und sogar Video zu verarbeiten. Stellen Sie sich eine Kundensupportsituation vor, in der jemand einfach ein Foto eines defekten Produkts oder ein kurzes Video eines Fehlercodes senden könnte. Gemini ist genau dafür konzipiert.

OpenAI's GPT-4o ist in diesem Bereich ebenfalls sehr gut geworden und kann Bilder und Audio sehr gut verarbeiten. Anthropic hat sich zwar verbessert, konzentriert sich aber in der Vergangenheit stärker auf die Perfektionierung der textbasierten Argumentation, sodass es normalerweise nicht die erste Wahl für sehr visuelle oder audioabhängige Aufgaben ist.

Function Calling: KI dazu bringen, mit Ihren Systemen zu kommunizieren

Dies ist wahrscheinlich die wichtigste Funktion für jeden realen geschäftlichen Anwendungsfall. "Function Calling" oder "Tool Use (Werkzeugnutzung)" ermöglicht es einer KI, tatsächlich Dinge zu tun, anstatt nur zu reden. So kann eine KI den Bestellstatus in Shopify überprüfen, ein Ticket in Zendesk aktualisieren oder die Zahlungshistorie eines Kunden aus Ihrer Datenbank abrufen.

Alle drei APIs können dies tun, aber sie haben jeweils ihren eigenen Stil. OpenAI ist großartig darin, mehrere Anfragen gleichzeitig zu bearbeiten, was es schnell macht. Claude ist besser darin, mehrstufige Aufgaben nacheinander abzuarbeiten, und er ist besonders gut darin, seinen Denkprozess zu erklären, was bei der Fehlersuche hilfreich ist.

Das Problem? Das selbst einzurichten ist ein großes technisches Projekt. Sie müssen jedes Tool definieren, die Hin- und Herkommunikation abwickeln, Fehler verwalten und die Ergebnisse korrekt an das Modell zurückmelden. Das ist eine enorme Aufgabe, weshalb viele Teams Plattformen wie eesel AI verwenden, die all diese Komplexität über einen einfachen Workflow-Builder (Workflow-Ersteller) für Sie abwickeln.

Die geschäftliche Realität: Preise und Implementierung

Okay, nun zu den beiden Fragen, die jeden Unternehmensleiter wirklich interessieren: "Wie viel wird das kosten?" und "Wie schwierig ist es, das zum Laufen zu bringen?"

Eine detaillierte Preisaufschlüsselung

Alle drei Plattformen berechnen Ihnen die Kosten basierend auf der Anzahl der verwendeten Tokens. Sie zahlen für die Daten, die Sie an das Modell senden (Eingabe), und für die Daten, die es generiert (Ausgabe). Das klingt einfach, kann aber Ihre monatliche Rechnung wirklich unvorhersehbar machen. Ein arbeitsreicher Monat für Ihr Support-Team könnte zu einer überraschend hohen Rechnung führen.

Hier ist eine grobe Vorstellung davon, wie ihre Preise für ihre beliebtesten Modelle aussehen. Diese Zahlen ändern sich, aber die allgemeinen Kostenunterschiede bleiben in der Regel gleich.

| Anbieter | Modell | Eingabepreis (pro 1 Mio. Tokens) | Ausgabepreis (pro 1 Mio. Tokens) | Am besten geeignet für |

|---|---|---|---|---|

| OpenAI | GPT-4.1 | 2,00 $ | 8,00 $ | Hochleistungsfähige, allgemeine Aufgaben |

| GPT-4.1 mini | 0,40 $ | 1,60 $ | Ausgewogene Leistung und Kosten | |

| GPT-4.1 nano | 0,10 $ | 0,40 $ | Hohes Volumen, Aufgaben mit niedriger Latenz | |

| Anthropic | Claude 4 Opus | 15,00 $ | 75,00 $ | Komplexe Argumentation, Programmierung |

| Claude 4 Sonnet | 3,00 $ | 15,00 $ | Ausgewogene Unternehmensaufgaben | |

| Claude 3 Haiku | 0,25 $ | 1,25 $ | Schnelle Aufgaben mit hohem Volumen | |

| Gemini 2.5 Pro | 1,25 $ | 10,00 $ | Fortschrittliche Multimodalität, langer Kontext | |

| Gemini 2.5 Flash | 0,15 $ | 0,60 $ | Schnelle, kostengünstige Aufgaben |

Die Preisangaben sind korrekt ab Ende 2024 und basieren auf öffentlich zugänglichen Daten.

Die Einrichtung: Die Herausforderung bei der Implementierung

Wenn es um Entwicklerressourcen geht, hat OpenAI mit einer Menge Dokumentation und Community-Foren die Nase vorn. Wenn Ihr Unternehmen bereits auf Google Cloud läuft, wird sich die Anbindung an Gemini natürlich anfühlen. Anthropic holt mit einer ausgezeichneten, übersichtlichen Dokumentation für seine API schnell auf.

Aber hier ist der Realitätscheck: Für ein Support-Team, das nur einen Teil seiner Arbeit automatisieren möchte, ist keine dieser APIs einfach zu bedienen. Die direkte Integration mit einer API bedeutet, dass Sie Entwickler benötigen. Sie brauchen Leute, die den Code schreiben, die Server verwalten, die Prompts (Eingabeaufforderungen) optimieren und sicherstellen, dass nichts kaputt geht. Es ist eine ernsthafte, fortlaufende Investition von Zeit und Geld.

Die intelligentere Wahl: Warum Sie eine Plattform benötigen

Nach alledem stellen Sie vielleicht fest, dass die Debatte über die Feinheiten der OpenAI API vs. Anthropic API vs. Gemini API die falsche Frage ist. Die eigentliche Herausforderung besteht nicht nur darin, ein Modell auszuwählen, sondern dieses Modell in ein Werkzeug zu verwandeln, das Ihrem Unternehmen tatsächlich hilft.

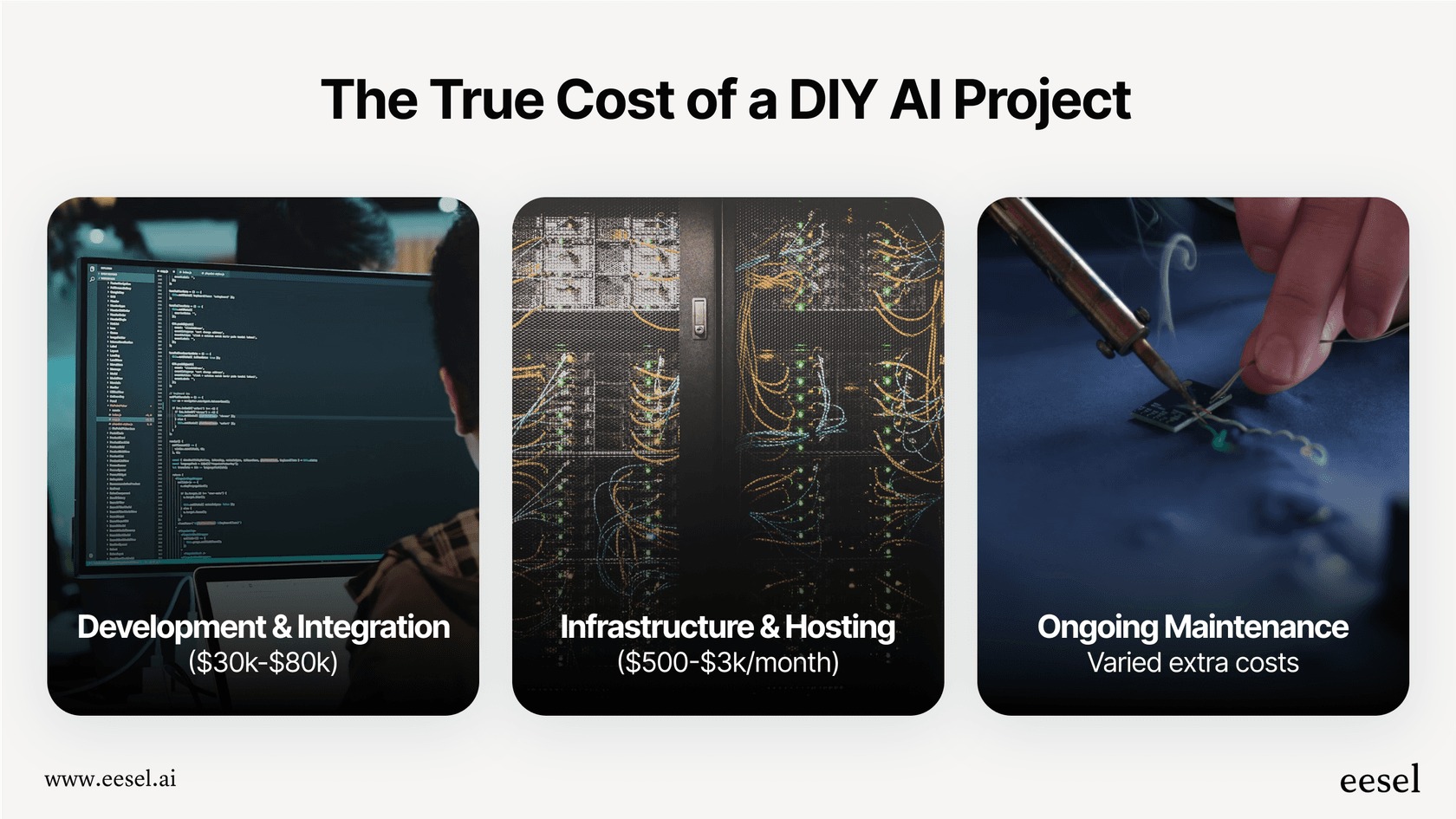

Die versteckten Kosten, wenn Sie es selbst bauen

Der DIY-Ansatz klingt in der Theorie großartig, ist aber voll von versteckter Arbeit und Risiken:

-

Zeit und Personal: Einen soliden KI-Agenten für Ihren Helpdesk zu bauen, ist nichts, was man an einem Wochenende erledigt. Es kann leicht ein paar Ingenieure Monate kosten, etwas Zuverlässiges zu bauen, zu testen und einzusetzen.

-

So viel Komplexität: Plötzlich sind Sie für alles verantwortlich. Die richtigen Prompts (Eingabeaufforderungen) zu finden, das Wissen von verschiedenen Orten zu synchronisieren, Workflows zu erstellen, eine Schnittstelle zu entwerfen und die Ergebnisse zu verfolgen, landet alles auf Ihrem Tisch.

-

Eine riskante Wette: Woher wissen Sie überhaupt, ob Ihre individuelle Lösung gut funktionieren wird? Es ist schwierig, sie in realen Szenarien zu testen, bevor Sie sie live mit Ihren Kunden schalten. Sie bauen im Wesentlichen im Dunkeln.

-

Festgefahren sein: Wenn Sie Ihr gesamtes System um eine API herum aufbauen, sind Sie daran gebunden. Was passiert, wenn ein Konkurrent ein Modell herausbringt, das besser oder billiger ist? Ein Wechsel kann fast so viel Arbeit sein wie ein Neuanfang.

Wie eesel AI alles vereinfacht

Genau dieses Problem sollte eine Plattform wie eesel AI lösen. Sie gibt Ihnen die Leistung dieser KI-Modelle ohne den massiven technischen Aufwand.

-

In wenigen Minuten loslegen, nicht in Monaten: Sie müssen sich nicht mit langen Entwicklungsprojekten herumschlagen. eesel AI verfügt über One-Click-Integrationen mit Helpdesks wie Zendesk, Freshdesk und Intercom. Sie können alles selbst einrichten, ohne mit einem Verkäufer sprechen zu müssen.

-

Volle Kontrolle, kein Code erforderlich: Sie erhalten die Flexibilität eines kundenspezifischen Tools, aber über eine einfache Schnittstelle. Sie können den Prompt Editor (Eingabeaufforderungseditor) verwenden, um die Persönlichkeit Ihrer KI zu formen, benutzerdefinierte Workflows zu erstellen und sich mit AI Actions (KI-Aktionen) mit Ihren Tools zu verbinden, alles ohne Entwickler.

-

Mit Zuversicht testen: Das ist ein wichtiger Punkt. Der Simulationsmodus in eesel AI ermöglicht es Ihnen, Ihr Setup an Tausenden Ihrer eigenen vergangenen Support-Tickets zu testen. Sie können genau sehen, wie es geantwortet hätte, eine Prognose Ihrer Automatisierungsrate erhalten und seine Leistung anpassen, bevor es jemals mit einem Kunden spricht. Es nimmt dem Prozess alle Rätselraten.

-

Vorhersehbare Preise: Anstelle des wilden Ritts der Token-basierten Abrechnung bietet eesel AI transparente Pläne. Sie wissen genau, was Sie jeden Monat bezahlen, und es gibt keine Gebühren pro Lösung, die Ihnen für den Erfolg mehr berechnen.

Konzentrieren Sie sich auf die Lösung, nicht auf das Tool

Während OpenAI, Anthropic und Gemini alle erstaunliche Technologien anbieten, sind sie genau das: Technologien. Für die meisten Unternehmen ist es eine Ablenkung vom eigentlichen Ziel, sich in einen technischen Vergleich ihrer APIs zu verstricken.

Wenn Sie Kundenprobleme schneller lösen und Ihr Support-Team entlasten wollen, ist die bessere Frage, wie Sie das mit dem geringsten Zeitaufwand, Risiko und Kosten erreichen können. Eine KI-Plattform kümmert sich um die Komplexität der Auswahl und Verwaltung von Modellen, sodass Sie sich auf das konzentrieren können, was Sie gut können: großartige Support-Workflows zu entwerfen und sich um Ihre Kunden zu kümmern.

Sind Sie bereit zu sehen, wie eine KI-Plattform Ihrem Support-Team ohne den technischen Overhead helfen kann? Richten Sie Ihren ersten KI-Agenten mit eesel AI in wenigen Minuten ein.

Häufig gestellte Fragen

Der wichtigste Faktor ist nicht nur die reine Modellleistung, sondern die praktische Implementierung und Zuverlässigkeit. Überlegen Sie, wie einfach Sie die API integrieren, die laufende Entwicklung verwalten und konsistente, genaue Ergebnisse für Ihre [spezifischen Geschäftsabläufe](https://www.eesel.ai/blog/a-practical-guide-to-mastering-ai-and-automation-in-customer-support) und Kundeninteraktionen erzielen können.

Alle drei Plattformen verwenden ein [Token-basiertes Preismodell](https://openai.com/pricing), bei dem sowohl Eingabe als auch Ausgabe berechnet werden, was die monatlichen Kosten unvorhersehbar machen kann. OpenAI bietet im Allgemeinen wettbewerbsfähige Preise, Anthropic's Opus kann für seine fortschrittliche Argumentation teurer sein, und Google Gemini ist wettbewerbsfähig, insbesondere mit seinem kostengünstigen Flash-Modell.

Die direkte Implementierung einer dieser APIs für komplexe Geschäftsaufgaben, wie z. B. die [Automatisierung eines Kundensupport-Desks](https://www.eesel.ai/solution/ai-service-desk), erfordert einen erheblichen technischen Aufwand. Ein kleines Team stünde vor großen Herausforderungen beim Schreiben von Code, der Verwaltung von Prompts (Eingabeaufforderungen), der Fehlerbehandlung und der effektiven Integration in bestehende Systeme.

Google Gemini wurde von Anfang an für native Multimodalität entwickelt und zeichnet sich durch das Verständnis von Bildern, Videos und Audio aus. OpenAI's GPT-4o ist ebenfalls sehr kompetent im Umgang mit Bildern und Audio geworden. Anthropic hat sich in der Vergangenheit stärker auf fortgeschrittene textbasierte Argumentation konzentriert, obwohl sich seine multimodalen Fähigkeiten verbessern.

Während Gemini und neuere OpenAI-Modelle sehr große Kontextfenster beanspruchen, kann ihre Genauigkeit an den höchsten Grenzen manchmal abnehmen. Anthropic's Claude bietet mit einem 200.000-Token-Fenster eine bemerkenswert konsistente Leistung über den gesamten Bereich und ist daher sehr zuverlässig für die Aufnahme langer Dokumente, ohne den Fokus zu verlieren.

Eine Plattform wie eesel AI vereinfacht den gesamten Prozess, indem sie die Komplexität der direkten API-Integration, des Prompt Engineerings und des Infrastrukturmanagements abstrahiert. Dies reduziert die Entwicklungszeit erheblich, beseitigt versteckte Kosten und ermöglicht es Unternehmen, [robuste KI-Lösungen schnell](https://www.eesel.ai/blog/how-to-create-an-ai-helpdesk-with-eesel-ai) und mit vorhersehbarer Preisgestaltung bereitzustellen.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.