Tudo movido por voz parece ser o novo normal, desde assistentes de reunião que anotam notas para você até comandos de voz que cuidam da sua lista de compras. Mas a tecnologia por trás de tudo isso pode parecer um pouco uma sopa de letrinhas. Você ouvirá frequentemente sobre as APIs Whisper e Text-to-Speech (TTS) da OpenAI e, embora pareçam relacionadas, elas realmente fazem trabalhos opostos.

Descobrir a diferença é muito importante para quem deseja construir aplicativos com recursos de voz ou apenas fazer seus negócios funcionarem um pouco mais suavemente com IA. Este guia explicará exatamente o que as APIs Whisper e TTS fazem, como elas são diferentes, como elas atuam juntas e ajudará você a descobrir qual delas você realmente precisa.

O núcleo de Whisper vs API TTS: Voz para texto vs texto para voz

Antes de entrarmos em uma comparação direta, vamos entender o básico. Essas duas tecnologias são realmente apenas dois lados da mesma moeda: uma é para ouvir e a outra é para falar.

O que é OpenAI Whisper?

OpenAI Whisper é o que é conhecido como um modelo de voz para texto (speech-to-text - STT). Seu trabalho é pegar áudio falado e transformá-lo em texto escrito. Simples assim.

Foi treinado em impressionantes 680.000 horas de áudio de toda a web, e é por isso que é tão bom em entender diferentes sotaques, filtrar o ruído de fundo e até mesmo captar jargões técnicos. Ele pode transcrever 98 idiomas diferentes e até mesmo traduzir muitos deles para o inglês. Você pode obtê-lo como um modelo de código aberto para executar em seu próprio hardware ou usar a API paga, que é muito mais fácil de integrar em seus projetos.

Basicamente, o Whisper é os "ouvidos" de um sistema de IA.

O que é uma API TTS?

Uma API de Texto para Voz (Text-to-Speech - TTS) faz o completo oposto. Ela pega texto escrito e o transforma em áudio falado. A OpenAI tem sua própria API TTS que pode criar vozes com som muito humano a partir de um bloco de texto. Esses sistemas são projetados para soar natural, com o tipo certo de ritmo e tom que você esperaria de uma pessoa.

Você pode pensar em uma API TTS como a "voz" de um sistema de IA. É a tecnologia que permite que seu GPS lhe dê instruções passo a passo, seu telefone leia um artigo em voz alta ou um assistente de IA lhe dê uma resposta verbal.

Como as APIs Whisper e TTS funcionam juntas

Aqui está a principal coisa que as pessoas entendem errado em todo o debate "Whisper vs API TTS": você não escolhe um em vez do outro. Eles são colaboradores. Você os usa em diferentes pontos de um processo para criar um loop de conversa completo.

Digamos que você esteja construindo um assistente de voz. Veja como os dois se uniriam:

-

Você fala: Você faz uma pergunta, como: "Quais são seus horários de funcionamento?"

-

Whisper ouve: O sistema captura o áudio e o Whisper o transcreve em uma string de texto simples: "Quais são seus horários de funcionamento?"

-

O aplicativo pensa: Seu aplicativo (ou um modelo de linguagem grande) recebe esse texto, descobre o que você quer e encontra a resposta. A resposta também é texto: "Estamos abertos das 9h às 17h, de segunda a sexta-feira."

-

A API TTS fala: Finalmente, a API TTS pega essa resposta de texto e a transforma em um arquivo de áudio de uma voz sintetizada falando as palavras, para que você possa ouvir a resposta.

Como você pode ver, eles funcionam em sequência. Eles não são intercambiáveis. O áudio se torna texto, o texto é processado e, em seguida, a resposta de texto se torna áudio novamente.

O verdadeiro desafio não é escolher entre eles, mas integrá-los suavemente e construir toda a lógica no meio. Isso geralmente leva muito tempo do desenvolvedor, manutenção contínua e você deve ter cuidado com erros ou "alucinações" onde a IA entende algo ou apenas inventa uma resposta errada.

Escolhendo a ferramenta certa para o trabalho

Quando você está procurando construir algo com voz, você precisa olhar para algumas coisas importantes. Embora o Whisper seja uma excelente escolha para voz para texto, existem outros players como Deepgram, Google e Amazon por aí.

Aqui estão os fatores que você vai querer pensar sobre:

-

Precisão: Quão bem o modelo realmente entende o que está sendo dito? Isso é frequentemente medido pela "Taxa de Erro de Palavras" (Word Error Rate - WER), e uma pontuação menor é melhor. O Whisper é conhecido por ser muito preciso, mas nada é 100% perfeito. Algumas palavras erradas podem confundir completamente seu aplicativo.

-

Velocidade: Quão rápido você obtém uma resposta? Para uma conversa em tempo real, você precisa de uma latência muito baixa. Mas se você está apenas transcrevendo uma longa gravação de reunião depois do ocorrido, a velocidade não é tão crítica.

-

Custo: O preço da API é geralmente calculado por minuto de áudio que você processa. Mas não se esqueça dos "custos ocultos". Se você seguir a rota de código aberto com o Whisper, você precisará de servidores poderosos, alguém para mantê-los e horas de desenvolvedor, o que pode aumentar rapidamente.

-

Recursos extras: Você precisa de coisas como identificar diferentes falantes, transcrição em tempo real ou um vocabulário personalizado para o jargão da sua indústria? As APIs básicas podem não ter isso.

É aqui que construir do zero pode realmente se tornar uma dor de cabeça. Para muitas empresas, especialmente em suporte ao cliente, o principal objetivo é apenas responder às perguntas dos clientes mais rapidamente. Um bot de voz personalizado é uma maneira de fazer isso, mas é um projeto enorme e de longo prazo.

Uma rota mais direta é frequentemente usar uma plataforma que resolve o problema real de negócios sem a curva de aprendizado acentuada. Por exemplo, uma ferramenta como eesel AI é construída para automatizar o suporte, conectando-se diretamente ao helpdesk e às bases de conhecimento que você já usa. Ela evita toda a confusão do pipeline STT/TTS, concentrando-se no texto, onde a maioria dos tickets de suporte está de qualquer maneira. Isso permite que você esteja pronto e funcionando em minutos, não em meses.

| Funcionalidade | Construindo com APIs Brutas (Whisper/TTS) | Usando uma Plataforma como eesel AI |

|---|---|---|

| Tempo de Configuração | Semanas a meses de desenvolvimento | Minutos, com integrações de um clique |

| Fonte de Conhecimento | Requer codificação personalizada para cada fonte | Conecta-se instantaneamente a helpdesks, documentos, etc. |

| Manutenção | Tempo contínuo do desenvolvedor e custos de servidor | Gerenciado pela plataforma |

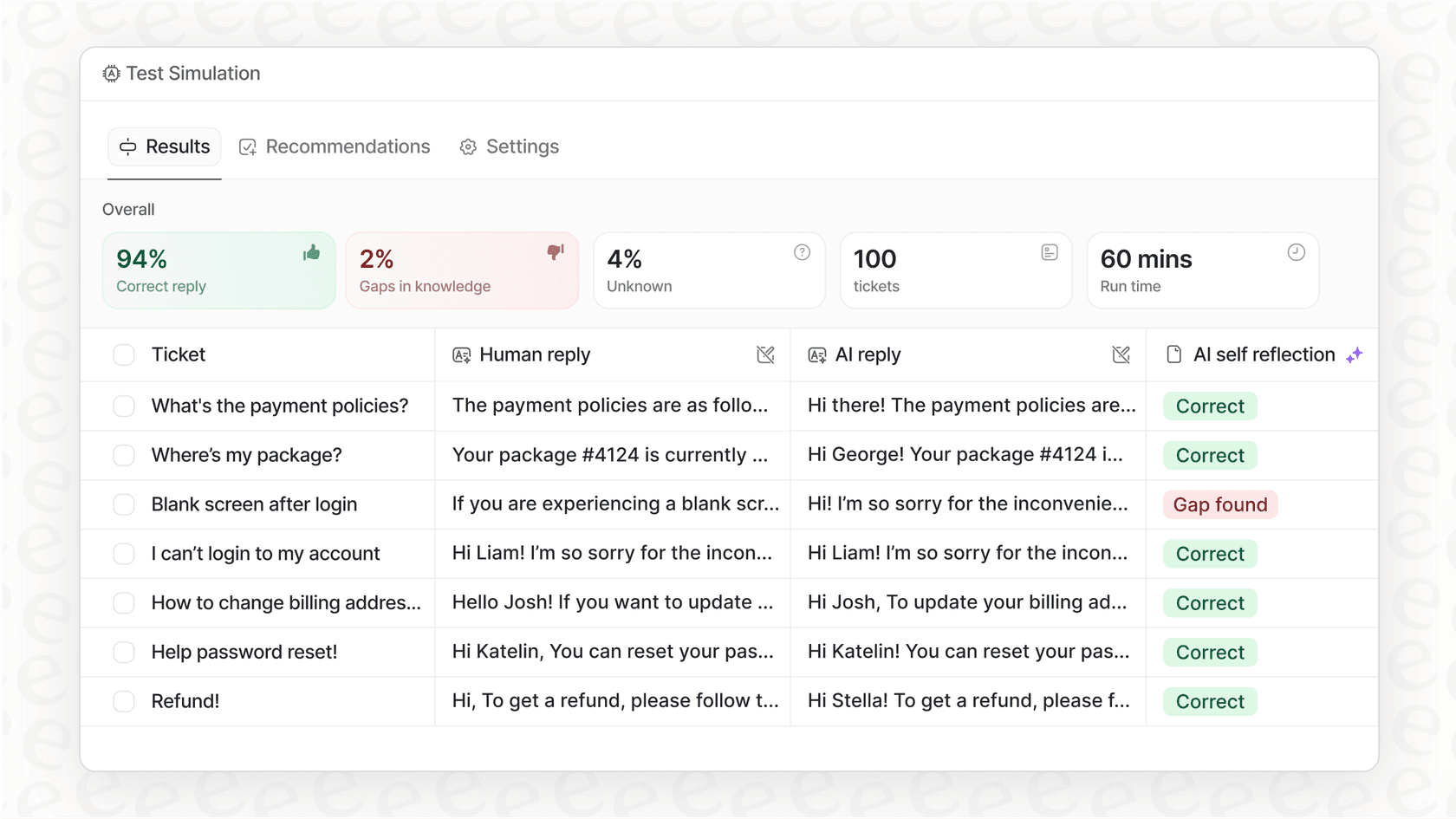

| Teste | Difícil de simular o desempenho do mundo real | Simulação robusta em tickets históricos |

| Foco Principal | Implementação técnica de I/O de voz | Resolvendo o problema de negócios (automação de suporte) |

Exemplos do mundo real de APIs Whisper e TTS

As APIs Whisper e TTS são os motores por trás de muitas ferramentas que já estamos usando todos os dias:

-

Transcrição de Reuniões: Criando automaticamente um resumo escrito de chamadas e reuniões.

-

Legenda de Vídeos: Gerando legendas para vídeos para torná-los mais acessíveis.

-

Assistentes de Voz: O cérebro por trás de alto-falantes inteligentes e comandos de voz no aplicativo.

-

Voicebots de Suporte ao Cliente: Sistemas telefônicos automatizados que podem realmente entender e responder às pessoas.

Mas, às vezes, focar em um voicebot sofisticado significa que você perde uma vitória maior e mais fácil. A maior parte do suporte ao cliente ainda acontece por e-mail e chat ao vivo. Automatizar esses canais baseados em texto pode lhe dar um retorno muito mais rápido sobre o seu investimento, ao mesmo tempo em que resolve o mesmo problema: dar às pessoas respostas rápidas e precisas.

Em vez de construir um sistema de voz complicado do zero, uma plataforma como eesel AI permite que você use a IA diretamente onde sua equipe e seus clientes já estão.

- Ela instantaneamente conhece suas coisas: eesel AI treina em seus tickets de suporte anteriores, artigos da central de ajuda e documentos internos em lugares como Confluence ou Google Docs. Ela capta a voz e as soluções da sua marca desde o primeiro dia, algo que levaria séculos para construir em um bot personalizado.

- Você pode testá-la com segurança: Você definitivamente quer saber se uma IA funciona antes de deixá-la falar com seus clientes. eesel AI tem um modo de simulação que permite que você a teste em milhares de seus tickets anteriores, para que você possa ver exatamente como ela vai se desempenhar.

- Você está sempre no controle: Você decide quais perguntas a IA lida e quando é hora de passar uma conversa para um humano. Isso permite que você a implemente gradualmente e mantenha sua experiência do cliente ótima.

Preços da API OpenAI Whisper e TTS

Se você decidir que usar as APIs diretamente é a jogada certa, é bom saber o que vai custar. Os preços da OpenAI são todos baseados no uso.

-

Preços da API Whisper: A API Whisper custa $0,006 por minuto de áudio, arredondado para o segundo mais próximo. Então, transcrever uma reunião de uma hora custaria cerca de US$ 0,36.

-

Preços da API TTS: A API de Texto para Voz custa US$ 0,015 por 1.000 caracteres para o modelo padrão e US$ 0,030 por 1.000 caracteres para o modelo HD de alta qualidade.

Embora essas taxas pareçam baixas, os custos podem aumentar se você tiver muito tráfego. Mais importante, esse preço não inclui o custo das chamadas do modelo de IA para descobrir as respostas, ou os custos de desenvolvedor e servidor para manter tudo funcionando.

Concentre-se na solução, não apenas na tecnologia

Então, aí está. Whisper (voz para texto) e TTS (texto para voz) são ferramentas poderosas que trabalham juntas para dar vida às interfaces de voz. Whisper ouve e TTS fala. Eles são duas partes de um todo, não concorrentes.

Mas construir uma solução de negócios a partir dessas peças brutas é um projeto sério. Requer muita habilidade técnica, manutenção contínua e um grande investimento em tempo de desenvolvimento.

Para as empresas que estão apenas procurando melhorar seu suporte ao cliente, geralmente há um caminho muito mais direto. Ao automatizar as conversas baseadas em texto onde sua equipe já gasta a maior parte do seu tempo, você pode obter grandes resultados sem o incômodo de um sistema de voz personalizado.

Plataformas como eesel AI oferecem uma solução pronta para uso que se conecta às suas ferramentas existentes, aprende com o conhecimento da sua empresa e oferece o controle que você precisa para automatizar o suporte da maneira certa.

Pronto para ver o que uma plataforma de suporte de IA construída para o trabalho pode fazer? Experimente eesel AI gratuitamente e você pode estar pronto e funcionando em minutos.

Perguntas frequentes

A diferença fundamental é sua direcionalidade: Whisper converte áudio falado em texto escrito (voz para texto), atuando como os "ouvidos" do sistema. Por outro lado, uma API TTS transforma texto escrito em áudio falado (texto para voz), servindo como a "voz" do sistema.

Elas [colaboram sequencialmente](https://community.openai.com/t/gpts-with-custom-actions-by-whisper-api-and-tts/490765) para criar um [loop conversacional](https://www.eesel.ai/blog/what-is-conversational-ai). O Whisper primeiro transcreve a fala do usuário em texto, que um aplicativo então processa para formular uma resposta baseada em texto. Finalmente, a API TTS converte essa resposta de texto de volta em áudio falado para o usuário.

Elas não são concorrentes e servem a funções opostas e complementares. Normalmente, você usa ambas em conjunto para uma interação de voz bidirecional completa, com o Whisper lidando com a entrada e uma API TTS lidando com a saída.

Os principais fatores incluem precisão (por exemplo, Taxa de Erro de Palavras), velocidade (latência para aplicações em tempo real), custo (preços da API mais despesas ocultas de infraestrutura e desenvolvimento) e [recursos extras como identificação de falantes](https://incora.software/insights/whisper-vs-google-speech-to-text) ou vocabulários personalizados.

Sim, você pode usá-los independentemente, dependendo do seu objetivo. Por exemplo, o Whisper sozinho é perfeito para transcrever gravações de reuniões, enquanto uma API TTS pode ser usada sozinha para ler artigos em voz alta. No entanto, um [assistente de voz conversacional](https://www.eesel.ai/blog/what-is-an-ai-virtual-assistant) completo requer ambos.

Eles alimentam aplicações como transcrição de reuniões, legendagem de vídeo, assistentes de voz interativos (por exemplo, alto-falantes inteligentes) e voicebots automatizados de suporte ao cliente. Eles formam o núcleo de qualquer sistema que precise entender e gerar fala semelhante à humana.

Share this article

Article by

Stevia Putri

Stevia Putri é uma generalista de marketing na eesel AI, onde ajuda a transformar ferramentas poderosas de IA em histórias que ressoam. Ela é movida pela curiosidade, clareza e o lado humano da tecnologia.