As 7 melhores alternativas ao Modal AI para desenvolvedores em 2025

Stevia Putri

Katelin Teen

Última edição October 5, 2025

Então, você está usando o Modal. É uma ferramenta fantástica para colocar código Python, modelos de aprendizado de máquina e grandes trabalhos em lote rodando na nuvem sem dor de cabeça. Essa abordagem serverless (sem servidor) para computação GPU é uma verdadeira salvação para experimentos rápidos. Mas, à medida que seu projeto aumenta, você pode começar a notar algumas coisas, como custos imprevisíveis ou limites da plataforma, que o fazem pensar em alternativas ao Modal AI.

Se você está construindo um aplicativo de IA e pensando: "O que mais existe por aí?", você veio ao lugar certo. Vamos analisar dois tipos principais de alternativas: plataformas que ajudam você a resolver problemas de negócios específicos sem o mergulho profundo em DevOps e outras que oferecem mais poder bruto e flexibilidade para seu código personalizado.

O que é Modal AI?

Vamos recapitular rapidamente. Modal é uma plataforma serverless que permite aos desenvolvedores executar código na nuvem sem ter que mexer com a infraestrutura subjacente. Você pode literalmente pegar uma função Python, colocar um decorator (decorador) nela e executá-la em hardware (equipamento) seriamente poderoso (olá, GPUs H100). As pessoas adoram por seus cold starts (inícios a frio) quase instantâneos e uma experiência de desenvolvimento que parece que você ainda está trabalhando em sua máquina local.

É mais frequentemente usado para coisas como:

-

Executar inferência para large language models (modelos de linguagem grandes) e geradores de imagem.

-

Ajustar modelos de código aberto em dados personalizados.

-

Escalonar trabalhos de processamento em lote para serem executados em milhares de containers (recipientes) de uma só vez.

Basicamente, é para qualquer desenvolvedor que prefira escrever código a ficar atolado em configurações do Kubernetes e arquivos YAML intermináveis.

Por que procurar alternativas ao Modal AI?

Embora o Modal seja um campeão da simplicidade, esse foco vem com algumas desvantagens. À medida que os projetos amadurecem de um protótipo legal para um sistema de produção real, alguns pontos problemáticos comuns tendem a surgir.

-

É difícil construir aplicações completas: O Modal é uma fera na execução de funções individuais, mas não foi realmente projetado para orquestrar uma aplicação completa com um frontend (interface), um backend (servidor) e um banco de dados. Tentar juntar vários serviços pode parecer um pouco desajeitado.

-

Os custos podem se tornar imprevisíveis: O modelo de pagamento por segundo é perfeito para tarefas curtas e ocasionais. Mas, para trabalhos que precisam ser executados por um tempo ou exigem acesso constante à GPU, esses segundos se somam rapidamente, e prever sua conta mensal pode se tornar um verdadeiro jogo de adivinhação.

-

Você fica preso: A plataforma funciona sua mágica usando código e infraestrutura específicos do Modal. Isso é ótimo para começar, mas torna a mudança de sua aplicação para outro provedor de nuvem um grande projeto de refatoração.

-

Controle e rede limitados: Você não pode usar sua própria conta de nuvem (BYOC - Bring Your Own Cloud) ou implantar em sua própria rede privada (VPC - Virtual Private Cloud). Para empresas maiores, isso pode ser um impeditivo devido à segurança de dados, residência e regras de compliance (conformidade).

-

Nenhum CI/CD ou fluxos de trabalho Git integrados: Se você quiser um pipeline (canal) de desenvolvimento adequado com testes automatizados e implantações acionadas pelo Git, você tem que adicionar ferramentas externas. Isso adiciona de volta parte da complexidade que o Modal deveria ajudá-lo a evitar.

Nossos critérios para escolher as melhores alternativas ao Modal AI

Para tornar esta lista realmente útil, escolhemos plataformas que abordam diretamente algumas das lacunas no Modal. Analisamos cada uma através de algumas lentes principais:

-

Propósito principal: É projetado para construir um produto de IA específico (como um agente de suporte) ou é para codificação de propósito geral?

-

Modelo de preços: O preço é claro e previsível ou você precisará de uma planilha para descobrir?

-

Experiência do desenvolvedor: Quão fácil é implantar seu código e mantê-lo funcionando?

-

Escalabilidade e controle: Ele pode lidar com tráfego de produção real e oferece recursos avançados como BYOC?

Uma rápida comparação das principais alternativas ao Modal AI

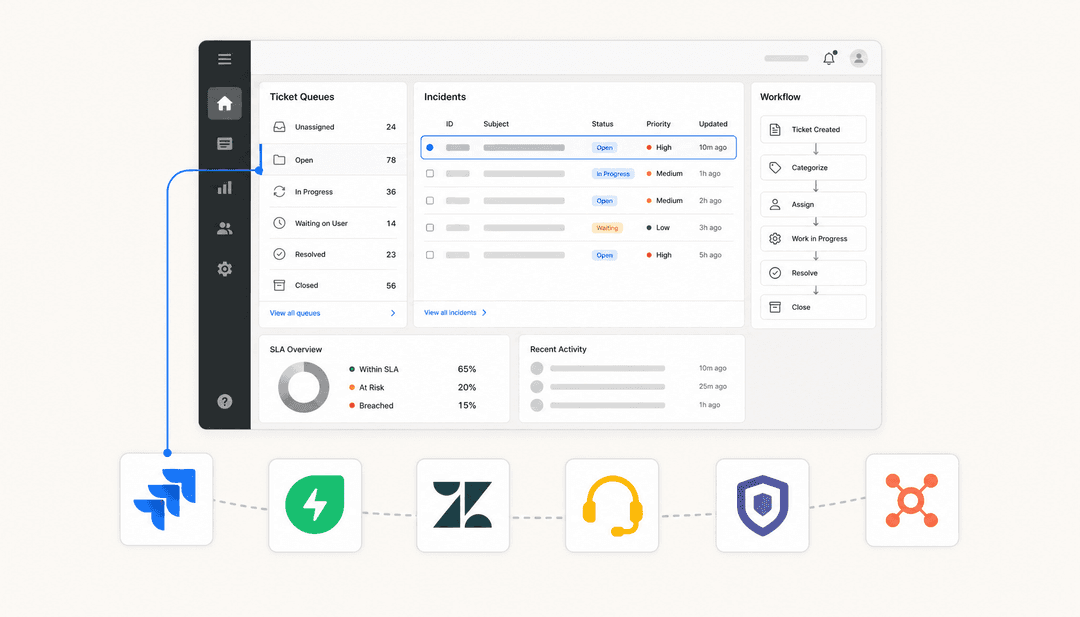

Aqui está uma visão de alto nível de como nossas principais escolhas se comparam entre si.

| Plataforma | Melhor Para | Modelo de Preços | Recurso Principal | Suporte BYOC |

|---|---|---|---|---|

| eesel AI | Automação de suporte ao cliente com IA | Por interação (previsível) | Entre em operação em minutos, sem necessidade de infraestrutura | Não |

| Northflank | Implantação de produtos de IA full-stack | Baseado no uso | CI/CD baseado no Git e orquestração de GPU | Sim |

| RunPod | Computação GPU acessível | Por segundo | Mercado de GPU de baixo custo | Não |

| Replicate | Demonstrações e APIs de modelos públicos | Por segundo | A maneira mais fácil de implantar modelos de código aberto | Não |

| Baseten | Ferramentas internas de ML e APIs de modelo | Baseado no uso | Construtor de IU integrado para demonstrações | Não |

| AWS SageMaker | MLOps de nível empresarial | Baseado no uso (complexo) | Integração e segurança profundas com a AWS | Sim |

| Anyscale | Treinamento distribuído com Ray | Baseado no uso | Computação escalável baseada em Ray | Sim |

As 7 melhores alternativas ao Modal AI em 2025

Certo, vamos mergulhar nos detalhes. Aqui estão as plataformas que achamos que valem a pena considerar quando você estiver pronto para passar do Modal.

1. eesel AI

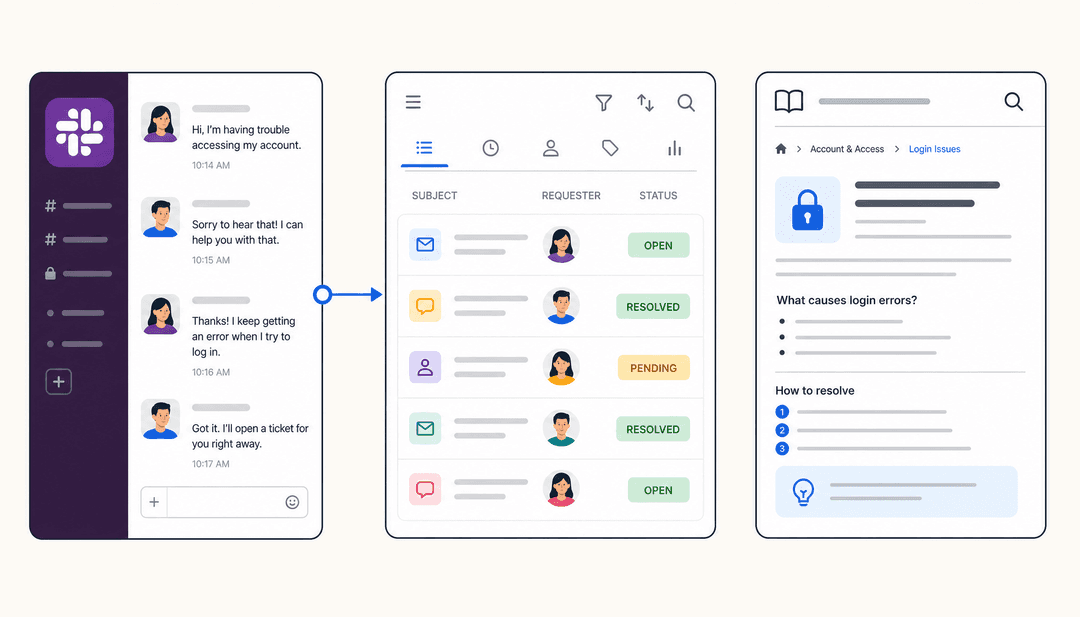

Primeiro, temos um tipo diferente de alternativa. Se sua principal razão para usar o Modal era construir uma aplicação de IA específica, como um chatbot de suporte ao cliente ou um *agente de helpdesk interno, então uma plataforma como eesel AI é uma rota muito mais direta. Em vez de fornecer os blocos de construção de baixo nível, ele fornece uma solução finalizada e pronta para produção.

Você pode conectar o eesel AI diretamente ao seu helpdesk (como Zendesk ou Intercom), knowledge bases (bases de conhecimento) (Confluence ou Google Docs) e ferramentas de chat (bate-papo) (Slack ou Microsoft Teams). Ele lê seus tickets (chamados) de suporte anteriores para aprender como automatizar o suporte de primeira linha, draft replies (rascunhar respostas) para seus agentes humanos e triage issues (priorizar problemas), tudo isso combinando com a voz de sua marca. Você pode passar de se inscrever a ter um agente de IA funcionando em questão de minutos, não meses.

Por que é uma ótima alternativa para construir você mesmo no Modal:

Você não precisa conversar com um vendedor para começar; você pode configurar, configurar e lançar seu agente de IA tudo sozinho. Antes mesmo de deixá-lo conversar com um cliente real, você pode executar uma simulação em milhares de seus tickets históricos para ver exatamente como ele teria se comportado. Isso permite que você calcule seu potencial ROI (retorno sobre o investimento) com antecedência. Além disso, você obtém um workflow engine (motor de fluxo de trabalho) que lhe dá controle total sobre quais tickets a IA lida e quais ações ela pode tomar, seja procurando informações de pedidos ou escalando um problema complicado para um humano.

-

Prós: Entre em operação em minutos, sem infraestrutura para gerenciar, um poderoso modo de simulação e preços claros, sem taxas ocultas por resolução.

-

Contras: É focado especificamente no atendimento ao cliente e suporte interno, então não é uma plataforma para executar código de propósito geral.

-

Preços: Os preços do eesel AI são construídos em torno da previsibilidade. O plano Team custa US$ 299/mês (US$ 239/mês se cobrado anualmente) e cobre até 1.000 interações de IA. O plano Business custa US$ 799/mês (US$ 639/mês se cobrado anualmente) para 3.000 interações e adiciona recursos extras, como treinamento em tickets anteriores e triage (triagem) com tecnologia de IA. Este modelo significa que seus custos permanecem fixos, mesmo se você tiver um mês agitado.

2. Northflank

Se você superou os scripts de função única e precisa construir um produto de IA completo e de várias partes, o Northflank é um concorrente sólido. Ao contrário da abordagem de função primeiro do Modal, o Northflank permite que você implante qualquer serviço containerized (em contêiner), seja uma API de backend, uma IU de frontend ou um banco de dados, e vincule todos eles.

Seus maiores pontos de venda são o pipeline de CI/CD integrado baseado no Git, ambientes de visualização para cada pull request (solicitação de recebimento) e orquestração inteligente de GPU. Ele também suporta trazer sua própria nuvem (BYOC), dando a você o tipo de controle de infraestrutura que o Modal não oferece.

-

Prós: Sem bloqueio de fornecedor, preços claros, CI/CD integrado e projetado para aplicações full-stack.

-

Contras: Pode parecer um pouco mais complexo do que o Modal se tudo o que você deseja fazer é executar um único script.

-

Preços: Northflank opera em um modelo de pagamento conforme o uso com base nos recursos que você usa. Você é cobrado por hora: a CPU custa US$ 0,01667/hora, a memória custa US$ 0,00833/GB/hora e as GPUs têm suas próprias taxas (uma NVIDIA H100, por exemplo, custa US$ 2,74/hora). Isso lhe dá muito controle, mas significa que você precisa ficar de olho no seu uso para gerenciar os custos.

3. RunPod

Se a principal razão pela qual você está procurando uma alternativa é reduzir sua conta de GPU, então o RunPod deve estar no topo de sua lista. É uma plataforma de nuvem que fornece computação GPU sob demanda a alguns dos preços mais competitivos que você encontrará em qualquer lugar. Ele realiza isso com um mercado que inclui data centers (centros de dados) seguros e uma "Nuvem da Comunidade" de máquinas peer-to-peer (ponto a ponto).

O RunPod oferece mais controle direto sobre seu ambiente do que o Modal, suportando imagens Docker personalizadas e armazenamento persistente. É uma ótima opção para pessoas de ML que precisam executar notebooks Jupyter, ajustar modelos ou implantar APIs de inferência sem gastar muito.

-

Prós: Custos de GPU extremamente baixos, uma enorme seleção de GPUs disponíveis e controle total sobre seu ambiente de execução.

-

Contras: Requer um pouco mais de configuração manual do que o Modal e não tem CI/CD integrado ou suporte para construir aplicações full-stack.

-

Preços: Os preços do RunPod são difíceis de superar, com faturamento por segundo. Por exemplo, uma GPU NVIDIA H100 pode ser encontrada por apenas US$ 1,99/hora em sua Nuvem Segura. Eles também oferecem instâncias de GPU serverless (sem servidor) com preços por segundo, tornando-o uma das opções mais baratas disponíveis para cargas de trabalho de inferência spiky (irregulares).

4. Replicate

Replicate é construído para uma coisa: implantar e compartilhar modelos de código aberto por meio de uma API simples. Se você apenas deseja colocar um novo modelo generativo legal online, compartilhá-lo com o mundo ou conectá-lo a outro aplicativo, o Replicate é provavelmente a maneira mais fácil de fazer isso. Você pode implantar modelos populares de sua extensa biblioteca com apenas alguns cliques.

Ele compartilha o amor do Modal pela simplicidade, mas é hiperfocado no caso de uso de inferência. Não é a ferramenta certa para treinar modelos, executar trabalhos em lote ou construir aplicações privadas de nível de produção.

-

Prós: Hospedagem de modelo sem configuração, fácil de compartilhar ou até mesmo monetizar seus modelos e uma biblioteca da comunidade fantástica.

-

Contras: Não é realmente construído para aplicações de produção e não oferece infraestrutura privada ou CI/CD.

-

Preços: O modelo de preços do Replicate é baseado no uso por segundo do hardware. Uma GPU Nvidia T4 custa US$ 0,000225/seg (o que equivale a US$ 0,81/hora) e uma Nvidia A100 custa US$ 0,001400/seg (US$ 5,04/hora). Para alguns modelos proprietários, eles cobram por saída (como por imagem gerada), o que pode facilitar a estimativa dos custos.

5. Baseten

Baseten é destinado a equipes de aprendizado de máquina que precisam ter seus modelos servidos como APIs rapidamente, especialmente para ferramentas internas ou produtos em estágio inicial. Seu recurso matador é um "construtor de aplicativos" integrado que permite criar uma interface de usuário simples para seus modelos sem tocar em nenhum código de frontend. Isso torna super rápido compartilhar seu trabalho com colegas e stakeholders (partes interessadas).

É uma escolha fantástica para transformar um modelo em um endpoint (ponto de extremidade) de API pronto para produção com todos os acessórios, como autoscaling (escalonamento automático) e logging (registro), mas não é tão flexível para construir backends (servidores) mais complexos ou aplicações completas.

-

Prós: Uma maneira incrivelmente rápida de ir de um modelo para uma API ativa, e o construtor de IU integrado é perfeito para demonstrações.

-

Contras: Tende a ser mais voltado para ferramentas internas e tem opções limitadas para orquestrar vários serviços.

-

Preços: Os preços do Baseten são de pagamento conforme o uso, cobrados por minuto para máquinas dedicadas. As instâncias de GPU começam em US$ 0,01052/minuto para uma T4 e sobem para US$ 0,10833/minuto para uma H100. Eles também oferecem APIs pré-embaladas para LLMs populares, que são cobradas por milhão de tokens.

6. AWS SageMaker

Para grandes empresas que já estão totalmente inseridas no ecossistema da AWS, o Amazon SageMaker é o campeão peso-pesado. É uma plataforma MLOps massiva que tenta fazer tudo no ciclo de vida do aprendizado de máquina, desde rotular dados e treinar modelos até implantá-los e monitorá-los em produção.

O SageMaker se integra profundamente com outros serviços da AWS, como IAM e VPC, o que lhe confere os recursos de segurança e compliance (conformidade) de nível empresarial que o Modal não possui. Mas todo esse poder vem com uma curva de aprendizado acentuada e pode ser um exagero sério para equipes menores.

-

Prós: Um ecossistema poderoso e maduro com recursos de segurança e compliance (conformidade) de primeira linha.

-

Contras: Pode ser muito complexo de configurar e gerenciar, e o preço é notoriamente difícil de prever.

-

Preços: Os preços do SageMaker são uma fera à parte, com um modelo de pagamento conforme o uso que abrange dezenas de componentes diferentes. Você é cobrado separadamente pelo tempo da instância, armazenamento, processamento de dados e muito mais. Embora seja flexível, torna a previsão de custos uma verdadeira dor de cabeça e é fácil ser atingido por uma conta surpresa se você não tiver cuidado.

7. Anyscale

Anyscale vem dos criadores do Ray, a estrutura de código aberto go-to (preferida) para computação distribuída. Isso o torna a plataforma perfeita para equipes que precisam executar trabalhos de treinamento e inferência distribuídos enormes usando o Ray. Se você está atingindo tetos de desempenho com trabalhos de GPU única no Modal, o Anyscale oferece um caminho direto para escalar em muitas máquinas.

É uma ferramenta muito especializada que é toda sobre o ecossistema Ray, então é realmente melhor para equipes que já estão comprometidas em usar o Ray para computação paralela.

-

Prós: A melhor plataforma disponível para computação escalável baseada em Ray; também é tolerante a falhas.

-

Contras: Altamente especializado e não destinado a ser uma plataforma de aplicação de propósito geral.

-

Preços: A Anyscale oferece faturamento baseado no uso com taxas diferentes, dependendo se você usa seu serviço hospedado ou implanta em sua própria nuvem (BYOC - Bring Your Own Cloud). A computação hospedada começa em US$ 0,0112/hora para uma instância somente CPU e sobe para US$ 1,8603/hora para uma NVIDIA H100. O modelo BYOC tem taxas de plataforma mais baixas, mas você ainda é responsável pelas contas do seu provedor de nuvem.

Como escolher entre as melhores alternativas ao Modal AI para seu projeto

Com todas essas opções, escolher a certa realmente se resume ao que você está tentando realizar.

Quando escolher alternativas ao Modal AI na camada de aplicação como o eesel AI

Você quer resolver um problema de negócios, não gerenciar servidores. Se seu objetivo final é lançar um agente de suporte de IA refinado que funcione com suas ferramentas existentes, escolher uma plataforma como eesel AI economizará meses de esforço de desenvolvimento. Você pode gastar seu tempo se concentrando na experiência do cliente em vez da pilha de tecnologia subjacente.

Quando escolher alternativas ao Modal AI na camada de infraestrutura

Você precisa executar código personalizado ou tem requisitos exclusivos. Se você está desenvolvendo um modelo de ML totalmente novo, precisa de controle total sobre seu ambiente de container (recipiente) ou deseja construir uma aplicação full-stack do zero, então uma plataforma como Northflank ou RunPod lhe dará o poder e a flexibilidade de que você precisa.

De blocos de construção a soluções de negócios

O Modal fez um ótimo trabalho ao mostrar ao mundo que os desenvolvedores adoram ferramentas que escondem as partes confusas da infraestrutura. Mas o próximo passo nesta evolução é esconder a própria lógica da aplicação. Enquanto plataformas como o Modal lhe dão os tijolos LEGO, soluções como o eesel AI lhe dão a espaçonave totalmente construída.

Para a maioria das equipes, o objetivo não é apenas executar código na nuvem, é obter um resultado de negócios específico. Se esse resultado for um suporte ao cliente mais inteligente, rápido e útil, então construir tudo do zero em uma plataforma de desenvolvedor está pegando a rota panorâmica. A alternativa mais inteligente é usar uma solução que já resolveu esse problema para você.

Pronto para ver o quão rápido você pode lançar um agente de suporte de IA de classe mundial? Experimente o eesel AI gratuitamente e comece em minutos.

Perguntas frequentes

A complexidade da configuração varia muito entre as alternativas ao Modal AI. Algumas, como o eesel AI, são soluções pré-construídas projetadas para implantação quase instantânea, enquanto outras, como o AWS SageMaker, exigem uma configuração mais extensa, mas oferecem profunda personalização para as necessidades empresariais.

Embora algumas alternativas ao Modal AI (por exemplo, RunPod, Replicate) também usem faturamento por segundo, outras oferecem modelos mais previsíveis, como por interação (eesel AI) ou baseados no uso, com taxas horárias mais claras para recursos (Northflank, Baseten). No entanto, o preço do AWS SageMaker pode ser significativamente mais complexo de prever devido aos seus muitos componentes.

Muitas alternativas ao Modal AI, particularmente aquelas focadas em infraestrutura como o Northflank, oferecem maior flexibilidade e suporte para conteinerização padrão e BYOC, reduzindo o bloqueio de fornecedor. Plataformas mais especializadas em um serviço específico podem ter alguns elementos específicos da plataforma, mas geralmente visam padrões mais abertos do que o Modal.

Para construir aplicações de IA full-stack completas, o Northflank é um forte concorrente. Se sua principal necessidade é computação GPU bruta e acessível, o RunPod é uma excelente escolha. Para resolver problemas de negócios específicos, como suporte ao cliente, o eesel AI oferece uma solução abrangente e pronta para uso.

Sim, várias alternativas ao Modal AI, incluindo Northflank, AWS SageMaker e Anyscale (com sua opção BYOC), fornecem significativamente mais controle sobre sua infraestrutura. Isso permite a implantação em sua própria conta de nuvem ou redes privadas, o que geralmente é fundamental para a conformidade e segurança em nível empresarial.

Muitas alternativas ao Modal AI, especialmente o Northflank, oferecem pipelines de CI/CD robustos e integrados baseados no Git, implantações automatizadas e ambientes de visualização. Isso aborda um ponto problemático comum do Modal, que normalmente requer a conexão de ferramentas externas para um pipeline de desenvolvimento adequado.

O Anyscale, construído na estrutura Ray, é projetado especificamente para cargas de trabalho de treinamento e inferência distribuídas massivamente escaláveis, tornando-o ideal para ML de alto desempenho. O AWS SageMaker também oferece amplos recursos de escalonamento para grandes necessidades de MLOps de nível empresarial.

Share this article

Article by

Stevia Putri

Stevia Putri é uma generalista de marketing na eesel AI, onde ajuda a transformar ferramentas poderosas de IA em histórias que ressoam. Ela é movida pela curiosidade, clareza e o lado humano da tecnologia.