Então, provavelmente já viu o alvoroço sobre a velocidade incrível da Groq. Eles estão a fazer ondas ao executar modelos de linguagem grandes (LLMs) mais rápido do que quase qualquer outra pessoa. O seu molho secreto? Unidades de Processamento de Linguagem (LPUs) personalizadas, uma abordagem totalmente diferente das GPUs que geralmente alimentam o mundo da IA.

Mas com qualquer nova tecnologia interessante, surgem as grandes questões: Qual é o senão? Quanto custa? E é realmente uma boa opção para o que precisa de fazer?

Este guia irá guiá-lo por tudo o que precisa de saber sobre os preços da Groq. Vamos analisar o seu modelo de "tokens como serviço", verificar os custos para diferentes modelos de IA e identificar as situações exatas em que a Groq é uma estrela. Também seremos realistas sobre as suas limitações e exploraremos uma alternativa mais prática e completa para equipas que apenas querem colocar a IA a funcionar sem um projeto de desenvolvimento massivo.

O que é a Groq? Compreender a tecnologia por trás do preço

No seu cerne, a Groq é toda sobre hardware especializado. Eles criaram um chip chamado Unidade de Processamento de Linguagem (LPU).

Pense nisto desta forma: a maior parte da IA corre em GPUs (Unidades de Processamento Gráfico), os mesmos chips que alimentam os videojogos de topo. São poderosos, mas são generalistas. As LPUs da Groq foram construídas de raiz para um único trabalho: executar modelos de IA a uma velocidade relâmpago.

Este processo é chamado de "inferência", é a parte em que a IA realmente faz o trabalho, como responder a uma pergunta ou escrever uma frase. Para algo como um chatbot ou um agente de apoio ao cliente, a velocidade aqui é tudo. Ninguém quer esperar por uma resposta; uma IA lenta e com atrasos parece simplesmente avariada.

A principal vantagem da Groq é a sua latência ridiculamente baixa e alta taxa de transferência (quantas palavras, ou "tokens", consegue gerar por segundo). Gera texto tão rápido que parece quase instantâneo. Conseguiram isto com uma arquitetura única que evita os congestionamentos habituais que se veem nos sistemas de GPU. Não é uma ferramenta para treinar modelos de IA; é uma máquina altamente especializada para executá-los o mais rápido humanamente (ou inumanamente) possível.

A detalhar o modelo de preços da Groq

O modelo de preços da Groq funciona com base no "pague conforme o uso", o que é bastante comum para APIs de IA. É cobrado com base em "tokens", que pode considerar como pequenas partes de palavras. Paga pelos tokens que envia (o seu pedido) e pelos tokens que o modelo devolve (a resposta).

É simples, mas também significa que a sua fatura pode variar bastante dependendo de quanto o utiliza. Vejamos a estrutura oficial de preços da Groq.

Preços da Groq para modelos de linguagem grandes (LLMs)

A Groq dá-lhe acesso a uma variedade de LLMs de código aberto. O preço muda dependendo do tamanho e da inteligência do modelo. Modelos maiores geralmente custam mais por token, mas conseguem lidar com pedidos mais complicados.

Aqui está uma tabela que apresenta os preços para os seus modelos mais populares, usando a informação da sua página de preços oficial.

| Modelo de IA | Velocidade (Tokens/Segundo) | Preço de Entrada (Por Milhão de Tokens) | Preço de Saída (Por Milhão de Tokens) |

|---|---|---|---|

| Llama 3.1 8B Instant 128k | 840 TPS | $0,05 | $0,08 |

| Llama 4 Scout (17Bx16E) 128k | 594 TPS | $0,11 | $0,34 |

| GPT OSS 20B 128k | 1.000 TPS | $0,10 | $0,50 |

| Qwen3 32B 131k | 662 TPS | $0,29 | $0,59 |

| Llama 3.3 70B Versatile 128k | 394 TPS | $0,59 | $0,79 |

| GPT OSS 120B 128k | 500 TPS | $0,15 | $0,75 |

| Kimi K2-0905 1T 256k | 200 TPS | $1,00 | $3,00 |

Preços da Groq para outros modelos

A Groq não se resume a texto. Eles também têm modelos para outras tarefas, como transformar fala em texto.

-

Texto para Fala (PlayAI Dialog v1.0): Isto custar-lhe-á $50,00 por cada milhão de caracteres gerados.

-

Reconhecimento Automático de Fala (Whisper Large v3): O preço é de $0,111 por hora de áudio transcrito.

Soluções empresariais e de API em lote

Se está a operar em grande escala, a Groq tem algumas opções para ajudar a gerir os custos em trabalhos de alto volume.

-

API em Lote (Batch API): Permite-lhe enviar milhares de pedidos de uma só vez e obter um desconto de 50% sobre as taxas em tempo real. É ótimo para tarefas que não são urgentes, onde pode submeter um trabalho enorme e obter os resultados num ou dois dias.

-

Caching de Prompts: Isto ajuda a poupar dinheiro em consultas repetitivas. Se enviar a mesma entrada com frequência, obterá um "acerto de cache" e será cobrado 50% menos por esses tokens de entrada.

-

Acesso Empresarial: Para as coisas grandes, como configurar hardware Groq no local (GroqRack) ou usar modelos personalizados, precisará de falar com a equipa de vendas deles para um contrato personalizado.

Para quem é a Groq? A analisar o valor por trás do preço

Com o seu foco na velocidade pura, a Groq é uma escolha perfeita para alguns projetos, mas honestamente, é um exagero para outros. Descobrir se está no seu ponto ideal é fundamental.

Onde a velocidade da Groq justifica o preço

A Groq foi construída para aplicações onde uma resposta em tempo real não é apenas algo bom de se ter, é o ponto principal.

-

IA Conversacional em Direto: Pense em bots de serviço ao cliente super-responsivos, assistentes virtuais e ferramentas de tradução em tempo real onde qualquer atraso tornaria a conversa estranha e pouco natural.

-

Geração de Conteúdo Interativo: Coisas como assistentes de programação de IA que oferecem sugestões enquanto escreve ou ferramentas de escrita colaborativa que dão feedback instantâneo.

-

Análise de Dados em Tempo Real: Para processar e resumir feeds de informação em direto, como tendências de redes sociais ou dados do mercado de ações, à medida que acontecem.

-

Aplicações Ativadas por Voz: Criar assistentes de voz que conseguem entender o que está a dizer e responder sem aquelas pausas longas e estranhas.

Quando o preço pode não ser a escolha certa

Apesar de a velocidade ser incrível, a Groq é uma ferramenta especializada e não está isenta de desvantagens.

-

Apenas Inferência: Não pode usar as LPUs da Groq para treinar ou afinar um modelo de IA. Tem de chegar com um modelo que já esteja treinado e pronto a usar.

-

Precisa de Escala para Fazer Sentido: Só sente realmente os benefícios da arquitetura da Groq quando está a executar coisas em grande escala. Se é um desenvolvedor a experimentar ou uma equipa pequena com pouco tráfego, o custo e o esforço podem ser difíceis de justificar.

-

É um Motor, Não um Carro: Esta é provavelmente a coisa mais importante a entender. A Groq dá-lhe um motor incrivelmente rápido, mas é apenas o motor. Você tem de construir o resto do carro, o chassis, as rodas, a direção, os bancos. Isso significa que a sua equipa precisa de lidar com todo o código para integrações, interfaces de utilizador e a lógica que faz tudo funcionar em conjunto. É um trabalho enorme que exige recursos de engenharia sérios.

Para a maioria das empresas, especialmente equipas de suporte e TI, ter uma API rápida é apenas uma pequena peça do puzzle. Precisa de um sistema completo que realmente resolva problemas de negócio.

Um caminho mais prático para equipas de suporte

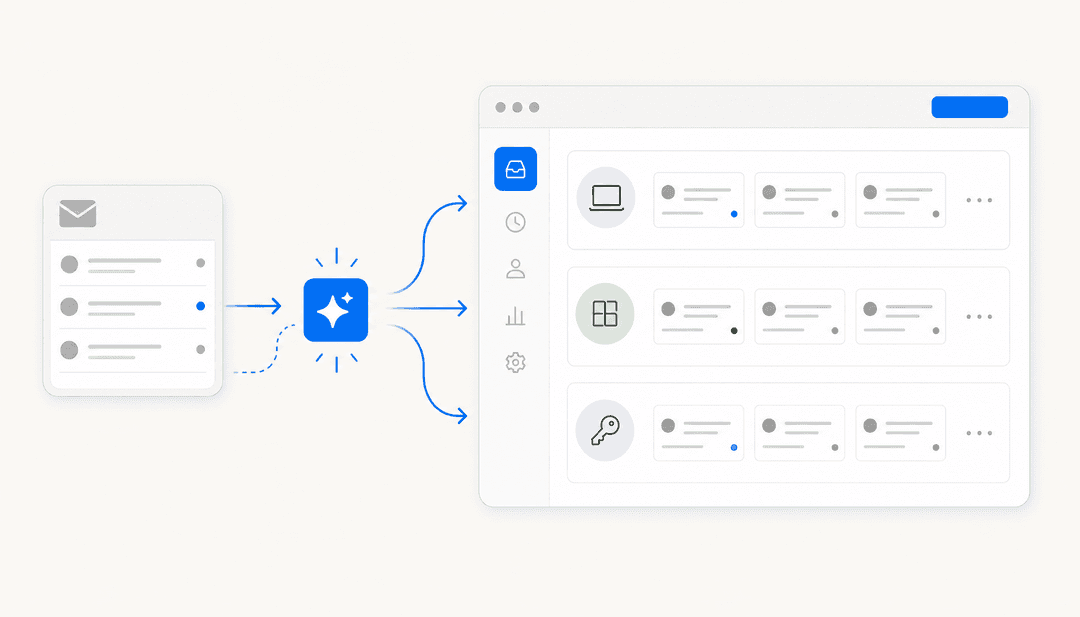

A Groq resolve um problema: a velocidade do hardware. Mas para uma equipa de suporte ou TI ocupada, isso é apenas uma pequena parte da equação. Precisa de uma ferramenta que realmente resolva os problemas dos clientes, não apenas de uma API rápida.

É aqui que apostar numa solução completa como a eesel AI faz muito mais sentido. Vamos manter a nossa analogia do carro. Se a Groq lhe dá o motor, a eesel AI dá-lhe o carro inteiro, com o depósito cheio e pronto a arrancar. Não precisa de uma equipa de boxes de desenvolvedores para o pôr na estrada.

Eis por que uma plataforma de ponta a ponta é uma aposta melhor para a maioria das equipas:

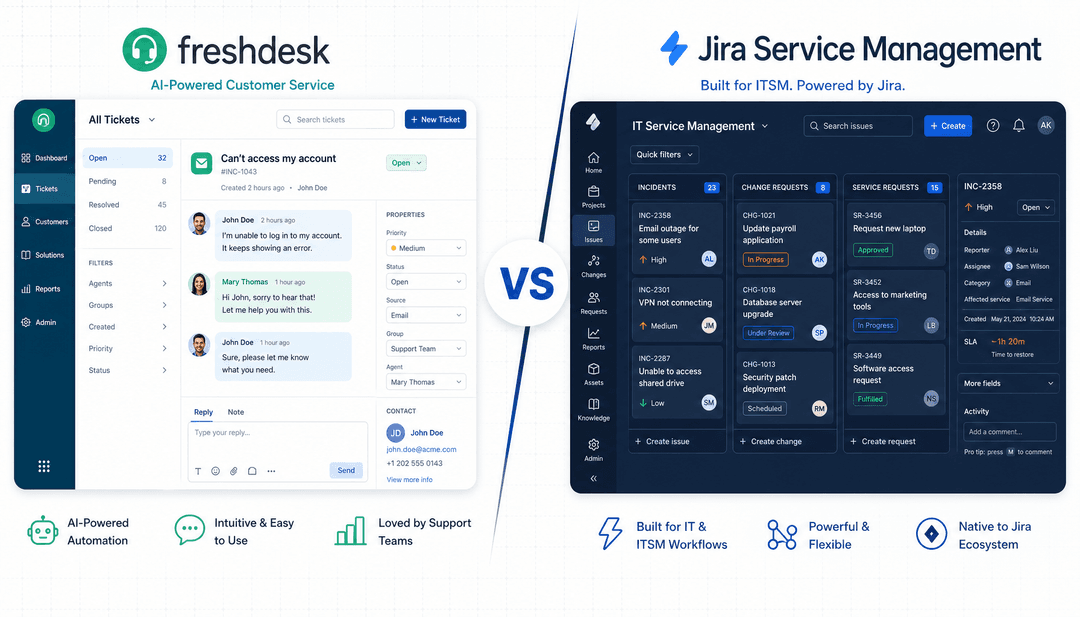

- Entre em funcionamento em minutos, não em meses: Com a eesel AI, não precisa de escrever uma única linha de código. Oferece integrações de um clique com help desks como Zendesk e Freshdesk, além de bases de conhecimento como Confluence. Pode ter um agente de IA totalmente funcional em poucos minutos, tudo por si. Sem longas chamadas de vendas ou configurações complicadas.

- Unifique o seu conhecimento instantaneamente: Uma IA é tão inteligente quanto a informação que possui. A eesel AI conecta-se e aprende automaticamente com os seus tickets passados, artigos de ajuda e documentos internos. Isto garante que as suas respostas sejam precisas e soem como a sua marca, sem que precise de copiar e colar manualmente tudo para um novo sistema.

- Implemente com segurança e controlo total: Quando está a construir sobre uma API em bruto, um erro pode causar grandes problemas. A eesel AI tem um modo de simulação que lhe permite testar a sua IA em milhares dos seus tickets passados antes de sequer falar com um cliente real. Pode ver exatamente como teria respondido, prever o seu impacto e implementá-la com confiança.

- Preços previsíveis e transparentes: Um modelo baseado no uso como o da Groq pode levar a algumas faturas surpresa desagradáveis. A eesel AI tem planos de preços transparentes baseados num número fixo de interações de IA por mês. Os seus custos são previsíveis e não é penalizado com taxas extras por resolver mais tickets.

Para qualquer equipa que precise de aumentar a eficiência e deixar os clientes mais felizes agora, uma plataforma completa como a eesel AI é a maneira mais rápida e fiável de lá chegar.

Considerações finais sobre os preços da Groq

Olhe, a tecnologia da Groq é realmente impressionante. Se faz parte de uma equipa com recursos de engenharia profundos a construir uma aplicação em tempo real onde cada milissegundo conta, a velocidade deles é difícil de bater. O modelo de preços da Groq permite que pague diretamente por esse desempenho bruto.

No entanto, para a maioria das empresas, especialmente no serviço ao cliente e TI, o objetivo não é apenas a velocidade, é resolver problemas de forma eficiente. Construir um sistema de suporte inteiro do zero em cima de uma API é um projeto massivo e caro.

Se está à procura de uma solução que lhe dê todo o poder da IA sem a dor de cabeça do desenvolvimento, dê uma olhada na eesel AI. É uma plataforma totalmente gerida, projetada para automatizar o seu suporte, ajudar os seus agentes e fazer toda a sua operação funcionar de forma mais suave desde o primeiro dia.

Perguntas frequentes

Os preços dos LLMs da Groq baseiam-se num modelo de "tokens como serviço" do tipo "pague conforme o uso". É cobrado por milhão de tokens tanto para a entrada (o seu pedido) como para a saída (a resposta do modelo), com os preços a variarem dependendo do LLM específico que escolher.

Sim, a Groq oferece várias soluções para utilização de alto volume. A sua API em Lote (Batch API) oferece um desconto de 50% para pedidos não urgentes e de grande escala, e o caching de prompts pode reduzir os custos para consultas repetitivas. Para implementações personalizadas como o GroqRack ou modelos à medida, deve contactar a equipa de vendas para obter preços empresariais da Groq.

Além da contagem de tokens, o modelo de IA específico que selecionar tem um impacto significativo nos preços da Groq; modelos maiores e mais capazes geralmente custam mais por token. Adicionalmente, o facto de usar inferência em tempo real ou a API em Lote com desconto para tarefas não urgentes afetará o seu custo geral.

Os preços da Groq vão além dos LLMs baseados apenas em texto. Eles também oferecem preços para outros serviços de IA, como texto para fala (PlayAI Dialog v1.0) cobrado por milhão de caracteres, e reconhecimento automático de fala (Whisper Large v3) faturado por hora de áudio transcrito.

Uma empresa deve considerar os preços da Groq quando a velocidade de resposta em tempo real é absolutamente crítica para a sua aplicação, como em IA conversacional em direto, geração de conteúdo interativo ou aplicações ativadas por voz. É mais adequado para projetos que operam a uma escala significativa, onde a baixa latência é um requisito primário.

As principais limitações são que a Groq é apenas para inferência, o que significa que não a pode usar para treinar modelos. Os benefícios dos preços da Groq são mais aparentes em grande escala, e fornece um "motor, não um carro", exigindo recursos de engenharia significativos para construir uma aplicação completa em torno da sua API rápida.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.