{ "title": "GLM 5.1ガイド:長期間のAIエンジニアリングにおける新たな王者", "keyword": "GLM 5.1", "slug": "glm-5-1", "description": "コーディングや長期間のタスクでSOTAベンチマークを打ち立てるフラッグシップAIモデル、GLM 5.1を紹介します。2026年において、このモデルがどのようにClaudeやGPT-5を凌駕しているのかを学びましょう。", "excerpt": "GLM 5.1はエージェント型エンジニアリングを再定義しています。SOTA(最高水準)のコーディング性能から8時間に及ぶ自律タスクまで、このモデルがなぜAIチームメイトの新たなベンチマークとなるのかを解説します。", "categories": ["ブログライターAI"], "tags": ["GLM 5.1", "エージェント型エンジニアリング", "AIベンチマーク", "コーディングAI", "Z.ai"], "coverImage": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerUrl": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerAlt": "複雑なコーディングインターフェースを背景にした、未来的なGLM 5.1のロゴ。", "faqs": [ { "question": "GLM 5.1とは何ですか?", "answer": "GLM 5.1はZ.aiによる次世代のフラッグシップAIモデルであり、長期間にわたるエージェント型エンジニアリングタスクのために特別に設計されています。" }, { "question": "GLM 5.1のコーディングベンチマークでの性能はどうですか?", "answer": "GLM 5.1はSWE-Bench Proで58.4というSOTAスコアを達成し、GPT-5.4やClaude Opus 4.6を上回りました。" }, { "question": "GLM 5.1はローカルで実行できますか?", "answer": "はい、GLM 5.1のモデルウェイトはオープンソースであり、Ollama、vLLM、SGLangなどのローカルフレームワークと互換性があります。" } ] }

AIの世界は急速に進化しています。AIにスニペットを要求してうまくいくことを願う「バイブ・コーディング」の時代から、AIモデルが複雑なマルチステップのプロジェクトを独立して引き受ける「エージェント型エンジニアリング」の時代へと移行しました。しかし、この新しい時代においても、ほとんどのモデルは壁にぶつかります。最初は順調でも、タスクが複雑になりツール呼び出しが積み重なると、性能が停滞してしまうのです。選択肢を使い果たし、同じミスを繰り返し、最終的には諦めてしまいます。

そこで登場したのが GLM-5.1 です。2026年初頭にリリースされたZ.aiのこの次世代フラッグシップモデルは、単なる漸進的なアップデートではありません。何百回もの反復と何千回ものツール呼び出しを必要とする「長期間(ロングホライゾン)」のタスクにおいて、最適な結果を導き出すために構築されたモデルなのです。

完全に自律的なAIヘルプデスクエージェントを構築する場合でも、高性能なGPUカーネルを最適化する場合でも、GLM 5.1は「生産的な」AIチームメイトの新たな基準を打ち立てています。

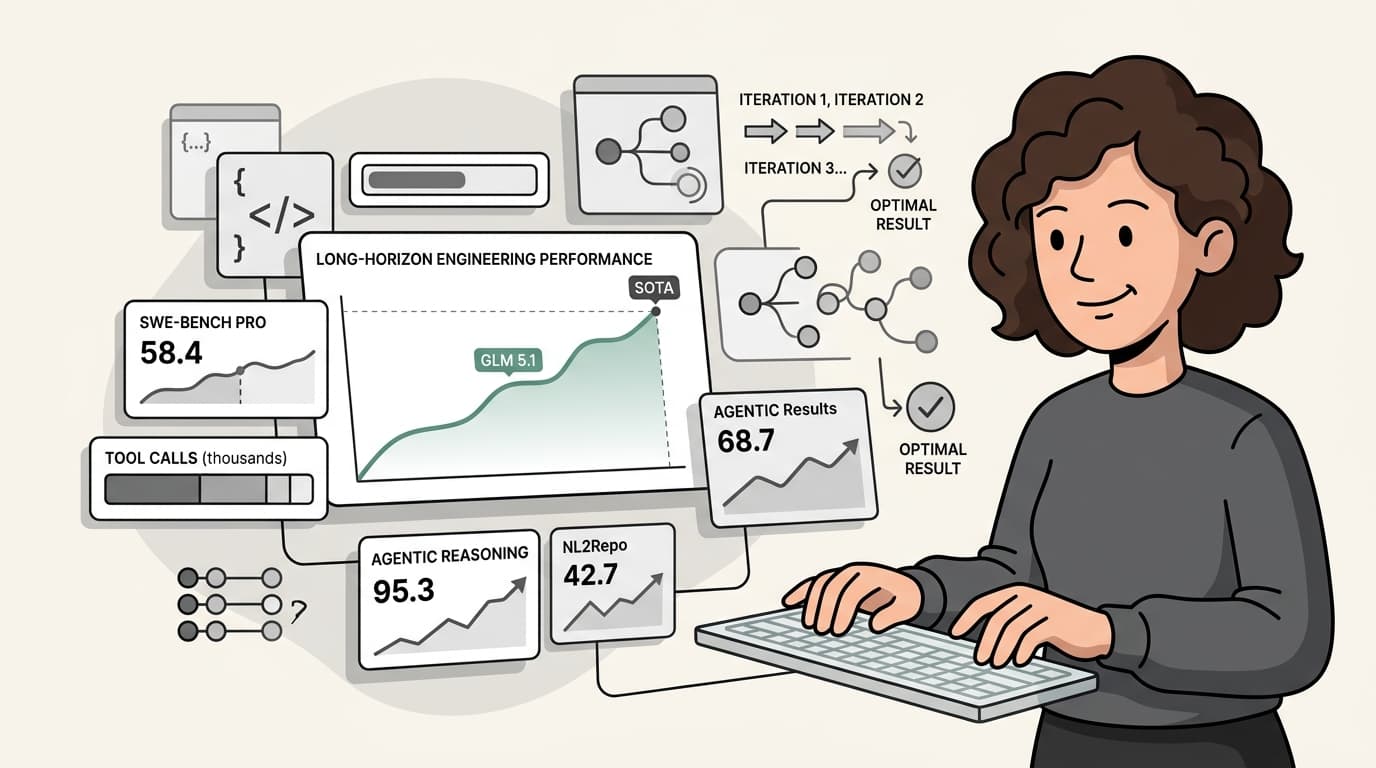

ベンチマーク分析:エンジニアリングにおけるSOTA

エンジニアリングモデルの真の性能を知るには、実際の作業をシミュレートしたベンチマークを見る必要があります。GLM 5.1はこれらのベンチマークに参加するだけでなく、リードしています。

複雑で現実的なソフトウェアエンジニアリングタスクをテストするために設計されたベンチマークである SWE-Bench Pro において、GLM 5.1は 58.4 という最高水準(SOTA)のスコアを達成しました。これを比較すると、GPT-5.4(57.7)やClaude Opus 4.6(57.3)といった強力なモデルを上回っています。

しかし、優れているのはコーディングだけではありません。GLM 5.1は全体的に大幅な向上を見せています。

- Terminal-Bench 2.0: Terminus-2フレームワークで 63.5 を記録し、Claude Codeハーネスでラップした場合には 69.0 にまで跳ね上がりました。これは、現実のターミナル環境を操作する驚異的な能力を示しています。

- 推論: AIME 2026で 95.3、ツールを使用したHumanity’s Last Exam (HLE) で 52.3 を記録し、高度な推論能力が技術的スキルを犠牲にしていないことを証明しました。

- リポジトリ生成: NL2Repoでは 42.7 を記録し、単一のファイルだけでなくリポジトリ全体を扱えることを示しました。

「階段状」パターン:GLM 5.1がいかにして難問を解決するか

ほとんどのLLMは予測可能なパターンに従います。問題の簡単な部分はすぐに解決しますが、その後性能が頭打ちになります。彼らはすでに「レパートリーを使い果たして」いるため、時間やツール呼び出しを増やしても改善しません。

GLM 5.1は、Z.aiが 「階段状(Staircase)」最適化パターン と呼ぶ手法でこの傾向を打ち破ります。モデルは停滞するのではなく、ボトルネックを継続的に特定し、それを克服するための構造的な変更を実装します。

例えば、VectorDBBench の課題を考えてみましょう。目標は高性能なベクトルデータベースを構築することでした。ほとんどのモデルが3,500 QPSに達したところで停止する中、GLM 5.1は 600回の反復 と 6,000回以上のツール呼び出し を実行することが許可されました。

その結果は?最終的に 21.5k QPS に達し、以前の最高記録の約6倍となりました。実行中、モデルは単に設定を微調整しただけではありません。自律的に戦略を切り替えました。フルコーパススキャンからIVFクラスタープロービングへ移行し、その後u8プレスコアリングを備えた2段階パイプラインを導入しました。階段の各「ステップ」は、モデルが自身のログを分析し、障害を特定し、構造的な修正を設計した瞬間でした。

現実世界のエージェント型エンジニアリングシナリオ

長期間AIの力は理論上の話ではありません。非常に野心的なシナリオでテストされています。

1. GPUカーネルの最適化 (KernelBench)

KernelBench では、モデルはPyTorchの参照実装を取り込み、より高速なGPUカーネルを生成するタスクを課されます。GLM 5.1は、レベル3の問題(MobileNetやMambaのようなフルモデルアーキテクチャをカバー)で 3.6倍の高速化 を達成しました。この最適化は1,200回のツール使用制限の最後まで維持され、GLM-5のような前世代モデルが頭打ちになった後も改善を見つけ続けました。

2. 8時間でLinuxデスクトップを構築

おそらく最も印象的なデモンストレーションは、オープンエンドのタスクでした。それは、Linuxスタイルのデスクトップ環境をWebアプリケーションとしてゼロから構築することです。ほとんどのモデルは基本的なタスクバーを作成して停止してしまいます。しかし、GLM 5.1は 8時間連続で実行 されました。ファイルブラウザ、ターミナル、テキストエディタ、さらにはゲームまで構築し、その間ずっとUIの視覚的な一貫性を保ち、スムーズなインタラクションを実現しました。

始め方:今日からGLM 5.1を使う方法

GLM 5.1を自身のプロジェクトで使用したい場合でも、AIチームメイトを通じてその動作を確認したい場合でも、いくつかの始め方があります。

APIアクセス

GLM 5.1には、公式の Z.ai API または OpenRouter などのプロバイダーを通じてアクセスできます。OpenRouterでの価格は、100万入力トークンあたり0.698ドル、100万出力トークンあたり4.40ドルという非常に競争力のある設定で、202,752トークンという巨大なコンテキストウィンドウを備えています。

ローカルデプロイメント

データをローカルに保持したい場合、モデルウェイトは HuggingFace にてMITライセンスおよびNVIDIA Open Model Licenseの下で公開されています。以下の主要なローカルサービングフレームワークと互換性があります。

- vLLM (v0.19.0以降)

- SGLang (v0.5.10以降)

- Ollama

eesel AIとの統合

eesel AIでは、仕事の未来は 重労働をこなすAIチームメイト にあると信じています。GLM 5.1の長期間タスクを処理する能力は、AIコンテンツジェネレーター や、単に質問に答えるだけでなく時間をかけて複雑な問題を解決するサポートエージェントにとって完璧なエンジンとなります。

結論:自律型チームメイトの未来

GLM 5.1はAI能力における根本的な転換を表しています。もはや最初の回答だけが重要なのではなく、仕事が正しく完了するまで やり遂げる粘り強さ が重要なのです。長期間のタスクをマスターすることで、GLM 5.1はAIが単なるツールではなく、真に自律的なチームメイトとなる世界へと私たちを近づけています。

2026年が進むにつれ、「そこそこ」のモデルと、何千ものステップにわたって最適化を維持できるモデルとの間のギャップは広がる一方でしょう。エンジニアリングの未来を構築しているなら、GLM 5.1こそがその最前線です。

よくある質問

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.