De nouveaux modèles d'IA sortent fréquemment, et l'un de ceux qui attire particulièrement l'attention est DeepSeek V3.2. Ce nouveau modèle à poids ouverts (open-weight) de DeepSeek AI est remarquable pour ses performances, qui sont comparées à celles de modèles tels que GPT-5.

Bien que cela représente une étape importante pour les développeurs et les chercheurs, les détails techniques peuvent être complexes. Pour les entreprises, la question principale concerne ses applications pratiques. Comprendre ses utilisations, ses limites et les coûts impliqués est essentiel pour exploiter ses capacités.

Qu'est-ce que DeepSeek V3.2 ?

DeepSeek V3.2 est un grand modèle de langage (LLM - Large Language Model) conçu pour être à la fois puissant et efficace sur le plan informatique. Il s'agit de la suite officielle du modèle expérimental V3.2-Exp, et il est conçu pour gérer des tâches de raisonnement complexes et agir comme un agent d'IA performant sans nécessiter un supercalculateur pour chaque tâche.

Le 3.2 Speciale, par contre... est-ce que la partie « Speciale » ne le rend pas simplement meilleur en maths ? Je ne suis pas sûr que les améliorations du « 3.2 Speciale » par rapport au « 3.2 » apportent quoi que ce soit pour l'écriture. (Je ne parle PAS du « 3.2 Exp », celui qui est sorti il y a un moment. Je parle des deux qui sont sortis aujourd'hui : « 3.2 » vs « 3.2 Speciale »).

Il se décline en plusieurs versions :

-

DeepSeek V3.2 : Il s'agit de la version principale, disponible via une interface web, une application et une API. Considérez-le comme un modèle polyvalent, idéal pour un large éventail de tâches et particulièrement doué pour utiliser des outils externes afin d'accomplir des missions.

-

DeepSeek V3.2-Speciale : Celui-ci est un spécialiste, disponible uniquement via API. Il a été entraîné exclusivement sur des tâches de raisonnement profond et excelle dans la programmation compétitive et les mathématiques avancées. Le revers de la médaille est qu'il ne prend pas en charge l'appel d'outils (tool-calling), il est donc moins généraliste. Il n'est également disponible que pour une durée limitée, via un point de terminaison temporaire jusqu'au 15 décembre 2025.

Ce qui rend ce modèle si important, c'est qu'il s'agit d'un modèle à « poids ouverts ». Cela signifie que les composants de base du modèle (ses poids) sont publiquement disponibles sur des plateformes comme Hugging Face pour les versions standard et Speciale. Cela ouvre la porte aux chercheurs et aux développeurs pour s'appuyer dessus, le personnaliser et explorer de nouvelles possibilités.

Fonctionnalités clés de DeepSeek V3.2

Les performances du modèle sont attribuées à plusieurs innovations qui améliorent sa vitesse, son intelligence et ses capacités.

Une plus grande efficacité avec la DeepSeek Sparse Attention (DSA)

L'un des plus grands goulots d'étranglement pour les LLM est l'« attention », c'est-à-dire la manière dont le modèle analyse le contexte d'une conversation pour générer une réponse pertinente. L'attention normale est coûteuse en ressources car l'IA doit analyser chaque mot précédent.

DeepSeek V3.2 utilise une approche plus intelligente appelée DeepSeek Sparse Attention (DSA, attention éparse). Il dispose d'un « indexeur ultra-rapide » (lightning indexer) et d'un « sélecteur de jetons » (token-selector) qui trouvent et se concentrent rapidement sur les parties les plus pertinentes du texte. Au lieu de tout analyser, il sélectionne les éléments clés.

Ce changement réduit considérablement la charge de calcul, améliorant la vitesse et réduisant les coûts, en particulier pour les tâches impliquant de longs documents ou des historiques de discussion. C'est une innovation qui a d'abord été testée dans le modèle expérimental V3.2-Exp et qui a maintenant été perfectionnée.

Apprentissage par renforcement évolutif pour un raisonnement avancé

Pour devenir vraiment performant en raisonnement complexe, DeepSeek V3.2 a été entraîné à l'aide d'une méthode appelée Apprentissage par renforcement avec récompenses vérifiables (RLVR - Reinforcement Learning with Verifiable Rewards). Au lieu de recevoir uniquement des commentaires humains, le modèle est récompensé lorsqu'il produit des réponses vérifiables et correctes dans des domaines comme les mathématiques et le codage. C'est analogue au fait de récompenser un élève pour avoir montré son raisonnement, et pas seulement pour avoir trouvé la bonne réponse.

Il apprend également à vérifier son propre travail. Le modèle peut vérifier ses étapes de raisonnement et affiner ses réponses, ce qui conduit à des résultats plus fiables. Comme l'ont noté ses créateurs, c'est important car « les réponses correctes ne garantissent pas un raisonnement correct ».

Le modèle dispose même d'un mode « Thinking » (réflexion), disponible dans le modèle d'API deepseek-reasoner, qui lui permet de planifier et de raisonner sur une tâche avant de générer une réponse. C'est un grand pas vers une IA plus réfléchie et précise.

Capacités d'agent et intégration d'outils

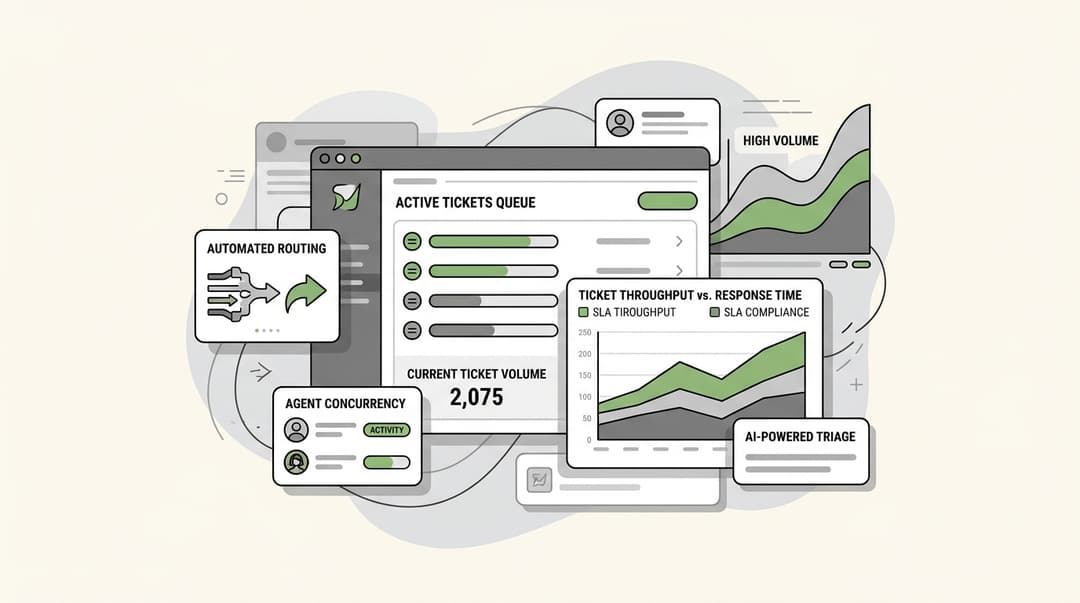

DeepSeek V3.2 ne se contente pas de générer du texte ; il est conçu pour être un « agent » capable d'utiliser des outils externes pour accomplir des tâches. Il a été entraîné à l'aide d'un pipeline comprenant plus de 1 800 environnements.

C'est ce qui permet à l'IA de passer de la simple discussion à l'action concrète, comme rechercher une commande ou traiter un remboursement. Pour les entreprises, c'est une capacité majeure. Cependant, construire et gérer des connexions avec vos outils métier spécifiques (comme Zendesk pour les tickets de support ou Shopify pour l'e-commerce) est un projet d'ingénierie conséquent si vous utilisez uniquement le modèle brut. C'est un moteur puissant, mais vous devez encore construire la voiture tout autour.

Performances et benchmarks de DeepSeek V3.2

L'équipe de DeepSeek AI a fait preuve de transparence en publiant des benchmarks détaillés dans son rapport technique. Les résultats montrent que V3.2 ne fait pas que rattraper les modèles propriétaires ; il rivalise directement avec les meilleurs au monde.

Comparaison avec les modèles leaders

Le rapport technique officiel montre que le modèle standard DeepSeek V3.2 affiche des performances comparables à GPT-5 sur des benchmarks clés. La variante V3.2-Speciale surpasserait GPT-5 en raisonnement et aurait des performances comparables à Gemini-3.0-Pro.

Je viens de l'essayer dans OpenRouter car la version web de DeepSeek a encore l'ancienne version, puis je lui ai posé mes questions les plus difficiles que seuls Sonnet 4.5, Opus 4.5 et Gemini 3.0 peuvent résoudre. Résultats : DeepSeek V3.2 Speciale y répond également correctement. C'est le premier modèle ouvert qui y parvient, même GLM 4.6 n'a pas pu.

Voici un aperçu rapide de la façon dont les modèles se comparent sur certains des benchmarks d'évaluation les plus difficiles :

| Modèle | HLE (Holistic Language Evaluation) | Codeforces (Elo) | MMLU-Pro | GPQA-Diamond |

|---|---|---|---|---|

| DeepSeek V3.2 | 21,7 | 2046 | 85,0 | 80,7 |

| DeepSeek V3.2-Speciale | 25,1 | 2401 | 86,2 | 84,1 |

| GPT-5 | 23,5 | 2355 | 85,8 | 83,0 |

| Gemini-3.0-Pro | 26,3 | 2420 | 86,5 | 84,8 |

Réussites dans des domaines spécialisés

Au-delà des scores de benchmarks, le modèle a démontré des réussites notables dans le monde réel. Le modèle V3.2-Speciale a fait preuve de performances de haut niveau dans des compétitions académiques internationales.

Il a également excellé lors des tests des finales mondiales de l'ICPC et de l'Olympiade mathématique de Chine. Cela démontre sa capacité à gérer des problèmes complexes et spécialisés, allant bien au-delà de la simple génération de texte pour atteindre une résolution de problèmes de haut niveau.

Considérations pratiques pour l'utilisation de DeepSeek V3.2

Bien que la puissance brute du modèle soit indéniable, le transformer en un outil utile pour votre entreprise nécessite une planification pratique. Ce n'est pas tout à fait une solution « clé en main ».

Il est certainement doué pour écrire des scènes convaincantes et créatives. Cependant, on dirait que c'est un modèle qui aime usurper des identités et c'est rédhibitoire. Je vais devoir voir s'il peut être incité à éviter cet écueil, car sinon, je pourrais le voir devenir l'un de mes modèles réguliers.

Comment accéder au modèle DeepSeek V3.2 et l'exécuter

Le moyen le plus simple de commencer est d'utiliser l'API de la plateforme DeepSeek. Vous pouvez vous inscrire et commencer à effectuer des appels immédiatement. N'oubliez pas que la variante ultra-spécialisée Speciale se trouve sur un point de terminaison temporaire qui expire le 15 décembre 2025.

Exécuter le modèle sur vos propres serveurs est techniquement possible, mais c'est une entreprise sérieuse. Cela nécessite du code personnalisé, des outils spécialisés comme vLLM et une quantité importante de matériel GPU coûteux. Pour la plupart des entreprises, ce n'est tout simplement pas une option pratique.

Tarification de l'API et coût de DeepSeek V3.2

Le prix de DeepSeek V3.2 est fixé par million de jetons (un jeton est essentiellement un mot ou une partie de mot). Le coût est compétitif, mais il peut s'accumuler rapidement si vous l'utilisez à grande échelle. La tarification change également selon que le modèle est en « Thinking Mode » et si votre texte d'entrée a déjà été traité auparavant (un « succès de cache » ou cache hit).

Voici la répartition issue de leur page de tarification officielle :

| Version du modèle | Prix d'entrée (1M de jetons) | Prix de sortie (1M de jetons) |

|---|---|---|

| DeepSeek-V3.2 (Non-thinking) | 0,28 $ (échec de cache) / 0,028 $ (succès de cache) | 0,42 $ |

| DeepSeek-V3.2 (Thinking) | 0,28 $ (échec de cache) / 0,028 $ (succès de cache) | 0,42 $ |

Le modèle V3.2-Speciale est proposé au même prix tant qu'il est disponible, ce qui est une excellente affaire compte tenu de sa puissance spécialisée.

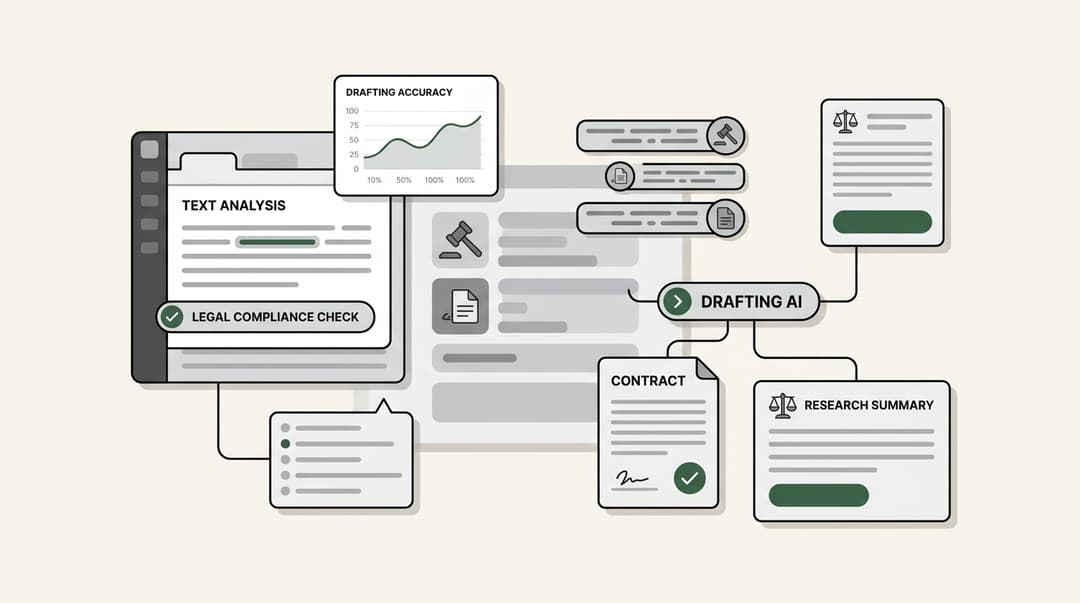

Le fossé entre un modèle et une solution d'entreprise

Une considération clé est que DeepSeek V3.2 est un moteur fondamental. Pour une entreprise, une solution complète nécessite plus que le moteur seul. Un LLM brut n'est qu'un composant d'un système plus large.

Voici ce qui manque si vous utilisez uniquement l'API :

-

Intégrations : Le modèle ne peut pas communiquer avec votre service d'assistance, votre plateforme d'e-commerce ou votre wiki interne dès sa sortie de boîte. Le connecter à vos systèmes d'entreprise comme Zendesk, Shopify ou Slack demande énormément de travail de développement personnalisé.

-

Couche applicative : Il n'y a pas de tableau de bord pour votre équipe, pas de rapports pour voir comment il se comporte, et aucun moyen simple de définir des règles métier comme : « Toujours transférer les questions de facturation à un humain ».

-

Boucle d'apprentissage continu : Le modèle n'apprendra pas automatiquement de vos derniers tickets de support ou de vos articles de base de connaissances mis à jour. Vous devriez construire tout un pipeline de données pour le maintenir à jour.

-

Confidentialité des données : La politique de confidentialité de DeepSeek mentionne que les données des utilisateurs pourraient être utilisées pour améliorer leurs services (bien que vous puissiez vous y opposer), et les données sont stockées en RPC (République populaire de Chine). Cela peut être un obstacle majeur pour les entreprises ayant des exigences strictes en matière de résidence ou de confidentialité des données.

C'est là que des plateformes comme eesel AI peuvent être utiles. eesel fournit une solution d'IA pour le service client qui intègre des modèles puissants. Elle est conçue pour se connecter aux outils d'entreprise, apprendre des données existantes et permettre des tests de performance dans un environnement sécurisé avant toute interaction avec le client. eesel a également des politiques concernant la confidentialité des données, garantissant contractuellement que les données ne sont pas utilisées pour l'entraînement et offrant une résidence des données dans l'UE pour les besoins de conformité.

Une étape majeure pour les modèles ouverts

DeepSeek V3.2 représente une réussite significative dans le domaine des modèles à poids ouverts, offrant aux développeurs un nouvel outil puissant. Cela montre que l'IA de haute performance devient de plus en plus accessible.

Pour approfondir les prouesses techniques et comprendre ce qui fait de ce modèle un nouveau prétendant potentiel au titre de « state-of-the-art », cette vidéo de bycloud offre une excellente explication visuelle de ses capacités.

Les prochaines étapes peuvent être envisagées sous deux angles :

-

Pour les développeurs : L'API DeepSeek et les modèles sur Hugging Face offrent un moyen direct d'explorer les capacités du modèle.

-

Pour les dirigeants d'entreprise : La puissance et l'accessibilité croissantes des modèles d'IA présentent un choix. Les entreprises peuvent soit développer des solutions en interne, soit s'associer à des plateformes spécialisées dans l'intégration de cette technologie dans des outils d'entreprise sécurisés et fiables.

Pour les entreprises cherchant à appliquer l'IA pour l'automatisation du support et l'efficacité des agents, des solutions comme eesel AI sont disponibles. eesel est conçu pour s'intégrer aux systèmes métier et apprendre des données de l'entreprise afin de fournir des résolutions clients automatisées, avec des résultats rapportés allant jusqu'à 81 % de résolution autonome.

Questions fréquemment posées

DeepSeek V3.2 se distingue par sa nature « à poids ouverts » (open-weight), permettant aux développeurs de s'appuyer dessus, et son utilisation de la DeepSeek Sparse Attention (DSA) pour une plus grande efficacité. Cela signifie qu'il est à la fois puissant et moins coûteux en ressources informatiques, en particulier pour les tâches impliquant de longs contextes.

Bien que vous puissiez accéder à DeepSeek V3.2 via son API, l'utiliser efficacement pour votre entreprise nécessite un travail de développement important. Vous devrez créer des intégrations avec vos outils existants (comme Zendesk ou Shopify), concevoir une interface utilisateur et gérer les pipelines de données. Des plateformes comme eesel AI s'en chargent pour vous, en fournissant une solution prête à l'emploi propulsée par des modèles comme celui-ci.

Non, DeepSeek V3.2 n'est pas gratuit. Son prix est basé sur l'utilisation des jetons (tokens) via son API. Le coût varie selon que vous utilisez le mode standard ou le mode « Thinking » et peut augmenter rapidement à grande échelle. Bien que les poids du modèle soient ouverts aux chercheurs, l'utilisation commerciale via l'API est un service payant.

Les principales limites sont d'ordre pratique. Le modèle brut manque d'intégrations spécifiques à l'entreprise, d'une couche applicative conviviale et d'une boucle d'apprentissage automatique. De plus, sa politique de confidentialité des données, qui précise que les données sont stockées en RPC, pourrait être une préoccupation pour les entreprises ayant des exigences strictes en matière de résidence des données.

Le DeepSeek V3.2 standard est un modèle polyvalent qui prend en charge l'appel d'outils (tool-calling), ce qui le rend idéal pour un large éventail de tâches d'agent. DeepSeek V3.2-Speciale est une version hautement spécialisée entraînée pour le raisonnement profond, excellant en mathématiques et en programmation, mais il ne prend pas en charge l'appel d'outils et n'est disponible que pour une durée limitée.

Share this article

Article by

Stevia Putri

Stevia Putri est une généraliste en marketing chez eesel AI, où elle aide à transformer des outils d'IA puissants en récits percutants. Elle est animée par la curiosité, la clarté et le côté humain de la technologie.

Selon son rapport technique officiel, le modèle standard DeepSeek V3.2 affiche des performances équivalentes à GPT-5 sur plusieurs benchmarks clés. La version spécialisée, DeepSeek V3.2-Speciale, surpasse même GPT-5 dans les tâches de raisonnement complexe, ce qui en fait un concurrent de premier plan dans le domaine de l'IA.