Parece que todas las empresas del planeta están en una carrera por integrar la IA Generativa y los Modelos de Lenguaje Grandes (LLMs) en, bueno, todo. Y aunque ha sido un cambio fascinante de presenciar, también ha creado un nuevo dolor de cabeza en materia de seguridad. Ya no hablamos solo de los ciberataques habituales. Ahora, tenemos que preocuparnos por amenazas extrañamente específicas como la inyección de prompts, la fuga de datos y la manipulación sigilosa de modelos que pueden convertir un útil asistente de IA en un grave problema.

Con la aparición de estos nuevos riesgos, está surgiendo una nueva clase de herramientas para gestionarlos. Lakera es uno de los grandes nombres en este campo, construyendo una plataforma desde cero para la seguridad de la IA. Su reciente adquisición por parte de Check Point prácticamente ha consolidado su posición como un actor principal. Entonces, ¿qué es exactamente Lakera y cómo funciona? Vamos a desglosarlo.

¿Qué es Lakera?

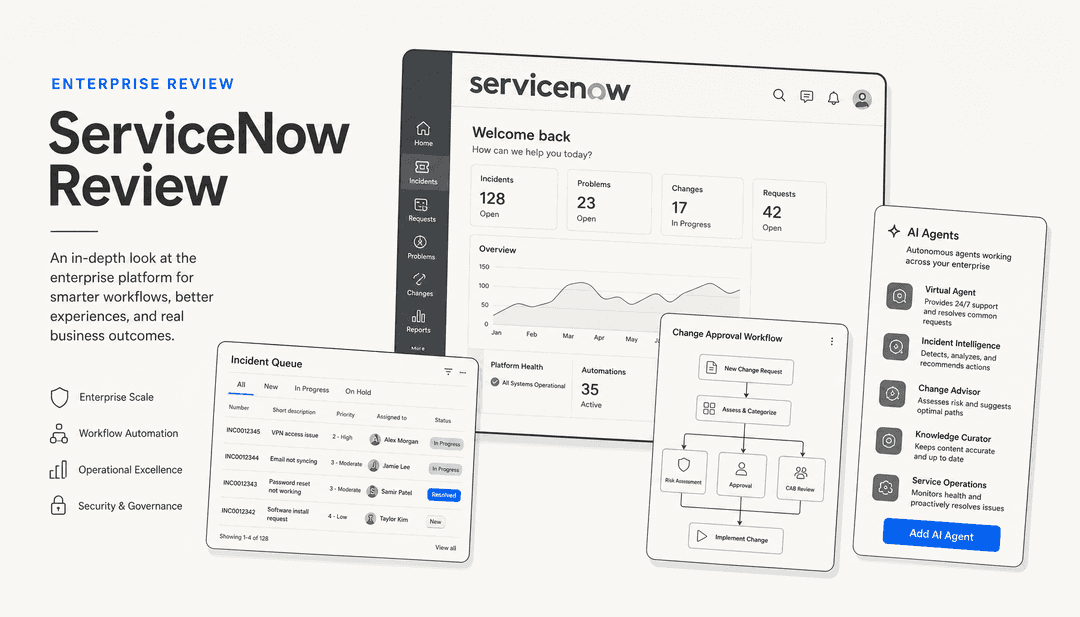

En esencia, Lakera es una plataforma de seguridad construida para el nuevo y extraño mundo de los LLMs, las aplicaciones de IA generativa y los agentes autónomos que impulsan. El objetivo principal de Lakera es permitir que las empresas utilicen la IA sin preocuparse constantemente de que algo salga mal. Está diseñada para cubrir todo el ciclo de vida de una aplicación de IA, desde las primeras etapas de prueba hasta su protección en tiempo real una vez que está en funcionamiento.

La empresa fue fundada por expertos en IA que provienen de lugares como Google y Meta, por lo que tienen un profundo conocimiento de cómo funcionan estos sistemas. Con oficinas en Zúrich y San Francisco, se han ganado la reputación de ser un proveedor de seguridad serio y centrado en los desarrolladores. La plataforma se reduce realmente a dos productos principales: Lakera Guard, para la protección en tiempo real, y Lakera Red, que ayuda a los equipos a eliminar errores de seguridad antes de que una aplicación sea lanzada.

Características clave de la plataforma Lakera

El poder de Lakera no proviene de una única solución mágica. Se trata de un enfoque de seguridad por capas que combina un sistema de defensa en tiempo real, herramientas de prueba proactivas y un flujo constante de datos de amenazas recopilados de una comunidad masiva.

Lakera Guard: Protección en tiempo de ejecución y en tiempo real

Puedes pensar en Lakera Guard como un portero para tu LLM. Se para en la puerta, verificando cada prompt de usuario antes de que se le permita llegar a tu modelo. La API de Guard inspecciona las entradas en busca de amenazas sobre la marcha, y sus principales tareas son:

-

Detener la inyección de prompts: Esto es muy importante. Detecta y bloquea los intentos de los usuarios de engañar o hacer "jailbreak" al LLM. Evita que el modelo haga cosas que no debería, como ignorar sus propias reglas de seguridad o ejecutar comandos dañinos.

-

Prevenir la fuga de datos: Sirve como una red de seguridad para evitar que el modelo revele accidentalmente información sensible. Esto podría ser cualquier cosa, desde información personal identificable (PII) de clientes y contraseñas hasta secretos internos de la empresa.

-

Gestionar la moderación de contenido: Filtra tanto lo que los usuarios escriben como lo que el modelo responde. Esto ayuda a mantener las conversaciones libres de contenido tóxico, dañino o simplemente extraño, asegurando que tu IA se mantenga profesional y alineada con tu marca.

Una de las cosas más impresionantes es su velocidad. Usuarios como Dropbox han reportado tiempos de respuesta por debajo de los 50 milisegundos. Eso significa que puedes añadir una capa seria de seguridad sin hacer esperar a tus usuarios, lo cual es un gran problema para la experiencia de usuario.

Lakera Red: Red teaming proactivo basado en riesgos

Mientras que Lakera Guard es tu protección en tiempo real, Lakera Red se trata de encontrar problemas antes de que tu aplicación se lance. Es una herramienta creada para que los equipos de seguridad esencialmente hagan "red team" a sus propios sistemas de IA, que es una forma elegante de decir que la atacan ellos mismos para encontrar puntos débiles.

Lakera Red ejecuta toda una batería de ataques simulados para ver cómo reacciona el modelo. Al hacer esto de manera controlada, los equipos pueden identificar vulnerabilidades, ya sea en la lógica del modelo o en la forma en que maneja los datos. Después de encontrar un problema, Lakera Red te da consejos claros y prácticos sobre cómo solucionarlo, ayudándote a fortalecer tu aplicación contra ataques que de otro modo solo descubrirías en el mundo real.

Lakera Gandalf: Inteligencia de amenazas de origen colaborativo

Esta podría ser la parte más única de todo el sistema de Lakera. A primera vista, Gandalf es un juego de ciberseguridad sorprendentemente divertido (y adictivo) que ha sido jugado por más de un millón de personas. Pero es mucho más que eso; es un motor brillante para recopilar inteligencia sobre amenazas.

Cada vez que alguien juega a Gandalf e intenta engañar a la IA, está contribuyendo a un esfuerzo masivo y global de red team. El juego registra cada nuevo patrón de ataque y solución ingeniosa, enviando esos datos directamente a los modelos de defensa de Lakera. Con una biblioteca de más de 80 millones de ejemplos adversarios, este ciclo de retroalimentación significa que la seguridad de Lakera siempre está aprendiendo y adaptándose a los últimos trucos que los hackers están intentando.

¿Quién usa Lakera? Un vistazo a los casos de uso en el mundo real

Un número creciente de empresas de la lista Fortune 500 están recurriendo a Lakera, especialmente aquellas en campos altamente regulados como la banca y las finanzas, donde la seguridad de los datos no es solo una buena idea, es un requisito legal. Su protección de nivel empresarial la ha convertido en una opción popular para las empresas que están creando aplicaciones de IA orientadas al cliente y no pueden permitirse ningún error.

Asegurando aplicaciones LLM empresariales con Lakera: el caso de Dropbox

Uno de los mejores ejemplos públicos proviene de cómo Dropbox usa Lakera Guard para proteger sus funciones impulsadas por IA. Cuando el equipo de Dropbox comenzó a usar LLMs para cosas como la búsqueda inteligente y la generación de resúmenes de documentos, sabían que la seguridad tenía que ser una prioridad absoluta. Necesitaban algo rápido, eficaz y, fundamentalmente, algo que pudieran ejecutar dentro de su propia infraestructura para garantizar la privacidad del usuario.

Evaluaron algunas opciones diferentes, pero se decidieron por Lakera por un par de razones clave:

-

Implementación interna: Podían ejecutar Lakera Guard en un contenedor de Docker como un microservicio interno. Esto fue decisivo porque significaba que ningún dato de usuario tenía que salir de su red.

-

Baja latencia: Era lo suficientemente rápido para cumplir con sus estándares de rendimiento, por lo que añadir seguridad no significaba ralentizar el producto para sus usuarios.

-

Protección eficaz: Hacía bien su trabajo, protegiendo sus LLMs de la inyección de prompts y ayudándoles a moderar el contenido, lo cual era esencial para mantener la confianza en sus nuevas funciones de IA.

La historia de Dropbox es una ilustración perfecta de cómo un equipo técnico puede usar Lakera para resolver un desafío de seguridad muy real a nivel de infraestructura.

Más allá de la seguridad de Lakera: garantizando que la IA sea precisa y confiable

Bloquear las entradas maliciosas es una pieza enorme del rompecabezas, pero no es todo el juego. Una vez que te has asegurado de que lo malo se queda fuera, todavía tienes que asegurarte de que lo correcto sale.

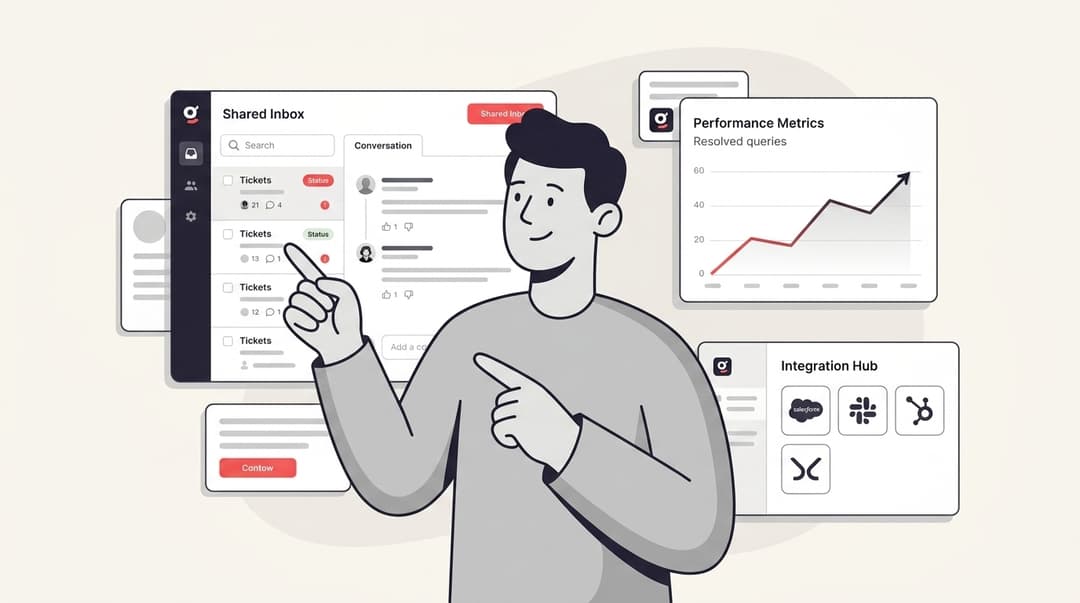

Las plataformas de seguridad como Lakera son vitales para proteger el lado técnico de un LLM. Pero los equipos de negocio tienen un conjunto diferente de preocupaciones. Necesitan estar seguros de que sus agentes de IA solo responden preguntas utilizando información aprobada por la empresa, como un centro de ayuda público o documentación interna. Ahí es donde entra en juego una plataforma como eesel AI. Ofrece una forma sencilla y de autoservicio para que cualquiera pueda construir agentes de IA que se basan en el conocimiento de tu empresa, dándote tanto seguridad como precisión.

El desafío de implementar Lakera

Si estás pensando en usar una herramienta como Lakera, es bueno tener una idea realista de lo que se necesita para ponerla en marcha. Es una herramienta poderosa, pero no es exactamente una varita mágica que puedas agitar sobre tu aplicación.

La necesidad de experiencia técnica

Seamos honestos: configurar Lakera no es un trabajo de cinco minutos para tu gerente de soporte. Como deja claro el ejemplo de Dropbox, esta es una herramienta para un equipo técnico. El proceso de implementación generalmente implica trabajar con APIs, desplegar y gestionar infraestructura como contenedores de Docker, e integrar el servicio en tu canal de aplicaciones existente. Esto requiere tiempo de los desarrolladores o de un equipo de seguridad dedicado, lo que puede ser un obstáculo para equipos más pequeños o aquellos que intentan moverse rápidamente.

La seguridad de Lakera es solo una pieza del rompecabezas de la confianza en la IA

Lakera hace un excelente trabajo para los profesionales de la seguridad, pero ¿qué pasa con los equipos de negocio que son responsables del rendimiento del agente de IA? Sus preocupaciones son diferentes. Necesitan saber si la IA es realmente útil, si está dando respuestas correctas y cómo se comportará cuando miles de clientes reales comiencen a usarla.

Para construir una experiencia de IA en la que la gente pueda confiar de verdad, necesitas combinar una seguridad sólida con controles prácticos a nivel de negocio. Por ejemplo, antes de que un agente de IA hable con un cliente, un líder de soporte debería poder probarlo con miles de tickets de soporte anteriores para ver cómo se habría desempeñado. Este tipo de simulación, una característica central de eesel AI, puede ayudar a prever su tasa de resolución y encontrar lagunas en su conocimiento. Permite a los equipos lanzar la IA con confianza, no solo desde una perspectiva de seguridad, sino también desde una de rendimiento.

Precios de Lakera

Lakera tiene dos niveles de precios principales para diferentes tipos de usuarios. El plan "Community" es gratuito, lo cual es perfecto para desarrolladores individuales o equipos pequeños que quieren probarlo y ver cómo funciona. El inconveniente es que está limitado a 10,000 solicitudes por mes y no tiene las características más avanzadas que necesitarías para una aplicación empresarial a gran escala.

Para las empresas más grandes, está el plan "Enterprise". Este plan es totalmente personalizable e incluye todo, desde opciones de autoalojamiento hasta soporte premium y herramientas de seguridad avanzadas como SSO. Lo único es que tienes que ponerte en contacto con su equipo de ventas para obtener un presupuesto personalizado. Esto puede ralentizar el proceso para los equipos que prefieren el enfoque directo de un plan de negocio de autoservicio.

| Característica | Community | Enterprise |

|---|---|---|

| Precio | 0 $ / mes | Personalizado (Contactar a Ventas) |

| Solicitudes | 10k / mes | Flexible |

| Tamaño máximo de prompt | 8k tokens | Configurable |

| Alojamiento | SaaS | SaaS o Autoalojado |

| Soporte | Comunidad | Nivel empresarial |

| Características avanzadas | No incluidas | SSO, RBAC, integración SIEM |

Construyendo un stack completo de confianza y seguridad en IA con Lakera

Lakera juega un papel esencial en el bloqueo de la capa de seguridad fundamental del stack de IA. Es una solución seria y preparada para empresas para proteger tus modelos de una lista de amenazas en constante crecimiento, y la adquisición por parte de Check Point solo resalta la importancia de esta pieza del rompecabezas.

Pero una estrategia de IA completa necesita más que una buena defensa. El verdadero éxito proviene de la construcción de aplicaciones que no solo son seguras, sino también consistentemente precisas, confiables y fáciles de supervisar para los equipos de negocio. La mejor IA es tanto bien protegida como genuinamente útil.

Una vez que tienes la base de seguridad de tu IA cubierta, el siguiente paso lógico es construir aplicaciones útiles y confiables sobre ella. Si buscas desplegar agentes de IA que aprendan de la base de conocimientos de tu empresa y trabajen directamente dentro de tu helpdesk, puedes construir, probar y lanzar el primero en solo unos minutos con eesel AI.

Preguntas frecuentes

¿Qué es exactamente Lakera y qué problema principal busca resolver para las empresas que utilizan IA?

Lakera es una plataforma de seguridad de IA diseñada para ayudar a las empresas a integrar de forma segura la IA Generativa y los LLMs en sus operaciones. Su objetivo principal es proteger las aplicaciones de IA de amenazas emergentes como la inyección de prompts, la fuga de datos y la manipulación de modelos a lo largo de todo su ciclo de vida.

¿Qué tipo de organizaciones o industrias suelen encontrar más beneficioso el uso de Lakera para sus iniciativas de IA?

Lakera es particularmente beneficiosa para empresas de la lista Fortune 500 y aquellas en campos altamente regulados como la banca y las finanzas. Es ideal para negocios que construyen aplicaciones de IA de cara al cliente que requieren una protección robusta de nivel empresarial y garantizan la privacidad del usuario.

¿Cómo protege Lakera Guard los modelos de IA de amenazas en tiempo real como la inyección de prompts y la fuga de datos?

Lakera Guard actúa como una defensa en tiempo real, inspeccionando cada prompt del usuario antes de que llegue al LLM. Detecta y bloquea activamente los intentos de inyección de prompts, previene la divulgación accidental de información sensible y se encarga de la moderación de contenido tanto para las entradas del usuario como para las salidas del modelo.

¿Cuál es el propósito de Lakera Red y cómo ayuda a los equipos a proteger sus aplicaciones de IA de forma proactiva?

Lakera Red es una herramienta proactiva de red teaming que permite a los equipos de seguridad encontrar vulnerabilidades antes de que una aplicación de IA se ponga en marcha. Ejecuta ataques simulados para identificar puntos débiles y proporciona consejos prácticos para fortalecer la aplicación contra futuras amenazas.

¿Qué nivel de conocimientos técnicos se requiere generalmente para implementar y gestionar Lakera en una infraestructura existente?

Implementar Lakera requiere conocimientos técnicos, a menudo con la participación de desarrolladores o equipos de seguridad dedicados. Normalmente incluye trabajar con APIs, desplegar infraestructura como contenedores de Docker e integrar el servicio en los flujos de trabajo de las aplicaciones existentes.

¿Es Lakera una solución completa para garantizar la confianza y la seguridad de la IA, o suele funcionar junto con otras herramientas?

Lakera proporciona una capa fundamental vital para la seguridad de la IA, protegiendo contra amenazas técnicas. Sin embargo, para un stack completo de confianza y seguridad en IA, a menudo necesita combinarse con herramientas que aborden preocupaciones a nivel de negocio como la precisión, la fiabilidad y las pruebas de rendimiento para los agentes de IA.

¿Qué diferencias hay entre el plan gratuito "Community" de Lakera y el plan "Enterprise", y para quién está diseñado cada uno?

El plan "Community" de Lakera es gratuito, ofrece hasta 10,000 solicitudes por mes y es adecuado para desarrolladores individuales o equipos pequeños que deseen explorar la plataforma. El plan "Enterprise" es personalizable para empresas más grandes, ofreciendo límites de solicitudes flexibles, autoalojamiento, características avanzadas como SSO y soporte premium.