Es fühlt sich an, als ob jedes Unternehmen auf der Welt darum wetteifert, generative KI und große Sprachmodelle (LLMs) in, nun ja, alles zu integrieren. Und obwohl dieser Wandel faszinierend zu beobachten ist, hat er auch ganz neue Sicherheitsprobleme geschaffen. Wir sprechen nicht mehr nur über die üblichen Cyberangriffe. Jetzt müssen wir uns um seltsam spezifische Bedrohungen wie Prompt-Injection, Datenlecks und raffinierte Modellmanipulationen sorgen, die einen hilfreichen KI-Assistenten in eine ernsthafte Haftungsfalle verwandeln können.

Während diese neuen Risiken auftauchen, entsteht eine neue Klasse von Tools, um sie zu bewältigen. Lakera ist einer der großen Namen in diesem Bereich und entwickelt eine Plattform von Grund auf für KI-Sicherheit. Die kürzliche Übernahme durch Check Point hat seine Position als wichtiger Akteur so gut wie gefestigt. Was genau ist also Lakera und wie funktioniert das alles? Schauen wir uns das einmal genauer an.

Was ist Lakera?

Im Kern ist Lakera eine Sicherheitsplattform, die für die seltsame neue Welt der LLMs, generativen KI-Apps und der von ihnen angetriebenen autonomen Agenten entwickelt wurde. Der ganze Sinn von Lakera besteht darin, Unternehmen die Nutzung von KI zu ermöglichen, ohne dass sie sich ständig Sorgen machen müssen, dass etwas schiefgeht. Es ist darauf ausgelegt, den gesamten Lebenszyklus einer KI-Anwendung abzudecken, von den frühen Testphasen bis hin zum Echtzeitschutz, sobald sie live ist.

Das Unternehmen wurde von KI-Experten gegründet, die von Unternehmen wie Google und Meta kommen, sodass sie ein tiefes Verständnis dafür haben, wie diese Systeme funktionieren. Mit Büros in Zürich und San Francisco haben sie sich einen Ruf als ernstzunehmender, entwicklerorientierter Sicherheitsanbieter erarbeitet. Die Plattform lässt sich im Wesentlichen auf zwei Hauptprodukte reduzieren: Lakera Guard für den Echtzeitschutz und Lakera Red, das Teams dabei hilft, Sicherheitslücken zu beseitigen, bevor eine Anwendung überhaupt veröffentlicht wird.

Hauptmerkmale der Lakera-Plattform

Lakeras Stärke kommt nicht von einer einzigen Wunderwaffe. Es geht um einen mehrschichtigen Sicherheitsansatz, der ein Echtzeit-Abwehrsystem, proaktive Testwerkzeuge und einen stetigen Strom von Bedrohungsdaten aus einer riesigen Community kombiniert.

Lakera Guard: Laufzeitschutz in Echtzeit

Man kann sich Lakera Guard wie einen Türsteher für sein LLM vorstellen. Er steht an der Tür und prüft jede Benutzereingabe, bevor sie Ihr Modell erreichen darf. Die Guard-API überprüft Eingaben im laufenden Betrieb auf Bedrohungen, und ihre Hauptaufgaben sind:

-

Prompt-Injection stoppen: Dies ist ein wichtiger Punkt. Es erkennt und blockiert Versuche von Benutzern, das LLM auszutricksen oder zu „jailbreaken“. Es verhindert, dass das Modell Dinge tut, die es nicht tun sollte, wie zum Beispiel seine eigenen Sicherheitsregeln zu ignorieren oder schädliche Befehle auszuführen.

-

Datenlecks verhindern: Es dient als Sicherheitsnetz, um das Modell daran zu hindern, versehentlich sensible Informationen preiszugeben. Das kann alles sein, von personenbezogenen Daten und Passwörtern von Kunden bis hin zu internen Firmengeheimnissen.

-

Inhaltsmoderation durchführen: Es filtert sowohl das, was Benutzer eingeben, als auch das, was das Modell antwortet. Dies hilft, Gespräche frei von toxischen, schädlichen oder einfach nur seltsamen Inhalten zu halten und stellt sicher, dass Ihre KI markenkonform und professionell bleibt.

Eines der beeindruckendsten Dinge daran ist, wie schnell es ist. Benutzer wie Dropbox haben Reaktionszeiten von unter 50 Millisekunden gemeldet. Das bedeutet, dass Sie eine ernsthafte Sicherheitsebene hinzufügen können, ohne Ihre Benutzer warten zu lassen, was für die Benutzererfahrung enorm wichtig ist.

Lakera Red: Proaktives risikobasiertes Red Teaming

Während Lakera Guard Ihr Schutz in Echtzeit ist, geht es bei Lakera Red darum, Probleme zu finden, bevor Ihre App live geht. Es ist ein Werkzeug für Sicherheitsteams, um ihre eigenen KI-Systeme im Wesentlichen einem „Red Teaming“ zu unterziehen, was eine schicke Art zu sagen ist, dass sie es selbst angreifen, um Schwachstellen zu finden.

Lakera Red führt eine ganze Reihe simulierter Angriffe durch, um zu sehen, wie das Modell reagiert. Indem dies auf kontrollierte Weise geschieht, können Teams Schwachstellen identifizieren, sei es in der Logik des Modells oder in der Art und Weise, wie es mit Daten umgeht. Nachdem es ein Problem gefunden hat, gibt Lakera Red Ihnen klare, umsetzbare Ratschläge, wie Sie es beheben können, und hilft Ihnen, Ihre App gegen Angriffe zu härten, die Sie sonst nur in freier Wildbahn entdecken würden.

Lakera Gandalf: Crowdsourced Threat Intelligence

Dies ist vielleicht der einzigartigste Teil des gesamten Lakera-Setups. Oberflächlich betrachtet ist Gandalf ein überraschend unterhaltsames (und süchtig machendes) Cybersicherheitsspiel, das von über einer Million Menschen gespielt wurde. Aber es ist viel mehr als das; es ist eine brillante Maschine zur Sammlung von Bedrohungsdaten.

Jedes Mal, wenn jemand Gandalf spielt und versucht, die KI auszutricksen, trägt er zu einer massiven, globalen Red-Team-Anstrengung bei. Das Spiel protokolliert jedes neue Angriffsmuster und jede clevere Umgehung und speist diese Daten direkt in die Verteidigungsmodelle von Lakera ein. Mit einer Bibliothek von über 80 Millionen feindseligen Beispielen bedeutet diese Rückkopplungsschleife, dass die Sicherheit von Lakera ständig lernt und sich an die neuesten Tricks anpasst, die Hacker ausprobieren.

Wer nutzt Lakera? Ein Blick auf reale Anwendungsfälle

Eine wachsende Zahl von Fortune-500-Unternehmen wendet sich an Lakera, insbesondere solche in stark regulierten Bereichen wie dem Bank- und Finanzwesen, in denen Datensicherheit nicht nur eine gute Idee, sondern eine gesetzliche Anforderung ist. Sein unternehmenstauglicher Schutz hat es zu einer beliebten Wahl für Unternehmen gemacht, die kundenorientierte KI-Anwendungen entwickeln und sich keine Fehler leisten können.

Sicherung von Unternehmens-LLM-Anwendungen mit Lakera: Der Fall Dropbox

Eines der besten öffentlichen Beispiele stammt davon, wie Dropbox Lakera Guard zum Schutz seiner KI-gestützten Funktionen einsetzt. Als das Dropbox-Team begann, LLMs für Dinge wie die intelligente Suche und die Dokumentenzusammenfassung zu verwenden, wussten sie, dass Sicherheit oberste Priorität haben musste. Sie brauchten etwas Schnelles, Effektives und, ganz entscheidend, etwas, das sie in ihrer eigenen Infrastruktur betreiben konnten, um die Privatsphäre der Benutzer zu gewährleisten.

Sie prüften einige verschiedene Optionen, entschieden sich aber aus ein paar wichtigen Gründen für Lakera:

-

Inhouse-Bereitstellung: Sie konnten Lakera Guard in einem Docker-Container als internen Microservice ausführen. Das war ein entscheidender Faktor, denn es bedeutete, dass keine Benutzerdaten jemals ihr Netzwerk verlassen mussten.

-

Geringe Latenz: Es war schnell genug, um ihre Leistungsstandards zu erfüllen, sodass die zusätzliche Sicherheit das Produkt für ihre Benutzer nicht verlangsamte.

-

Effektiver Schutz: Es hat seine Arbeit gut gemacht, schützte ihre LLMs vor Prompt-Injection und half ihnen bei der Moderation von Inhalten, was für die Aufrechterhaltung des Vertrauens in ihre neuen KI-Funktionen unerlässlich war.

Die Geschichte von Dropbox ist ein perfektes Beispiel dafür, wie ein technisches Team Lakera nutzen kann, um eine sehr reale Sicherheitsherausforderung auf Infrastrukturebene zu lösen.

Jenseits der Lakera-Sicherheit: Sicherstellen, dass KI genau und vertrauenswürdig ist

Das Blockieren bösartiger Eingaben ist ein riesiger Teil des Puzzles, aber nicht das ganze Spiel. Sobald Sie sichergestellt haben, dass die schlechten Dinge draußen bleiben, müssen Sie immer noch sicherstellen, dass das Richtige herauskommt.

Sicherheitsplattformen wie Lakera sind unerlässlich, um die technische Seite eines LLM zu schützen. Aber die Business-Teams haben andere Sorgen. Sie müssen sicher sein, dass ihre KI-Agenten nur Fragen unter Verwendung genehmigter Unternehmensinformationen beantworten, wie z. B. einem öffentlichen Hilfecenter oder interner Dokumentation. Hier kommt eine Plattform wie eesel AI ins Spiel. Sie bietet eine einfache Self-Service-Möglichkeit für jedermann, KI-Agenten zu erstellen, die auf dem Wissen Ihres Unternehmens basieren und Ihnen sowohl Sicherheit als auch Genauigkeit bieten.

Die Herausforderung bei der Implementierung von Lakera

Wenn Sie darüber nachdenken, ein Tool wie Lakera zu verwenden, ist es gut, eine realistische Vorstellung davon zu haben, was für die Inbetriebnahme erforderlich ist. Es ist ein mächtiges Werkzeug, aber es ist nicht gerade ein Zauberstab, den man über seine Anwendung schwenken kann.

Die Notwendigkeit von technischem Fachwissen

Seien wir ehrlich: Die Einrichtung von Lakera ist kein Fünf-Minuten-Job für Ihren Support-Manager. Wie das Dropbox-Beispiel deutlich macht, ist dies ein Werkzeug für ein technisches Team. Der Implementierungsprozess umfasst in der Regel die Arbeit mit APIs, die Bereitstellung und Verwaltung von Infrastruktur wie Docker-Containern und das Einbinden des Dienstes in Ihre bestehende Anwendungs-Pipeline. Dies erfordert Zeit von Entwicklern oder einem dedizierten Sicherheitsteam, was für kleinere Teams oder solche, die schnell vorankommen wollen, eine Hürde sein kann.

Lakera-Sicherheit ist nur ein Teil des KI-Vertrauenspuzzles

Lakera leistet hervorragende Arbeit für Sicherheitsprofis, aber was ist mit den Business-Teams, die für die Leistung des KI-Agenten verantwortlich sind? Ihre Bedenken sind andere. Sie müssen wissen, ob die KI tatsächlich hilfreich ist, ob sie korrekte Antworten gibt und wie sie sich verhalten wird, wenn Tausende von echten Kunden sie nutzen.

Um ein KI-Erlebnis zu schaffen, dem die Menschen wirklich vertrauen können, müssen Sie starke Sicherheit mit praktischen Kontrollen auf Geschäftsebene kombinieren. Bevor ein KI-Agent jemals mit einem Kunden spricht, sollte ein Support-Leiter beispielsweise in der Lage sein, ihn an Tausenden von früheren Support-Tickets zu testen, um zu sehen, wie er abgeschnitten hätte. Diese Art der Simulation, ein Kernmerkmal von eesel AI, kann helfen, seine Lösungsquote vorherzusagen und Wissenslücken zu finden. Es ermöglicht Teams, KI mit Zuversicht zu starten, nicht nur aus Sicherheitsperspektive, sondern auch aus Leistungssicht.

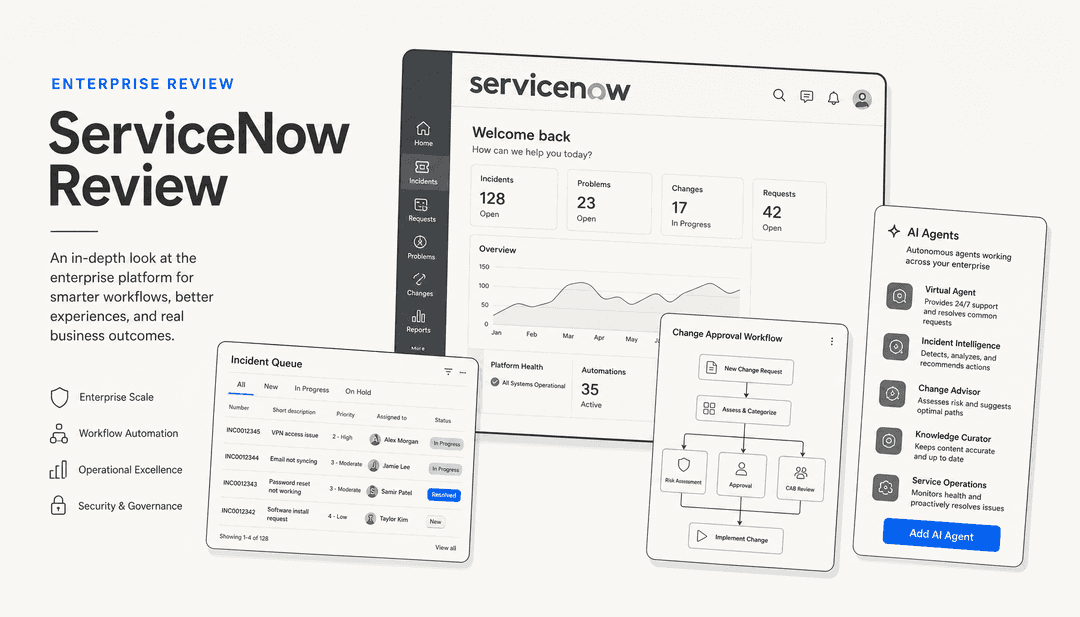

Lakera-Preise

Lakera hat zwei Hauptpreisstufen für verschiedene Arten von Benutzern. Der „Community“-Plan ist kostenlos, was perfekt für Einzelentwickler oder kleine Teams ist, die es auf Herz und Nieren prüfen und sehen wollen, wie es funktioniert. Der Haken ist, dass er auf 10.000 Anfragen pro Monat begrenzt ist und nicht die fortgeschritteneren Funktionen hat, die man für eine vollwertige Geschäftsanwendung benötigen würde.

Für größere Unternehmen gibt es den „Enterprise“-Plan. Dieser Plan ist vollständig anpassbar und umfasst alles von Self-Hosting-Optionen bis hin zu Premium-Support und fortschrittlichen Sicherheitstools wie SSO. Das Einzige ist, dass Sie sich für ein individuelles Angebot an deren Vertriebsteam wenden müssen. Dies kann den Prozess für Teams verlangsamen, die den unkomplizierten Ansatz eines Self-Service-Business-Plans bevorzugen.

| Merkmal | Community | Enterprise |

|---|---|---|

| Preis | 0 $ / Monat | Individuell (Vertrieb kontaktieren) |

| Anfragen | 10.000 / Monat | Flexibel |

| Maximale Prompt-Größe | 8.000 Tokens | Konfigurierbar |

| Hosting | SaaS | SaaS oder Self-Hosted |

| Support | Community | Enterprise-Level |

| Erweiterte Funktionen | Nicht enthalten | SSO, RBAC, SIEM-Integration |

Aufbau eines vollständigen KI-Vertrauens- und Sicherheits-Stacks mit Lakera

Lakera spielt eine wesentliche Rolle bei der Absicherung der grundlegenden Sicherheitsschicht des KI-Stacks. Es ist eine ernstzunehmende, unternehmenstaugliche Lösung zum Schutz Ihrer Modelle vor einer ständig wachsenden Liste von Bedrohungen, und die Übernahme durch Check Point unterstreicht nur, wie wichtig dieses Puzzleteil ist.

Aber eine vollständige KI-Strategie braucht mehr als nur eine gute Verteidigung. Echter Erfolg entsteht durch die Entwicklung von Anwendungen, die nicht nur sicher, sondern auch durchweg genau, zuverlässig und für Business-Teams leicht zu überwachen sind. Die beste KI ist sowohl gut geschützt als auch wirklich hilfreich.

Sobald Sie Ihre KI-Sicherheitsgrundlage im Griff haben, ist der nächste logische Schritt, nützliche, vertrauenswürdige Anwendungen darauf aufzubauen. Wenn Sie KI-Agenten einsetzen möchten, die aus der Wissensdatenbank Ihres Unternehmens lernen und direkt in Ihrem Helpdesk arbeiten, können Sie mit eesel AI in nur wenigen Minuten Ihren ersten Agenten erstellen, testen und starten.

Häufig gestellte Fragen

Was genau ist Lakera und welches Hauptproblem löst es für Unternehmen, die KI einsetzen?

Lakera ist eine KI-Sicherheitsplattform, die Unternehmen dabei helfen soll, generative KI und LLMs sicher in ihre Abläufe zu integrieren. Ihr Hauptziel ist es, KI-Anwendungen während ihres gesamten Lebenszyklus vor neuen Bedrohungen wie Prompt-Injection, Datenlecks und Modellmanipulation zu schützen.

Für welche Arten von Organisationen oder Branchen ist Lakera bei ihren KI-Initiativen normalerweise am vorteilhaftesten?

Lakera ist besonders vorteilhaft für Fortune-500-Unternehmen und solche in stark regulierten Bereichen wie dem Bank- und Finanzwesen. Es ist ideal für Unternehmen, die kundenorientierte KI-Anwendungen entwickeln, die einen robusten, unternehmenstauglichen Schutz und garantierten Benutzerdatenschutz erfordern.

Wie schützt Lakera Guard KI-Modelle vor Echtzeit-Bedrohungen wie Prompt-Injection und Datenlecks?

Lakera Guard fungiert als Echtzeit-Abwehr, die jede Benutzereingabe überprüft, bevor sie das LLM erreicht. Es erkennt und blockiert aktiv Versuche von Prompt-Injections, verhindert die versehentliche Preisgabe sensibler Informationen und übernimmt die Inhaltsmoderation sowohl für Benutzereingaben als auch für Modellausgaben.

Was ist der Zweck von Lakera Red und wie hilft es Teams, ihre KI-Anwendungen proaktiv zu sichern?

Lakera Red ist ein proaktives Red-Teaming-Tool, das es Sicherheitsteams ermöglicht, Schwachstellen zu finden, bevor eine KI-Anwendung live geht. Es führt simulierte Angriffe durch, um Schwachstellen zu identifizieren, und gibt umsetzbare Ratschläge zur Härtung der App gegen zukünftige Bedrohungen.

Welches technische Fachwissen ist im Allgemeinen erforderlich, um Lakera in einer bestehenden Infrastruktur zu implementieren und zu verwalten?

Die Implementierung von Lakera erfordert technisches Fachwissen und oft die Einbeziehung von Entwicklern oder dedizierten Sicherheitsteams. Dies umfasst in der Regel die Arbeit mit APIs, die Bereitstellung von Infrastruktur wie Docker-Containern und die Integration des Dienstes in bestehende Anwendungs-Pipelines.

Ist Lakera eine umfassende Lösung zur Gewährleistung von KI-Vertrauen und -Sicherheit, oder arbeitet es typischerweise mit anderen Tools zusammen?

Lakera bietet eine wichtige grundlegende Schicht für die KI-Sicherheit und schützt vor technischen Bedrohungen. Für einen vollständigen KI-Vertrauens- und Sicherheits-Stack muss es jedoch oft mit Tools kombiniert werden, die sich um geschäftliche Anliegen wie Genauigkeit, Zuverlässigkeit und Leistungstests für KI-Agenten kümmern.

Wie unterscheidet sich der kostenlose „Community“-Plan von Lakera vom „Enterprise“-Plan und für wen sind die beiden jeweils konzipiert?

Der „Community“-Plan von Lakera ist kostenlos, bietet bis zu 10.000 Anfragen pro Monat und eignet sich für Einzelentwickler oder kleine Teams, die die Plattform erkunden möchten. Der „Enterprise“-Plan ist für größere Unternehmen anpassbar und bietet flexible Anfrage-Limits, Self-Hosting, erweiterte Funktionen wie SSO und Premium-Support.