Ein praktischer Leitfaden für Prompt Engineering

Stevia Putri

Katelin Teen

Zuletzt bearbeitet February 1, 2026

Wir alle kennen diese Situation. Sie stellen einem KI-Chatbot eine Frage in der Hoffnung auf eine brillante Antwort und erhalten etwas so Generisches, dass es im Grunde nutzlos ist. Das ist frustrierend, oder? Die Lücke zwischen einer fantastischen Antwort und einem Blindgänger lässt sich oft auf eine Sache zurückführen: die Qualität Ihres Prompts (Eingabeaufforderung).

Genau darum geht es beim Prompt Engineering. Es ist die Fähigkeit, klare und effektive Anweisungen zu formulieren, um ein KI-Modell genau zu dem zu führen, was Sie wollen. Hierbei geht es nicht darum, irgendwelche geheimen Zauberwörter zu finden; es geht darum zu lernen, wie man klar mit einer KI kommuniziert.

Was ist Prompt Engineering?

Also, was genau ist Prompt Engineering? Einfach ausgedrückt ist es der Prozess des Entwerfens und Verfeinerns von Prompts, um eine spezifische, hochwertige Ausgabe von einem generativen KI-Modell zu erhalten. Es ist weit mehr als nur das Stellen einer Frage. Es ist eine Disziplin, die präzise Anweisungen, relevanten Kontext und ein gewisses Maß an kreativer Führung kombiniert, um die KI zu steuern.

Der gesamte Zweck besteht darin, KI-Antworten genauer, relevanter und konsistenter zu machen. Es verwandelt ein Allzweck-Werkzeug in einen zuverlässigen Spezialisten für jede Aufgabe, die Sie im Sinn haben – sei es das Schreiben von Code, das Zusammenfassen eines Berichts oder das Erstellen von Marketing-Texten. Da Large Language Models (LLMs) immer leistungsfähiger geworden sind, ist der Bedarf an gutem Prompt Engineering parallel dazu explosionsartig gestiegen.

Warum Prompt Engineering so wichtig ist

Es ist ganz einfach: Die Qualität dessen, was Sie von einer KI erhalten, ist direkt mit der Qualität dessen verknüpft, was Sie eingeben. Bessere Prompts führen zu besseren, nützlicheren Ergebnissen. Es ist nicht nur eine nette Zusatzqualifikation; es wird für jeden, der echten Nutzen aus KI-Tools ziehen möchte, unerlässlich.

Hier sind die Hauptvorteile, wenn man gut im Prompt Engineering wird:

- Größere Kontrolle und Vorhersehbarkeit: KI kann sich manchmal wie ein Spielautomat anfühlen. Man zieht den Hebel und hofft auf das Beste. Gut formulierte Prompts ändern das. Sie reduzieren die Zufälligkeit in den KI-Antworten und sorgen dafür, dass die Ausgabe Ihren spezifischen Zielen, Ihrem Tonfall und Ihrem Format entspricht. Sie erhalten das, was Sie wollen, nicht das, was die KI glaubt, dass Sie es wollen.

- Verbesserte Genauigkeit und Relevanz: Indem Sie der KI genügend Kontext geben, führen Sie sie zu den richtigen Informationen. Dies ist der Schlüssel zur Vermeidung von „Halluzinationen“ – ein schicker Begriff dafür, wenn eine KI selbstbewusst Dinge erfindet und falsche Informationen als Fakten präsentiert. Gute Prompts halten die KI in der Realität verankert.

- Höhere Effizienz: Denken Sie daran, wie viel Zeit Sie schon damit verschwendet haben, einen vagen Prompt immer wieder anzupassen. Die richtige Antwort beim ersten oder zweiten Versuch zu erhalten, ist eine massive Zeitersparnis. Klare, effektive Prompts reduzieren das Hin und Her und lassen Sie Ihre Arbeit schneller erledigen.

Die größte Herausforderung besteht natürlich darin, dass das manuelle Verfeinern von Prompts mühsam sein kann. Es erfordert viel Ausprobieren und ein gutes Verständnis dafür, wie ein bestimmtes Modell „denkt“. Aber das Erlernen einiger grundlegender Techniken kann Ihnen einen großen Vorsprung verschaffen.

Verstehen Sie mich nicht falsch, die Fähigkeit, einen guten Prompt zu entwerfen, ist eine wichtige Fertigkeit. Wenn ich schätzen müsste, würde ich sagen, dass sie etwa 25 % dazu beiträgt, großartige Ergebnisse von einem Large Language Model zu erhalten.

Kerntechniken des Prompt Engineering erklärt

Sind Sie bereit, Ihr Prompting-Spiel zu verbessern? Dies ist Ihr grundlegender Werkzeugkasten. Wir bewegen uns von den Grundlagen zu fortgeschritteneren Methoden, die Ihre Ergebnisse drastisch verbessern können.

Zero-Shot- vs. Few-Shot-Prompt-Engineering

Dies ist eine der ersten Unterscheidungen, auf die Sie stoßen werden.

Zero-Shot-Prompting ist das, was die meisten von uns ganz natürlich tun. Sie bitten die KI, etwas zu tun, ohne ihr Beispiele dafür zu geben, wie eine gute Antwort aussieht. Sie verlassen sich auf das bereits vorhandene Wissen des Modells, um es herauszufinden. Zum Beispiel: „Klassifiziere diese Kundenbewertung als positiv, negativ oder neutral: 'Das Produkt kam pünktlich an, war aber kleiner als erwartet.'“ Es ist einfach und direkt, kann aber manchmal die Nuancen vermissen lassen, die Sie suchen.

Few-Shot-Prompting hingegen ist so, als würde man der KI vor dem Test eine kleine Lernhilfe geben. Sie stellen ein paar Beispiele (oder „Shots“) bereit, um ihr genau das Muster oder den Stil zu zeigen, dem sie folgen soll. Dies ist unglaublich effektiv, wenn Sie ein bestimmtes Format benötigen. Bevor Sie ihr die neue Kundenbewertung geben, könnten Sie ihr zuerst ein paar Beispiele zeigen:

- Bewertung: „Ich liebe das! Funktioniert perfekt.“ -> Stimmung: Positiv

- Bewertung: „Es ist nach einmaligem Gebrauch kaputt gegangen.“ -> Stimmung: Negativ

- Bewertung: „Der Versand war schnell.“ -> Stimmung: Neutral

Chain-of-Thought (CoT) Prompt Engineering

Dies klingt kompliziert, aber die Idee ist in ihrer Einfachheit brillant. Chain-of-Thought (CoT) Prompting (Gedankenkette) ermutigt das Modell, ein komplexes Problem in eine Reihe kleinerer, logischer Schritte zu zerlegen, bevor es die endgültige Antwort ausgibt. Im Wesentlichen wird die KI aufgefordert, ihren „Rechenweg aufzuzeigen“.

Der erstaunlichste Teil ist, wie einfach dies ausgelöst werden kann. Der klassische Zero-Shot-CoT-Trick besteht darin, einfach den Satz „Lass uns Schritt für Schritt denken“ am Ende Ihres Prompts hinzuzufügen. Diese einfache Ergänzung kann bei komplexen Fragen den Unterschied zwischen einer richtigen und einer falschen Antwort ausmachen.

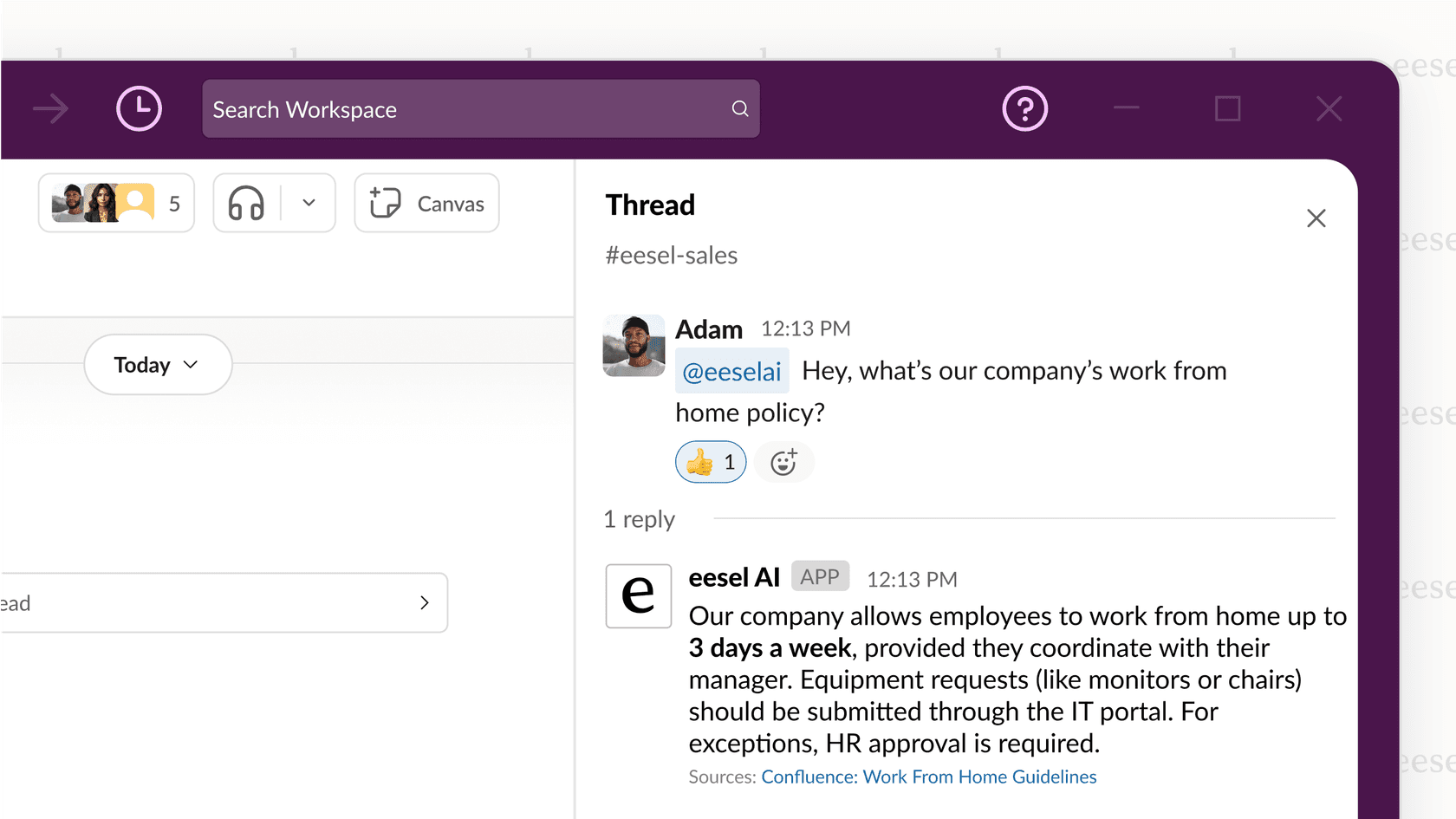

Retrieval-Augmented Generation (RAG) für Prompt Engineering

Retrieval-Augmented Generation (RAG) ist eine leistungsstarke Technik, insbesondere für Unternehmen. Kurz gesagt verbindet RAG eine KI mit einer externen, aktuellen Wissensdatenbank, die nicht Teil ihrer ursprünglichen Trainingsdaten war. Stellen Sie es sich so vor, als würde man der KI einen Test mit offenem Buch geben, anstatt sie rein auf ihr Gedächtnis vertrauen zu lassen.

Best Practices für Prompt Engineering

Die fortgeschrittenen Techniken zu kennen ist großartig, aber der tägliche Erfolg hängt oft davon ab, die Grundlagen zu beherrschen. Hier sind einige praktische Tipps, die Sie sofort anwenden können, um bessere Prompts zu schreiben.

Definieren Sie eine klare Persona, Zielgruppe und ein Ziel

Lassen Sie die KI nicht raten, was Sie wollen. Seien Sie explizit in Bezug auf die Rolle, die sie spielen soll, mit wem sie spricht und was sie tun soll.

- Persona: Sagen Sie der KI, wer sie sein soll. Zum Beispiel: „Sie sind ein Senior Copywriter mit 10 Jahren Erfahrung im Bereich B2B SaaS.“ Dies legt den Tonfall und das Expertenniveau fest.

- Zielgruppe: Geben Sie an, für wen die Antwort bestimmt ist. Zum Beispiel: „...Sie schreiben eine E-Mail an einen nicht-technischen CEO.“ Dies weist die KI an, Fachjargon zu vermeiden und direkt zu sein.

- Ziel: Nennen Sie die gewünschte Aktion oder Ausgabe klar, meist mit einem starken Verb. Zum Beispiel: „Generieren Sie drei Betreffzeilen für eine E-Mail, die eine neue Funktion ankündigt.“

Geben Sie spezifischen Kontext und Einschränkungen an

Die KI weiß nur das, was Sie ihr sagen. Gehen Sie nicht davon aus, dass sie impliziten Kontext versteht. Geben Sie ihr alle Hintergrundinformationen, die sie benötigt, um den Job richtig zu machen.

- Kontext: Wenn Sie sie bitten, über ein Produkt zu schreiben, geben Sie ihr den Namen des Produkts, die wichtigsten Funktionen und die Zielgruppe. Je detaillierter, desto besser.

- Einschränkungen: Setzen Sie klare Grenzen. Nennen Sie die maximale Wortzahl („Halten Sie die Zusammenfassung unter 200 Wörtern“), das gewünschte Format („Formatieren Sie die Ausgabe als Markdown-Tabelle“) und den Tonfall („Verwenden Sie einen lockeren und ermutigenden Ton“).

Nutzen Sie Formatierung, um Ihren Prompt zu strukturieren

Eine riesige Textwand ist für Menschen schwer zu lesen, und auch für eine KI ist sie schwer zu analysieren. Verwenden Sie einfache Formatierungen, um eine klare Struktur innerhalb Ihres Prompts zu schaffen. Markdown (wie Überschriften und Listen) oder sogar einfache Beschriftungen können einen großen Unterschied machen.

Sie könnten Ihren Prompt beispielsweise so strukturieren: „ANWEISUNGEN: Fassen Sie den folgenden Artikel zusammen.“ „KONTEXT: Der Artikel handelt von der Zukunft der Fernarbeit.“ „ARTIKEL: [Artikeltext hier einfügen]“ „AUSGABEFORMAT: Eine Aufzählung der drei wichtigsten Erkenntnisse.“

Dies hilft dem Modell, die verschiedenen Teile Ihrer Anfrage zu verstehen und zu wissen, was mit jeder Information zu tun ist.

Iterieren und verfeinern Sie Ihre Prompts

Ihr erster Prompt ist fast nie Ihr bester. Prompt Engineering ist ein iterativer Prozess. Betrachten Sie es als ein Gespräch. Wenn die erste Antwort nicht ganz passt, geben Sie nicht einfach auf. Verfeinern Sie Ihren Prompt, fügen Sie mehr Kontext hinzu oder versuchen Sie eine andere Formulierung. Experimentieren Sie mit verschiedenen Techniken, um zu sehen, was für Ihre spezifische Aufgabe am besten funktioniert. Jede Iteration bringt Sie dem perfekten Ergebnis näher. <quote text="Es gibt viele Tipps, die man in diesen beiden Leitfäden beachten muss, also habe ich versucht, sie alle nach dem 80/20-Prinzip zu filtern, und bin auf 5 Fragen gekommen, die ich normalerweise durchgehe, wenn ich einen Prompt erstelle:

- Haben Sie eine Persona festgelegt, die das Modell nachahmen soll?

- Haben Sie eine klare und unmissverständliche Aktion (Action) für das Modell vorgegeben?

- Haben Sie alle Anforderungen (Requirements) für die Ausgabe aufgelistet?

- Haben Sie die Situation, in der Sie sich befinden, und das, was Sie mit dieser Aufgabe erreichen wollen, klar erklärt?

- Haben Sie, wo möglich, drei Beispiele (Examples) für das gegeben, was Sie suchen?

Die Anfangsbuchstaben der fettgedruckten Wörter ergeben im Englischen PARSE, was ein leicht zu merkendes Akronym ist, wenn man sie braucht." sourceIcon="https://www.iconpacks.net/icons/2/free-reddit-logo-icon-2436-thumb.png" sourceName="Reddit" sourceLink="https://www.reddit.com/r/PromptEngineering/comments/1byj8pd/comment/kz7j6kv/">

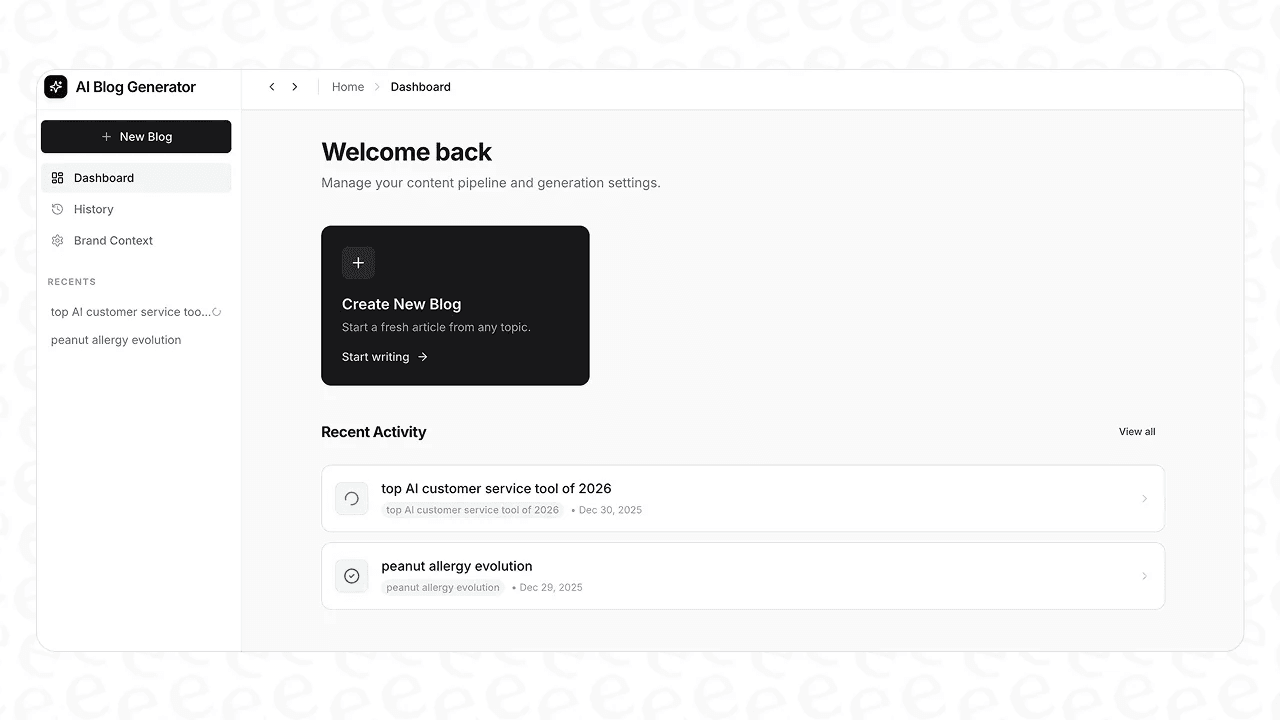

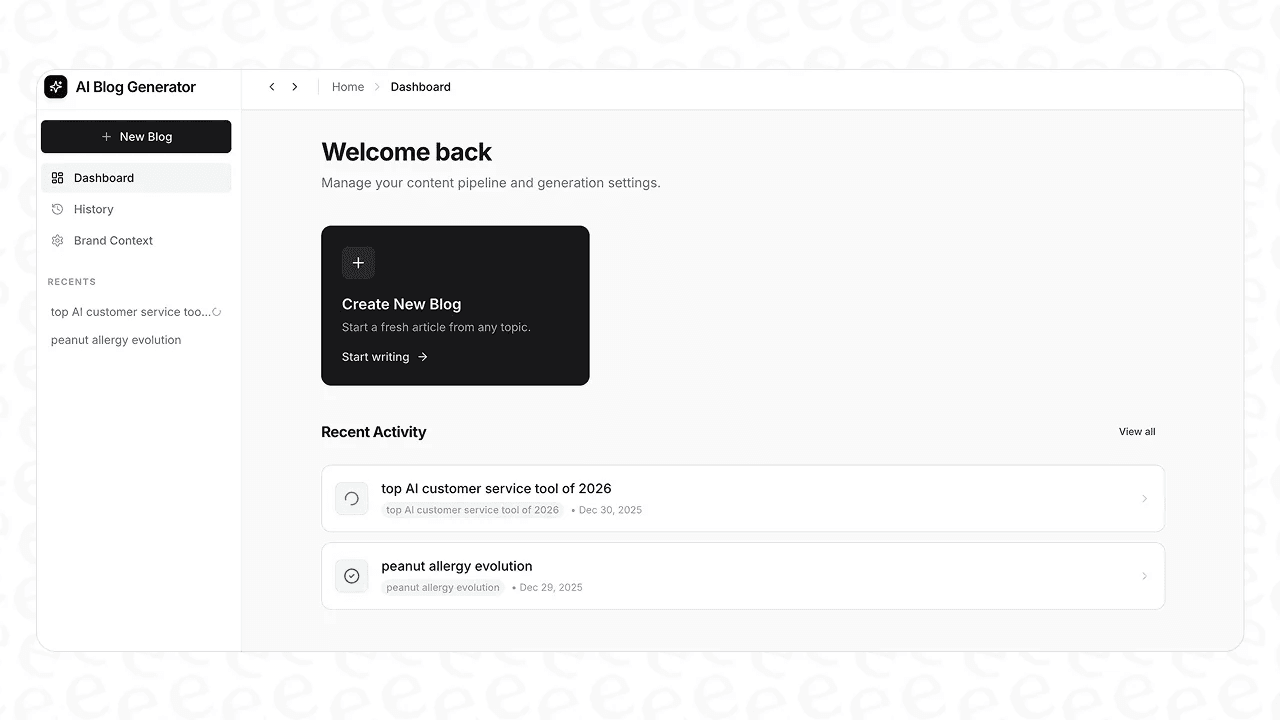

Wie der eesel AI Blog Writer Prompt Engineering automatisiert

Das Erlernen all dieser manuellen Techniken ist mächtig, aber es ist auch viel Arbeit, insbesondere für komplexe Aufgaben wie das Erstellen von SEO-optimierten Inhalten in großem Stil. Hier kommen spezialisierte Tools ins Spiel, die die schwere Arbeit für Sie übernehmen.

Hinter den Kulissen führt der eesel AI Blog Writer eine Reihe anspruchsvoller, automatisierter Prompts aus, um einen vollständigen Artikel zu generieren. So sieht das aus:

- Kontextbewusste Recherche: Er fungiert wie ein spezialisiertes RAG-System, das für die Erstellung von Inhalten entwickelt wurde. Er recherchiert Ihr Thema automatisch in Echtzeit, um tiefe, nuancierte Einblicke zu gewinnen, sodass Sie einen gut recherchierten Artikel erhalten und nicht nur oberflächlichen KI-Füllstoff.

- Automatische Asset-Generierung: Er fordert KI-Bildmodelle auf, relevante Visuals und Infografiken für Ihren Beitrag zu erstellen, und strukturiert komplexe Daten automatisch in saubere, leicht lesbare Tabellen.

- Authentischer Social Proof: Er sucht nach echten Zitaten aus Reddit-Threads und bettet relevante YouTube-Videos direkt in den Artikel ein. Dies fügt eine Ebene menschlicher Erfahrung und Glaubwürdigkeit hinzu, die mit manuellem Prompting allein fast unmöglich zu erreichen ist.

Eine Infografik, die den automatisierten Prompt-Engineering-Workflow des eesel AI Blog Writers detailliert beschreibt, vom Keyword bis zum veröffentlichungsreifen Beitrag.

Die Ergebnisse sprechen für sich. Durch den Einsatz dieses Tools wuchs unser eigener eesel AI Blog in nur drei Monaten von 700 auf 750.000 tägliche Impressionen.

Es ist völlig kostenlos zum Ausprobieren, und die kostenpflichtigen Pläne beginnen bei nur $99 für 50 Blog-Posts. Es wurde entwickelt, um Ihnen die Power von Experten-Prompt-Engineering ohne die Lernkurve zu bieten.

Die Zukunft des Prompt Engineering

Das Feld des Prompt Engineering entwickelt sich rasant weiter. Da KI-Modelle immer intelligenter und intuitiver werden, könnte die Notwendigkeit für hyperspezifische „Zauberwort“-Prompts schwinden. Die Modelle werden besser darin, unsere natürliche Sprache und Absicht zu verstehen, ohne dass sie so viel Anleitung benötigen.

Während sich die spezifischen Techniken, die wir heute verwenden, ändern mögen, wird die Kernkompetenz bleiben. Die Fähigkeit, klar zu kommunizieren, guten Kontext zu liefern und ein klares Ziel zu definieren, wird immer der Schlüssel sein, um das Beste aus der KI herauszuholen, egal wie fortschrittlich sie wird.

Für diejenigen, die einen visuellen Durchgang bevorzugen, gibt es exzellente Ressourcen, die diese Konzepte weiter aufschlüsseln. Das folgende Video bietet einen umfassenden Leitfaden zum Prompt Engineering und deckt alles von den Grundlagen bis hin zu fortgeschritteneren Strategien ab.

Prompt Engineering ist der Schlüssel, um konsistente, hochwertige Ergebnisse von generativer KI freizuschalten. Es ist der Unterschied zwischen dem Kampf mit einem Werkzeug und dem Besitz eines echten kreativen Partners.

Das Verständnis der grundlegenden Techniken wie Zero-Shot, Few-Shot, CoT und RAG gibt Ihnen die Kontrolle, fast jede manuelle Prompting-Aufgabe zu bewältigen. Aber wie wir gesehen haben, entstehen für hochwertige, repetitive Arbeiten wie das Erstellen großartiger SEO-Inhalte spezialisierte Tools, die all diese Komplexität für Sie automatisieren. Diese Plattformen haben das Fachwissen bereits eingebaut, sodass Sie sich auf die Strategie anstatt auf die Syntax konzentrieren können.

Hören Sie auf, mit Prompts zu ringen, und fangen Sie an zu veröffentlichen. Generieren Sie Ihren ersten Blog-Post mit dem eesel AI Blog Writer und sehen Sie den Unterschied selbst.

Häufig gestellte Fragen

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.