Es scheint, als versuche heutzutage jedes Unternehmen, etwas Cooles mit Large Language Models (LLMs) (große Sprachmodelle) zu bauen. Aber ziemlich schnell stößt jeder auf die gleiche Mauer: Wie bringt man diesen leistungsstarken Modellen bei, etwas über Ihr Geschäft zu wissen? Alle Ihre einzigartigen, wertvollen Informationen, Kundensupport-Tickets, internen Wikis, Produktspezifikationen sind für sie völlig unsichtbar.

Dies ist genau das Problem, für das Daten-Frameworks entwickelt wurden. Sie fungieren als Vermittler zwischen einem LLM und Ihren privaten Daten. Eines der beliebtesten Open-Source-Tools, zu dem Entwickler greifen, ist LlamaIndex.

In diesem Leitfaden geben wir Ihnen einen geradlinigen, geschäftsorientierten Einblick in das, was LlamaIndex ist, wie es funktioniert und was die Leute damit bauen. Wir werden auch ehrlich über seine Einschränkungen sprechen und darüber, warum eine vorgefertigte KI-Plattform ein viel schnellerer Weg sein könnte, um die Arbeit zu erledigen.

Was ist LlamaIndex?

Einfach ausgedrückt ist LlamaIndex ein Open-Source-Framework, das Entwicklern die Tools gibt, um LLMs mit ihren eigenen privaten Daten zu verbinden. Sein Hauptzweck ist es, eine Pipeline zu erstellen, die Ihre unternehmensspezifischen Informationen an ein Modell wie GPT-4 weiterleiten kann, sodass es Antworten geben kann, die auf Ihrem Wissen basieren, nicht nur auf dem, was im öffentlichen Internet steht.

Hier ist eine gute Möglichkeit, darüber nachzudenken: Stellen Sie sich vor, ein LLM ist ein brillanter neuer Mitarbeiter, der jedes Buch in der öffentlichen Bibliothek gelesen hat. Er weiß eine Menge über allgemeine Themen, hat aber keine Ahnung, wo Ihr Unternehmen seine Finanzberichte aufbewahrt oder wie Ihre interne Software funktioniert. LlamaIndex ist das Toolkit, das ein Entwickler verwendet, um als Unternehmensbibliothekar für diesen neuen Mitarbeiter zu fungieren. Es liest, katalogisiert und indiziert jedes einzelne Dokument, das Ihr Unternehmen besitzt.

Wenn also ein Benutzer eine Frage stellt, muss das LLM nicht raten. Es kann den perfekt organisierten Index konsultieren, den Ihr Entwickler erstellt hat, und genau die Information herausholen, die es benötigt. Auf diese Weise können Sie Dinge wie einen Chatbot erstellen, der Ihr Produkt in- und auswendig kennt, oder ein internes Suchtool, das tatsächlich funktioniert.

Wie LlamaIndex funktioniert: Die RAG-Pipeline erklärt

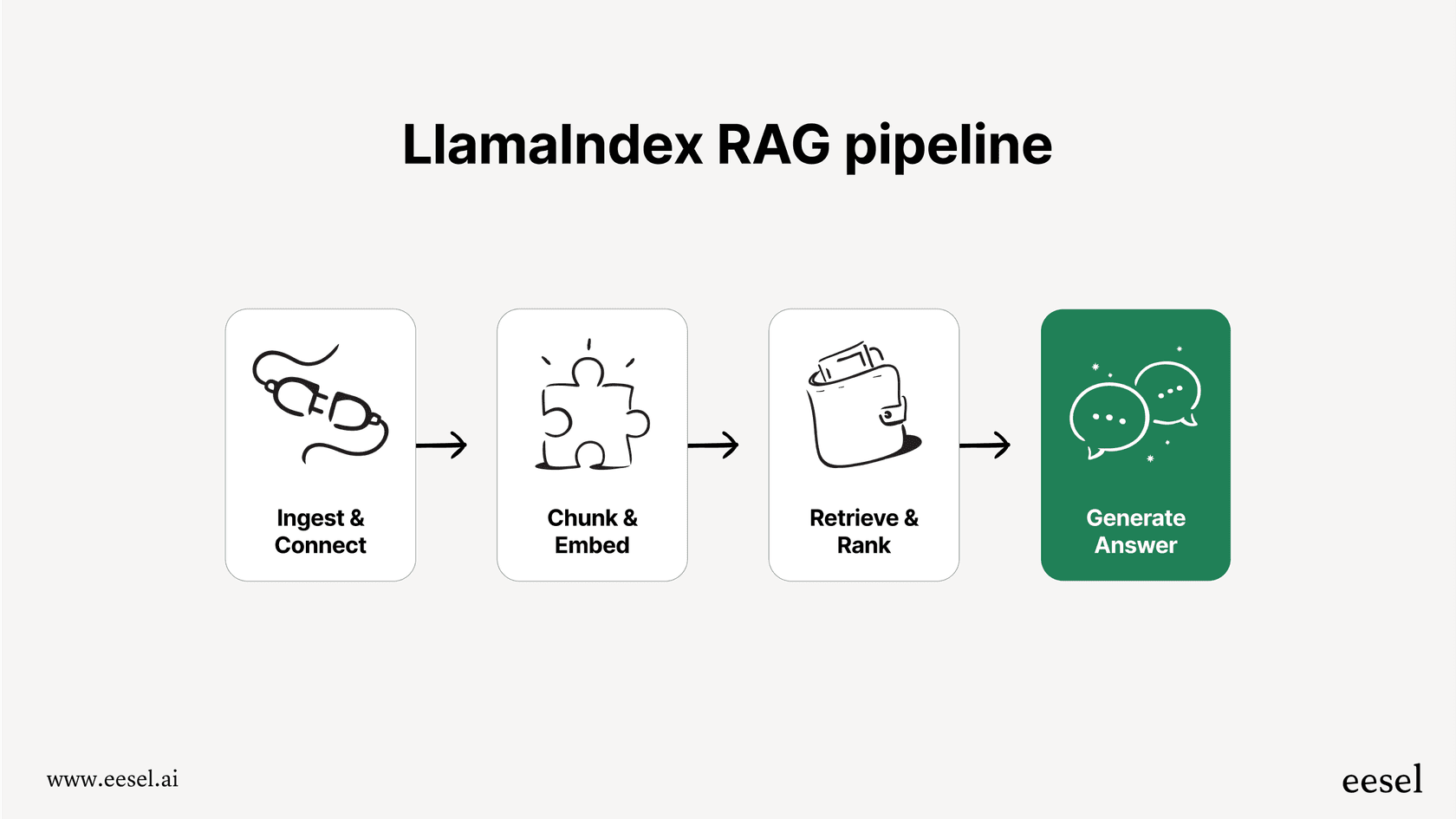

Der Prozess, der all dies ermöglicht, wird Retrieval-Augmented Generation oder RAG genannt. Es klingt ein wenig einschüchternd, aber es ist wirklich nur eine logische, vierstufige Reise von Ihren Rohdaten zu einer intelligenten, genauen Antwort von einem LLM.

Gehen wir es durch.

Schritt 1: Ihre Daten mit LlamaIndex abrufen

Zuallererst müssen Sie Ihre Daten laden. LlamaIndex verwendet dazu sogenannte "Datenkonnektoren" (oder "Loader"). Dies sind im Grunde kleine Skripte, die entwickelt wurden, um Informationen von all den verschiedenen Orten abzurufen, an denen Sie sie aufbewahren, PDFs, Datenbanken, Notion, was auch immer. Es gibt eine große Community-Bibliothek namens LlamaHub, in der Sie vorgefertigte Konnektoren für Hunderte von verschiedenen Quellen finden können.

Während es großartig ist, Optionen zu haben, taucht hier auch die erste Herausforderung auf. Sie benötigen einen Entwickler, der mit Python vertraut ist, um diese Verbindungen einzurichten und zu warten. Je nachdem, wie unordentlich Ihre Datenquellen sind, kann sich allein dieser Schritt in ein ziemlich zeitaufwändiges Engineering-Projekt verwandeln.

Schritt 2: Alles mit LlamaIndex indizieren und speichern

Sobald die Daten vorhanden sind, können Sie sie nicht einfach auf das LLM werfen. Es muss richtig strukturiert sein. Dies ist der "Indizierungs"-Teil des Prozesses.

LlamaIndex zerlegt Ihre Dokumente in kleinere, mundgerechte "Chunks" (Teilstücke). Jeder Chunk wird dann durch ein Embedding-Modell (Einbettungsmodell) geleitet, was eine elegante Art ist zu sagen, dass es den Text in eine Zahlenfolge (eine "Vektoreinbettung") umwandelt. Diese Zahlen erfassen die tatsächliche Bedeutung des Textes. All diese Vektoren werden in einer speziellen Art von Datenbank gespeichert, die als "Vektordatenbank" bezeichnet wird und so konzipiert ist, dass sie nicht nur anhand von Schlüsselwörtern, sondern auch anhand der Bedeutung durchsucht werden kann.

Schritt 3: Wie LlamaIndex die Frage des Benutzers versteht

Jetzt kommen wir zum guten Teil. Wenn ein Benutzer eine Frage stellt, durchläuft seine Abfrage genau den gleichen Prozess. Sie wird mit demselben Modell in eine Vektoreinbettung umgewandelt.

Das System geht dann zur Vektordatenbank und sucht nach den Daten-Chunks mit Einbettungen, die der Einbettung der Frage am ähnlichsten sind. Im Klartext findet es die Snippets aus Ihren Originaldokumenten, die am wahrscheinlichsten die Antwort enthalten.

Diese relevanten Informationsblöcke werden dann gebündelt und zusammen mit der Originalfrage des Benutzers an das LLM gesendet. Dies gibt dem Modell den gesamten Kontext, den es benötigt, um eine Antwort zu erstellen, die tatsächlich auf den Daten Ihres Unternehmens basiert.

Hauptmerkmale und -fähigkeiten von LlamaIndex

Über diese Kern-RAG-Pipeline hinaus bietet LlamaIndex einige weitere fortschrittliche Tools für Entwickler, die komplexere Apps erstellen möchten.

LlamaIndex Abfrage-Engines und Chatbots

Abfrage-Engines sind die Komponenten, die den gesamten Abruf- und Antwortprozess verarbeiten. Eine Steigerung davon sind "Chat-Engines", die für natürlichere, wechselseitige Gespräche entwickelt wurden. Sie können den Chatverlauf speichern, sodass der Benutzer Folgefragen stellen kann, ohne dass der Bot den Überblick über das Gespräch verliert. Auf diese Weise erstellen Sie einen benutzerdefinierten Chatbot, der sich weniger wie ein Roboter und mehr wie ein hilfreicher Assistent anfühlt.

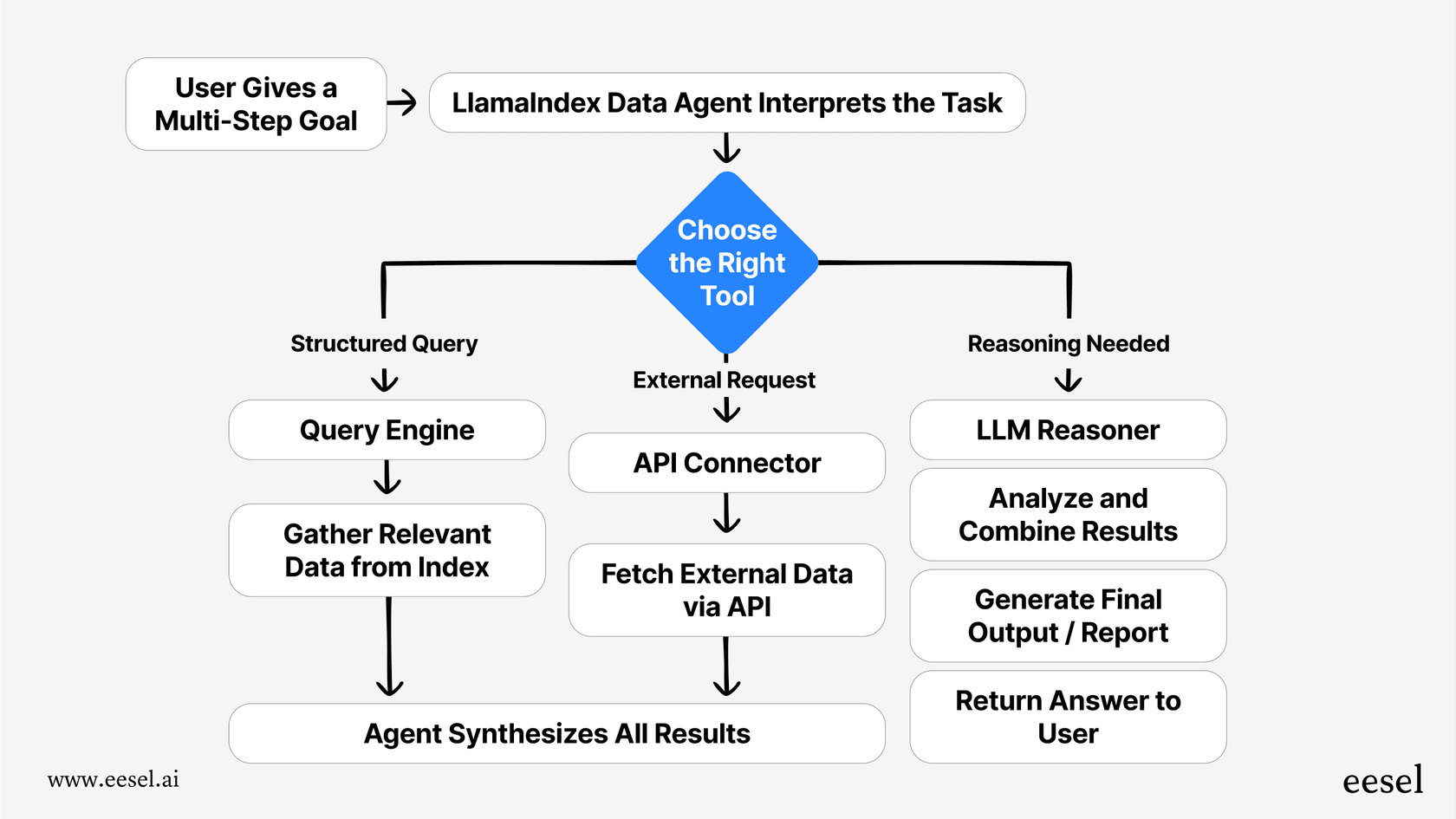

LlamaIndex Datenagenten

Datenagenten sind der Punkt, an dem die Dinge wirklich interessant und wirklich kompliziert werden. Stellen Sie sich einen Agenten als einen LLM-gestützten Mitarbeiter vor, der mehrstufige Aufgaben bewältigen kann. Sie können ihm ein übergeordnetes Ziel und Zugriff auf eine Reihe von "Tools" (wie eine Abfrage-Engine oder eine API) geben, und er wird die Schritte herausfinden, die erforderlich sind, um die Aufgabe zu erledigen.

Sie könnten beispielsweise einem Agenten sagen: "Finden Sie unseren neuesten Verkaufsbericht, fassen Sie die wichtigsten Erkenntnisse zusammen und entwerfen Sie eine E-Mail an das Vertriebsteam." Der Agent würde zuerst ein Tool verwenden, um den Bericht zu finden, ein zweites Tool, um ihn zu analysieren und zusammenzufassen, und ein drittes, um die E-Mail zu verfassen. Es ist eine unglaublich leistungsstarke Idee, aber diese Agenten zuverlässig zu machen, ist ein erheblicher technischer Aufwand, der viel Fachwissen im Systemdesign erfordert.

Häufige Anwendungsfälle und Einschränkungen von LlamaIndex

LlamaIndex gibt Ihren Entwicklern eine leistungsstarke Kiste mit LEGOs, aber es liegt ganz bei ihnen, das Endprodukt zu entwerfen und zu bauen.

Was können Sie mit LlamaIndex bauen?

-

Frage-Antwort über Ihre Dokumente: Dies ist der häufigste Anwendungsfall. Lassen Sie Mitarbeiter oder Kunden normale Fragen stellen und Antworten aus Ihren internen Wikis (Confluence, Google Docs), technischen Handbüchern oder Unternehmensberichten erhalten.

-

Benutzerdefinierte Chatbots: Sie können interne Bots erstellen, die bei IT- oder HR-Fragen helfen, oder kundenorientierte Bots, die echte Experten für Ihre Produkte sind.

-

Strukturierte Datenextraktion: Verwenden Sie ein LLM, um unordentlichen, unstrukturierten Text wie E-Mails oder Support-Tickets zu lesen und wichtige Details wie Namen, Datumsangaben oder Bestellnummern herauszuziehen und sie zur Analyse in einem sauberen, strukturierten Format zu speichern.

Was sind die geschäftlichen Einschränkungen von LlamaIndex?

Während LlamaIndex ein aufregendes Tool für Entwickler ist, gibt es einige sehr reale geschäftliche Einschränkungen, die am Anfang leicht zu übersehen sind.

-

Es erfordert ernsthafte technische Fähigkeiten: Seien wir klar, LlamaIndex ist ein Framework für Entwickler. Dies ist kein Tool, das Ihr Support-Team einfach in die Hand nehmen und verwenden kann. Sie benötigen ein Team von Python-Ingenieuren, idealerweise mit etwas KI-Erfahrung, um alles, was Sie damit erstellen, zu erstellen, zu starten und zu warten.

-

Die Gesamtkosten sind viel mehr als "kostenlos": Das Open-Source-Framework kostet nichts, aber das ist nur die Spitze des Eisbergs. Die tatsächlichen Kosten sind die Gehälter für die Entwickler, die es erstellen, die monatlichen Rechnungen für Server und Vektordatenbanken sowie die ständige Entwicklungszeit, die für Fehlerbehebungen und Updates benötigt wird.

-

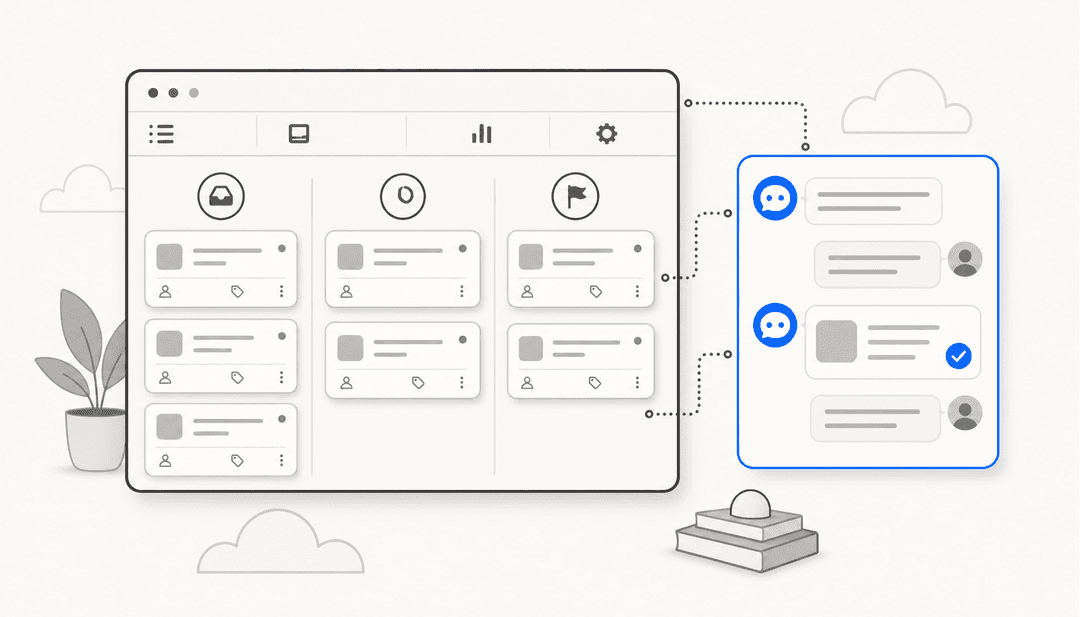

Sie müssen alles darum herum bauen: LlamaIndex stellt den Motor zur Verfügung, aber Sie müssen das gesamte Auto selbst bauen. Das bedeutet, die Benutzeroberfläche, ein Admin-Panel für Ihr Team, Reporting-Dashboards zu erstellen und es vor allem in die Tools zu integrieren, die Sie bereits verwenden, wie Zendesk oder Slack. All diese kundenspezifische Entwicklung kann Monate dauern, was bedeutet, dass Sie lange warten, um einen Wert zu sehen.

LlamaCloud Preisgestaltung

Das Unternehmen hinter dem LlamaIndex-Framework bietet ein kommerzielles Produkt namens LlamaCloud an. Es wurde entwickelt, um Ihnen einen Teil der Knochenarbeit abzunehmen, insbesondere die Teile zum Parsen, Erfassen und Indizieren von Dokumenten.

Es ist jedoch wichtig zu verstehen, was LlamaCloud nicht tut. Es erstellt nicht die endgültige Anwendung für Sie. Es ist ein Managed Service, der die ersten beiden Schritte der RAG-Pipeline vereinfacht. Ihr Engineering-Team muss weiterhin die Abfrage-Engines, Agenten, Benutzeroberfläche und die gesamte Geschäftslogik erstellen. Die Preisgestaltung basiert auf Credits, wobei 1.000 Credits 1 US-Dollar kosten.

| Plan | Kostenlos | Starter | Pro | Unternehmen |

|---|---|---|---|---|

| Enthaltene Credits | 10K | 50K | 500K | Benutzerdefiniert |

| Pay-as-you-go Credits | 0 | bis zu 500K (500 $) | bis zu 5.000K (5.000 $) | Benutzerdefiniert |

| Benutzer | 1 | 5 | 10 | Unbegrenzt |

| Datenquellen | 0 | 50 | 100 | Unbegrenzt |

| Support | Basic | Basic | Basic | Dediziert |

Selbst mit LlamaCloud liegt der Großteil der Arbeit, wie das Erstellen der tatsächlichen Workflows und der Benutzeroberfläche, immer noch bei Ihrem Team.

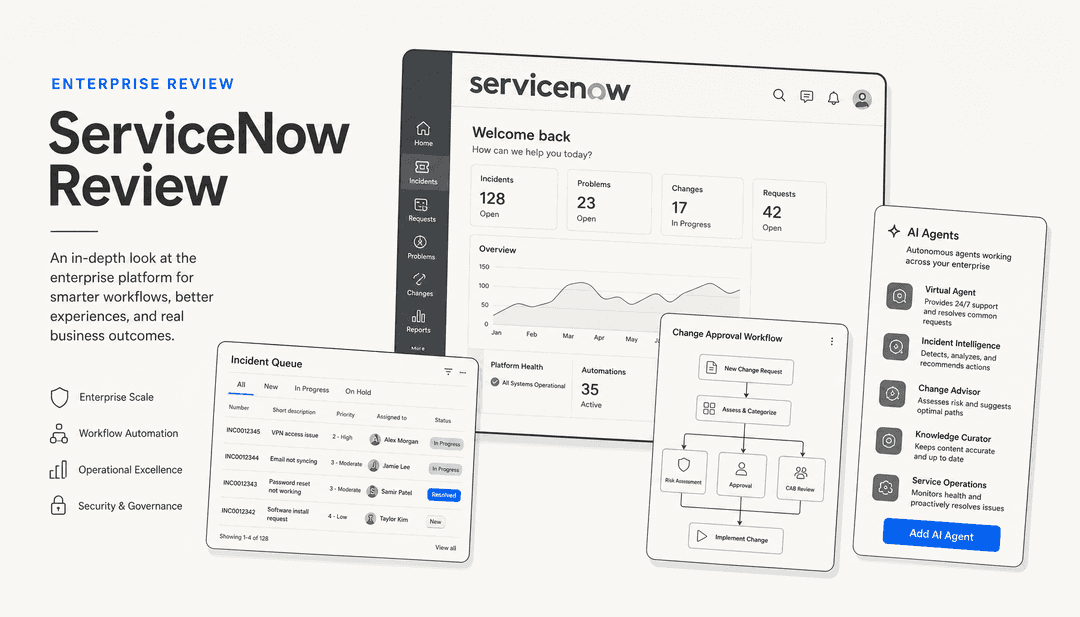

Die Alternative zu LlamaIndex: Eine verwaltete KI-Plattform

Die Entscheidung für die Verwendung von LlamaIndex läuft wirklich auf die klassische "Bauen vs. Kaufen"-Debatte hinaus. Wenn Sie ein Technologieunternehmen mit einer großen Anzahl von Ingenieuren sind und eine vollständig benutzerdefinierte KI-App von Grund auf neu bauen möchten, ist LlamaIndex eine fantastische Option.

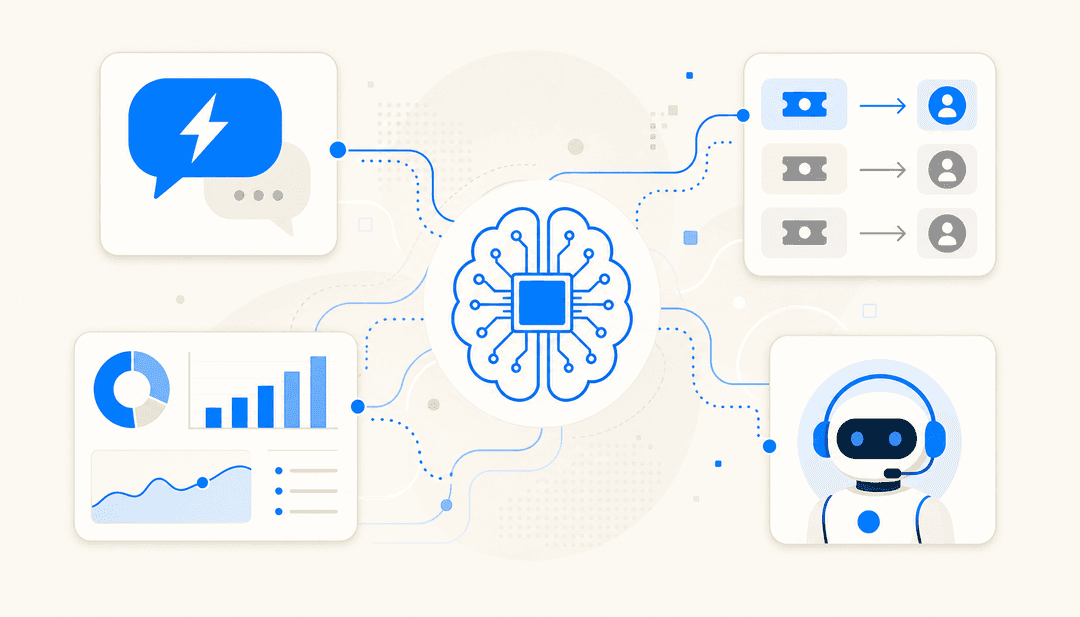

Aber was ist, wenn Sie ein Unternehmen sind, das KI nur verwenden möchte, um ein Problem zu lösen, z. B. heute? Für die meisten Teams ist die bessere Alternative eine vollständig verwaltete End-to-End-KI-Plattform. Hier kommt ein Tool wie eesel AI ins Spiel. Es erledigt all die komplizierten Dinge unter der Haube, Datenerfassung, Indizierung, RAG-Pipelines und liefert eine Lösung, die Sie in Minuten, nicht in Monaten, verwenden können.

| Funktion | LlamaIndex (DIY-Ansatz) | eesel AI (Verwaltete Plattform) |

|---|---|---|

| Einrichtungszeit | Wochen bis Monate | In wenigen Minuten live gehen |

| Erforderliche Fähigkeiten | Python-Entwickler, KI/ML-Ingenieure | Nicht-technische Benutzer |

| Integrationen | Erfordert Codierung für jede Verbindung | 100+ One-Click-Integrationen (Zendesk, Slack usw.) |

| Workflows | Muss von Grund auf neu erstellt werden | Vollständig anpassbare Workflow-Engine |

| Testen | Manuelles Testen, benutzerdefinierte Skripte erforderlich | Integrierte Simulation über historische Tickets |

| Wartung | Laufender Engineering-Aufwand | Vollständig verwaltet und gewartet von eesel AI |

Folgendes macht eine verwaltete Plattform wie eesel AI wirklich anders:

-

Es ist wirklich Self-Service: Sie können sich anmelden, Ihren Helpdesk wie Freshdesk oder Intercom verbinden, ihn auf Ihre Wissensquellen verweisen und einen funktionierenden KI-Agenten haben, ohne jemals mit einem Vertriebsmitarbeiter sprechen zu müssen.

-

Sie erhalten die volle Kontrolle, ohne Code zu schreiben: Eine einfache, visuelle Oberfläche ermöglicht es Ihnen, genau zu entscheiden, welche Tickets die KI bearbeiten soll, ihre Persönlichkeit anzupassen und benutzerdefinierte Aktionen einzurichten (wie das Nachschlagen von Bestelldetails von Shopify). Keine Entwickler erforderlich.

-

Sie können es mit Zuversicht testen: Bevor Ihre KI jemals mit einem echten Kunden spricht, können Sie eine Simulation mit Tausenden Ihrer vergangenen Support-Tickets durchführen. Sie sehen genau, wie sie reagiert hätte, und erhalten eine solide Prognose Ihrer Automatisierungsrate. Sie können mit dem Wissen starten, was Sie genau erwartet.

Beginnen Sie noch heute mit einer speziell entwickelten KI-Lösung

LlamaIndex ist ein ausgezeichnetes, flexibles Framework für Entwicklungsteams, die die Zeit, das Budget und das spezifische Fachwissen haben, um benutzerdefinierte LLM-Anwendungen von Grund auf neu zu erstellen. Es gibt Ihnen die vollständige Kontrolle, was großartig ist, wenn Sie sie benötigen.

Für die meisten Unternehmen ist es jedoch nicht das Ziel, ein KI-Framework zu erstellen, sondern Probleme zu lösen und die Dinge jetzt effizienter zu gestalten. Dafür ist eine verwaltete Plattform fast immer der praktischere und kostengünstigere Weg.

Mit eesel AI erhalten Sie die gesamte Leistung eines kundenspezifischen RAG-Systems mit der Einfachheit eines Self-Service-Tools. Es verbindet sich mit Ihrem Wissen, wird in die Tools integriert, die Sie bereits verwenden, und gibt Ihnen die Kontrolle, die Sie benötigen, um sicher zu automatisieren.

Anstatt die nächsten Monate damit zu verbringen, die Sanitäranlagen zu bauen, könnten Sie Support-Tickets noch heute Nachmittag automatisieren. Starten Sie Ihre kostenlose Testversion oder buchen Sie eine Demo, um zu sehen, wie es für Ihr Team funktionieren kann.

Häufig gestellte Fragen

LlamaIndex ist ein Open-Source-Framework, das entwickelt wurde, um Large Language Models (LLMs) mit Ihren privaten Daten zu verbinden. Es erstellt eine Pipeline, die Ihre unternehmensspezifischen Informationen an ein LLM weiterleitet, sodass dieses Antworten generieren kann, die auf Ihrem internen Wissen und nicht nur auf öffentlichen Internetdaten basieren.

Mit LlamaIndex beginnt die RAG-Pipeline mit dem Laden Ihrer Daten mithilfe von Konnektoren und dem anschließenden Indizieren, indem Text in numerische Einbettungen konvertiert wird, die in einer Vektordatenbank gespeichert sind. Wenn ein Benutzer eine Abfrage durchführt, wird die Frage ebenfalls eingebettet, mit relevanten Datenblöcken abgeglichen und diese Blöcke werden dann an das LLM gesendet, um eine kontextbezogene Antwort zu generieren.

Sie können robuste Frage-Antwort-Systeme über Ihre internen Dokumente erstellen, benutzerdefinierte Chatbots für den Kundensupport oder die interne Personalabteilung erstellen und es sogar für die strukturierte Datenextraktion aus unstrukturiertem Text wie E-Mails oder Support-Tickets verwenden.

LlamaIndex erfordert erhebliche technische Fähigkeiten von Python- und KI-Ingenieuren für die Einrichtung und Wartung. Während das Framework kostenlos ist, umfassen die Gesamtkosten Entwicklergehälter, Infrastruktur und laufende Entwicklungszeit. Sie müssen auch alle umliegenden Komponenten wie Benutzeroberfläche, Admin-Panels und Integrationen von Grund auf neu erstellen.

Während das Kern-Framework von LlamaIndex kostenlos ist, entstehen Unternehmen erhebliche Kosten durch Entwicklergehälter für den Aufbau und die Wartung der Anwendung, monatliche Rechnungen für Server und Vektordatenbanken sowie kontinuierliche Entwicklungsarbeit für Updates und Fehlerbehebungen. Der Aspekt „kostenlos“ bezieht sich nur auf das Framework selbst, nicht auf die gesamte Lösung.

LlamaCloud ist ein kommerzielles Produkt, das von dem Unternehmen hinter dem LlamaIndex-Framework angeboten wird. Es bietet einen Managed Service speziell für die Datenerfassung, das Parsen und das Indizieren von Teilen der RAG-Pipeline, wodurch die ersten Schritte vereinfacht werden. Ihr Engineering-Team ist jedoch weiterhin für den Aufbau der Abfrage-Engines, Agenten, Benutzeroberfläche und Geschäftslogik für die endgültige Anwendung verantwortlich.

Die Verwendung von LlamaIndex ist ideal, wenn Ihr Unternehmen über ein engagiertes Team von KI/ML-Ingenieuren verfügt, ausreichend Zeit und Budget, um eine hochgradig angepasste LLM-Anwendung von Grund auf neu zu erstellen, die eine vollständige Kontrolle erfordert. Für die meisten Unternehmen, die Probleme schnell und effizient ohne umfangreiche kundenspezifische Entwicklung lösen möchten, ist eine vollständig verwaltete End-to-End-KI-Plattform oft eine praktischere und schnellere Lösung.

Share this article

Article by

Stevia Putri

Stevia Putri ist Marketing-Generalistin bei eesel AI, wo sie dazu beiträgt, leistungsstarke KI-Tools in Geschichten zu verwandeln, die Anklang finden. Sie wird von Neugier, Klarheit und der menschlichen Seite der Technologie angetrieben.