OpenAI hat vor Kurzem GPT 5.2 veröffentlicht, ihr selbst ernanntes „fortschrittlichstes Modell“. Die Ankündigung war mit beeindruckenden Benchmarks verbunden, die signifikante Fortschritte in den Bereichen Coding, logisches Schlussfolgern (Reasoning) und Bilderkennung (Vision) versprachen. Auf dem Papier sieht es unglaublich aus.

Seit der Veröffentlichung für die Nutzer ist die Resonanz jedoch eher gemischt. Es scheint eine Lücke zwischen den Labortests und dem zu geben, was die Menschen im täglichen Gebrauch erleben. Was ist also die wahre Geschichte?

Dieser Beitrag bietet einen ausgewogenen Blick darauf, was GPT 5.2 ist, was es verspricht, wo es scheinbar hinter den Erwartungen zurückbleibt und was das alles für Unternehmen bedeutet, die nach KI-Lösungen suchen.

Was ist GPT 5.2? Eine Familie neuer Modelle

Zunächst einmal ist GPT 5.2 nicht nur ein einzelnes Modell. Es ist die neueste Serie von großen Sprachmodellen (Large Language Models) von OpenAI, die für komplexe, professionelle Aufgaben entwickelt wurden. Es handelt sich um eine Familie von Optionen, wobei jede auf unterschiedliche Bedürfnisse und Preispunkte zugeschnitten ist.

Laut der offiziellen Ankündigung von OpenAI gliedert sich die Familie wie folgt auf:

-

GPT-5.2 Instant: Dies ist die schnelle Version, die für alltägliche Aufgaben und das Lernen innerhalb von ChatGPT konzipiert wurde. Sie ist für schnelle Antworten optimiert.

-

GPT-5.2 Thinking: Dies ist das Kernmodell für tiefere, komplexere Arbeiten wie Coding und Analysen. Wenn Sie die API nutzen, ist dies das Modell, das Sie mit

gpt-5.2aufrufen. -

GPT-5.2 Pro: Die leistungsstärkste und präziseste Option im Sortiment. Sie ist für schwierige Fragestellungen gedacht, bei denen die bestmögliche Antwort die oberste Priorität hat.

Zusätzlich zu diesen hat OpenAI auch GPT-5 mini als kleinere, effizientere Option sowie ein spezialisiertes GPT-5.2-Codex für Entwickler eingeführt. Es ist klar, dass sie versuchen, alle Bereiche abzudecken, indem sie eine Reihe von Modellen anbieten.

Die offizielle Geschichte: Neue Funktionen und behauptete Verbesserungen

Basierend auf den Einführungsunterlagen von OpenAI zeigt das Modell deutliche Fortschritte gegenüber früheren Versionen. Lassen Sie uns die Schlüsselbereiche aufschlüsseln, in denen GPT 5.2 laut der offiziellen Dokumentation besonders gut abschneiden soll.

Verbesserte Leistung bei professionellen Aufgaben

Eines der Versprechen von GPT 5.2 ist die Art und Weise, wie es professionelle Wissensarbeit bewältigt und einen höheren wirtschaftlichen Nutzen freisetzt. OpenAI behauptet, dass es viel besser darin ist, Tabellenkalkulationen zu erstellen, Präsentationen zu entwerfen und anspruchsvollen Code zu schreiben als seine Vorgänger.

Um dies zu belegen, verweisen sie auf den GDPval-Benchmark, bei dem das Modell angeblich Branchenexperten bei über 70 % der Aufgaben übertrifft. Die Verbesserungen beim Coding sind besonders bemerkenswert; das Modell erreichte neue Bestwerte bei schwierigen Benchmarks wie SWE-Bench Pro (55,6 %). Die Idee dahinter ist, dass es nun komplexere Software-Engineering-Probleme bewältigen kann und über das bloße Generieren einfacher Skripte hinausgeht.

Stärkere logische Schlussfolgerung, Vision und Long-Context-Fähigkeiten

OpenAI hebt auch die Fähigkeit des Modells hervor, komplexe Informationen logisch zu durchdringen, insbesondere bei langen Dokumenten. Der „Nadel im Heuhaufen“-Test (Needle in a Haystack) von OpenAI (OpenAI MRCRv2), der prüft, ob ein Modell spezifische Informationen in einem großen Textkörper finden kann, zeigte eine nahezu perfekte Genauigkeit. Dies deutet darauf hin, dass Sie dem Modell einen langen Bericht vorlegen und darauf vertrauen können, dass es die benötigten Details extrahiert.

Auch die Bilderkennungsfähigkeiten (Vision) wurden verbessert, wobei die Fehlerraten bei Aufgaben wie dem Analysieren von Diagrammen und dem Verständnis von Software-Benutzeroberflächen etwa um die Hälfte gesenkt wurden. Theoretisch können Sie ihm ein komplexes Dashboard oder das Diagramm einer Hauptplatine zeigen, und es wird ein viel besseres räumliches Verständnis von dem haben, was es sieht. Zudem erzielte es Bestnoten in wissenschaftlichen und mathematischen Benchmarks wie GPQA Diamond (92,4 %) und FrontierMath (40,3 %), was die Grenzen dessen, was KI in hochtechnischen Bereichen leisten kann, verschiebt.

Zuverlässigere Tool-Aufrufe für agentische Workflows

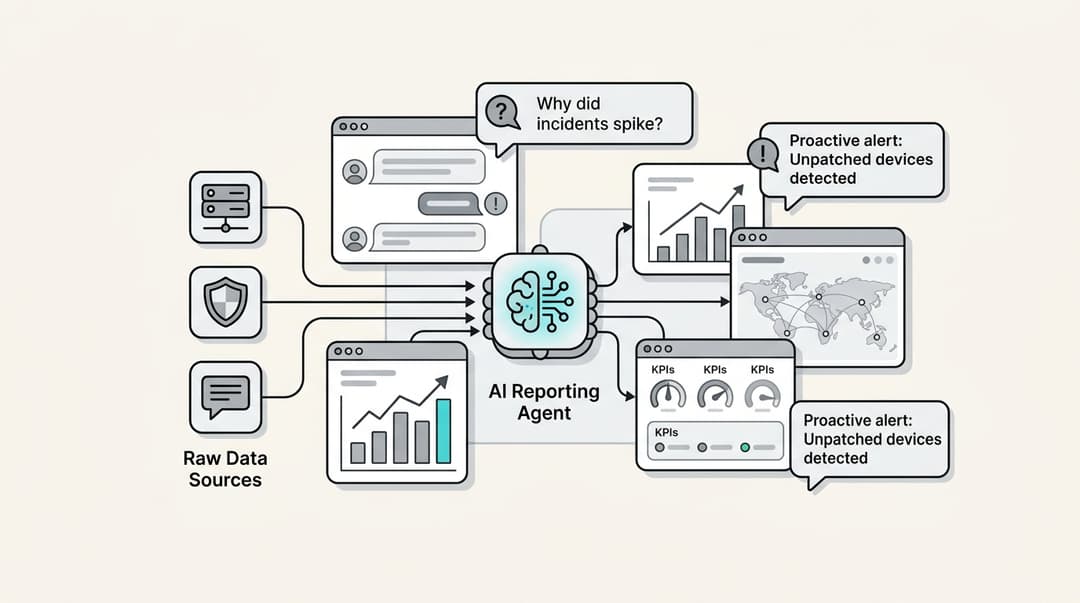

Dies ist eine eher technische Funktion, aber sie ist entscheidend für den Aufbau praktischer KI-Anwendungen. „Tool Calling“ (Tool-Aufrufe) beschreibt, wie ein KI-Modell mit anderer Software interagiert, um Aktionen auszuführen – etwa eine Bestellung in Shopify nachzuschlagen oder ein Ticket in Jira zu erstellen. GPT 5.2 wurde entwickelt, um diese komplexen, mehrstufigen Aufgaben von Anfang bis Ende viel besser auszuführen.

Es erreichte beeindruckende 98,7 % im Tau2-bench Telecom Benchmark, einem Test, der darauf ausgelegt ist, Kundensupport-Aufgaben mit mehreren Interaktionsrunden zu simulieren. In der Praxis bedeutet dies, dass Sie zuverlässigere KI-Agenten bauen können, die ganze Workflows abwickeln können, wie zum Beispiel das Lösen eines Versandproblems eines Kunden oder das Analysieren von Verkaufsdaten, und das mit weniger Fehlern.

Einführung von GPT-5.2-Codex für fortgeschrittenes Coding

Für Entwickler hat OpenAI zusätzlich GPT-5.2-Codex veröffentlicht, eine Version des Modells, die speziell für „Software-Engineering und Cybersicherheit“ optimiert wurde. Dies ist nicht nur dazu da, ein paar Zeilen Code zu schreiben; es ist darauf ausgelegt, große Codebasen zu verarbeiten und bei langen, komplexen Aufgaben wie Code-Migrationen und Refactorings zu unterstützen.

Es bietet zudem ein verbessertes Sicherheitsbewusstsein. Derzeit ist es in Codex-Oberflächen für zahlende ChatGPT-Nutzer verfügbar, wobei der API-Zugriff für einen späteren Zeitpunkt geplant ist. Dies unterstreicht den Fokus von OpenAI darauf, seine Modelle zu unverzichtbaren Werkzeugen für Software-Entwicklungsteams zu machen.

Erfahrungen aus der Praxis: Ein gemischtes Bild beim Nutzerfeedback

Benchmarks sind das eine, aber der wahre Test ist die Leistung des Modells für echte Menschen in ihrer täglichen Arbeit. Seit der Veröffentlichung von GPT 5.2 war das Feedback in Entwicklerforen und in Publikationen wie Medium sehr unterschiedlich.

Viele Nutzer stoßen auf Probleme, die Benchmarks schlichtweg nicht erfassen, was eine Lücke zwischen der beworbenen Leistung und der täglichen Realität entstehen lässt.

Bedenken hinsichtlich des Tonfalls und vermehrte Ablehnungen

Eine der häufigsten Beschwerden betrifft die Persönlichkeit des Modells. Viele Nutzer beschreiben den Tonfall als „flacher und übermäßig bereinigt“, als wäre es darauf trainiert worden, so vorsichtig zu sein, dass es weniger in der Lage ist, zu improvisieren oder Kreativität zu zeigen.

Ich will keinen Ja-Sager, aber ich will auch keinen misstrauischen, paranoiden Assistenten, der denkt, ich würde bei jeder Anfrage einen Jailbreak versuchen, selbst bei grenzwertigen. Wir sprachen über Online-Betrug, ich bat ihn, diesen Betrug auf einfache Weise zu erklären, und er sagte: 'Ich kann Betrug nicht fördern'... Verdammt, aber ich habe ihn gebeten, es einfach zu erklären, nicht zu betrügen!!!

Dies hängt mit einem weiteren großen Problem zusammen: vermehrte Ablehnungen. Nutzer berichten, dass das Modell nun übervorsichtig ist und sich manchmal weigert, Themen zu diskutieren oder Aufgaben zu erledigen, die frühere Versionen problemlos bewältigt haben. Für jeden, der sich beim kreativen Schreiben, Brainstorming oder der Erkundung nuancierter Themen auf das Modell verlässt, kann dies eine Herausforderung darstellen. Es fühlt sich für einige Nutzer wie ein Rückschritt in der Benutzerfreundlichkeit an, selbst wenn die zugrunde liegende Technologie leistungsfähiger ist.

Inkonsistente Leistung und Kontextprobleme

Noch besorgniserregender sind die Berichte über inkonsistente Leistungen. Einige Nutzer haben das Gefühl, dass das Modell bei ihren spezifischen Aufgaben weniger effektiv zu sein scheint als GPT-4. Es mag in einem Benchmark-Test gut abschneiden, scheitert dann aber an einem Problem, das den gesunden Menschenverstand erfordert.

Das Nervigste, was mir aufgefallen ist: Ich frage etwas und es antwortet. Dann frage ich etwas anderes und es beantwortet die erste Frage zusammen mit der zweiten Frage noch einmal.

Eine weitere häufige Beschwerde ist, dass das Modell bei langen Gesprächen den Kontext verliert oder sich selbst widerspricht. Dies kommt unerwartet, da OpenAI die Leistung bei Long-Context-Benchmarks so betont hat. Wie ein Rezensent es ausdrückte: „Benchmarks sind sauber. Echte Dokumente sind es nicht“. Anwendungsfälle in der realen Welt sind chaotisch, und es scheint, dass das Modell immer noch stolpern kann. Diese Inkonsistenz macht es für Unternehmen schwierig, zuverlässige Workflows auf Basis des reinen Modells aufzubauen. Es erfordert möglicherweise ein sorgfältigeres Prompt Engineering, um das gewünschte Ergebnis zu erzielen.

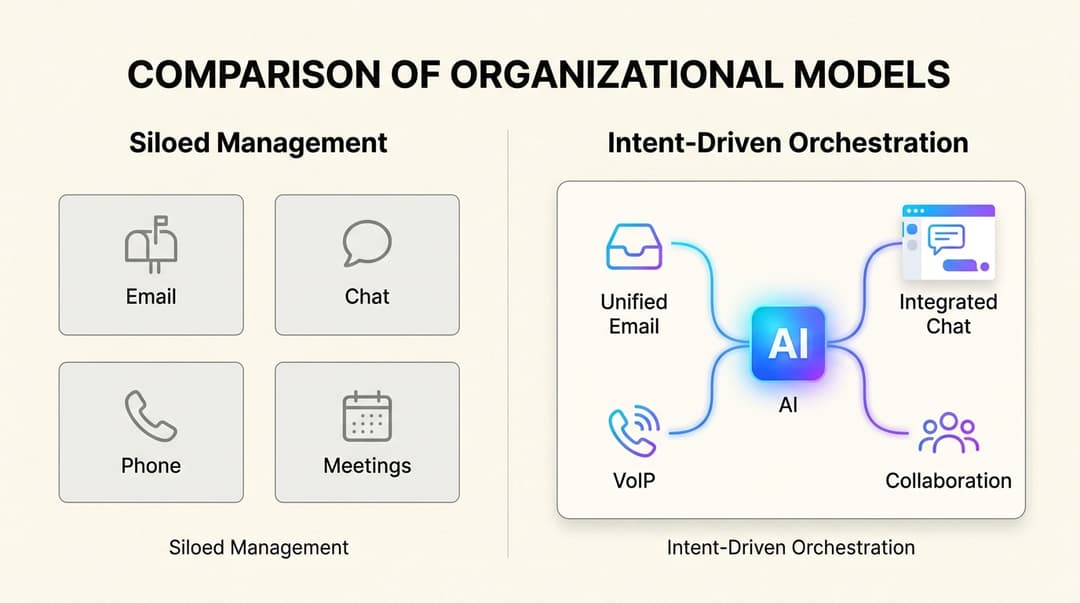

Für geschäftliche Anwendungen wie KI im Kundenservice ist Vorhersehbarkeit wichtig. Spezialisierte Plattformen wie eesel AI sind darauf ausgelegt, eine konsistente und markengerechte Leistung zu erbringen. Diese Plattformen lernen direkt aus den eigenen Daten eines Unternehmens und vergangenen erfolgreichen Gesprächen, um maßgeschneiderte Antworten zu liefern.

Preisgestaltung und Zugänglichkeit verstehen

Abgesehen von der Leistung sind die Kosten und die Zugänglichkeit eines neuen Modells enorme Faktoren für jedes Unternehmen. GPT 5.2 kommt mit einer neuen Preisstruktur, die es als Premium-Modell für Unternehmen positioniert. Schauen wir uns die Zahlen auf der offiziellen Preisseite von OpenAI an.

API-Preisstruktur

Die Standard-API-Preise für die neuen Modelle liegen deutlich über denen früherer Versionen, was signalisiert, dass diese Leistung ihren Preis hat. Für Unternehmen, die asynchrone Aufgaben bewältigen können (also keine sofortige Antwort benötigen), bietet OpenAI auch eine Batch API an, die einen Rabatt von 50 % gewährt – ein Anreiz für nicht dringende Workloads.

Hier ist eine klare Aufschlüsselung der Standardkosten pro Million Token für Input und Output, die Ihnen beim Vergleich der Optionen helfen soll. Dieser visuelle Vergleich verdeutlicht den erheblichen Kostenunterschied zwischen den Modellen.

| Modell | Input (pro 1 Mio. Token) | Output (pro 1 Mio. Token) |

|---|---|---|

| gpt-5.2-pro | 21,00 $ | 168,00 $ |

| gpt-5.2 | 1,75 $ | 14,00 $ |

| gpt-5-mini | 0,25 $ | 2,00 $ |

Was diese Preisgestaltung für Unternehmen bedeutet

Was bedeutet diese Preisgestaltung nun konkret? GPT 5.2 ist ein mächtiges, aber rohes Material. Die variablen, tokenbasierten Kosten können die Budgetplanung für KI erschweren, insbesondere wenn Modellinkonsistenzen bedeuten, dass Sie denselben Prompt mehrmals ausführen müssen, um ein brauchbares Ergebnis zu erhalten. Jeder Versuch kostet Geld.

Der höhere Preis von gpt-5.2-pro, insbesondere für den Output, bedeutet, dass es sich wahrscheinlich am besten für sehr spezifische, hochwertige Aufgaben eignet, bei denen die Kosten gerechtfertigt werden können. Für viele alltägliche Geschäftsanforderungen ist es möglicherweise nicht erforderlich.

Unternehmen, die nach berechenbaren KI-Kosten suchen, könnten andere Modelle in Betracht ziehen. Beispielsweise bieten einige Dienste wie eesel AI eine interaktionsbasierte Preisgestaltung an. Bei diesem Modell sind die Kosten an Ergebnisse gebunden (wie ein gelöstes Ticket) und nicht an die Token-Berechnung. Dieser Ansatz kann die Kostenprognose und die Messung des ROI vereinfachen.

Ist GPT 5.2 ein mächtiges Werkzeug, das eine sorgfältige Handhabung erfordert?

Was ist also das abschließende Fazit zu GPT 5.2? Einerseits setzt es neue Rekorde bei technischen Benchmarks und stellt eine unglaubliche technische Leistung dar. Andererseits bringt es Herausforderungen bei der Konsistenz und Benutzerfreundlichkeit in realen Anwendungen mit sich, wobei einige Erstanwender von einer Lücke zwischen der Benchmark-Leistung und ihrer Erfahrung berichten.

Für technische Teams mit Zeit, Budget und Fachwissen zum Experimentieren, zur Feinabstimmung von Prompts und zum Aufbau umfassender Sicherheitsvorkehrungen (Guardrails) bietet es eine enorme Leistungsfähigkeit.

Viele Unternehmen möchten jedoch nicht direkt mit einem rohen KI-Modell arbeiten. Sie suchen nach Lösungen für spezifische Probleme, wie die Reduzierung von Support-Tickets oder den Zugriff auf internes Wissen. Das Ziel ist das Ergebnis, nicht der Prozess.

Eine Alternative zum Eigenbau ist die Nutzung einer spezialisierten Lösung. eesel AI bietet Produkte an, die für spezifische Geschäftsanforderungen entwickelt wurden. Es lernt aus Unternehmensdaten, um Antworten zu geben, die auf den Kontext der Organisation zugeschnitten sind. Erfahren Sie, wie ein KI-Agent noch heute damit beginnen kann, Ihre Support-Tickets zu lösen.

Um einige dieser Praxistests in Aktion zu sehen, bietet dieses Video von Fireship eine schnelle und aufschlussreiche Analyse der Leistung von GPT 5.2 und zeigt sowohl die Stärken als auch die Punkte auf, an denen es hinter dem Hype zurückzubleiben scheint.

Häufig gestellte Fragen

GPT 5.2 ist die neueste Serie von Sprachmodellen von OpenAI, die für komplexe professionelle Aufgaben entwickelt wurde. Es handelt sich nicht um ein einzelnes Modell, sondern um eine Familie (Instant, Thinking, Pro und mini), die im Vergleich zu älteren Versionen wie GPT-4 große Verbesserungen beim Coding, beim logischen Schlussfolgern und beim Verständnis langer Dokumente verspricht.

Laut den Benchmarks von OpenAI ja. Sie haben ein spezialisiertes Modell namens GPT-5.2-Codex veröffentlicht, das bei schwierigen Software-Engineering-Tests besser abschnitt. Einige Entwickler in der Praxis haben jedoch von gemischten Ergebnissen berichtet, sodass Ihre persönlichen Erfahrungen variieren können.

Dies scheint an mehreren Faktoren zu liegen. Nutzer haben darauf hingewiesen, dass der Tonfall von GPT 5.2 „flach“ oder übermäßig vorsichtig wirken kann, was dazu führt, dass es bestimmte Aufgaben ablehnt. Andere haben festgestellt, dass es Probleme mit der Konsistenz hat und in langen Gesprächen den Kontext verlieren kann, was in sauberen Benchmark-Tests nicht immer erfasst wird.

Die Preise für GPT 5.2 variieren je nach Modell. Das Standardmodell `gpt-5.2` kostet 1,75 $ für den Input und 14,00 $ für den Output pro Million Token. Die leistungsstärkste Version, `gpt-5.2-pro`, ist mit 21,00 $ für den Input und 168,00 $ für den Output pro Million Token deutlich teurer.

Obwohl dies möglich ist, sind die Leistungsschwankungen des Modells und die tokenbasierten Kosten Faktoren, die man bei kritischen Funktionen wie dem Kundensupport berücksichtigen muss. Unternehmen nutzen oft spezialisierte Plattformen wie eesel AI, die auf unternehmensspezifischen Daten trainiert sind, um konsistente Antworten für diese Anwendungsfälle zu liefern.

Share this article

Article by

Stevia Putri

Stevia Putri ist Marketing-Generalistin bei eesel AI, wo sie dabei hilft, leistungsstarke KI-Tools in Geschichten zu verwandeln, die Anklang finden. Sie wird von Neugier, Klarheit und der menschlichen Seite der Technologie angetrieben.