Blog

Tipps, Anleitungen und Einblicke zu KI-Teamkollegen, smarterem Support und dem Aufbau besserer Teams.

ChatGPT Images 2.0: Die Ära des visuellen Schlussfolgerns ist 2026 angebrochen

Bei ChatGPT Images 2.0 geht es nicht nur um bessere Bilder – es ist ein System für „visuelles Schlussfolgern“, das Kontext, Logik und Informationshierarchie versteht.

CapCut Preise 2026: Ein vollständiger Leitfaden zu kostenlosen, Standard- und Pro-Plänen

Verwirrt von den jüngsten Preisänderungen bei CapCut? Sie sind nicht allein. Unser Leitfaden für 2026 entschlüsselt die kostenlosen, Standard- und Pro-Pläne und vergleicht Funktionen, Kosten und was Sie wirklich für Ihr Geld bekommen.

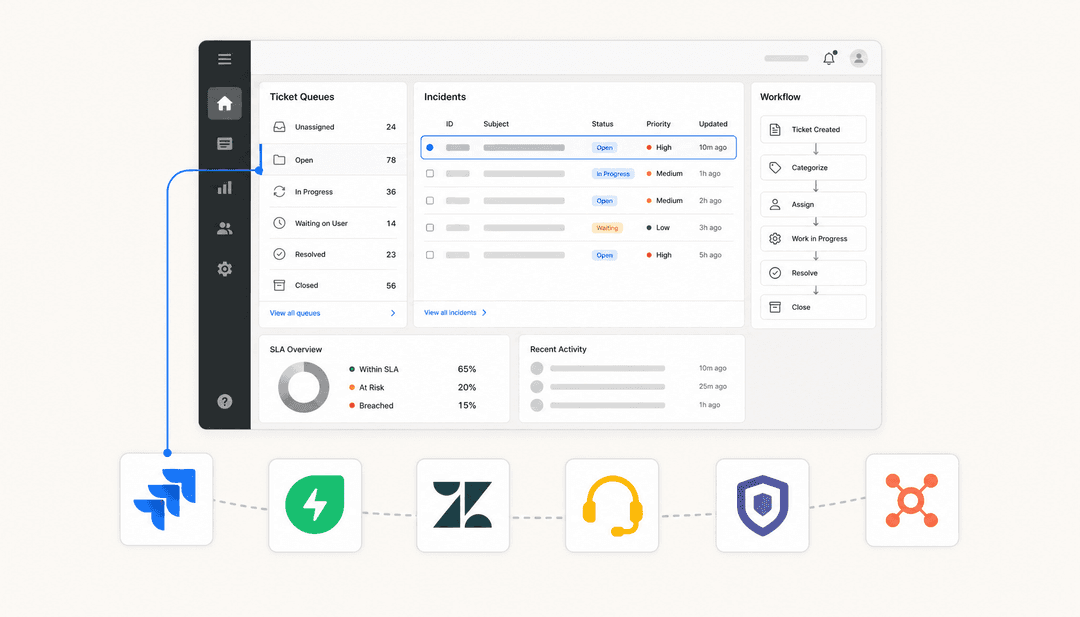

Die besten ServiceNow-Alternativen 2026

ServiceNow ist für Fortune-500-Unternehmen konzipiert. Hier sind 5 Alternativen, die denselben ITSM-Funktionsumfang mit weniger Komplexität und transparenter Preisgestaltung bieten.

IT-Helpdesk-KI 2026: 6 Tools, die es wert sind

Sechs IT-Helpdesk-KI-Tools im Vergleich für 2026: eesel AI, ServiceNow, Freshservice, Jira Service Management, ManageEngine und Zendesk.

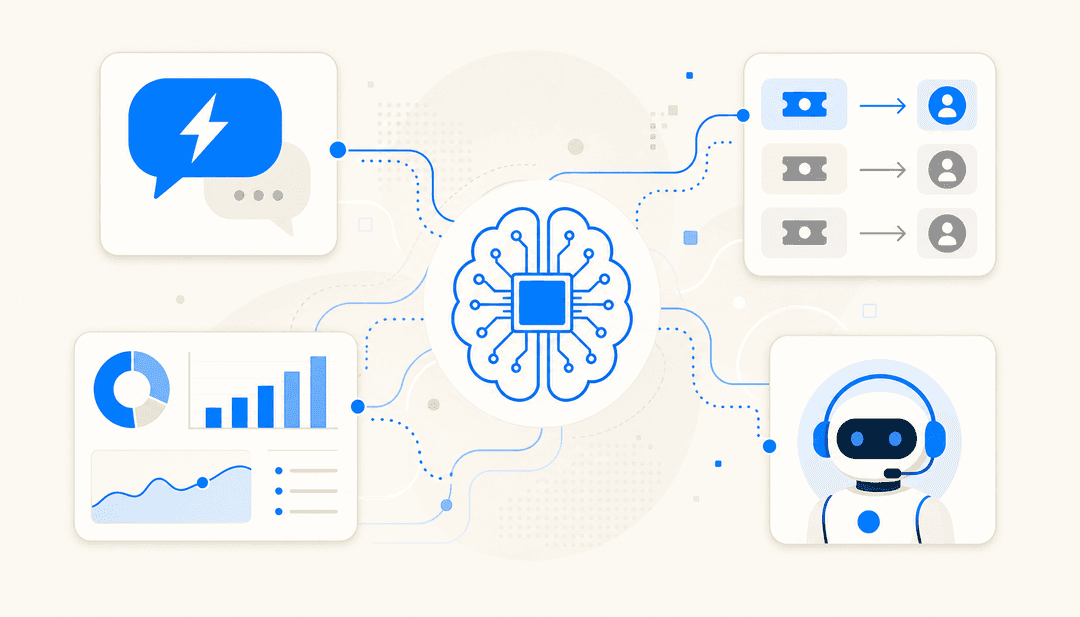

KI-gestütztes ITSM 2026: was wirklich dahintersteckt und wie man es bewertet

KI-gestütztes ITSM 2026 reicht von Add-on-Zusammenfassungen bis zu Agenten, die Tickets unbeaufsichtigt schließen. Was real ist, was Marketing ist, und wie man Anbieter bewertet.

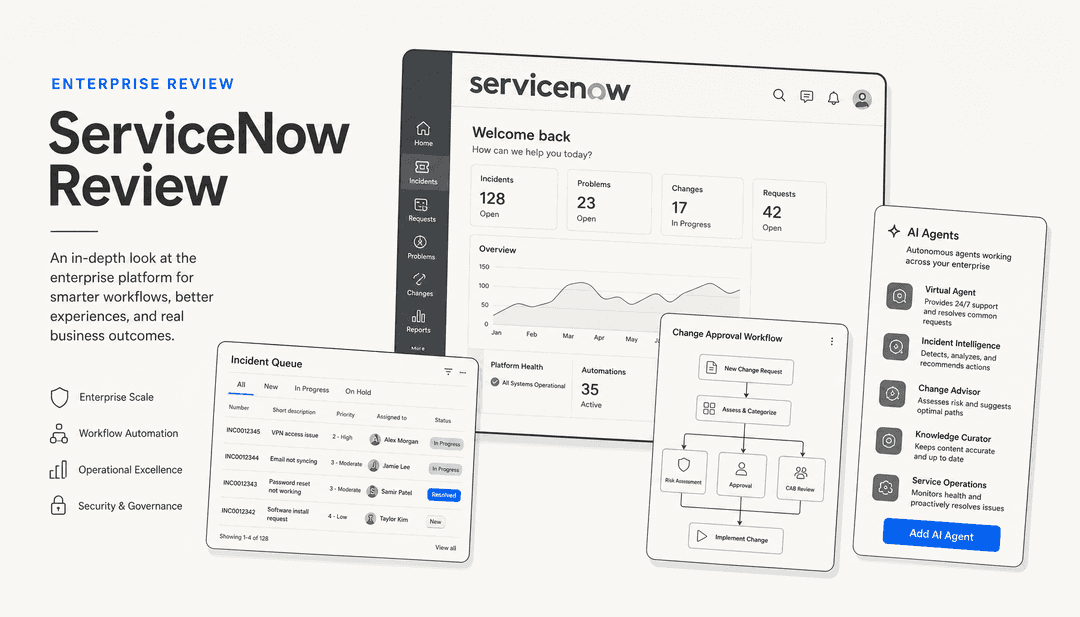

Ein ehrlicher ServiceNow-Test für Enterprises in 2026

Ein ehrlicher ServiceNow-Test für Enterprise-Teams in 2026 – was in der Plattform steckt, das echte Kostenbild, die AI-Agents- und Autonomous-Workforce-Story und wo es tatsächlich passt.

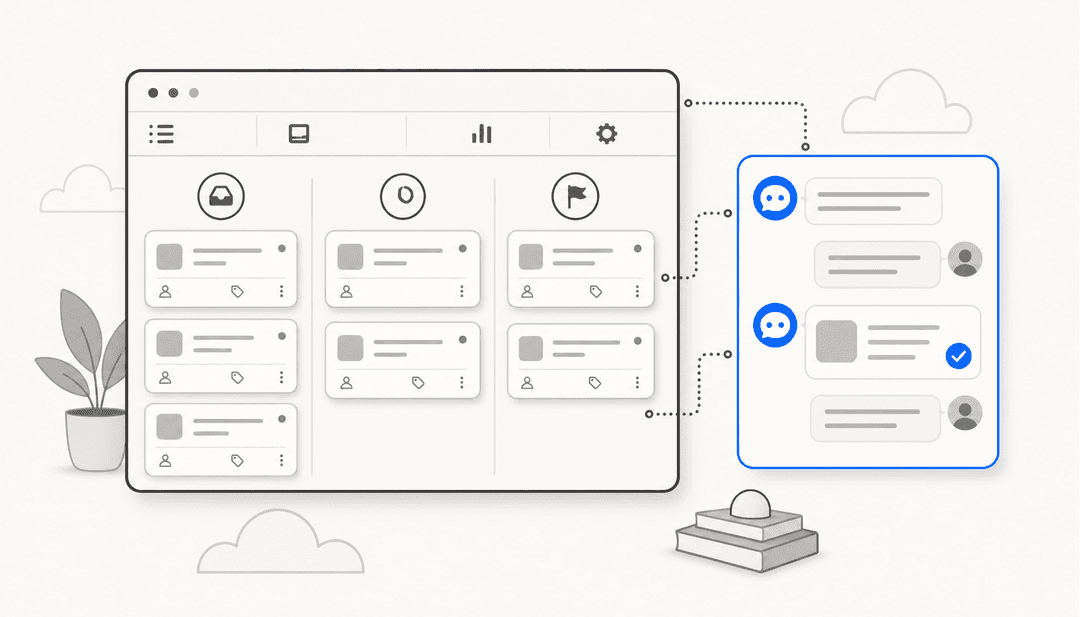

Serval AI: Ein Käuferleitfaden vom eesel AI Team

Ein Käuferleitfaden zu Serval, verfasst vom Team bei eesel AI. Verifizierte Funktionen, Preisgestaltung und Implementierungsmodell, mit einem Vergleich zur integrationsorientierten Alternative.

Claude Pro Preise 2026: Alles, was Sie wissen müssen

Claudes Preisgestaltung hat sich von einem einfachen 20-Dollar-Abonnement zu einem komplexen gestaffelten Modell mit Max-Plänen für Power-User entwickelt. Hier ist der datengestützte Leitfaden.

Die 7 besten kostenlosen KI-Kaltakquise-E-Mail-Generatoren im Jahr 2026: Ich habe über 15 Apps getestet

Die meisten kostenlosen KI-Kaltakquise-E-Mail-Generatoren produzieren generischen 'Wortsalat'. Ich habe 17 Apps getestet, um die 7 zu finden, die tatsächlich in Posteingängen landen und den Umsatz im Jahr 2026 steigern.

Bereit, Ihren KI-Teamkollegen einzustellen?

In Minuten eingerichtet. Keine Kreditkarte erforderlich.