Se está a construir algo com IA conversacional, provavelmente já reparou que as coisas estão a evoluir rapidamente. A OpenAI, em particular, parece estar constantemente a lançar novas ferramentas para programadores. Ao criar uma aplicação conversacional, uma das primeiras grandes decisões a tomar é a escolha da API certa. É uma escolha que molda a velocidade da sua aplicação, a experiência do utilizador e, claro, o seu orçamento.

Durante bastante tempo, a API de Chat Completions foi a escolha padrão para quase toda a gente. Mas agora, existe uma nova opção construída especificamente para chats de alta velocidade e orientados por voz: a API Realtime. Então, qual delas deve realmente usar?

Este guia irá guiá-lo através das diferenças entre a API Realtime e a API de Chat Completions. Abordaremos a sua arquitetura, velocidade, custo e as melhores situações para usar cada uma. No final, terá uma ideia muito mais clara de qual é a certa para o seu projeto, especialmente se estiver a trabalhar em ferramentas de apoio ao cliente.

O que é a API de Chat Completions da OpenAI?

Pode pensar na API de Chat Completions da OpenAI como o motor fiável para IA baseada em texto. É a ferramenta padrão da indústria que os programadores têm usado durante anos para alimentar tudo, desde chatbots a assistentes de escrita com modelos como o GPT-4. A melhor parte é a sua natureza direta e fiável.

O processo é simples: envia uma lista estruturada de mensagens usando um pedido HTTP padrão. Cada mensagem recebe um papel ("sistema", "utilizador" ou "assistente") para dar algum contexto ao modelo. A API recebe o seu pedido, pensa por um momento e envia de volta uma resposta de texto completa. Como cada uma destas chamadas é uma transação separada, a API é "stateless" (sem estado).

Este modelo de pedido e resposta torna-a super flexível para uma tonelada de tarefas diferentes. Mas quando se tenta introduzir a voz na equação, começa a parecer um pouco desajeitada. Para construir um assistente de voz com esta API, tem de encadear alguns serviços diferentes: um modelo de conversão de voz para texto (como o Whisper) para perceber o que o utilizador disse, a API de Chat Completions para gerar uma resposta e, em seguida, um modelo de conversão de texto para voz para transformar essa resposta em áudio. Esta cadeia de eventos adiciona um atraso notável, fazendo com que a conversa pareça menos natural.

O que é a API Realtime da OpenAI?

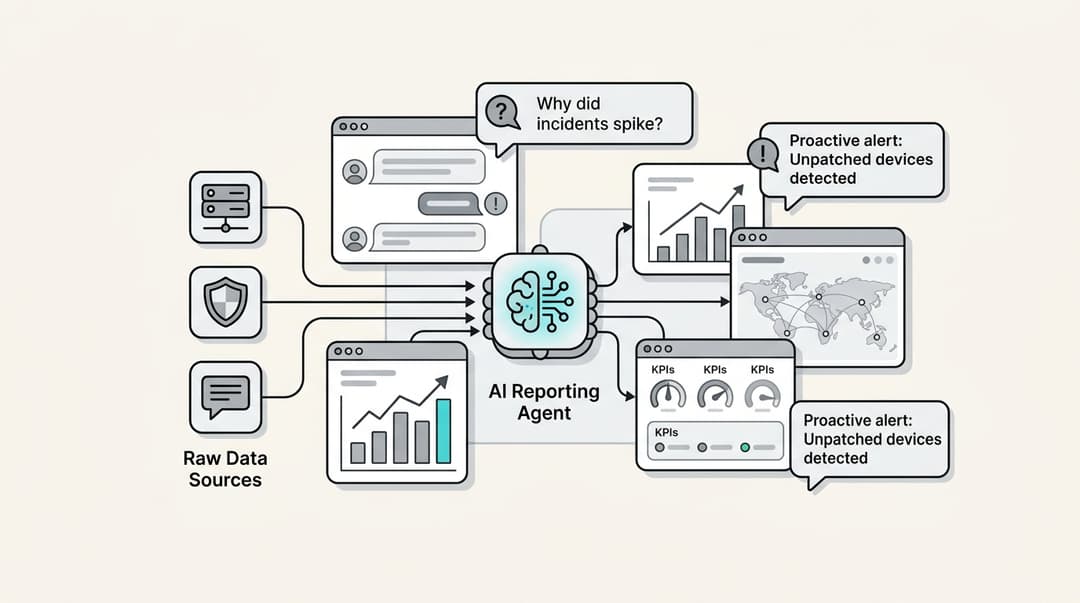

A API Realtime da OpenAI é a solução da OpenAI para essa latência. É uma ferramenta especializada, construída de raiz para criar conversas de voz para voz incrivelmente rápidas que se assemelham muito mais a falar com uma pessoa real.

Em vez do simples modelo de pedido-resposta, a API Realtime usa uma conexão WebSocket persistente. Isto abre uma via de dois sentidos onde o áudio pode ser transmitido para a frente e para trás sem interrupção. Este design é o segredo para o seu desempenho rápido, permitindo o tipo de troca natural que simplesmente não é possível com a API mais antiga.

Ela gere todo o pipeline de voz, reconhecimento de fala, processamento e geração de fala, tudo de uma só vez. Uma das suas características mais interessantes é como lida com interrupções. Um utilizador pode intervir e falar por cima da IA, tal como numa conversa normal, e a API pode ajustar-se de imediato. Isso é uma enorme melhoria em relação às interações rígidas e por turnos de uma configuração de API encadeada.

Diferenças principais: API Realtime vs. API de Chat Completions

Apesar de ambas as APIs permitirem usar os poderosos modelos da OpenAI, são ferramentas fundamentalmente diferentes para trabalhos diferentes. Vamos aprofundar onde elas se separam.

Arquitetura e protocolo de comunicação

A maior diferença é como elas comunicam.

A API de Chat Completions funciona com pedidos HTTP padrão. Cada chamada é uma transação nova e independente. É um método simples e testado pelo tempo que praticamente todos os programadores conhecem. Pense nisso como enviar uma carta e esperar por uma resposta; funciona, mas não é instantâneo.

A API Realtime, por outro lado, usa WebSockets para criar uma conexão estável e bidirecional. A configuração é um pouco mais envolvida, mas é o que precisa para o streaming constante de dados que a interação em tempo real exige. É mais como ter uma linha telefónica aberta onde ambas as pessoas podem falar e ouvir ao mesmo tempo.

Latência e experiência do utilizador

Esta escolha arquitetónica tem um efeito massivo na velocidade e no que o utilizador realmente experiencia.

Com a API de Chat Completions, o atraso é naturalmente maior. Tem a latência do próprio pedido HTTP, mais o tempo que cada passo na cadeia de voz leva (transcrição, processamento, síntese de fala). Isto torna-a uma má escolha para conversas de voz fluidas e naturais. Aquela pequena pausa antes de uma resposta pode fazer com que uma interação pareça robótica e estranha.

A API Realtime é construída para a velocidade, com tempos de resposta frequentemente a registar menos de algumas centenas de milissegundos. Isto permite conversas de voz suaves e semelhantes às humanas, onde a conversa pode fluir. Os utilizadores podem interromper, e a IA pode responder quase imediatamente, o que proporciona uma experiência muito mais envolvente.

Modalidades e função principal

No seu âmago, as duas APIs são feitas para tipos diferentes de dados.

A API de Chat Completions é texto-entra, texto-sai. Toda a sua configuração está orientada para processar e gerar palavras num ecrã. Pode adicionar-lhe capacidades de áudio, mas é mais uma solução de contorno do que o seu propósito principal.

A API Realtime é nativamente de voz para voz. Foi concebida para compreender e gerar áudio diretamente. Isto permite-lhe reter subtilezas como o tom e a inflexão que muitas vezes se perdem quando se converte a fala para texto e vice-versa.

Aqui está uma tabela rápida para resumir as principais diferenças:

| Característica | API de Chat Completions | API Realtime |

|---|---|---|

| Caso de Uso Principal | Chat baseado em texto, geração de conteúdo | Agentes de voz em tempo real, transcrição ao vivo |

| Comunicação | HTTP (Pedido-Resposta) | WebSockets (Streaming Persistente) |

| Latência | Mais alta | Muito Baixa ( |

A alternativa mais simples para equipas de suporte

Sejamos realistas: construir diretamente sobre estas APIs, especialmente a mais complexa API Realtime, é um grande projeto. Requer muito tempo de engenharia, manutenção contínua e um profundo conhecimento de como gerir a infraestrutura de streaming. Para a maioria das equipas de suporte, isso simplesmente não é prático.

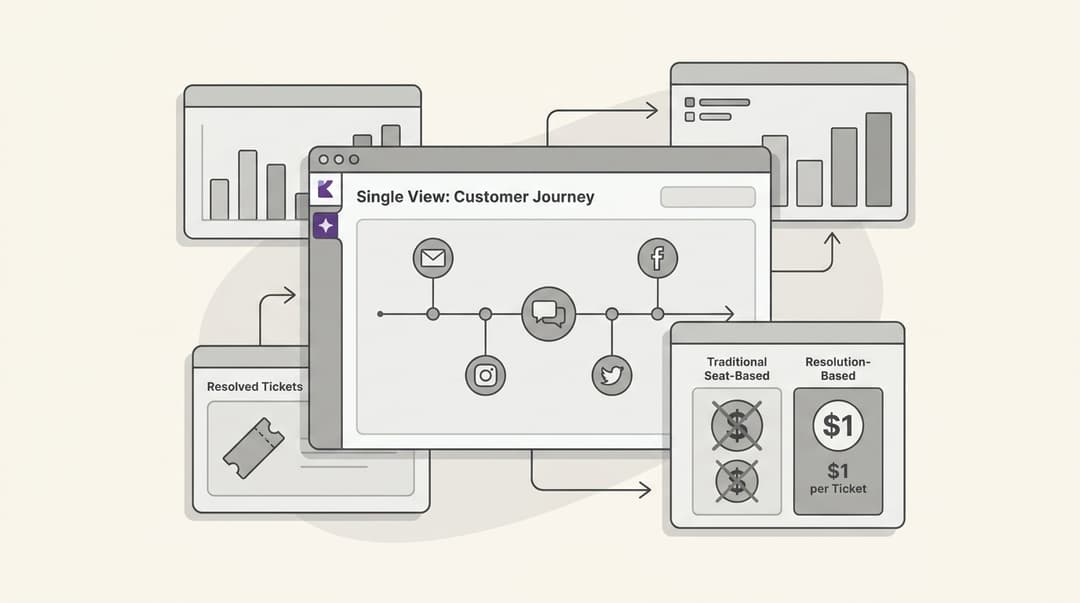

É aqui que uma plataforma como a eesel AI pode ser uma grande ajuda. Dá-lhe todo o poder destes modelos avançados sem a dor de cabeça da engenharia. A eesel AI foi concebida especificamente para equipas de suporte, não apenas para programadores. Pode configurar um agente de IA poderoso que lida com tickets, obtém respostas das suas fontes de conhecimento como Notion ou Confluence, e até realiza ações personalizadas, tudo a partir de um painel de controlo simples. Pode estar a funcionar em minutos, não em meses.

Comparação de preços

O custo é sempre uma grande peça do puzzle, e os preços para estas duas APIs são bastante diferentes.

O preço da API Realtime está dividido entre texto e áudio:

-

Tokens de entrada de texto: $5 por 1 milhão de tokens

-

Tokens de saída de texto: $20 por 1 milhão de tokens

-

Entrada de áudio: $100 por 1 milhão de tokens (o que é cerca de $0.06 por minuto)

-

Saída de áudio: $200 por 1 milhão de tokens (cerca de $0.24 por minuto)

Para a API de Chat Completions, o preço depende do modelo que usar. Para um modelo popular e poderoso como o GPT-4o, o custo é:

-

Entrada: $5 por 1 milhão de tokens

-

Saída: $15 por 1 milhão de tokens

O principal a notar aqui é que processar áudio através da API Realtime custa consideravelmente mais do que o processamento de texto padrão. Quando adiciona esse custo à complexidade de desenvolvimento, construir um agente de voz do zero torna-se um investimento sério.

Isto contrasta fortemente com os preços diretos de uma plataforma como a eesel AI. Oferecemos planos mensais ou anuais claros baseados na sua utilização, sem taxas ocultas por resolução. Isso significa que não receberá uma fatura surpresa após um mês movimentado, dando-lhe o tipo de previsibilidade de custos que precisa para expandir o seu suporte.

Escolher entre a API Realtime e a API de Chat Completions

A escolha entre a API Realtime e a API de Chat Completions resume-se realmente ao que está disposto a trocar. A API de Chat Completions é a opção versátil, fiável e económica para tudo o que está relacionado com texto. A API Realtime é a especialista de alto desempenho, construída especificamente para chats de voz naturais e de baixa latência.

A sua decisão deve ser guiada pelo que está a tentar alcançar. Se o sucesso da sua aplicação depende da voz em tempo real, a API Realtime é onde deve apontar. Para quase tudo o resto, a API de Chat Completions é o ponto de partida mais sensato e eficiente. Mas para muitos, há uma maneira ainda melhor.

Construa agentes de IA poderosos sem a complexidade

Se procura o poder da IA conversacional em tempo real sem o enorme esforço de engenharia, a eesel AI é a ponte. Oferecemos uma plataforma poderosa e fácil de usar que lhe permite implementar IA avançada para a sua equipa de suporte.

-

Comece a funcionar em minutos, não em meses: Integre com help desks como Zendesk ou Freshdesk com apenas um clique.

-

Controlo total: Ajuste a personalidade da sua IA, o que ela sabe e o que pode fazer sem escrever qualquer código.

-

Teste com confiança: Use o nosso modo de simulação para ver exatamente como a sua IA lidará com tickets passados antes de a deixar falar com os clientes.

Pronto para automatizar o seu suporte de linha da frente sem a sobrecarga de engenharia? Comece o seu teste gratuito da eesel AI hoje.

Perguntas frequentes

A sua decisão deve depender da modalidade principal. Se o sucesso do seu projeto depende de conversas de voz fluidas e semelhantes às humanas com latência mínima, a API Realtime é a escolha clara. Para interações baseadas em texto, geração de conteúdo ou processamento de backend onde a voz em tempo real não é crítica, a API de Chat Completions é mais adequada.

Embora sirvam funções primárias diferentes, pode usar ambas numa aplicação sofisticada. Por exemplo, a API Realtime poderia lidar com a interação de voz ao vivo, enquanto a API de Chat Completions poderia alimentar tarefas assíncronas como resumir a conversa ou gerar e-mails de acompanhamento em segundo plano.

Se a sua aplicação precisa de interações de voz de fala para fala completas e naturais, a API Realtime será mais económica apesar do seu custo de áudio por token mais elevado, pois foi concebida para lidar eficientemente com todo o pipeline de voz. Tentar encadear múltiplos serviços com a API de Chat Completions para voz pode levar a custos gerais significativamente mais altos e a uma experiência do utilizador muito pior devido à complexidade e latência adicionais.

A transição de uma configuração baseada em texto da API de Chat Completions para uma experiência de voz completa com a API Realtime pode ser bastante complexa. A API Realtime requer uma abordagem arquitetónica diferente (WebSockets para streaming) e a gestão do pipeline de voz integrado, o que representa um esforço de engenharia significativo em comparação com os simples pedidos HTTP.

A implementação da API Realtime requer a configuração e gestão de conexões WebSocket persistentes para streaming contínuo de áudio, o que é mais envolvido do que os pedidos HTTP sem estado da API de Chat Completions. Terá de lidar com a entrada/saída de áudio em tempo real, estabilidade da conexão e, potencialmente, buffering do lado do cliente para garantir um fluxo de conversação suave.

Ambas as APIs podem lidar com lógica conversacional complexa, pois aproveitam poderosos modelos de linguagem subjacentes. A API de Chat Completions pode ser mais simples de gerir para diálogos de várias voltas muito profundos e centrados em texto, onde a fala em tempo real não é necessária. No entanto, a API Realtime destaca-se em diálogos de voz complexos e fluidos, gerindo o contexto implicitamente dentro do fluxo contínuo.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.