Wenn Sie etwas mit Conversational AI entwickeln, haben Sie wahrscheinlich bemerkt, dass sich die Dinge schnell bewegen. Insbesondere OpenAI scheint ständig neue Entwicklertools auf den Markt zu bringen. Wenn Sie eine Konversations-App zusammenstellen, ist eine der ersten großen Entscheidungen, die Sie treffen müssen, die Wahl der richtigen API (Application Programming Interface, dt. Anwendungsprogrammierschnittstelle). Diese Wahl bestimmt die Geschwindigkeit Ihrer App, das Benutzererlebnis und natürlich Ihr Budget.

Eine ganze Weile lang war die Chat Completions API die Standardwahl für so ziemlich jeden. Aber jetzt gibt es eine neue Option, die speziell für schnelle, sprachgesteuerte Chats entwickelt wurde: die Realtime API. Also, welche sollten Sie tatsächlich verwenden?

Dieser Leitfaden führt Sie durch die Unterschiede zwischen der Realtime API und der Chat Completions API. Wir werden uns mit ihrer Architektur, Geschwindigkeit, Kosten und den besten Situationen für die Verwendung der jeweiligen API befassen. Am Ende haben Sie eine viel klarere Vorstellung davon, welche für Ihr Projekt die richtige ist, insbesondere wenn Sie an Kundensupport-Tools arbeiten.

Was ist die OpenAI Chat Completions API?

Sie können sich die OpenAI Chat Completions API als den zuverlässigen Motor für textbasierte KI (Künstliche Intelligenz) vorstellen. Sie ist das branchenübliche Tool, das Entwickler seit Jahren verwenden, um alles von Chatbots bis hin zu Schreibassistenten mit Modellen wie GPT-4 zu betreiben. Das Beste daran ist ihre unkomplizierte und zuverlässige Natur.

Der Prozess ist einfach: Sie senden eine strukturierte Liste von Nachrichten über eine Standard-HTTP-Anfrage. Jede Nachricht erhält eine Rolle ("system", "user" oder "assistant"), um dem Modell etwas Kontext zu geben. Die API nimmt Ihre Anfrage entgegen, denkt einen Moment nach und sendet eine vollständige Textantwort zurück. Da jeder dieser Aufrufe eine eigene, separate Transaktion ist, ist die API "zustandslos".

Dieses Anfrage-und-Antwort-Modell macht sie super flexibel für eine Vielzahl von Aufgaben. Aber wenn Sie versuchen, Sprache ins Spiel zu bringen, fühlt es sich etwas klobig an. Um einen Sprachassistenten mit dieser API zu erstellen, müssen Sie ein paar verschiedene Dienste miteinander verketten: ein Speech-to-Text-Modell (wie Whisper), um herauszufinden, was der Benutzer gesagt hat, die Chat Completions API, um eine Antwort zu generieren, und dann ein Text-to-Speech-Modell, um diese Antwort in Audio umzuwandeln. Diese Kette von Ereignissen fügt eine spürbare Verzögerung hinzu, wodurch sich das Gespräch weniger natürlich anfühlt.

Was ist die OpenAI Realtime API?

Die OpenAI Realtime API ist die Lösung von OpenAI für diese Verzögerung. Es ist ein spezialisiertes Tool, das von Grund auf für die Erstellung unglaublich schneller Speech-to-Speech-Konversationen entwickelt wurde, die sich viel mehr wie ein Gespräch mit einer echten Person anfühlen.

Anstelle des einfachen Anfrage-Antwort-Modells verwendet die Realtime API eine persistente WebSocket-Verbindung. Dies eröffnet eine Zwei-Wege-Straße, auf der Audio ohne Unterbrechung hin- und hergestreamt werden kann. Dieses Design ist das Geheimnis ihrer schnellen Leistung und ermöglicht die Art von natürlichem Hin und Her, die mit der älteren API einfach nicht möglich ist.

Sie verwaltet die gesamte Sprachpipeline, Spracherkennung, Denken und Spracherzeugung, alles in einem Durchgang. Eine ihrer coolsten Funktionen ist die Art und Weise, wie sie Unterbrechungen behandelt. Ein Benutzer kann einspringen und über die KI sprechen, genau wie in einem normalen Gespräch, und die API kann sich sofort anpassen. Das ist eine enorme Verbesserung gegenüber den steifen, zugbasierten Interaktionen einer verketteten API-Konfiguration.

Hauptunterschiede: Realtime API vs. Chat Completions API

Auch wenn beide APIs es Ihnen ermöglichen, die leistungsstarken Modelle von OpenAI zu nutzen, sind sie doch grundlegend unterschiedliche Werkzeuge für unterschiedliche Aufgaben. Lassen Sie uns genauer untersuchen, wo sie sich unterscheiden.

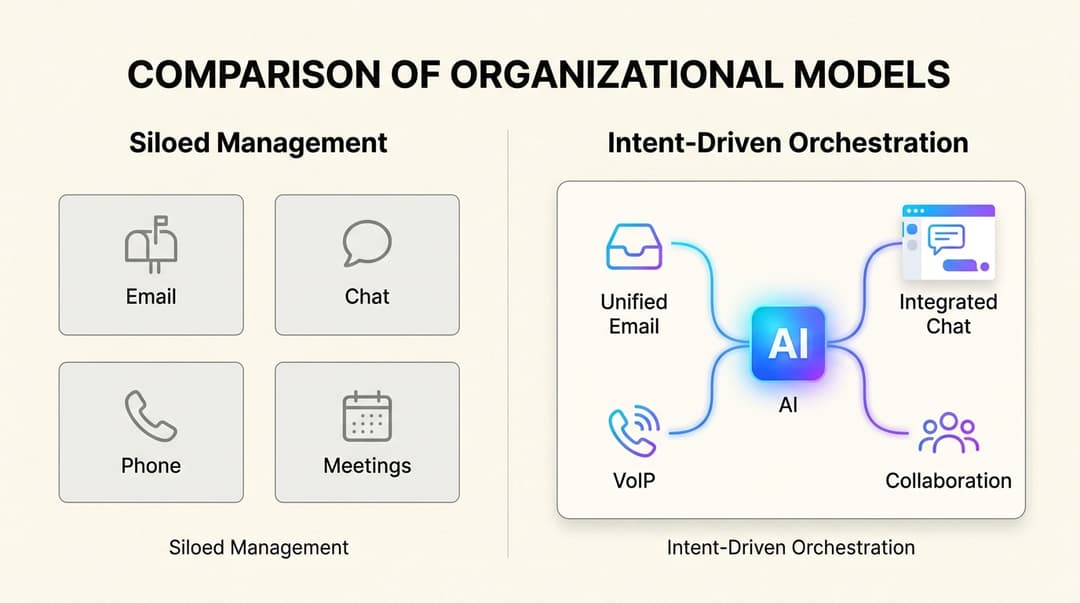

Architektur und Kommunikationsprotokoll

Der größte Unterschied besteht darin, wie sie miteinander kommunizieren.

Die Chat Completions API arbeitet mit Standard-HTTP-Anfragen. Jeder Aufruf ist eine neue, unabhängige Transaktion. Es ist eine einfache, bewährte Methode, die so ziemlich jeder Entwickler kennt. Stellen Sie sich das wie das Senden eines Briefes und das Warten auf eine Antwort vor, es funktioniert, aber es ist nicht sofort.

Die Realtime API hingegen verwendet WebSockets, um eine stabile, bidirektionale Verbindung herzustellen. Dies ist etwas aufwändiger einzurichten, aber es ist das, was Sie für das konstante Datenstreaming benötigen, das eine Echtzeit-Interaktion erfordert. Es ist eher wie eine offene Telefonleitung, bei der beide Personen gleichzeitig sprechen und zuhören können.

Latenz und Benutzererfahrung

Diese architektonische Wahl hat einen massiven Einfluss auf die Geschwindigkeit und das, was der Benutzer tatsächlich erlebt.

Mit der Chat Completions API ist die Verzögerung einfach naturgemäß höher. Sie haben die Verzögerung durch die HTTP-Anfrage selbst, plus die Zeit, die jeder Schritt in der Sprachkette benötigt (Transkription, Verarbeitung, Sprachsynthese). Dies macht sie zu einer schlechten Wahl für flüssige, natürliche Sprachkonversationen. Diese kleine Pause vor einer Antwort kann eine Interaktion robotisch und unangenehm wirken lassen.

Die Realtime API ist auf Geschwindigkeit ausgelegt, mit Reaktionszeiten, die oft unter wenigen hundert Millisekunden liegen. Dies ermöglicht reibungslose, menschenähnliche Sprachchats, bei denen das Gespräch fließen kann. Benutzer können unterbrechen, und die KI kann fast sofort reagieren, was für ein viel ansprechenderes Erlebnis sorgt.

Modalitäten und Kernfunktion

Im Kern sind die beiden APIs für verschiedene Arten von Daten gemacht.

Die Chat Completions API ist Text-in, Text-out. Ihre gesamte Konfiguration ist darauf ausgerichtet, Wörter auf einem Bildschirm zu verarbeiten und zu erzeugen. Sie können Audiofunktionen hinzufügen, aber das ist eher eine Notlösung als ihr Hauptzweck.

Die Realtime API ist nativ Speech-to-Speech. Sie ist darauf ausgelegt, Audio direkt zu verstehen und zu erzeugen. Dies ermöglicht es ihr, Nuancen wie Tonfall und Beugung beizubehalten, die oft verloren gehen, wenn Sie Sprache in Text umwandeln und wieder zurück.

Hier ist eine kurze Tabelle, die die wichtigsten Unterschiede zusammenfasst:

| Merkmal | Chat Completions API | Realtime API |

|---|---|---|

| Primärer Anwendungsfall | Textbasierter Chat, Inhaltserstellung | Echtzeit-Sprachagenten, Live-Transkription |

| Kommunikation | HTTP (Anfrage-Antwort) | WebSockets (Persistentes Streaming) |

| Latenz | Höher | Sehr niedrig ( |

Die einfachere Alternative für Support-Teams

Seien wir ehrlich: Das direkte Aufbauen auf diesen APIs, insbesondere der komplexeren Realtime API, ist ein großes Projekt. Es erfordert viel Engineering-Zeit, kontinuierliche Wartung und ein tiefes Verständnis dafür, wie man Streaming-Infrastruktur verwaltet. Für die meisten Support-Teams ist das einfach nicht praktikabel.

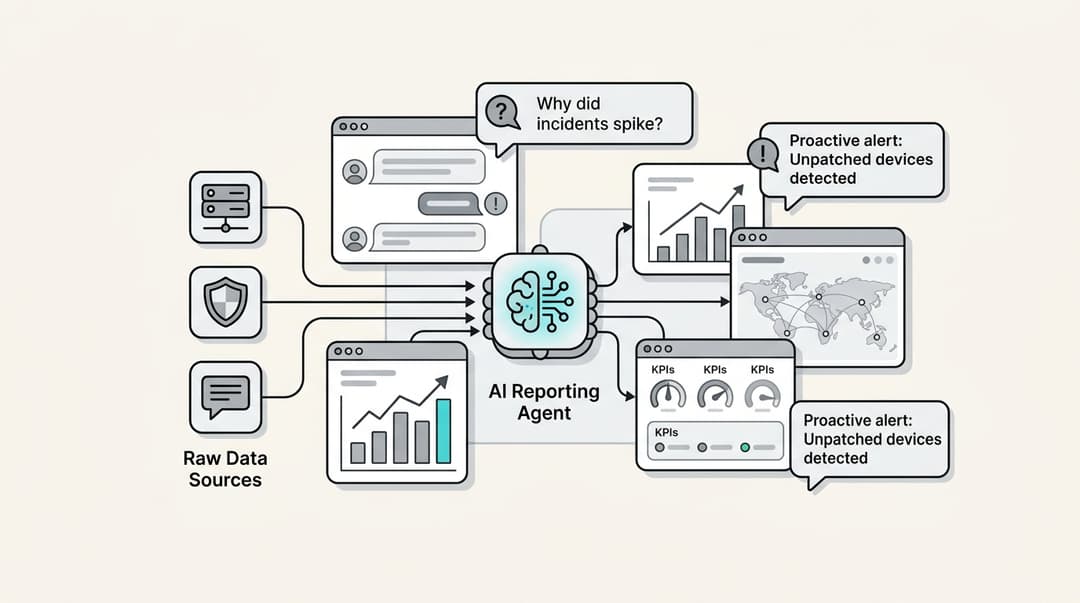

Hier kann eine Plattform wie eesel AI eine große Hilfe sein. Sie bietet Ihnen die gesamte Leistung dieser fortschrittlichen Modelle ohne die Engineering-Kopfschmerzen. eesel AI wurde speziell für Support-Teams entwickelt, nicht nur für Entwickler. Sie können einen leistungsstarken KI-Agenten einrichten, der Tickets bearbeitet, Antworten aus Ihren Wissensquellen wie Notion oder Confluence abruft und sogar benutzerdefinierte Aktionen ausführt, alles über ein einfaches Dashboard. Sie können in wenigen Minuten einsatzbereit sein, nicht erst in Monaten.

Preisvergleich

Die Kosten sind immer ein wichtiger Teil des Puzzles, und die Preise für diese beiden APIs sind ziemlich unterschiedlich.

Die Preise für die Realtime API sind zwischen Text und Audio aufgeteilt:

-

Text-Input-Token: $5 pro 1 Million Token

-

Text-Output-Token: $20 pro 1 Million Token

-

Audio-Input: $100 pro 1 Million Token (das sind etwa $0,06 pro Minute)

-

Audio-Output: $200 pro 1 Million Token (etwa $0,24 pro Minute)

Für die Chat Completions API hängen die Preise von dem Modell ab, das Sie verwenden. Für ein beliebtes und leistungsstarkes Modell wie GPT-4o sind die Kosten:

-

Input: $5 pro 1 Million Token

-

Output: $15 pro 1 Million Token

Das Wichtigste, was Sie hier bemerken sollten, ist, dass die Verarbeitung von Audio über die Realtime API einiges mehr kostet als die Standard-Textverarbeitung. Wenn Sie diese Kosten zur Entwicklungskomplexität hinzufügen, wird der Aufbau eines Sprachagenten von Grund auf zu einer ernsthaften Investition.

Dies steht in großem Gegensatz zu den unkomplizierten Preisen einer Plattform wie eesel AI. Wir bieten klare monatliche oder jährliche Pläne an, die darauf basieren, wie viel Sie nutzen, ohne versteckte Gebühren pro Auflösung. Das bedeutet, dass Sie nach einem arbeitsreichen Monat keine überraschende Rechnung erhalten, was Ihnen die Art von Kostenvorhersagbarkeit gibt, die Sie für das Wachstum Ihres Supports benötigen.

Auswahl zwischen Realtime API vs. Chat Completions API

Die Wahl zwischen der Realtime API und der Chat Completions API läuft wirklich darauf hinaus, was Sie bereit sind zu tauschen. Die Chat Completions API ist die vielseitige, zuverlässige und budgetfreundliche Option für alles, was mit Text zu tun hat. Die Realtime API ist der Hochleistungs-Spezialist, der speziell für natürliche, latenzarme Sprachchats entwickelt wurde.

Ihre Entscheidung sollte davon geleitet sein, was Sie erreichen wollen. Wenn der Erfolg Ihrer App von Echtzeit-Sprache abhängt, ist die Realtime API das, was Sie anstreben sollten. Für fast alles andere ist die Chat Completions API der sinnvollere und effizientere Ausgangspunkt. Aber für viele gibt es einen noch besseren Weg.

Erstellen Sie leistungsstarke KI-Agenten ohne die Komplexität

Wenn Sie die Leistung von Echtzeit-KI-Konversationen ohne den massiven technischen Aufwand suchen, ist eesel AI die Brücke. Wir bieten eine leistungsstarke und einfach zu bedienende Plattform, mit der Sie fortschrittliche KI für Ihr Support-Team einsetzen können.

-

Gehen Sie in wenigen Minuten live, nicht erst in Monaten: Integrieren Sie sich mit Helpdesks wie Zendesk oder Freshdesk mit nur einem Klick.

-

Totale Kontrolle: Optimieren Sie die Persönlichkeit Ihrer KI, was sie weiß und was sie tun kann, ohne Code zu schreiben.

-

Testen Sie mit Zuversicht: Verwenden Sie unseren Simulationsmodus, um genau zu sehen, wie Ihre KI vergangene Tickets behandelt, bevor Sie sie jemals mit Kunden sprechen lassen.

Sind Sie bereit, Ihren Frontline-Support ohne den technischen Aufwand zu automatisieren? Starten Sie noch heute Ihre kostenlose eesel AI-Testversion.

Häufig gestellte Fragen

Ihre Entscheidung sollte von der primären Modalität abhängen. Wenn der Erfolg Ihres Projekts von flüssigen, menschenähnlichen Sprachkonversationen mit minimaler Latenz abhängt, ist die Realtime API die klare Wahl. Für textbasierte Interaktionen, Inhaltserstellung oder Backend-Verarbeitung, bei denen Echtzeit-Sprache nicht kritisch ist, ist die Chat Completions API besser geeignet.

Obwohl sie unterschiedliche Hauptfunktionen erfüllen, könnten Sie beide in einer hochentwickelten Anwendung verwenden. Beispielsweise könnte die Realtime API die Live-Sprachinteraktion verarbeiten, während die Chat Completions API asynchrone Aufgaben wie das Zusammenfassen des Gesprächs oder das Generieren von Folge-E-Mails im Hintergrund übernehmen könnte.

Wenn Ihre Anwendung vollständige, natürliche Speech-to-Speech-Sprachinteraktionen benötigt, ist die Realtime API trotz ihrer höheren Audio-Kosten pro Token kostengünstiger, da sie die gesamte Sprachpipeline effizient verarbeitet. Der Versuch, mehrere Dienste mit der Chat Completions API für Sprache zu verketten, kann aufgrund der zusätzlichen Komplexität und Latenz zu deutlich höheren Gesamtkosten und einer viel schlechteren Benutzererfahrung führen.

Der Übergang von einer textbasierten Chat Completions API-Konfiguration zu einer vollständigen Spracherfahrung mit der Realtime API kann recht komplex sein. Die Realtime API erfordert einen anderen architektonischen Ansatz (WebSockets für Streaming) und die Verwaltung der integrierten Sprachpipeline, was im Vergleich zu einfachen HTTP-Anfragen einen erheblichen technischen Aufwand darstellt.

Die Implementierung der Realtime API erfordert das Einrichten und Verwalten persistenter WebSocket-Verbindungen für kontinuierliches Audio-Streaming, was aufwändiger ist als die zustandslosen HTTP-Anfragen der Chat Completions API. Sie müssen Echtzeit-Audioeingabe/-ausgabe, Verbindungsstabilität und potenziell clientseitige Pufferung verwalten, um einen reibungslosen Gesprächsfluss zu gewährleisten.

Beide APIs können komplexe Gesprächslogiken verarbeiten, da sie leistungsstarke zugrunde liegende Sprachmodelle nutzen. Die Chat Completions API ist möglicherweise einfacher zu verwalten für sehr tiefe, textzentrierte mehrrundige Dialoge, bei denen keine Echtzeit-Sprache erforderlich ist. Die Realtime API zeichnet sich jedoch durch komplexe, flüssige Sprachdialoge aus und verwaltet den Kontext implizit innerhalb des kontinuierlichen Streams.

Share this article

Article by

Stevia Putri

Stevia Putri ist Marketing Generalist bei eesel AI, wo sie hilft, leistungsstarke KI-Tools in Geschichten zu verwandeln, die Anklang finden. Sie wird von Neugierde, Klarheit und der menschlichen Seite der Technologie angetrieben.