A OpenAI lançou recentemente o GPT 5.2, seu autoproclamado "modelo mais avançado". O anúncio veio acompanhado de benchmarks impressionantes, prometendo avanços significativos em programação, raciocínio e visão. No papel, parece incrível.

No entanto, desde o seu lançamento para os usuários, a recepção tem sido mista. Parece haver uma lacuna entre os testes de laboratório e o que as pessoas estão vivenciando no uso diário. Então, qual é a verdadeira história?

Este post fornecerá uma visão equilibrada sobre o que é o GPT 5.2, o que ele promete, onde parece estar falhando e o que tudo isso significa para as empresas que buscam soluções de IA.

O que é o GPT 5.2? Uma família de novos modelos

Primeiro, o GPT 5.2 não é apenas um modelo. É a série mais recente de grandes modelos de linguagem (large language models) da OpenAI, construída para tarefas profissionais complexas. É uma família de opções, cada uma adaptada para diferentes necessidades e faixas de preço.

De acordo com o anúncio oficial da OpenAI, aqui está como a família se divide:

-

GPT-5.2 Instant: Esta é a versão veloz, projetada para tarefas cotidianas e aprendizado dentro do ChatGPT. Foi feita para respostas rápidas.

-

GPT-5.2 Thinking: Este é o modelo principal para trabalhos mais profundos e complexos, como programação e análise. Se você estiver usando a API, este é o que você chamará com

gpt-5.2. -

GPT-5.2 Pro: A opção mais poderosa e precisa da linha. É voltada para questões difíceis, onde obter a melhor resposta possível é a prioridade máxima.

Além desses, a OpenAI também lançou o GPT-5 mini como uma opção menor e mais eficiente, e um GPT-5.2-Codex especializado para desenvolvedores. Está claro que eles estão tentando cobrir todas as frentes oferecendo uma gama de modelos.

A história oficial: Novos recursos e melhorias reivindicadas

Com base nos materiais de lançamento da OpenAI, o modelo mostra ganhos significativos em relação às versões anteriores. Vamos detalhar as principais áreas onde o GPT 5.2 deve ter um bom desempenho, de acordo com a documentação oficial.

Desempenho aprimorado em tarefas profissionais

Uma das promessas do GPT 5.2 é como ele lida com o trabalho de conhecimento profissional e desbloqueia mais valor econômico. A OpenAI afirma que ele é muito melhor na criação de planilhas, construção de apresentações e escrita de códigos sofisticados do que seus antecessores.

Para sustentar isso, eles apontam para o benchmark GDPval, onde o modelo supostamente supera profissionais do setor em mais de 70% das tarefas. As melhorias na programação são particularmente notáveis, com o modelo atingindo novas pontuações de estado da arte em benchmarks difíceis como o SWE-Bench Pro (55,6%). A ideia é que ele agora pode lidar com problemas de engenharia de software mais complexos, indo além da simples geração de scripts básicos.

Raciocínio, visão e capacidades de contexto longo mais fortes

A OpenAI também destaca a capacidade do modelo de raciocinar através de informações complexas, especialmente em documentos longos. O teste "agulha no palheiro" da OpenAI (OpenAI MRCRv2), que verifica se um modelo consegue encontrar informações específicas em um grande corpo de texto, mostrou uma precisão quase perfeita. Isso sugere que você pode fornecer a ele um relatório extenso e confiar que ele extrairá os detalhes necessários.

Suas capacidades de visão também foram atualizadas, com as taxas de erro em tarefas como raciocínio sobre gráficos e compreensão de interfaces de software reduzidas aproximadamente pela metade. Em teoria, você pode mostrar a ele um painel (dashboard) complexo ou um diagrama de placa-mãe, e ele terá uma compreensão espacial muito melhor do que está vendo. Ele também obteve notas máximas em benchmarks de ciência e matemática como GPQA Diamond (92,4%) e FrontierMath (40,3%), expandindo o que a IA pode fazer em campos altamente técnicos.

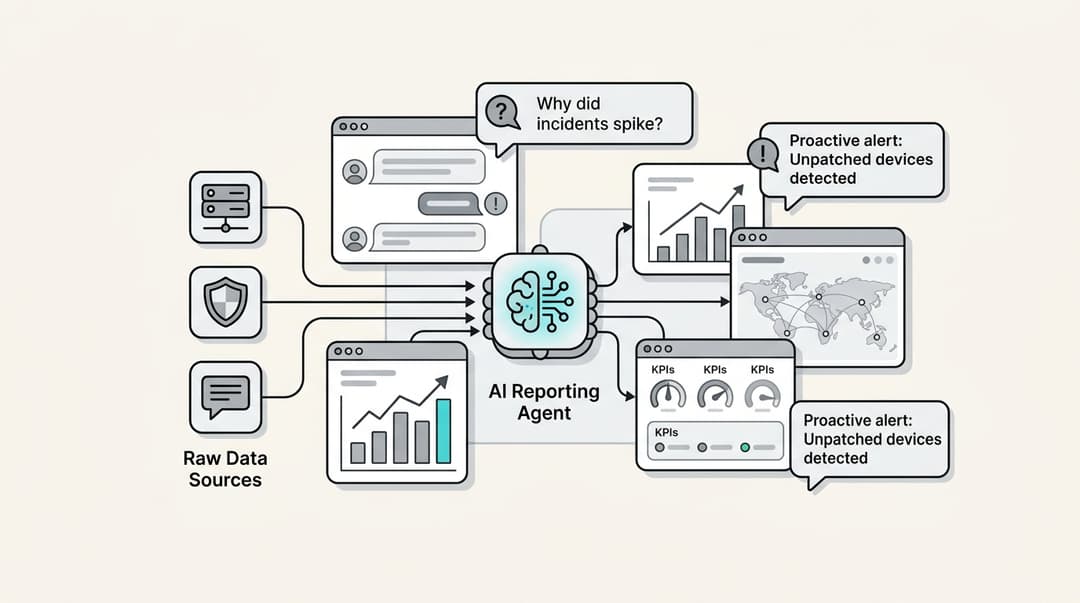

Chamada de ferramentas mais confiável para fluxos de trabalho de agentes

Este é um recurso mais técnico, mas é importante para construir aplicações práticas de IA. A "chamada de ferramentas" (tool calling) é como um modelo de IA interage com outros softwares para realizar ações, como consultar um pedido no Shopify ou criar um ticket no Jira. O GPT 5.2 foi projetado para ser muito melhor na execução dessas tarefas complexas de várias etapas do início ao fim.

Ele obteve impressionantes 98,7% no benchmark Tau2-bench Telecom, um teste projetado para simular tarefas de suporte ao cliente de vários turnos. Na prática, isso significa que você pode construir agentes de IA mais confiáveis que podem lidar com fluxos de trabalho inteiros, como resolver o problema de envio de um cliente ou analisar dados de vendas, com menos erros.

Introduzindo o GPT-5.2-Codex para programação avançada

Para desenvolvedores, a OpenAI também lançou o GPT-5.2-Codex, uma versão do modelo especificamente otimizada para "engenharia de software e segurança cibernética". Isso não serve apenas para escrever algumas linhas de código; foi construído para lidar com grandes bases de código e auxiliar em tarefas longas e complexas, como migrações e refatorações de código.

Ele também vem com consciência de segurança aprimorada. Por enquanto, está disponível nas superfícies do Codex para usuários pagos do ChatGPT, com o acesso via API planejado para ser lançado posteriormente. Isso indica o foco da OpenAI em tornar seus modelos ferramentas essenciais para equipes de desenvolvimento de software.

Experiências do mundo real: Um feedback misto dos usuários

Benchmarks são uma coisa, mas o teste real é como um modelo se comporta para pessoas reais em seu trabalho diário. Desde o lançamento do GPT 5.2, o feedback em fóruns de desenvolvedores e em publicações como o Medium tem sido variado.

Muitos usuários estão enfrentando problemas que os benchmarks simplesmente não capturam, criando uma lacuna entre o desempenho anunciado e a realidade do dia a dia.

Preocupações sobre o tom e o aumento de recusas

Uma das reclamações comuns é sobre a personalidade do modelo. Muitos usuários descrevem seu tom como "mais monótono e excessivamente sanitizado", como se tivesse sido treinado para ser tão cauteloso que se tornou menos capaz de improvisar ou mostrar criatividade.

Eu não quero um puxa-saco, mas também não quero um assistente suspeito e paranoico que acha que estou fazendo jailbreak em cada solicitação, mesmo nas limítrofes. Estávamos falando sobre golpes online, pedi para ele explicar esse golpe de uma forma simples e ele disse 'não posso incentivar golpes'... Caramba, mas eu pedi para ele explicar de forma simples, não para aplicar um golpe!!!

Isso se conecta a outro problema importante: o aumento das recusas. Os usuários relatam que o modelo agora é excessivamente cauteloso e às vezes se recusa a discutir tópicos ou completar tarefas que versões anteriores resolviam tranquilamente. Para qualquer pessoa que dependa do modelo para escrita criativa, brainstorming ou exploração de tópicos nuances, isso pode representar desafios. Parece um retrocesso na usabilidade para alguns usuários, mesmo que a tecnologia subjacente seja mais poderosa.

Desempenho inconsistente e problemas de contexto

Ainda mais preocupantes são os relatos de desempenho inconsistente. Alguns usuários sentem que, para suas tarefas específicas, o modelo parece menos eficaz que o GPT-4. Ele pode ter um bom desempenho em um teste de benchmark, mas depois ter dificuldades com um problema de senso comum.

A coisa mais irritante que notei é que eu pergunto algo e ele responde. Depois pergunto outra coisa e ele responde a primeira pergunta junto com a segunda.

Outra reclamação frequente é que o modelo perde o contexto ou se contradiz durante conversas longas. Isso é inesperado, dadas as afirmações da OpenAI sobre seu desempenho em benchmarks de contexto longo. Como um revisor colocou, "benchmarks são limpos. Documentos reais não são". Casos de uso do mundo real são bagunçados, e parece que o modelo ainda pode se confundir. Essa inconsistência torna difícil para as empresas construírem fluxos de trabalho confiáveis baseados no modelo bruto. Pode exigir uma engenharia de prompt mais cuidadosa para obter o resultado desejado.

Para aplicações empresariais, como IA para atendimento ao cliente, a previsibilidade é fundamental. Plataformas especializadas como a eesel AI são projetadas para fornecer um desempenho consistente e alinhado à marca. Essas plataformas aprendem diretamente com os próprios dados da empresa e conversas bem-sucedidas do passado para entregar respostas personalizadas.

Entendendo os preços e a acessibilidade

Deixando o desempenho de lado, o custo e a acessibilidade de um novo modelo são fatores enormes para qualquer empresa. O GPT 5.2 vem com uma nova estrutura de preços que o posiciona como um modelo premium de nível empresarial (enterprise-grade). Vamos dar uma olhada nos números da página oficial de preços da OpenAI.

Estrutura de preços da API

Os preços padrão da API para os novos modelos são significativamente mais altos que as versões anteriores, sinalizando que esse poder tem um custo. Para empresas que podem lidar com tarefas assíncronas (o que significa que não precisam de uma resposta instantânea), a OpenAI também oferece uma Batch API que fornece um desconto de 50%, o que é um incentivo para cargas de trabalho não urgentes.

Aqui está uma análise clara dos custos padrão por milhão de tokens para entrada (input) e saída (output), o que deve ajudá-lo a comparar as opções. Esta comparação visual destaca a diferença de custo significativa entre os modelos.

| Modelo | Entrada (por 1M tokens) | Saída (por 1M tokens) |

|---|---|---|

| gpt-5.2-pro | US$ 21,00 | US$ 168,00 |

| gpt-5.2 | US$ 1,75 | US$ 14,00 |

| gpt-5-mini | US$ 0,25 | US$ 2,00 |

O que esses preços significam para as empresas

Então, o que esses preços realmente significam? O GPT 5.2 é uma matéria-prima poderosa, mas bruta. O custo variável baseado em tokens pode tornar o orçamento para IA um desafio, especialmente se as inconsistências do modelo significarem que você terá que rodar o mesmo prompt várias vezes para obter um resultado utilizável. Cada tentativa custa dinheiro.

O preço mais alto do gpt-5.2-pro, especialmente para sua saída, significa que ele provavelmente é mais adequado para tarefas específicas e de alto valor, onde o custo pode ser justificado. Para muitas necessidades comerciais do dia a dia, ele pode não ser necessário.

Empresas que buscam custos de IA previsíveis podem considerar modelos diferentes. Por exemplo, alguns serviços como a eesel AI oferecem preços baseados em interações. Com esse modelo, os custos estão atrelados aos resultados (como um ticket resolvido), em vez da computação de tokens. Essa abordagem pode simplificar a previsão de custos e a medição do ROI.

O GPT 5.2 é uma ferramenta poderosa que requer manuseio cuidadoso?

Então, qual é a conclusão final sobre o GPT 5.2? Por um lado, ele estabelece novos recordes em benchmarks técnicos e representa um feito incrível de engenharia. Por outro, ele também apresenta alguns desafios de consistência e usabilidade em aplicações do mundo real, com alguns usuários iniciais relatando uma lacuna entre o desempenho nos benchmarks e sua experiência prática.

Para equipes técnicas com tempo, orçamento e expertise para experimentar, refinar prompts e construir salvaguardas extensas, ele oferece muito poder.

No entanto, muitas empresas não buscam trabalhar diretamente com um modelo de IA bruto. Elas buscam resolver problemas específicos, como reduzir tickets de suporte ou acessar conhecimento interno. O objetivo é o resultado, não o processo.

Uma alternativa a construir do zero é usar uma solução especializada. A eesel AI oferece produtos projetados para necessidades comerciais específicas. Ela aprende com os dados da empresa para fornecer respostas adaptadas ao contexto da organização. Veja como um Agente de IA pode começar a resolver seus tickets de suporte hoje mesmo.

Para ver alguns desses testes do mundo real em ação, este vídeo do Fireship oferece uma análise rápida e esclarecedora do desempenho do GPT 5.2, destacando tanto seus pontos fortes quanto onde ele parece não corresponder a todo o alvoroço (hype).

Perguntas frequentes

O GPT 5.2 é a série mais recente de modelos de linguagem da OpenAI, projetada para trabalhos profissionais complexos. Não é um modelo único, mas uma família (Instant, Thinking, Pro e mini) que promete grandes melhorias em programação, raciocínio e compreensão de documentos longos em comparação com versões mais antigas, como o GPT-4.

De acordo com os benchmarks da OpenAI, sim. Eles lançaram um modelo especializado, o GPT-5.2-Codex, que obteve pontuações mais altas em testes difíceis de engenharia de software. No entanto, alguns desenvolvedores no mundo real relataram resultados mistos, então sua experiência pode variar.

Isso parece se resumir a alguns fatores. Os usuários apontaram que o tom do GPT 5.2 pode parecer "monótono" ou excessivamente cauteloso, levando-o a recusar certas tarefas. Outros descobriram que ele tem dificuldades com a consistência e pode perder o contexto em conversas longas, o que nem sempre é capturado em testes de benchmark limpos.

O preço do GPT 5.2 varia de acordo com o modelo. O modelo `gpt-5.2` padrão custa US$ 1,75 para entrada (input) e US$ 14,00 para saída (output) por milhão de tokens. A versão mais poderosa, `gpt-5.2-pro`, é muito mais cara, custando US$ 21,00 para entrada e US$ 168,00 para saída por milhão de tokens.

Embora seja possível, a variabilidade de desempenho do modelo e os custos baseados em tokens são fatores a serem considerados para funções críticas como suporte ao cliente. As empresas costumam usar plataformas especializadas, como a eesel AI, que são treinadas em dados específicos da empresa para fornecer respostas consistentes para esses casos de uso.

Share this article

Article by

Stevia Putri

Stevia Putri é uma generalista de marketing na eesel AI, onde ajuda a transformar ferramentas poderosas de IA em histórias que ressoam. Ela é movida pela curiosidade, clareza e pelo lado humano da tecnologia.