Então, está a pensar em construir um agente de IA personalizado. É um projeto comum hoje em dia, com o objetivo de responder a perguntas de clientes ou a tickets internos muito mais rapidamente, permitindo que a sua equipa se concentre nos assuntos mais complicados. Assim que começar a pesquisar como realmente construir um, provavelmente encontrará dois nomes repetidamente: a API de Assistentes da OpenAI e o LangChain.

Escolher entre eles é uma grande decisão que tem de tomar no início. Este guia irá guiá-lo através das diferenças do mundo real, olhando para além das especificações técnicas para o que cada escolha significa para o orçamento, cronograma e sanidade do seu projeto no futuro. Vamos compará-los em termos de controlo, custo e facilidade de utilização, para que possa escolher a base certa. Poderemos até mostrar-lhe uma terceira opção que lhe permite evitar completamente a dor de cabeça do desenvolvimento.

O que é a API de Assistentes da OpenAI?

A API de Assistentes da OpenAI é uma framework que ajuda os programadores a construir aplicações de IA utilizando os modelos da OpenAI, como o GPT-4. Foi concebida para facilitar um pouco a criação de agentes de conversação que conseguem realmente lembrar-se do que foi dito anteriormente numa conversa. Pense nela como um kit de iniciação da OpenAI, que lhe dá algumas peças prontas para tarefas comuns de IA para lhe poupar alguma programação.

Possui algumas funcionalidades chave que tratam das partes aborrecidas da construção de um chatbot:

-

Threads Persistentes: Esta é apenas uma forma de dizer que a API gere o histórico da conversa por si. É uma funcionalidade simpática porque os seus programadores não precisam de acompanhar manualmente todo o registo da conversa a cada nova mensagem, o que mantém o código mais limpo.

-

Ferramentas Integradas: Vem com algumas ferramentas úteis logo à partida. O Code Interpreter permite que a IA execute código Python para coisas como cálculos ou análise de dados. O Knowledge Retrieval permite-lhe pesquisar documentos que carregou, um processo frequentemente chamado de Geração Aumentada por Recuperação (RAG).

-

Chamada de Funções: Isto permite que o seu assistente se conecte a ferramentas e APIs externas. Por exemplo, poderia usá-lo para verificar o estado de uma encomenda na sua loja Shopify ou registar um novo ticket no Jira.

Então, para quem é? A API de Assistentes é uma escolha sólida para equipas que estão totalmente imersas no ecossistema da OpenAI e querem um caminho mais guiado e simplificado. Mas não se deixe enganar por "simplificado" pensando que é uma ferramenta sem código. Ainda precisará de sérias competências de programação para construir, lançar e manter um agente de IA real e pronto para produção.

O que é o LangChain?

Do outro lado, temos o LangChain. É uma framework popular de código aberto para construir aplicações com modelos de linguagem de grande escala (LLMs). A maior diferença é que o LangChain não está vinculado a um fornecedor de modelos específico. É mais como um adaptador universal, concebido para ligar qualquer LLM aos dados da sua empresa, APIs externas e outras ferramentas.

Esta flexibilidade permite que os programadores criem fluxos de trabalho mais complicados e de múltiplos passos. Aqui estão as principais ideias por detrás dele:

-

Agnóstico de Modelo: Este é o grande ponto. Com o LangChain, pode usar modelos da OpenAI, Anthropic (Claude), Google (Gemini), ou até mesmo modelos de código aberto que aloja por conta própria. Dá-lhe a liberdade de escolher o melhor modelo para uma tarefa específica e ajuda-o a evitar ficar preso a um único fornecedor.

-

Cadeias (Chains): O LangChain tem tudo a ver com permitir que ligue vários passos. Por exemplo, uma "cadeia" pode pegar na pergunta de um utilizador, extrair informações de uma base de dados, enviá-las para um LLM para escrever um resumo amigável e depois formatar a resposta final.

-

Agentes: Os agentes levam as coisas um passo mais além. Usam um LLM como um cérebro para decidir o que fazer a seguir. Em vez de apenas seguir uma lista de passos pré-definida, um agente pode descobrir por si próprio se precisa de usar uma ferramenta de pesquisa, uma calculadora ou alguma outra API para obter a resposta certa.

O LangChain é para programadores que querem controlo total, adoram experimentar diferentes LLMs ou precisam de construir fluxos de trabalho de IA realmente específicos e complexos. Mas todo esse poder tem um preço: é mais difícil de aprender, e fica responsável por gerir todas as partes móveis.

Diferenças Chave

A escolha entre estes dois resume-se realmente a alguns compromissos chave. Está basicamente a decidir entre algo que é mais simples para começar versus algo que lhe dá mais controlo, e ter algo a funcionar rapidamente versus ter mais flexibilidade a longo prazo. Vamos aprofundar o que isso realmente significa.

| Característica | API de Assistentes | LangChain |

|---|---|---|

| Objetivo Principal | Kit de iniciação para modelos OpenAI | Framework universal e agnóstica de modelo |

| Controlo | Limitado ao ecossistema da OpenAI | Controlo total sobre todos os componentes |

| Flexibilidade | Menor, dependente do roadmap da OpenAI | Elevada, pode trocar modelos/bases de dados |

| Dependência do Fornecedor | Elevada, integração profunda com a OpenAI | Baixa, projetada para ser agnóstica de modelo |

| Facilidade de Configuração | Mais simples para bots básicos | Configuração inicial mais complexa |

| Manutenção | Dependente das atualizações da OpenAI | Autogerida, mais complexa |

| Modelo de Custo | Pagamento conforme o uso para todos os serviços | Framework gratuita, mas paga pelo LLM, alojamento e engenheiros |

Controlo, flexibilidade e dependência do fornecedor

-

LangChain: Esta framework dá-lhe as chaves do reino. Pode trocar literalmente todas as partes da sua configuração de IA: o LLM, a base de dados vetorial que usa para RAG, os modelos de embedding, tudo. Esta é a sua melhor proteção contra ficar preso a um fornecedor. Se um modelo novo e melhor surgir amanhã, pode mudar. A desvantagem? A sua equipa de engenharia é agora responsável por construir e manter todo este sistema complexo, o que pode facilmente tornar-se um trabalho a tempo inteiro.

-

API de Assistentes: Usar esta API significa que está praticamente preso ao mundo da OpenAI. Tem de usar os modelos deles, o sistema de recuperação deles e a forma deles de fazer as coisas. É mais simples pôr uma versão básica a funcionar, mas também está dependente dos preços e do roadmap deles. Se eles alterarem os preços ou eliminarem um modelo do qual depende, não há muito que possa fazer.

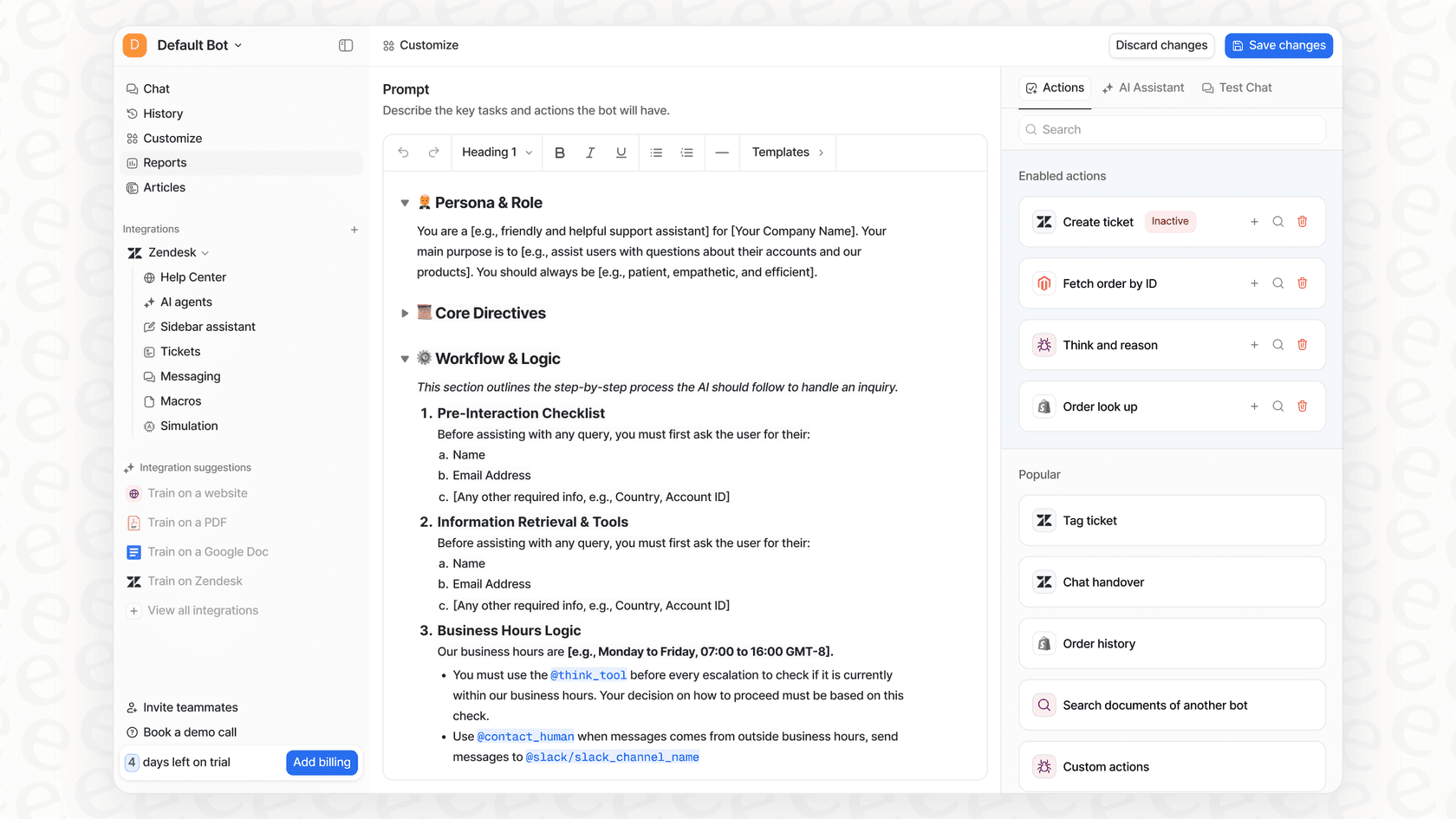

Do ponto de vista empresarial, este debate pode parecer um pouco abstrato. Apenas quer algo que funcione; não quer gerir uma pilha tecnológica ou preocupar-se em ficar preso a um fornecedor. É aqui que uma solução como a eesel AI muda a conversa. Ela trata de toda a tecnologia complexa nos bastidores, mas dá-lhe um painel de controlo simples e sem código para controlar a personalidade da sua IA, fontes de conhecimento e o que ela pode fazer, sem precisar que os seus engenheiros escrevam uma única linha de código.

Facilidade de configuração e manutenção contínua

-

API de Assistentes: A maioria das pessoas acha que é um pouco mais fácil de começar, especialmente para projetos simples, porque trata automaticamente de coisas como a memória da conversa. Mas construir uma aplicação polida e fiável ainda é um projeto enorme. Precisa de alguém que realmente saiba como trabalhar com APIs, gerir diferentes ferramentas e construir uma interface de utilizador. E a manutenção nunca para, tem de acompanhar constantemente as alterações e atualizações da API da OpenAI.

-

LangChain: Este caminho é definitivamente mais trabalhoso à partida. Tem de escrever muito mais código só para ligar as peças básicas, gerir a memória do agente e configurar os seus fluxos de trabalho. Embora isto lhe dê mais controlo, também significa que há muito mais código para depurar e manter. Muitos programadores descobrem que os projetos LangChain podem tornar-se incrivelmente complicados, rapidamente.

Existe uma forma mais rápida de lá chegar. Ambos os caminhos precisam de meses do tempo de um programador para criar algo que realmente queira que os clientes usem. Para empresas que precisam de uma solução agora, uma plataforma como a eesel AI oferece um caminho totalmente diferente. Pode ligar o seu helpdesk (como Zendesk) e bases de conhecimento (como Confluence) em poucos cliques e ter um agente de IA a funcionar implementado no mesmo dia. É a diferença entre um projeto de engenharia de seis meses e um resultado imediato.

RAG, uso de ferramentas e fluxos de trabalho avançados

Ambas as frameworks podem construir poderosos bots RAG e agentes que podem usar outras ferramentas para realizar tarefas.

O LangChain dá-lhe um controlo muito detalhado sobre todo o processo RAG. Pode configurar formas personalizadas de dividir documentos, escolher entre todo o tipo de armazenamentos vetoriais e usar modelos de reranking sofisticados para tornar as suas respostas mais precisas. Também tem ferramentas avançadas como o LangGraph para construir agentes realmente complexos que podem voltar atrás e corrigir-se a si mesmos.

A API de Assistentes tem um sistema RAG poderoso, mas é mais uma "caixa preta." Carrega os seus ficheiros e simplesmente funciona, mas não tem muita palavra a dizer sobre como funciona nos bastidores. Para muitas situações, é perfeitamente adequado, mas se tiver necessidades muito específicas, pode achá-lo um pouco restritivo.

Para uma equipa de suporte, o objetivo não é construir o sistema RAG mais tecnicamente elegante; é apenas obter respostas precisas dos documentos certos. Uma ferramenta como a eesel AI conecta-se a todo o seu conhecimento de uma só vez, aprendendo com tickets passados, artigos de ajuda e documentos internos. Pode facilmente dizer-lhe o que deve e não deve saber, dando-lhe respostas fiáveis sem o drama da engenharia.

__

Análise de Preços

Vamos falar de dinheiro, porque a forma como paga por estes dois é completamente diferente, e a conta final pode ser um verdadeiro choque.

-

Preços da API de Assistentes: Paga conforme o uso, por tudo. Isto inclui os tokens para o modelo da OpenAI que está a usar, uma taxa para armazenar os threads da conversa e outra taxa para usar a ferramenta de recuperação com base na quantidade de dados que está a armazenar. Este preço baseado no uso pode tornar-se caro rapidamente e é quase impossível de prever, o que torna o orçamento um pesadelo.

-

Preços do LangChain: A framework em si é gratuita porque é de código aberto, o que parece apelativo. Mas o custo total é geralmente muito mais elevado. Ainda tem de pagar pelas chamadas à API de qualquer LLM que escolha (o que é igualmente imprevisível), mais tem de pagar pelo alojamento da sua aplicação, uma base de dados vetorial e, mais importante, o salário pesado dos engenheiros que precisa para construir e manter tudo.

Existe uma forma melhor de orçamentar. Esta é uma grande razão pela qual muitas empresas escolhem uma plataforma como a eesel AI. O preço é claro e previsível. Paga uma taxa fixa baseada num número definido de interações de IA por mês, para que saiba exatamente qual será a sua fatura. Sem surpresas, sem taxas por token. Torna simples orçamentar e provar o valor desde o primeiro dia.

__

O dilema empresarial: Construir vs. Comprar

No final do dia, escolher entre a API de Assistentes e o LangChain é uma decisão clássica de "construir". Está a dar aos seus programadores um conjunto de ferramentas para construir uma solução do zero. Este é o passo certo se construir sistemas de IA for uma parte central do que a sua empresa faz.

But para a maioria das empresas, especialmente em departamentos como suporte ao cliente ou TI, o objetivo não é tornar-se especialista em frameworks de IA. O objetivo é resolver problemas mais rapidamente, cortar custos e tornar clientes e funcionários mais felizes.

É aqui que uma decisão de "comprar" muitas vezes faz muito mais sentido. Uma plataforma de IA como a eesel AI não é uma ferramenta para programadores; é uma solução de negócio. Dá-lhe o poder de um agente construído à medida sem o tempo, custo, risco e manutenção constante que advêm de o construir por si mesmo.

| Fator | Construir (API de Assistentes / LangChain) | Comprar (eesel AI) |

|---|---|---|

| Utilizador | Programadores | Utilizadores de Negócio (ex: Diretor de Suporte) |

| Tempo até ao Valor | Semanas ou meses | Minutos ou horas |

| Escolha do Modelo | Preso à OpenAI ou complexo de gerir | Os melhores modelos são geridos por si |

| Custo Total | Imprevisível e elevado (taxas de API + salários de programadores) | Previsível, taxa de subscrição fixa |

| Risco | Elevado (falha do projeto, sobrecarga de manutenção) | Baixo (plataforma comprovada, serviço gerido) |

Pense na diferença em termos práticos. Tanto a API de Assistentes como o LangChain são ferramentas para programadores. Uma solução como a eesel AI é construída para um utilizador de negócio, como um Diretor de Suporte. Configurar um agente personalizado com ferramentas de programação pode levar semanas ou até meses. Uma plataforma sem código pode estar a funcionar em minutos. Com a API, está preso aos modelos da OpenAI, enquanto o LangChain lhe dá escolha, mas adiciona complexidade. Uma plataforma gerida escolhe os melhores modelos por si. Finalmente, o custo de uma construção personalizada é imprevisível e elevado quando se considera o tempo dos programadores, enquanto uma subscrição é previsível e fácil de gerir.

API de Assistentes vs. LangChain: Foco no resultado, não na framework

A conversa sobre a API de Assistentes vs. LangChain é boa para as equipas de engenharia terem. A API de Assistentes dá-lhe um caminho mais simples, mas mais restritivo com a OpenAI, enquanto o LangChain oferece liberdade total, mas com muito mais complexidade.

Ambos são conjuntos de ferramentas poderosos para construir algo. Mas ambos requerem um grande e contínuo investimento em programadores especializados para obter qualquer retorno.

Para os líderes empresariais, há uma pergunta melhor a fazer: qual é a forma mais rápida e fiável de obter o resultado que quero? Em vez de iniciar um projeto interno longo, caro e arriscado, poderia usar uma plataforma que lhe dá o resultado final, um agente de IA inteligente, integrado e eficaz, desde o primeiro dia.

Pronto para implementar um agente de IA que aprende com o seu conhecimento existente e funciona com as suas ferramentas, sem todo o trabalho pesado? Experimente a eesel AI gratuitamente e veja quão rapidamente pode começar a automatizar o suporte.

Perguntas frequentes

A diferença principal reside no [controlo versus conveniência](https://community.openai.com/t/the-difference-of-assistant-api-and-langchain/496223). A API de Assistentes oferece um ambiente mais gerido e específico da OpenAI, simplificando alguns aspetos do desenvolvimento mas limitando a flexibilidade. O LangChain fornece uma framework de código aberto e altamente personalizável que funciona com vários LLMs mas requer mais esforço de desenvolvimento.

Optar pela API de Assistentes significa comprometer-se com o ecossistema da OpenAI, incluindo os seus modelos e serviços. [O LangChain, por ser agnóstico de modelo](https://blog.finxter.com/langchain-vs-assistant-api-comparing-nlp-powerhouses/), permite alternar entre diferentes fornecedores de LLM, reduzindo significativamente a dependência do fornecedor e oferecendo maior flexibilidade a longo prazo.

A API de Assistentes é frequentemente vista como mais fácil para a configuração inicial, especialmente para agentes de conversação simples, devido às suas funcionalidades integradas como threads persistentes. No entanto, construir uma aplicação pronta para produção com qualquer uma delas ainda exige uma experiência de desenvolvimento significativa e manutenção contínua.

Os custos da API de Assistentes são baseados no uso, cobrindo tokens, armazenamento de threads e recuperação, o que os torna imprevisíveis. O LangChain em si é gratuito, mas os custos totais incluem chamadas à API do LLM, alojamento e, crucialmente, os salários substanciais dos engenheiros necessários para o desenvolvimento, implementação e manutenção contínua.

Para [máxima personalização e controlo detalhado](https://www.ampcome.com/articles/openai-assistants-vs-langchain-agents-what-are-they-how-to-build-them), o LangChain é a escolha superior. Permite que os programadores configurem todos os componentes, desde LLMs específicos e pipelines RAG a [agentes de múltiplos passos](https://www.eesel.ai/pt/blog/what-are-autonomous-ai-agents-a-guide-for-businesses) complexos, oferecendo uma flexibilidade incomparável em comparação com a API de Assistentes mais opinativa.

A API de Assistentes fornece um sistema de RAG potente e pronto a usar onde carrega ficheiros, mas funciona como uma "caixa preta" com personalização limitada. O LangChain oferece um controlo extensivo sobre todo o pipeline de RAG, permitindo a divisão personalizada de documentos, vários armazenamentos vetoriais e reranking sofisticado.

A API de Assistentes é adequada para projetos profundamente integrados com o ecossistema da OpenAI que priorizam uma configuração mais rápida para tarefas de conversação mais simples. O LangChain é ideal para [fluxos de trabalho de IA complexos e personalizados](https://dev.to/ruturajmaggirwar/langchain-with-pinecone-vs-openai-assistant-3l19), aplicações multi-modelo, ou cenários onde evitar a dependência do fornecedor e ter um controlo profundo são críticos.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.