新しいAIモデルが頻繁にリリースされる中、大きな注目を集めているのがDeepSeek V3.2です。DeepSeek AIによるこの新しいオープンウェイトモデルは、そのパフォーマンスの高さで知られ、GPT-5のようなモデルとも比較されています。

これは開発者や研究者にとって重要な一歩となりますが、技術的な詳細は複雑になりがちです。ビジネスにおける最大の関心事は、その実用的なアプリケーションについてでしょう。その用途、制限、そしてかかるコストを理解することが、その能力を活用するための鍵となります。

DeepSeek V3.2とは?

DeepSeek V3.2は、強力でありながら計算効率も高くなるように構築された大規模言語モデル(LLM)です。実験的なV3.2-Expモデルの正式な後継であり、すべてのジョブにスーパーコンピュータを必要とすることなく、困難な推論タスクを処理し、有能なAIエージェントとして機能するように設計されています。

3.2 Specialeについては……「Speciale」の部分は単に数学関係が得意になっただけではないでしょうか?「3.2 Speciale」が「3.2」から改善された点が、文章作成に役立つかどうかは分かりません。(以前から出ている「3.2 Exp」の話ではなく、今日両方リリースされた「3.2」対「3.2 Speciale」の話をしています)。

このモデルには、いくつかの異なる種類があります。

-

DeepSeek V3.2: これがメインバージョンであり、Webインターフェース、アプリ、およびAPIを通じて利用可能です。幅広いタスクに対応し、特に外部ツールを使用して物事を完了させることに長けた、汎用性の高いオールラウンダーだと考えてください。

-

DeepSeek V3.2-Speciale: こちらはAPI経由でのみ利用可能なスペシャリストモデルです。深い推論タスク専用に訓練されており、競技プログラミングや高度な数学に優れています。引き換えに、ツール呼び出し(tool-calling)をサポートしていないため、汎用性は低くなります。また、2025年12月15日までの期間限定エンドポイントを通じてのみ提供される予定です。

これが大きな話題となっている理由は、本モデルが「オープンウェイト(open-weight)」モデルであるためです。つまり、モデルのコアコンポーネント(重み)がHugging Faceなどのプラットフォーム上で、標準版およびSpeciale版の両方で公開されています。これにより、研究者や開発者はその上で構築したり、カスタマイズしたりして、どのような可能性があるかを探ることができます。

DeepSeek V3.2の主な機能

このモデルのパフォーマンスは、スピード、知能、および能力を強化するいくつかの革新的な技術によるものです。

DeepSeek Sparse Attention (DSA) による効率性の向上

LLMの最大のボトルネックの一つは「アテンション(注意機構)」です。これは、モデルが会話の文脈を振り返って、関連性の高い回答を生成するための仕組みです。通常の計算方法では、AIが過去のすべての単語を分析しなければならないため、計算コストが非常に高くなります。

DeepSeek V3.2は、DeepSeek Sparse Attention (DSA) と呼ばれるよりスマートなアプローチを使用しています。「ライトニングインデクサー」と「トークンセレクター」を備えており、テキストの最も関連性の高い部分だけを素早く見つけて焦点を当てます。すべてを分析する代わりに、主要な要素を選び出します。

この変更により、計算負荷が大幅に軽減され、スピードが向上し、特に長いドキュメントやチャット履歴を伴うタスクのコストが削減されます。これは実験的なV3.2-Expモデルで最初にテストされ、今回完成されたイノベーションです。

高度な推論のためのスケーラブルな強化学習

複雑な推論に極めて強くなるために、DeepSeek V3.2は「検証可能な報酬を伴う強化学習(RLVR:Reinforcement Learning with Verifiable Rewards)」と呼ばれる方法を用いて訓練されました。単に人間からフィードバックを受けるだけでなく、数学やコーディングなどの分野で、検証可能な正解を出したことに対してモデルに報酬が与えられます。これは、生徒が単に正しい答えを出すだけでなく、その計算過程(解法)を示したことに対して評価するのと似ています。

また、自分の作業をダブルチェックすることも学習します。モデルは自身の推論ステップを検証し、回答を洗練させることができるため、より信頼性の高い出力につながります。開発者が指摘しているように、これは「正解が正しい推論を保証するわけではない」ため、重要なポイントです。

さらに、deepseek-reasoner APIモデルで利用可能な「Thinking(思考)」モードも備えており、回答を生成する前にタスクを計画し、推論することができます。これは、より思慮深く正確なAIに向けた大きな一歩です。

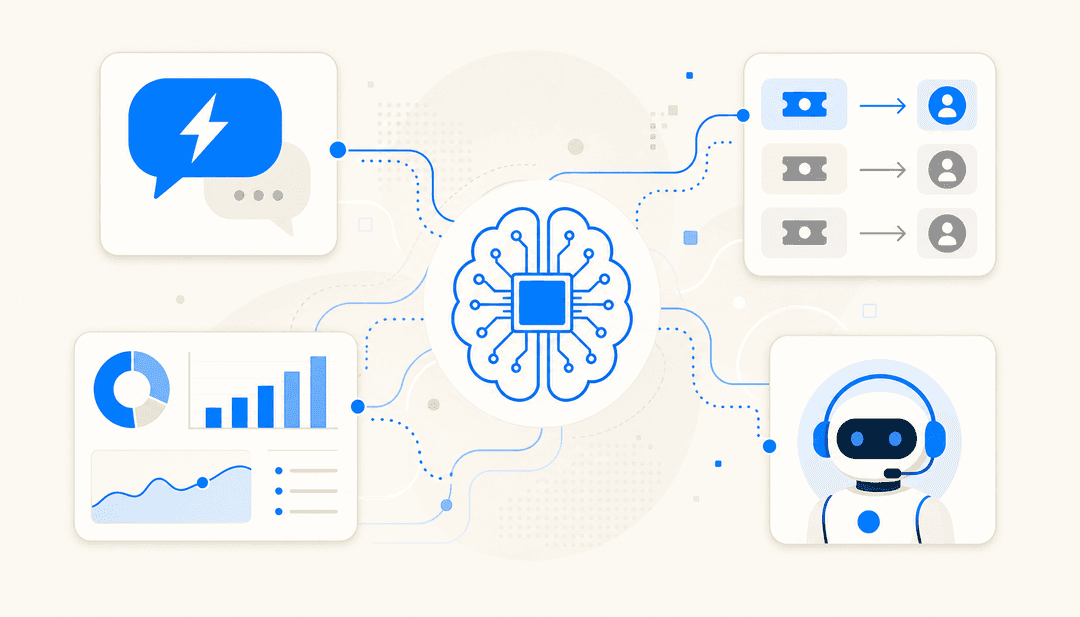

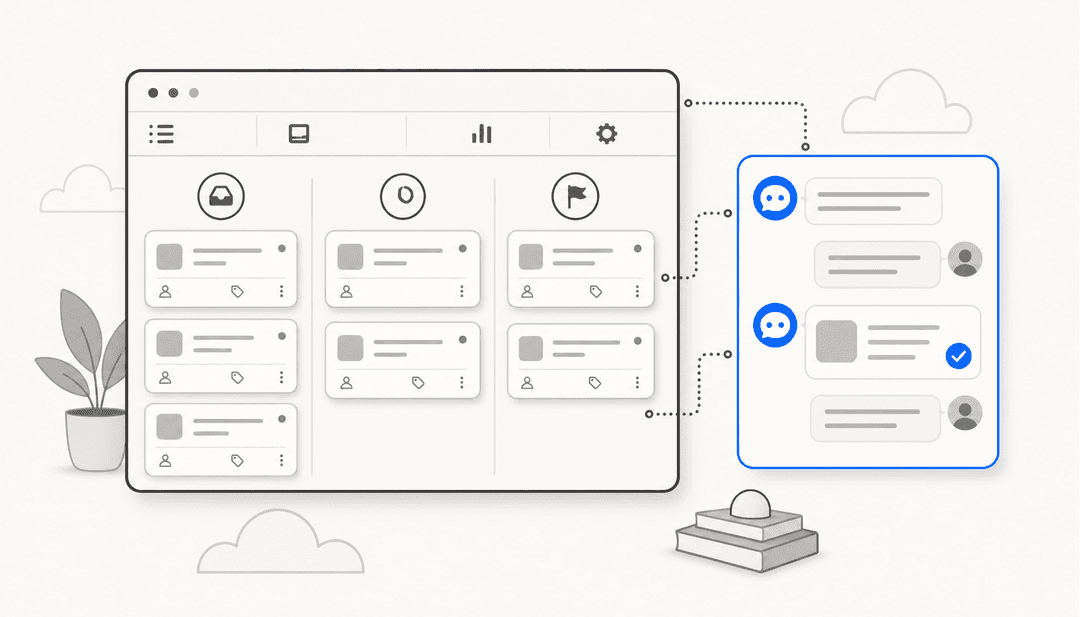

エージェント機能とツールの統合

DeepSeek V3.2は単にテキストを生成するだけではありません。外部ツールを使用してタスクを完了できる「エージェント」として設計されています。1,800以上の環境を使用したパイプラインを用いて訓練されました。

これにより、AIは何かついて話すだけの段階から、注文の照会や返金処理のように、実際に何かを実行する段階へと進むことができます。ビジネスにとって、これは重要な能力です。しかし、生のモデルを使用する場合、特定のビジネスツール(サポートチケット用のZendeskや、Eコマース用のShopifyなど)への接続の構築と管理は、大規模なエンジニアリングプロジェクトとなります。強力なエンジンではありますが、その周囲に車を構築する必要があるのです。

DeepSeek V3.2のパフォーマンスとベンチマーク

DeepSeek AIのチームは透明性を重視しており、テクニカルレポートで広範なベンチマークを公開しています。その結果は、V3.2が単に商用モデルに追いついているだけでなく、世界最高のモデルと対等に渡り合っていることを示しています。

主要モデルとの比較

公式テクニカルレポートによると、標準のDeepSeek V3.2モデルは主要なベンチマークにおいてGPT-5と同等のパフォーマンスを発揮しています。V3.2-Specialeバリアントは、推論においてGPT-5を上回り、Gemini-3.0-Proに匹敵するパフォーマンスを持つと報告されています。

DeepSeekのウェブサイトはまだ旧バージョンのままなので、OpenRouterで試してみました。Sonnet 4.5、Opus 4.5、Gemini 3.0でしか解けないような最も難しい質問を投げましたが、結果はDeepSeek v3.2 Specialeも正しく回答しました。これを実現した最初のオープンモデルです。GLM 4.6ですら無理でした。

以下は、最も過酷な評価ベンチマークにおける各モデルの比較です。

| モデル | HLE (Holistic Language Evaluation) | Codeforces (Elo) | MMLU-Pro | GPQA-Diamond |

|---|---|---|---|---|

| DeepSeek V3.2 | 21.7 | 2046 | 85.0 | 80.7 |

| DeepSeek V3.2-Speciale | 25.1 | 2401 | 86.2 | 84.1 |

| GPT-5 | 23.5 | 2355 | 85.8 | 83.0 |

| Gemini-3.0-Pro | 26.3 | 2420 | 86.5 | 84.8 |

専門分野における実績

ベンチマークのスコアだけでなく、このモデルは現実世界でも顕著な成果を上げています。V3.2-Specialeモデルは、国際的な学術競技会において高いレベルのパフォーマンスを実証しました。

また、ICPCワールドファイナルや中国数学オリンピックのテストにも合格しました。これは、単なるテキスト生成を超えて、高度な問題解決が必要な複雑で専門的な課題に対処できる能力を示しています。

DeepSeek V3.2を使用する際の実用的な検討事項

モデルの生のパワーは否定できませんが、それをビジネスに役立つツールに変えるには、実用的な計画が必要です。決して「プラグアンドプレイ(差し込めばすぐ使える)」ではありません。

確かに、説得力がありクリエイティブなシーンを書くのは得意です。しかし、なりすまし(impersonate)を好むモデルのようで、それはNGです。その落とし穴を避けるようにプロンプトで指示できるかどうかを確認する必要があります。そうでなければ、レギュラーメンバーの一員になれるポテンシャルがあるのですが。

DeepSeek V3.2モデルへのアクセスと実行方法

最も簡単な開始方法は、DeepSeek Platform APIを使用することです。サインアップしてすぐに呼び出しを開始できます。高度に特化したSpecialeバリアントは、2025年12月15日に期限切れとなる一時的なエンドポイント上にあることを忘れないでください。

自社サーバーでモデルを実行することは技術的に可能ですが、それは本格的な取り組みとなります。カスタムコード、vLLMのような専門ツール、そして非常に高価な大量のGPUハードウェアが必要です。ほとんどのビジネスにとって、これは現実的な選択肢ではありません。

DeepSeek V3.2のAPI価格とコスト

DeepSeek V3.2は、100万トークン(トークンは基本的にな単語または単語の一部)単位で価格設定されています。価格競争力はありますが、大規模に使用するとすぐにコストがかさみます。また、モデルが「Thinking(思考)モード」であるかどうか、および入力テキストが以前に処理されたことがあるか(「キャッシュヒット」)によっても価格が変わります。

公式の料金ページによる内訳は以下の通りです。

| モデルバージョン | 入力価格 (1M トークン) | 出力価格 (1M トークン) |

|---|---|---|

| DeepSeek-V3.2 (Non-thinking) | $0.28 (キャッシュミス) / $0.028 (キャッシュヒット) | $0.42 |

| DeepSeek-V3.2 (Thinking) | $0.28 (キャッシュミス) / $0.028 (キャッシュヒット) | $0.42 |

V3.2-Specialeモデルは、提供期間中、同じ価格で提供されています。その専門的な能力を考えると、非常にお得な価格設定です。

モデルとビジネスソリューションのギャップ

重要な考慮事項は、DeepSeek V3.2が基礎となる「エンジン」であるということです。ビジネスにとって、完全なソリューションにはエンジン以上のものが必要です。生のLLMは、より大きなシステムの一構成要素に過ぎません。

APIを使用するだけでは不足している点は以下の通りです。

-

統合(インテグレーション): モデルは、そのままではヘルプデスクやEコマースプラットフォーム、社内Wikiと会話することはできません。Zendesk、Shopify、Slackなどのビジネスシステムに接続するには、膨大なカスタム開発作業が必要です。

-

アプリケーション層: チームが使用するためのダッシュボードも、パフォーマンスを確認するためのレポートも、「請求に関する質問は常に人間にエスカレーションする」といったビジネスルールを設定する簡単な方法もありません。

-

継続的な学習ループ: モデルは最新のサポートチケットや更新されたナレッジベース記事から自動的に学習することはありません。常に最新の状態を保つためには、データパイプライン全体を構築する必要があります。

-

データプライバシー: DeepSeekのプライバシーポリシーには、ユーザーデータがサービス向上のために使用される可能性があること(オプトアウト可能)、およびデータが中国(PRC)に保存されることが記載されています。これは、厳格なデータ居住性やプライバシー要件を持つ企業にとっては、致命的な問題になる可能性があります。

ここで、eesel AIのようなプラットフォームが役立ちます。eeselは、強力なモデルを統合したカスタマーサービス用のAIソリューションを提供します。ビジネスツールに接続し、既存のデータから学習し、顧客とのやり取りの前に安全な環境でパフォーマンスをテストできるように設計されています。また、eeselはデータプライバシーに関するポリシーを設けており、データがトレーニングに使用されないことを契約で保証したり、コンプライアンスのニーズに合わせてEU域内でのデータ居住を提供したりしています。

オープンモデルにおける大きな前進

DeepSeek V3.2は、オープンウェイトモデルにおける重要な成果であり、開発者に強力な新しいツールを提供します。これは、高性能なAIがより身近なものになりつつあることを示しています。

このモデルの技術的な成果や、なぜこれが新しい「最先端(state-of-the-art)」の候補となり得るのかをさらに深く知るために、bycloudによるこの動画が、その能力を非常に分かりやすく解説しています。

今後のステップは、2つの視点から検討できます。

-

開発者向け: DeepSeek APIやHugging Face上のモデルを利用して、モデルの能力を直接探索することができます。

-

ビジネスリーダー向け: AIモデルのパワーとアクセシビリティが向上していることは、一つの選択肢を提示しています。企業は、社内ソリューションを独自に開発するか、あるいはこのテクノロジーを安全で信頼性の高いビジネスツールに統合することに特化したプラットフォームと提携するかを選択できます。

サポートの自動化やエージェントの効率化にAIを適用したいと考えている企業には、eesel AIのようなソリューションが用意されています。eeselはビジネスシステムと統合し、社内データから学習して顧客対応の自動解決を提供するように設計されており、最大81%の自律的な解決という結果も報告されています。

よくある質問

DeepSeek V3.2は、開発者がその上で構築できる「オープンウェイト(open-weight)」という性質と、効率性を高めるDeepSeek Sparse Attention(DSA)の使用が際立っています。これは、特に長いコンテキストを扱うタスクにおいて、強力でありながら計算コストが低いことを意味します。

DeepSeek V3.2にはAPI経由でアクセスできますが、ビジネスで効果的に活用するにはかなりの開発作業が必要です。既存のツール(ZendeskやShopifyなど)への統合を構築し、ユーザーインターフェースを作成し、データパイプラインを管理する必要があります。eesel AIのようなプラットフォームはこれらを代行し、このようなモデルを搭載したすぐに使えるソリューションを提供します。

いいえ、DeepSeek V3.2は無料ではありません。APIを通じたトークン使用量に基づいて課金されます。コストは標準モードか「Thinking(思考)」モードかによって異なり、大規模な利用ではすぐに積み重なる可能性があります。モデルの重み(ウェイト)は研究者向けに公開されていますが、APIを介した商用利用は有料サービスです。

公式のテクニカルレポートによると、標準のDeepSeek V3.2モデルは、いくつかの主要なベンチマークでGPT-5と同等のパフォーマンスを発揮します。特化型バージョンのDeepSeek V3.2-Specialeは、複雑な推論タスクにおいてGPT-5を凌駕することもあり、AI分野におけるトップクラスの競合となっています。

主な制限は実用面での課題です。生のモデルには、ビジネス固有の統合、使いやすいアプリケーション層、および自動学習ループが欠けています。さらに、データが中国(PRC)に保存されると記されているデータプライバシーポリシーは、厳格なデータ居住要件を持つ企業にとって懸念事項になる可能性があります。

標準のDeepSeek V3.2は、ツール呼び出し(tool-calling)をサポートする汎用性の高いオールラウンダーであり、幅広いエージェンティックなタスクに適しています。DeepSeek V3.2-Specialeは、深い推論のために訓練された高度な特化型バージョンで、数学やコーディングに優れていますが、ツール呼び出しはサポートしておらず、期間限定での提供となります。

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.