Es fühlt sich so an, als gäbe es jede Woche eine neue KI-Ankündigung, die einen innehalten und staunen lässt, und OpenAIs Enthüllung einer hyperrealistischen, konversationellen Stimme für ChatGPT war definitiv eine davon. Die Demos waren ziemlich beeindruckend – eine KI, die plaudern, lachen und sogar singen konnte, mit einem fast unheimlichen Maß an menschenähnlicher Emotion und Timing.

Diese neue Funktion, Teil des großen ChatGPT Voice Rollouts, läuft auf ihrem neuesten Modell, GPT-4o. Es ist ein riesiger Sprung von den textbasierten Chats, an die wir alle gewöhnt sind, und entführt uns in eine Welt, in der sich das Gespräch mit einer KI viel natürlicher anfühlt. Die gute Nachricht ist, dass es jetzt für jeden verfügbar ist, der eingeloggt ist, obwohl Sie als zahlender Abonnent viel höhere Nutzungslimits erhalten.

Was hat es also mit der ganzen Aufregung auf sich? In diesem Beitrag werden wir uns damit beschäftigen, was dieser neue Sprachmodus ist, wie er im Vergleich zur alten Version abschneidet, was die Leute wirklich darüber denken und was seine Grenzen für Unternehmen bedeuten, die konversationelle KI für mehr als nur ein bisschen Spaß nutzen möchten.

Was ist der neue GPT-4o Sprachmodus?

Im Kern ist der neue Sprachmodus (Voice Mode) eine völlig andere Spezies. Er wird von GPT-4o angetrieben, dem ersten Modell von OpenAI, das von Anfang bis Ende auf Text, Bild und Audio trainiert wurde. Einfach ausgedrückt: Es verarbeitet nicht nur Wörter, es verarbeitet Klang.

Dies ist aus technischer Sicht eine massive Veränderung. Der alte Sprachmodus war etwas schwerfällig und wurde aus drei separaten Modellen zusammengestellt: eines, um Ihre Sprache in Text umzuwandeln, ein zweites, um eine Antwort zu generieren, und ein drittes, um diesen Text wieder in Sprache umzuwandeln. Es funktionierte, aber es war nicht gerade flüssig.

GPT-4o erledigt alles in einem Durchgang. Da die KI Audio direkt verarbeitet, kann sie Ihren Tonfall erfassen, mehrere Sprecher hören und sogar Hintergrundgeräusche bemerken, ohne abgelenkt zu werden. Dieser All-in-One-Ansatz lässt das Gespräch viel realer wirken, mit einer durchschnittlichen Antwortzeit von nur 320 Millisekunden. Das ist im Grunde so schnell wie ein Mensch.

Hier ist, was das tatsächlich für Sie bedeutet:

-

Echtzeit-Antworten, flüssiger Ablauf: Diese unangenehmen, roboterhaften Pausen gehören der Vergangenheit an. Die KI antwortet fast sofort, sodass das Gespräch natürlich fließt.

-

Sie können sie unterbrechen: Genau wie beim Gespräch mit einem Freund können Sie einspringen, während die KI spricht. Sie wird anhalten, zuhören und ihre Antwort anpassen, ohne verwirrt zu werden.

-

Emotionales und tonales Bewusstsein: Das ist der wirklich coole Teil. GPT-4o kann die kleinen Feinheiten in Ihrer Stimme erfassen, wie Sarkasmus, Aufregung oder Zögern, und mit einer breiten Palette eigener Emotionen und Tonfälle antworten.

Um Ihnen einige Optionen zu geben, stehen neun voreingestellte Stimmen zur Auswahl: Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce und Vale. Sie finden sie alle in den offiziellen FAQ aufgelistet.

Natürlich verlief der Rollout nicht völlig reibungslos. Sie haben vielleicht von dem Drama um die „Sky“-Stimme gehört. OpenAI musste diese pausieren, nachdem Scarlett Johansson Bedenken geäußert hatte, dass sie ihrer Stimme sehr ähnlich klang. Eine von NPR in Auftrag gegebene Analyse ergab später, dass Skys Stimme der von Johansson ähnlicher war als 98 % der anderen Schauspielerinnen, die sie untersuchten. Das zeigt nur, wie knifflig diese neue Welt der KI-Interaktion wird.

Vergleich der alten und neuen Sprachmodi

Obwohl die Technik ein riesiger Schritt nach vorne ist, war die tatsächliche Benutzererfahrung (User Experience) ein viel diskutiertes Thema. Es ist sicher schneller, aber ist es auch besser? Die Antwort ist etwas komplizierter, als man denkt.

Um wirklich zu verstehen, was anders ist, lassen Sie uns den alten Sprachmodus dem neuen gegenüberstellen.

| Funktion | Standard-Stimme (Legacy) | Fortgeschrittener Sprachmodus (GPT-4o) |

|---|---|---|

| Zugrunde liegendes Modell | Drei separate Modelle für Transkription, Intelligenz und Sprachsynthese | Ein einzelnes, multimodales End-to-End-Modell (GPT-4o) |

| Antwortgeschwindigkeit | Spürbare Verzögerung von 2,8 bis 5,4 Sekunden | Nahezu verzögerungsfrei, mit einer durchschnittlichen Antwortzeit von 320ms |

| Gesprächsfluss | Rundenbasiert; Sie mussten warten, bis die KI fertig gesprochen hatte | Flüssig und unterbrechbar, ermöglicht natürliches Hin und Her |

| Tonales Bewusstsein | Monoton und roboterhaft; konnte Benutzeremotionen aus dem Audio nicht verarbeiten | Kann Benutzeremotionen erkennen und mit variabler Intonation antworten |

| Benutzerwahrnehmung | Oft als „bedacht“, „ruhig“ und „tröstlich“ beschrieben | Von einigen als „gehetzt“, „oberflächlich“ und weniger persönlich empfunden |

In der letzten Zeile, „Benutzerwahrnehmung“, wird es interessant. Obwohl die neue Stimme technisch gesehen in jeder Hinsicht besser ist, vermisst eine überraschende Anzahl von Menschen tatsächlich die alte Version. Die Legacy-Stimme mit ihren langsamen, bewussten Pausen fühlte sich für manche tiefgründiger an. Sie gab einem eine Sekunde Zeit zum Nachdenken und fühlte sich wie ein ruhiger, geduldiger Partner an.

Im Gegensatz dazu kann sich die neue GPT-4o-Stimme manchmal etwas zu eifrig anfühlen. Sie antwortet so schnell, dass man das Gefühl haben kann, sie wolle das Gespräch vorantreiben. Für kurze Fragen ist das großartig. Aber für tiefere Brainstorming-Sitzungen oder einfaches lautes Nachdenken fanden einige Nutzer, dass das alte, langsamere Tempo tatsächlich hilfreicher war.

Man kann im AVM auch keine so tiefgehenden Diskussionen führen wie im Standard-Modus, und die Antworten sind viel oberflächlicher. Das ist unbrauchbar, wenn man Brainstorming für kreative Schreibprojekte etc. betreibt.

So greifen Sie auf den neuen Sprachmodus zu und nutzen ihn

Wollen Sie es selbst ausprobieren? Der Einstieg ist ziemlich einfach.

Laut den OpenAI FAQ sind Sprachgespräche für alle angemeldeten Nutzer in den mobilen Apps, Desktop-Apps und der Web-Version unter chatgpt.com verfügbar. Wenn Sie ein Plus-Abonnent sind, erhalten Sie bis zu 5-mal höhere Nachrichtenlimits als kostenlose Nutzer, sodass Sie viel länger chatten können.

So schalten Sie ihn ein:

-

Öffnen Sie die ChatGPT-App auf Ihrem Telefon oder gehen Sie auf die Website.

-

Suchen Sie nach dem Kopfhörer-Symbol in der unteren rechten Ecke und tippen Sie darauf.

-

Wenn Sie es zum ersten Mal benutzen, werden Sie aufgefordert, eine der neun Stimmen zu wählen.

-

Machen Sie sich keinen Stress bei der Auswahl. Sie können sie später jederzeit in Ihren Einstellungen ändern.

Und das ist alles! Sie können anfangen zu sprechen und sehen, was Sie davon halten.

Reaktion der Community: Ein gemischtes Bild

Die erste Reaktion war pure Begeisterung. Die Demos waren atemberaubend und zeigten eine KI, die auf das reagieren konnte, was ein Nutzer durch seine Telefonkamera sah, und ein Gespräch führen konnte, das sich unglaublich real anfühlte. Es schien wie ein echter Durchbruch.

Doch als mehr Leute es in die Hände bekamen, wurde das Feedback etwas komplizierter. Ein kurzer Blick in Foren wie Reddit zeigt eine Community, die sowohl beeindruckt als auch ein wenig enttäuscht ist.

Einerseits sind die Geschwindigkeit und der natürliche Fluss klare Siege. Andererseits gibt es das weit verbreitete Gefühl, dass beim Upgrade etwas verloren gegangen ist.

Viele Nutzer empfanden ein seltsames Gefühl des Verlustes gegenüber der alten Stimme. Einige beschrieben sie als einen „tröstenden Freund“, dessen langsameres, gemesseneres Tempo perfekt war, um Ideen auszutauschen oder ein schwieriges Problem durchzuarbeiten.

Das wird sich anfühlen, als würde man einen lieben Freund verlieren. Die Standard-Stimme ist bedacht und hat eine Stimme und einen Rhythmus, die natürlich und tröstlich sind. Ergreifend.

Andere haben darauf hingewiesen, dass die neue, schnellere Stimme oft so wirkt, als wolle sie das Gespräch beenden. Sie gibt Ihnen vielleicht eine kurze Antwort und verstummt dann, anstatt sich auf die Art von offenem Chat einzulassen, in dem die alte Stimme gut war.

Eine häufige Beschwerde ist, dass sich die „Persönlichkeit“ der neuen Stimme etwas generisch anfühlt und nicht ganz mit dem leistungsstarken Textmodell darunter verbunden ist. Einige haben das Gefühl, dass ihre Antworten „oberflächlicher“ sind, was für kreative Aufgaben, bei denen man einen Partner für tiefes Nachdenken wünscht, nicht ideal ist.Es ist, als würde sie versuchen, das Gespräch mit jeder Nachricht abzuschließen und zu beenden, selbst wenn wir gerade erst angefangen haben und es eindeutig der Beginn eines Gesprächs ist.

Es ist ein klassisches Beispiel dafür, dass eine technische Verbesserung nicht immer zu einer besseren menschlichen Erfahrung für jeden führt. Die neue Stimme ist ein unglaubliches Stück Ingenieurskunst, aber es scheint, als hätte sie noch nicht ganz die Magie eingefangen, die dazu führte, dass einige Nutzer die alte, schwerfälligere Version wirklich mochten.

Um den Unterschied selbst zu sehen und zu hören, schauen Sie sich diese Videorezension an, die den neuen Sprachmodus in Aktion demonstriert. Sie bietet einen direkten Einblick in die Geschwindigkeit, den Tonfall und den Gesprächsfluss des GPT-4o-Updates.

Überlegungen für Geschäftsanwendungen

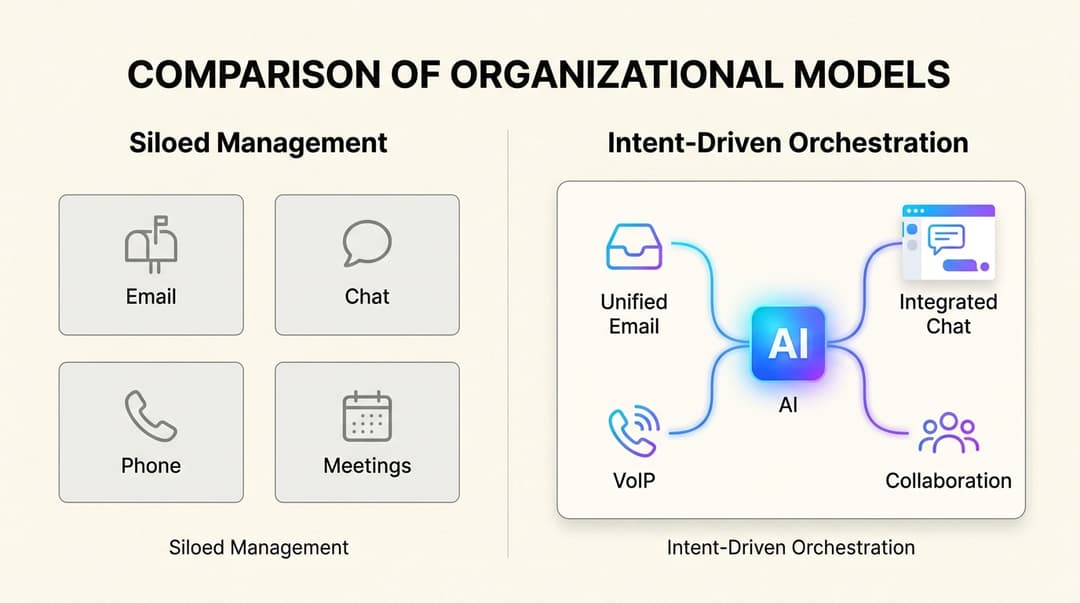

Während das Chatten mit einer KI auf dem Telefon cool ist, was bedeutet das alles für Unternehmen? Das Potenzial für konversationelle KI im Kundenservice, Vertrieb und internen Support ist riesig, aber ein Allzweckwerkzeug wie ChatGPT hat in einem professionellen Umfeld spezifische Einschränkungen.

Das gemischte Nutzerfeedback zu seiner Persönlichkeit ist erst der Anfang. Hier sind einige Überlegungen für Geschäftsanwendungen:

-

Es fehlt der geschäftliche Kontext: ChatGPT hat keine Ahnung von Ihrem Unternehmen. Es kann nicht in Ihre Helpdesk-Daten in Zendesk schauen, die Bestellhistorie eines Kunden in Shopify prüfen oder Ihre internen Richtlinien in Confluence finden. Seine Antworten werden immer generisch bleiben.

-

Es kann keine Aktionen ausführen: Ein Kunde kann es nicht bitten, eine Rückerstattung zu bearbeiten, und ein Mitarbeiter kann es nicht bitten, ein Support-Ticket in Jira zu erstellen. Es ist eine geschlossene Box, die nur sprechen kann; sie kann nichts innerhalb Ihrer bestehenden Arbeitsabläufe (Workflows) tun.

-

Begrenzte Anpassung und Sicherheitskontrollen: Für Geschäftsanwendungen ist die Kontrolle über die Markenstimme der KI, die Gewährleistung der Einhaltung von Unternehmensrichtlinien und die Festlegung von Regeln für die Übergabe an Menschen entscheidend. Allzweck-Tools bieten möglicherweise keine granulare Kontrolle über diese Aspekte.

Während die Technologie für den persönlichen Gebrauch erstaunlich ist, benötigen Unternehmen einen zweckgebundenen KI-Teamkollegen, der in ihre bestehenden Systeme und Arbeitsabläufe integriert ist.

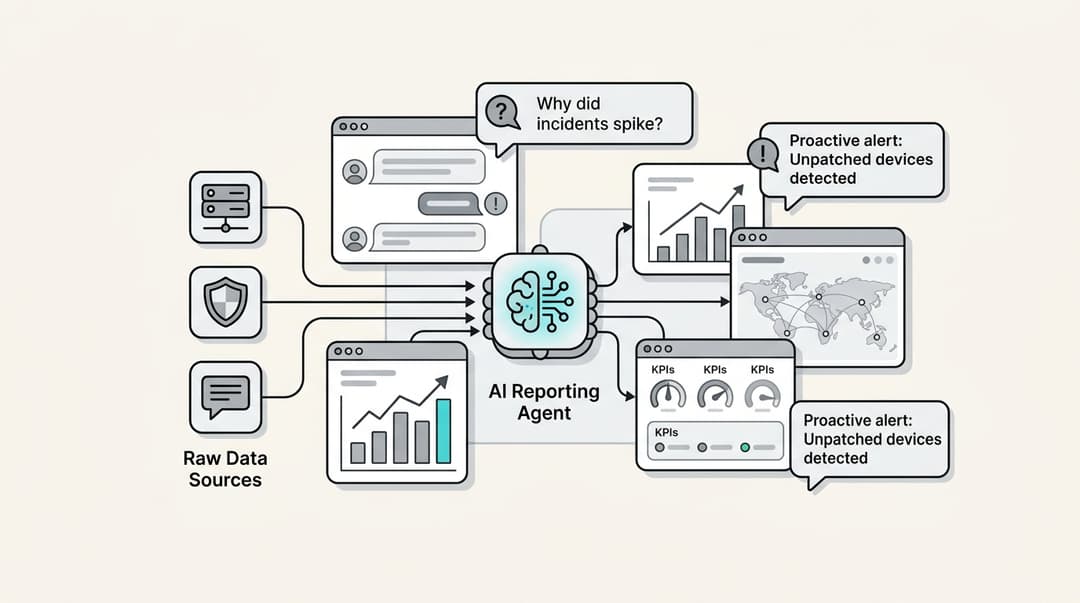

eesel AI: Eine spezialisierte KI für Unternehmen

Hier können spezialisierte Tools wie eesel AI von Vorteil sein. Wir haben eesel um eine einfache Idee herum aufgebaut: Sie konfigurieren eine KI nicht nur, Sie stellen sie als neuen Teamkollegen ein. Sie ist in Minuten, nicht in Wochen, einsatzbereit, indem sie sich mit Ihren vorhandenen Tools verbindet und aus Ihren spezifischen Geschäftsdaten, Ihren vergangenen Tickets, Help-Center-Artikeln und internen Dokumenten lernt. Das bedeutet, dass sie vom ersten Tag an den richtigen Kontext hat.

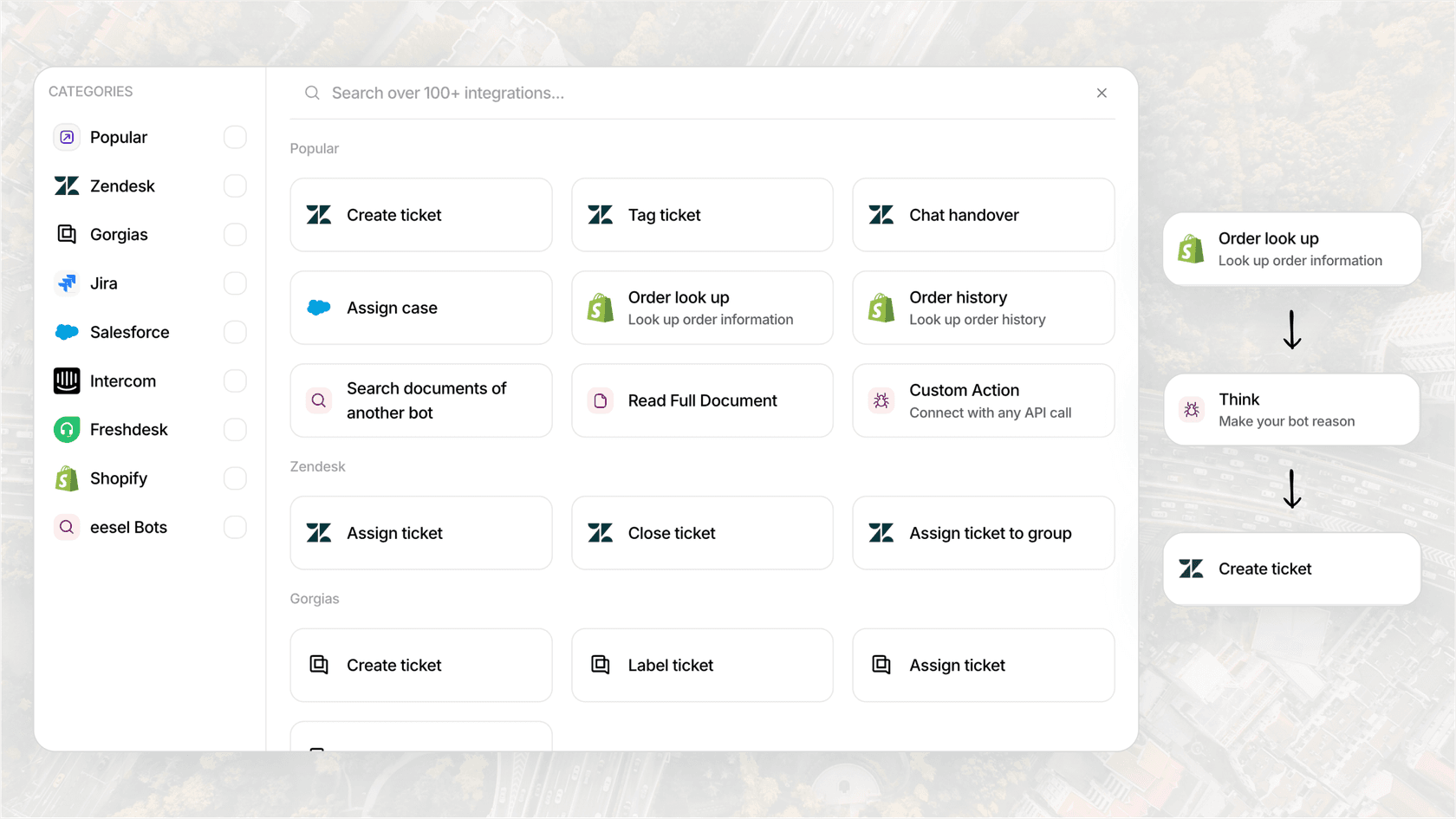

Hier ist, wie ein KI-Teamkollege wie eesel die Einschränkungen eines Allzweck-Sprachwerkzeugs handhabt:

-

Kontextbewusst: eesel verbindet sich direkt mit Ihren Wissensquellen wie Confluence und Helpdesks wie Zendesk. Es gibt nicht nur eine generische Antwort; es gibt die richtige Antwort basierend auf den tatsächlichen Informationen Ihres Unternehmens.

-

Aktionsorientiert: Die Agents von eesel AI sind darauf ausgelegt, mehr als nur zu sprechen. Sie können so eingerichtet werden, dass sie Aufgaben in anderen Apps ausführen, wie das Nachschlagen von Bestellinformationen in Shopify, das Aktualisieren eines Ticketfeldes oder das Weiterleiten eingehender Anfragen an das richtige Team.

-

Vollständig kontrolliert: Mit eesel haben Sie das Sagen. Sie definieren den Tonfall, die Wissensdatenbank (Knowledge Base) und die Eskalationsregeln in einfachem Englisch. Sie können sagen: „Eskaliere Abrechnungsstreitigkeiten immer an einen Menschen“, und die KI wird es tun. Dies stellt sicher, dass sie als zuverlässige Erweiterung Ihres Teams fungiert.

Für Unternehmen, die leistungsstarke konversationelle KI intern nutzen möchten, ist unser AI Internal Chat ein perfektes Beispiel. Sie können ihn zu Ihrem Slack oder zu Microsoft Teams einladen, wo er sofortige, vertrauenswürdige Antworten auf Mitarbeiterfragen geben kann – alles basierend auf der privaten Dokumentation Ihres Unternehmens. Es ist ein praktischer Weg, um repetitive Fragen zu reduzieren und jedem zu helfen, mehr zu erreichen.

Abschließende Gedanken

Es besteht kein Zweifel, dass der ChatGPT Voice Rollout eine enorme technologische Errungenschaft ist. Er macht die KI-Interaktion natürlicher, zugänglicher und menschenähnlicher als je zuvor und ist ein faszinierender Blick auf das, was als Nächstes kommt.

Das Feedback der Nutzer verdeutlicht den Unterschied zwischen Allzweck-KI und spezialisierter KI. Während eine Allzweck-Sprach-KI für den persönlichen Gebrauch und schnelle Fragen effektiv ist, haben Unternehmen oft andere Anforderungen. Diese Anforderungen umfassen oft eine tiefe Integration in bestehende Systeme, die Fähigkeit, spezifische Aktionen auszuführen, und robuste Sicherheitskontrollen.

Sind Sie bereit zu sehen, was ein wahrer KI-Teamkollege für Ihr Unternehmen tun kann? Erkunden Sie die KI-Lösungen von eesel oder starten Sie noch heute eine kostenlose Testversion.

Häufig gestellte Fragen

Der größte Unterschied ist die zugrunde liegende Technologie. Die neue Stimme verwendet ein einzelnes End-to-End-Modell namens GPT-4o, das Audio direkt verarbeitet. Dies macht Gespräche viel schneller, natürlicher und ermöglicht es der KI, Emotionen zu erkennen und mit ihnen zu reagieren, im Gegensatz zum älteren, mehrstufigen System.

Ja, er ist für alle angemeldeten Nutzer auf Mobilgeräten, Desktop und im Web verfügbar. Zahlende Abonnenten (wie ChatGPT Plus-Nutzer) erhalten jedoch deutlich höhere Nachrichtenlimits, was viel längere Gespräche ermöglicht.

Einige Nutzer fanden das langsamere, bedachtere Tempo der älteren Stimme beruhigend und tiefgründig. Sie hatten das Gefühl, dass sie ein besserer Partner für Brainstorming oder das Durcharbeiten komplexer Ideen war, während die neue, schnellere Stimme sich manchmal gehetzt oder oberflächlich anfühlen kann.

Um ihn zu aktivieren, öffnen Sie die ChatGPT-App oder die Website und suchen Sie nach dem Kopfhörer-Symbol, das sich normalerweise in der unteren rechten Ecke befindet. Tippen Sie darauf, und Sie werden aufgefordert, eine Stimme zu wählen, um Ihr Gespräch zu beginnen.

Für Unternehmen liegen die Haupteinschränkungen in einem Mangel an spezifischem Kontext (es kann nicht auf Ihre Unternehmensdaten zugreifen), der Unfähigkeit, Aktionen in Ihrer Unternehmenssoftware auszuführen (wie das Bearbeiten einer Rückerstattung) und dem Mangel an Kontrolle über die Persönlichkeit, den Tonfall und die Sicherheitsprotokolle.

Es stehen neun voreingestellte Stimmen zur Auswahl. Sie heißen Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce und Vale. Sie können Ihre ausgewählte Stimme jederzeit in den Einstellungen ändern.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.