Parece que toda semana há um novo anúncio de IA que faz você parar e observar, e a revelação da OpenAI de uma voz hiper-realista e conversacional para o ChatGPT foi definitivamente um deles. As demonstrações foram incríveis: uma IA que conseguia conversar, rir e até cantar com um nível quase assustador de emoção e tempo de resposta humano.

Este novo recurso, parte do grande lançamento da voz do ChatGPT, está rodando em seu modelo mais recente, o GPT-4o. É um salto enorme em relação aos chats baseados em texto com os quais todos estamos acostumados, puxando-nos para um mundo onde falar com uma IA parece muito mais natural. A boa notícia é que agora ele está disponível para qualquer pessoa que esteja logada, embora, se você for um assinante pago, receba limites de uso muito maiores.

Então, qual é o motivo de tanta animação? Neste post, vamos detalhar o que é este novo modo de voz, como ele se compara à versão antiga, o que as pessoas realmente pensam sobre ele e o que seus limites significam para empresas que desejam usar IA conversacional para mais do que apenas diversão.

O que é o novo modo de voz GPT-4o?

Em sua essência, o novo modo de voz é algo completamente diferente. Ele é alimentado pelo GPT-4o, que é o primeiro modelo da OpenAI treinado do início ao fim em texto, visão e áudio. Simplificando, ele não processa apenas palavras; ele processa som.

Esta é uma mudança massiva do ponto de vista técnico. O antigo modo de voz era um pouco travado, costurado a partir de três modelos separados: um para transformar sua fala em texto, outro para criar uma resposta e um terceiro para transformar esse texto de volta em fala. Funcionava, mas não era exatamente fluido.

O GPT-4o lida com tudo de uma só vez. Como a IA processa o áudio diretamente, ela consegue captar seu tom, ouvir vários interlocutores e até notar ruídos de fundo sem se distrair. Essa abordagem tudo-em-um faz com que a conversa pareça muito mais real, com um tempo médio de resposta de apenas 320 milissegundos. Isso é basicamente tão rápido quanto uma pessoa.

Aqui está o que isso realmente significa para você:

-

Respostas fluidas em tempo real: Aquelas pausas robóticas e estranhas ficaram no passado. Ele responde quase instantaneamente, fazendo com que o chat flua naturalmente.

-

Você pode interrompê-lo: Assim como ao falar com um amigo, você pode intervir enquanto a IA está falando. Ela vai parar, ouvir e ajustar sua resposta sem ficar confusa.

-

Percepção emocional e tonal: Esta é a parte realmente legal. O GPT-4o consegue captar pequenos detalhes na sua voz, como sarcasmo, empolgação ou hesitação, e responder com uma ampla gama de suas próprias emoções e tons.

Para oferecer algumas opções, existem nove vozes predefinidas para escolher: Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce e Vale. Você pode encontrar todas elas listadas no FAQ oficial.

Claro, o lançamento não foi totalmente tranquilo. Você deve ter ouvido falar sobre o drama em torno da voz "Sky". A OpenAI teve que pausá-la após Scarlett Johansson expressar preocupação de que a voz soava muito parecida com a dela. Uma análise encomendada pela NPR descobriu posteriormente que a voz da Sky era mais semelhante à de Johansson do que 98% das outras atrizes que analisaram. Isso só mostra quão complexo este novo mundo de interação com IA está se tornando.

Comparando os modos de voz antigo e novo

Embora a tecnologia seja um grande passo à frente, a experiência real do usuário tem sido um tópico quente. É mais rápido, com certeza, mas é melhor? A resposta é um pouco mais complicada do que você imagina.

Para entender realmente o que mudou, vamos colocar o antigo modo de voz lado a lado com o novo.

| Recurso | Voz Padrão (Legada) | Modo de Voz Avançado (GPT-4o) |

|---|---|---|

| Modelo Subjacente | Três modelos separados para transcrição, inteligência e síntese de fala | Um modelo multimodal único de ponta a ponta (GPT-4o) |

| Velocidade de Resposta | Atraso perceptível de 2,8 a 5,4 segundos | Quase instantâneo, com tempo médio de resposta de 320ms |

| Fluxo da Conversa | Baseado em turnos; você tinha que esperar a IA terminar de falar | Fluido e passível de interrupção, permitindo um vaivém natural |

| Percepção Tonal | Monótono e robótico; não conseguia processar a emoção do usuário pelo áudio | Consegue detectar a emoção do usuário e responder com entonação variada |

| Percepção do Usuário | Frequentemente descrito como "reflexivo", "calmo" e "confortante" | Percebido por alguns como "apressado", "superficial" e menos pessoal |

Essa última linha, "Percepção do Usuário", é onde as coisas ficam interessantes. Mesmo que a nova voz seja tecnicamente melhor em todos os aspectos, um número surpreendente de pessoas realmente sente falta da antiga. A voz legada, com suas pausas lentas e deliberadas, parecia mais reflexiva para alguns. Ela dava um segundo para você pensar e parecia um parceiro calmo e paciente.

Em contraste, a nova voz do GPT-4o às vezes pode parecer um pouco ansiosa demais. Ela é tão rápida em responder que pode parecer que está tentando apressar a conversa. Para perguntas rápidas, é ótima. Mas para brainstorming mais profundo ou apenas para pensar em voz alta, alguns usuários acharam que o ritmo antigo e mais lento era, na verdade, mais útil.

Você também não consegue ter discussões aprofundadas no Modo de Voz Avançado (AVM) como consegue no Padrão, e as respostas são muito mais superficiais. Isso é inutilizável se você estiver fazendo brainstorming de ideias para projetos de escrita criativa, etc.

Como acessar e usar o novo modo de voz

Quer testar por si mesmo? Começar é bem simples.

De acordo com o FAQ da OpenAI, as conversas por voz estão disponíveis para todos os usuários logados nos aplicativos móveis, aplicativos de desktop e na versão web em chatgpt.com. Se você for um assinante Plus, terá limites de mensagens até 5x maiores do que os usuários gratuitos, podendo conversar por muito mais tempo.

Aqui está como ativá-lo:

-

Abra o aplicativo ChatGPT no seu telefone ou acesse o site.

-

Procure o ícone de fone de ouvido no canto inferior direito e toque nele.

-

Na primeira vez que usar, você será solicitado a escolher uma das nove vozes.

-

Não se estresse sobre qual escolher. Você sempre pode alterá-la depois nas suas configurações.

E é isso! Você pode começar a falar e ver o que acha.

Resposta da comunidade: Um misto de opiniões

A reação inicial foi de pura admiração. As demonstrações foram de cair o queixo, mostrando uma IA que conseguia reagir ao que um usuário estava vendo através da câmera do celular e manter uma conversa que parecia incrivelmente real. Parecia um avanço genuíno.

Mas à medida que mais pessoas colocaram as mãos na ferramenta, o feedback ficou um pouco mais complexo. Uma olhada rápida em fóruns como o Reddit mostra uma comunidade que está impressionada e, ao mesmo tempo, um pouco decepcionada.

Por um lado, a velocidade e o fluxo natural são vitórias óbvias. Por outro, há um sentimento comum de que algo se perdeu na atualização.

Muitos usuários sentiram uma estranha sensação de perda pela voz antiga. Alguns a descreveram como um "amigo confortante", cujo ritmo mais lento e compassado era perfeito para trocar ideias ou trabalhar em um problema difícil.

Isso vai ser como perder um querido amigo. A Voz Padrão é reflexiva e tem uma voz e cadência que é natural e confortante. Comovente.

Outros apontaram que a nova voz, mais rápida, muitas vezes parece que está tentando encerrar a conversa. Ela pode te dar uma resposta rápida e depois ficar em silêncio, em vez de se engajar no tipo de chat aberto em que a voz antiga era boa.

Uma reclamação comum é que a "personalidade" da nova voz parece um pouco genérica e não muito conectada ao poderoso modelo de texto que está por baixo. Alguns sentem que suas respostas são mais "superficiais", o que não é ideal para tarefas criativas onde você quer um parceiro para um pensamento profundo.É como se estivesse tentando concluir e encerrar a conversa a cada mensagem, mesmo quando acabamos de começar e é claramente o início de um diálogo.

É um exemplo clássico de uma melhoria técnica que nem sempre leva a uma experiência humana melhor para todos. A nova voz é uma peça de engenharia incrível, mas parece que ainda não capturou a magia que fazia alguns usuários realmente gostarem da versão antiga e mais limitada.

Para ver e ouvir a diferença por si mesmo, confira esta análise em vídeo que demonstra o novo modo de voz em ação. Ela oferece uma visão direta da velocidade, tom e fluxo conversacional da atualização do GPT-4o.

Considerações para aplicações de negócios

Embora conversar com uma IA no seu celular seja legal, o que tudo isso significa para as empresas? O potencial para IA conversacional no atendimento ao cliente, vendas e suporte interno é massivo, mas uma ferramenta de propósito geral como o ChatGPT possui limitações específicas em um ambiente profissional.

O feedback misto dos usuários sobre sua personalidade é apenas o começo. Aqui estão algumas considerações para aplicações empresariais:

-

Falta contexto de negócios: O ChatGPT não tem ideia sobre sua empresa. Ele não consegue consultar seus dados de helpdesk no Zendesk, verificar o histórico de pedidos de um cliente no Shopify ou encontrar suas políticas internas no Confluence. Suas respostas serão sempre genéricas.

-

Não consegue realizar ações: Um cliente não pode pedir para processar um reembolso, e um funcionário não pode pedir para criar um ticket de suporte no Jira. É uma caixa fechada que só pode falar; ela não pode fazer nada dentro de seus fluxos de trabalho existentes.

-

Controles de segurança e personalização limitados: Para aplicações de negócios, controlar a voz da marca da IA, garantir a adesão às políticas da empresa e configurar regras para transferência humana são cruciais. Ferramentas de uso geral podem não oferecer controle granular sobre esses aspectos.

Embora a tecnologia seja incrível para assuntos pessoais, as empresas precisam de um colega de equipe de IA construído especificamente para esse fim, que esteja conectado aos seus sistemas e fluxos de trabalho existentes.

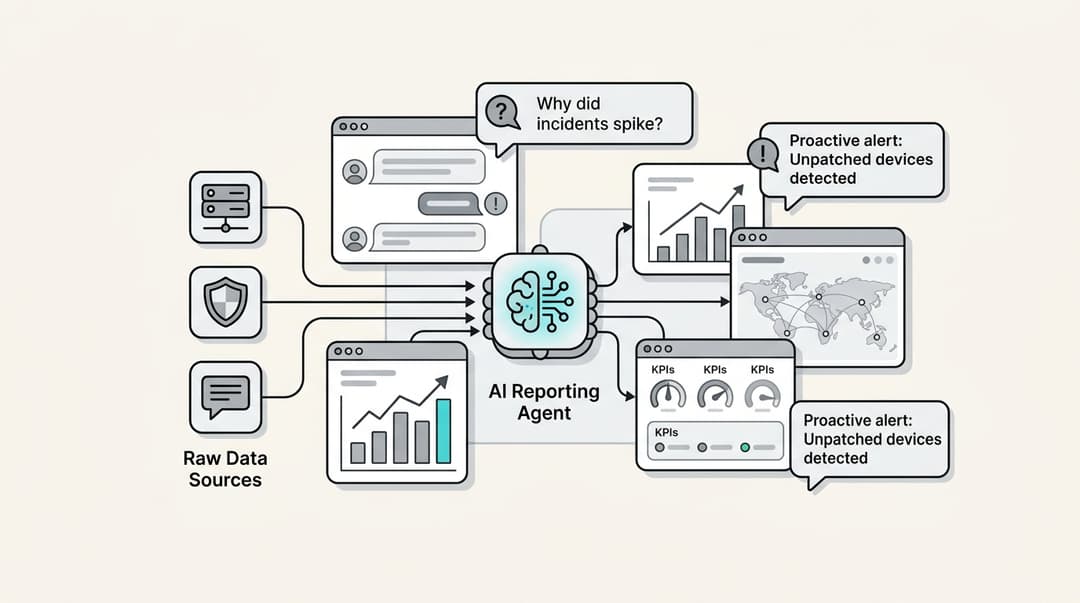

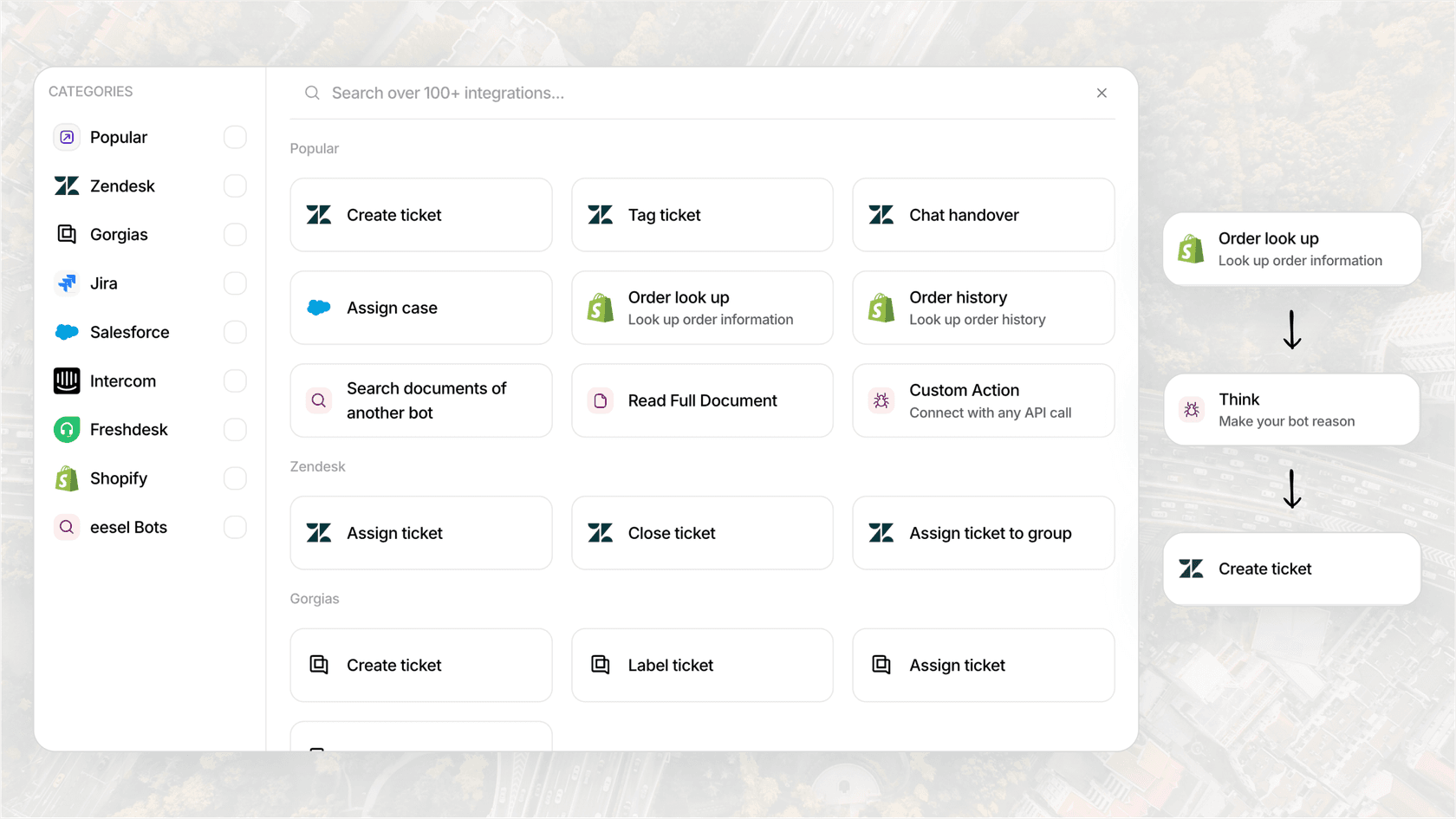

eesel AI: Uma IA especializada para negócios

É aqui que ferramentas especializadas como o eesel AI podem ser benéficas. Construímos o eesel em torno de uma ideia simples: você não apenas configura uma IA, você a contrata como um novo colega de equipe. Ele entra no ritmo em minutos, não semanas, conectando-se às suas ferramentas existentes e aprendendo com seus dados específicos de negócios, seus tickets antigos, artigos do centro de ajuda e documentos internos. Isso significa que ele tem o contexto certo desde o primeiro dia.

Aqui está como um colega de equipe de IA como o eesel lida com as limitações de uma ferramenta de voz de propósito geral:

-

Ciente do Contexto: O eesel se conecta diretamente às suas fontes de conhecimento, como o Confluence, e helpdesks, como o Zendesk. Ele não dá apenas uma resposta genérica; ele dá a resposta certa com base nas informações reais da sua empresa.

-

Orientado à Ação: Os Agentes da eesel AI são projetados para fazer mais do que apenas falar. Eles podem ser configurados para realizar tarefas em outros aplicativos, como consultar informações de pedidos no Shopify, atualizar um campo de ticket ou rotear solicitações recebidas para a equipe certa.

-

Totalmente Controlado: Com o eesel, você está no comando. Você define o tom, a base de conhecimento e as regras de escalonamento usando linguagem natural. Você pode dizer: "Sempre encaminhe disputas de faturamento para um humano", e ele o fará. Isso garante que ele atue como uma extensão confiável da sua equipe.

Para empresas que buscam usar IA conversacional poderosa internamente, nosso AI Internal Chat é um exemplo perfeito. Você pode convidá-lo para o seu Slack ou Microsoft Teams, onde ele pode dar respostas instantâneas e confiáveis às perguntas dos funcionários, tudo com base na documentação privada da sua empresa. É uma maneira prática de reduzir perguntas repetitivas e ajudar todos a produzirem mais.

Considerações finais

Não há dúvida de que o lançamento da voz do ChatGPT é uma enorme conquista tecnológica. Ele está tornando a interação com a IA mais natural, acessível e humana do que nunca, e é um vislumbre fascinante do que vem por aí.

O feedback dos usuários destaca uma distinção entre IA de propósito geral e especializada. Enquanto uma IA de voz de propósito geral é eficaz para uso pessoal e perguntas rápidas, as empresas costumam ter requisitos diferentes. Esses requisitos frequentemente incluem integração profunda com sistemas existentes, a capacidade de realizar ações específicas e controles de segurança robustos.

Pronto para ver o que um verdadeiro colega de equipe de IA pode fazer pelo seu negócio? Explore as soluções de IA do eesel ou inicie um teste gratuito hoje mesmo.

Perguntas frequentes

A maior diferença é a tecnologia subjacente. A nova voz usa um modelo único de ponta a ponta (end-to-end) chamado GPT-4o que processa áudio diretamente. Isso torna as conversas muito mais rápidas, naturais e permite que a IA detecte e responda com emoção, ao contrário do sistema antigo de várias etapas.

Sim, está disponível para todos os usuários logados no celular, desktop e na web. No entanto, assinantes pagos (como usuários do ChatGPT Plus) recebem limites de mensagens significativamente mais altos, permitindo conversas muito mais longas.

Alguns usuários acharam que o ritmo mais lento e deliberado da voz antiga era calmante e reflexivo. Eles sentiam que era uma parceira melhor para brainstorming ou para trabalhar ideias complexas, enquanto a nova voz, mais rápida, às vezes pode parecer apressada ou superficial.

Para ativá-lo, abra o aplicativo ou site do ChatGPT e procure o ícone de fone de ouvido, geralmente no canto inferior direito. Toque nele e você será solicitado a escolher uma voz para iniciar sua conversa.

Para as empresas, suas principais limitações são a falta de contexto específico (não pode acessar os dados da sua empresa), a incapacidade de realizar ações em seu software de negócios (como processar um reembolso) e a falta de controle sobre sua personalidade, tom e protocolos de segurança.

Existem nove vozes predefinidas disponíveis para escolha. Elas se chamam Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce e Vale. Você pode alterar a voz selecionada a qualquer momento nas configurações.

Share this article

Article by

Kenneth Pangan

Escritor e profissional de marketing há mais de dez anos, Kenneth Pangan divide seu tempo entre história, política e arte, com muitas interrupções de seus cães exigindo atenção.