最近、AIコーディングアシスタントを使って作業したことがあるなら、おそらく「停滞期」に直面したことがあるでしょう。セッションを開始し、モデルが最初の数行で素晴らしいコードを提示してくれたかと思えば……その後は突然、力尽きてしまうのです。同じバグのあるコードを繰り返し始めたり、フィードバックを無視したり、数回のデバッグの後に完全に文脈を見失ったりします。

知能はそこにあると分かっているのに、スタミナが足りない。これは非常にフラストレーションが溜まるものです。

そこで登場したのがGLM 5.1です。

2026年4月にZ.AI(智譜AI)からリリースされたGLM 5.1は、単なるLLMリーダーボードの漸進的なアップデートではありません。研究者が「ロングホライゾン(長期的)」タスクと呼ぶもの(通常、AIがクラッシュしたり失敗したりするような、複雑で多段階のエンジニアリングプロジェクト)に取り組むために特別に構築されたモデルです。

より信頼性の高い自律型エージェントを求める開発リーダーであれ、AIの世話に疲れたエンジニアであれ、GLM 5.1は「エージェントエンジニアリング」に対する私たちの考え方を大きく変える存在です。

「停滞」の問題:なぜ他のモデルは長期タスクで失敗するのか

ほとんどのLLM(GPT-5.4やClaude 4.6のような強力なモデルでさえ)は、「ワンショット」または短いセッションでのパフォーマンスに最適化されています。それらは、すぐに正しい答えを出すように作られています。ほとんどの用途において、それは素晴らしいことです。

しかし、エンジニアリングはワンショットのゲームではありません。実験、失敗、そして改善を繰り返すプロセスです。複雑なリポジトリレベルのバグを解決するように従来のモデルに依頼すると、多くの場合、早い段階でそのレパートリーを使い果たしてしまいます。最も明白な修正を最初に適用し、それがうまくいかないと、パフォーマンスの限界に達してしまいます。時間をかけたり、ツール呼び出しを増やしたりしても、通常は役に立ちません。ただ空回りするだけです。

この「停滞」が起こるのは、ほとんどのモデルが、戦略がうまくいっていないことを認識する内部判断力に欠けているためです。彼らは効果的に「バックトラック(やり直し)」したり、アプローチ全体を再考したりすることができません。その代わりに、同じ穴を掘り続け、論理的な行き止まりにどんどん深く入り込んでいくのです。

ブレイクスルー:GLM 5.1はどのようにロングホライゾンタスクを処理するのか

GLM 5.1は、「長く実行すればするほど、結果は良くなるはずだ」という異なる哲学のもとに構築されました。

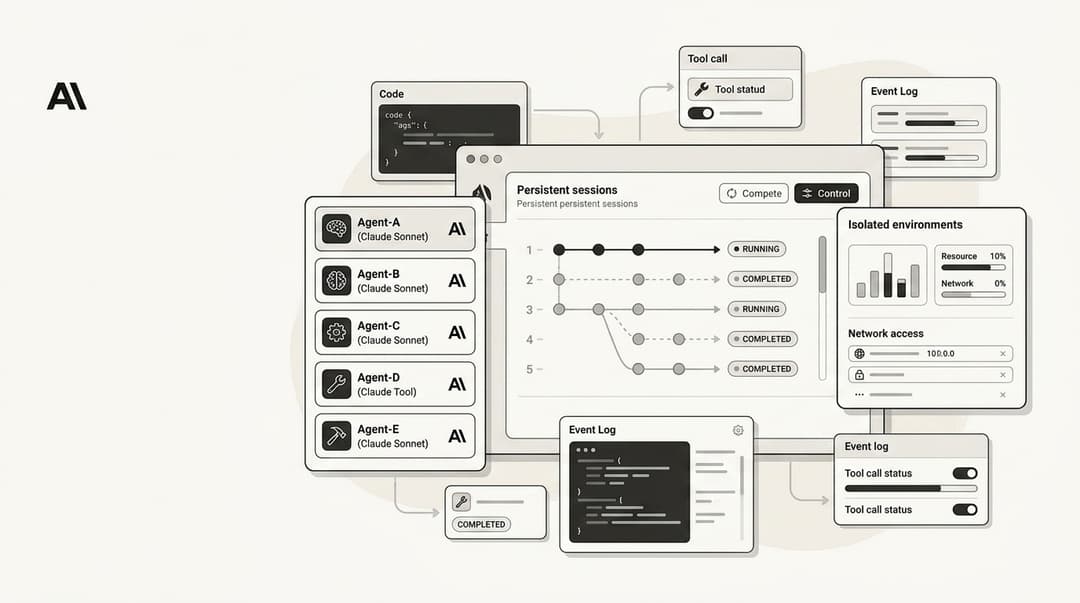

これは単なるマーケティングの誇大広告ではありません。Z.AIは、1,000回を超えるツール呼び出しが続くセッションに向けてモデルを最適化しました。その秘訣は、「リフレクション(内省)ベースの推論」と呼ばれるものです。

GLM 5.1は、ただ前進するのではなく、内部のリフレクションループを使用して中間ステップを評価します。コマンドが失敗したり、テストスイートがパスしなかったりした場合、モデルには「待てよ、この戦略全体が間違っている」と判断し、以前の決定ポイントまで戻る判断力があります。

この「ロングホライゾン」機能により、モデルは曖昧な問題をより優れた判断力で処理できるようになります。数時間にわたるセッションでも生産性を維持し、複雑な問題を分解し、実験を実行し、ブロッカー(障害)を正確に特定します。これは、常に監督が必要なジュニア開発者と、チケットを最初から最後まで一人で解決できるシニア開発者との違いのようなものです。

ベンチマーク対決:リーダーボードをリードする

数字がその評判を裏付けています。AIエージェントが現実世界のGitHubの問題をどのように解決するかを評価するゴールドスタンダードであるSWE-Bench Proにおいて、GLM 5.1は驚異的な58.4%の成功率を達成しました。

参考までに、これはGPT-5.4(57.7%)やClaude Opus 4.6(57.3%)を上回る数値です。この差は小さく見えるかもしれませんが、自律型エージェントの世界では、1パーセントの差がバグ修正にかかる数千時間の人間工学的な節約を意味します。

しかし、単一のベンチマークだけではありません。GLM 5.1は以下でもリードしています:

- Terminal-Bench 2.0: 環境構築やログ分析など、現実世界のターミナルタスクのためのベンチマーク。

- NL2Repo: アーキテクチャ的に一貫したリポジトリ全体をゼロから生成するためのテスト。

これらのスコアは、GLM 5.1が単なるチャットボットではなく、自律型システムの強力なエンジンであることを証明しています。

実践ガイド:GLM 5.1を今すぐ導入・使用する方法

幸いなことに、これを使い始めるために巨大なサーバーファームは必要ありません。GLM 5.1は驚くほど手軽に利用できます。

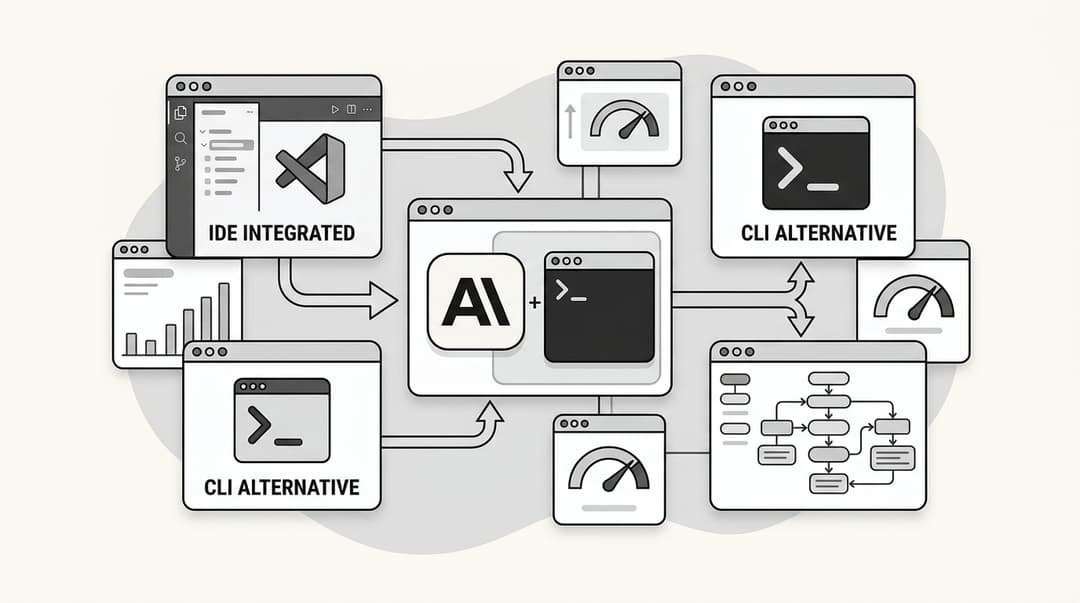

APIアクセス

ほとんどの商用利用ケースでは、APIルートを選択することになるでしょう。2026年4月現在、OpenRouterとNVIDIA Buildが主要なプロバイダーです。

- OpenRouterの価格: 100万入力トークンあたり約2.00ドル、100万出力トークンあたり6.00ドル。

- NVIDIA Build: より競争力のある料金を提供しており、開発者がモデルをテストするための無料クレジットも用意されています。

ローカルデプロイ

プライバシーを重視する場合や、自分のハードウェアで実行したい場合は、OllamaがすでにGLM 5.1のサポートを追加しています。GGUFまたはFP16形式でローカル実行できますが、フラッグシップバージョンを最大限に活用するには、それなりのGPUセットアップが必要です。

プロンプトのヒント

GLM 5.1は反復のために構築されているため、オープンエンドで複雑なタスクを恐れずに与えてください。モデルのためにタスクを小さなステップに分解するのではなく、ゴールとツールを与え、その内部リフレクションループに重労働を任せてみてください。

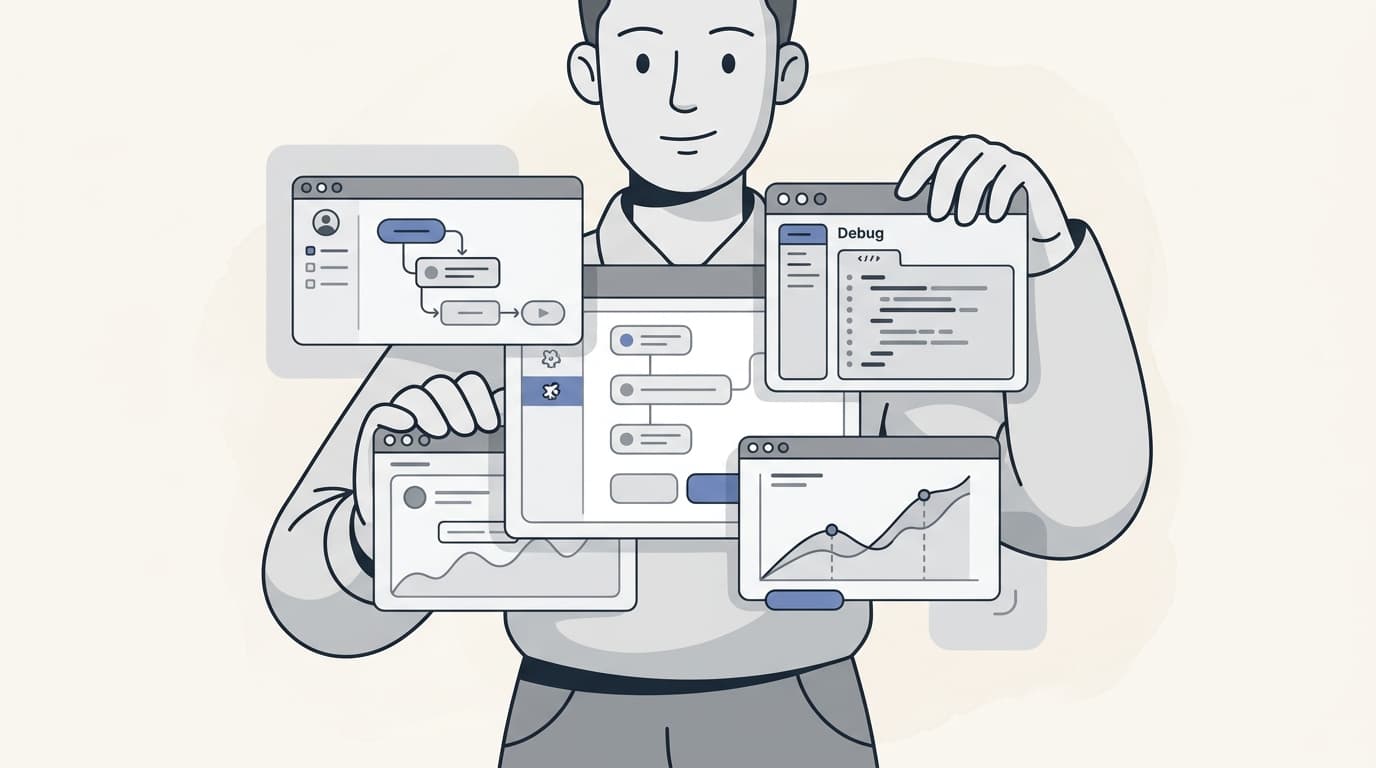

eesel AIの視点:自律型サポートのためのLLM

eesel AIでは、自律型サポートエージェントをより信頼性の高いものにする方法を常に模索しています。私たちにとって、「ロングホライゾン」のブレイクスルーはゲームチェンジャーです。

カスタマーサポートのチケットは、多くの場合、多段階のデバッグ(顧客アカウントの確認、ログファイルの閲覧、技術的な統合の検証、そして修正案の策定)を必要とします。もしAIエージェントがそのプロセスの途中で「停滞」してしまったら、顧客は悪い体験をすることになります。

数百回のツール呼び出しを継続し、壁にぶつかったときに自己修正するGLM 5.1の能力は、真に自律的なサポートに必要なものです。これにより、過去の数千件のチケットでAIをテストし、推論の行き止まりに決して陥らないことを保証する、より信頼性の高い「シミュレーションモード」を実行できるようになります。

eesel AIがどのように自律型エージェントを構築しているかをご覧ください

結論

GLM 5.1のリリースは、「AIの停滞期」時代の終わりを告げるものです。私たちは、単に質問に答えるだけのモデルから、問題を解決できるエージェント的なチームメイトへと移行しています。

挑戦し続け、やり直し、長期にわたって生産性を維持する能力こそが、次世代のAIツールを定義するでしょう。まだ試していないなら、GLM 5.1は素晴らしい出発点です。

よくある質問

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.