AI分野の進化はこれ以上速くならないだろうと思っていた矢先、Googleがまた大きなアップデートを発表しました。今回登場したのは、Gemini 3 Flashです。これは同社のラインナップにおける最新モデルで、「高度な知能とスピードの両立、そして大幅な低コスト化」という一点に特化して構築されています。大量のタスクを迅速かつ効率的にこなすための、頼れる実用的なモデルとして設計されています。

この新しいモデルが一体どのようなものなのかを理解しようとしているなら、ここが最適な場所です。このガイドでは、Gemini 3 Flashについて知っておくべきこと、その機能、対象ユーザー、コスト、そして現実的な制限事項について詳しく説明します。派手な宣伝文句を削ぎ落とし、一つの核心的な問いに答えます。「この強力な新モデルはあなたのニーズに適したツールなのか、それとも、より専門的ですぐに使えるプラットフォームの方があなたのビジネスに合っているのか?」

Gemini 3 Flashとは?

Gemini 3 Flashの核心は、Googleが開発した、軽量で超高速、かつコスト効率に優れた大規模言語モデル(LLM)です。Gemini 3ファミリーにおける、より強力なGemini 3 Proや重量級のGemini 3 Deep Thinkに対する、機敏でエネルギッシュな弟分のような存在だと考えてください。これは、質の高い回答が「今すぐ」必要な、高頻度のタスクのために構築されています。こちらの図解は、Geminiファミリーの中でFlashがどこに位置付けられるかを示しています。

Googleは、「Flashレベルの低遅延でPro級の推論を(Pro-grade reasoning with Flash-level latency)」提供すると約束しています。これは簡単に言えば、プレミアムモデルの知能を、ラグ(遅延)や高額な費用を気にすることなく利用できるということです。

最も話題になっている機能の一つが、そのマルチモーダル(multimodal)能力です。これは単なる「テキスト入力・テキスト出力」のモデルではありません。テキスト、画像、音声、動画、さらには長いPDFドキュメントまで、多様な入力を組み合わせて理解し、処理することができます。

覚えておくべき重要な点は、Gemini 3 Flashが基盤モデル(foundational model)であるということです。つまり、主に開発者や企業がその上にアプリケーションを構築するためのツールです。APIを直接使用することはないかもしれませんが、無料のGeminiアプリのような消費者向け製品をより高速で高性能にするために、すでにこのモデルが活用され始めています。

主な特徴と機能

では、このモデルの何がそれほど重要なのでしょうか? それは単一の機能ではなく、スピード、コスト、そして開発者にとって非常に柔軟なツールとするための新しい制御機能の組み合わせにあります。

スピード、コスト、インテリジェンスの新たなバランス

Gemini 3 Flashの主なセールスポイントは、パフォーマンス、スピード、コストの「スイートスポット」をいかに突いているかという点です。これまでの、3つのうちどれかを大幅に犠牲にしなければならなかった時代を終わらせようとしています。

数字がそれを裏付けています。大学院レベルの推論テストであるGPQA Diamondベンチマークで90.4%、Humanity’s Last Examで33.7%という印象的なスコアを記録しており、より巨大で高価なモデルに引けを取らない実力を示しています。実際、前世代のGemini 2.5 Proよりもはるかに強力でありながら、3倍高速で、運用コストも大幅に抑えられています。これは効率性における大きな飛躍です。

高度なマルチモーダル理解と重要な制限事項

前述の通り、Gemini 3 Flashはマルチモーダルであり、幅広いメディアタイプを処理できます。Googleのデモで見られたように、ゴルフのスイング動画を見せてフィードバックを求めたり、1時間の講義動画をアップロードして数秒で文字起こしや要約を作成させたりすることができます。これにより、非構造化データの分析において膨大な可能性が開かれます。

しかし、ここに落とし穴があります。出力はテキストのみです。画像、動画、音声を「理解」することはできますが、それらを「作成」することはできません。画像を出力させたり、短い音声クリップを作成させたりすることは不可能です。この図解は情報の流れを示しています。

もう一つの注目すべき技術的詳細は、Gemini 2.5にあった画像セグメンテーション(image segmentation)機能がなくなったことです。一部の専門家によれば、これは画像内の特定のオブジェクトを識別するピクセルレベルのマクスを取得できなくなったことを意味し、特定のコンピュータビジョン・タスクにとっては便利な機能が失われたことになります。

「推論レベル」とコード実行による微調整制御

Googleは、「thinking_level(推論レベル)」という独創的な新しいパラメータを導入しました。これにより、開発者はモデルがタスクに適用する推論の量をスライダーのように制御できます。「minimal(最小)」、「low(低)」、「medium(中)」、「high(高)」から選択可能です。

これは典型的なトレードオフです。「high」の推論レベルを選択すれば、より緻密な推論が得られますが、速度は低下しコストも上がります。単純で迅速なタスクの場合は、「minimal」に下げることで、ほぼ瞬時の安価なレスポンスを得られます。このレベルの制御は、特定のアプリケーションに合わせてパフォーマンスとコストを微調整するのに最適です。

さらに、コーディングにおいても非常に強力です。SWE-bench Verifiedベンチマークで78%という高いスコアを記録しており、これは現実世界のコード問題を修正する能力をテストするものです。これにより、エージェント・ワークフローや複雑なソフトウェアを構築する開発者にとって、非常に有用なツールとなります。

ユースケースと活用例:誰のためのものか?

これらの機能を備えたGemini 3 Flashは、消費者向けアプリから複雑な企業システムまで、多くの異なる方法で使用されることになります。

応答性の高いアプリケーションを構築する開発者向け

開発者にとって、低レイテンシ(低遅延)と強力な推論能力の組み合わせは大きな利点です。遅延がユーザー体験を台無しにしてしまうインタラクティブなアプリケーションに最適です。例えば以下のようなものが挙げられます:

- アプリ内のリアルタイム・チャットアシスタント。

- ダイナミックな会話ができるゲーム内キャラクター。

- データストリームを即座に分析・要約するツール。

Google AI Studio、Google Antigravity、Gemini CLI、Android Studio、Vertex AIなどのツールからGemini APIを通じてアクセスできるため、開発に携わる人なら誰でも簡単に使い始めることができます。

複雑な情報を分析する企業向け

ビジネスの世界では、Gemini 3 Flashはすでにいくつかの難易度の高い問題の解決に使用されています。例えば、Resemble AIはリアルタイムのディープフェイク検出に、法律テクノロジー企業のHarveyは法的文書の分析に、それぞれ活用しています。

PDF、動画、音声録音などの膨大な非構造化データを迅速に精査し、重要な洞察を引き出す能力は、技術チームにとって大きな武器となります。退屈なレビュープロセスを自動化し、専門家がより戦略的な業務に集中できるようサポートします。

Google製品を通じた一般ユーザー向け

私たちの多くはAPIを直接触ることはないかもしれませんが、日常的に使用しているGoogle製品を通じてGemini 3 Flashの影響を確実に実感することになるでしょう。すでにGeminiアプリの無料版に展開されており、新しいGoogle検索のAIモードの機能も支えています。

つまり、Geminiに複数箇所の立ち寄り先があるロード旅行の計画を立てさせたり、複雑な科学の概念を説明させたりする際、より速く、より徹底した回答が得られるようになります。すべては、AIを日常の疑問に対してより応答性が高く、便利なものにすることが目的です。

Gemini 3 Flashの動作を実際に見て、そのスピードと能力を体感するには、Sam Witteveenによるこの徹底解説をチェックしてください。日常的な「主力モデル」としてのパフォーマンスを探っています。

生のAIモデルを使用する際の現実的な制限

Gemini 3 Flashが否定できないほど強力であることは間違いありませんが、それが何であり、何でないかを理解することが重要です。ここで、特に迅速な解決策を求める企業にとって、期待と現実が交差します。

それは強力な「部品」であり、完成品ではない

Gemini 3 Flashを、素晴らしい高性能なレゴ(LEGO)ブロックの箱だと考えてください。信じられないほどの可能性を秘めていますが、それを使ってどうやって城を建てるかを知る必要があります。ビジネスにおいて実際の価値を引き出すには、誰かがそれらを組み立てる必要があります。

つまり、本物の技術的専門知識が必要です。API統合、プロンプト・エンジニアリング(prompt engineering)、データセキュリティ、そしてユーザーインターフェースの構築に長けた開発者が必要です。これは、カスタマーサポートの自動化や社内ナレッジベースの作成といった特定のビジネス課題に対する「すぐに使える」解決策ではありません。その生のパワーを機能的で信頼性の高いビジネスツールに変えるには、数ヶ月かかることもある大規模な開発プロジェクトが必要になります。

モデルからビジネスソリューションへのギャップを埋める

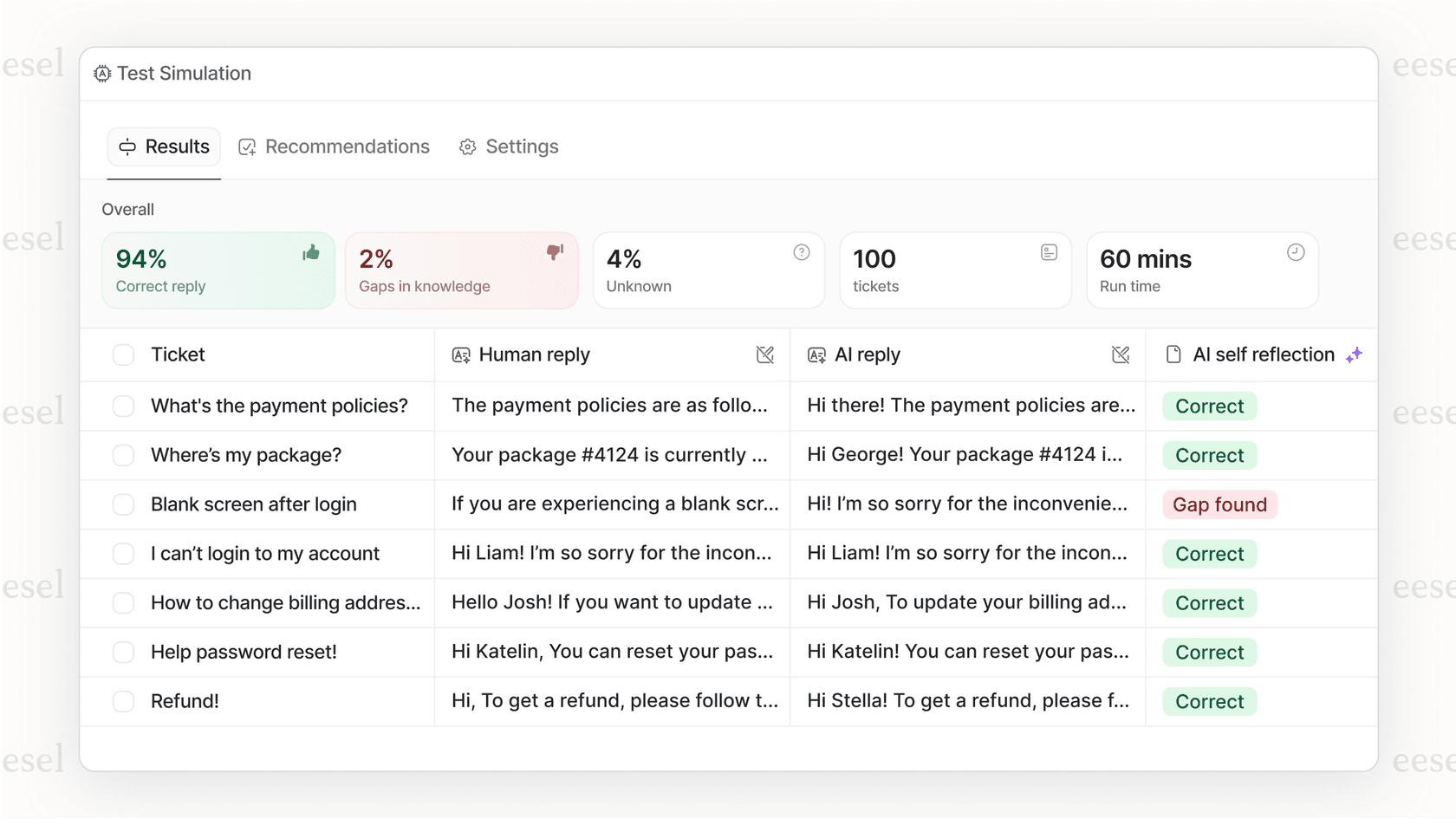

ここで、特定の問題を解決するために構築されたAIプラットフォームが登場します。開発チームがGemini 3 Flashを使ってカスタム・サポートチャットボットを構築するのに1四半期以上費やす可能性がある一方で、eesel AIのようなプラットフォームは、その価値をすぐに提供できるように設計されています。

eeselは、Zendesk、Slack、Notion、Googleドキュメントなど、すでに使用しているツールに直接接続する「AIチームメイト」プラットフォームです。ノーコードでセルフサービス型のプラットフォームであり、数ヶ月ではなく数分で稼働を開始します。セットアップに開発者は必要ありません。初日からサポート担当者の返信を下書きするAI Copilot(AIコパイロット)を導入したり、最前線の質問に対応する完全自律型のAI Agent(AIエージェント)をデプロイしたりできます。目標は、単なるパーツの箱ではなく、完全なソリューションを提供することです。

特定の機能とアクセシビリティのギャップ

モデルの制限事項に話を戻しましょう。テキストのみの出力は、多くのビジネスユースケースにとって大きな課題です。例えば、Eコマースストアを運営している場合、商品の画像やカルーセルを顧客に見せることができるチャットボットが必要でしょう。Gemini 3 Flashのような生のモデルでは、それを行うことはできません。その上に視覚的な機能を構築する必要があります。対照的に、eeselのEコマース向けAIチャットボットのような専門ツールには、商品カルーセルや「カートに追加」ボタンなどの機能が組み込まれています。

同様に、画像セグメンテーションが欠如しているため、画像や図面の一部を視覚的に特定することに依存しているビジネスの場合、その機能を再現するには別のツールや大量のカスタムコードが必要になります。専門プラットフォームは、最初からこれらのエンドユーザー向けの機能を念頭に置いて設計されています。

価格について

Googleは価格設定について非常に透明性が高く、それがこのモデルの大きな魅力の一つとなっています。大量に使用するケースでも手頃な価格になるよう設計されています。以下は、100万トークン(1トークンは約0.75単語に相当)あたりのコストの内訳です。

| モデル | 入力価格(/100万トークン) | 出力価格(/100万トークン) |

|---|---|---|

| Gemini 2.5 Flash | $0.30 | $2.50 |

| Gemini 3 Flash | $0.50 | $3.00 |

| Gemini 3 Pro (≤200k) | $2.00 | $12.00 |

| Gemini 3 Pro (>200k) | $4.00 | $18.00 |

Googleはまた、非同期タスクのためのコンテキスト・キャッシング(context caching)やBatch APIなどの機能も提供しており、開発者は特定の種類の業務においてさらにコストを削減できます。

強力なツール、しかし完全な解決策ではない

Gemini 3 Flashが印象的な前進であることは間違いありません。スピード、インテリジェンス、手頃な価格の素晴らしい融合を提供し、高度なAIをかつてないほど身近なものにしています。基盤モデルとしての柔軟性は、カスタムアプリケーションを構築するための時間、リソース、専門知識を持つ開発者にとって、膨大な可能性を解き放ちます。

しかし、ほとんどの企業にとっての教訓はこれです。課題は単に強力なAIモデルにアクセスすることだけではありません。本来のロードマップを乱すことなく、現実世界の問題を解決する、完全に統合されたソリューションをいかにデプロイするかということです。

カスタマーサポートを改善し、社内知識を管理し、あるいは専用のAI開発プロジェクトを立ち上げることなく売上を伸ばす必要があるチームにとって、既製のプラットフォームはほぼ常に、より実用的な道となります。既存のツールから学習し、数分で価値を生み出し始めるAIチームメイトをお探しの場合は、eesel AIで何ができるかを確認してみてください。

よくある質問

最大の利点は、スピード、コスト、インテリジェンスのバランスです。Proレベルの推論をはるかに低い価格と少ない遅延で提供するため、大量のインタラクティブなタスクに最適です。

いいえ、生成はできません。Gemini 3 Flashは強力なマルチモーダル理解(画像、動画、音声を処理する能力)を備えていますが、出力は厳密にテキストのみに限定されています。

理想的なユーザーは、開発者や技術チームを持つ企業です。これは基盤モデル(foundational model)であり、カスタムアプリケーションを作成するための強力な構成要素であることを意味します。特定のビジネス課題に対する即戦力のソリューションではありません。

Gemini 3 Flashは大幅に安価です。例えば、100万トークンあたりの入力価格は0.50ドルですが、Gemini 3 Proは2.00ドルからとなっており、Flashは入力において約4倍コスト効率に優れています。

単体では適していません。Gemini 3 Flashでチャットボットを構築するには、ユーザーインターフェースやビジネスロジックを作成するための大規模な開発作業が必要です。ノーコードのソリューションをお探しの場合は、内部で強力なモデルを使用しているeesel AIのような専門プラットフォームを利用する方が良いでしょう。

マルチモーダル(multimodal)とは、モデルがテキスト以外のさまざまな種類の情報を理解し処理できることを意味します。Gemini 3 Flashには、テキスト、画像、音声クリップ、さらには動画などを組み合わせて入力し、分析させることができます。

Share this article

Article by

Stevia Putri

Stevia Putriはeesel AIのマーケティング・ジェネラリストで、強力なAIツールを人々の心に響くストーリーに変える手助けをしています。彼女は好奇心、明快さ、そしてテクノロジーの人間的な側面に突き動かされています。