OpenAI lanzó recientemente GPT 5.2, al que autodenominan su "modelo más avanzado". El anuncio vino acompañado de benchmarks (puntos de referencia) impresionantes, prometiendo avances significativos en codificación, razonamiento y visión. Sobre el papel, parece increíble.

Sin embargo, desde su lanzamiento para los usuarios, la recepción ha sido variada. Parece existir una brecha entre las pruebas de laboratorio y lo que la gente experimenta en el uso diario. Entonces, ¿cuál es la verdadera historia?

Este artículo ofrecerá una mirada equilibrada sobre qué es GPT 5.2, qué promete, dónde parece estar fallando y qué significa todo esto para las empresas que buscan soluciones de IA.

¿Qué es GPT 5.2? Una familia de nuevos modelos

En primer lugar, GPT 5.2 no es solo un modelo. Es la serie más reciente de modelos de lenguaje de gran tamaño (LLM) de OpenAI, creados para tareas profesionales y complejas. Se trata de una familia de opciones, cada una adaptada a diferentes necesidades y presupuestos.

Según el anuncio oficial de OpenAI, así se desglosa la familia:

-

GPT-5.2 Instant: Esta es la versión rápida diseñada para tareas cotidianas y aprendizaje dentro de ChatGPT. Está pensada para respuestas rápidas.

-

GPT-5.2 Thinking: Este es el modelo principal para trabajos más profundos y complejos, como la programación y el análisis. Si usted está utilizando la API, este es el que llamará con

gpt-5.2. -

GPT-5.2 Pro: La opción más potente y precisa de la gama. Es para preguntas difíciles donde obtener la mejor respuesta posible es la prioridad absoluta.

Junto a estos, OpenAI también presentó GPT-5 mini como una opción más pequeña y eficiente, y un modelo especializado GPT-5.2-Codex para desarrolladores. Está claro que intentan cubrir todas las bases ofreciendo una variedad de modelos.

La historia oficial: Nuevas funciones y mejoras declaradas

Basándose en los materiales de lanzamiento de OpenAI, el modelo muestra ganancias significativas respecto a versiones anteriores. Analicemos las áreas clave donde se supone que GPT 5.2 rinde bien, según su documentación oficial.

Rendimiento mejorado en tareas profesionales

Una de las promesas de GPT 5.2 es cómo gestiona el trabajo de conocimiento profesional y desbloquea más valor económico. OpenAI afirma que es mucho mejor creando hojas de cálculo, elaborando presentaciones y escribiendo código sofisticado que sus predecesores.

Para respaldar esto, señalan el benchmark GDPval, donde el modelo supuestamente supera a profesionales del sector en más del 70 % de las tareas. Las mejoras en programación son particularmente notables, con el modelo alcanzando nuevas puntuaciones récord en benchmarks difíciles como SWE-Bench Pro (55,6 %). La idea es que ahora puede manejar problemas de ingeniería de software más complejos, yendo más allá de la simple generación de scripts básicos.

Mayor capacidad de razonamiento, visión y contexto largo

OpenAI también destaca la capacidad del modelo para razonar a través de información compleja, especialmente en documentos largos. La prueba de la "aguja en un pajar" de OpenAI (MRCRv2), que comprueba si un modelo puede encontrar información específica en un gran cuerpo de texto, mostró una precisión casi perfecta. Esto sugiere que usted podría proporcionarle un informe extenso y confiar en que extraerá los detalles que necesita.

Sus capacidades de visión también se han actualizado, reduciendo a la mitad las tasas de error en tareas como el razonamiento de gráficos y la comprensión de interfaces de software. En teoría, puede mostrarle un tablero de control complejo o el diagrama de una placa base, y tendrá una comprensión espacial mucho mejor de lo que está viendo. También obtuvo las mejores puntuaciones en benchmarks de ciencia y matemáticas como GPQA Diamond (92,4 %) y FrontierMath (40,3 %), ampliando los límites de lo que la IA puede hacer en campos altamente técnicos.

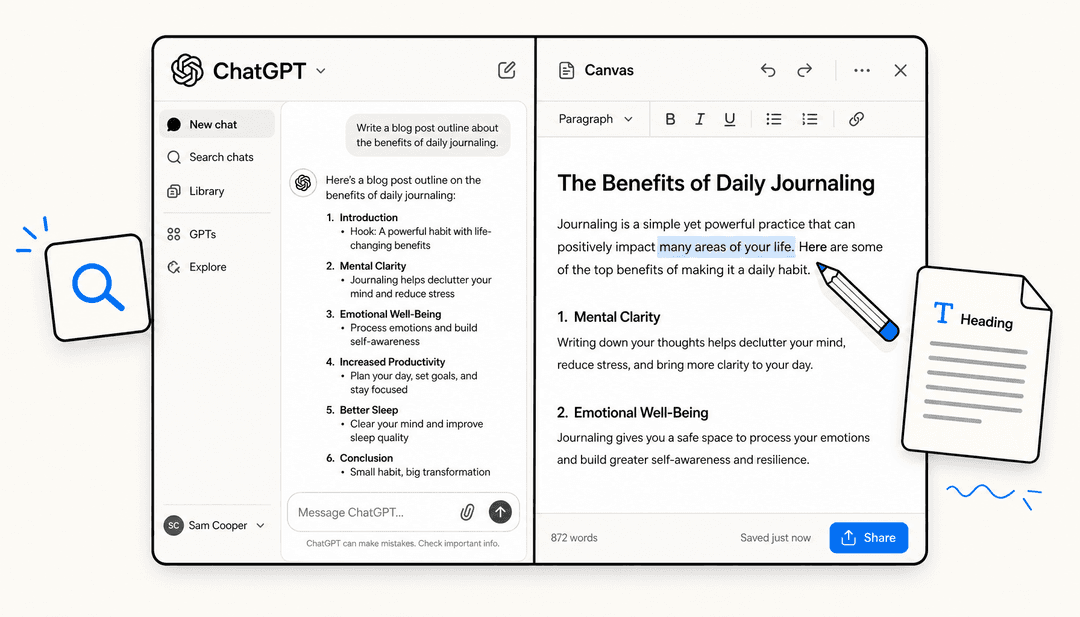

Llamada a herramientas más fiable para flujos de trabajo de agentes

Esta es una función más técnica, pero es crucial para construir aplicaciones de IA prácticas. La "llamada a herramientas" (tool calling) es la forma en que un modelo de IA interactúa con otro software para realizar acciones, como buscar un pedido en Shopify o crear un ticket en Jira. GPT 5.2 está diseñado para ser mucho mejor ejecutando estas tareas complejas de varios pasos de principio a fin.

Obtuvo un impresionante 98,7 % en el benchmark Tau2-bench Telecom, una prueba diseñada para simular tareas de atención al cliente de múltiples turnos. En la práctica, esto significa que usted puede construir agentes de IA más fiables que puedan gestionar flujos de trabajo completos, como resolver el problema de envío de un cliente o analizar datos de ventas, con menos errores.

Introducción de GPT-5.2-Codex para programación avanzada

Para los desarrolladores, OpenAI también lanzó GPT-5.2-Codex, una versión del modelo optimizada específicamente para la "ingeniería de software y ciberseguridad". Esto no es solo para escribir unas pocas líneas de código; está diseñado para manejar grandes bases de código y ayudar con tareas largas y complejas como migraciones de código y refactorizaciones.

También viene con una mayor conciencia de seguridad. Por ahora, está disponible en las superficies de Codex para usuarios de pago de ChatGPT, con planes de lanzar el acceso a la API más adelante. Esto indica el enfoque de OpenAI en hacer de sus modelos herramientas esenciales para los equipos de desarrollo de software.

Experiencias del mundo real: Comentarios mixtos de los usuarios

Los benchmarks son una cosa, pero la verdadera prueba es cómo se comporta un modelo para las personas reales en su trabajo diario. Desde el lanzamiento de GPT 5.2, los comentarios en foros de desarrolladores y en publicaciones como Medium han sido variados.

Muchos usuarios se encuentran con problemas que los benchmarks simplemente no captan, creando una brecha entre el rendimiento anunciado y la realidad cotidiana.

Preocupaciones sobre el tono y el aumento de rechazos

Una de las quejas comunes es sobre la personalidad del modelo. Muchos usuarios describen su tono como "más plano y excesivamente higienizado", como si hubiera sido entrenado para ser tan cauteloso que es menos capaz de improvisar o mostrar creatividad.

No quiero a alguien que siempre me diga que sí, pero tampoco quiero a un asistente sospechoso y paranoico que piense que estoy haciendo jailbreak en cada solicitud, incluso en las que están en el límite. Estábamos hablando de estafas online, le pedí que explicara esta estafa de forma sencilla y me dijo 'No puedo fomentar las estafas'... ¡Maldición, pero si le pedí que lo explicara de forma sencilla, no que estafara!!!

Esto se vincula con otro problema importante: el aumento de los rechazos. Los usuarios informan que el modelo es ahora excesivamente precavido y a veces se niega a discutir temas o completar tareas que las versiones anteriores manejaban sin problemas. Para cualquiera que dependa del modelo para la escritura creativa, la lluvia de ideas o la exploración de temas matizados, esto puede presentar desafíos. Para algunos usuarios, se siente como un paso atrás en la usabilidad, incluso si la tecnología subyacente es más potente.

Rendimiento inconsistente y problemas de contexto

Aún más preocupantes son los informes sobre el rendimiento inconsistente. Algunos usuarios sienten que para sus tareas específicas, el modelo parece menos efectivo que GPT-4. Puede que rinda bien en una prueba de benchmark pero luego tenga dificultades con un problema de sentido común.

Lo más molesto que he notado es que le pregunto algo y me responde. Luego le pregunto otra cosa y responde a la primera pregunta junto con la segunda.

Otra queja frecuente es que el modelo pierde el contexto o se contradice durante conversaciones largas. Esto es inesperado, dadas las afirmaciones de OpenAI sobre su rendimiento en benchmarks de contexto largo. Como dijo un revisor: "los benchmarks son limpios. Los documentos reales no". Los casos de uso del mundo real son desordenados, y parece que el modelo todavía puede tropezar. Esta inconsistencia dificulta que las empresas construyan flujos de trabajo fiables sobre el modelo base. Puede requerir una ingeniería de prompts (instrucciones) más cuidadosa para obtener el resultado deseado.

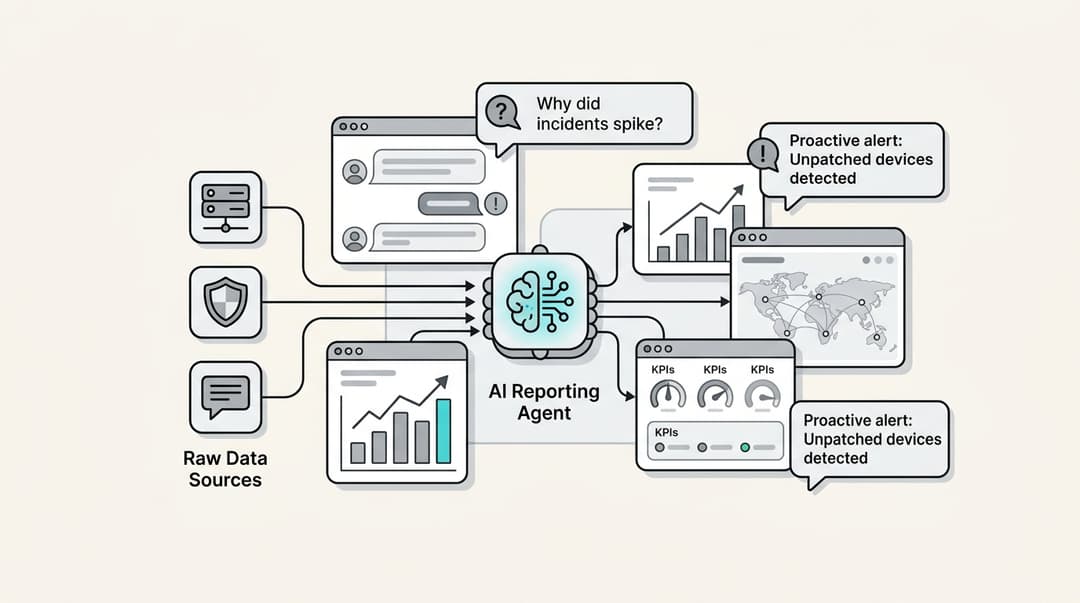

Para aplicaciones empresariales como la IA para el servicio al cliente, la previsibilidad es importante. Plataformas especializadas como eesel AI están diseñadas para proporcionar un rendimiento consistente y acorde con la marca. Estas plataformas aprenden directamente de los propios datos de la empresa y de conversaciones exitosas pasadas para ofrecer respuestas personalizadas.

Entendiendo el precio y la accesibilidad

Dejando a un lado el rendimiento, el coste y la accesibilidad de un nuevo modelo son factores enormes para cualquier negocio. GPT 5.2 viene con una nueva estructura de precios que lo posiciona como un modelo premium de grado empresarial. Echemos un vistazo a las cifras de la página oficial de precios de OpenAI.

Estructura de precios de la API

El precio estándar de la API para los nuevos modelos es significativamente más alto que en versiones anteriores, lo que indica que esta potencia tiene un coste. Para las empresas que pueden manejar tareas asíncronas (lo que significa que no necesitan una respuesta instantánea), OpenAI también ofrece una API por lotes (Batch API) que proporciona un descuento del 50 %, lo que supone un incentivo para las cargas de trabajo que no son urgentes.

Aquí tiene un desglose claro de los costes estándar por millón de tokens para entrada y salida, lo que debería ayudarle a comparar las opciones. Esta comparación visual resalta la diferencia de coste significativa entre los modelos.

| Modelo | Entrada (por 1M de tokens) | Salida (por 1M de tokens) |

|---|---|---|

| gpt-5.2-pro | 21,00 $ | 168,00 $ |

| gpt-5.2 | 1,75 $ | 14,00 $ |

| gpt-5-mini | 0,25 $ | 2,00 $ |

Qué significan estos precios para las empresas

Entonces, ¿qué significan realmente estos precios? GPT 5.2 es un material potente pero en bruto. El coste variable basado en tokens puede hacer que la presupuestación para la IA sea un reto, especialmente si las inconsistencias del modelo significan que tiene que ejecutar el mismo prompt varias veces para obtener un resultado utilizable. Cada intento cuesta dinero.

El precio más alto de gpt-5.2-pro, especialmente para su salida, significa que probablemente sea más adecuado para tareas muy específicas y de alto valor donde el coste pueda justificarse. Para muchas necesidades empresariales diarias, puede que no sea necesario.

Las empresas que buscan costes de IA predecibles pueden considerar modelos diferentes. Por ejemplo, algunos servicios como eesel AI ofrecen un precio basado en interacciones. Con este modelo, los costes están ligados a los resultados (como un ticket resuelto) en lugar de al cálculo de tokens. Este enfoque puede simplificar la previsión de costes y la medición del ROI (Retorno de la Inversión).

¿Es GPT 5.2 una herramienta potente que requiere un manejo cuidadoso?

Entonces, ¿cuál es la conclusión final sobre GPT 5.2? Por un lado, establece nuevos récords en benchmarks técnicos y representa una hazaña increíble de ingeniería. Por otro, también presenta algunos retos de consistencia y usabilidad en aplicaciones del mundo real, con algunos de los primeros usuarios informando de una brecha entre el rendimiento de los benchmarks y su experiencia personal.

Para los equipos técnicos con el tiempo, el presupuesto y la experiencia para experimentar, ajustar los prompts y construir amplias barreras de seguridad, ofrece muchísima potencia.

Sin embargo, muchas empresas no buscan trabajar directamente con un modelo de IA en bruto. Buscan resolver problemas específicos, como reducir los tickets de soporte o acceder al conocimiento interno. El objetivo es el resultado, no el proceso.

Una alternativa a construir desde cero es utilizar una solución especializada. eesel AI ofrece productos diseñados para necesidades empresariales específicas. Aprende de los datos de la empresa para proporcionar respuestas adaptadas al contexto de la organización. Vea cómo un Agente de IA puede empezar a resolver sus tickets de soporte hoy mismo.

Para ver algunas de estas pruebas del mundo real en acción, este vídeo de Fireship ofrece un desglose rápido y revelador del rendimiento de GPT 5.2, destacando tanto sus puntos fuertes como aquellos en los que parece no estar a la altura de las expectativas.

Preguntas frecuentes

GPT 5.2 es la serie más reciente de modelos de lenguaje de OpenAI, diseñada para trabajos profesionales complejos. No es un modelo único, sino una familia (Instant, Thinking, Pro y mini) que promete grandes mejoras en codificación, razonamiento y comprensión de documentos extensos en comparación con versiones anteriores como GPT-4.

Según los benchmarks de OpenAI, sí. Lanzaron un modelo especializado, GPT-5.2-Codex, que obtuvo puntuaciones más altas en pruebas difíciles de ingeniería de software. Sin embargo, algunos desarrolladores en el mundo real han reportado resultados mixtos, por lo que su experiencia puede variar.

Esto parece deberse a varios factores. Los usuarios han señalado que el tono de GPT 5.2 puede sentirse "plano" o excesivamente cauteloso, lo que le lleva a rechazar ciertas tareas. Otros han descubierto que tiene problemas con la consistencia y puede perder el contexto en conversaciones largas, algo que no siempre se refleja en las pruebas controladas de benchmark.

El precio de GPT 5.2 varía según el modelo. El modelo estándar `gpt-5.2` cuesta 1,75 $ por entrada y 14,00 $ por salida por cada millón de tokens. La versión más potente, `gpt-5.2-pro`, es mucho más cara, con un coste de 21,00 $ por entrada y 168,00 $ por salida por millón de tokens.

Aunque es posible, la variabilidad del rendimiento del modelo y los costes basados en tokens son factores a considerar para funciones críticas como la atención al cliente. Las empresas suelen utilizar plataformas especializadas, como eesel AI, que se entrenan con datos específicos de la empresa para ofrecer respuestas coherentes en estos casos de uso.

Share this article

Article by

Stevia Putri

Stevia Putri es una experta en marketing en eesel AI, donde ayuda a transformar potentes herramientas de IA en historias que resuenan. Se mueve por la curiosidad, la claridad y el lado humano de la tecnología.