Cuando ChatGPT se lanzó por primera vez, era un chatbot sencillo: usted hacía una pregunta y él proporcionaba una respuesta basada en texto. Esto ha evolucionado. El 6 de octubre de 2025, OpenAI anunció que las aplicaciones llegarán a ChatGPT, transformándolo de una herramienta de texto en una plataforma interactiva completa.

Esto marca un cambio significativo. Significa que los desarrolladores ahora pueden crear experiencias visuales enriquecidas directamente dentro de una conversación. Imagine menos texto de ida y vuelta y más mapas interactivos, formularios y carruseles de productos. Actualmente, las aplicaciones se están implementando en versión preliminar para los clientes de ChatGPT Business, Enterprise y Edu, y es un gran paso adelante para lo que la IA conversacional puede hacer. Pero, ¿qué significa esto realmente para su empresa? Esta guía le llevará a través del nuevo SDK, detallando qué es, cómo funciona y los desafíos del mundo real que debe considerar antes de comenzar.

¿Qué es el SDK para aplicaciones de ChatGPT?

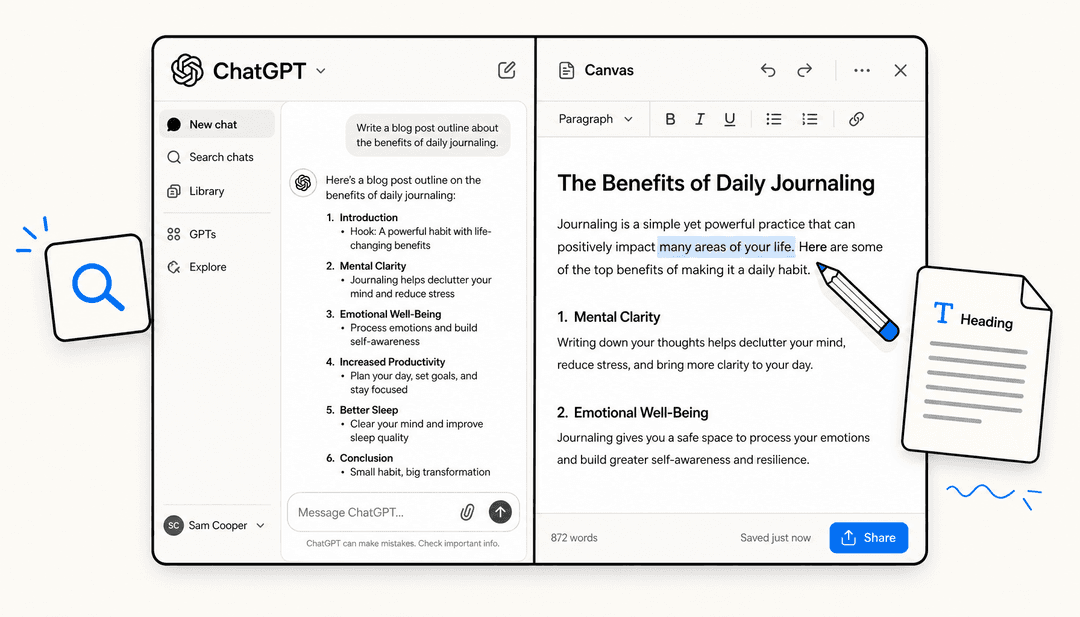

El SDK para aplicaciones de ChatGPT (Software Development Kit) es un conjunto de herramientas de código abierto que permite a los desarrolladores crear y ejecutar aplicaciones conversacionales directamente dentro de ChatGPT. La diferencia clave aquí es que estas aplicaciones no se limitan al texto. Pueden mostrar interfaces de usuario (UI) interactivas como mapas, listas o formularios, haciendo que la experiencia del chat se sienta más dinámica y útil.

Por ejemplo, en lugar de pedirle a ChatGPT que describa casas en Austin y recibir un bloque de texto, usted podría preguntar: "Busca casas en Austin por menos de $500k". Una aplicación de una empresa como Zillow podría aparecer con un mapa interactivo y listados de propiedades en los que puede hacer clic, todo sin salir del chat. Ya estamos viendo esto con los primeros socios. Zillow, Canva y Spotify lo están utilizando para permitir que las personas exploren listados de viviendas, creen presentaciones o generen listas de reproducción a través de la conversación. Esto ofrece un vistazo a un futuro donde las interacciones con la IA se sienten más como usar un asistente integral.

Los componentes principales para construir con el SDK para aplicaciones de ChatGPT

La creación de una aplicación para ChatGPT involucra tres componentes principales. Necesita una forma para que la IA hable con su aplicación, una interfaz de usuario interactiva para que el usuario la vea y haga clic, y un servidor backend para manejar todo el trabajo pesado. Analicemos lo que hace cada una de estas piezas.

El Protocolo de Contexto de Modelo (MCP): Comunicación con ChatGPT

El primer componente es algo llamado Protocolo de Contexto de Modelo, o MCP (Model Context Protocol). Es un estándar abierto que actúa como el puente de comunicación entre ChatGPT y cualquier herramienta externa que desee conectar. Es el conjunto de reglas que permite que la IA y su aplicación hablen entre sí de forma segura. Todo el SDK de Aplicaciones está construido directamente sobre él.

Los trabajos principales de un servidor MCP son indicarle al modelo de IA qué herramientas tiene su aplicación (como "buscar productos" o "reservar una reunión"), ejecutar la acción correcta cuando la IA solicita una herramienta y luego enviar los resultados, incluyendo cualquier componente visual de la interfaz de usuario que deba mostrarse al usuario. Proporciona la estructura subyacente para que el sistema funcione.

Componentes web: Construyendo la interfaz de usuario interactiva

El siguiente componente es la capa visual con la que interactúa el usuario. La capa visual de una aplicación de ChatGPT se construye utilizando tecnologías web estándar con las que probablemente esté familiarizado: HTML, CSS y JavaScript. Estos componentes se muestran dentro de lo que se denomina un iframe directamente en el cliente de ChatGPT.

Para asegurar que todo se comunique correctamente, la interacción entre el frontend de su aplicación y ChatGPT es gestionada por un objeto JavaScript especial llamado "window.openai". Para ayudar a los desarrolladores, OpenAI proporciona una biblioteca de UI del SDK de Aplicaciones de código abierto. Está construida con Tailwind 4 y Radix, ofreciendo una serie de componentes pre-estilizados y accesibles para que no tenga que construir cada botón y menú desplegable desde cero. Esto ayuda a mantener una apariencia y sensación consistentes con el resto de la experiencia de ChatGPT.

El servidor MCP: La lógica de backend de la aplicación

El componente final es el servidor MCP. Este es el backend (parte posterior) de su aplicación, y los desarrolladores son responsables de construir, alojar y mantener este servidor, que impulsa la funcionalidad de la aplicación.

Este servidor tiene varias responsabilidades clave. Primero, debe anunciar sus herramientas, lo que significa que le indica a ChatGPT qué acciones puede realizar la aplicación. Segundo, cuando ChatGPT decide usar una de esas herramientas, el servidor ejecuta la lógica, ya sea buscando información en una base de datos o conectándose a otra API. Finalmente, sirve la interfaz de usuario, enviando los componentes web de regreso a ChatGPT para que puedan mostrarse al usuario. Para ayudar con esto, OpenAI proporciona SDK oficiales para lenguajes populares como Node.js y Python con el fin de agilizar el proceso de puesta en marcha de un servidor.

Casos de uso clave y oportunidades para el SDK de aplicaciones de ChatGPT

Este nuevo ecosistema de aplicaciones desbloquea formas poderosas para que las empresas se conecten con los clientes y hagan que sus servicios sean más accesibles, todo dentro de una ventana de chat.

Mejora del comercio electrónico y la atención al cliente

Una aplicación principal se encuentra en el comercio electrónico y la atención al cliente. Imagine una experiencia de compra donde pueda hacer una pregunta, ver recomendaciones de productos en un carrusel e incluso realizar el pago sin salir de la conversación. Ya estamos viendo esto con socios de lanzamiento como Booking.com para viajes, Zillow para bienes raíces y Expedia para planificación de viajes. Están haciendo que las compras complejas se sientan tan simples como un chat rápido.

Crear un bot de soporte personalizado con el SDK es una opción para equipos con los recursos de ingeniería necesarios. Como alternativa, plataformas como el Agente de IA de eesel AI ofrecen una solución pre-construida. Se conecta a una mesa de ayuda (help desk), aprende de conversaciones y documentación pasadas, y puede gestionar tickets de soporte de primera línea sin necesidad de desarrollo personalizado.

Integración de herramientas creativas y de productividad

Existe un enorme potencial para que las herramientas creativas y de productividad se conviertan en parte del flujo conversacional. Esta integración puede agilizar los flujos de trabajo al hacer que las herramientas sean accesibles a través del lenguaje natural.

Socios como Canva y Figma ya están mostrando lo que es posible. Podría pedirle a ChatGPT que diseñe un esquema de una presentación para usted, y la aplicación de Canva podría generar instantáneamente un conjunto completo de diapositivas allí mismo en el chat. O podría usar Spotify para crear la lista de reproducción de trabajo perfecta simplemente describiendo el ambiente que busca. Esto difumina la línea entre la conversación y la creación, haciendo que las herramientas poderosas se sientan más intuitivas.

Limitaciones y desafíos del SDK para aplicaciones de ChatGPT

Si bien el SDK ofrece un potencial significativo, construir una aplicación lista para producción implica complejidades y compromisos de recursos. Es importante entender estos desafíos antes de comenzar el desarrollo.

El compromiso de desarrollo

El SDK es un conjunto de herramientas enfocado en desarrolladores. No es una plataforma "sin código" (no-code) o de "bajo código" (low-code). Usted necesita experiencia en programación en lenguajes como Python o Node.js, habilidades de desarrollo frontend para construir la interfaz de usuario y el conocimiento para gestionar un servidor.

Según la guía de inicio rápido oficial, la configuración básica implica construir tanto un componente web como un servidor MCP, y luego usar una herramienta como ngrok para exponer su servidor local a internet solo para realizar pruebas. El proceso de construcción, despliegue y mantenimiento de un servidor MCP es una responsabilidad de ingeniería continua.

Así que el primer día probé el nuevo SDK de aplicaciones de OpenAI súper emocionado por testearlo. Pero inmediatamente me topé con numerosos problemas: los conectores MCP no podían llamar a list_tools → resultó que nadie podía en ese momento... Necesitas una cuenta de pago solo para depurar tu propia aplicación... Si cambias cosas localmente, necesitas ngrok (o similar) solo para exponerlo... Luego te encuentras con problemas de CSP (Política de Seguridad de Contenido) al intentar cargarlo desde tu propio host... En general… no es una gran experiencia para el desarrollador 😅

La curva de aprendizaje de un nuevo ecosistema

Como toda tecnología nueva, existe una curva de aprendizaje. Los desarrolladores deben ponerse al día con nuevos conceptos como el Protocolo de Contexto de Modelo y descubrir cómo gestionar el estado en una interfaz de usuario que existe dentro de una conversación.

La plataforma aún es joven, lo que significa que las mejores prácticas, la documentación y el soporte de la comunidad todavía están madurando. Esto puede llevar a pasar más tiempo solucionando problemas y menos tiempo construyendo. Este enfoque difiere de las plataformas diseñadas para un uso inmediato. Por ejemplo, con una herramienta como eesel AI, los equipos pueden definir reglas de escalación y establecer comportamientos en lenguaje sencillo en lugar de código, ofreciendo un camino diferente para la implementación.

Un camino incierto hacia la monetización

Finalmente, la monetización es una consideración clave. OpenAI ha introducido opciones de monetización a través de algo llamado el Protocolo de Comercio Agéntico (Agentic Commerce Protocol), que habilita una función de "Pago Instantáneo" (Instant Checkout) para las aplicaciones.

Me pregunto cómo funciona la monetización, si habrá una opción para vender tus aplicaciones.

En este momento, esta función solo está disponible para socios beta del marketplace aprobados. Para el desarrollador o empresa promedio, el camino para generar ingresos de una aplicación de ChatGPT aún no está totalmente pavimentado. Esto puede crear un riesgo comercial para cualquier empresa que busque un retorno claro e inmediato de la inversión que requiere construir y mantener una aplicación.

Entendiendo los costos de desarrollo

Si bien el SDK de Aplicaciones en sí es de código abierto y gratuito, el costo total de construir y ejecutar una aplicación de ChatGPT va mucho más allá del SDK.

Aquí hay un desglose rápido de los costos reales que debe presupuestar:

- Tiempo del desarrollador: Este es el más importante. El costo de las horas de ingeniería para planificar, construir, probar e iterar en su aplicación será su mayor gasto, con diferencia.

- Costos de alojamiento: Su servidor MCP tiene que vivir en algún lugar. Tendrá una factura mensual de un proveedor de la nube como AWS, Google Cloud o Azure para mantenerlo funcionando.

- Mantenimiento: Las aplicaciones no se instalan y se olvidan. Hay un costo continuo para actualizar la aplicación, corregir errores que surjan y asegurarse de que siga siendo compatible con cualquier cambio en el SDK.

- Tarifas de suscripción de ChatGPT: Para usar estas aplicaciones en un entorno empresarial seguro, su equipo y sus clientes necesitarán un plan de pago de ChatGPT. El plan Business comienza en $25 por usuario al mes, y el plan Enterprise tiene precios personalizados. Estos costos son independientes de los gastos de desarrollo de su aplicación.

Para profundizar en cómo funcionan estas aplicaciones y cómo se ve el nuevo ecosistema, el siguiente video proporciona una introducción útil.

¿Cuándo es construir una aplicación personalizada la opción correcta?

El SDK para aplicaciones de ChatGPT es un paso masivo hacia adelante para la IA conversacional. Abre la puerta a la creación de experiencias increíblemente ricas e interactivas y, para los desarrolladores, es una nueva frontera emocionante para explorar.

Es una solución más adecuada para una audiencia específica: equipos con recursos de ingeniería dedicados, una razón estratégica clara para estar en la plataforma de ChatGPT y la paciencia para navegar por un ecosistema nuevo y en constante cambio. Para muchas empresas, el objetivo principal es resolver los problemas de los clientes de manera eficiente.

Para aquellos que buscan automatizar el soporte, mejorar los flujos de trabajo de los agentes o implementar un chatbot enfocado en las ventas, existen alternativas al desarrollo personalizado. Plataformas como eesel AI pueden integrarse con las herramientas existentes para comenzar a abordar los problemas de los clientes.

Preguntas frecuentes

Share this article

Article by

Amogh Sarda

CEO of eesel AI. Amogh Sarda is obsessed with making the ultimate AI for customer service teams. He lives in Sydney, Australia and has previously worked at Atlassian and Intercom. Outside of work he’s usually surfing or on stage doing improv.