Así que estás pensando en crear un agente de IA personalizado. Es un proyecto bastante común hoy en día, con el objetivo de responder a las preguntas de los clientes o a los tickets internos mucho más rápido, y permitir que tu equipo se concentre en las tareas más complicadas. Tan pronto como empieces a investigar cómo construir uno, probablemente te encontrarás con dos nombres una y otra vez: la API de Asistentes de OpenAI y LangChain.

Elegir entre ellos es una gran decisión que debes tomar desde el principio. Esta guía te explicará las diferencias reales, mirando más allá de las especificaciones técnicas para entender lo que cada opción significa para el presupuesto, los plazos y la cordura de tu proyecto a largo plazo. Los compararemos en cuanto a control, costo y facilidad de uso, para que puedas elegir la base correcta. Incluso podríamos mostrarte una tercera opción que te permite evitar por completo el dolor de cabeza del desarrollo.

¿Qué es la API de Asistentes de OpenAI?

La API de Asistentes de OpenAI es un framework que ayuda a los desarrolladores a construir aplicaciones de IA utilizando los modelos de OpenAI, como GPT-4. Está diseñada para facilitar un poco la creación de agentes conversacionales que realmente puedan recordar lo que se dijo anteriormente en un chat. Piénsalo como un kit de inicio de OpenAI, que te proporciona algunas piezas ya hechas para tareas comunes de IA y así ahorrarte algo de código.

Cuenta con algunas características clave que se encargan de las partes más molestas de construir un chatbot:

-

Hilos persistentes: Esto es solo una forma de decir que la API gestiona el historial de la conversación por ti. Es una buena característica porque tus desarrolladores no tienen que hacer un seguimiento manual de todo el registro del chat con cada nuevo mensaje, lo que mantiene el código más limpio.

-

Herramientas integradas: Viene con un par de herramientas útiles listas para usar. El Intérprete de Código permite a la IA ejecutar código Python para cosas como cálculos o análisis de datos. La Recuperación de Conocimiento le permite buscar en documentos que has subido, un proceso a menudo llamado Generación Aumentada por Recuperación (RAG).

-

Llamada a funciones: Esto permite que tu asistente se conecte a herramientas y API externas. Por ejemplo, podrías usarlo para verificar el estado de un pedido en tu tienda de Shopify o registrar un nuevo ticket en Jira.

Entonces, ¿para quién es? La API de Asistentes es una opción sólida para equipos que están completamente comprometidos con el ecosistema de OpenAI y quieren un camino más guiado y optimizado. Pero no dejes que "optimizado" te engañe pensando que es una herramienta sin código. Todavía necesitarás serias habilidades de programación para construir, lanzar y mantener un agente de IA real y listo para producción.

¿Qué es LangChain?

Por otro lado, tenemos LangChain. Es un popular framework de código abierto para construir aplicaciones con modelos de lenguaje grandes (LLMs). La mayor diferencia es que LangChain no está atado a un proveedor de modelos específico. Es más como un adaptador universal, diseñado para conectar cualquier LLM a los datos de tu empresa, API externas y otras herramientas.

Esta flexibilidad permite a los desarrolladores crear flujos de trabajo más complicados y de múltiples pasos. Aquí están las ideas principales detrás de él:

-

Agnóstico al modelo: Esta es la gran ventaja. Con LangChain, puedes usar modelos de OpenAI, Anthropic (Claude), Google (Gemini), o incluso modelos de código abierto que alojes tú mismo. Te da la libertad de elegir el mejor modelo para una tarea específica y te ayuda a evitar quedar atrapado con un solo proveedor.

-

Cadenas: LangChain se trata de permitirte enlazar múltiples pasos. Por ejemplo, una "cadena" podría tomar la pregunta de un usuario, extraer información de una base de datos, enviarla a un LLM para que escriba un resumen amigable y luego formatear la respuesta final.

-

Agentes: Los agentes van un paso más allá. Usan un LLM como cerebro para decidir qué hacer a continuación. En lugar de solo seguir una lista de pasos preestablecida, un agente puede determinar por sí mismo si necesita usar una herramienta de búsqueda, una calculadora o alguna otra API para obtener la respuesta correcta.

LangChain es para desarrolladores que quieren control total, les encanta experimentar con diferentes LLMs o necesitan construir flujos de trabajo de IA realmente específicos y complejos. Pero todo ese poder tiene un precio: es más difícil de aprender y eres responsable de gestionar todas las piezas móviles.

Diferencias clave

La elección entre estos dos realmente se reduce a algunas compensaciones clave. Básicamente, estás decidiendo entre algo que es más simple para empezar versus algo que te da más control, y tener algo funcionando rápidamente versus tener más flexibilidad a largo plazo. Profundicemos en lo que eso significa realmente.

| Característica | API de Asistentes | LangChain |

|---|---|---|

| Objetivo principal | Kit de inicio para modelos de OpenAI | Framework universal y agnóstico al modelo |

| Control | Limitado al ecosistema de OpenAI | Control total sobre todos los componentes |

| Flexibilidad | Menor, atado a la hoja de ruta de OpenAI | Alta, se pueden intercambiar modelos/bases de datos |

| Dependencia de un proveedor | Alta, integración profunda con OpenAI | Baja, diseñado para ser agnóstico al modelo |

| Facilidad de configuración | Más simple para bots básicos | Configuración inicial más compleja |

| Mantenimiento | Dependiente de las actualizaciones de OpenAI | Autogestionado, más complejo |

| Modelo de costos | Pago por uso para todos los servicios | Framework gratuito, pero pagas por el LLM, el alojamiento y los ingenieros |

Control, flexibilidad y dependencia de un proveedor

-

LangChain: Este framework te da las llaves del reino. Puedes cambiar literalmente cada parte de tu configuración de IA: el LLM, la base de datos vectorial que usas para RAG, los modelos de embedding, todo. Esta es tu mejor protección contra quedar atrapado con un solo proveedor. Si mañana sale un modelo nuevo y mejor, puedes cambiarlo. ¿La desventaja? Tu equipo de ingeniería es ahora responsable de construir y mantener todo este sistema complejo, lo que fácilmente puede convertirse en un trabajo a tiempo completo.

-

API de Asistentes: Usar esta API significa que estás prácticamente encerrado en el mundo de OpenAI. Tienes que usar sus modelos, su sistema de recuperación y su forma de hacer las cosas. Es más simple poner en marcha una versión básica, pero también estás atado a sus precios y a su hoja de ruta. Si cambian los precios o eliminan un modelo del que dependes, no hay mucho que puedas hacer al respecto.

Desde una perspectiva empresarial, este debate puede parecer un poco abstracto. Solo quieres algo que funcione; no quieres gestionar una pila tecnológica ni preocuparte por estar atado a un solo proveedor. Aquí es donde una solución como eesel AI cambia la conversación. Gestiona toda la tecnología compleja entre bastidores, pero te ofrece un panel de control simple y sin código para controlar la personalidad de tu IA, sus fuentes de conocimiento y lo que puede hacer, sin necesidad de que tus ingenieros escriban una sola línea de código.

Facilidad de configuración y mantenimiento continuo

-

API de Asistentes: La mayoría de la gente considera que es un poco más fácil empezar con ella, especialmente para proyectos simples, porque gestiona automáticamente cosas como la memoria de la conversación. Pero construir una aplicación pulida y fiable sigue siendo un proyecto enorme. Necesitas a alguien que realmente sepa manejarse con las API, gestionar diferentes herramientas y construir una interfaz de usuario. Y el mantenimiento nunca termina; tienes que estar constantemente al día con los cambios y actualizaciones de la API de OpenAI.

-

LangChain: Este camino definitivamente requiere más trabajo al principio. Tienes que escribir mucho más código solo para conectar las piezas básicas, gestionar la memoria del agente y configurar tus flujos de trabajo. Si bien esto te da más control, también significa que hay mucho más código que depurar y mantener. Muchos desarrolladores descubren que los proyectos de LangChain pueden volverse increíblemente complicados, y muy rápido.

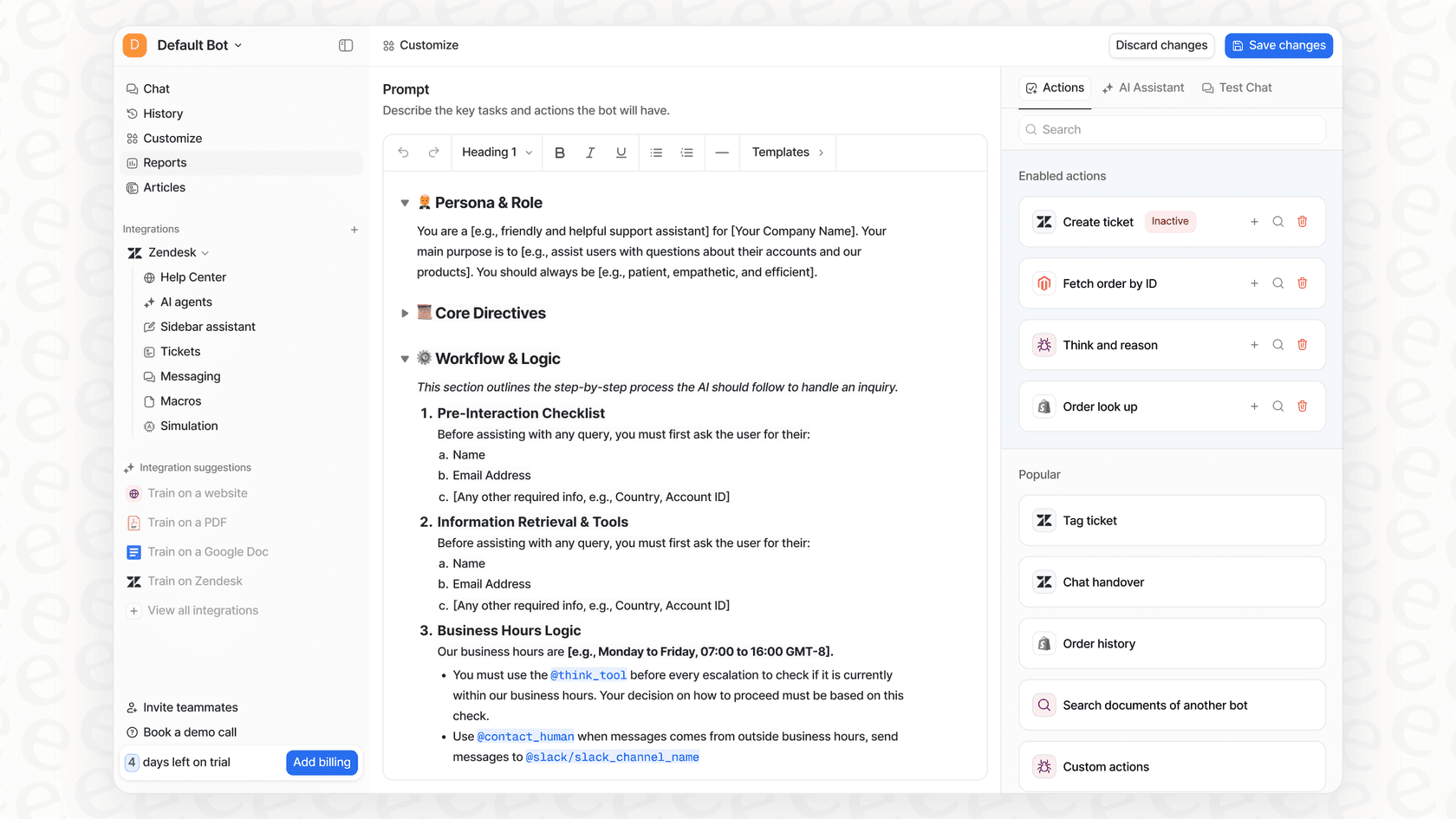

Hay una forma más rápida de llegar allí. Ambos caminos necesitan meses del tiempo de un desarrollador para crear algo que realmente querrías que usaran los clientes. Para las empresas que necesitan una solución ahora, una plataforma como eesel AI ofrece un camino totalmente diferente. Puedes conectar tu servicio de asistencia (como Zendesk) y tus bases de conocimiento (como Confluence) en unos pocos clics y tener un agente de IA funcionando el mismo día. Es la diferencia entre un proyecto de ingeniería de seis meses y un resultado inmediato.

RAG, uso de herramientas y flujos de trabajo avanzados

Ambos frameworks pueden construir potentes bots RAG y agentes que pueden usar otras herramientas para realizar tareas.

LangChain te da un control muy detallado sobre todo el proceso de RAG. Puedes configurar formas personalizadas de dividir documentos, elegir entre todo tipo de almacenes de vectores y usar modelos de reclasificación sofisticados para hacer tus respuestas más precisas. También cuenta con herramientas avanzadas como LangGraph para construir agentes realmente complejos que pueden retroceder y corregirse a sí mismos.

La API de Asistentes tiene un potente sistema de RAG, pero es más una "caja negra". Subes tus archivos y simplemente funciona, pero no tienes mucho que decir sobre cómo funciona internamente. Para muchas situaciones, es perfectamente adecuado, pero si tienes necesidades muy específicas, podrías encontrarlo un poco restrictivo.

Para un equipo de soporte, el objetivo no es construir el sistema RAG más elegante técnicamente; es simplemente obtener respuestas precisas de los documentos correctos. Una herramienta como eesel AI se conecta a todo tu conocimiento de una sola vez, aprendiendo de tickets pasados, artículos de ayuda y documentos internos. Puedes decirle fácilmente qué debe y no debe saber, dándote respuestas fiables sin el drama de la ingeniería.

__

Desglose de precios

Hablemos de dinero, porque la forma en que pagas por estos dos es completamente diferente, y la factura final puede ser una verdadera sorpresa.

-

Precios de la API de Asistentes: Pagas por uso, por todo. Esto incluye los tokens del modelo de OpenAI que estás usando, una tarifa por almacenar los hilos de conversación y otra tarifa por usar la herramienta de recuperación basada en la cantidad de datos que almacenas. Este precio basado en el uso puede volverse caro rápidamente y es casi imposible de predecir, lo que convierte la elaboración de presupuestos en una pesadilla.

-

Precios de LangChain: El framework en sí es gratuito porque es de código abierto, lo que suena atractivo. Pero el costo total suele ser mucho más alto. Todavía tienes que pagar por las llamadas a la API del LLM que elijas (lo cual es igual de impredecible), además tienes que pagar por el alojamiento de tu aplicación, una base de datos vectorial y, lo más importante, el considerable salario de los ingenieros que necesitas para construir y mantener todo el sistema.

Hay una mejor manera de presupuestar. Esta es una gran razón por la que muchas empresas eligen una plataforma como eesel AI. El precio es claro y predecible. Pagas una tarifa plana basada en un número determinado de interacciones de IA al mes, por lo que sabes exactamente cuál será tu factura. Sin sorpresas, sin tarifas por token. Facilita la elaboración de presupuestos y la demostración del valor desde el primer día.

__

El dilema empresarial: Construir vs. Comprar

Al final del día, elegir entre la API de Asistentes y LangChain es una clásica decisión de "construir". Le estás dando a tus desarrolladores un conjunto de herramientas para construir una solución desde cero. Este es el movimiento correcto si la construcción de sistemas de IA es una parte central de lo que hace tu empresa.

Pero para la mayoría de las empresas, especialmente en departamentos como atención al cliente o TI, el objetivo no es convertirse en expertos en frameworks de IA. El objetivo es resolver problemas más rápido, reducir costos y hacer más felices a los clientes y empleados.

Aquí es donde una decisión de "comprar" a menudo tiene mucho más sentido. Una plataforma de IA como eesel AI no es una herramienta para desarrolladores; es una solución de negocio. Te da el poder de un agente hecho a medida sin el tiempo, el costo, el riesgo y el mantenimiento constante que conlleva construirlo tú mismo.

| Factor | Construir (API de Asistentes / LangChain) | Comprar (eesel AI) |

|---|---|---|

| Usuario | Desarrolladores | Usuarios de negocio (p. ej., Director de Soporte) |

| Tiempo para obtener valor | Semanas o meses | Minutos u horas |

| Elección de modelo | Atado a OpenAI o complejo de gestionar | Los mejores modelos se gestionan por ti |

| Costo total | Impredecible y alto (tarifas de API + salarios de desarrolladores) | Predecible, tarifa de suscripción plana |

| Riesgo | Alto (fallo del proyecto, sobrecarga de mantenimiento) | Bajo (plataforma probada, servicio gestionado) |

Piensa en la diferencia en términos prácticos. Tanto la API de Asistentes como LangChain son herramientas para desarrolladores. Una solución como eesel AI está creada para un usuario de negocio, como un Director de Soporte. Configurar un agente personalizado con herramientas de desarrollo puede llevar semanas o incluso meses. Una plataforma sin código puede estar en funcionamiento en minutos. Con la API, estás atado a los modelos de OpenAI, mientras que LangChain te da opciones pero añade complejidad. Una plataforma gestionada elige los mejores modelos para ti. Finalmente, el costo de una construcción personalizada es impredecible y alto cuando se tiene en cuenta el tiempo de los desarrolladores, mientras que una suscripción es predecible y fácil de gestionar.

API de Asistentes vs. LangChain: Céntrate en el resultado, no en el framework

La conversación sobre la API de Asistentes vs. LangChain es buena para los equipos de ingeniería. La API de Asistentes te ofrece un camino más simple pero más restrictivo con OpenAI, mientras que LangChain ofrece total libertad pero con mucha más complejidad.

Ambos son conjuntos de herramientas potentes para construir algo. Pero ambos requieren una inversión grande y continua en desarrolladores especializados para obtener algo a cambio.

Para los líderes empresariales, hay una pregunta mejor que hacer: ¿cuál es la forma más rápida y fiable de obtener el resultado que quiero? En lugar de iniciar un proyecto interno largo, costoso y arriesgado, podrías usar una plataforma que te dé el resultado final, un agente de IA inteligente, integrado y eficaz, desde el primer día.

¿Listo para implementar un agente de IA que aprenda de tu conocimiento existente y funcione con tus herramientas, sin todo el trabajo pesado? Prueba eesel AI gratis y descubre lo rápido que puedes empezar a automatizar el soporte.

Preguntas frecuentes

La diferencia principal radica en [el control frente a la comodidad](https://community.openai.com/t/the-difference-of-assistant-api-and-langchain/496223). La API de Asistentes ofrece un entorno más gestionado y específico de OpenAI, simplificando algunos aspectos del desarrollo pero limitando la flexibilidad. LangChain proporciona un framework de código abierto y altamente personalizable que funciona con varios LLMs pero requiere un mayor esfuerzo de desarrollo.

Optar por la API de Asistentes significa comprometerse con el ecosistema de OpenAI, incluyendo sus modelos y servicios. [LangChain, al ser agnóstico al modelo](https://blog.finxter.com/langchain-vs-assistant-api-comparing-nlp-powerhouses/), te permite cambiar entre diferentes proveedores de LLM, reduciendo significativamente la dependencia de un proveedor y ofreciendo una mayor flexibilidad a largo plazo.

La API de Asistentes a menudo se percibe como más fácil para la configuración inicial, especialmente para agentes conversacionales sencillos, debido a sus características integradas como los hilos persistentes. Sin embargo, construir una aplicación lista para producción con cualquiera de las dos opciones todavía exige una experiencia de desarrollo significativa y un mantenimiento continuo.

Los costos de la API de Asistentes se basan en el uso, cubriendo tokens, almacenamiento de hilos y recuperación, lo que los hace impredecibles. LangChain en sí es gratuito, pero los costos totales incluyen las llamadas a la API del LLM, el alojamiento y, fundamentalmente, los considerables salarios de ingeniería necesarios para el desarrollo, la implementación y el mantenimiento continuo.

Para obtener la [máxima personalización y un control detallado](https://www.ampcome.com/articles/openai-assistants-vs-langchain-agents-what-are-they-how-to-build-them), LangChain es la opción superior. Permite a los desarrolladores configurar cada componente, desde LLMs específicos y pipelines de RAG hasta complejos [agentes de múltiples pasos](https://www.eesel.ai/es/blog/what-are-autonomous-ai-agents-a-guide-for-businesses), ofreciendo una flexibilidad inigualable en comparación con la API de Asistentes, que es más rígida.

La API de Asistentes proporciona un sistema RAG potente y listo para usar donde subes archivos, pero funciona como una "caja negra" con personalización limitada. LangChain ofrece un control exhaustivo sobre todo el pipeline de RAG, permitiendo la división personalizada de documentos, diversos almacenes de vectores y una reclasificación sofisticada.

La API de Asistentes es adecuada para proyectos profundamente integrados con el ecosistema de OpenAI que priorizan una configuración más rápida para tareas conversacionales más simples. LangChain es ideal para [flujos de trabajo de IA complejos y personalizados](https://dev.to/ruturajmaggirwar/langchain-with-pinecone-vs-openai-assistant-3l19), aplicaciones con múltiples modelos o escenarios donde evitar la dependencia de un proveedor y tener un control profundo son críticos.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.