GLM 5.1 Leitfaden: Der neue König des Long-Horizon AI-Engineerings

Stevia Putri

Zuletzt bearbeitet April 21, 2026

{ "title": "GLM 5.1 Leitfaden: Der neue König des Long-Horizon AI-Engineerings", "keyword": "GLM 5.1", "slug": "glm-5-1", "description": "Entdecken Sie GLM 5.1, das Flaggschiff-KI-Modell, das SOTA-Benchmarks im Coding und bei Aufgaben mit langem Zeithorizont setzt. Erfahren Sie, wie es 2026 Claude und GPT-5 übertrifft.", "excerpt": "GLM 5.1 definiert agentisches Engineering neu. Von SOTA-Coding-Leistung bis hin zu 8-stündigen autonomen Aufgaben: Erfahren Sie, warum dieses Modell der neue Maßstab für KI-Teamkollegen ist.", "categories": ["Blog Writer AI"], "tags": ["GLM 5.1", "Agentisches Engineering", "KI-Benchmarks", "Coding-KI", "Z.ai"], "coverImage": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerUrl": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerAlt": "Ein futuristisches GLM 5.1-Logo vor dem Hintergrund einer komplexen Coding-Oberfläche.", "faqs": [ { "question": "Was ist GLM 5.1?", "answer": "GLM 5.1 ist ein Flaggschiff-KI-Modell der nächsten Generation von Z.ai, das speziell für agentische Engineering-Aufgaben mit langem Zeithorizont entwickelt wurde." }, { "question": "Wie schneidet GLM 5.1 bei Coding-Benchmarks ab?", "answer": "GLM 5.1 erreichte einen SOTA-Wert von 58,4 auf dem SWE-Bench Pro und übertraf damit GPT-5.4 und Claude Opus 4.6." }, { "question": "Kann ich GLM 5.1 lokal ausführen?", "answer": "Ja, die Modellgewichte von GLM 5.1 sind Open-Source und kompatibel mit lokalen Frameworks wie Ollama, vLLM und SGLang." } ] }

Die Welt der KI entwickelt sich rasant. Wir haben uns von „Vibe Coding“, bei dem man eine KI um einen Schnipsel bittet und hofft, dass er funktioniert, hin zum „agentischen Engineering“ bewegt, bei dem KI-Modelle komplexe, mehrstufige Projekte eigenständig übernehmen. Doch selbst in dieser neuen Ära stoßen die meisten Modelle an ihre Grenzen. Sie starten stark, aber sobald die Aufgabe komplexer wird und sich die Tool-Aufrufe häufen, stagnieren sie. Sie schöpfen ihre Möglichkeiten aus, wiederholen Fehler und geben schließlich auf.

Hier kommt GLM-5.1 ins Spiel. Dieses Anfang 2026 veröffentlichte Flaggschiff-Modell der nächsten Generation von Z.ai ist nicht nur ein weiteres inkrementelles Update. Es ist ein Modell, das speziell für den „Long-Horizon“ entwickelt wurde – Aufgaben, die Hunderte von Iterationsrunden und Tausende von Tool-Aufrufen erfordern, um ein optimales Ergebnis zu erzielen.

Egal, ob Sie einen vollautonomen KI-Helpdesk-Agenten aufbauen oder hochperformante GPU-Kernel optimieren: GLM 5.1 setzt einen neuen Standard dafür, was es bedeutet, ein „produktiver“ KI-Teamkollege zu sein.

Benchmark-Analyse: SOTA im Engineering

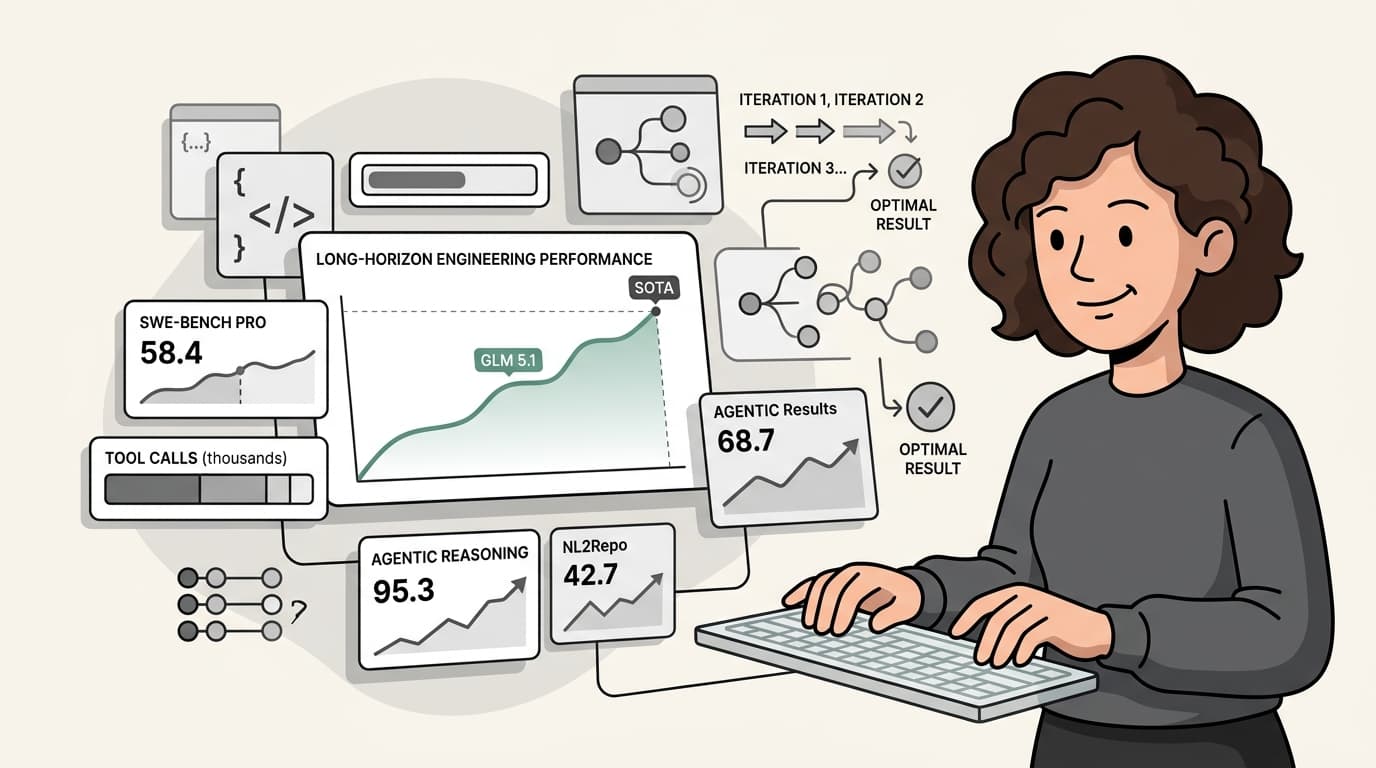

Wenn Sie wissen wollen, wie ein Engineering-Modell wirklich abschneidet, müssen Sie sich Benchmarks ansehen, die echte Arbeit simulieren. GLM 5.1 nimmt nicht nur an diesen Benchmarks teil; es führt sie an.

Auf dem SWE-Bench Pro, einem Benchmark, der Modelle bei komplexen, realen Software-Engineering-Aufgaben testet, erreichte GLM 5.1 einen State-of-the-Art (SOTA)-Wert von 58,4. Um das ins Verhältnis zu setzen: Es übertraf Schwergewichte wie GPT-5.4 (57,7) und Claude Opus 4.6 (57,3).

Aber es geht nicht nur ums Coden. GLM 5.1 zeigt durchweg signifikante Zuwächse:

- Terminal-Bench 2.0: Es erzielte 63,5 im Terminus-2-Framework und sprang auf 69,0, wenn es in das Claude Code-Harness eingebettet wurde. Dies zeigt seine unglaubliche Kompetenz bei der Navigation in realen Terminal-Umgebungen.

- Reasoning: Es erreichte eine 95,3 bei AIME 2026 und eine 52,3 bei der „Humanity’s Last Exam“ (HLE) mit Tools, was beweist, dass sein logisches Denkvermögen auf hohem Niveau nicht zugunsten technischer Fähigkeiten geopfert wird.

- Repo-Generierung: Bei NL2Repo erzielte es 42,7, was zeigt, dass es ganze Repositories verarbeiten kann, nicht nur isolierte Dateien.

Das „Treppen“-Muster: Wie GLM 5.1 schwierige Probleme löst

Die meisten LLMs folgen einem vorhersehbaren Pfad: Sie lösen die einfachen Teile eines Problems schnell, dann flacht ihre Leistung ab. Ihnen mehr Zeit oder mehr Tool-Aufrufe zu geben, hilft nicht, da sie ihr „Repertoire bereits ausgeschöpft“ haben.

GLM 5.1 bricht diesen Trend mit dem, was Z.ai das „Treppen“-Optimierungsmuster nennt. Anstatt zu stagnieren, identifiziert das Modell kontinuierlich Engpässe und implementiert strukturelle Änderungen, um diese zu überwinden.

Nehmen wir zum Beispiel die VectorDBBench-Herausforderung. Das Ziel war der Bau einer hochperformanten Vektordatenbank. Während die meisten Modelle vielleicht 3.500 QPS erreichen und dann aufhören, durfte GLM 5.1 für 600 Iterationen und über 6.000 Tool-Aufrufe laufen.

Das Ergebnis? Es erreichte letztendlich 21,5k QPS, etwa das 6-fache des bisherigen Bestwerts. Während des Laufs passte das Modell nicht nur Einstellungen an; es änderte autonom seine Strategien. Es wechselte vom Scannen des gesamten Korpus zum IVF-Cluster-Probing und führte dann eine zweistufige Pipeline mit u8-Prescoring ein. Jede „Stufe“ in der Treppe war ein Moment, in dem das Modell seine eigenen Protokolle analysierte, einen Blocker identifizierte und eine strukturelle Korrektur entwickelte.

Reale Szenarien für agentisches Engineering

Die Kraft der Long-Horizon-KI ist nicht theoretisch; sie wird in unglaublich ehrgeizigen Szenarien getestet.

1. Optimierung von GPU-Kerneln (KernelBench)

Auf KernelBench werden Modelle damit beauftragt, eine PyTorch-Referenzimplementierung zu nehmen und einen schnelleren GPU-Kernel zu erstellen. GLM 5.1 erreichte eine 3,6-fache Beschleunigung bei Problemen der Stufe 3 (die vollständige Modellarchitekturen wie MobileNet und Mamba abdecken). Es hielt diese Optimierung weit über das Limit von 1.200 Tool-Use-Turns hinaus aufrecht und fand weiterhin Verbesserungen, wo Vorgänger wie GLM-5 stagnierten.

2. Bau eines Linux-Desktops in 8 Stunden

Die vielleicht beeindruckendste Demonstration war eine offene Aufgabe: Bauen Sie eine Linux-ähnliche Desktop-Umgebung als Webanwendung von Grund auf neu. Die meisten Modelle erstellen eine einfache Taskleiste und hören dann auf. GLM 5.1 hingegen lief 8 Stunden lang kontinuierlich. Es baute den Dateibrowser, das Terminal, den Texteditor und sogar Spiele, während es gleichzeitig sicherstellte, dass die Benutzeroberfläche visuell konsistent blieb und die Interaktionen reibungslos funktionierten.

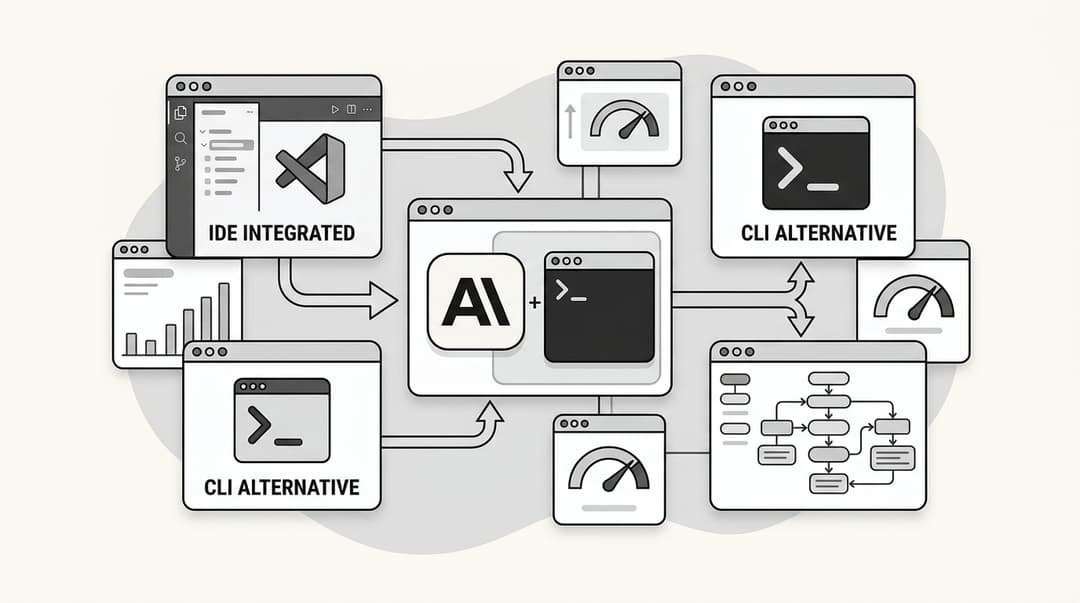

Erste Schritte: So nutzen Sie GLM 5.1 heute

Egal, ob Sie GLM 5.1 für Ihre eigenen Projekte nutzen oder es in Aktion durch einen KI-Teamkollegen sehen möchten, es gibt verschiedene Möglichkeiten, loszulegen.

API-Zugriff

Sie können über die offizielle Z.ai API oder über Anbieter wie OpenRouter auf GLM 5.1 zugreifen. Bei OpenRouter ist die Preisgestaltung mit 0,698 $ pro Million Input-Token und 4,40 $ pro Million Output-Token bei einem massiven 202.752-Token-Kontextfenster äußerst wettbewerbsfähig.

Lokale Bereitstellung

Für diejenigen, die ihre Daten lieber lokal behalten möchten, sind die Modellgewichte öffentlich auf HuggingFace unter der MIT-Lizenz und der NVIDIA Open Model License verfügbar. Es ist mit den wichtigsten lokalen Serving-Frameworks kompatibel, darunter:

- vLLM (v0.19.0+)

- SGLang (v0.5.10+)

- Ollama

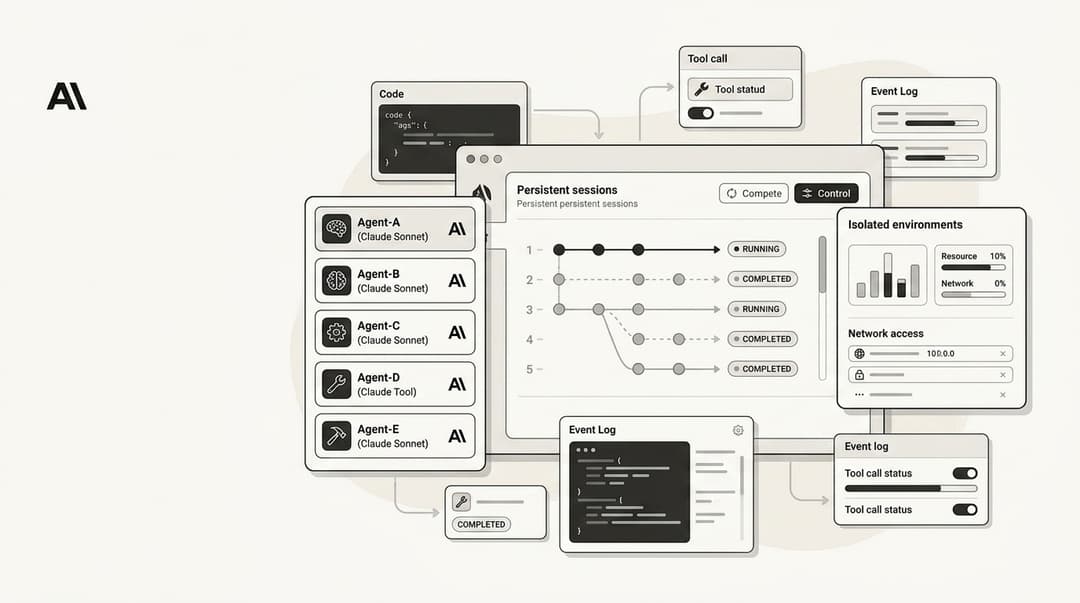

Integration mit eesel AI

Bei eesel AI glauben wir, dass die Zukunft der Arbeit in KI-Teamkollegen liegt, die die schwere Arbeit übernehmen. Die Fähigkeit von GLM 5.1, Aufgaben mit langem Zeithorizont zu bewältigen, macht es zur perfekten Engine für KI-Content-Generatoren und Support-Agenten, die nicht nur Fragen beantworten, sondern komplexe Probleme über einen längeren Zeitraum lösen.

Fazit: Die Zukunft autonomer Teamkollegen

GLM 5.1 stellt einen grundlegenden Wandel in der KI-Fähigkeit dar. Es geht nicht mehr nur um die erste Antwort; es geht um die Hartnäckigkeit, dranzubleiben, bis die Arbeit richtig erledigt ist. Durch die Beherrschung von Aufgaben mit langem Zeithorizont bringt uns GLM 5.1 einer Welt näher, in der KI nicht nur ein Werkzeug, sondern ein wirklich autonomer Teamkollege ist.

Während wir uns durch das Jahr 2026 bewegen, wird die Lücke zwischen „gut genug“-Modellen und solchen, die Optimierungen über Tausende von Schritten hinweg aufrechterhalten können, nur noch größer werden. Wenn Sie für die Zukunft des Engineerings bauen, ist GLM 5.1 die neue Grenze.

Häufig gestellte Fragen

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.