GLM 5.1: Das Ende des KI-Plateaus? | eesel AI

Stevia Putri

Zuletzt bearbeitet April 21, 2026

Wenn Sie in letzter Zeit mit KI-Coding-Assistenten gearbeitet haben, sind Sie wahrscheinlich auf das „Plateau“ gestoßen. Sie starten eine Sitzung, das Modell liefert Ihnen die ersten paar brillanten Zeilen, und dann... gibt es irgendwie auf. Es beginnt, denselben fehlerhaften Code zu wiederholen, ignoriert Ihr Feedback oder verliert nach ein paar Debugging-Runden völlig den Faden.

Es ist frustrierend, weil wir wissen, dass die Intelligenz vorhanden ist, aber die Ausdauer fehlt.

Hier kommt GLM 5.1 ins Spiel.

GLM 5.1 wurde im April 2026 von Z.AI (Zhipu AI) veröffentlicht und ist nicht nur ein weiteres inkrementelles Update für die LLM-Bestenlisten. Es ist ein Modell, das speziell dafür entwickelt wurde, sogenannte „Long-Horizon“-Aufgaben anzugehen (die Art von komplexen, mehrstufigen Ingenieursprojekten, bei denen KI normalerweise abstürzt und scheitert).

Egal, ob Sie ein Entwicklungsleiter sind, der zuverlässigere autonome Agenten sucht, oder ein Ingenieur, der es leid ist, seine KI zu beaufsichtigen – GLM 5.1 stellt einen massiven Wandel in unserem Verständnis von „Agentic Engineering“ dar.

Das „Plateau“-Problem: Warum andere Modelle bei langen Aufgaben versagen

Die meisten LLMs (selbst die Schwergewichte wie GPT-5.4 und Claude 4.6) sind auf „One-Shot“- oder Kurzzeit-Leistung optimiert. Sie sind darauf ausgelegt, Ihnen sofort die richtige Antwort zu geben. Und für die meisten Dinge ist das großartig.

Aber Softwareentwicklung ist kein One-Shot-Spiel. Es ist ein iterativer Prozess aus Experimentieren, Scheitern und Verfeinern. Wenn Sie ein herkömmliches Modell bitten, einen komplexen Bug auf Repository-Ebene zu lösen, erschöpft es oft früh sein Repertoire. Es wendet zuerst die offensichtlichsten Korrekturen an, und wenn diese nicht funktionieren, stößt es an eine Leistungsgrenze. Ihm mehr Zeit oder mehr Tool-Aufrufe zu geben, hilft meist nicht; es dreht sich nur im Kreis.

Dieses „Plateau“ entsteht, weil den meisten Modellen das interne Urteilsvermögen fehlt, um zu erkennen, wenn eine Strategie nicht funktioniert. Sie können nicht effektiv „zurückgehen“ oder ihren gesamten Ansatz überdenken. Stattdessen graben sie weiter im selben Loch und geraten immer tiefer in eine logische Sackgasse.

Durchbruch: Wie GLM 5.1 Long-Horizon-Aufgaben bewältigt

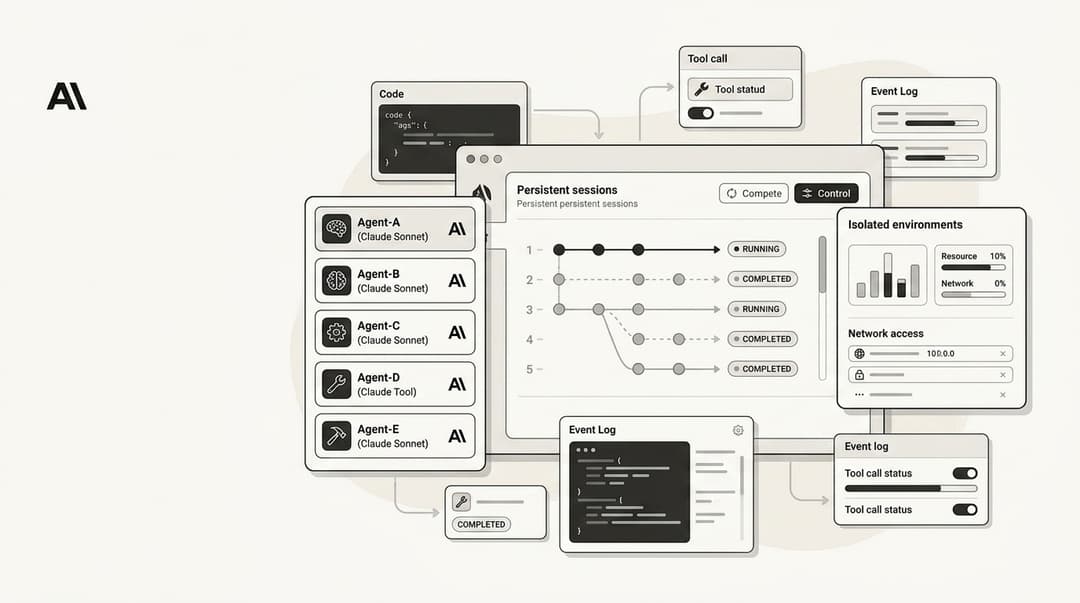

GLM 5.1 wurde mit einer anderen Philosophie entwickelt: Je länger es läuft, desto besser sollte das Ergebnis sein.

Das ist nicht nur Marketing-Geschwätz. Z.AI hat das Modell für Sitzungen optimiert, die über tausend Tool-Aufrufe dauern. Das Geheimrezept ist etwas, das sie „Reflexionsbasiertes Denken“ (Reflection-based Reasoning) nennen.

Anstatt einfach nur vorwärts zu preschen, nutzt GLM 5.1 eine interne Reflexionsschleife, um seine Zwischenschritte zu bewerten. Wenn ein Befehl fehlschlägt oder eine Testsuite nicht besteht, hat das Modell das Urteilsvermögen zu sagen: „Warte, diese ganze Strategie ist falsch“, und zu einem früheren Entscheidungspunkt zurückzukehren.

Diese „Long-Horizon“-Fähigkeit bedeutet, dass das Modell mehrdeutige Probleme mit deutlich besserem Urteilsvermögen handhaben kann. Es bleibt über stundenlange Sitzungen hinweg produktiv, zerlegt komplexe Probleme, führt Experimente durch und identifiziert Blockaden mit echter Präzision. Es ist der Unterschied zwischen einem Junior-Entwickler, der ständige Aufsicht benötigt, und einem Senior-Entwickler, der allein gelassen werden kann, um ein Ticket von Anfang bis Ende zu lösen.

Benchmark-Showdown: An der Spitze der Bestenlisten

Die Zahlen untermauern den Hype. Auf SWE-Bench Pro (dem Goldstandard für die Bewertung, wie KI-Agenten reale GitHub-Probleme lösen) erreichte GLM 5.1 eine beeindruckende Erfolgsquote von 58,4 %.

Zum Vergleich: Das schlägt GPT-5.4 (57,7 %) und Claude Opus 4.6 (57,3 %). Auch wenn diese Abstände gering erscheinen mögen, spart jeder Prozentpunkt in der Welt der autonomen Agenten tausende von Arbeitsstunden bei der Fehlerbehebung.

Aber es geht nicht nur um einen Benchmark. GLM 5.1 führt auch bei:

- Terminal-Bench 2.0: Ein Benchmark für reale Terminal-Aufgaben wie Umgebungs-Setup und Log-Analyse.

- NL2Repo: Ein Test für die Generierung vollständiger, architektonisch konsistenter Repositorys von Grund auf.

Diese Ergebnisse beweisen, dass GLM 5.1 mehr als nur ein Chatbot ist; es ist ein Kraftpaket für autonome Systeme.

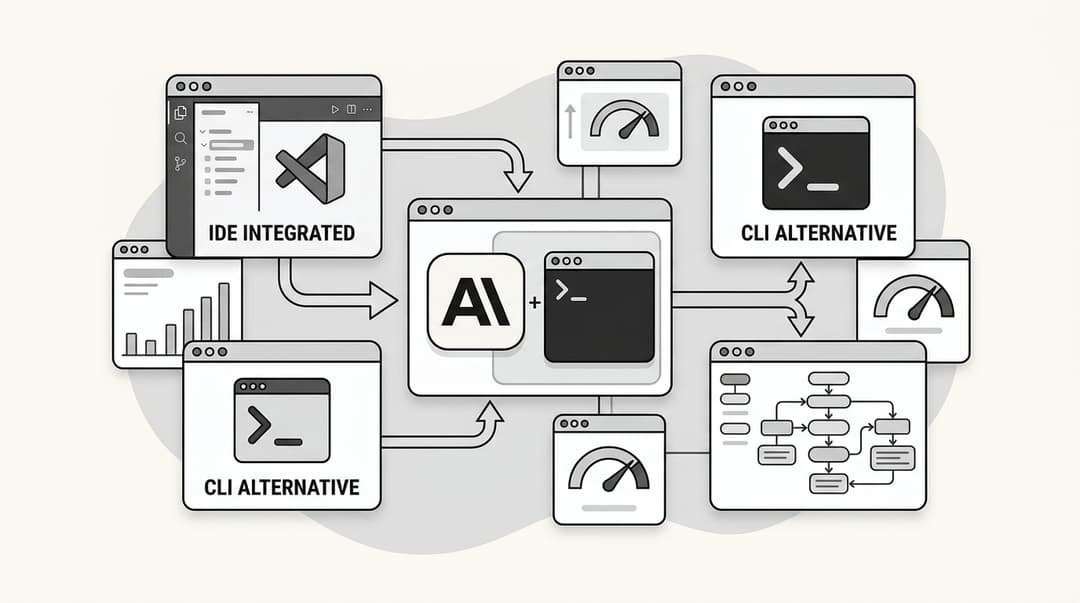

Praxisleitfaden: Wie Sie GLM 5.1 heute bereitstellen und nutzen

Die gute Nachricht ist, dass Sie keine riesige Serverfarm benötigen, um damit zu experimentieren. GLM 5.1 ist überraschend zugänglich.

API-Zugriff

Für die meisten produktiven Anwendungsfälle ist der API-Weg zu empfehlen. Seit April 2026 sind OpenRouter und NVIDIA Build die primären Anbieter.

- OpenRouter-Preise: Etwa 2,00 $ pro 1 Mio. Eingabe-Token und 6,00 $ pro 1 Mio. Ausgabe-Token.

- NVIDIA Build: Bietet etwas wettbewerbsfähigere Preise und kostenlose Credits für Entwickler zum Testen des Modells.

Lokale Bereitstellung

Wenn Sie datenschutzbewusst sind oder Dinge einfach gerne auf Ihrer eigenen Hardware ausführen, hat Ollama bereits Unterstützung für GLM 5.1 hinzugefügt. Sie können es lokal in GGUF- oder FP16-Formaten ausführen, wobei Sie für die Flaggschiff-Version ein anständiges GPU-Setup benötigen.

Profi-Tipp für das Prompting

Da GLM 5.1 für Iterationen gebaut ist, scheuen Sie sich nicht, ihm offene, komplexe Aufgaben zu geben. Anstatt Dinge für das Modell in winzige Schritte zu unterteilen, geben Sie ihm das Ziel und die Werkzeuge und lassen Sie seine interne Reflexionsschleife die schwere Arbeit erledigen.

Die eesel AI-Perspektive: LLMs für autonomen Support

Bei eesel AI suchen wir ständig nach Wegen, unsere autonomen Support-Agenten noch zuverlässiger zu machen. Für uns ist der „Long-Horizon“-Durchbruch ein Wendepunkt.

Kundensupport-Tickets erfordern oft mehrstufiges Debugging (Überprüfung des Kundenkontos, Durchsicht von Logdateien, Verifizierung einer technischen Integration und anschließende Formulierung einer Lösung). Wenn ein KI-Agent auf halbem Weg durch diesen Prozess „plateauiert“, erhält der Kunde eine schlechte Erfahrung.

Die Fähigkeit von GLM 5.1, hunderte von Tool-Aufrufen durchzuhalten und sich selbst zu korrigieren, wenn es auf ein Hindernis stößt, ist genau das, was für wirklich autonomen Support benötigt wird. Es ermöglicht uns, zuverlässigere „Simulationsmodi“ auszuführen, in denen wir die KI an tausenden vergangenen Tickets testen, um sicherzustellen, dass sie nie in eine logische Sackgasse gerät.

Erfahren Sie, wie eesel AI autonome Agenten baut

Fazit

Die Veröffentlichung von GLM 5.1 markiert das Ende der Ära des „KI-Plateaus“. Wir bewegen uns weg von Modellen, die nur Fragen beantworten, hin zu agentischen Teamkollegen, die Probleme lösen können.

Die Fähigkeit, es weiter zu versuchen, zurückzugehen und die Produktivität über lange Zeiträume aufrechtzuerhalten, wird die nächste Generation von KI-Tools definieren. Wenn Sie es noch nicht ausprobiert haben, ist GLM 5.1 ein großartiger Ausgangspunkt.

Häufig gestellte Fragen

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.