Neue KI-Modelle werden in hoher Frequenz veröffentlicht, und eines, das derzeit erhebliche Aufmerksamkeit erregt, ist DeepSeek V3.2. Dieses neue Open-Weight-Modell von DeepSeek AI ist bemerkenswert für seine Leistung, die bereits mit Modellen wie GPT-5 verglichen wird.

Während dies für Entwickler und Forscher einen bedeutenden Fortschritt darstellt, können die technischen Details komplex sein. Für Unternehmen stellt sich primär die Frage nach den praktischen Anwendungen. Das Verständnis der Einsatzmöglichkeiten, Einschränkungen und der damit verbundenen Kosten ist der Schlüssel, um die Fähigkeiten des Modells optimal zu nutzen.

Was ist DeepSeek V3.2?

DeepSeek V3.2 ist ein großes Sprachmodell (Large Language Model, LLM), das so konzipiert wurde, dass es sowohl leistungsstark als auch recheneffizient ist. Es ist der offizielle Nachfolger des experimentellen Modells V3.2-Exp und wurde entwickelt, um schwierige Denkaufgaben zu bewältigen und als fähiger KI-Agent zu agieren, ohne für jede Aufgabe einen Supercomputer zu benötigen.

3.2 Speciale jedoch... dient der 'Speciale'-Teil nicht nur dazu, es in Mathematik besser zu machen? Ich bin mir nicht sicher, ob die Verbesserungen von '3.2 Speciale' gegenüber '3.2' beim Schreiben etwas bringen. (Ich spreche NICHT von '3.2 Exp', das schon länger draußen ist. Ich spreche von den beiden, die heute erschienen sind: '3.2' vs '3.2 Speciale').

Es ist in verschiedenen Varianten verfügbar:

-

DeepSeek V3.2: Dies ist die Hauptversion, die über eine Web-Oberfläche, App und API zugänglich ist. Betrachten Sie es als den vielseitigen Allrounder, der sich für ein breites Spektrum an Aufgaben eignet und besonders gut darin ist, externe Werkzeuge zu nutzen, um Aufgaben zu erledigen.

-

DeepSeek V3.2-Speciale: Dies ist eine Spezialversion, die nur über die API verfügbar ist. Sie wurde ausschließlich für Aufgaben trainiert, die tiefgehendes logisches Denken (Reasoning) erfordern, und glänzt beim kompetitiven Programmieren sowie in fortgeschrittener Mathematik. Der Nachteil ist, dass sie kein Tool-Calling unterstützt, also weniger generalistisch einsetzbar ist. Zudem ist sie nur für begrenzte Zeit über einen temporären Endpunkt bis zum 15. Dezember 2025 verfügbar.

Das Besondere daran ist, dass es sich um ein „Open-Weight“-Modell handelt. Das bedeutet, dass die Kernkomponenten des Modells (seine Gewichte) auf Plattformen wie Hugging Face sowohl für die Standard- als auch für die Speciale-Version öffentlich zugänglich sind. Dies öffnet Forschern und Entwicklern die Tür, darauf aufzubauen, es anzupassen und neue Möglichkeiten zu erkunden.

Hauptfunktionen von DeepSeek V3.2

Die Leistung des Modells beruht auf mehreren Innovationen, die seine Geschwindigkeit, Intelligenz und Fähigkeiten verbessern.

Höhere Effizienz mit DeepSeek Sparse Attention (DSA)

Einer der größten Engpässe für LLMs ist die „Attention“ (Aufmerksamkeit), also die Art und Weise, wie das Modell den Kontext eines Gesprächs betrachtet, um eine relevante Antwort zu generieren. Herkömmliche Attention ist rechenintensiv, da die KI jedes einzelne vorangegangene Wort analysieren muss.

DeepSeek V3.2 nutzt einen intelligenteren Ansatz namens DeepSeek Sparse Attention (DSA). Es verfügt über einen „Lightning Indexer“ und einen „Token-Selector“, die schnell nur die relevantesten Teile des Textes finden und sich darauf konzentrieren. Anstatt alles zu analysieren, wählt es die entscheidenden Stücke aus.

Diese Änderung reduziert die Rechenlast erheblich, verbessert die Geschwindigkeit und senkt die Kosten, insbesondere bei Aufgaben mit langen Dokumenten oder Chat-Verläufen. Diese Innovation wurde zuerst im experimentellen Modell V3.2-Exp getestet und nun perfektioniert.

Skalierbares Reinforcement Learning für fortgeschrittenes Denken

Um wirklich gut in komplexer Logik zu werden, wurde DeepSeek V3.2 mit einer Methode namens Reinforcement Learning with Verifiable Rewards (RLVR) (Bestärkendes Lernen mit verifizierbaren Belohnungen) trainiert. Anstatt nur Feedback von Menschen zu erhalten, wird das Modell für das Erzeugen von nachweislich korrekten Antworten in Bereichen wie Mathematik und Programmierung belohnt. Dies ist vergleichbar damit, einen Schüler für den Rechenweg zu belohnen, nicht nur für das richtige Ergebnis.

Es lernt zudem, die eigene Arbeit zu überprüfen. Das Modell kann seine Denkschritte verifizieren und seine Antworten verfeinern, was zu zuverlässigeren Ergebnissen führt. Wie die Schöpfer anmerkten, ist dies wichtig, da „korrekte Antworten kein korrektes logisches Denken garantieren“.

Das Modell verfügt sogar über einen „Thinking“-Modus (Denkmodus), der im deepseek-reasoner API-Modell verfügbar ist. Dieser erlaubt es dem Modell, eine Aufgabe zu planen und zu durchdenken, bevor es eine Antwort generiert. Dies ist ein großer Schritt hin zu einer reflektierteren und präziseren KI.

Agentische Fähigkeiten und Tool-Integration

Bei DeepSeek V3.2 geht es nicht nur um die Generierung von Text; es ist als „Agent“ konzipiert, der externe Werkzeuge nutzen kann, um Aufgaben abzuschließen. Es wurde unter Verwendung einer Pipeline mit über 1.800 Umgebungen trainiert.

Dies ermöglicht es der KI, vom bloßen Reden zum tatsächlichen Handeln überzugehen – etwa eine Bestellung nachzuschlagen oder eine Rückerstattung zu bearbeiten. Für Unternehmen ist dies eine bedeutende Fähigkeit. Allerdings ist das Aufbauen und Verwalten von Verbindungen zu Ihren spezifischen Geschäftswerkzeugen (wie Zendesk für Support-Tickets oder Shopify für den E-Commerce) ein erhebliches technisches Projekt, wenn Sie lediglich das Rohmodell verwenden. Es ist ein leistungsstarker Motor, aber Sie müssen das Auto darum herum noch bauen.

DeepSeek V3.2 Leistung und Benchmarks

Das Team von DeepSeek AI war transparent und hat in seinem technischen Bericht umfangreiche Benchmarks veröffentlicht. Die Ergebnisse zeigen, dass V3.2 nicht nur zu proprietären Modellen aufschließt, sondern direkt mit den weltweit besten konkurriert.

Vergleich mit führenden Modellen

Der offizielle technische Bericht zeigt, dass das Standardmodell DeepSeek V3.2 bei wichtigen Benchmarks auf Augenhöhe mit GPT-5 agiert. Die Variante V3.2-Speciale übertrifft GPT-5 Berichten zufolge beim logischen Denken und liefert eine Leistung, die mit Gemini-3.0-Pro vergleichbar ist.

Habe es gerade in OpenRouter ausprobiert, da das DeepSeek-Web noch die alte Version hat. Dann habe ich ihm meine schwierigsten Fragen gestellt, die nur Sonnet 4.5, Opus 4.5 und Gemini 3.0 lösen können. Ergebnis: DeepSeek v3.2 Speciale beantwortet sie ebenfalls korrekt. Das erste offene Modell, das das schafft, nicht einmal GLM 4.6 konnte das.

Hier ist ein kurzer Überblick, wie die Modelle bei einigen der anspruchsvollsten Evaluierungs-Benchmarks abschneiden:

| Modell | HLE (Holistic Language Evaluation) | Codeforces (Elo) | MMLU-Pro | GPQA-Diamond |

|---|---|---|---|---|

| DeepSeek V3.2 | 21,7 | 2046 | 85,0 | 80,7 |

| DeepSeek V3.2-Speciale | 25,1 | 2401 | 86,2 | 84,1 |

| GPT-5 | 23,5 | 2355 | 85,8 | 83,0 |

| Gemini-3.0-Pro | 26,3 | 2420 | 86,5 | 84,8 |

Erfolge in spezialisierten Bereichen

Über die Benchmark-Ergebnisse hinaus hat das Modell bemerkenswerte Erfolge in der realen Welt erzielt. Das V3.2-Speciale-Modell zeigte Höchstleistungen in internationalen akademischen Wettbewerben.

Es bestand zudem Tests im ICPC World Finals und der Chinesischen Mathematik-Olympiade mit Bravour. Dies unterstreicht seine Fähigkeit, komplexe und spezialisierte Probleme zu bewältigen, die weit über einfache Textgenerierung hinausgehen und echtes High-Level-Problem-Solving erfordern.

Praktische Überlegungen zur Nutzung von DeepSeek V3.2

Obwohl die rohe Kraft des Modells unbestreitbar ist, erfordert die Umwandlung in ein nützliches Werkzeug für Ihr Unternehmen eine praktische Planung. Es ist nicht ganz „Plug-and-Play“.

Es ist definitiv gut darin, fesselnde und kreative Szenen zu schreiben. Es sieht jedoch so aus, als ob es ein Modell ist, das gerne Rollen übernimmt (Impersonation), und das ist ein No-Go. Ich muss sehen, ob es per Prompting dazu gebracht werden kann, diese Falle zu vermeiden, denn ansonsten könnte ich mir vorstellen, dass es Teil meiner regelmäßigen Auswahl wird.

So greifen Sie auf das DeepSeek V3.2-Modell zu und betreiben es

Der einfachste Weg für den Einstieg ist die DeepSeek Platform API. Sie können sich registrieren und sofort mit Aufrufen beginnen. Bitte beachten Sie, dass die hochspezialisierte Speciale-Variante über einen temporären Endpunkt verfügt, der am 15. Dezember 2025 abläuft.

Das Betreiben des Modells auf eigenen Servern ist technisch möglich, aber ein gewaltiges Unterfangen. Es erfordert benutzerdefinierten Code, spezialisierte Tools wie vLLM und eine Menge teurer GPU-Hardware. Für die meisten Unternehmen ist dies keine praktikable Option.

API-Preise und Kosten für DeepSeek V3.2

DeepSeek V3.2 wird pro Million Token abgerechnet (ein Token entspricht in etwa einem Wort oder einem Wortteil). Die Preise sind wettbewerbsfähig, können sich aber bei hoher Nutzung schnell summieren. Die Preisgestaltung ändert sich zudem je nachdem, ob sich das Modell im „Thinking Mode“ befindet und ob Ihr Eingabetext bereits zuvor verarbeitet wurde (ein „Cache-Hit“).

Hier ist die Aufschlüsselung von der offiziellen Preisseite:

| Modellversion | Preis Eingabe (Input) (1 Mio. Token) | Preis Ausgabe (Output) (1 Mio. Token) |

|---|---|---|

| DeepSeek-V3.2 (Normal) | 0,28 $ (Cache-Miss) / 0,028 $ (Cache-Hit) | 0,42 $ |

| DeepSeek-V3.2 (Thinking) | 0,28 $ (Cache-Miss) / 0,028 $ (Cache-Hit) | 0,42 $ |

Das V3.2-Speciale-Modell wird zum gleichen Preis angeboten, solange es verfügbar ist – ein hervorragendes Angebot für diese spezialisierte Leistung.

Die Lücke zwischen einem Modell und einer Geschäftslösung

Ein wichtiger Punkt ist, dass DeepSeek V3.2 ein grundlegender Motor ist. Für ein Unternehmen erfordert eine vollständige Lösung mehr als nur den Motor allein. Ein reines LLM ist nur eine Komponente eines größeren Systems.

Hier ist das, was fehlt, wenn Sie nur die API nutzen:

-

Integrationen: Das Modell kann von Haus aus nicht mit Ihrem Helpdesk, Ihrer E-Commerce-Plattform oder Ihrem internen Wiki kommunizieren. Die Anbindung an Geschäftssysteme wie Zendesk, Shopify oder Slack erfordert viel individuelle Entwicklungsarbeit.

-

Anwendungsebene: Es gibt kein Dashboard für Ihr Team, kein Reporting zur Leistungskontrolle und keine einfache Möglichkeit, Geschäftsregeln festzulegen (z. B. „Fragen zur Abrechnung immer an einen Menschen weiterleiten“).

-

Kontinuierliche Lernschleife: Das Modell lernt nicht automatisch aus Ihren neuesten Support-Tickets oder aktualisierten Wissensdatenbank-Artikeln. Sie müssten eine komplette Datenpipeline aufbauen, um es aktuell zu halten.

-

Datenschutz: Die Datenschutzrichtlinie von DeepSeek erwähnt, dass Nutzerdaten verwendet werden könnten, um deren Dienste zu verbessern (auch wenn man widersprechen kann), und dass Daten in der Volksrepublik China gespeichert werden. Dies kann für Unternehmen mit strengen Anforderungen an den Datenstandort oder den Datenschutz ein Ausschlusskriterium sein.

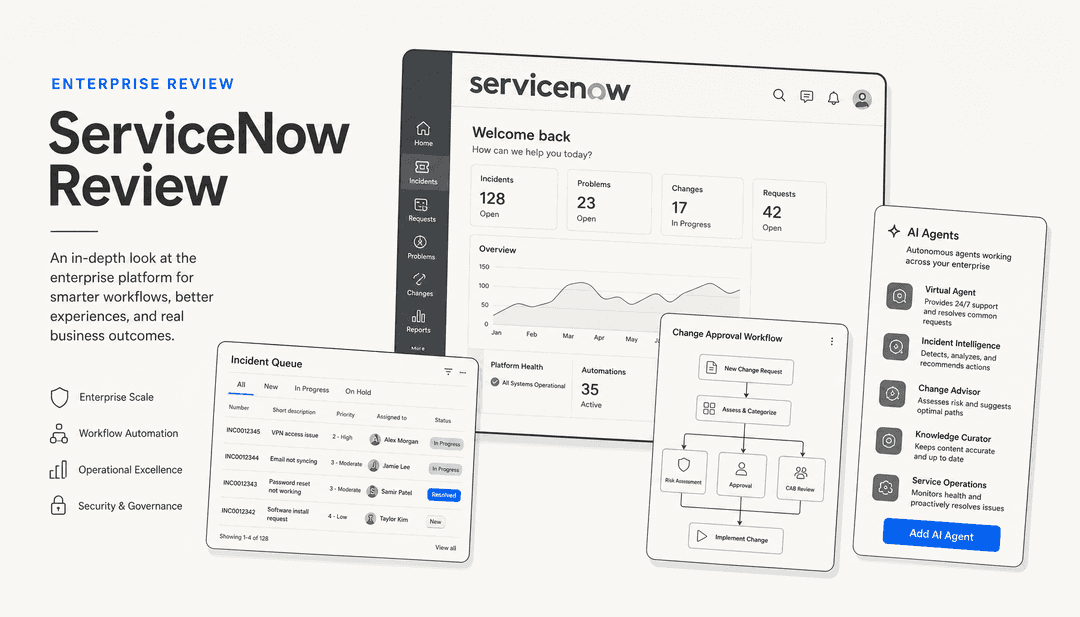

Hier können Plattformen wie eesel AI nützlich sein. eesel bietet eine KI-Lösung für den Kundenservice, die leistungsstarke Modelle integriert. Sie ist darauf ausgelegt, sich mit Geschäftswerkzeugen zu verbinden, von vorhandenen Daten zu lernen und Leistungstests in einer sicheren Umgebung zu ermöglichen, bevor es zur Kundeninteraktion kommt. eesel hat zudem Richtlinien zum Datenschutz, wie etwa die vertragliche Garantie, dass Daten nicht für das Training verwendet werden, und bietet die Datenspeicherung in der EU für Compliance-Anforderungen an.

Ein großer Schritt für offene Modelle

DeepSeek V3.2 stellt eine bedeutende Leistung im Bereich der Open-Weight-Modelle dar und bietet Entwicklern ein mächtiges neues Werkzeug. Es zeigt, dass Hochleistungs-KI immer zugänglicher wird.

Für einen tieferen Einblick in die technischen Errungenschaften und was dieses Modell zu einem potenziellen neuen Spitzenreiter macht, bietet dieses Video von bycloud eine hervorragende visuelle Erklärung der Fähigkeiten.

Die nächsten Schritte lassen sich aus zwei Perspektiven betrachten:

-

Für Entwickler: Die DeepSeek API und die Modelle auf Hugging Face bieten einen direkten Weg, die Fähigkeiten des Modells zu erkunden.

-

Für Unternehmensleiter: Die zunehmende Leistung und Zugänglichkeit von KI-Modellen stellt Unternehmen vor eine Wahl. Sie können entweder interne Lösungen entwickeln oder mit Plattformen zusammenarbeiten, die darauf spezialisiert sind, diese Technologie in sichere und zuverlässige Geschäftswerkzeuge zu integrieren.

Für Unternehmen, die KI zur Support-Automatisierung und Steigerung der Agenten-Effizienz einsetzen möchten, stehen Lösungen wie eesel AI zur Verfügung. eesel ist darauf ausgelegt, sich in Geschäftssysteme zu integrieren und aus Unternehmensdaten zu lernen, um automatisierte Kundenlösungen bereitzustellen – mit berichteten Ergebnissen von bis zu 81 % autonomer Klärung.

Häufig gestellte Fragen (FAQ)

DeepSeek V3.2 zeichnet sich durch seinen „Open-Weight“-Charakter aus, der es Entwicklern ermöglicht, darauf aufzubauen, sowie durch die Verwendung von DeepSeek Sparse Attention (DSA) für eine höhere Effizienz. Das bedeutet, dass es sowohl leistungsstark als auch weniger rechenintensiv ist, insbesondere bei Aufgaben mit langen Kontexten.

Obwohl Sie über die API auf DeepSeek V3.2 zugreifen können, erfordert die effektive Nutzung für geschäftliche Zwecke erhebliche Entwicklungsarbeit. Sie müssten Integrationen zu Ihren bestehenden Tools (wie Zendesk oder Shopify) erstellen, eine Benutzeroberfläche entwickeln und Datenpipelines verwalten. Plattformen wie eesel AI übernehmen dies für Sie und bieten eine gebrauchsfertige Lösung, die von Modellen wie diesem angetrieben wird.

Nein, DeepSeek V3.2 ist nicht kostenlos. Die Abrechnung erfolgt auf Basis der Token-Nutzung über die API. Die Kosten variieren je nachdem, ob Sie den Standard- oder den „Thinking“-Modus verwenden, und können sich bei hoher Skalierung schnell summieren. Während die Modellgewichte für Forscher offen zugänglich sind, ist die kommerzielle Nutzung über die API ein kostenpflichtiger Dienst.

Laut offiziellem technischem Bericht erbringt das Standardmodell DeepSeek V3.2 bei mehreren wichtigen Benchmarks eine Leistung auf Augenhöhe mit GPT-5. Die spezialisierte Version, DeepSeek V3.2-Speciale, übertrifft GPT-5 sogar bei komplexen logischen Aufgaben, was sie zu einem der Top-Wettbewerber im KI-Bereich macht.

Die Haupteinschränkungen sind praktischer Natur. Dem reinen Modell fehlen geschäftsspezifische Integrationen, eine benutzerfreundliche Anwendungsebene und eine automatische Lernschleife. Zudem könnten die Datenschutzrichtlinien, die besagen, dass Daten in der Volksrepublik China gespeichert werden, für Unternehmen mit strengen Anforderungen an den Datenstandort ein Problem darstellen.

Das Standardmodell DeepSeek V3.2 ist ein vielseitiger Allrounder, der Tool-Calling (Funktionsaufrufe) unterstützt und sich daher hervorragend für eine breite Palette agentischer Aufgaben eignet. DeepSeek V3.2-Speciale ist eine hochspezialisierte Version, die für tiefgehendes logisches Denken trainiert wurde und in den Bereichen Mathematik und Programmierung glänzt, jedoch kein Tool-Calling unterstützt und nur für begrenzte Zeit verfügbar ist.

Share this article

Article by

Stevia Putri

Stevia Putri ist Marketing-Generalistin bei eesel AI, wo sie hilft, leistungsstarke KI-Tools in Geschichten zu verwandeln, die Anklang finden. Sie wird von Neugier, Klarheit und der menschlichen Seite der Technologie angetrieben.